# 追加書き込みを増やさない意識で「所在」だけ先に掴む journalctl --disk-usage journalctl -b --no-pager | head # 走行データがDB/ファイルのどちらかを確認 find /var /data /home -maxdepth 4 -type f \( -name "*.db" -o -name "*.sqlite" -o -name "*.log" -o -name "*.pcap" \) 2>/dev/null | head # 取得は“コピー先”を用意してから(原本へ操作を増やさない) # 例: rsyncで読み取り中心に集める、コンテナ内も同様に探索

# まず“媒体の種類”を把握(構成により手段が変わる) # eMMC / UFS / NVMe / NAND(UBI) / SD など # 起動回復を急いで書き換える前に # ・原本のイメージ化(可能ならビット単位) # ・イメージ上でファイルシステム検証 # ・鍵や証跡が絡む場合は設定変更を避ける

# よくある落とし穴 # ・ブートローダ解除で初期化が走る # ・鍵がTPM/HSM/SoC領域にあり、手順を誤ると復号不能になる # 先に確認したいこと # ・鍵はどこにあるか(TPM/HSM/ファイル/外部サーバ) # ・取得対象は“復号後データ”か“暗号化状態の証跡”か # ・車両側/クラウド側のログ突合が必要か

# 例: 分散しやすい保存先 # ・/var/log, journald, log rotation # ・SQLite/ファイルベースDB # ・コンテナ内 / ボリューム / バインドマウント # ・送信待ちキュー(スプール)やクラウド側保存 # 先に「所在マップ」を作り、そこから取得対象を確定する

# 影響範囲チェックの考え方 # 1) いつから欠けたか(時刻の連続性) # 2) どの種類が欠けたか(走行データ/診断/通信/更新) # 3) どこに保存される設計か(OS/アプリ/コンテナ/外部) # 例: ログの容量とローテーションの影響を把握 journalctl --disk-usage ls -lh /var/log 2>/dev/null | head # DB系なら“コピーしてから”整合確認(原本を触らない)

・原本に対して修復(fsck/自動回復)を走らせ、痕跡や未使用領域が書き換わる。

・ブートローダ解除や初期化系の操作で、暗号鍵やデータ領域が消去される。

・権限や設定を無理に変えて監査上の整合が崩れ、証跡として使いにくくなる。

・暗号化やセキュアブートが絡み、鍵の扱いで迷ったら。

・コンテナのボリュームやバインドの追い方が分からない。

・eMMC/UFS/NVMeのどれで、取得手段の選定に迷ったら。

・ログローテーションの設定が不明で、欠損範囲の見積りができない。

・共有ストレージ、コンテナ、本番データ、監査要件が絡む場合は、無理に権限を触る前に相談すると早く収束しやすいです。

・事故・水没・熱の可能性があり、通電判断に迷ったら。

もくじ

- 第1章:ログは取れてるはずなのに、事故の瞬間だけ消える──車載Linuxは「PCの延長」じゃない

- 第2章:AGLの全体像を3分で掴む──IVI/テレマティクス/ECU境界とデータの通り道

- 第3章:まず“壊すな”が最優先──電源断・上書き・OTA更新が復旧を難しくする理由

- 第4章:走行データはどこに残る?──systemd-journald / DLT / アプリログ / カーネル痕跡

- 第5章:eMMC/UFS/NANDのクセ──ウェアレベリングとTRIMが「消去」を前倒しする

- 第6章:A/BパーティションとOSTree・dm-verity──AGL特有のストレージ構成を読み解く

- 第7章:取得フェーズの現場判断──論理イメージ→物理→Chip-offの分岐点

- 第8章:復旧フェーズの実務──ext4/f2fs/ubifs、タイムライン再構成、欠損の扱い

- 第9章:再発防止は設計から──「取り出せるAGL」に寄せるログ/スナップショット設計

- 第10章:帰結:事故対応を夜勤ゲーにしない──走行データ復旧の“勝ち筋”を固定する

【注意】 本記事は一般的な技術情報の提供を目的としています。車載Linux(AGL)環境の走行データ復旧・調査は、機器損傷や上書きリスク、証拠保全、契約条件・法令・安全要件など個別事情の影響を強く受けます。具体的な案件では、株式会社情報工学研究所のような専門事業者への相談をご検討ください。

第1章:ログは取れてるはずなのに、事故の瞬間だけ消える──車載Linuxは「PCの延長」じゃない

「ログは有効にしてあります」「監視も入っています」──それでも、障害や事故の直前・直後だけが抜け落ちる。AGL(Automotive Grade Linux)や車載Linuxを扱う現場では、これが“あるある”として起きます。サーバ運用の感覚で見ると不思議ですが、車載環境は前提が違います。電源断や瞬断が起きうること、ストレージがeMMC/UFSなどのフラッシュであること、アップデートやローテーションが自動で走ること、そして「安全優先で最小限の稼働に寄せる」設計が入りやすいこと。これらが重なると、記録が残る・残らないの境界がシビアになります。

心の中では、こう思ってしまいますよね。

「……肝心な瞬間だけ無いって、結局“見えない”じゃないか」

この疑いは自然です。むしろ健全です。なぜなら、走行データやログは“存在していたはず”でも、保存の仕組みが「バッファ→フラッシュ書き込み」という段階を踏む以上、電源断のタイミング次第で未書き込みの情報が発生し得るからです。さらに車載では、再起動時にログ整理(ローテーションや古いログ削除)が自動で走ることも多く、復旧の観点では「起動させた行為」が痕跡を変化させる可能性があります。

車載で“消えやすい瞬間”が生まれる典型パターン

事実として、ログが欠ける原因は単一ではありません。代表的には次のような要因が組み合わさります。

- 電源断・瞬断で、ユーザ空間のバッファやジャーナルがフラッシュへ反映されない

- 起動時処理でログが圧縮・ローテーション・削除され、目的の期間が押し出される

- フラッシュ特性(ウェアレベリング等)により、削除・更新の結果が“遅れて”効いてくる

- アプリが走行データを別経路(DB、独自ファイル、クラウド送信)で持っており、ログだけ追っても全体像が出ない

つまり、「ログが無い」ではなく「ログだけでは足りない」「取ったつもりでも、取れていない」が現場で起きやすい、という構造です。ここを誤解したまま調査を始めると、復旧のダメージコントロールが難しくなります。

このブログのゴール:復旧“作業”ではなく、復旧“勝ち筋”を固定する

本記事で扱うのは、魔法のコマンド集ではありません。AGL環境で走行データを扱うとき、どこに何が残りやすいのか、何をすると消えやすいのか、どういう順序なら被害最小化になるのかを、エンジニアが再現できる形で整理します。終盤では「一般論の限界」にも触れます。実車・実装・契約・安全要件で判断が変わるため、最終的には株式会社情報工学研究所のような専門家に相談すべき局面が必ず出てくる──その流れが自然に腹落ちする構成にします。

第2章:AGLの全体像を3分で掴む──IVI/テレマティクス/ECU境界とデータの通り道

AGLは車載向けLinuxディストリビューションの一つで、実際の製品では「どのドメインをAGLで担当しているか」によって、残るデータも、取り出せる経路も変わります。ここを曖昧にしたまま復旧に入ると、現場では高確率で迷子になります。

まず押さえるべきは、AGLが置かれる位置づけです。典型的にはIVI(インフォテインメント)や統合コックピット領域で採用され、テレマティクスやゲートウェイに近い構成もあります。一方で、車両制御ECU(安全系)とは境界が明確に分かれていることが多く、走行データの“生成元”がどちら側かで、復旧対象が変わります。

「走行データ」は1種類ではない

走行データという言葉は便利ですが、実務では中身が複数に割れます。例としては次のように分類できます。

- 位置・速度・加速度など、IVI/アプリ側が取得・加工して保存するデータ

- 車両ネットワーク(CAN等)由来のイベントを、ゲートウェイ/収集プロセスが記録したデータ

- 障害や事故の“周辺状況”を示すログ(OSログ、アプリログ、診断ログ)

ここで重要なのは、(1)〜(3)が同じ保存先・同じ寿命で残るとは限らない、という点です。だから復旧の入口で「何が欲しいか」を具体化することが、最短経路になります。

ログ・データの層と“残り方”の見取り図

AGL環境で目にしやすいデータの層を、復旧の観点で整理すると次のようになります(実装により異なるため、あくまで構造理解のための表です)。

| 層 | 例 | 復旧の観点(ポイント) |

|---|---|---|

| OS/サービス層 | systemd、journald、カーネルログ 等 | 永続設定・ローテーション設定・起動で変化する可能性を最初に確認 |

| アプリ層 | アプリ独自ログ、SQLite等のDB、設定ファイル 等 | 走行データが“ログではなくDB”にいることが多い。破損時は整合性回復が鍵 |

| 診断/トレース層 | 診断ログ、トレース、外部出力(USB/ネットワーク)等 | 外部退避があれば最短ルート。無ければ“残りやすい設計”の改善点になる |

この表が示しているのは、「どこに記録があるか」を先に当てると、無駄な作業が減るという事実です。逆に言うと、AGLを“Linuxだから同じ”と見なすと、境界(IVI/テレマティクス/ECU)と層(OS/アプリ/診断)を見落として、調査が遠回りになります。

ここまでの伏線:復旧は“取得の前提条件”で難易度が変わる

次章以降は、実際に「取り出す」段階に入ります。ここで最大の落とし穴は、取得のために起動させたり、ログを見ようとして書き込みを発生させたりして、結果的に痕跡を変化させることです。復旧で大事なのは、最初に場を整えること。つまり、最初の数手で被害最小化の方向へ寄せることです。

第3章:まず“壊すな”が最優先──電源断・上書き・更新が復旧を難しくする理由

復旧や解析の現場で、最初に共有すべき方針は「起動できるなら起動してログを抜く」ではありません。AGL/車載Linuxでは、それが“復旧を遠ざける”ことがあります。ここは経験則ではなく、仕組みの問題です。ストレージやファイルシステム、ログ機構は、動かせば動かすほど状態が変化します。だから最初にやるべきは、作業の歯止めをかけることです。

心の会話:現場の疑いは正しい

「見るだけなら安全でしょ?」と思いたくなります。けれど現実には、見る行為が書き込みを誘発することがあります。

- ログ閲覧や検索のためにサービスを起動し、ログが追記される

- 自動マウントが走り、ジャーナル更新が行われる

- 起動時処理でローテーション・削除が走り、欲しい期間が押し出される

つまり、解析開始前に「保存されていたはずの痕跡」が変わる可能性がある。これは車載に限らずLinux一般でも起きますが、車載は電源断・更新・容量制約が加わるぶん、影響が表面化しやすい、という違いがあります。

取得前に決めるべき“運用ルール”(被害最小化のための手順)

ここから先は、復旧の成功率に直結するため、基本の手順を明文化します(個別環境で調整が必要です)。

- 目的を固定する(何が欲しいのか:走行データ本体/周辺ログ/タイムライン復元 など)

- 書き込みを最小化する方針を決める(可能なら読み取り優先、原本に対して修復をかけない)

- 取得経路を選ぶ(論理取得/ストレージイメージ取得/ハードウェアレベルの取得)

- 取得したコピーに対して解析する(原本に対して診断・修復をしない)

ここで重要なのは、「fsck等で直せば読めるはず」という発想を“原本”に適用しないことです。原本に修復をかける行為は、証拠性や再現性の観点でも、復旧可能性の観点でもリスクが上がります。復旧はスピード勝負になりがちですが、最初の手順を誤ると、後段の工夫で取り返しにくくなります。

なぜ車載フラッシュは“後から効く”のか(上書きが進みやすい構造)

eMMC/UFSなどのフラッシュストレージは、内部で書き込み単位や配置最適化を行います。その結果、ユーザ視点の「このファイルを消した/上書きした」と、物理的に「どこがどう書き換わったか」が直結しません。さらに、ログの追記やローテーションが発生し続けると、内部の空き領域管理が進み、復旧可能性が下がっていく方向に寄りやすい。これは構造上の性質であり、根性で回避できるものではありません。

だからこそ、取得段階では「いかに動かさないか」「いかにコピーを先に確保するか」が要になります。ここまでで伏線は揃いました。次章では、実際にAGL環境で“どこに何が残り得るか”を、ログ系(journald等)と診断系、アプリ保存(DB/ファイル)に分けて、探索の順序を具体化します。

第4章:走行データはどこに残る?──systemd-journald / DLT / アプリログ / カーネル痕跡

ここからは「どこを見ればいいのか」を、復旧の順序として整理します。AGLの“走行データ”は、単一のログにまとまっているとは限りません。OS層・診断層・アプリ層に分散し、保存期間も粒度も別々です。だから現場で起きがちな失敗は、OSログだけ眺めて「何も無い」と判断してしまうことです。逆に、探索の順番さえ定まれば、「残っているものを先に拾う」ことでタイムラインを組み直せる可能性が上がります。

探索の優先順位:外部に出ているもの → 永続領域 → 揮発領域

復旧の現場では、まず「外部に逃げているデータ」が最優先です。クラウド送信、USB退避、診断ツールの吸い上げログ、開発用のトレース出力など、実機を触らずに得られるものは“原本を動かさない”という意味で強いからです。外部に何も無い場合に、初めて車載機内部の永続領域(フラッシュ上のファイル)へ進みます。揮発領域(RAM上にしかないログ)は、電源断が絡むと残らない前提で、設計改善の検討材料として扱うのが現実的です。

systemd-journald:設定次第で「残る/残らない」が決まる

Linuxのログ基盤として広く使われるsystemd-journaldは、設定によって保管先が変わります。永続化が有効ならフラッシュに残りますが、揮発設定だと再起動で消えます。さらに、容量制限とローテーションが設定されているため、長期間の追跡が必要な場合は「痕跡が押し出される」ことがあります。

ここでのポイントは、ログが無いときに「障害が無かった」と結論づけないことです。ログが無いのは、障害が無いのではなく、保持されない設計・保持期間不足・書き込み前電源断など複数の可能性を含みます。復旧では、まずjournaldの保存モード(永続か揮発か)、保存先、ローテーションの実態を確認してから、他レイヤに進むのが合理的です。

DLT(Diagnostic Log and Trace):あるなら最短ルート、ただし運用設計で欠ける

車載の診断ログとしてDLTが使われている環境では、アプリの重要イベントがDLTに集約されている場合があります。この場合、走行データそのものではなくても「走行データが生成・送信・保存された」という事実(いつ、どのコンポーネントが、どの処理をしたか)が追えるため、復旧の手がかりとして非常に強いです。

ただしDLTも万能ではありません。DLTビューアで見えているログが、必ずしもフラッシュに長期保存されているとは限らず、リングバッファ的に短期間で消える構成もあります。さらに、ログ量が増えるとローテーションや圧縮が走り、障害前後のデータが欠けることもあります。DLTは「あるかどうか」だけでなく「どう残す設計になっているか」が勝負です。

アプリログ/DB:走行データがいる確率が高い“本丸”

走行データ(位置・速度・イベントの系列など)が最終的に格納されるのは、アプリ側のDBや独自ファイルであることが多いです。ここはOSログよりも“データそのもの”に近い一方、電源断や容量不足、書き込み中断で破損しやすいという課題があります。典型的にはSQLiteなどの軽量DBが使われますが、DBであればトランザクションやジャーナルの状態によって、復旧の方針が変わります。

復旧の現場では、まず「どのプロセスが、どの保存先に、どんな単位で書いているか」を把握します。設計情報が無い場合は、設定ファイル、ログ、起動スクリプト、プロセス一覧、ファイル更新時刻など複数の痕跡から推定します。ここで焦って“修復”を当てると、状況が悪化することがあります。原本からコピーを確保し、コピー側で整合性確認を進めるのが基本です。

カーネル痕跡:クラッシュ原因の切り分けに効くが、仕込みの有無が大きい

走行データの欠損が、実はカーネルパニックやOOM(Out of Memory)など“OSの停止”に起因している場合、ユーザ空間のログだけでは原因が見えません。このとき役に立つのがカーネル痕跡です。ただし、クラッシュ情報を永続化する仕組み(例:pstoreなど)が仕込まれていないと、電源断で痕跡が消えます。

ここまでで、第1章〜第3章の伏線(「肝心な瞬間が消える」「AGLは境界がある」「まず壊すな」)が、第4章の探索手順へ繋がりました。次章では、フラッシュストレージ特性(eMMC/UFS/NAND)が復旧に与える具体的影響を、誤解しやすい点に絞って整理します。

第5章:eMMC/UFS/NANDのクセ──ウェアレベリングとTRIMが「消去」を前倒しする

車載Linuxの復旧で、PCのHDD時代と決定的に違うのがフラッシュストレージの挙動です。eMMCやUFSの内部では、書き込みの偏りを抑えるためのウェアレベリング、性能維持のためのガベージコレクション、ブロック単位の再配置などが行われます。これらは正常動作のために必要ですが、復旧の観点では「削除や上書きが、見た目以上に進む」方向に働くことがあります。

「消したのに残る」「残したのに消える」理由を誤解しない

フラッシュでは、ファイル削除=即物理消去ではありません。一方で、空き領域管理が進むと、削除済み領域の回収(ガベージコレクション)が走り、結果的に復旧可能性が下がります。つまり、短期的には残っていても、中長期的には内部処理で消えやすい、という性質があります。ここを知らないまま機器を何度も起動・停止・ログ取得していると、復旧チャンスを自分で削っていくことになりかねません。

TRIM/DISCARDの影響:環境によっては復旧を難しくする

TRIM(Linuxではdiscard等)は、削除した領域をストレージに通知して再利用を促進する仕組みです。性能や寿命にはメリットがある一方、復旧の観点では「削除済み領域の再利用が進む」側面があります。運用やマウントオプション、ファイルシステム、ストレージ実装によって挙動が異なるため一概には言えませんが、少なくとも“復旧可能性が上がる方向”の機能ではない、という点は押さえるべき事実です。

現場での対処:最初に“動かさない”理由がここにある

第3章で述べた「まず壊すな」は、精神論ではありません。起動・ログ閲覧・ファイルコピーなどの行為が書き込みを増やし、ウェアレベリングやガベージコレクションの引き金になる可能性があるからです。特に障害直後は、ログが大量に吐かれたり、再起動ループで同じ領域への書き込みが繰り返されたりして、内部処理が加速する場合があります。復旧のダメージコントロールとしては、可能な限り早く“コピーを確保してから”解析へ移るのが合理的です。

誤りやすい判断を防ぐためのチェック項目

復旧前の初動で、次の観点をチェックすると、判断ミスが減ります(個別案件では優先度が変わります)。

- ストレージ種別(eMMC/UFS/NAND)と容量、残容量の逼迫状況

- ファイルシステム種別(ext4/f2fs/ubifs等)とマウントオプション(discard等)

- 再起動回数・再起動ループの有無(ログ増加・書き込み増加の可能性)

- 障害発生直後に何を操作したか(起動、診断、更新、ログ取得など)

次章では、AGLでよく見られるA/Bパーティションや整合性検証(dm-verity等)の考え方が、復旧と取得の手順にどう影響するかを整理します。ここは「見えているOSが“目的のスロット”とは限らない」という落とし穴に直結します。

第6章:A/Bパーティションと整合性検証──更新方式が“痕跡の所在”を変える

車載はアップデートが前提です。そのため、システム領域を二重化(A/B)して安全に切り替える設計が採られることがあります。また、改ざん防止や整合性確保のために、起動時に検証を行う構成もあります。これらは安全性・可用性のために重要ですが、復旧・解析では「見えている世界が1つとは限らない」という現実を生みます。

“今起動している側”だけ見ても全体は分からない

障害が起きたとき、直前まで動いていたシステムがA側で、復旧後に起動しているのがB側、というケースはあり得ます。この場合、起動して確認できるログや設定はB側のもので、事故直前のA側の痕跡とは一致しません。現場でありがちな誤解は、「起動できた側のログを見て、何も無い」と結論づけてしまうことです。実際には、痕跡は“別スロット”に残っている可能性があります。

整合性検証が絡むと“改変しない”の重要度が上がる

起動時の整合性検証は、意図せず状態を変える行為に敏感です。復旧目的であっても、原本側に手を入れてしまうと、起動検証の前提が崩れたり、証跡の再現性が下がったりします。したがって、ここでも基本は同じです。原本は守る。コピーを作って、コピー側で解析する。必要な場合は、構成(どの領域がA/Bで、どこにログやデータが置かれているか)を先に把握し、見るべき場所を外さないようにします。

復旧の観点での“領域の見取り図”を作る

取得や解析を進める前に、最低限「どの領域に何があるか」を整理すると、作業は安定します。たとえば次のように、領域の役割をまとめます。

| 領域 | 役割 | 復旧での注意点 |

|---|---|---|

| システムA/B | OS/ミドル/アプリの実体 | 事故直前の痕跡が“非起動側”にある可能性。起動側だけで判断しない |

| データ領域 | 走行データ、DB、永続ログ等 | 容量逼迫・ローテーション・破損が起きやすい。本丸なので慎重に取得 |

| ブート/検証関連 | 起動設定、検証情報 等 | 不用意な改変で起動不能・再現性低下のリスク。原本保全を優先 |

この章の要点は、「起動できたから分かった」ではなく、「起動できた側は“一部”である」可能性を常に持つことです。次章では、実際の取得フェーズとして、論理取得→物理イメージ→ハードウェアレベルという分岐を、判断基準とともに整理します。

第7章:取得フェーズの現場判断──論理取得→物理イメージ→ハードウェア取得の分岐点

復旧を成功させる鍵は、解析テクニック以前に「取得の選択」を間違えないことです。現場でありがちなのは、時間が無いからと論理取得に寄せすぎて、結果的に痕跡を減らしてしまうこと。逆に、何でも最初からハードウェア取得に振るとコストと期間が膨らみ、意思決定が止まることがあります。ここは“歯止め”と“現実性”のバランスで、最適解を探します。

論理取得が向く条件/向かない条件

論理取得は、OSが起動し、アクセス経路(SSH、サービスモード等)が確立でき、なおかつ「起動による書き込みリスクを許容できる」場合に有効です。たとえば外部退避済みのログを追加で回収する、走行データが確実にアプリDBに保存されていて短時間でコピーできる、といった状況です。

一方、以下のような場合は論理取得だけで完結させるのは危険です。

- 起動が不安定(再起動ループ、ストレージI/Oエラー等)で、書き込みが増える可能性が高い

- 事故直前の数分が重要で、ローテーションや上書きの影響を避けたい

- ファイルシステム破損が疑われ、通常のコピーが途中で止まる

物理イメージ取得が“基準解”になりやすい理由

ストレージをブロックとして取得し、コピー側で解析する方法は、原本を守りながら多角的に調べられる点で強いです。ログの欠損があっても、断片やメタ情報から復元できる可能性が残ります。特に、ファイルシステムレベルで見えない痕跡(削除済み、破損したDBページ等)に踏み込めるのは、物理イメージの利点です。

もちろん、物理イメージ取得にも現場制約があります。取得インタフェース、作業環境、治具、分解の可否、保証や契約の扱い、安全要件などです。ここが一般論では言い切れない部分で、終盤で触れる「一般論の限界」に繋がります。

ハードウェア取得(最終手段)の判断:時間・コスト・成功確率の三角形

起動不能、ストレージI/Oが壊滅的、論理コピーが成立しない場合、ハードウェアレベルの取得が選択肢になります。これは専門性と設備を要し、実施可否は案件条件に左右されます。重要なのは、感情で決めないことです。

「もう手が無いから、全部やってください」

そう言いたくなる局面ほど、ダメージコントロールの観点で、優先順位を付けるべきです。必要なデータの範囲、成功の定義、時間制約、法的・契約的要件を整理し、取るべき手段を決めます。ここは株式会社情報工学研究所のような専門家が介入すると、判断のブレが減り、作業の再現性が上がります。

取得手段の選び方(整理表)

| 手段 | メリット | 注意点 |

|---|---|---|

| 論理取得 | 速い/既存のアクセス経路で実施可能 | 起動や操作が書き込みを増やす可能性。欠損・破損への耐性は低め |

| 物理イメージ | 原本保全と多角解析が両立しやすい | 治具・環境・作業時間が必要。案件条件(分解可否等)の影響を受ける |

| ハードウェア取得 | 起動不能でも進められる可能性 | 高度な専門性・設備・コスト。実施可否は契約/安全/保証条件に左右される |

次章では、取得したデータをどう復旧・再構成するか、つまり「読める形に戻す」と「意味のある順番に並べる」を具体化します。ここで重要なのは、車載は時刻がズレやすく、ログの時刻だけに依存すると誤る、という事実です。

第8章:復旧フェーズの実務──ファイルシステム修復とタイムライン再構成、欠損の扱い

取得ができたら、次は「復旧」です。ここで言う復旧は、単にファイルを“読めるようにする”だけでは終わりません。走行データやログは、単体のファイルではなく、複数の断片(ログ、DB、設定、送信履歴)が組み合わさって意味を持ちます。したがって実務は、(1) 読める形に戻す、(2) 意味のある順番に並べる、(3) 欠損を前提に説明可能な形へ落とす、の三段階になります。

(1) 読める形に戻す:原本ではなくコピーで、段階的に

基本原則は一貫していて、「原本に手を入れない」「コピー側で検証と復旧を進める」です。理由は2つあります。1つ目は、原本の状態を保っておくことで、手法を変えて再挑戦できる余地が残ること。2つ目は、調査・説明の再現性を確保しやすいことです。車載の案件では、技術的な結果だけでなく、社内報告・顧客報告・場合によっては法的観点での説明が求められることがあり、後から「どの時点で何をしたか」を追えることが重要になります。

ファイルシステムは環境により異なります。ext4のようにジャーナリング前提のものもあれば、フラッシュに寄せた設計(例:f2fs)や、NAND向けの仕組み(例:UBI/UBIFS)のように、層が厚いものもあります。ここで大事なのは、一般論として“ひとつの手”で全部が直ることはない、という点です。症状(マウントできない、読み取りエラーが出る、DBだけ壊れている、など)に応じて、やるべきことも避けるべきことも変わります。

(2) タイムライン再構成:車載は時刻がズレる前提で組み直す

走行データ復旧で詰まりやすいのが「時刻」です。サーバのように常時NTP同期されているとは限らず、RTCの精度や起動条件、タイムゾーン設定、電源断の影響で、時刻が飛ぶ・戻る・未初期化になるケースも現場では起こり得ます。そのため「ログのtimestampだけ」で時系列を作ると、誤った因果関係を作ってしまうリスクがあります。

タイムラインを作るときは、複数の“軸”を使います。例えば以下のような情報です。

- ブート回数や起動シーケンスに相当する痕跡(再起動の区切りが分かるもの)

- ログやDBの連番、トランザクションID、単調増加カウンタ

- DLTなど診断ログ側のメタ情報(アプリ起動やエラー発生の順序が追えるもの)

- ファイル更新時刻(ただし時刻ズレがある前提で相対関係として扱う)

要するに、「絶対時刻で正確に並べる」よりも、「相対順序を崩さずに並べる」ことを優先し、最後に絶対時刻へ寄せる、というやり方が現実的です。これは脚色ではなく、車載で時刻が揺らぎ得るという前提に基づく、実務的な組み立て方です。

(3) 欠損の扱い:無理に埋めない、説明可能にする

復旧では、欠けた部分を“それらしく補う”ことはしてはいけません。必要なのは、どこまでが事実として復元でき、どこから先が不明かを線引きすることです。特に、事故・障害対応では「何が分かっていて、何が分からないか」を明確にすることが、後工程(再発防止、設計変更、顧客説明)を安定させます。

たとえば「電源断の瞬間の数秒が欠ける」ような場合、欠けた事実を隠すのではなく、欠損が起きる構造(バッファ未書き込み、ローテーション、フラッシュ内部処理など)を説明し、そのうえで“欠けていても言える結論”と“欠けているから言えない結論”を分けます。ここまでができると、現場のダメージコントロールが一段進みます。

次章では、復旧を「起きてから頑張る」だけにしないために、AGL側を“取り出せる設計”へ寄せる方法を整理します。ここが、夜勤対応を減らすための核心です。

第9章:再発防止は設計から──「取り出せるAGL」に寄せるログ/スナップショット設計

ここから先は、復旧の「作業」ではなく、復旧の「勝ち筋」を固定する話です。現場の本音としてはこうです。

「障害対応のたびに、ログが足りない・時刻が怪しい・取れない、を繰り返したくない」

その感覚は正しいです。復旧は、起きてからの頑張りだけでは限界があります。だから“取り出せる設計”へ寄せます。ポイントは、すべてを保存しようとしないこと。保存すると書き込みが増え、ストレージ寿命や性能、個人情報・機密情報の扱いが課題になります。必要十分な粒度に絞って、歯止めの効いた仕組みにします。

ログ設計の基本:何を残すか(イベント設計)を先に決める

まず決めるのは「何が起きたら困るか」です。走行データそのものより、事故・障害の前後で追いたいのは、典型的には以下です。

- 起動・停止・再起動の区切り(再起動ループや復帰タイミングを説明できる)

- ストレージI/O異常、容量逼迫、DB書き込み失敗など“データが欠ける原因”になり得るイベント

- 走行データの生成・保存・送信の成功/失敗(アプリが何をしたか)

- アップデート(OTA)や設定変更の適用タイミング

このイベント設計が固まると、journald、DLT、アプリログ、外部退避のどこに載せるべきかが決まります。逆に、イベント設計が無いままログだけ増やすと、ノイズが増え、障害時に探せなくなります(ノイズカットが効かない状態です)。

永続化と退避:短期リング+障害時スナップの考え方

車載は容量も書き込み耐性も無限ではありません。したがって、常時フルログを長期保存する設計は現実的でないことが多いです。そこでよく採られるのが、「短期のリングバッファ(一定期間・一定容量)」と、「異常検知時のスナップショット退避」です。

例えば、通常時は一定期間分の重要イベントだけを保持し、異常(クラッシュ、I/Oエラー、データ保存失敗など)を検知したら、関連ログ・関連DB・設定・直近の走行データ断片をまとめて退避します。退避先は、ローカル別領域、USB、あるいはネットワーク経由の収集先など、案件の要件(接続性、セキュリティ、コスト)で変わります。ここは一般論だけでは決められないため、個別設計が必要になります。

時刻の安定化:復旧のために“時刻の説明可能性”を上げる

第8章で触れたとおり、時刻の揺らぎはタイムラインを壊します。完全な時刻精度を保証できない場合でも、最低限「いつからいつまでが同一ブートか」「この順序でイベントが起きたか」を説明できるように、単調増加のカウンタやブートID相当の識別子をログに含める設計は有効です。これにより、時刻が飛んでも順序を再構成しやすくなります。

セキュリティとプライバシー:残すほどリスクも増える

走行データには位置情報や行動履歴など、センシティブな情報が含まれ得ます。また、ログにはトークンや識別子、内部IP、設定値など機密性の高い情報が混ざることがあります。したがって「残せば残すほど良い」ではありません。アクセス制御、暗号化、保持期間、削除ポリシー、開示範囲など、運用と一体で設計する必要があります。

ここまでの設計は、現場の負担を増やすためではなく、障害対応を“軟着陸”させるためのものです。次章では、終盤として「一般論の限界」と「専門家に相談すべき局面」を、押し売りではなく自然に理解できる形でまとめます。

第10章:帰結:事故対応を夜勤ゲーにしない──走行データ復旧の“勝ち筋”を固定する

結論はシンプルです。AGL/車載Linuxの走行データ復旧は、スーパーハックで解決する話ではなく、最初の意思決定と設計で勝ち筋が決まります。具体的には、(1) まず壊さない(原本保全・書き込み抑制)、(2) どこに何があるかを外さない(OS/診断/アプリ/外部退避の層で探索)、(3) タイムラインを複数軸で再構成する(時刻ズレ前提)、(4) 次から取り出せる設計へ寄せる(イベント設計+短期リング+異常時スナップ)、の4点です。

現場の感情に答える:なぜ「また面倒」が繰り返されるのか

「また新しいログ仕組み?」「運用が増えるだけでは?」という抵抗感は、現場が正しいコスト感覚を持っている証拠です。むしろ問題は、ログやデータの取り出しが“属人化”していることです。誰かが詳しいから回っている、夜勤対応で帳尻を合わせている──この状態は、障害が重なると破綻します。

だから、目的は“運用追加”ではなく、“運用の歯止め”です。必要最低限のイベントだけ残し、異常時に自動で必要情報がまとまるようにする。これができると、障害対応は「場を整える」側に寄り、説明と判断が速くなります。

一般論の限界:車載は条件で手段が変わる

ここは重要なので明確に書きます。AGL環境の復旧・調査は、一般論だけで最適解を確定できません。理由は、案件ごとに次の条件が違うからです。

- ハードウェア構成(ストレージ種別、分解可否、取得インタフェース)

- ソフトウェア構成(ログ方式、A/B有無、診断出力、暗号化や整合性検証の有無)

- 運用・契約条件(保証、ベンダ制約、車両の取り扱い、法令・安全要件、機密保持)

- 目的(原因究明、データ救出、証拠保全、再発防止設計など)

同じ「ログが欠けた」でも、やるべき手段は変わります。だから、どこかの手順をそのまま当てはめるのは危険です。一般論は方向性を示すだけで、個別案件の“正解”は設計と判断で決まります。

相談すべき局面:迷ったら、早い段階で専門家に寄せる

復旧は、初動の判断が最も効きます。逆に言うと、初動で誤ると後から取り返すのが難しい。たとえば次の状況では、早期に株式会社情報工学研究所のような専門家へ相談する価値が高いです。

- 事故直前の数分が重要で、起動や操作で上書きが進むのを避けたい

- ストレージI/O異常やファイルシステム破損が疑われ、通常コピーが成立しない

- A/B構成や整合性検証、暗号化の有無が不明で、見るべき領域を外しそう

- 取得・解析結果を、社内外に説明可能な形(再現性、手順、根拠)で残す必要がある

相談のゴールは「全部任せる」だけではありません。現場の運用や製品要件に合わせて、最小コストで被害最小化できる手順へ落とし込むことです。復旧・調査・設計改善は一本の線で繋がっており、そこを通すことで夜勤ゲーから抜けやすくなります。

付録:現在のプログラム言語各種における注意点(AGLの走行データ記録・復旧設計で詰まりやすいポイント)

最後に、AGL/車載Linuxで「走行データを残す」「障害時に取り出す」「後から解析できる形にする」ために、主要プログラム言語ごとの落とし穴を整理します。ここでの指摘は、特定言語を否定する意図ではありません。車載の制約(電源断、ストレージ特性、時刻の揺らぎ、セキュリティ・プライバシー)に対して、どこで事故りやすいかを明確にする目的です。

C / C++

- メモリ安全性:バッファ破壊やUse-After-Freeは、走行データの欠損だけでなく、ログ基盤ごと落ちる原因になり得ます。異常時こそログが必要なので、クラッシュ耐性を意識した設計が重要です。

- ファイルI/O:fsync相当の扱い、バッファリング、エラー戻り値の無視が“事故の瞬間だけ欠ける”状況を作りやすいです。電源断前提で、どこまでを確実に永続化するかを設計で決める必要があります。

- ABI/クロスコンパイル:車載ではツールチェーンやABI差分で再現が崩れることがあります。ビルド条件と依存関係を固定し、解析可能性(後で同じバイナリを再現できる)を確保するのが実務的です。

Rust

- メモリ安全性は強い一方、非同期/並行(async)の設計を誤ると「ログの順序が読めない」「シャットダウン時に未フラッシュが残る」などが起きます。終了処理(flush/close)を“必ず通る”設計が重要です。

- 依存クレート:ビルドサイズや更新頻度が増えると、車載の更新・検証(整合性、署名)との整合が課題になります。バージョン固定とSBOM的な管理があると後工程が楽になります。

Python

- 実行環境依存:Python自体のバージョン、ネイティブ拡張、OS依存が絡むと、車載配布や再現が難しくなります。重要部分はプロセス分離し、落ちてもデータが壊れない設計が必要です。

- 性能とタイミング:走行データの高頻度収集で、GCやI/Oが遅延すると欠損が出ます。取るべき粒度を絞り、リングバッファ化するなど、設計で吸収するのが現実的です。

- 例外処理:例外が握り潰されると「何も起きていないように見える」状態になります。失敗をログに残す設計(成功/失敗のイベント)を先に決めるのが効果的です。

Java / Kotlin(JVM系)

- 停止時間:GCやJITの挙動で、瞬間的な停止が起き得ます。走行データの取りこぼしやタイムラインの歪みに繋がるため、リアルタイム性が必要なら設計で分離する必要があります。

- ファイルI/Oと同期:JVMのバッファリングやログフレームワーク設定次第で、電源断時に欠損が起きます。障害時に残すべき最小イベントは、確実に永続化する経路を確保します。

- 依存管理:ライブラリ更新と車載の署名/検証の整合を崩すと、運用が複雑化します。更新ポリシーと検証手順を固めるのが重要です。

JavaScript / TypeScript(Node.js)

- 単一スレッドのイベントループ:I/O待ちや重い処理で遅延すると、走行データ収集・送信が詰まる可能性があります。重い処理は分離し、ログは非同期でも「順序が追える」形(ID付与など)にします。

- 依存パッケージ:更新頻度が高く、サプライチェーンリスクや再現性の問題が出やすいです。車載では特に、バージョン固定と検証手順が重要です。

- 時刻扱い:タイムゾーンやフォーマットの揺れで解析が困難になりやすいです。ログはISO 8601などで統一し、ブートIDや連番も併記すると再構成しやすくなります。

Go

- 並行処理:goroutineの乱立やチャネル設計の誤りで、終了時にログが落ちる(flushされない)ことがあります。シャットダウンシーケンスを明確にし、重要イベントは確実に吐き切る設計が必要です。

- 静的リンクとサイズ:配布はしやすい反面、バイナリが大きくなると更新・検証の運用に影響します。更新頻度と検証コストのバランスが必要です。

C#(.NET)

- ランタイム依存:デプロイ形態(自己完結/ランタイム依存)で運用が変わります。車載では更新の制約が強いことがあるため、配布・検証の設計が重要です。

- 非同期I/O:async設計で終了時に未処理が残ると、障害直前のログが欠けます。重要イベントは“確実に残る経路”に寄せる必要があります。

Swift

- 主戦場はモバイル寄りですが、車載連携(スマホ連携やUI周辺)でログが分散すると、タイムラインが崩れやすいです。車載側・端末側・クラウド側で相関IDを統一し、後から結合できるようにします。

共通の注意点(言語に依存しない、車載ならではの落とし穴)

- 「成功ログ」だけでなく「失敗ログ」を残す:保存失敗・送信失敗・容量逼迫・I/Oエラーは、走行データ欠損の原因になります。

- 終了処理(flush/close)を“必ず通す”:電源断前提で、どこまでを確実に永続化するかを決め、重要イベントだけは落ちにくくします。

- 時刻が揺らぐ前提で、相関ID・ブートID・連番を付ける:後からタイムラインを再構成しやすくなります。

- セキュリティ・プライバシーを設計に含める:残すほどリスクも増えるため、アクセス制御・暗号化・保持期間を運用と一体で決めます。

以上を踏まえると、個別案件では「どのデータを、どの経路で、どの粒度で、どの期間、どんな保護の下で残すか」を設計し直す必要が出ます。一般論だけで安全に決め切るのは難しいため、具体的な構成・契約条件・安全要件まで含めて検討する段階では、株式会社情報工学研究所のような専門家へ相談し、被害最小化と運用コストのバランスを取ることをご検討ください。

AGL走行データが消失した際の原因特定と復旧手順、法令準拠のデータ管理設計、緊急時のBCP運用体制構築を支援します。

AGL概要と車載Linuxの特徴

Automotive Grade Linux(AGL)は車載組み込みシステム向けにLinuxを標準化するオープンソースプロジェクトです。業界各社や学術機関が連携し、車両制御やインフォテイメント機能を共通プラットフォームで実装することで、開発コストの削減と品質向上を図っています。AGLはYocto Projectを基盤にカスタマイズ性を維持しつつ、厳しい耐振動・耐温度要件に対応できるよう設計されています。

特徴

- Yocto Projectベースの柔軟なビルドシステム

- Linuxカーネルをコアとする安全性重視のアーキテクチャ

- クラウド連携やOTA(Over-The-Air)アップデート対応

AGLの構造は「ハードウェア抽象化層」「カーネル」「ミドルウェア」「アプリケーション層」から成り、各層がモジュール化されています。これにより、車載ECU(Electronic Control Unit)ごとに必要な機能だけを組み込むことが可能です。セキュリティやリアルタイム性の要件にも対応し、業界標準の仕様策定を進めています。

技術担当者はAGLの各層の役割を上司に正確に伝え、導入時のリスクやメリットを明確に説明してください。

AGL導入時のモジュール選定やカスタマイズ範囲で混同しやすい点を整理し、仕様適合性を優先することを心がけてください。

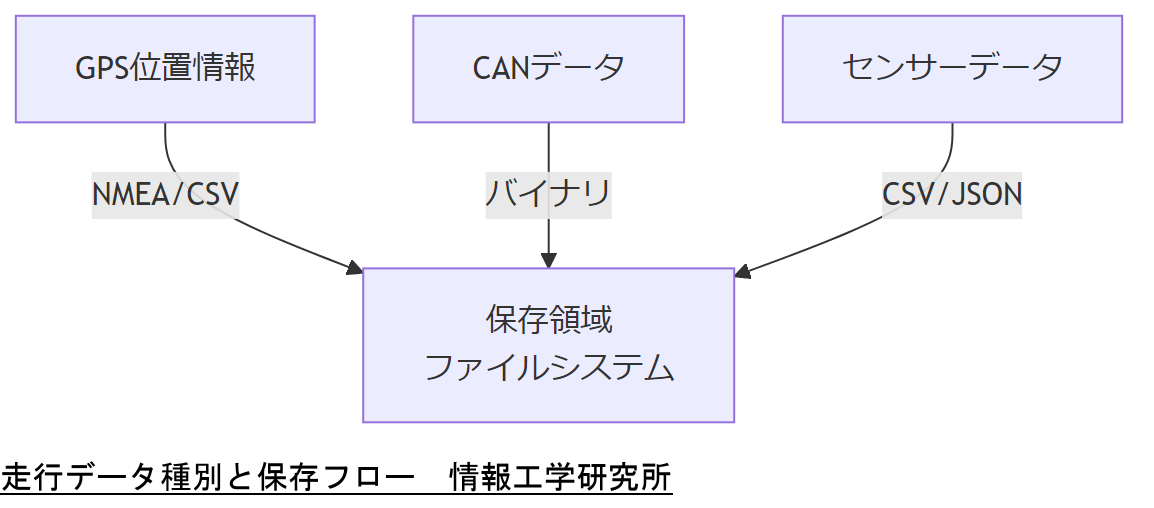

走行データの種類と法的要件

車載システムが記録する走行データには主に以下の3種類があります。GPS位置情報は経路解析や事故調査に必須で、CAN(Controller Area Network)データは車両制御信号や速度・エンジン回転数を示し、センサーデータは加速度やブレーキ・ステアリング操作などを記録します。これらを適切に保存・参照できることが、事故対応や品質保証において法令遵守の観点から必須です。

主な法的要件

- 道路運送車両法:記録装置義務付けと保存期間(最長3年)[出典:国土交通省『道路運送車両法施行規則』2020年]

- 運輸安全マネジメント制度:事業者による定期的なデータ監査と報告義務[出典:国土交通省『運輸安全マネジメント制度ガイドライン』2019年]

- 個人情報保護法:運転者の行動ログに含まれる個人情報の取扱い[出典:個人情報保護委員会『ガイドライン』2017年]

これらを踏まえ、AGL環境ではログファイルのフォーマット統一とタイムスタンプの正確性確保が重要です。たとえば、CANデータはセッションファイルとしてバイナリ形式で出力されることが多く、復旧時にはバイナリ解析ツールが必要です。GPSデータはNMEA形式でCSVなどに変換し、可視化ツールで経路再現を行います。

| データ種別 | フォーマット | 保存期間 | 法令 |

|---|---|---|---|

| GPS位置情報 | NMEA/CSV | 最長3年 | 道路運送車両法 |

| CANデータ | バイナリ/DBC | 最長3年 | 道路運送車両法 |

| センサーデータ | CSV/JSON | 最長1年 | 運輸安全マネジメント |

各データ種別ごとに保存要件が異なる点を、法務部門へ正確に説明し、保存期間管理の責任者を明確にしてください。

フォーマット変換時のデータ欠損やタイムスタンプずれに注意し、解析前に整合性チェックを必ず実施してください。

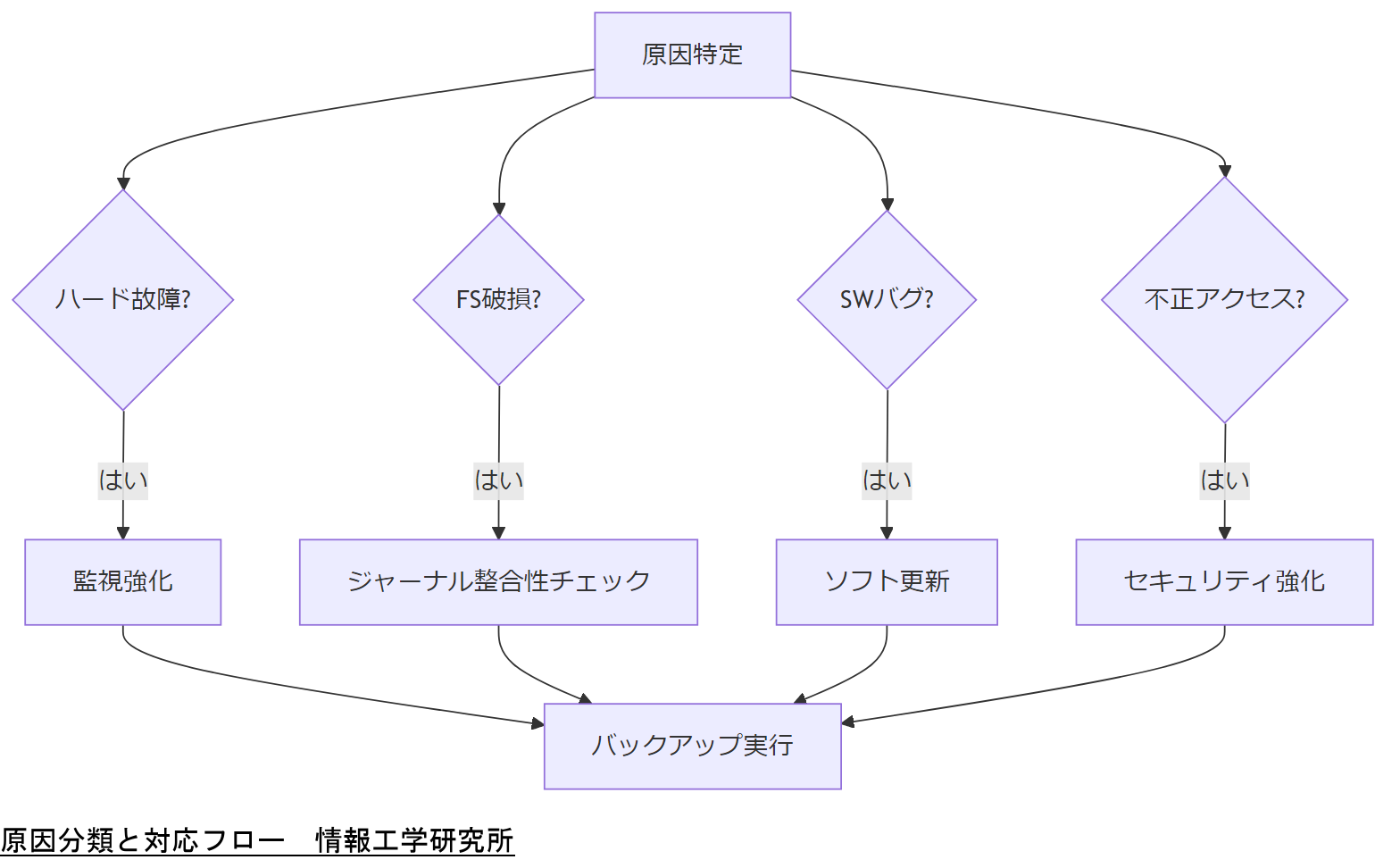

データ消失の原因とリスク評価

AGL環境における走行データ消失は、原因の特定とリスク評価を迅速に行うことで被害を最小限に抑えられます。本章では主な原因を分類し、発生頻度や業務への影響度を評価して対応優先度を明確化します。

主な原因分類

- ハードウェア故障:耐振動試験に合格しても、長期運用でSSDやeMMCの書き込み寿命到達が発生します。

- ファイルシステム破損:電源断や不正シャットダウンによりジャーナリング機能が追いつかず整合性が失われます。

- ソフトウェアバグ:アプリケーション層やミドルウェアのメモリリーク・例外未処理がデータ欠損を誘発します。

- サイバー攻撃・不正改ざん:外部からのランサムウェア感染や不正侵入によるデータ消去リスク。

それぞれの原因について、発生頻度(高・中・低)、影響度(重大・中程度・軽微)をマトリクス評価すると、ハードウェア故障とファイルシステム破損は頻度が高く影響も大きいため最優先で監視・予防策を講じる必要があります。

| 原因 | 発生頻度 | 影響度 | 優先度 |

|---|---|---|---|

| ハードウェア故障 | 高 | 重大 | 最優先 |

| ファイルシステム破損 | 高 | 重大 | 最優先 |

| ソフトウェアバグ | 中 | 中程度 | 高 |

| サイバー攻撃 | 低 | 重大 | 高 |

原因マトリクスを基に、運用部門へ優先的に対策すべき項目を示し、予算・リソースの配分を合意してください。

発生頻度と影響度を正確に評価し、対応漏れや過剰対策を防ぐため、定量的なログ分析を併用してください。

初期診断と即時対応フロー

障害発生後、まずは速やかに状態を把握し、二次被害を防止するための初期診断と即時対応が必要です。本章では、ログ収集から仮復旧までのフローを解説します。

対応フロー概要

- システムログの取得:journalctlやdmesgコマンドで直近ログを抽出

- データ保全モード移行:読み取り専用マウントで書き込み抑制

- 電源管理確認:バッテリー/DC電源の安定供給を確保

- 緊急バックアップ:rsyncによる差分コピー

| ステップ | 目的 | ツール |

|---|---|---|

| ログ収集 | 原因推定 | journalctl, dmesg |

| 読み取り専用化 | データ保全 | mount -o ro |

| 電源安定化 | 連続稼働 | UPS, バッテリー交換 |

| 緊急コピー | データバックアップ | rsync |

初期診断の各ステップで使用するツールと運用フローを運用担当者に周知し、緊急対応手順の理解を得てください。

読み取り専用化のタイミングを誤るとログ不足に繋がるため、ログ収集と読み取り専用化は並行して実施してください。

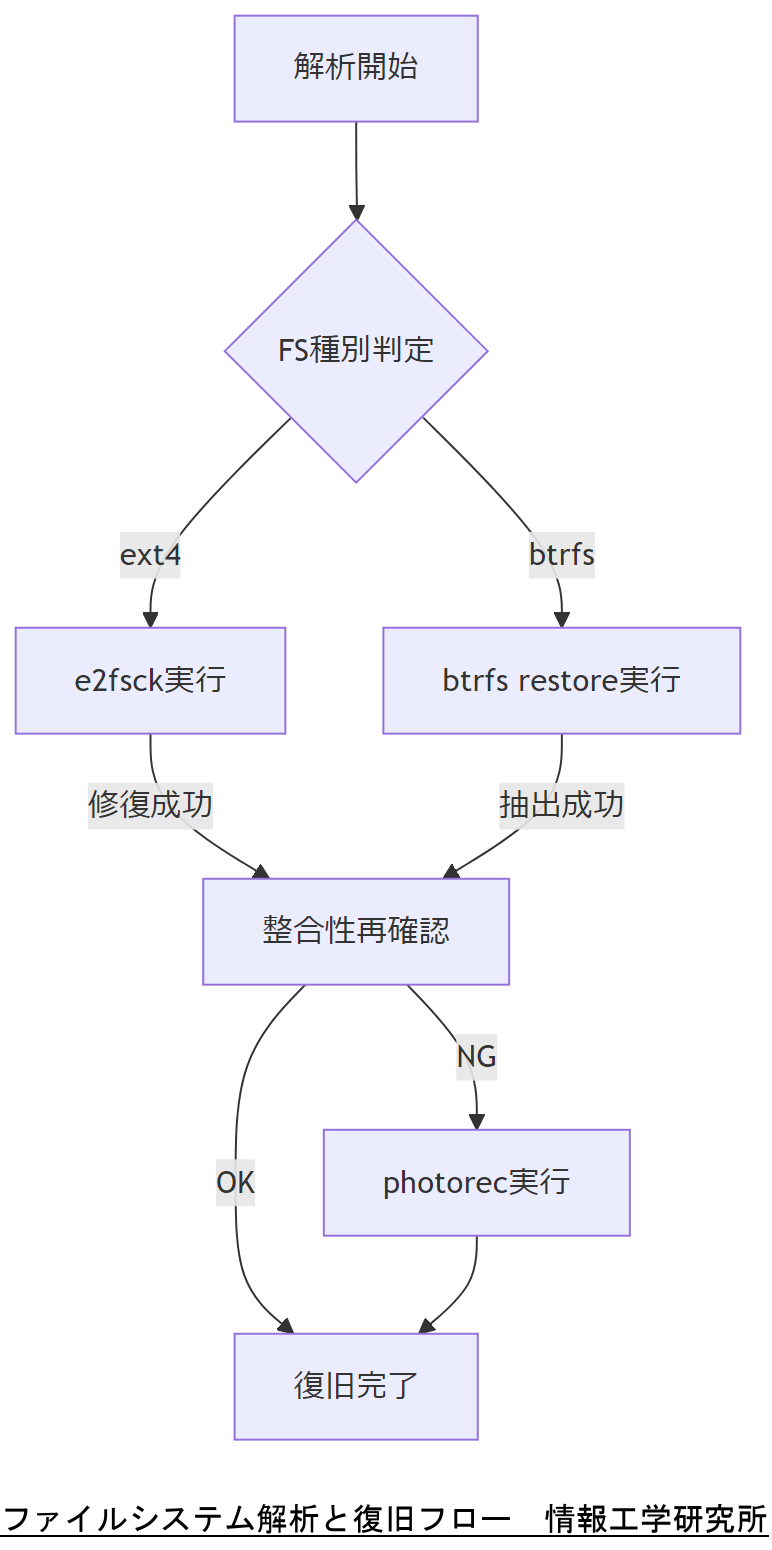

ファイルシステム解析と復旧プロセス

ファイルシステム破損時の復旧は、ジャーナリングの有無やファイル構造に応じた手順を踏むことが肝要です。本章ではext4およびbtrfsを例に、解析ツールと復旧手順を解説します。

解析・復旧ツール

- e2fsck:ext4ジャーナル整合性チェック・修復

- debugfs:メタデータ閲覧および直接ファイル抽出

- btrfs restore:btrfsスナップショットからのデータ抽出

- photorec:ファイルシステム構造を無視したデータ復元

| ツール | 対応FS | 機能 | 備考 |

|---|---|---|---|

| e2fsck | ext4 | 整合性チェック・修復 | オフライン推奨 |

| debugfs | ext2/3/4 | メタデータ操作・抽出 | 読み取り専用で使用 |

| btrfs restore | btrfs | スナップショット復旧 | スナップショット必須 |

| photorec | 汎用 | ファイルヘッダ解析復元 | 構造不明時に有効 |

復旧ツールごとの前提条件とリスクを運用チームに説明し、オフライン解析の実施可否を合意してください。

スナップショット取得忘れやオンライン修復による追加破損を防ぐため、必ず読み取り専用コピーで事前検証を行ってください。

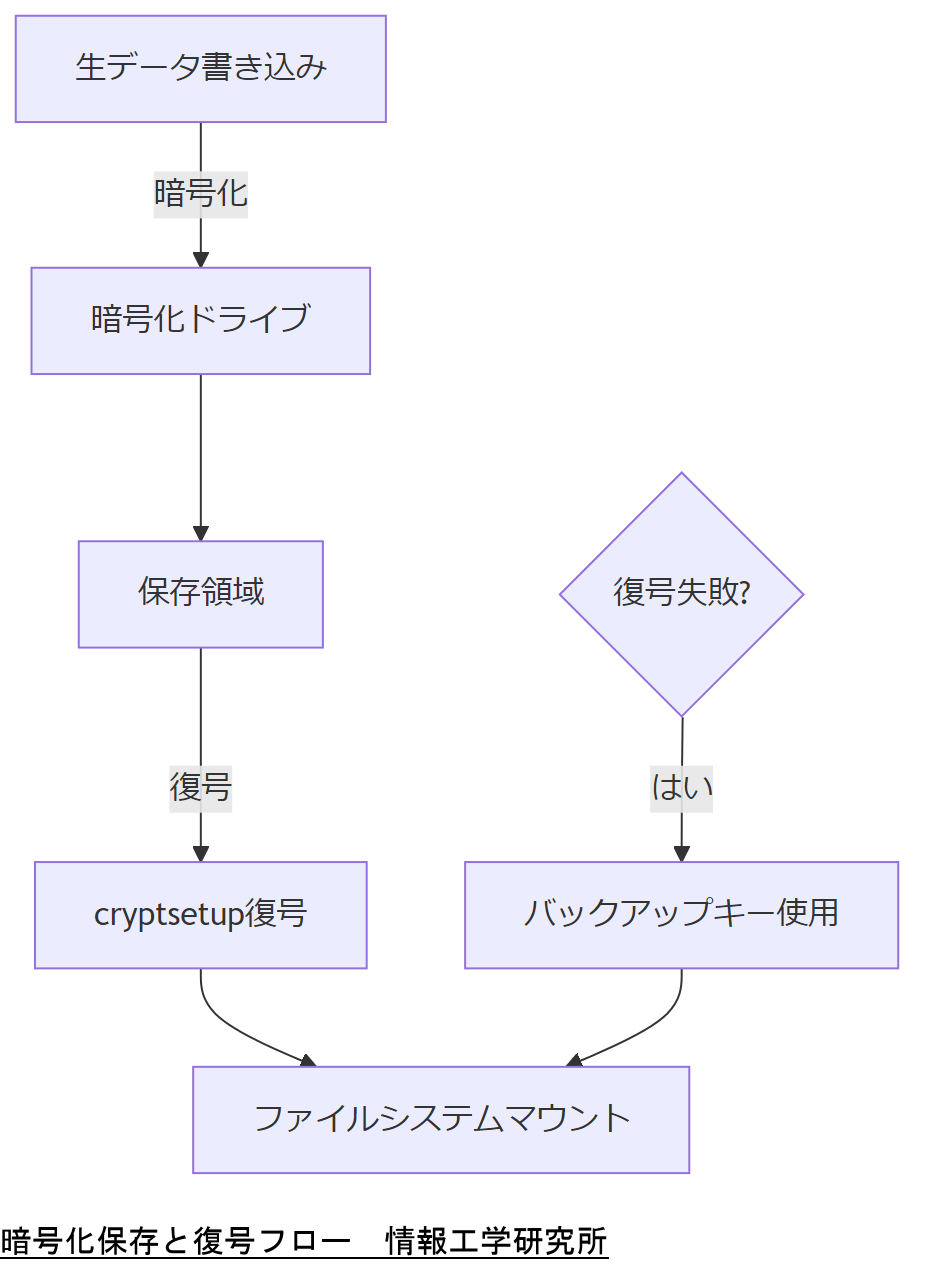

セキュリティ対策と暗号化解除

走行データは不正アクセスや紛失時の情報漏えいを防止するため、保存領域で暗号化を実施します。AGL環境ではLinux標準のdm-crypt/LUKSを用い、AES-256などの強力な暗号化方式を適用します。本節では暗号化設定手順と復号(復旧)プロセスを解説します。

暗号化・復号の流れ

- 初期設定:cryptsetup luksFormat でLUKS領域を作成

- キー管理:パスフレーズまたはTPM連携による自動アンロック

- マウント時復号:cryptsetup luksOpen でデバイスを復号

- 復旧時対応:バックアップキーによるオフライン復号

| 操作 | コマンド | 備考 |

|---|---|---|

| LUKS領域作成 | cryptsetup luksFormat /dev/sdX | 事前にパーティションを準備 |

| デバイス解錠 | cryptsetup luksOpen /dev/sdX cryptdata | マウント前に実行 |

| ファイルシステム作成 | mkfs.ext4 /dev/mapper/cryptdata | 初回のみ |

| オフライン復号 | cryptsetup luksOpen --readonly /dev/sdX cryptdata | 復旧作業時に使用 |

暗号化キーの管理責任者と保管手順をセキュリティ部門と合意し、定期的なキー更新(ローテーション)計画を共有してください。

復旧時にキー紛失リスクが高まるため、バックアップキーのオフライン保管とテスト復号手順を必ず定義・実施してください。

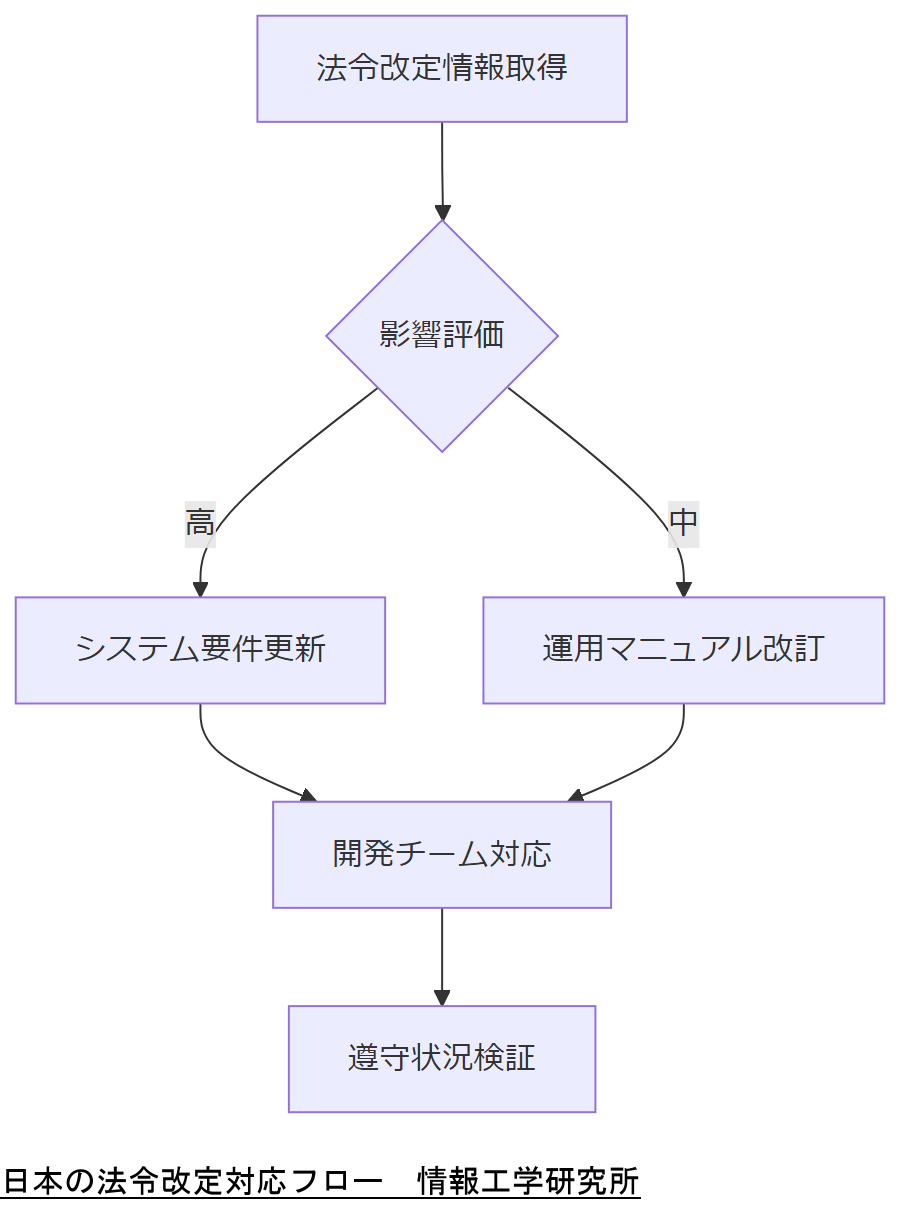

法令・政府方針の最新動向(日本)

車載データ管理では法令や政府方針の動向把握が不可欠です。ここでは近年改定された主要法令とガイドラインのポイントを整理し、AGL環境での準拠事項を明確化します。

最新動向

- 道路運送車両法施行規則改正(2024年10月施行):テレマティクスデータの保存形式・暗号化要件が追加 [出典:国土交通省『道路運送車両法施行規則改正』2024年]

- 運輸安全マネジメント制度ガイドライン改定(2024年4月公表):デジタルログのリアルタイム監視と報告手順の強化 [出典:国土交通省『運輸安全マネジメント制度ガイドライン改定』2024年]

- サイバーセキュリティガイドライン(2023年12月改定):車載システム向け脅威リストと緊急対応プロセスを追加 [出典:内閣サイバーセキュリティセンター『サイバーセキュリティガイドライン』2023年]

| 名称 | 施行・公表日 | 主な改定内容 | 適用範囲 |

|---|---|---|---|

| 道路運送車両法施行規則改正 | 2024年10月 | テレマティクスデータの暗号化・フォーマット義務化 | 全自動車事業者 |

| 運輸安全マネジメント制度ガイドライン改定 | 2024年4月 | リアルタイムデータ監視報告の手順強化 | 運輸事業者全般 |

| サイバーセキュリティガイドライン | 2023年12月 | 車載システム向け脅威リスト追加、対応フロー明示 | 重要インフラ事業者 |

最新法令の改定内容がシステム要件に与える影響を法務・開発部門に提示し、対応スケジュールを承認してください。

改定内容の適用範囲を誤解しないよう、対象車両・サービス区分を明確化し、運用開始前に再評価を実施してください。

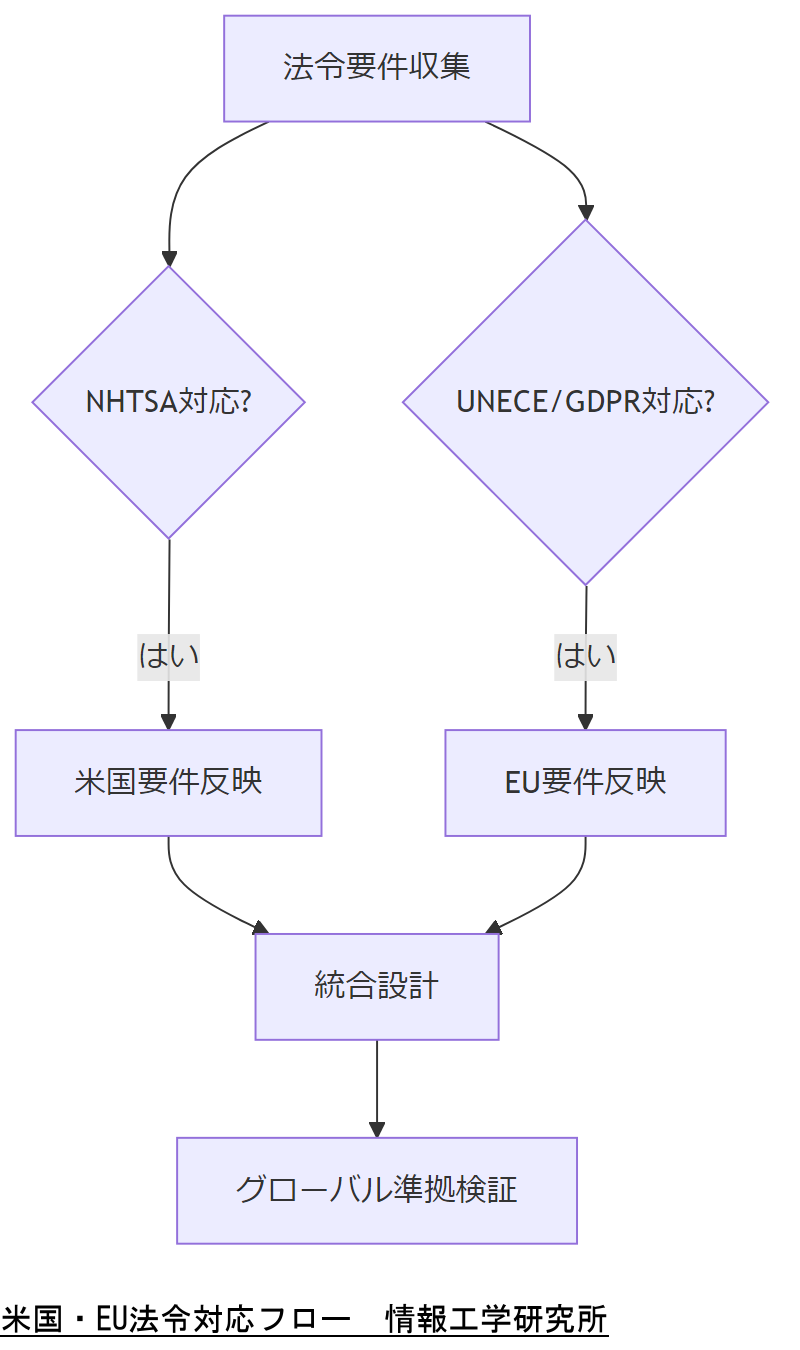

アメリカ・EUの法令・政府方針とインパクト

日本以外でも車載データ管理に関する法令・指針が整備されており、グローバル展開企業は各地域の要件を同時に満たす必要があります。本節では、米国NHTSA指針とEUのUNECE規則およびGDPRが与える影響を整理します。

NHTSA指針

米国運輸省(NHTSA)は2021年に『Cybersecurity Best Practices for Modern Vehicles』を公表し、車載システムのサイバーセキュリティ設計要件を明示しています。リアルタイムログ監視、侵入検知システム(IDS)、暗号化通信の採用などが推奨され、データ復旧時にも改ざん検知機能が求められます。[出典:米国運輸省『Cybersecurity Best Practices for Modern Vehicles』2021年]

UNECE規則とGDPR

国連欧州経済委員会(UNECE)が策定するWP.29規則(自動車サイバーセキュリティおよびソフトウェア更新管理)は2020年に採択され、認証要件を明確化しました。また、GDPR(EU一般データ保護規則、2016年)では個人データの取扱い基準を厳格化しており、走行ログに含まれる位置情報や運転者情報の取り扱いが制限されます。[出典:欧州委員会『UNECE WP.29規則概要』2020年][出典:欧州委員会『一般データ保護規則(GDPR)』2016年]

| 項目 | NHTSA指針(米国) | UNECE/GDPR(EU) |

|---|---|---|

| データ保護要件 | IDS・暗号化推奨 | 認証要件・暗号化必須 |

| ログ監視 | リアルタイム監視義務 | 定期検査レポート提出 |

| 個人情報取扱い | ガイダンス提供 | 厳格な同意取得・消去権保証 |

| 改定時期 | 2021年 | 2020年/2016年 |

米国およびEUの要件差異を法務部門に示し、グローバル共通プラットフォームへの適用方針を合意してください。

地域別規制の統合設計では要件相違による実装漏れを防ぐため、条文対照表を作成し定期的に更新してください。

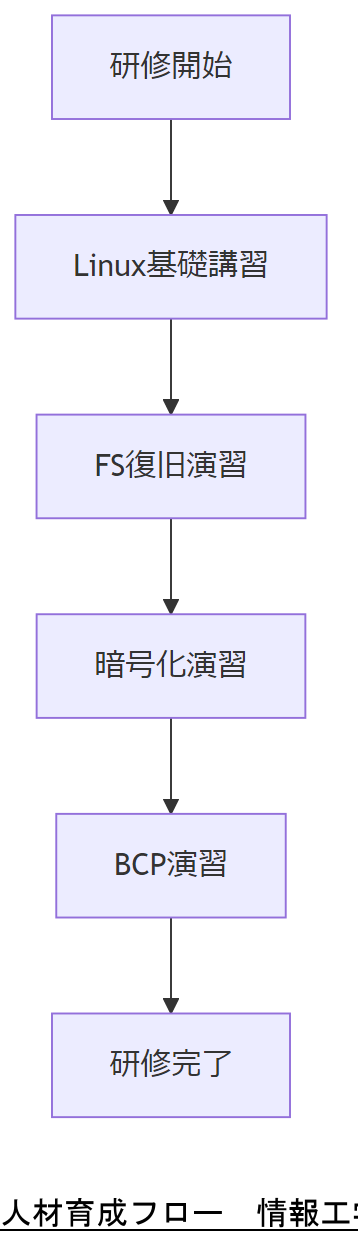

資格・人材育成・募集要件

AGL環境の運用・復旧を円滑に行うには、専門知識を有する技術者の育成と適切な資格取得が不可欠です。本章では必要な公的資格と社内教育プログラム、募集要件のポイントを解説します。

必要な公的資格

- 情報処理安全確保支援士(IPA):セキュリティ監査・運用知識が証明される国家資格[出典:情報処理推進機構『情報処理安全確保支援士制度概要』2022年]

- 電気通信主任技術者(総務省):通信ネットワーク設計・運用管理の専門家認定[出典:総務省『電気通信主任技術者制度』2021年]

- 高度情報処理技術者(IPA):Linuxシステム設計・トラブルシューティング能力を認定[出典:情報処理推進機構『高度情報処理技術者試験要領』2023年]

資格取得のほか、社内研修では以下の内容をカリキュラムに組み込むことが推奨されます。

- Linuxシステム基礎とAGL特有のアーキテクチャ講習

- ファイルシステム復旧演習(ext4/btrfs)

- 暗号化・キー管理の実技ワークショップ

- 緊急時BCP演習とテーブルトップ演習

| 資格 | 取得目安 | 研修項目 |

|---|---|---|

| 情報処理安全確保支援士 | 6か月 | セキュリティ監査演習 |

| 電気通信主任技術者 | 1年 | ネットワーク設計実践 |

| 高度情報処理技術者 | 6か月 | Linuxトラブルシュート |

研修カリキュラムと資格取得計画を人事・教育担当と共有し、受講スケジュールを確定してください。

資格取得後の実務経験を組み合わせることで、知識だけでなく対応力を高める育成設計を意識してください。

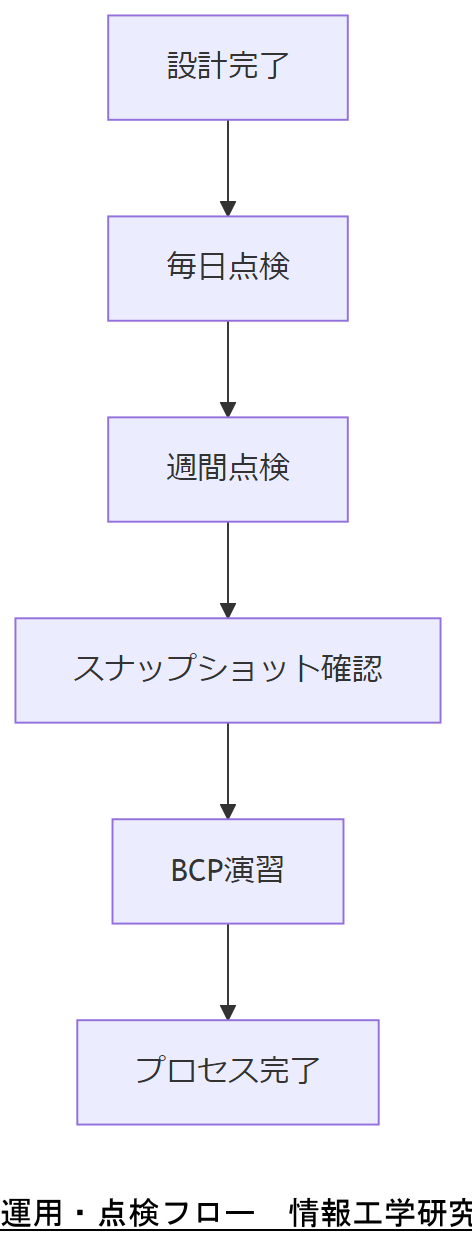

システム設計・運用・点検のベストプラクティス

信頼性と可用性を確保するため、車載Linux環境の設計から日常運用、定期点検まで一貫したプロセスが重要です。本章では冗長構成や監視・点検フローをまとめます。

設計時の留意点

- 冗長化:RAID 1/5構成でディスク故障耐性を向上

- クラスタリング:複数ECU間で負荷分散・フェイルオーバー

- スナップショット:定期的なbtrfs/ZFSスナップショット取得

- ログ集約:syslogサーバとの連携で集中管理

運用・点検フロー

| 頻度 | 項目 | 方法 |

|---|---|---|

| 毎日 | ログ容量チェック | df, duコマンド |

| 週間 | ジャーナル整合性確認 | e2fsck(読み取り専用) |

| 月間 | スナップショットテスト | btrfs send/receive |

| 年次 | BCP演習 | テーブルトップ演習 |

運用・点検フローと担当者を運用部と保守部で共有し、SLA・責任範囲を明確化してください。

定期点検の結果と異常検知のタイムスタンプを帳票化し、運用改善サイクルに組み込むことを徹底してください。

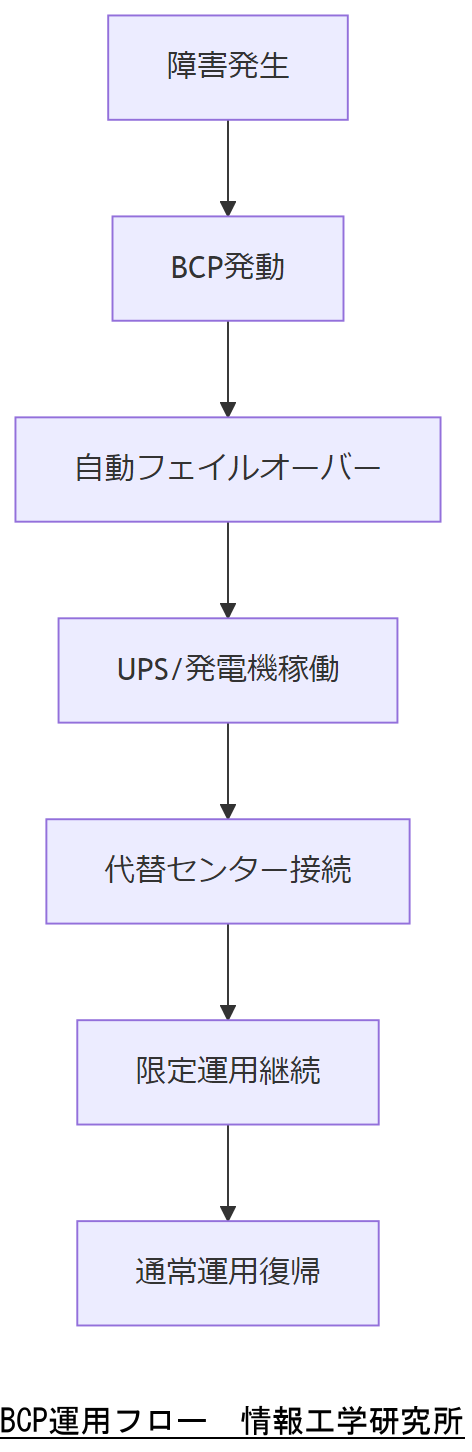

BCPの策定と運用

事業継続計画(BCP)は、緊急時にもシステム稼働を維持し、AGL走行データの可用性を確保するために不可欠です。データ保存は3重化を基本とし、運用は「緊急時」「無電化時」「システム停止時」の3段階に分けた手順を策定します。さらに、10万人以上のユーザーを抱える場合は、フェーズごとにより細分化した対応計画が必要です。

BCP運用フェーズ

- 通常運用フェーズ:定常バックアップ3重化(オンサイト・オフサイト・クラウド)

- 緊急時フェーズ:システム監視で異常検知後、即時フェイルオーバー

- 無電化フェーズ:UPS/非常用発電機による電源維持

- 完全停止フェーズ:代替データセンター/モバイル回線を活用した限定運用

| フェーズ | 主な対応 | 運用ポイント |

|---|---|---|

| 通常運用 | 3重バックアップ実行 | バックアップ整合性チェック |

| 緊急時 | 自動フェイルオーバー | 切替テストの定期実施 |

| 無電化 | UPS/発電機起動 | 燃料・バッテリー残量監視 |

| システム停止 | 代替ネットワーク運用 | 回線切替リハーサル |

BCP各フェーズの責任者と実行手順を事前に共有し、緊急発動時の役割分担を明確にしてください。

3重バックアップの整合性を定期的に検証し、テストフェイルオーバーを通じて想定外の運用障害を未然に防いでください。

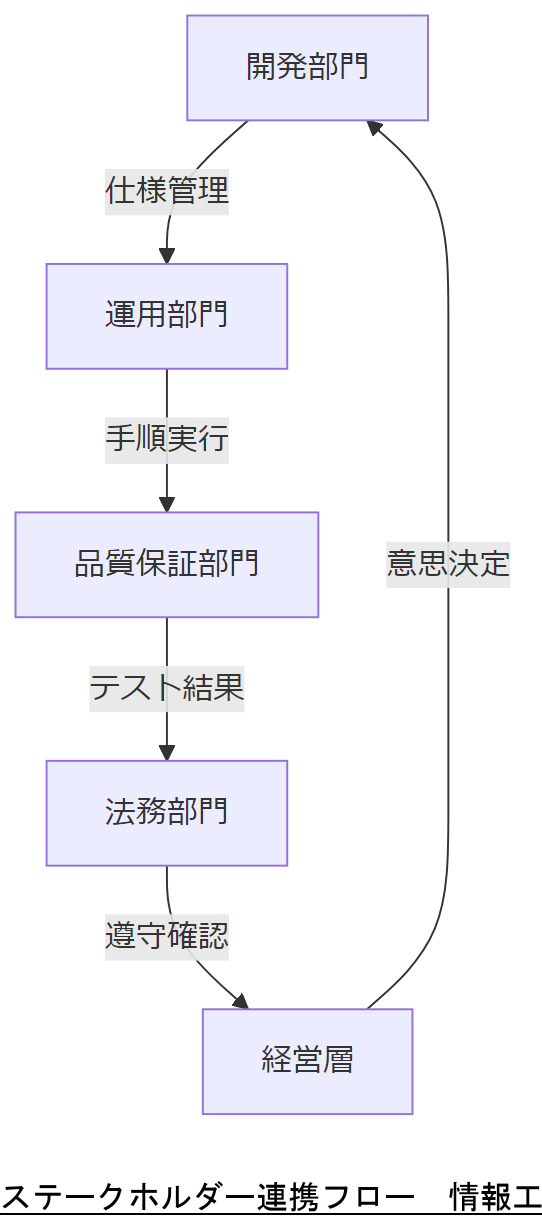

ステークホルダー別注意点

AGL走行データの管理・復旧プロジェクトには、多様な関係者が関与します。各ステークホルダーの役割と注意すべきポイントを整理し、円滑なプロジェクト推進を支援します。

主な関係者と役割

- 開発部門:AGLカスタマイズ/アプリ実装。仕様変更時の影響範囲を把握。

- 運用部門:日常監視と障害初動対応。対応手順の遵守度を定期確認。

- 品質保証部門:テスト計画立案と実施。復旧テストの網羅性を担保。

- 法務部門:法令遵守チェックと契約レビュー。データ保存要件の変更に速やかに対応。

- 経営層:予算承認と方針決定。リスク評価レポートの理解と承認。

| 関係者 | 注意点 | 連携方法 |

|---|---|---|

| 開発部門 | 仕様変更の影響試算不足 | 定例レビュー会議 |

| 運用部門 | 手順逸脱によるデータ損失 | 手順書共有・演習 |

| 品質保証部門 | テストケース漏れ | クロスチェック |

| 法務部門 | 法令改定の見落とし | 定期情報共有 |

| 経営層 | リスク評価情報の理解不足 | 簡易レポート提示 |

各部門の役割と注意点を図示してプロジェクトキックオフ時に全関係者へ周知し、承認を得てください。

関係者間の情報ギャップを防ぐため、定例コミュニケーションチャネルとエスカレーションルールを明確に設定してください。

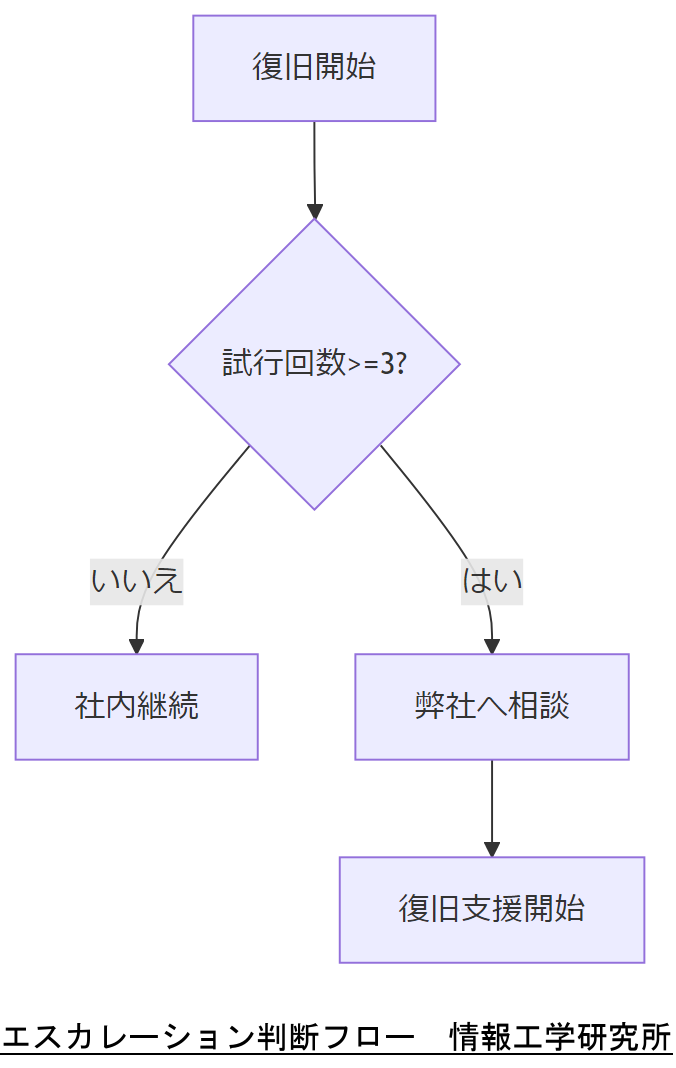

外部専門家へのエスカレーションタイミング

復旧作業中に想定外の障害やスキル不足を感じた場合、適切なタイミングで外部専門家にエスカレーションすることが重要です。本章では判断基準と弊社への相談フローを示します。

エスカレーション判断基準

- 復旧試行3回以上で進捗が得られない場合

- 重要ログの破損範囲が予想以上に広い場合

- 暗号化キーが不明または破損しており、社内復号が不可能な場合

- 法令遵守要件との整合性が判定困難な場合

| 条件 | 社内対応 | エスカレーション |

|---|---|---|

| 復旧試行3回未満 | 継続試行 | 不要 |

| 3回以上失敗 | 一時停止 | 弊社相談 |

| キー管理不明 | 調査継続 | 弊社相談 |

| 法令不明点 | 法務確認 | 弊社相談 |

エスカレーション条件と弊社お問い合わせフォームへの案内手順を運用部門と法務部門で合意してください。

初動判断の遅延を防ぐため、エスカレーション基準を復旧手順書に明示し、実際の演習で検証してください。

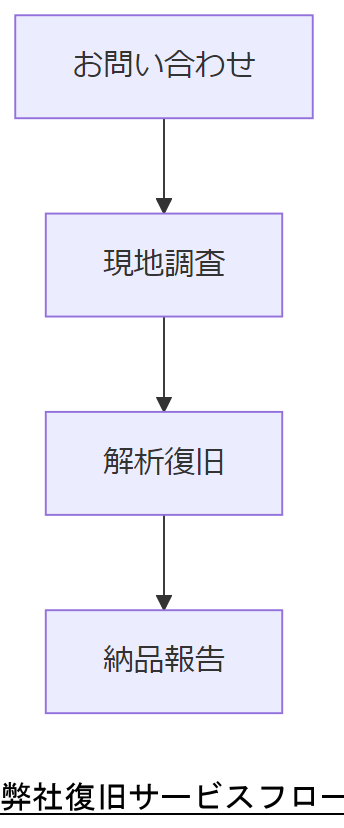

弊社への依頼メリットと流れ

情報工学研究所(弊社)は他社では難易度が高い案件も多数復旧してきた実績があります。本章では弊社にご依頼いただくメリットと、問い合わせから復旧完了までの流れをご紹介します。

依頼メリット

- 高度解析技術:独自開発ツールによる破損データ回収

- 安心の法令準拠支援:最新法令ガイドライン対応

- 迅速対応:現地調査から24時間以内の初動レポート提供

- ワンストップ:解析~復旧~納品まで一貫サポート

| フェーズ | 所要時間 | 主要作業 |

|---|---|---|

| お問い合わせ | 即日 | 障害状況ヒアリング |

| 現地調査 | 1~2日 | デバイス診断 |

| 解析・復旧 | 3~5日 | データ抽出・整合性検証 |

| 納品・報告 | 即日 | 復旧データ納品、報告書作成 |

弊社への依頼メリットとフローを社内稟議資料としてまとめ、経営層へご承認をお願いします。

サービス利用時の想定スケジュールを把握し、内部リソースと調整しながら依頼のタイミングを計画してください。

まとめと今後の展望

本記事ではAGL環境での走行データ復旧に必要な技術要素と運用体制、法令対応、BCP策定、ステークホルダー調整まで網羅しました。情報工学研究所はこれらに精通した技術と経験を活かし、お客様の車載システムデータ復旧を全面サポートします。

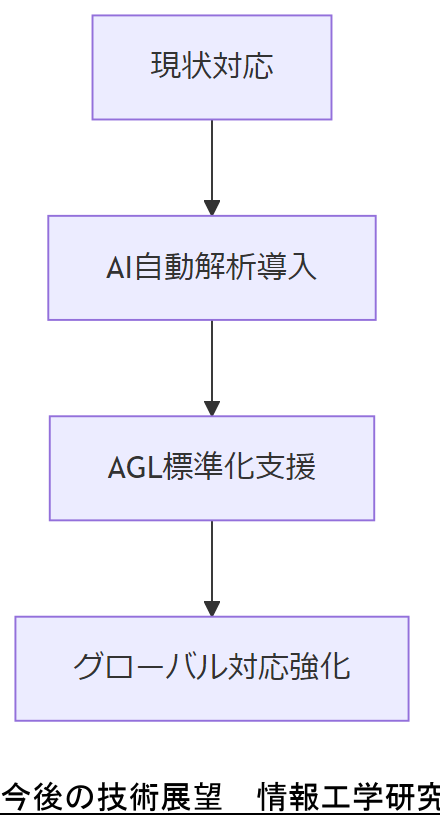

今後の展望

- AI解析の導入:故障パターン自動検知による復旧時間短縮

- 標準化推進:AGL標準仕様の更なる進化支援

- グローバル対応:地域法令変化への迅速対応体制強化

今後検討すべき技術要素を技術戦略会議で共有し、優先的に投資すべきポイントを議論してください。

最新技術導入のタイミングを逸しないよう、技術動向と業務ニーズを定期的にレビューしてください。

はじめに

車載Linuxの重要性と走行データ復旧の必要性 近年、自動車の電子化が進む中で、車載Linux環境の重要性が高まっています。Automotive Grade Linux(AGL)は、そのオープンソースの特性から、多様な車両システムに対応できる柔軟性を持ち、車両の安全性や利便性を向上させる役割を果たしています。しかし、これに伴い、走行データの収集や管理も重要な課題となっています。走行データは、運転行動の分析や車両のパフォーマンス向上に寄与する一方で、データの損失や障害が発生するリスクも存在します。 データが失われると、運転の安全性やサービスの質が低下する恐れがあるため、迅速なデータ復旧の手段を講じることが求められます。特に、車両の運行履歴や故障診断データは、企業にとって非常に価値のある情報であり、適切な管理が不可欠です。この記事では、AGL環境における走行データの復旧方法やその重要性について詳しく解説し、信頼できるデータ復旧業者の役割についても触れていきます。データの安全性を確保し、安心して車両を運用するための知識を深めていきましょう。

Automotive Grade Linuxとは何か?

Automotive Grade Linux(AGL)は、車載システム向けに特化したオープンソースのLinuxディストリビューションです。自動車業界の多様なニーズに応えるため、AGLは各種アプリケーションやサービスを統合し、車両の機能を向上させることを目的としています。AGLの基本的な特徴は、その柔軟性と拡張性にあります。これにより、自動車メーカーやサプライヤーは、さまざまなプラットフォームやハードウェアに対応したシステムを迅速に構築できます。 AGLは、車両のインフォテインメントシステムや運転支援システムなど、さまざまな機能を実現するための基盤を提供します。また、オープンソースであるため、開発者は自由にソースコードを利用し、カスタマイズや機能追加を行うことができます。これにより、ユーザーは最新の技術を迅速に取り入れることができ、競争力を維持することが可能になります。 しかし、AGL環境ではデータの収集や管理が重要です。車両から得られる走行データは、運転行動の分析や車両のメンテナンスに役立ちますが、データが失われるとその価値は大きく損なわれます。したがって、AGLを利用する際には、データの安全性を確保し、万が一のデータ損失に備えた復旧手段を講じることが不可欠です。

車載環境におけるデータ管理の課題

車載環境におけるデータ管理は、様々な課題に直面しています。まず、走行データの取得方法が多様化していることが挙げられます。車両のセンサーやECU(電子制御ユニット)から取得されるデータは、リアルタイムでの処理が求められる一方で、膨大な量の情報を生成します。このため、データの保存や分析にかかる負担が増大し、適切な管理が難しくなります。 次に、データの整合性と信頼性の確保も重要な課題です。走行データは運転行動や車両のパフォーマンスを分析する上で不可欠ですが、データが不完全であったり、異常値が含まれていたりすると、正確な分析ができなくなります。その結果、誤った判断を招く可能性があります。 さらに、セキュリティ面でも懸念があります。車載システムは外部からの攻撃にさらされるリスクが高く、データが不正にアクセスされたり改ざんされたりすることがあります。これにより、運転の安全性が脅かされるだけでなく、プライバシーの侵害にもつながります。 これらの課題に対処するためには、データの管理体制を強化し、適切なバックアップや復旧手段を講じることが必要です。また、データの暗号化やアクセス制御を導入することで、セキュリティを向上させることも重要です。車載環境におけるデータ管理の課題を理解し、対策を講じることが、今後の安全な運行を支える基盤となります。

走行データの解析手法とその利点

走行データの解析手法は多岐にわたり、それぞれに特有の利点があります。まず、基本的な手法としては、データマイニングや機械学習を用いた解析があります。これらの手法は、大量のデータからパターンやトレンドを抽出し、運転行動や車両の性能を評価するのに役立ちます。例えば、運転中の加速やブレーキの頻度を分析することで、運転者の運転スタイルを把握し、安全運転の促進に繋げることができます。 さらに、リアルタイムデータ解析は、車両の状態を常時監視することが可能です。これにより、異常が発生した際には即座に警告を発することができ、事故の未然防止に寄与します。また、走行データを基にした予測解析は、メンテナンスのタイミングを見極めるために有用です。予測モデルを使用することで、故障のリスクを低減し、コストを削減することが期待できます。 加えて、データの可視化技術も重要です。視覚的にデータを表示することで、運転者や管理者は直感的に情報を理解しやすくなり、迅速な意思決定が可能となります。これにより、運転行動の改善や車両運用の効率化が図れます。 走行データの解析手法は、単なる情報収集にとどまらず、運転の安全性や効率性を向上させるための重要なツールです。これらの手法を正しく活用することで、企業は競争力を高め、顧客により良いサービスを提供することができるでしょう。

AGLを活用したデータ復旧のプロセス

AGLを活用したデータ復旧のプロセスは、データ損失が発生した際に迅速かつ効果的に行うことが求められます。まず、データ損失の原因を特定することが重要です。これには、ハードウェアの故障やソフトウェアの不具合、または人為的なミスが含まれます。原因が明確になれば、次のステップとして、データ復旧のための適切な手法を選定します。 AGL環境では、データのバックアップが事前に行われていることが理想的ですが、万が一バックアップがない場合でも、専門的なデータ復旧ツールを利用することで、失われたデータを取り戻す可能性があります。これらのツールは、AGLが使用するファイルシステムに対応しており、効率的にデータをスキャンし、復旧可能なファイルを特定します。 復旧プロセスが進む中で、データの整合性を確認することも欠かせません。復旧されたデータが正確であることを確認するために、データ検証を行うことが重要です。これにより、復旧作業の信頼性が高まり、データの安全性を確保することができます。 最後に、データ復旧後は、再発防止策を講じることが必要です。定期的なバックアップの実施や、システムの監視体制を強化することで、今後のデータ損失のリスクを軽減することができます。AGLを活用したデータ復旧のプロセスは、適切な手順を踏むことで、企業の運行を支える重要な要素となります。

未来の車載システムに向けた展望

未来の車載システムは、ますます高度化し、複雑なデータ処理を必要とする環境へと進化しています。Automotive Grade Linux(AGL)のようなオープンソースプラットフォームは、こうした進化を支える重要な基盤となります。将来的には、AIやIoT技術の導入が進み、より高度なデータ解析やリアルタイムのフィードバックが可能になるでしょう。これにより、運転者はより安全で快適な運転体験を享受できるようになります。 また、データの収集と分析が進むことで、車両のパフォーマンス向上やメンテナンスの効率化が図られることが期待されます。たとえば、走行データを基にした予測分析は、故障の予測やメンテナンススケジュールの最適化に寄与し、運行コストの削減につながります。さらに、データのセキュリティ面においても、暗号化技術やアクセス制御の強化が求められ、プライバシーの保護が重要視されるでしょう。 このように、未来の車載システムは、技術革新と共に進化し続け、データ管理や復旧の手法も同様に進化していくことが予想されます。企業はこれらの変化に対応し、信頼できるデータ復旧業者と連携することで、データの安全性を確保し、安心して運用できる環境を整えることが重要です。

AGLによる走行データ復旧の可能性

Automotive Grade Linux(AGL)は、車載システムにおけるデータ管理の新たな可能性を提供しています。走行データは、運転行動の分析や車両のパフォーマンス向上に不可欠な情報ですが、その価値を最大限に引き出すためには、データの安全性と復旧手段の確保が重要です。AGL環境では、オープンソースの特性を活かし、柔軟なデータ管理が可能となりますが、データ損失のリスクも念頭に置く必要があります。 データ復旧のプロセスは、損失の原因特定から始まり、適切な手法を選定することが求められます。専門的なツールを使用することで、失われたデータを復元し、その整合性を確認することが重要です。また、復旧後には再発防止策を講じることで、今後のデータ損失リスクを軽減することができます。 これからの車載システムは、AIやIoT技術の進化に伴い、さらに高度なデータ解析が可能となり、運転者にとって安全で快適な運転体験を提供することが期待されます。信頼できるデータ復旧業者と連携することで、企業はデータの安全性を確保し、安心して車両を運用できる環境を整えることができるのです。

今すぐAGLの導入を検討しよう!

AGLの導入を検討することで、車載システムの柔軟性と効率性を向上させることが可能です。データの安全性を確保し、万が一のデータ損失に備えるためには、信頼できるデータ復旧業者との連携が欠かせません。AGLを活用することで、リアルタイムでのデータ管理や解析が実現し、運転行動の改善や車両のパフォーマンス向上につながります。特に、走行データの収集と分析は、運行の安全性や効率性を高めるための重要な要素です。 今後の技術革新に対応するためにも、AGLの導入を前向きに検討してみてはいかがでしょうか。データ管理の最適化と復旧手段の確保は、企業の競争力を高める上で不可欠なステップです。専門的な知識が必要な場面でも、信頼できる業者に相談することで、安心して運用できる環境を整えることができます。AGLの導入を通じて、未来の車載システムの可能性を広げ、データの安全性を確保しましょう。

データ復旧におけるリスクとその対策

データ復旧には、いくつかのリスクが伴います。まず第一に、データ損失が発生した際には、迅速な対応が求められますが、適切な手順を踏まないと、さらなるデータ損失を引き起こす可能性があります。例えば、自己流での復旧作業や不適切なツールの使用は、データの上書きや損傷を招くことがあります。そのため、専門的な知識を持った業者に依頼することが推奨されます。 次に、データ復旧ツールの選定も重要です。市販のソフトウェアには多くの選択肢がありますが、すべてがAGL環境に適合するわけではありません。適切なツールを選ぶことで、復旧の成功率が大きく向上します。また、復旧作業中にデータの整合性を確認するためのプロセスも欠かせません。復旧されたデータが正確であることを確認しないと、後々の分析や運用に支障をきたす恐れがあります。 さらに、復旧後の再発防止策も重要です。定期的なバックアップの実施や、システムの監視体制を強化することで、将来的なデータ損失のリスクを軽減できます。データ復旧におけるリスクを理解し、適切な対策を講じることで、安心して車両を運用できる環境を整えることが可能です。

補足情報

※株式会社情報工学研究所は(以下、当社)は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。