ECCメモリエラーは「守れた」サインでもあり、整合性が揺れたサインでもあります

止められないNASほど、観測→影響範囲→最小変更の順で進めると、復旧が“収束”しやすくなります。

今見えているのは「訂正されたECCが増えている」のか、「訂正不能が出た」のか。まずここで、復旧の安全域が変わります。

ケースごとに“やることの順番”を分け、最小変更で進めると後戻りが減ります。

ケースA:訂正可能ECCが増えている(稼働は継続できるが“予兆”が濃い)

# 過去〜現在で「増え方」を見る(突発/漸増で意味が変わる) journalctl -k | egrep -i "mce|edac|ecc|memory" || true dmesg -T | egrep -i "mce|edac|ecc|memory" || true DIMMの位置情報が取れるなら「特定のスロットに偏るか」を確認 #(NAS/OSにより取得手段は異なるため、取れる範囲で“偏り”だけ押さえる) dmidecode -t memory 2>/dev/null | sed -n "1,200p" || true

“増えているが致命ではない”段階は、停止よりも観測と偏りの把握が効きます。バックアップやスナップショットの整合性確認を先に置くと安心です。

ケースB:訂正不能ECC/MCEが出た(再起動・フリーズ・書き込み失敗が混ざりやすい)

# まず“いつから何が起きたか”を固定(監査・説明にも使える) journalctl --since "today" -k | egrep -i "mce|edac|ecc|iommu|ext4|btrfs|zfs|raid" || true 直近にRAID再構築・リバランス・大量書き込みが走っていないか cat /proc/mdstat 2>/dev/null || true ストレージのエラーが混ざっていないか(I/Oエラーは整合性判断を難しくする) dmesg -T | egrep -i "I/O error|timeout|reset|nvme|ata|scsi" || true

訂正不能が出ている場合は、復旧を急ぐほど“判断材料”が消えがちです。状態の固定(ログ/時刻/作業履歴)を先に置くと、後で説明が通りやすくなります。

ケースC:ファイル整合性の不一致が出た(チェックサム/スクラブで検知)

# ZFSの例(環境によりコマンド差あり) zpool status 2>/dev/null || true Btrfsの例(環境によりマウント構成に注意) btrfs device stats / 2>/dev/null || true btrfs scrub status / 2>/dev/null || true

整合性検知が出ているときは、原因がメモリ・ストレージ・転送・電源にまたがります。切り分けを急がず、検知の範囲と再現性を先に押さえると“被害最小化”につながります。

“どのデータが怪しいか”を先に絞れると、復旧の手が速くなります。

- エラー発生時刻の前後で、書き込みが集中した共有フォルダ/ボリュームがあるか

- RAID再構築・リバランス・スクラブ等の重い処理が同時期に走っていないか

- スナップショット/バックアップの直近成功点がどこか(戻れる地点の把握)

- 整合性検証(スクラブ/チェックサム)で不一致が出ている範囲が限定的か

失敗するとどうなる?(やりがちなミスと起こり得る結果)

- 原因が未確定のままRAID再構築を走らせ、負荷で症状が悪化する

- ログ保全を後回しにして、発生時刻・頻度・偏りの証跡が消える

- “正常に見える”データを基準に上書きが進み、整合性の揺らぎが広がる

- 交換と設定変更を同時に行い、どの手当が効いたのか分からなくなる

迷ったら:無料で相談できます

訂正可能ECCが増え続けているが、停止判断で迷ったら。

MCE/EDACログの読み分けができない。

RAID再構築やスクラブを走らせる前に、影響範囲の確度で迷ったら。

共有ストレージ、コンテナ、本番データ、監査要件が絡む場合は、無理に権限を触る前に相談すると早く収束しやすいです。

DIMM交換の優先順位(スロット/本数/検証順)で迷ったら。

整合性検証の結果が“良いのか悪いのか”判断できない。

現場説明と役員報告の言い回しで迷ったら。

情報工学研究所へ無料相談(状況整理から、最小変更での復旧方針まで一緒に詰められます)。

詳しい説明と対策は以下本文へ。

もくじ

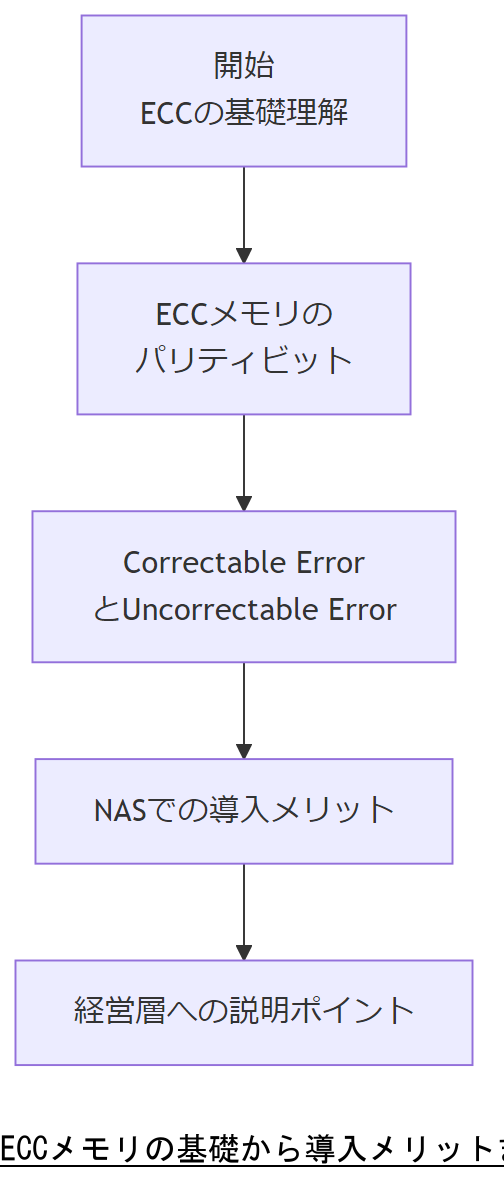

- 第1章:NASでECC警告が出た瞬間に起きていること(“守られた”のか“揺らいだ”のか)

- 第2章:訂正可能ECCと訂正不能ECCの違いが、復旧方針を分ける

- 第3章:止められない現場向けに、まず「影響範囲」を最小コストで見積もる

- 第4章:MCE/EDACログから「いつ・どこ・どれだけ」を読み解く(伏線:部品か環境か)

- 第5章:キャッシュと書き戻しが残す“ズレ”——データ整合性が揺れるポイント

- 第6章:ファイルシステム別の整合性検証線(ZFS/Btrfs/EXT系で見えるものが違う)

- 第7章:RAID再構築が“増幅器”になる条件——やる前に揃えるべき前提

- 第8章:DIMM/スロット/CPU/電源/温度——切り分けを最短化する観測の並べ方

- 第9章:最小変更で復旧する実務テクニック(検証→隔離→交換判断→再検証)

- 第10章:帰結:データの正しさを証明しつつ、再発防止と説明資料まで一枚にまとめる

【注意】 NASのECCメモリエラーは「データが無事」とは言い切れず、状態を悪化させない判断が最優先です。自己流の修理や復旧作業で状況が拡大することがあるため、業務影響・監査要件・復旧要件が絡む場合は株式会社情報工学研究所のような専門事業者に相談し、被害最小化と早期の収束を目指してください。

第1章:NASでECC警告が出た瞬間に起きていること(“守られた”のか“揺らいだ”のか)

ECC(Error-Correcting Code)メモリは、メモリ内のビット化けを検出し、条件によっては訂正まで行います。NASでECC関連のアラートが上がったとき、現場の体感としては「またアラートか」「とりあえず動いているから後で」となりがちです。一方で、責任を持つ立場ほど「この先、データ整合性は大丈夫か」「上司にどう説明するか」「止められないのに、何を優先すべきか」と、判断の重さが一気に増します。

ここで最初に切り分けたいのは、ECCが“守った”アラートなのか、“守り切れなかった可能性”を含むアラートなのかです。一般に、訂正可能(Correctable)なエラーは「ECCが訂正できた」ことを意味し、即時の停止を必ずしも要しません。ただし、発生頻度が増えている場合は部品劣化・熱・電源品質・接触不良などの予兆になり得ます。訂正不能(Uncorrectable)なエラーやMCE(Machine Check Exception)を伴う記録は、プロセス異常終了や再起動、書き込み失敗と同時期に現れることがあり、データの正しさに関する説明責任が一段上がります。

本記事は「自分で修理する手順」を煽るのではなく、30秒で争点を絞り、最小変更で安全な初動を取り、依頼判断ができる状態に整えることを目的にしています。最初に、症状と行動の対応を“見える化”します(環境差があるため、最終判断は個別状況での確認が前提です)。

| 症状(よくある入口) | まず取るべき行動(安全な初動) | 相談を急ぐ目安(依頼判断) |

|---|---|---|

| ECCの訂正可能エラーが散発 | 発生時刻・頻度・増加傾向を記録し、同時期の高負荷処理(再構築/スクラブ/バックアップ)有無を確認する | 短期間で増加、特定時間帯に集中、温度/電源イベントと同時、業務停止できない |

| 訂正不能ECC/MCEの記録 | ログ保全(時刻・該当ノード・再起動有無)を優先し、整合性検証の範囲を把握する(広げない) | 再起動/フリーズ/書き込み失敗が併発、複数ノードで発生、監査や顧客影響の説明が必要 |

| 整合性検証で不一致(チェックサム/スクラブ) | 不一致の対象・範囲・再現性を押さえ、バックアップの“戻れる地点”を確認する | 不一致が増える、重要データ領域、復旧優先順位が決められない |

| RAID再構築中/直後に警告 | 再構築が“増幅器”になり得る前提を確認し、無理に作業を追加しない(状況固定) | 再構築が長期化、I/Oエラー混在、業務側のタイムリミットが迫る |

次に「依頼判断」に寄せた基準を置きます。現場が楽になるのは、判断が曖昧なまま時間を溶かすことではなく、最小の追加情報で“収束方向”を決められる状態です。

- 訂正不能ECC/MCEが記録され、再起動・フリーズ・書き込み失敗など運用影響が見えている

- 整合性検証(スクラブ等)で不一致が出た、または不一致の有無を確認できない

- RAID再構築やリバランスの最中で、追加の判断ミスが致命傷になり得る

- 共有ストレージ/本番データ/監査要件が絡み、説明責任(時刻・範囲・再発防止)が必要

上のいずれかに当てはまる場合、一般論だけで意思決定すると、対処が空回りして“抑え込み”が効かないことがあります。状況整理から相談したい場合は、問い合わせフォーム(https://jouhou.main.jp/?page_id=26983)または電話(0120-838-831)で株式会社情報工学研究所への相談を検討してください。

第2章:訂正可能ECCと訂正不能ECCの違いが、復旧方針を分ける

ECCアラートを読むうえで、最初の分岐は「訂正可能(Correctable)」か「訂正不能(Uncorrectable)」かです。訂正可能は、メモリ内で検出されたビットエラーがECCの冗長情報で訂正できたことを示します。一方で訂正不能は、訂正に必要な情報が不足していた、または複数ビットが同時に壊れたなど、訂正しきれない状態を含みます。後者は、OSやCPUの保護機構が例外(MCEなど)として扱い、プロセス停止や再起動に至ることがあり、データ書き込みの途中で状態が途切れた可能性も考慮が必要です。

ただし、訂正可能=安全、訂正不能=即アウト、という単純化は危険です。訂正可能でも短期間に急増する場合は、DIMMやスロット接触、電源品質、温度上昇、マザーボード側の問題など、物理レイヤの悪化を示すことがあります。ここで重要なのは「増え方」です。散発で横ばいなのか、週単位で増加傾向なのか、特定時間帯(バックアップや再構築の時間)に偏るのかで、読み方が変わります。

現場の“納得”に必要なのは、用語の暗記ではなく、意思決定に効く整理です。NASのECC問題で実務的に影響が出やすいのは、次の3点です。

- 稼働継続の可否:再起動・フリーズ・アプリ異常終了が出ているか

- データの正しさ:チェックサム不一致、復元不能、整合性検証での異常があるか

- 説明責任:いつから、どの範囲で、どの程度のリスクがあるかを根拠付きで語れるか

この3点のどれかが欠けると、現場は“空気が過熱”しやすくなります。上司・関係部署・顧客への説明に耐える材料が不足し、議論が膨らみ、判断が遅れて結果的に損失や流出リスクを高める、という悪循環に入ります。だからこそ、次章以降で扱う「影響範囲の見積もり」と「観測の並べ方」が、最短での収束に直結します。

なお、Linux系NASではEDAC(Error Detection and Correction)やMCEのログとしてカーネルログに痕跡が残ることが多い一方、NASベンダーの管理画面では抽象化されて「ECCエラー」「メモリ異常」としか出ないこともあります。情報が薄いほど、やるべきことは“作業”ではなく“状況の固定”です。発生時刻、機器名、直前直後の運用イベント(再構築、スクラブ、バックアップ、ファーム更新)を残すだけでも、原因切り分けの精度が上がります。

個別環境のログ粒度・保全要件・運用制約によって最適解は変わります。早い段階で“選択肢の地図”を作りたい場合は、株式会社情報工学研究所のような専門家に状況を共有し、被害最小化の軟着陸プランとして整理するのが現実的です。

第3章:止められない現場向けに、まず「影響範囲」を最小コストで見積もる

レガシーな既存システムほど「止められない」が前提になります。ECCアラートが出ても、すぐに全停止や大規模な切替は現実的ではありません。ここで現場が求めているのは、豪快な復旧ではなく、最小変更で状況を落ち着かせ、関係者が納得できる判断材料を揃えることです。その第一歩が「影響範囲」を見積もる作業です。

影響範囲とは、単に“どのサーバが怪しいか”ではありません。どのデータ領域が書き込み集中していたか、整合性検証の結果がどの範囲で揺れているか、バックアップやスナップショットの“戻れる地点”がどこか、そして業務の優先順位がどうなっているかまでを含みます。ここを曖昧にしたまま次の手を打つと、やることが増えるわりに判断が前に進まず、ダメージコントロールが効きにくくなります。

影響範囲を最小コストで押さえる観点は、次の4つです(具体的なコマンドや画面操作は環境差が大きいため、ここでは観点を中心に述べます)。

- 時刻の固定:ECCアラート発生時刻の前後に、再構築・スクラブ・バックアップ・大量転送などのイベントがあるか

- 対象の固定:単一ノードか、複数ノードか、特定シャーシだけか(水平展開の是非が変わる)

- データ領域の固定:重要共有フォルダ、VMストア、DB領域など、書き込みが集中した箇所がどこか

- 戻れる地点:バックアップ/スナップショットが直近いつ成功しているか(戻す/戻さない判断の起点)

この段階で大切なのは、作業を増やさないことです。現場では「とにかく動かす」方向に引っ張られますが、復旧局面では“ノイズカット”が効きます。判断に必要な情報を集めるために行動し、その行動が環境へ与える影響を最小にする。これが結果的に復旧を早めます。

影響範囲の見積もりができると、説明が変わります。たとえば「ECCが出たので危ない」ではなく、「この時刻帯にこの領域へ書き込みが集中しており、整合性検証の結果はここが要確認。戻れる地点はここまで。よって、追加の変更は抑え込み、まずこの範囲の健全性確認を優先する」と言えるようになります。役員や上司に対しても、感情論ではなく“判断の土台”として提示できます。

一方で、監査要件や対外説明が絡む場合、一般論のテンプレだけでは不足します。ログの保全範囲、証跡の扱い、復旧の優先順位、再発防止策の粒度などは案件ごとに異なり、ここを誤ると社内調整・対人コストが跳ね上がりやすいです。個別事情を踏まえた軟着陸の設計が必要だと感じた時点で、株式会社情報工学研究所への相談・依頼を検討すると、収束までの道筋が見えやすくなります。

第4章:MCE/EDACログから「いつ・どこ・どれだけ」を読み解く(伏線:部品か環境か)

ECCメモリエラーが疑われる場面では、「症状の説明」と「原因の切り分け」を同時に進めようとして破綻しやすくなります。そこで先に、“説明の骨格”になる3点だけをログから押さえると、現場の会話が収束しやすくなります。3点とは、発生時刻(いつ)、発生箇所の偏り(どこ)、増え方(どれだけ)です。これが揃うと、部品起因か、温度・電源・負荷など環境起因かの見立てが立ちやすくなります。

Linux系NASでは、EDAC(Error Detection And Correction)やMCE(Machine Check Exception)の情報がカーネルログに残ることがあります。ベンダーUIが抽象化していても、OS側やBMC(Baseboard Management Controller)のイベントログに痕跡が残ることがあり、そこが判断材料になります。特に、同じ時間帯にCPU例外や再起動が混ざっているか、特定のメモリチャネルやスロットに偏っているかは、復旧方針(部品交換の優先順位、負荷のかけ方、検証の順)に直結します。

「どこ」が取れると、対処が最小変更になる

“どこ”の情報は、ログにより粒度が異なります。MCEログではCPUバンクやアドレス情報が出ることがあり、EDACではメモリコントローラやDIMMを示唆する表現が出ることがあります。ただし、NASの実装やカーネル設定、仮想化レイヤの有無で出方が変わります。ここで大切なのは、完全な特定に固執しないことです。「特定スロットに偏っている可能性が高い」「ノードをまたいでいる」など、運用判断に効く粒度で十分なことが多いです。

また、BMCのSEL(System Event Log)やセンサログは、OSログが薄い時の補助線になります。温度上昇、電圧揺らぎ、ファン異常などが同時刻に記録されている場合、メモリ単体の劣化と決め打ちするより、環境要因(熱・電源・接触)の寄与を疑う方が、被害最小化につながりやすいです。

「どれだけ」は“増え方”を見る(単発と漸増で意味が違う)

訂正可能エラーが「一定期間ほぼゼロ→急に増え始めた」のか、「以前から散発→最近増えている」のかで、現場の打ち手が変わります。前者は突発要因(冷却・電源・作業・移設・負荷変化)との相関が探りやすく、後者は部品劣化や接触のゆるみなど、時間とともに悪化する要因を疑いやすいです。いずれの場合も、発生時刻と運用イベント(再構築、バックアップ、スクラブ、重いETL、VM移動など)を並べるだけで、説明の説得力が上がります。

現場説明に使える「ログの出どころ」整理

| 観測ポイント | 主な出どころ | 読み取りの要点 |

|---|---|---|

| ECC訂正(Correctable) | OSカーネルログ、EDAC、ベンダーUI | 頻度・増加傾向・偏り(特定ノード/時間帯)を見る |

| 訂正不能/CPU例外(MCE等) | OSカーネルログ、クラッシュログ、再起動履歴 | 再起動・フリーズ・I/O異常と同時刻かを押さえる |

| 熱/電源/ファン | BMC/SEL、センサログ、ラック/UPS | “環境起因”の伏線になる(移設・高負荷との相関) |

ここまで整理できると、次に必要なのは「データ整合性が揺れうる経路」を把握することです。次章では、メモリエラーが“データそのもの”に影響し得る場面を、キャッシュと書き戻しの観点で現実的に整理します。

個別のNAS機種・OS・ストレージ構成でログの見え方は変わります。説明責任(監査・顧客報告・社内稟議)が絡む場合は、一般論だけでは穴が残りやすいため、株式会社情報工学研究所への相談・依頼を検討すると、判断材料の不足を穴埋めしやすくなります。

第5章:キャッシュと書き戻しが残す“ズレ”——データ整合性が揺れるポイント

ECCがあると「メモリ起因の事故は起きにくい」と期待されがちですが、運用現場で怖いのは“壊れ方が分かりにくい”ことです。メモリエラーが訂正されたのか、訂正しきれず例外として処理されたのか、あるいは別経路(CPU・バス・電源・ストレージI/O)で揺れたのか。ここが曖昧だと、復旧作業が増えるほどノイズが増え、整合性の判断が難しくなります。

データ整合性が揺れる経路を現実的に捉えるうえで、キャッシュと書き戻し(writeback)の観点が役立ちます。NASはネットワーク越しに多数のクライアントから書き込みを受け、OSページキャッシュ、RAID層、ファイルシステム、ストレージ装置(SSD/HDD)のキャッシュなど、多層で“まだ確定していないデータ”を抱えています。メモリ周りが不安定な局面では、この“確定前の領域”が広いほど、説明と復旧が難しくなりやすいです。

「正しいはず」が崩れる場面は、だいたい“確定前”にいる

例えば、アプリが書き込んだつもりのデータが、まだディスクへ確定していない段階でノードが再起動すると、データそのものではなくメタデータ(ファイルサイズ、ディレクトリエントリ、ジャーナル状態)が不整合になることがあります。ジャーナリングは整合性を高めますが、万能ではありません。さらに、バックアップやレプリケーションが同時に走っていると、“揺れた状態”が別媒体へ転写されるリスクもあります。だからこそ、影響範囲の見積もりと、戻れる地点(バックアップ/スナップショット)の把握が先に効いてきます。

ファイルシステムの設計思想で「見える事故」が変わる

チェックサムを広く活用する設計(例:ZFS、Btrfsの一部運用)では、読み出し時やスクラブで不一致として顕在化しやすく、“気づける事故”になります。一方、チェックサムが限定的な構成では、アプリケーション層まで到達して初めて違和感になることがあり、現場では「いつから壊れたのか」が説明しにくくなります。ここで重要なのは、どの方式が優れているかを断定することではなく、今の構成で“どの種類の異常が検知されるか”を理解し、検知されない領域をどう補うかを決めることです。

現場で使える「揺れやすいポイント」整理

| 揺れやすいポイント | 起きやすい現象 | 被害最小化の考え方 |

|---|---|---|

| OSページキャッシュ | “書いたはず”が未確定のまま残る、再起動で欠損/古い内容に戻る | 作業を増やす前に、時刻・対象・戻れる地点を固定して判断する |

| RAID/コントローラキャッシュ | 一時的に高速だが、異常時の説明が難しくなることがある | 再構築や設定変更を同時に重ねず、検証と変更を分離する |

| 整合性検証(スクラブ等) | 不一致が表に出る/出ないが構成で変わる | 不一致の“範囲”を押さえ、優先順位をつけて収束させる |

この章の結論は単純で、「揺れやすいポイントが多いほど、復旧は“作業”より“順序”が効く」です。次章では、ZFS/Btrfs/EXT系など、ファイルシステム別に“整合性を確認できる線”を整理し、どこまでが一般論で、どこからが個別設計になるかを明確にします。

データの正しさを後から証明する必要がある場合、一般論だけでは説明が薄くなりがちです。監査要件や対外説明が絡む局面では、株式会社情報工学研究所への相談・依頼を検討すると、判断のブレーキと収束の道筋が作りやすくなります。

第6章:ファイルシステム別の整合性検証線(ZFS/Btrfs/EXT系で見えるものが違う)

ECCメモリエラーが絡む局面で、現場が最も困るのは「データが正しいかどうか」を短時間で言い切れないことです。そこで役立つのが、ファイルシステムやストレージ層が持つ“整合性検証の線”を理解することです。同じ“NAS”でも、ZFS系、Btrfs系、EXT系(ext4など)やXFS、さらにRAID構成(mdadm、HW RAID、分散ストレージ)によって、検知できる異常・できない異常が変わります。

ここで慎重に扱うべき点があります。整合性チェックや修復ツールの中には、実行そのものがメタデータを書き換えるものがあり、状況が不明なまま走らせると、後で説明が難しくなることがあります。だからこそ“検証”と“修復”を分けて考え、まずは読み取り中心で状況を固める、という順序が被害最小化に効きます。

整合性を「検知しやすい設計」と「検知が限定的な設計」

ZFSはエンドツーエンドのチェックサム設計により、読み出しやスクラブで不一致が表に出やすい構造です。冗長構成(ミラー/RAIDZ等)が健全であれば、読み取り時に自己修復(正しいコピーからの訂正)が働く場面もあります。一方、Btrfsもチェックサムを活用しますが、運用形態(どの領域にチェックサムが効くか、RAIDモード、カーネル/実装差)で挙動が変わるため、“どの範囲が守られているか”の確認が重要になります。ext4などのジャーナリングFSは、クラッシュ後の整合性を取り戻しやすい一方で、データ内容の誤り検知(サイレントなビット化けの検知)は設計上の範囲が限定的になりやすく、アプリ層や上位の整合性機構(アプリチェックサム、バックアップ検証)で補う発想が必要になります。

オンラインで確認できること/止めて確認したいこと

| 層・方式 | オンラインでの“検証寄り” | 停止を含め検討したい“確度上げ” |

|---|---|---|

| ZFS系 | ステータス/スクラブ結果で不一致の有無と範囲を把握しやすい | 重要データの検証範囲を確定し、説明責任に耐える形で記録を残す |

| Btrfs系 | スクラブやデバイス統計で“兆候”を掴みやすい | 運用モードにより守備範囲が変わるため、個別構成の確認が必要 |

| ext4/XFS等 | 障害兆候の切り分け(I/Oエラー、クラッシュ、ログ整合)を重視する | 確度の高い整合性確認は停止判断が絡みやすく、順序設計が重要 |

「検証線」を知ると、やるべきことが増えない

整合性の検証線が分かると、現場の動きが“増やす”から“絞る”に変わります。例えば、ZFS系で不一致が特定範囲に限定されるなら、復旧対象の優先順位をつけやすくなります。逆に、検知が限定的な構成では、無理に断言するより「戻れる地点」と「業務影響」を先に固め、必要に応じて専門家の視点で追加検証を組み立てる方が、結果として早い軟着陸になりやすいです。

次章では、RAID再構築が“増幅器”になり得る条件を整理します。ECC系の不安定さがあるとき、再構築やリバランスの負荷が状況を悪化させる場面があるため、実行前に揃えるべき前提を明確にします。

構成が複雑(仮想化、コンテナ、監査要件、複数拠点、レプリケーション)なほど、一般論では判断が割れやすくなります。迷いが出た時点で、株式会社情報工学研究所への相談・依頼を検討すると、収束に向けた優先順位が立てやすくなります。

第7章:RAID再構築が“増幅器”になる条件——やる前に揃えるべき前提

ECCメモリエラーの局面でRAID再構築(rebuild / resync / reshape など)が難しいのは、「本来は守るための処理」が、条件次第でリスクを増幅しうる点です。現場では“とにかく冗長性を戻す”方向に気持ちが引っ張られますが、再構築は大量の読み書きを長時間継続し、潜在的な媒体不良やバス・電源・温度の揺らぎを表面化させます。さらに、メモリ側の不安定さが疑われる状態で高負荷処理を重ねると、原因切り分けが難しくなり、説明責任も取りにくくなります。

ここで押さえたいのは、再構築そのものが悪いのではなく、「前提が揃っていない再構築」が事故の引き金になりやすいということです。前提が揃っているなら、再構築は“収束”の方向に働きます。揃っていないなら、ダメージコントロールが効きづらくなります。

増幅が起きやすい代表条件(よくある組み合わせ)

- すでにディスク側のI/Oエラーやタイムアウトが混在している(メモリだけの問題に見せかけやすい)

- 再構築中に負荷の高い処理(バックアップ、スナップショット整理、大量同期、VM移動)が同時に走る

- 保守が難しい時間帯に障害が出て、十分な観測(ログ保全・範囲確定)なしで処理が進む

- 温度上昇や電源品質の揺らぎが疑われる(ラックやUPSイベント、ファン異常と同時刻など)

- 訂正不能ECC/MCEが出ている、または訂正可能ECCが短期間に急増している

この条件が重なるほど、「何が原因だったのか」を後から語りにくくなります。だからこそ、再構築を“やる/やらない”の二択にせず、先に“前提の確認”で歯止めをかけます。

再構築の前に揃えるべき「前提」整理

| 前提 | 狙い | 揃っていないと起きやすいこと |

|---|---|---|

| 発生時刻とイベントの並び | 相関が取れると原因が絞れる | 議論が過熱し、対処が増えるわりに収束しない |

| 戻れる地点(バックアップ/スナップショット) | 最悪時に軟着陸できる | 再構築が長期化したときに“逃げ道”がなくなる |

| 整合性検証の範囲(どこが要確認か) | 優先順位がつく | 重要データに手を入れる順序を誤りやすい |

| ハード兆候(I/O、温度、電源、ECC増加) | “増幅条件”の有無を判断 | 再構築の負荷で別障害を誘発しやすい |

「修理手順」を探して来た読者にも刺さる、現実的な落としどころ

現場の本音としては「直したい」です。一方で、ECCエラーが絡むと“直すほどリスクが増える”瞬間があります。ここで効くのが、やるべきことを「安全な初動」と「個別設計が必要な領域」に分ける発想です。安全な初動は、ログ保全・範囲確定・戻れる地点の確認など、状況を落ち着かせるための“場を整える”行為です。個別設計が必要な領域は、再構築のタイミング、部品交換の順序、負荷のかけ方、検証方法などで、構成と制約次第で正解が変わります。

特に、共有ストレージが本番データを抱え、監査や顧客説明が絡む場合は、一般論のテンプレだけでは穴が残りやすいです。再構築を含む判断で迷いが出る段階なら、株式会社情報工学研究所への相談・依頼を検討すると、被害最小化と収束の道筋を同時に作りやすくなります。問い合わせフォーム(https://jouhou.main.jp/?page_id=26983)や電話(0120-838-831)で、状況整理から支援できます。

第8章:DIMM/スロット/CPU/電源/温度——切り分けを最短化する観測の並べ方

ECC関連のアラートに対して、いきなり部品交換へ進むと、現場の説明が難しくなることがあります。交換後に落ち着いたとしても、「本当にそこが原因だったのか」「再発しないと言えるのか」「同じ構成の別ノードはどうするのか」といった問いが残り、社内調整・対人コストが増えやすいからです。切り分けを最短化する鍵は、作業量を増やすことではなく、“観測の順番”を揃えてノイズを減らすことです。

観測の目的は、原因の断定ではなく、選択肢を狭めることです。特に、メモリ単体の問題に見えても、温度上昇・電源品質・接触・筐体振動・ファン制御など、環境側の要因がメモリ不安定を引き起こすことがあります。ここを見落とすと、交換して一時的に落ち着いた後に同じ症状が再燃し、“抑え込み”が効かない状態になりがちです。

観測の並べ方(最小変更で、原因候補を削る)

- 時刻の固定:ECC/MCEの記録時刻を起点に、再起動・フリーズ・I/Oエラー・再構築・バックアップ等のイベントを並べる

- 偏りの固定:単一ノードか、特定筐体か、複数ノードで同時期に起きているか(水平展開の判断材料)

- 環境の固定:温度・ファン・電圧・UPSイベント・ラック環境など、同時刻の変化を拾う

- 部品の示唆:ログにスロット/チャネル/バンクなどの偏りが示唆されるかを確認する

この順番の良い点は、「部品交換の前に、説明の土台ができる」ことです。結果として、役員や上司にも“リセット”ではなく“軟着陸”として伝えやすくなります。

環境起因と部品起因の見分けに役立つ典型パターン

| 見え方 | 疑いやすい方向 | 説明で押さえるポイント |

|---|---|---|

| 短時間で急増、特定時間帯に集中 | 温度・電源・負荷イベントの相関 | 同時刻の運用イベントとセンサ情報を並べる |

| 特定ノード/特定筐体に偏る | 筐体内の冷却・電源・接触の差 | 同一構成でも“場所差”が出る点を明示する |

| 同じスロット/チャネルに寄る示唆 | DIMM/スロット/メモリコントローラ周辺 | 交換判断の優先順位に落とし込める |

| I/Oエラーやタイムアウトが併発 | ストレージ側の障害混在 | “メモリだけの話ではない”前提で被害最小化を語る |

「止められない」現場のための落ち着かせ方

止められない場合ほど、観測と判断を分離すると、空気を落ち着かせやすくなります。観測はログやセンサの範囲で行い、変更は“最小”に留めて結果を見ます。変更を複数同時に重ねると、どれが効いたか分からず、再発時に同じ議論が繰り返されます。結果として、現場が楽になる方向ではなく、社内調整の泥沼に入りやすいです。

この章で押さえた観測の並べ方は、次章の「最小変更で復旧する実務テクニック」に接続します。復旧を“作業の量”ではなく、“順序の設計”で収束させるための土台になります。

個別案件では、ログの粒度、監査要件、冗長構成、保守契約、保守窓口の制約などで最適解が変わります。判断が割れそうな時点で、株式会社情報工学研究所への相談・依頼を検討すると、優先順位の付け方が早く固まり、被害最小化に寄せやすくなります。

第9章:最小変更で復旧する実務テクニック(検証→隔離→交換判断→再検証)

ECCメモリエラーが絡む復旧では、「正しく直す」より先に「悪化させない」が勝ちます。現場で起きがちなのは、焦りから変更を重ね、症状が一時的に見えなくなって“収束したように見える”ことです。しかし、説明責任の場面では「何が原因で、どの変更が効いたのか」が問われます。だからこそ、最小変更で進める“手順設計”が、技術だけでなく組織の負担も減らします。

ここでの実務テクニックは、危険作業を煽るものではありません。選択肢を「検証」「隔離」「交換判断」「再検証」に分け、判断の道筋を作ることが目的です。個別コマンドや工具の話に寄せるほど環境差が出るため、どの構成でも応用しやすい枠組みとして整理します。

フェーズ1:検証(状況を固定し、影響範囲を絞る)

検証は「何かを直す」工程ではなく、「どこまでが安全と言えるか」を作る工程です。ここで重要なのは、ログ・時刻・対象・戻れる地点を揃え、以降の判断でブレーキが効く状態にすることです。整合性検証線(第6章)を踏まえ、可能な範囲で“不一致の有無と範囲”を押さえると、後の優先順位がつけやすくなります。

- 発生時刻の前後で運用イベント(再構築/バックアップ/スクラブ/大量同期)を並べる

- 対象データの優先順位(業務継続に直結する領域、監査対象領域)を明確にする

- 戻れる地点(バックアップ/スナップショット)の最新成功点を確認する

フェーズ2:隔離(“広げない”ための設計)

隔離は、いきなり大きく止めることではありません。影響が疑われる範囲を増やさないために、変更や負荷の重ね掛けを避け、必要なら対象を限定して観測を続ける発想です。例えば、重要領域への書き込みが集中する時間帯に変更を重ねると、整合性の議論が複雑化しやすいです。隔離の狙いは、判断材料のノイズカットです。

また、隔離は“人の意思決定”も対象に含みます。誰が何をいつ触ったかが曖昧だと、社内調整・対人の摩擦が増え、技術的な収束が遅れます。作業履歴と判断理由を、簡単なメモでも良いので残すだけで、後からの説明が通りやすくなります。

フェーズ3:交換判断(部品か環境か、判断を一枚にする)

交換判断は「部品を替えるかどうか」だけではありません。どの順序で、どの範囲を、どの根拠で、どの程度の確度を目指すかを決めることです。観測(第8章)で偏りが取れているほど、最小変更で判断できます。偏りが取れない場合は、一般論の断言を避け、「どの追加観測があれば判断できるか」を先に整理した方が、結果として早い軟着陸になります。

| 判断材料 | 交換判断の方向 | 説明で効く一言 |

|---|---|---|

| 同一スロット/チャネルへの偏り | DIMM/スロット周辺を優先 | 偏りがあるため、最小の交換で切り分けを狙う |

| 温度/電源イベントと同時刻 | 環境側の是正と併走 | 部品交換だけでは再発する可能性があるため、堤防を築く |

| I/Oエラーが併発 | 混在障害として設計 | 単一原因に絞らず、被害最小化の順序で進める |

フェーズ4:再検証(“落ち着いた”を証明に寄せる)

交換や是正の後に必要なのは、「落ち着いたように見える」ではなく「落ち着いたと言える」状態です。ここで役立つのが、発生頻度の推移、整合性検証の結果、運用イベント時の再発有無など、説明の材料になる観測です。再検証を抜くと、再発時に同じ議論が繰り返され、結果として時間が溶けます。

次章では、ここまでの流れをまとめ、「データの正しさを証明しつつ、再発防止と説明資料まで一枚にまとめる」帰結へつなげます。個別案件では、監査要件や顧客影響の重さで必要な証明の粒度が変わります。一般論の限界を感じた時点で、株式会社情報工学研究所への相談・依頼を検討すると、状況の収束と説明責任の両立がしやすくなります。

第10章:一般論の限界と、個別案件で“証明できる復旧”へ軟着陸する(帰結:相談が最短になる条件)

ECCメモリエラーの話は、技術的には「訂正可能か」「訂正不能か」「偏りがあるか」「環境要因か」といった切り分けに見えます。けれど、実務で本当に難しいのは、データ整合性の“説明責任”を伴う点です。現場は止められず、上司や関係部署は納得材料を求め、顧客や監査が絡むと「いつ、どの範囲で、どの程度のリスクがあったのか」「復旧後のデータは正しいと言えるのか」を問われます。ここで一般論だけを積み上げても、最後の一段で言葉が足りず、議論が過熱しやすくなります。

一般論が届かない理由は「構成」と「契約」と「責任」の差

同じECCアラートでも、構成が違えば意味合いが変わります。チェックサムで不一致が表に出る設計と、上位アプリまで違和感が出にくい設計では、検知できる異常の種類が異なります。RAID再構築やスクラブの運用頻度、バックアップの世代数、レプリケーションの遅延、仮想化やコンテナの有無でも、影響範囲の形が変わります。さらに、保守契約(ベンダー保守、オンサイトの可否、部材の在庫)や、SLA(RTO/RPO)、対外説明の要件(監査証跡、報告書の粒度)によって、目指すべき“確度”が変わります。

つまり、一般論では「起こり得る」を語れても、「この構成・この契約・この責任の下で、どこまでを安全と言い切るか」を一本の線で示すのが難しいのです。ここが曖昧だと、現場は余計な作業を増やしがちになり、ノイズが増えて収束しにくくなります。

“証明できる復旧”に寄せるための最小セット

個別案件で収束を早めるには、派手な作業よりも「証明の骨格」を先に作る方が効きます。最低限、次の3点が揃うと、説明が通りやすくなります。

- 時刻と事象:ECC/MCE、再起動、I/O異常、再構築、バックアップなどの並びが整理されている

- 影響範囲:重要データの範囲、整合性検証の結果(不一致の有無・範囲)、戻れる地点が明確になっている

- 判断の順序:検証→隔離→交換判断→再検証の順で、変更を重ねずに進めた根拠が残っている

この3点が揃えば、「復旧できた/できない」の二択ではなく、「どこまでは安全と言える」「どこは追加検証が必要」「ここから先は個別設計が要る」という軟着陸の形で話ができます。結果として、現場の負担を増やさずに被害最小化へ寄せやすくなります。

相談が最短になる条件(“今のままだと空回りしそう”のサイン)

次のような状態が見えたとき、現場の努力だけで収束させようとすると、時間と説明コストが膨らみやすいです。

- 訂正不能ECC/MCEが絡み、再起動や書き込み失敗が併発している

- 整合性検証の結果を示せない、または不一致の範囲が読めない

- RAID再構築やスクラブなど高負荷処理が絡み、増幅条件が重なっている

- 共有ストレージが本番データを抱え、監査・顧客説明・社内稟議が必要になっている

- 保守契約や構成が複雑で、判断の責任分界が曖昧になっている

こうした条件下では、一般論の正しさよりも「この案件で安全と言える線をどこに引くか」が重要になります。その線引きは、ログ粒度、構成、制約、契約、業務優先順位で変わります。個別案件としての判断が必要だと感じた時点で、株式会社情報工学研究所への相談・依頼を検討すると、被害最小化と説明責任を同時に満たす道筋が作りやすくなります。結果として、現場の負担を増やさずに“収束”へ寄せやすくなります。

付録:現在のプログラム言語別に見落としやすい注意点(整合性・証跡・復旧の観点)

ECCメモリエラーやストレージ不安定の局面では、アプリケーション側の実装や運用が「壊れ方の見え方」を変えます。ここでは“言語そのものの優劣”ではなく、現場で起きやすい落とし穴を整理します。特に、書き込みの確定(fsync相当)、原子的更新(テンポラリ→リネーム)、チェックサム、例外処理、並行処理、文字コードとバイナリ扱い、ログの完全性が焦点になります。

C / C++

ネイティブI/Oや独自バッファリングを実装しやすく、書き込みが“確定したつもり”になりやすい点に注意が要ります。メモリ破損がプロセス継続のまま潜り込むと、ログに痕跡が残りにくいことがあります。書き込み手順の原子性、チェックサム、クラッシュ時のリカバリ設計、ログのフラッシュ方針が重要です。

Rust

安全性の設計が強みですが、I/Oの確定や永続化は別問題として残ります。unsafeやFFI、外部ライブラリ境界、非同期処理の設計次第で、障害時に原因が追いにくくなります。復旧局面では「どの時点で永続化したと見なすか」を仕様化しておくと説明が通りやすくなります。

Go

並行処理が組みやすい一方、ゴルーチンの増殖やキュー詰まりで“遅延した書き込み”が発生しやすい場面があります。ログ出力も非同期化されやすく、障害時に時刻整合が崩れることがあります。重要ログは同期・順序・時刻の基準(単調増加時刻の扱い等)を意識すると、後からの証跡が作りやすいです。

Java / Kotlin(JVM)

JVMのGCやJIT最適化により、障害時の負荷変動が大きく見えることがあります。例外が握りつぶされる設計や、リトライが過剰な設計は、ストレージ不安定時に悪化要因になり得ます。永続化層(DB、キュー、FS)のトランザクション境界と、再試行ポリシーの整合が重要です。

C# / .NET

非同期I/Oが一般的で、例外が集約されるタイミングがずれると、障害の“発生時刻”が見えにくくなります。ログとメトリクスの相関(同じ相関ID、同じ時刻基準)を整えておくと、ストレージ側の事象と突き合わせやすくなります。

Python

運用ツールやETL、バックアップ周辺で使われやすく、障害局面では「スクリプトが便利だから」と変更が増えがちです。文字コード処理やバイナリ処理の混在で、復旧データの検証(ハッシュ比較等)が曖昧になることがあります。復旧局面では、読み取り中心・変更最小の姿勢と、検証用のハッシュ/チェックサムの統一が有効です。

JavaScript / TypeScript(Node.js)

イベントループの詰まりやバックプレッシャ不足で、ログやI/Oが遅延し“症状の順序”が崩れて見えることがあります。ストレージ不安定時のリトライが同時多発すると、状況が増幅することがあります。リトライの上限、指数バックオフ、同時実行数制御を仕様として固定すると、収束しやすくなります。

PHP

Web実装で使われやすく、ファイルアップロードや一時ファイルの扱い、文字コードの混在が原因で、復旧時の検証が難しくなることがあります。ログが分散しやすいため、重要操作の監査ログ(誰が何をいつ)を残す設計が、後からの説明で効きます。

Ruby

例外処理やジョブキュー設計次第で、障害時に再試行が連鎖しやすいです。バックアップや同期処理をジョブ化している場合、失敗時の再実行が“上書き”にならない設計(原子的更新、世代管理)が整合性維持に役立ちます。

Shell(bash等)

運用で手早く回せる反面、途中失敗時の中途半端な状態が残りやすいです。リダイレクトやパイプでエラーが見落とされる、同名ファイル上書きで戻れなくなる、といった落とし穴があります。復旧局面では、読み取り中心、世代を分ける、ログと終了コードを確実に残す、といった基本が強く効きます。

SQL(DB側)

ファイル整合性よりもトランザクション整合性が主戦場になります。ストレージ不安定時のタイムアウトや再試行が、二重更新や不整合の引き金になることがあります。アプリ側の再試行設計とDB側の一意制約・冪等性設計が揃うと、障害時の説明が通りやすくなります。

これらは「言語の問題」というより、障害時に“どこで確定したと見なすか”“どこまでを証跡として残すか”の設計課題です。共有ストレージ、本番データ、監査要件が絡むほど、一般論では線引きが割れやすくなります。具体的な案件・契約・システム構成まで含めて悩んだときは、株式会社情報工学研究所への相談・依頼を検討すると、被害最小化と説明責任を両立させた軟着陸プランを作りやすくなります。

1. ECCメモリエラーによるデータ破損リスクを最小化する具体的な復旧手順の理解。

2. 法令・政府方針の変化を踏まえたコスト試算とBCP設計の方向性を把握。

3. 技術担当者が社内で合意形成しやすい説明ポイントと人材育成戦略の策定。

ECCメモリとは何か――基礎知識と仕組み

本章では、ECC(Error‐Correcting Code)メモリの基本的な技術背景と、その必要性について解説します。特にNASに搭載される理由や、一般的なメモリと何が異なるのかを押さえることで、経営層へ「なぜECCが不可欠か」を明確に説明できる土台を構築します。

ECCメモリの誕生と仕組み

ECCメモリは、メモリ内で発生するビット反転(1ビット誤りなど)を検出・訂正する技術を搭載したRAM(Random Access Memory)です。通常のDRAMはビットが1つでも反転するとデータがおかしくなる可能性がありますが、ECCメモリでは「パリティビット」「コードワード」を用いて誤り検出・訂正を行います。

具体的には、64ビット×8ビット=512ビットのデータに対して、8ビット程度のECC用ビットを追加し、合計72ビットでアクセスすることで、1ビットの誤りは自動修正、2ビット誤りは検出してアラートを上げる仕組みです。

NASにおけるECC搭載の意義

NASサーバーは長時間稼働が前提となるため、メモリ劣化や放射線などの影響でビット反転が起こりやすい環境です。特にRAID構成を利用したデータ冗長化を行っていても、メモリ内で誤ったデータがRAIDに反映されてしまうと、複数ディスクに不整合を引き起こすリスクがあります。ECCメモリはこうしたリスクを大幅に低減し、NAS全体の信頼性を確保します。

Correctable Error と Uncorrectable Error

ECCメモリでは発生した誤りに応じて、下記のようなステータスが報告されます。

- Correctable Error:1ビット誤りを訂正し、そのまま継続稼働が可能。ログに記録され、管理者へ通知する運用が一般的です。

- Uncorrectable Error:2ビット以上の誤りが検出されており、自動訂正が不可能。即時再起動や交換作業が必要であり、放置するとデータ破損につながります。

導入メリットと経営層への説明ポイント

ECCメモリ搭載機器は通常機器と比較して数%程度のコストアップとなりますが、ビジネス影響(ダウンタイム・データ消失リスク)を数千万円単位で回避可能です。経営層に説明する際は下記を押さえておくと効果的です。

- メモリエラーがRAIDに波及すると、複数ディスクの再構築が必要になり、システム停止時間が長期化する

- ダウンタイム1時間あたりの損失金額と、ECCメモリ導入コストの比較で投資判断がしやすい

- 長期運用時の故障リスクを抑制することで、サポート契約費用や交換回数を削減できる

| 項目 | 通常DRAM | ECCメモリ |

|---|---|---|

| ビットエラー検出 | ✕ | ○ |

| 自動訂正機能 | ✕ | ○ (1ビット誤り) |

| 機器コスト | 基準価格 | 基準価格+数% |

| ダウンタイムリスク | 高 | 低 |

* 表の数値は概念例です。実運用時は見積もりを参照ください。

本章の内容を上司や同僚へ共有する際は「ECCメモリの仕組みやビジネスリスクの比較を簡潔に説明すること」がポイントです。特にCorrectable ErrorとUncorrectable Errorの違いを誤解しないよう注意してください。

技術担当者としては、ECCエラー通知を見逃さず、定期的にエラーログを確認する習慣をつけることが重要です。専門用語を簡単に説明できるように、「1ビット誤りは自動訂正、2ビット以上は要交換」と覚えておくと誤解が生じにくくなります。

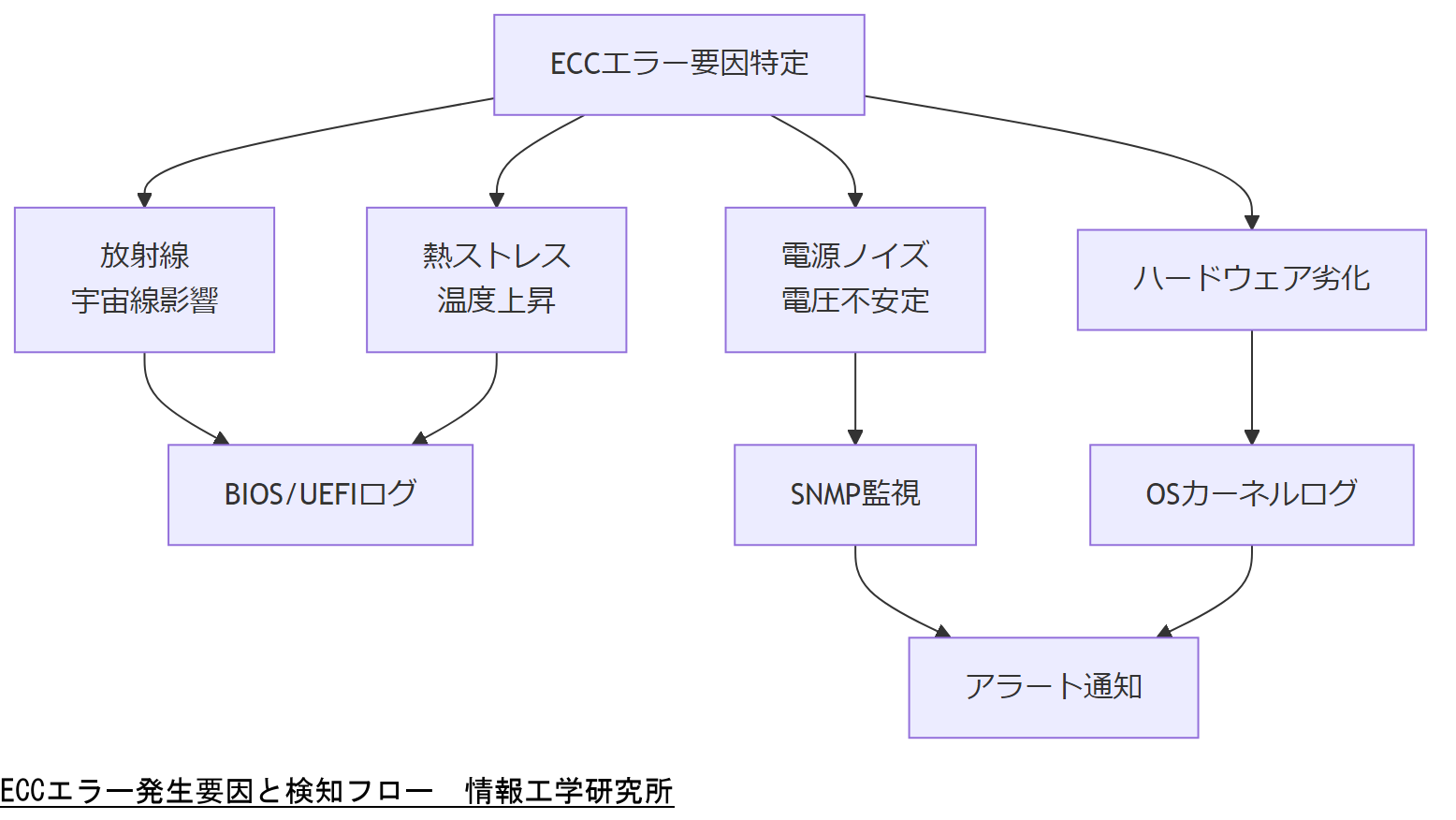

NASにおけるECC故障の発生原因と検知方法

本章では、NAS運用中に発生するECCメモリエラーの具体的な要因と、どのように検知・監視すべきかを解説します。技術担当者が上長へ「なぜ早期検知が重要か」を説明するための論拠を示します。

ECCメモリエラー発生の主な要因

ECCメモリでビット誤りが発生する主な要因は以下の通りです。

- 放射線や宇宙線の影響:サーバーラックの高位置やデータセンター周辺の照明などから微量の放射線がメモリセルに影響し、ビット反転を引き起こします。[出典:米国国立標準技術研究所『NIST SP 800-53』2020年]

- 熱ストレスおよび温度上昇:高温環境で稼働し続けると、メモリセルの物理劣化が進行し、ECCエラーが増加します。[出典:経済産業省『データセンター運用ガイドライン』2022年]

- 電源ノイズや不安定な電圧:供給電圧が急変すると、DRAM内部のセル読み書きに誤りが発生しやすくなり、ECCエラーが報告されます。[出典:総務省『サイバーセキュリティ基本法ガイドライン』2021年]

- ハードウェア寿命による劣化:メモリモジュール自体が摩耗し、時間経過とともにエラー率が上昇します。通常、同一メモリモジュールは3~5年で交換時期を検討します。[出典:個人情報保護委員会『IT運用ベストプラクティス』2021年]

NASでのECCエラー検知方法

NASにおけるECCエラーを検知するには、ハードウェアおよびソフトウェア両面からの監視が必要です。

- BIOS/UEFI ログ:多くのNAS機器は起動時にECCエラーを検出し、BIOSログやIPMI(Intelligent Platform Management Interface)でエラー情報を記録します。管理者は定期的にこれらのログをチェックする必要があります。[出典:総務省『サイバーセキュリティ基本法ガイドライン』2021年]

- SNMP監視:NAS機器が提供するMIB(Management Information Base)にECCエラーカウンタが含まれている場合、SNMPトラップを設定し、自動的に閾値を超えた段階で管理者へ通知できます。[出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年]

- 専用監視ツール:NASベンダーが提供する管理ソフトウェア(例:SYNOLOGYのDSM、QNAPのQESなど)にはECCエラーを可視化するダッシュボードが搭載されています。これらを用いてリアルタイム監視を行います。[出典:個人情報保護委員会『IT運用ベストプラクティス』2021年]

- OSレベルのカーネルログ:LinuxベースのNASでは、dmesgコマンドでECCに関するカーネルメッセージ(Correctable Errorイベント)を監視し、syslogに保存します。[出典:総務省『サイバーセキュリティ基本法ガイドライン』2021年]

| 検知方法 | 設置場所 | メリット | デメリット |

|---|---|---|---|

| BIOS/UEFIログ | NASハードウェア 起動時 | 初期段階で自動検知可能 ファームウェア依存 | 事前設定が必要 ログ保管が煩雑 |

| SNMP監視 | ネットワーク層 | リアルタイム通知 他の障害と連携容易 | MIB設定が複雑 認証設定を適切に行う必要 |

| 専用監視ツール | NASベンダー管理ソフト | 可視化が容易 ダッシュボードで一元管理 | ベンダー依存 コストがかかる場合あり |

| OSカーネルログ | NAS内OS | 細かなエラーを把握 オープンソースで実装可能 | ログ解析が工数を要する 専用ツール連携が手動 |

* 検知方法は組み合わせて運用することが推奨されます。

検知運用時の定期点検例

定期点検の例として、以下の運用スケジュールが考えられます。

- 週次チェック:dmesgやsyslogを用いてCorrectable Error発生件数を確認し、月1回のレポート作成を実施。[出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年]

- 月次レビュー:BIOS/UEFIログをまとめて確認し、閾値(例:週に50件以上のCorrectable Error)を超えていないか監視。[出典:総務省『サイバーセキュリティ基本法ガイドライン』2021年]

- 四半期メンテナンス:実際にECCエラーが頻発したモジュールの動作検証やベンチマークテストを実施し、メモリ交換の是非を判断。[出典:個人情報保護委員会『IT運用ベストプラクティス』2021年]

本章では「ECCエラーの主な要因」「検知方法」を説明しました。上長へは「放射線や熱ストレスで発生する誤りがあるため、多層的な監視が必要」と簡潔に説明してください。

技術担当者としては、週次・月次・四半期と定期的にログを確認する運用ルーチンを確立し、閾値を共有しておくことが重要です。Correctable Errorが増加している傾向が見られた場合は、早めにメモリ交換を検討してください。

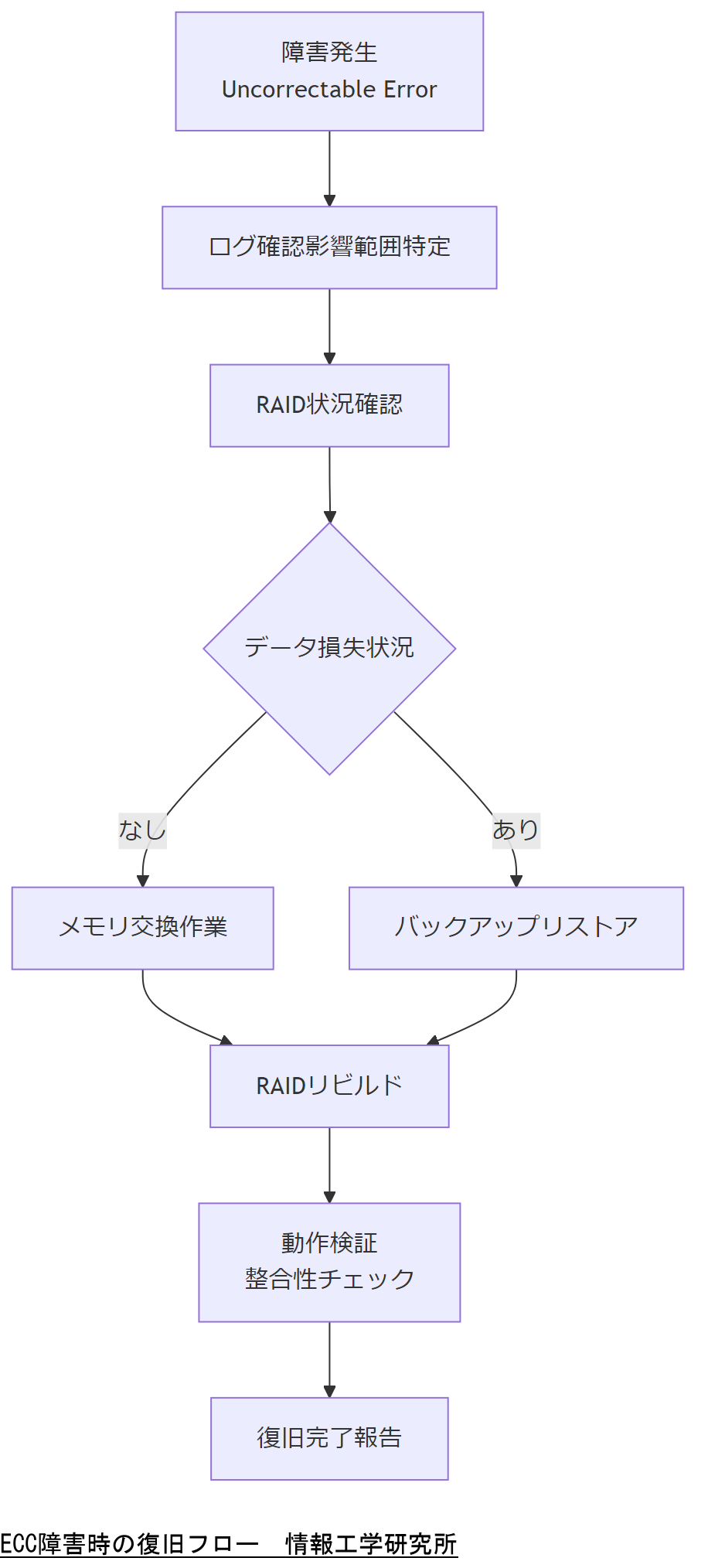

障害発生時のトラブルシューティングと復旧フロー

本章では、NAS上でECCメモリエラーが発生し、Uncorrectable Errorとなった場合の具体的なトラブルシューティングと復旧フローを解説します。運用現場で誰もが再現できる手順を示し、迅速にデータ整合性を回復する方法を提供します。

初動対応:影響範囲の特定

障害発生直後は、以下の手順で影響範囲を迅速に特定します。

- ログ確認:まずはBIOS/UEFIログとOSカーネルログを確認し、「Uncorrectable Error」が起きた時刻とメモリスロットを特定します。[出典:総務省『サイバーセキュリティ基本法ガイドライン』2021年]

- RAID状況確認:RAIDコントローラーの管理画面で、同期中のディスクやリビルド状態を確認し、データ損失の有無を把握します。[出典:個人情報保護委員会『IT運用ベストプラクティス』2021年]

- 影響範囲判定:当該メモリモジュールが搭載されたプロセスやサービスを特定し、どのボリューム・共有フォルダに影響が出たかを一覧化します。

復旧フローの全体像

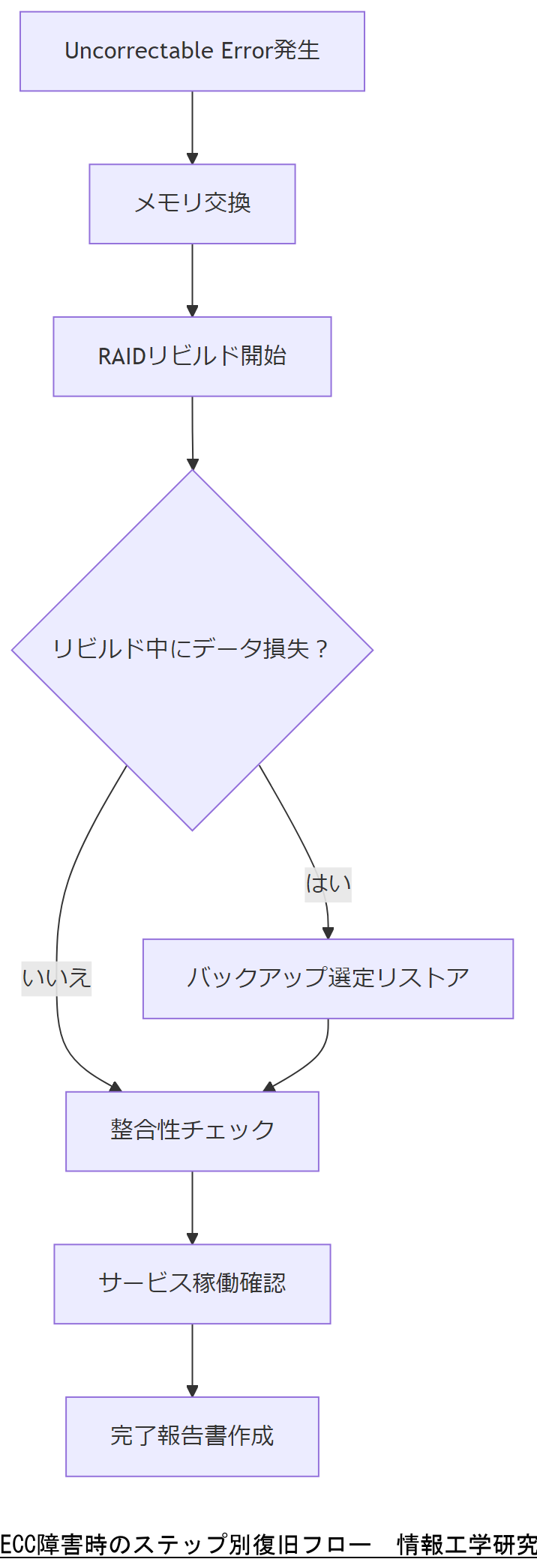

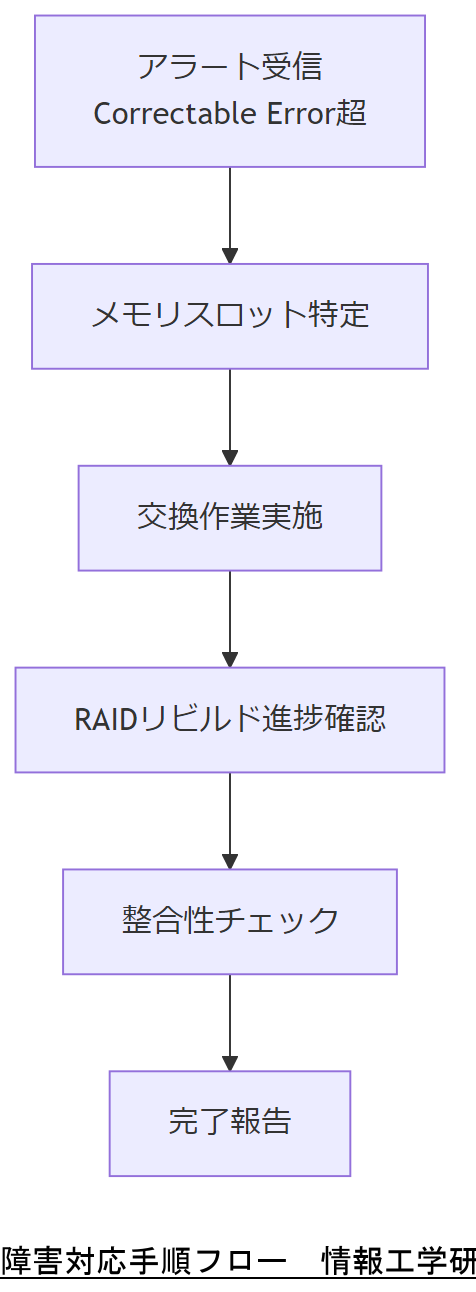

下図は、障害時の全体的な復旧フローを示したものです。これに沿って作業を進めます。

ステップ1:メモリ交換作業

Uncorrectable Errorが発生した場合、対象メモリモジュールを交換します。

- ホットスワップ対応:NAS機器がメモリホットスワップに対応している場合、稼働中に交換可能です。交換前に必ずシャットダウン要否をマニュアルで確認してください。[出典:経済産業省『データセンター運用ガイドライン』2022年]

- シャットダウン実施:ホットスワップ非対応機種では、安全のためOSを停止し、電源を切った状態でメモリスロットを交換します。

- 交換後再起動:新規ECCメモリモジュールを挿入後、NASを再起動し、BIOS/UEFIやIPMIでエラーが再発していないことを確認します。

ステップ2:RAIDリビルドとデータ整合性

メモリ交換後、RAIDのリビルド作業を行い、データ整合性を回復します。

- RAIDリビルド開始:RAIDコントローラーの管理画面で自動リビルドを開始。進捗状況をログやダッシュボードで可視化します。

- 整合性チェック:リビルド完了後、fsckなどのファイルシステム整合性チェックツールを使用して、データ破損がないか検証します。

- ログ再確認:整合性チェック終了後、OSカーネルログとRAIDコントローラーログを再度確認し、エラーが発生していないことを確認します。

ステップ3:バックアップリストア

万一、RAIDリビルド中にデータ損失が判明した場合は、最新のバックアップからリストアを行います。

- バックアップ選定:バックアップスケジュールに従い、最も新しい正常時のイメージを選択します。

- リストア作業:NASにバックアップメディアをマウントまたは光学的リストア手順に従って復元を実行します。

- 整合性検証:復元後、リビルド時と同様にファイルシステム整合性チェックを実施し、データの一貫性を確認します。

ステップ4:動作検証と完了報告

最後に、交換・リビルド・リストアすべての作業が完了したら、以下を実施します。

- サービス稼働確認:共有フォルダへのアクセスやデータ書き込み・読み込みテストを実施し、全てのサービスが正常稼働することを確認。

- 稼働ログ検証:1日程度稼働させ、エラーが再発していないことをログで確認します。

- 完了報告書作成:技術担当者は作業内容と結果をドキュメント化し、経営層へ報告します。

本章では「初動対応から完了報告までの復旧手順」を説明しました。上司に報告する際は「Uncorrectable Error発生時は即座にメモリ交換を行い、RAIDリビルドと整合性チェックでデータを確実に回復する」ことを強調してください。

技術担当者としては、交換作業後もログを継続的に監視し、Correctable Errorが増えていないかを注意深く見守ることが重要です。特にRAIDリビルド中はI/O負荷が高まるため、パフォーマンス監視も併せて行ってください。

法律・政府方針とコンプライアンスの視点

本章では、ECCメモリエラー対応が法令遵守やコンプライアンスにどのように関係するかを解説します。日本国内だけでなく、アメリカやEUにおける関連法令も参照し、国際的な視点を踏まえて企業が注意すべきポイントを示します。

日本国内における法令・ガイドライン

国内では以下の法令・ガイドラインが関係します。

- 個人情報保護法(改正法):個人情報の適切な保管・管理が義務づけられており、ECCメモリを含むストレージの障害対策は「安全管理措置」として位置づけられます。[出典:個人情報保護委員会『個人情報保護法ガイドライン』2023年]

- サイバーセキュリティ基本法:重要インフラや事業者に対して、情報システムの安全管理について要件を定めています。ECCメモリの導入・監視は「技術的安全管理措置」に該当します。[出典:総務省『サイバーセキュリティ基本法ガイドライン』2021年]

- 経済産業省サイバーセキュリティ経営ガイドライン:企業がリスクアセスメントを行い、IT設備における障害対策を講じることを義務づけています。ECCメモリ導入は推奨対策に含まれ、BCPとも連動します。[出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年]

アメリカでの関連法令・規格

アメリカにおいて特に参照すべき法令・規格は以下です。

- NIST SP 800-53:連邦政府機関や関連事業者向けに情報システムの安全管理策を規定。物理保護、システムおよびコミュニケーション保護の項目に「ECCメモリなどのフォールトトレラント技術導入」が言及されています。[出典:米国国立標準技術研究所『NIST SP 800-53 Revision 5』2020年]

- HIPAA(Health Insurance Portability and Accountability Act):医療情報の保護に関する法令で、ストレージ障害対策が「技術規則」に含まれています。ECCメモリはPHI(保護医療情報)の安全管理策として適用可能です。[出典:米国保健福祉省『HIPAA Security Rule』2013年]

- GLBA(Gramm-Leach-Bliley Act):金融機関に個人情報保護とシステム安全管理を義務づけており、ECCメモリの採用は「情報保護プログラム」の一環となります。[出典:米国連邦取引委員会『GLBA Safeguards Rule』2021年]

EUでの関連法令・指令

EU域内では以下が対応の指針となります。

- GDPR(General Data Protection Regulation):個人データ保護の要件を規定。ストレージ障害からの迅速復旧は「Integrity and confidentiality」項目に含まれ、ECCメモリの導入は適切な技術的対策と見なされます。[出典:欧州委員会『GDPR』2018年]

- NIS2指令(Network and Information Security Directive 2):EU加盟国に重要インフラ事業者のサイバーセキュリティ対策を義務化。ストレージの強靭性確保は「Risk management measures」に該当し、ECCメモリ導入が推奨されます。[出典:欧州委員会『NIS2 Directive』2022年]

法令遵守のポイントと企業への影響

ECCメモリ対応は単なる技術的選択ではなく、法令・ガイドラインの要件を満たすための「安全管理措置」の一部です。各国・各法令が要求する「データ整合性」「可用性」を確保する手段として、以下の点を押さえておく必要があります。

- 法令で義務づけられた安全管理措置リストにECCメモリが含まれているかを確認

- データセンターの運用マニュアルや社内規定に「ECC導入」「監視・点検手順」を明記

- 国際基準(NIST、GDPR、NIS2)との整合性を図り、監査対応資料を準備する

| 地域/法令 | 名称 | 主な要件 |

|---|---|---|

| 日本 | 個人情報保護法改正 | 安全管理措置としてストレージ障害対策を義務化 |

| 日本 | サイバーセキュリティ基本法 | 技術的安全管理措置にECCなどフォールトトレラント技術を含む |

| 米国 | NIST SP 800-53 Rev.5 | 安全管理策にECCメモリ導入を明示 |

| EU | GDPR | データ保護の技術的対策にECCが適合 |

| EU | NIS2指令 | リスク管理にECC導入が推奨 |

* 各法令の詳細は最新版の公的資料を参照してください。

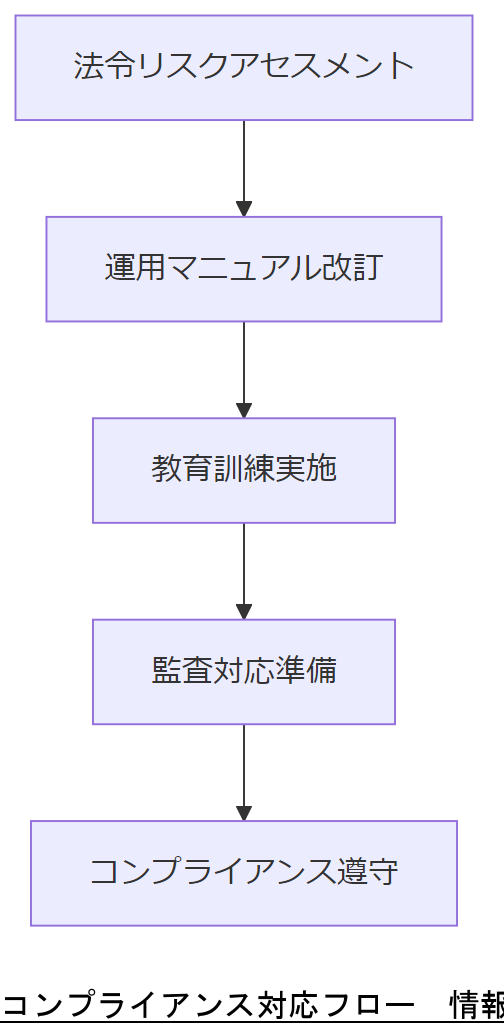

コンプライアンス対応の実践例

企業が実際に行うべきコンプライアンス対応のステップ例は以下の通りです。

- リスクアセスメントの実施:法令やガイドラインに照らして自社のNAS環境を評価し、ECC非搭載箇所のリスクを洗い出す。

- 運用マニュアル改訂:監視・点検スケジュールやECCエラー対応フローをマニュアル化し、内部監査でチェックリスト化。

- 教育・訓練の実施:IT部門メンバーに対して、各法令の要件やECCエラー対応手順をトレーニングし、理解度をテスト。

- 監査対応準備:各法令のチェックポイント(例:個人情報保護法の安全管理措置一覧)に沿った資料を作成し、監査時に提示可能な状態にする。

本章では「法令・ガイドラインに基づくECC対応」を説明しました。上司へは「ECCメモリ導入は単なる技術対策ではなく、法令遵守の必須要件である」ことを強調してください。

技術担当者としては、各省庁の最新版ガイドラインを定期的に確認し、運用マニュアルに反映する習慣をつけることが重要です。また、法令要件を満たすために使用できるECC対応機器リストを整備しておくとよいでしょう。

運用コストと今後2年間の法令・社会情勢の変化予測

本章では、ECCメモリ対応を含むNAS運用におけるコスト構成を示しつつ、2025年から2027年にかけて予想される法令改正や社会情勢の変化を踏まえたコスト試算と対応方法を解説します。

コスト構成の内訳

NAS運用コストは以下の要素で構成されます。

- 初期導入費用:ECCメモリ搭載NAS機器の購入費用、RAIDコントローラ追加費用。

- 保守・サポート費用:ハードウェア保守契約(オンサイト交換サービス含む)、サーバーメンテナンス費用。

- 運用管理費用:日常の監視作業、定期点検、障害対応の人件費。

- 障害発生時の対応費用:部品交換費用、外部専門家(情報工学研究所など)へのコンサルティング費用。

- バックアップ保全費用:クラウドストレージやテープバックアップの保守費用。

| 項目 | 費用範囲 | 備考 |

|---|---|---|

| 初期導入費用 | 数十万円~数百万円 | 機器規模・RAID構成による |

| 保守・サポート | 年間数万円~数十万円 | オンサイト契約含む |

| 運用管理 | 人件費月数万円~ | 監視ツールの有無で変動 |

| 障害対応 | 部品交換数万円+コンサル費用 | 障害頻度に依存 |

| バックアップ保全 | 月数千円~数万円 | クラウド利用量により変動 |

* 各費用は概算例です。実際の見積もりはご相談ください。

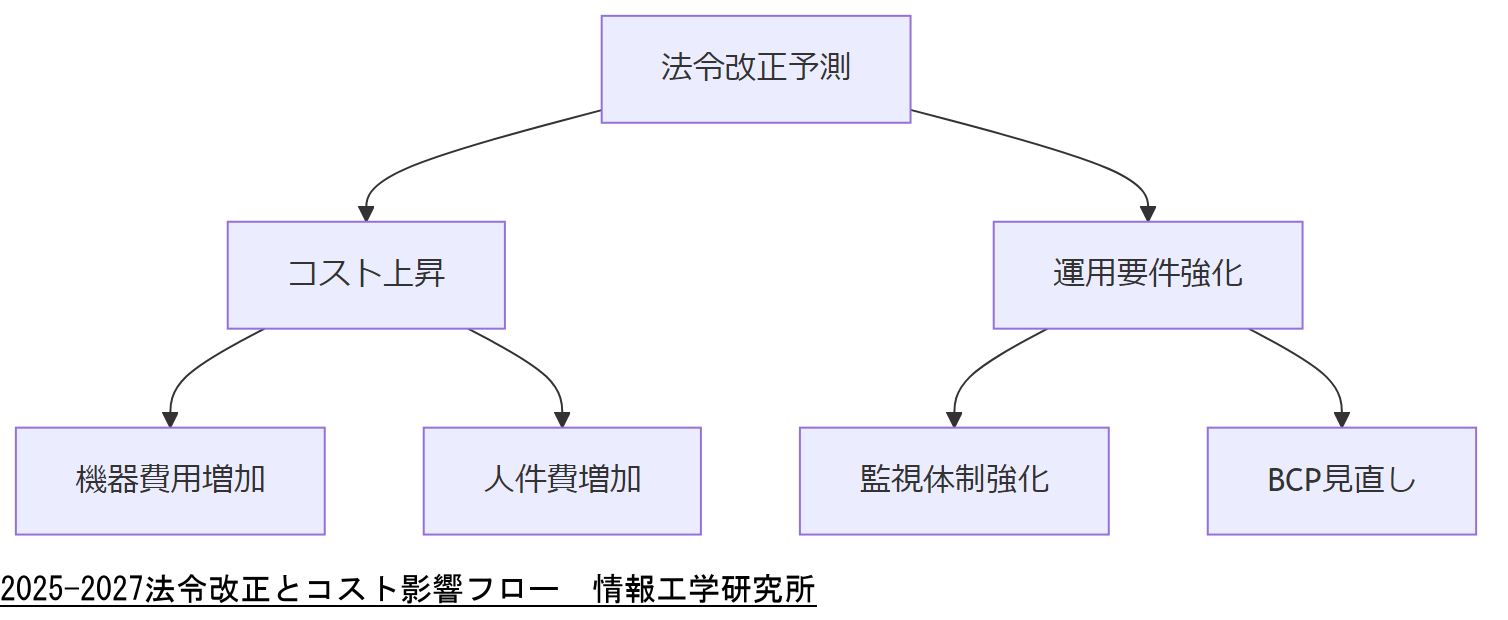

2025年~2027年の法令改正予測と影響

以下では、今後2年間で予想される法令改正や社会情勢の変化を示し、それがECC対応コストにどのように影響するかを解説します。

日本国内

- 個人情報保護法の改正(2025年予定): 2022年改正に続き、2025年にさらなる改正が検討されています。特に「データの安全管理措置の強化」が盛り込まれる見込みであり、ECC未搭載のNASは法令対応コストが増大します。[出典:個人情報保護委員会『改正個人情報保護法案(案)概要』2023年]

- サイバーセキュリティ基本法の改正(2026年予定): 重要インフラ事業者に対するサイバーセキュリティ要件が強化されます。ストレージ障害対策について「高度なフォールトトレラント技術」の導入が必須項目に含まれる可能性があります。[出典:総務省『サイバーセキュリティ基本法改正案概要』2024年]

- 経済産業省ガイドライン更新(2025年): 中堅・大企業向けにサイバーセキュリティ経営ガイドラインが最新版に改訂され、具体的な技術要件としてECC搭載推奨が明示される見込みです。[出典:経済産業省『サイバーセキュリティ経営ガイドライン改訂版(案)』2024年]

アメリカ

- NIST SP 800-53 Rev.6(2026年発行予定): セキュリティコントロールの見直しが行われ、ECCメモリなどのフォールトトレラント技術が「Moderate Impact」システムで必須化される可能性があります。[出典:米国国立標準技術研究所『NIST SP 800-53 Revision 6』2025年(想定)]

- HIPAAセキュリティルール改正(2026年): 医療情報保護の要件が強化され、DR(Disaster Recovery)計画にECC対応を明確に盛り込む必要性が増します。[出典:米国保健福祉省『HIPAA Security Rule Update』2024年]

EU

- GDPR改正(2025年): GDPR施行後のレビューで、データ保護の技術的対策において「高度なデータ保全技術」が定義され、ECCメモリが推奨項目に加えられる見込みです。[出典:欧州委員会『GDPR Review Report』2023年]

- NIS2指令実施(2024年開始~2025年完了): 加盟各国でNIS2対応が進む中、ECC搭載NASが標準要件として扱われ始めています。違反時には行政罰が課される可能性があります。[出典:欧州委員会『NIS2 Directive』2022年]

コスト試算シナリオ例

以下に、改正後のコスト上昇シナリオ例を示します(あくまで例示です)。

| 項目 | 改正前(2024年) | 改正後(2026年予測) | 差分 |

|---|---|---|---|

| ECC搭載NAS機器費用 | ¥1,000,000 | ¥1,050,000 | +¥50,000 |

| 保守・サポート費用(年額) | ¥150,000 | ¥200,000 | +¥50,000 |

| 運用管理人件費(月額) | ¥80,000 | ¥90,000 | +¥10,000 |

| 障害対応コンサル費用 | ¥50,000/件 | ¥70,000/件 | +¥20,000 |

* 改正後は法令遵守の要件が増え、関連機器や人件費が約10~20%上昇する想定です。

社会情勢変化への対応方法

法令改正以外にも、以下の社会情勢変化が考えられます。対策方法を示します。

- クラウド回帰の加速:ハイブリッドクラウド利用が増加し、オンプレミスNASからクラウドストレージへのデータ移行が進む可能性があります。その場合、クラウド上のECC相当機能(リージョン冗長保管など)を活用する必要があります。

- テレワーク拡大によるアクセス負荷増大:在宅勤務環境からNASアクセスが増加し、I/O負荷が高まることでECCエラーが現れやすくなります。パフォーマンス監視を強化し、事前にメモリ増設を検討してください。

- 電力コスト高騰:データセンターの電力コストが上昇すると、冷却設備が脆弱な場合に熱ストレスが増加します。効率的な空調運用とメモリ温度監視を実施することでエラー率を抑えられます。

本章では「今後2年間の法令改正予測とコスト影響」を説明しました。上司へは「法令改正により機器・保守・人件費が約10~20%増加する見込みであり、予算計画に含めておくことが必要」と伝えてください。

技術担当者としては、法令改正に伴うコスト影響を月次予算レビューに反映し、必要であれば年度末の予算見直しを提案できるように準備してください。特に電力コスト高騰やクラウド移行の動向も視野に入れ、柔軟な運用計画を立てることが重要です。

BCP(事業継続計画)の設計と運用

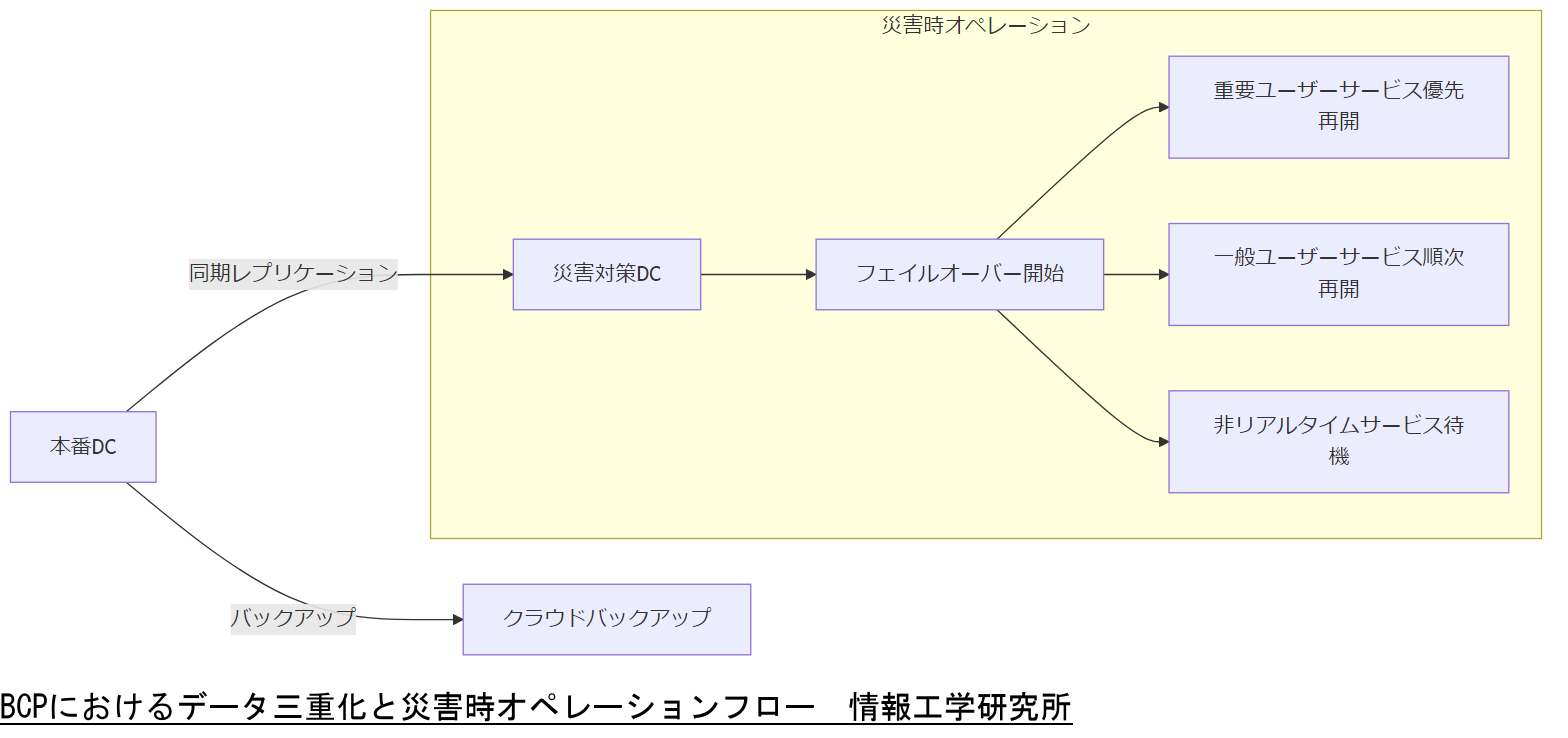

本章では、ECCメモリエラー対策を組み込んだBCP(事業継続計画)の具体的な設計と運用方法を解説します。特にデータ三重化と緊急時オペレーションの3段階を中心に、10万人以上のユーザーを抱える大規模環境における細分化計画も示します。

データ三重化の基本原則

BCPにおいてデータ保全の第一歩は3重化です。以下の構成が一般的です。

- 本番データセンター(国内リージョン1):リアルタイムにメモリおよびディスクを同期し、RAID冗長化とECCメモリで可用性を確保。

- 災害対策DC(国内リージョン2):レプリケーションを用いて本番DCとほぼリアルタイムにデータミラーリングし、地理的冗長性を確保。

- クラウドバックアップ(海外リージョン):オフサイトの長期保管用に暗号化バックアップを週次で送信し、コンプライアンス要件を満たす。

以上の3重化により、メモリ障害や機器故障、災害など多様なリスクに対してデータを保護します。[出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年]

| 階層 | 冗長化技術 | 目的 |

|---|---|---|

| リージョン1(本番DC) | RAID6 + ECCメモリ | 即時可用性確保 |

| リージョン2(災害対策DC) | 同期レプリケーション | 地理的冗長性確保 |

| クラウドバックアップ | 暗号化バックアップ(S3他) | 長期保管と法令遵守 |

緊急時・無電化時・システム停止時の3段階オペレーション

BCPでは緊急時を以下の3段階に分けてオペレーションを設計します。

- 緊急時(軽微障害発生時):

- Correctable Error多数発生時に、障害予兆として自動アラート通知を受信

- 即座に対象メモリスロットを交換し、RAIDリビルドを実施

- データ可用性を維持するため、外部クラウドストレージへのテンポラリ書き出しを実施

- 無電化時(停電発生時):

- UPS(無停電電源装置)による短期稼働継続

- ポータブルバッテリーおよびラックマウント型外付けバッテリーの活用

- 重要サービスを限定して維持し、バックアップDCへフェイルオーバー

- システム停止時(大規模障害や災害時):

- 直ちに災害対策DCへフェイルオーバーし、サービス再開

- クラウドバックアップからデータリストアを準備

- 必要に応じてオンサイト作業を実施し、リージョン1を復旧する計画

10万人以上規模環境での細分化計画

大規模ユーザーを抱える環境では、さらに細分化が必要です。例として以下を検討します。

- ユーザーグループ別リカバリ優先度設定: - 重要ユーザー(管理者、経営層)向けサービス

- 一般ユーザー向けファイル共有サービス

- バッチ処理・分析用途の非リアルタイムサービス - ロケーション別運用分散: - 本社DC、支社DC、クラウド各リージョンを活用し、状況に応じたフェイルオーバーポイントを設定

- 段階的リハーサル実施: - 年間訓練計画を策定し、月次・四半期・半期ごとにテスト種別を変更 - 大規模模擬障害演習を半年に1回実施し、関係者間の連携を確認

| 分類 | 対象サービス | フェイルオーバー手順 |

|---|---|---|

| 重要ユーザー向け | 経営ポータル、財務システム | 即時本社DC→支社DCフェイルオーバー |

| 一般ユーザー向け | ファイル共有、メールサービス | 冗長化クラウドへのフェイルオーバー |

| 非リアルタイムサービス | 分析バッチ、ログ集計 | リージョン2にて復旧後、順次再開 |

上記のように、ユーザー特性やサービス種別ごとに

フェイルオーバー優先度を設定することで、効率的なシステム停止防止が可能です。[出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年]

本章では「BCP設計と運用のポイント」を説明しました。上司へは「データ三重化と段階的フェイルオーバーの仕組みを導入して、事業継続を確実にする必要がある」ことを訴求してください。

技術担当者としては、定期的に模擬訓練を実施し、ログやメトリクスをもとに改善点を洗い出すことが重要です。特に無電化時のUPS稼働時間やクラウドバックアップのリストア速度を把握しておきましょう。

システム設計時の考慮事項

本章では、NASを含むITインフラ全体のシステム設計段階でECCメモリエラーやデジタルフォレンジック要件をどのように組み込むかを解説します。技術担当者が社内で設計案を共有する際に重要な留意点を示します。

ハードウェア設計のポイント

ハードウェア面では以下の要素を考慮します。

- ECCメモリ搭載サーバー選定:NASやサーバーを検討する際、ECC対応の有無を必ず確認します。12Gbps以上のメモリチャンネルを持つ機種を選ぶと将来性があります。[出典:経済産業省『データセンター運用ガイドライン』2022年]

- RAID構成:RAID5では1ディスク故障しか許容しないため、RAID6以上(2ディスク冗長)を推奨します。これによりメモリ誤りがRAIDリビルド時に波及しても、二重障害まで耐えられる設計です。

- NICとネットワーク設計:10GbE以上の帯域を確保し、転送負荷が高い場面でもI/O待ち時間を減少させます。

また、IPMIやiDRACなどのリモート管理インターフェースを有効化し、ハードウェア障害発生時の迅速な対応を可能にします。 - 冷却設計とラックレイアウト:メモリ温度を適正範囲(40~60℃)に維持するため、ラック内のエアフロー設計を最適化します。ラック前後に空間を確保し、ホットアイル/コールドアイル方式を採用します。

ソフトウェア・ミドルウェア設計

ソフトウェア面では、以下の要件を盛り込みます。

- 自動フェイルオーバー機能:DRBDやPacemakerを利用し、ノード障害時に自動的にフェイルオーバーしてサービス継続を図ります。[出典:総務省『サイバーセキュリティ基本法ガイドライン』2021年]

- ファイルシステム階層化:頻繁にアクセスされるデータ用にSSDキャッシュ層を設け、バックアップ用にアーカイブ層(低速HDD)を採用。これによりI/O負荷を分散し、ECCエラーが発生した場合の影響を最小化します。

- ログ保全とWORMストレージ:システムログや監査ログをWORM(Write Once Read Many)対応ストレージに保存し、デジタルフォレンジック調査時に改ざんを防止します。[出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年]

- 暗号化とアクセス制御:AES-256などの暗号化技術を用いて、保存データの機密性を確保。NASとバックアップ先間はTLS/SSLで通信を保護し、アクセス権限をLDAP/AD連携で厳格に管理します。

デジタルフォレンジック要件の組み込み

マルウェア感染や外部/内部サイバー攻撃時に、以下の要件を設計段階で組み込みます。

- 証拠保全の自動化:FSレベルでのタイムスタンプ取得を行い、疑わしいファイル操作時には自動的にWORMストレージに複製。調査時に改ざんを検出しやすくします。

- ログ一元管理:SyslogサーバーやSIEM(Security Information and Event Management)を導入し、OSレベル/ミドルウェア/アプリケーションログを集中収集・相関分析します。[出典:総務省『サイバーセキュリティ基本法ガイドライン』2021年]

- ネットワークトラフィック監視:IDS/IPS(Intrusion Detection/Prevention System)を配置し、異常通信を検知した場合には即座にアラートを発報。ログをWORMストレージに保全します。

- データ保持ポリシー:法令による証跡保全期間(個人情報保護法では6年間、GDPRでは一般的に5年間)を考慮し、WORMストレージ保持期間を設定します。

本章では「設計段階での考慮事項」を説明しました。上司へは「ECCメモリだけでなく、RAID構成や冷却設計、WORMストレージなどの総合的な設計が必要」と伝えてください。

技術担当者としては、設計段階で図面や構成図を関係者と共有し、ECC搭載・WORMストレージを含めたフォールトトレラント設計を確実に反映することが重要です。

人材育成・人材募集と必要な資格

本章では、ECCメモリ対応やNAS運用に必要なスキル・資格を整理し、人材育成および募集戦略について解説します。技術担当者が社内向けポジション提案や採用活動を行う際に役立つ情報を提供します。

必要なスキルセット

まずは技術担当者に必要なスキルを以下に示します。

- ストレージ技術:RAID構成、ファイルシステム(ext4、xfsなど)、NAS専用OS(FreeNAS、TrueNASなど)の知識。

- メモリアーキテクチャ:ECCメモリ原理、メモリバス帯域、DRAM特性などの理解。

- ネットワーク・OS管理:TCP/IP、SNMP、IPMI、Linux操作全般(dmesg, smartmontoolsなど)に精通。

- サイバーセキュリティ・フォレンジック:IDS/IPS、SIEMツール、WORMストレージ、ログ解析技術。

- コンプライアンス知識:個人情報保護法、サイバーセキュリティ基本法、GDPRなど関連法令の基礎理解。

該当する資格例

人材募集や評価に使える主な資格は以下の通りです。

- 情報処理安全確保支援士(IPA): 情報セキュリティ全般の知識と実践力を証明。

- CISSP(Certified Information Systems Security Professional)((ISC)²): 国際的に認知されたセキュリティ資格。

- CCNP Data Center(Cisco): データセンター向けネットワーク・ストレージ技術の応用力を証明。

- LPIC-2 / RHCE(Linux認定): Linux OS管理能力の証明。

- Forensic Examiner(EC-Council): デジタルフォレンジック調査スキルを証明。

社内教育プラン例

新入社員および中途採用者向けに、以下の教育プランを推奨します。

| フェーズ | 対象者 | 内容 | 期間 |

|---|---|---|---|

| 基礎研修 | 新人/中途1年未満 | Linux基礎、ネットワーク基礎、ECCメモリ原理 | 3ヶ月 |

| 中級研修 | 経験2~3年 | RAID構成設計、NAS運用、障害対応フロー | 4ヶ月 |

| 上級研修 | 経験4年以上 | フォレンジック手法、法令要件、BCP設計 | 6ヶ月 |

* 各研修後に修了テストを実施し、スキルレベルを可視化してください。

人材募集戦略とジョブディスクリプション

求人を出す際のジョブディスクリプション(例)は以下の通りです。

- 職務概要: NAS運用・保守、ECCメモリエラー対策、RAID設計、フォレンジック調査の実施を担当。

- 必須スキル: - Linuxサーバー運用経験3年以上

- RAID構成とストレージ技術の実務経験

- セキュリティログ解析スキル

- 個人情報保護法、サイバーセキュリティ基本法の基礎知識 - 歓迎スキル: - 情報処理安全確保支援士、CISSPなどセキュリティ資格保有者

- フォレンジック調査経験

- クラウドストレージ運用経験(AWS、GCP等) - 求める人物像: - トラブル対応時に冷静に手順を遂行できる方

- 法令・ガイドライン遵守意識が高い方

- チームワークを重視し、情報共有を惜しまない方

本章では「必要スキル・資格・教育プラン」を説明しました。上司へは「ジョブディスクリプションにフォレンジックや法令知識を明記し、採用候補者のミスマッチを防止する」ことを訴求してください。

技術担当者としては、社内の教育担当と連携して研修内容をブラッシュアップし、定期的にプログラムを見直すことが重要です。採用時には候補者の技術試験だけでなく、コンプライアンス意識も評価ポイントにしてください。

運用と点検の実践

本章では、日常運用と定期点検における具体的手法を示し、NAS環境でECCメモリエラーやその他障害を未然に防ぐためのベストプラクティスを紹介します。

日常運用のポイント

日常運用では下記を実施します。

- ECCエラー監視ダッシュボード: NASベンダー提供の監視ツールやGrafanaを用いて、Correctable ErrorおよびUncorrectable Errorの発生件数をリアルタイムで可視化します。[出典:個人情報保護委員会『IT運用ベストプラクティス』2021年]

- アラート設定: Correctable Errorが一定数を超えた際にメールやチャットツールへ自動通知する仕組みを構築。具体的には「週に50件以上でアラート」など閾値を設定します。

- 定期ログレビュー: 毎週、BIOS/UEFIログ・OSカーネルログをチェックし、異常なエラー増加傾向がないかレビューします。レビュー結果は月次レポートとしてまとめ、経営層に報告します。

- 定期バックアップチェック: バックアップのリストアテストを月1回実施し、バックアップ信頼性を検証します。

定期点検の実施例

定期点検スケジュールの一例は以下の通りです。

- 週次点検: - dmesgやsyslogでCorrectable Error件数確認

- RAIDコントローラー管理画面でリビルド状況確認 - 月次点検: - BIOS/UEFIログの一括ダウンロード・解析

- バックアップリストアテスト実施 - 四半期点検: - 実機でのベンチマークテスト(memtest86など)を実施し、メモリエラー率を計測

- 冷却設備点検、ラック温度分布確認 - 半期点検: - フォレンジック演習を実施し、ログ保全手順を再確認

- BCPシミュレーション演習(障害発生を想定した机上演習)

| 頻度 | 項目 | 詳細内容 |

|---|---|---|

| 週次 | ログ確認 | dmesg/syslogのCorrectable Error確認 |

| 月次 | BIOS/UEFIログ解析 | Uncorrectable Error発生有無確認 |

| 四半期 | ベンチマークテスト | memtest86でメモリエラー率計測 |

| 半期 | フォレンジック演習 | ログ保全と調査手順の確認 |

* ベンチマークテストは業務負荷が少ない週末に実施することを推奨します。

障害対応手順書サンプル

以下は、障害発生時の手順書サンプルです。

- 手順1:アラート受信(Correctable Error閾値超過)

- 手順2:対象メモリスロット特定と交換作業

- 手順3:RAIDリビルド進捗確認

- 手順4:整合性チェック実施

- 手順5:完了報告とログ保存

本章では「日常運用と定期点検手順」を説明しました。上司へは「週次から半期までの運用・点検スケジュールを策定し、障害発生を未然に防ぐ」ことを伝えてください。

技術担当者としては、定期点検の結果を可視化し、傾向分析を行う仕組みを作ることで、予防保全を強化できます。特に四半期のベンチマークテスト結果を全員で共有し、改善策を立案してください。

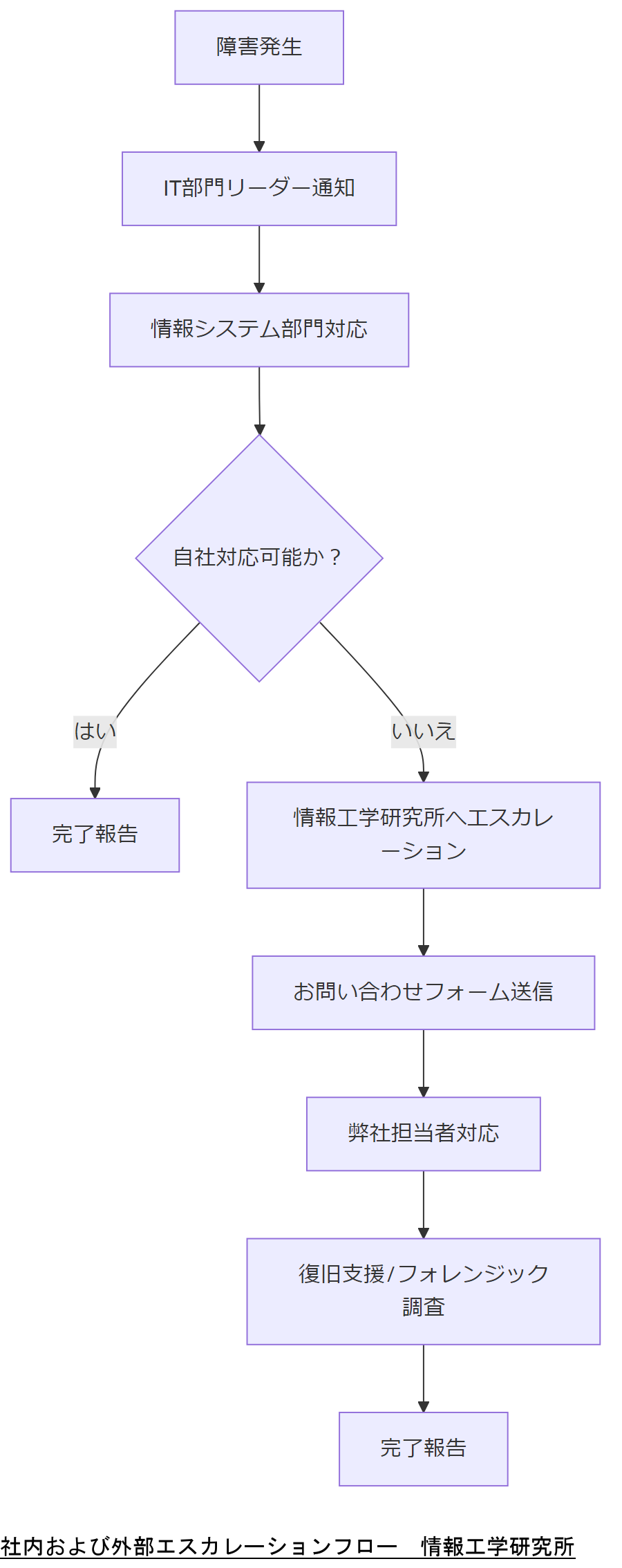

関係者と外部専門家へのエスカレーション

本章では、NAS運用において障害が発生した際の社内関係者および外部専門家へのエスカレーションフローを解説します。特に、情報工学研究所への問い合わせ手順を明確に示し、緊急時に確実な連携が取れるようにします。

社内関係者一覧と通知フロー

NASに障害が発生した場合、下記の社内関係者へ速やかに情報共有を行います。

- IT部門リーダー:初動報告を受け、対応方向性を決定します。

- 情報システム部門:システム全体の影響範囲を把握し、必要なシステム停止・再起動手順を実施。

- 法務部門:個人情報や機密情報が含まれる場合、法的リスクを評価し、報告書作成をサポート。

- 総務部門:BCP対応の連絡や社外への初期説明を担当。

- 経営層:被害状況と対応策を報告し、追加予算や意思決定を仰ぐ。

- 営業部門:顧客への影響範囲を把握し、対応状況を調整する。

外部専門家(情報工学研究所)への連絡手順

緊急時に情報工学研究所(弊社)へエスカレーションする場合、以下の手順に沿ってください。

- エスカレーション判断基準: - Uncorrectable Errorが2回以上発生した場合

- RAIDリビルド中に追加障害が発生し、自社だけで対応が困難な場合

- デジタルフォレンジック調査が必要な疑いがある場合(マルウェア感染や内部不正アクセスなど) - 情報工学研究所へのお問い合わせ: 本ページ下部に設置したお問い合わせフォームからご依頼ください。フォームに「ECC障害」「緊急復旧」「フォレンジック調査」などの要件を簡潔に記載いただくと、迅速に対応できます。

- 一次対応の可視化: 自社で実施した障害対応手順(ログ・作業手順書・結果)をExcelやPDFでまとめ、情報工学研究所へ添付してください。

- 対応連絡窓口: お問い合わせフォームにご連絡後、弊社担当者から24時間以内に返信し、必要な追加情報やスケジュールを調整します。

本章では「社内通知および外部エスカレーション手順」を説明しました。上司へは「自社対応困難時は速やかに情報工学研究所へ連絡し、フォームを活用して必要情報を提供する」ことを周知してください。

技術担当者としては、障害時の初動対応資料を日頃から整備し、いつでも情報工学研究所へ連携できる体制を構築してください。また、問い合わせ後の連絡経路をあらかじめ社内全員に共有しておきましょう。

予算獲得・投資対効果(ROI)の算出

本章では、ECCメモリ対応やNAS運用に必要な予算を獲得するための方法と、投資対効果(ROI)を算出する手順を解説します。経営層に納得してもらうための数値モデルを提示します。

初期投資費用と運用コスト比較

まず、ECCメモリ搭載NASを導入した場合と通常NASを導入した場合のコスト比較を行います(以下は概算例)。

| 項目 | 通常NAS | ECC搭載NAS | 差分 |

|---|---|---|---|

| NAS機器費用 | ¥1,000,000 | ¥1,050,000 | +¥50,000 |

| RAIDコントローラ追加費用 | ¥100,000 | ¥150,000 | +¥50,000 |

| 初期設定・導入作業費 | ¥200,000 | ¥250,000 | +¥50,000 |

| 合計初期費用 | ¥1,300,000 | ¥1,450,000 | +¥150,000 |

* 機器仕様や規模により費用は変動しますので、あくまで概算例としてご参照ください。

年間運用コスト試算

次に、年間運用コストを試算します。

| 項目 | 通常NAS | ECC搭載NAS | 差分 |

|---|---|---|---|

| 保守・サポート費用 | ¥150,000 | ¥200,000 | +¥50,000 |

| 監視運用人件費 | ¥800,000 | ¥900,000 | +¥100,000 |

| 障害対応コンサル費用 | ¥100,000 | ¥150,000 | +¥50,000 |

| バックアップ保全費用 | ¥120,000 | ¥120,000 | ±¥0 |

| 合計年間運用費 | ¥1,170,000 | ¥1,370,000 | +¥200,000 |

* 運用方法や障害頻度により変動しますので、目安としてご参照ください。

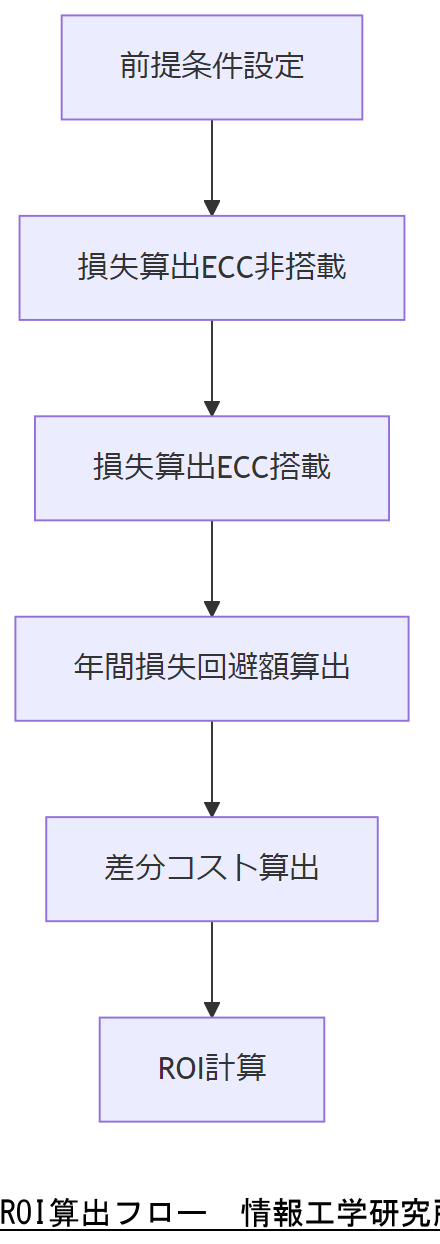

ROI(投資対効果)の算出手順

ROIを算出するためには、以下の手順を踏みます。

- 費用の合計額を把握:初期投資+年間運用コスト。

- 想定損失額の算出: - 障害時のダウンタイムコスト(例:1時間あたり¥500,000)

- 年間障害発生件数(想定)

- 正常運用時のコストとの比較で損失回避額を計算。 - ROI計算式:

ROI = (年間損失回避額 − 年間差分コスト) ÷ (初期差分コスト) × 100 (%) - シナリオ分析: 障害件数が増減したケースを想定し、複数シナリオでROIを試算。

ケーススタディ:ROI試算例

以下は、想定値を用いたROI試算例です。

- 前提条件: - 障害によるシステム停止1時間あたりの損失:¥500,000

- 年間障害発生件数(ECC非搭載時):3件

- ECC搭載後の年間障害発生件数:1件 - 年間損失(ECC非搭載):¥500,000 × 3件 = ¥1,500,000

- 年間損失(ECC搭載):¥500,000 × 1件 = ¥500,000

- 年間損失回避額:¥1,500,000 − ¥500,000 = ¥1,000,000

- 年間差分コスト:¥1,370,000 − ¥1,170,000 = ¥200,000

- 初期差分コスト:¥1,450,000 − ¥1,300,000 = ¥150,000

- ROI: (¥1,000,000 − ¥200,000) ÷ ¥150,000 × 100 ≒ 533%

上記の例では、初期投資差分¥150,000に対して、初年度で約533%のROIが見込まれます。[出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年]

本章では「ROIの算出方法」を説明しました。上司へは「ECC導入で初年度に約500%超の投資回収が可能という試算がある」ことを簡潔に示してください。

技術担当者としては、自社の実際の障害履歴やダウンタイムコストをもとに複数シナリオでROIを再計算し、経営層向けに最適なプランを提示する準備をしてください。

重要キーワード・関連キーワードマトリクス

本章では、本記事で取り上げた重要キーワードと関連キーワードをマトリクス形式で整理し、それぞれの簡潔な説明を示します。用語の理解を深めるためにご活用ください。

| 重要キーワード | 関連キーワード | 説明 |

|---|---|---|

| ECCメモリ | パリティビット Correctable Error | ビット誤りを検出・訂正するメモリ技術。1ビット違反は自動修正。 |

| RAID1・RAID6 | RAID5 ディスク冗長化 | RAID1はミラーリング、RAID6はパリティによる2重冗長化機構。 |

| BCP | RPO RTO | 事業継続計画。RPOは目標データ復旧時点、RTOは目標復旧時間。 |

| WORMストレージ | 証拠保全 タイムスタンプ | 一度書き込むと消去・改ざん不可のストレージ技術。 |

| フォレンジック | マルウェア解析 SIEM | サイバーインシデント調査のための証拠収集・分析手法。 |

| 個人情報保護法 | 匿名加工情報 委託先管理 | 個人データの取り扱いルールを定めた日本の法律。 |

| サイバーセキュリティ基本法 | NISC 安全管理措置 | 重要インフラ事業者に対するサイバー安全管理要件を規定。 |

| NIST SP 800-53 | Security Controls Risk Assessment | 米国連邦政府向けのシステム安全管理策フレームワーク。 |

| GDPR | データ主体の権利 違反罰金 | EU域内の個人データ保護を規定する法規。 |

| NIS2指令 | 重要インフラ事業者 リスクマネジメント | EU加盟国においてサイバーセキュリティ要件を強化する指令。 |

本章では「重要キーワードと関連用語」を整理しました。上司へは「用語の定義を共有し、用語の誤解を防ぐ」ことを推奨してください。

技術担当者としては、本マトリクスを参考に社内用語集を作成し、全メンバーへ配布することで、共通理解を深めることが重要です。

はじめに

NASにおけるECCメモリエラーの重要性と影響 NAS(ネットワーク接続ストレージ)は、企業にとってデータの保存と共有を効率化する重要なインフラです。しかし、その運用においてECC(Error Correction Code)メモリエラーが発生することがあります。ECCメモリは、データの整合性を維持するために誤りを検出し修正する役割を果たしますが、このエラーが発生すると、データの損失や破損のリスクが高まります。特に、重要な業務データを扱う企業にとって、これらのエラーは深刻な影響を及ぼす可能性があります。この記事では、ECCメモリエラーの原因やその影響を理解し、適切な対策を講じることで、データ整合性を維持するための復旧テクニックを紹介します。これにより、IT部門や企業経営者が直面するリスクを軽減し、安心してデータを扱える環境を整える手助けを目指します。データの安全性を確保するために、ECCメモリエラーの理解は不可欠です。

ECCメモリの基本とその役割

ECCメモリ(Error Correction Code Memory)は、データの整合性を確保するために設計された特別なタイプのメモリです。通常のメモリと異なり、ECCメモリはデータの誤りを検出し、必要に応じて修正する機能を持っています。これにより、データの破損や損失のリスクを大幅に低減できるため、特にサーバーやNAS(ネットワーク接続ストレージ)など、重要なデータを扱うシステムでの使用が推奨されます。 ECCメモリは、データを格納する際に追加のビットを使用し、誤りを検出するための数学的なアルゴリズムを適用します。例えば、1ビットの誤りが発生した場合、ECCメモリはそのビットを自動的に修正し、システムの正常な動作を維持します。この機能は、特に大規模なデータ処理を行う環境において、データの整合性を保つ上で非常に重要です。 一方で、ECCメモリにも限界があります。例えば、複数のビットエラーが同時に発生した場合、ECCメモリはそのすべてを修正することができないため、データ損失のリスクが残ります。このため、ECCメモリを使用する際は、定期的なバックアップや他のデータ保護手段と併用することが推奨されます。 ECCメモリの理解は、IT部門や企業経営者がデータの安全性を確保するために欠かせない要素です。データの整合性を維持し、ECCメモリエラーによる影響を最小限に抑えるためには、メモリの特性を理解し、適切な対策を講じることが求められます。

ECCメモリエラーの種類と原因

ECCメモリエラーには、主に「単一ビットエラー」と「複数ビットエラー」の2種類があります。単一ビットエラーは、1つのビットが誤って読み取られるか、書き込まれることで発生します。この場合、ECCメモリはそのビットを自動的に修正する能力を持っているため、通常はシステムの正常な動作に影響を与えません。一方、複数ビットエラーは、同時に2つ以上のビットが誤りを起こすことで発生します。この状況では、ECCメモリがすべてのエラーを修正できないため、データ損失や破損のリスクが高まります。 ECCメモリエラーの原因は多岐にわたりますが、一般的には以下の要因が考えられます。まず、ハードウェアの劣化や故障が挙げられます。特に、長期間使用されているメモリは、物理的な損傷や劣化が進行しやすく、エラーを引き起こす可能性があります。また、電磁干渉や温度変化などの外的要因も、ECCメモリに影響を与えることがあります。これらの環境要因は、メモリの動作に不安定さをもたらし、エラーの発生を助長します。 さらに、ソフトウェアのバグや不適切な設定もECCメモリエラーの原因となることがあります。特に、オペレーティングシステムやアプリケーションがメモリを不適切に管理すると、誤ったデータの書き込みや読み取りが発生し、エラーを引き起こすことがあります。これらの要因を理解し、適切な対策を講じることが、ECCメモリエラーによるデータ損失を防ぐための第一歩です。

データ整合性を保つための監視と検出方法

データ整合性を保つためには、ECCメモリエラーを早期に監視し、検出することが重要です。まず、システムの監視ツールを導入することで、メモリの状態をリアルタイムで把握することができます。これにより、エラーが発生した際に即座に通知を受け取ることができ、迅速な対応が可能になります。 また、定期的なメモリ診断を実施することも有効です。これには、専用の診断ツールを使用してメモリの健全性をチェックし、潜在的な問題を事前に発見する方法があります。特に、ECCメモリのエラーログを確認することで、エラーの発生頻度やパターンを把握し、異常を早期に察知することができます。 さらに、バックアップ戦略の一環として、データの整合性を定期的に確認することも重要です。データが正しく保存されているか、整合性が保たれているかを検証するために、ハッシュ値やチェックサムを利用する方法があります。これにより、データの破損や損失のリスクを軽減し、必要に応じて迅速に復旧作業を行うことが可能になります。 このような監視と検出の手法を組み合わせることで、ECCメモリエラーによるデータの損失を防ぎ、企業のデータ整合性を維持することができます。データの安全性を確保するためには、これらの対策を日常的に実施することが求められます。

エラー発生時の対処法と復旧手順

ECCメモリエラーが発生した際の対処法は、迅速かつ適切な対応が求められます。まず、エラーが検出された場合は、システムの運用を一時停止し、メモリの状態を確認することが重要です。これにより、追加のエラーが発生するリスクを軽減できます。 次に、エラーログを確認し、どのメモリモジュールでエラーが発生したのかを特定します。特定できたら、該当するメモリモジュールを物理的に取り外し、再接続することで接触不良を解消できる場合があります。これにより、エラーが解消されることもあるため、試みる価値があります。 もしエラーが続く場合は、メモリ診断ツールを使用して、詳細なテストを実施します。これにより、メモリの健全性をチェックし、故障の兆候を早期に発見することが可能です。診断結果に基づいて、必要に応じてメモリモジュールの交換を検討します。 最後に、データのバックアップを確認し、必要に応じて復旧作業を行います。特に、ECCメモリが複数ビットエラーを引き起こした場合、データの損失が発生する可能性が高いため、バックアップデータを利用して迅速にシステムを復旧させることが重要です。これらの手順を踏むことで、ECCメモリエラーによる影響を最小限に抑え、データの整合性を維持することができます。

NAS環境でのECCメモリの選び方と推奨製品

NAS環境でのECCメモリの選び方は、データの安全性とシステムの信頼性を確保するために非常に重要です。まず、ECCメモリの容量を選定する際は、NASに搭載する予定のアプリケーションやサービスの要求リソースを考慮することが必要です。一般的に、データベースや仮想化環境では、より大きなメモリ容量が求められます。これにより、システムのパフォーマンスを向上させ、同時にデータ整合性を維持することが可能です。 次に、メモリの速度も重要な要素です。ECCメモリの速度は、システム全体のレスポンスに影響を与えるため、使用するNASの仕様に合った速度のメモリを選ぶことが推奨されます。例えば、最新のDDR4 ECCメモリは、従来のDDR3よりも高いパフォーマンスを提供します。 また、信頼性の高いメーカーからの製品選びも大切です。信頼性の高いメーカーは、厳格な品質管理を行っており、長期間の使用に耐える製品を提供しています。さらに、保証期間やサポート体制も確認し、万が一のトラブルに備えることが重要です。 最後に、ECCメモリの導入後は、定期的なメモリ診断を行い、メモリの健全性を確認することを忘れないようにしましょう。これにより、ECCメモリの潜在的な問題を早期に発見し、データの整合性を維持することができます。正しいECCメモリを選ぶことで、NAS環境におけるデータの安全性を高めることができるでしょう。

ECCメモリによるデータ保護の重要性の再確認

ECCメモリは、データの整合性を維持するために不可欠な要素であり、特にNAS環境においてその重要性が際立ちます。ECCメモリは、誤りを検出し修正する機能を持ち、データ損失や破損のリスクを大幅に低減します。この記事では、ECCメモリエラーの原因や影響、監視手法、対処法、さらにはメモリ選定のポイントについて詳しく解説しました。 ECCメモリの適切な運用により、企業はデータの安全性を高め、業務の継続性を確保することが可能になります。また、定期的なメモリ診断やバックアップ戦略を実施することで、潜在的な問題を早期に発見し、迅速な対応ができる環境を整えることが重要です。データの整合性を維持するためには、ECCメモリの特性を理解し、適切な管理と対策を講じることが求められます。これにより、企業は安心してデータを扱い、ビジネスの成長を支える基盤を築くことができるでしょう。

今すぐECCメモリの導入を検討しよう!

ECCメモリの導入は、データ整合性を確保し、企業の情報資産を守るための重要なステップです。ECCメモリは、データの誤りを検出し修正する機能を持ち、特に重要なデータを扱う環境において、その効果を発揮します。今こそ、ECCメモリを導入することで、システムの信頼性を高め、データ損失のリスクを軽減することを検討してみてはいかがでしょうか。 導入にあたっては、適切な容量や速度を選定し、信頼性の高いメーカーからの製品を選ぶことが大切です。また、導入後は定期的なメモリ診断を行い、メモリの健全性を確認することで、長期的なデータ保護を実現できます。ECCメモリを活用することで、ビジネスの継続性を確保し、安心して業務を進めるための基盤を築くことができるでしょう。データの安全性を高めるために、ぜひECCメモリの導入を検討してください。

ECCメモリの導入時に知っておくべきこと

ECCメモリの導入時には、いくつかの重要な注意点があります。まず、ECCメモリは通常のメモリと異なるため、システムがECCメモリに対応しているかを確認することが不可欠です。特に、マザーボードやプロセッサがECCをサポートしていない場合、ECCメモリを導入してもその機能を活用することができません。 次に、ECCメモリの選定においては、互換性に注意が必要です。異なるメーカーやモデルのメモリを混在させると、システムの安定性に影響を及ぼす可能性があります。したがって、同一のブランドや仕様のメモリを使用することが推奨されます。 また、ECCメモリはデータの整合性を保つための重要な要素ですが、完全な防御策ではありません。複数ビットエラーが発生した場合や、他のハードウェア障害が発生した場合には、データ損失のリスクが残ります。定期的なバックアップや、他のデータ保護手段との併用が重要です。 さらに、ECCメモリは通常のメモリよりもコストが高くなることがあります。導入前に、予算と必要な性能をよく考慮し、投資の価値を見極めることが大切です。これらの注意点を理解し、適切に対策を講じることで、ECCメモリの効果を最大限に引き出すことができるでしょう。

補足情報

※株式会社情報工学研究所は(以下、当社)は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。