id uname -a lsblk pvs vgs lvs lvscan vgscan dmesg | tail -n 80

pvscan vgscan --mknodes vgchange -ay lvscan lvs -a -o+devices

lvm pvscan lvm vgscan --mknodes lvm vgchange -ay ls -l /dev/mapper cat /proc/cmdline grep -E 'mapper|lvm|uuid' /etc/fstab 2>/dev/null || true

mount | head dmesg | tail -n 120 lvs -o lv_name,lv_attr,lv_size,segtype,devices lvdisplay -m 2>/dev/null || true

lvs -a -o lv_name,lv_attr,lv_size,origin,data_percent,metadata_percent,segtype,devices dmsetup ls dmsetup info -c journalctl -k -n 200 2>/dev/null || true

mount | grep -E ' / |/var|/home|/data' || true df -hT | head findmnt -no SOURCE,TARGET,FSTYPE,OPTIONS / 2>/dev/null || true ls -l /dev/mapper lvs -a -o lv_name,lv_attr,lv_size,devices pvs -o pv_name,pv_uuid,pv_size,pv_free,vg_name vgs -o vg_name,vg_uuid,vg_size,vg_free,vg_attr

- 復旧を急いで vgcfgrestore や pvcreate を先に打ってしまい、元のメタ情報が上書きされて復旧が長期化する。

- Thin/スナップショットの状態を見ずに書き込みを発生させ、破損範囲が広がって起動不能やデータ欠損につながる。

- 共有ストレージやNFS/クラスタで単独判断して操作し、他ノード側で整合性崩れやサービス停止を招く。

- 監査/証跡が必要な環境で手順を残さずに変更し、原因究明が難しくなって再発防止や監査対応が通らなくなる。

もくじ

- 第1章:『またLVMか…』夜間障害で最初に湧くため息と、焦りの正体

- 第2章:LVMは「PV→VG→LV→FS→アプリ」の積み木—どこが崩れたかを5分で見抜く地図

- 第3章:典型パターンで当たりを付ける(ディスク消失/VGメタデータ破損/thin-pool枯渇/スナップショット地雷)

- 第4章:復旧を遅くする“やりがち”を止める(書き込み継続・再起動連打・fsck早押し)

- 第5章:まずは「読める状態」を最短で作る—レスキュー起動とRead-Only方針、必要ログの採取

- 第6章:アクティベーション戦略(部分起動・フィルタ・優先順位)—`pvscan/vgchange/lvchange` の使い分け

- 第7章:メタデータ復旧の王道—`vgcfgrestore` と「UUID/順序/バックアップ」の罠を回避する手順

- 第8章:thin-provisioning/スナップショット絡みの復旧—“見えてるのに読めない”を切り分ける

- 第9章:時間効率の最適化—RTOから逆算する選択(復旧/退避/再構築)とRunbook・自動化の作り方

- 第10章:結論:復旧の速さはコマンド力より「判断の順序」—LVM障害を“作業”から“運用設計”に変える

【注意】本記事は、Linux環境でLVM(Logical Volume Manager)障害が発生した際の一般的な復旧アプローチと、復旧時間(RTO)を短縮するための考え方を整理した情報提供です。実環境ではストレージ構成(RAID/仮想化/クラウド/暗号化/マルチパス)や障害の進行度、業務優先度によって最適解が変わります。誤った操作でメタデータ更新や上書きが起きると復旧難易度が上がるため、重要データが関わる場合は株式会社情報工学研究所のような専門事業者への相談を検討してください。

第1章:『またLVMか…』夜間障害で最初に湧くため息と、焦りの正体

夜間に鳴るアラートで、ルートFSが読めない/サービスが起動しない/iSCSIやローカルディスクが見えない──この手の状況で「またLVMか…」とため息が出るのは自然です。LVMは柔軟ですが、PV/VG/LVという抽象化の層が増えるぶん、原因の場所を外すと復旧が一気に遠回りになります。

現場の頭の中は、だいたいこんな感じになりがちです。

「復旧はできる気がする。でも、今は時間がない。どのコマンドが“安全”なんだっけ?」

この“焦り”の正体は、技術力不足ではなく、判断すべき軸が同時に複数あることです。

- RTO(復旧目標時間):何分〜何時間で復旧させる必要があるか

- RPO(許容されるデータ損失):直近の書き込みが失われても許容できるか

- 被害最小化(ダメージコントロール):今この瞬間の操作で、損傷を広げないか

- 復旧ルート:直すのか/読むだけにするのか/退避して再構築するのか

LVM障害では、まず“直す前に、広げない”が原則です。復旧を急ぐほど、書き込みを伴う操作(=メタデータ更新や再同期)を踏みがちで、これが後から効いてきます。ここで必要なのは、精神論ではなく順序です。

このブログのゴール:復旧の速さを「コマンドの暗記」ではなく「判断の順序」に落とす

本記事では、LVM障害を「頑張って全部追う」ではなく、層を切り分けて、最短で“読める状態”に戻すための考え方を整理します。特に終盤では、一般論の限界(構成差・障害差・業務差)を踏まえたうえで、個別案件では専門家に相談すべき判断ラインも明確にします。

まず次章で、LVMを“積み木”として把握し、どこが崩れたかを短時間で特定する地図を作ります。

第2章:LVMは「PV→VG→LV→FS→アプリ」の積み木—どこが崩れたかを5分で見抜く地図

LVM障害の切り分けは、まず層で考えるのが最短です。代表的には次の積み木になります。

- PV(Physical Volume):物理ディスクやパーティション(/dev/sdX, /dev/nvme0n1pX など)

- VG(Volume Group):PVを束ねたグループ

- LV(Logical Volume):実際にマウントされるブロックデバイス(/dev/<vg>/<lv>)

- FS(File System):ext4/xfs 等

- アプリ/ミドル:DB、コンテナ、Kubernetes、仮想マシンなど

“崩れている層”がどこかで、やることが変わります。たとえば、PVが見えていないのにLV側を触っても進みませんし、LVは出ているのにFSが壊れているならLVM操作では直りません。

まず5分でやる観察(原則:読み取り中心)

いきなり修復コマンドに走らず、まず観察します。観察は基本的に副作用が小さいからです(ただし環境によって例外はあるため、重要データはレスキュー環境+Read-Only方針が安全です)。

- ブロックデバイスの見え方:

lsblk -f,blkid - カーネルログ:

dmesg -T,journalctl -k - LVMの状態:

pvs,vgs,lvs -a -o +devices - スキャン:

pvscan,vgscan(必要に応じて)

ここで重要なのは「見えていないのは何か」を言語化することです。典型的な症状と疑う層の対応を、表に落とします。

| 症状 | 疑う層 | 最初の確認 | 時間効率の観点 |

|---|---|---|---|

| /dev/sdX 自体が消えた/不安定 | PVより下(物理/仮想/RAID/パス) | dmesg, lsblk, multipath, RAID状態 | 上位を触る前に下位の安定化が最優先 |

| PVは見えるがVGが見えない | VGメタデータ/フィルタ/UUID競合 | pvs/vgs, vgscan, /etc/lvm/lvm.conf | 原因が合えば復旧は速いが、誤操作で悪化しやすい |

| VGは見えるがLVがinactive | LVアクティベーション/依存関係 | lvs -a, vgchange -ay, lvchange | “部分起動”で読むだけに寄せると早い |

| LVは出るがmountできない | FS(ext4/xfs等) | fs種別確認、read-only mount試行 | LVMをいじるよりFS側の判断が時短 |

| thin/snapshot絡みで容量逼迫 | thin-pool/スナップショット | lvs -a, poolのusage確認 | “枯渇”は時間を食うので早期発見が重要 |

「いま直す」より「いま読める」へ寄せると復旧時間が短くなる場面がある

RTOが厳しい現場では、完全修復よりもまず読める状態にして退避し、再構築で整える方が早いことがあります。特に、原因がストレージ下位(物理障害やパス不安定)にありそうな場合は、上位で頑張るほど時間が溶けます。

次章では、よくあるLVM障害のパターンを整理し、最短で当たりを付ける方法に進みます。

第3章:典型パターンで当たりを付ける(ディスク消失/VGメタデータ破損/thin-pool枯渇/スナップショット地雷)

LVM障害は無限に見えますが、現場で遭遇頻度が高い“型”があります。型に当てはめて当たりを付けると、復旧時間が短くなります。

パターンA:PVが消えた/不安定(デバイス断・RAID劣化・パス問題)

症状は分かりやすく、lsblkに出たり消えたり、dmesgにI/O errorやreset、nvme timeout、SAS link reset等が出ます。ここで焦ってLVM側をいじると、スキャンが遅延したり、状態が揺れて判断が難しくなります。

- まずは下位の安定化(RAIDコントローラ/ハイパーバイザ/ストレージ/ケーブル/パス)

- 可能ならRead-Onlyでの退避を優先し、書き込みを増やさない

この段階は、いわば現場の温度を下げる(クールダウン)フェーズです。復旧の手数を増やさず、状況を固定する方が結果的に早いことが多いです。

パターンB:VGメタデータが読めない/UUID競合(クローンや復元後の衝突も含む)

「PVは見えるのにVGが出ない」「別のVG名が出る」「同じPV UUIDが複数見える」などは、メタデータや識別子周りの問題が疑われます。特に、ディスククローンやスナップショット復元を行った環境では、同一UUIDが二重に存在してスキャン結果が不安定になることがあります。

pvs -o +pv_uuid,vg_name,pv_nameでUUID重複の気配を確認vgsが空、または想定外のVGが出る場合は、誤ったアクティベーションを避ける

ここは“直しにいく”ほど危険が増えやすいポイントです。なぜなら、復旧コマンドの多くはメタデータを書き換える可能性があるからです。環境が複雑(マルチパス、SAN、仮想化)なほど、慎重に段取りを組む価値があります。

パターンC:thin-pool枯渇(thin-provisioningの“詰まり”)

thin LV環境では、プールのデータ領域やメタデータ領域が逼迫すると、LVがI/Oエラーになったり、ファイルシステムがRead-Onlyに落ちたりします。ここで容量を足す/削る判断を誤ると、復旧が長期化します。

lvs -a -o lv_name,vg_name,lv_attr,lv_size,data_percent,metadata_percentで逼迫を可視化- メタデータが枯渇している場合は、拡張や修復の手順が環境依存になりやすい

thinは便利ですが、障害時は「いつの時点の整合性を優先するか(RPO)」が絡みます。RTOが厳しいなら、まずRead-Onlyで読める範囲を確保し、退避→再構築のほうが速いケースもあります。

パターンD:スナップショット地雷(想定外に肥大化/COW領域枯渇)

LVMスナップショットは、取り方・保ち方を間違えると障害の引き金になります。COW領域が不足するとスナップショットが破綻し、性能劣化やI/Oエラーにつながることがあります。

lvs -aでsnapshotの存在とサイズを確認- 「いつ作ったか」「何のためか」が不明なsnapshotがあるなら、まず状況整理

「消せば速いでしょ」と思いがちですが、環境によっては消す操作が重い、あるいは依存関係があり得ます。時間効率の観点では、“消す/直す”より“読む”に寄せる判断が有利になることがあります。

この章のまとめ:型に当てて、次にやることを3つまでに絞る

LVM障害対応が長引く原因の多くは、「やることが多い」ではなくやることが絞れていないことです。まずは型に当て、次にやることを最大でも3つ程度に絞る。これが復旧時間を短くする最初のコツです。

次章では、復旧を遅くする“やりがち”を整理し、被害最小化(ダメージコントロール)として何を避けるべきかを具体化します。

第4章:復旧を遅くする“やりがち”を止める(書き込み継続・再起動連打・fsck早押し)

LVM障害の現場で時間を溶かすのは、技術が足りないからではなく「急いでいる時ほど踏みやすい地雷」が多いからです。ここでは、復旧時間を伸ばしやすい“やりがち”を、なぜ危ないのかまで含めて整理します。

やりがち①:通常起動を繰り返す(再起動連打)

「起動しないなら再起動」が反射で出るのは分かります。ですが、通常起動はサービスが自動で動くため、意図せぬ書き込みが発生しやすいです。systemdが起動し、ログが増え、DBがリカバリを始め、場合によってはファイルシステムのジャーナル再生が走ります。

心の会話でいうと、こうなりがちです。

「一回だけ…起動すれば状況が分かるかも」

ところが、障害の種類によっては、その“一回”が後で効きます。特に、下位ストレージが不安定な場合、リトライのたびに読み取り不能セクタに当たり続ける、あるいはRAIDコントローラがエラーを蓄積して状況が悪化することがあります。

やりがち②:fsckを即実行(特にオプション付き)

「mountできない→fsck」は定番ですが、fsckは基本的に書き込みを伴う修復です。ファイルシステム破損が疑われるときほど、まずはRead-Onlyで状態を観察し、必要ならクローン/イメージを取ってから判断する方が、被害最小化(ダメージコントロール)につながります。

また、ファイルシステムの種類により考え方が違います。特にXFSは設計上、ext系と同じノリで扱うと危険が出ます(詳細は後章で触れます)。

やりがち③:LVMを「作り直す系」のコマンドを試す

緊急時に検索して出てきた断片をつなぎ合わせると、次のようなコマンドに手が伸びやすいです。

pvcreate/vgcreate/lvcreatevgreduce/pvremovelvremove/mkfs

これらはディスク上のメタデータを書き換える可能性が高いため、既存データが関わる復旧フェーズでの実行は要注意です。特にpvcreateやmkfsは、上書きの入口になり得ます。

やりがち④:状態が揺れているのにスキャンを繰り返す(状況が変わる)

下位ストレージが不安定なとき、pvscanやvgscanの実行結果が毎回違うことがあります。これが起きると、切り分けが難しくなるだけでなく、操作判断がブレます。まずは「見え方が揺れていないか」を確認し、揺れているなら下位の安定化・固定化を優先する方が結果的に早いです。

| 行動 | 起きがちな副作用 | 代替(時間効率の良い順序) |

|---|---|---|

| 通常起動を繰り返す | 自動書き込み・ログ増加・復旧処理の自走 | レスキュー起動→必要最小の観察→Read-Onlyで退避 |

| fsck即実行 | 修復の書き込みで状況が変わる/誤修復 | Read-Onlyマウントで確認→退避→必要時に段階的判断 |

| pvcreate/mkfs等 | メタデータ上書きのリスク | 現状メタデータの保全→バックアップ/スナップ取得→復旧手順へ |

| スキャン連打 | 結果の揺れで判断が崩れる | 下位の安定化→構成を固定→再現性ある観察 |

この章のまとめ:「やらないこと」を先に決めると復旧が速くなる

LVM障害対応は、やることを増やすほど速くなるわけではありません。むしろ「やらない」を先に決めると、被害最小化(ダメージコントロール)と時間短縮を両立しやすくなります。

次章では、実務で効果が大きい「レスキュー環境+Read-Only方針」で、まず“読める状態”を最短で作る具体策に進みます。

第5章:まずは「読める状態」を最短で作る—レスキュー起動とRead-Only方針、必要ログの採取

RTOが厳しい現場ほど、「完全復旧」より先に“読める状態”を作って退避するだけで一気に前進します。ここでの狙いは、環境を落ち着かせる(クールダウン)ことではなく、状況を固定し、再現性のある判断材料を揃えることです。

ステップ1:通常OSではなくレスキュー環境で起動する

可能なら、レスキューISOやメンテナンスモードなど、サービスが自動起動しにくい環境で起動します。理由は単純で、通常OSは勝手に動くものが多く、障害時に余計な書き込みが走りやすいからです。

心の会話としてはこうです。

「とにかく起動して、画面が出れば安心できるのに…」

ただ、復旧の観点では「安心」より「安全(副作用の少なさ)」が重要です。重要データが絡むならなおさらです。

ステップ2:Read-Only方針を“具体的な操作”に落とす

Read-Onlyと言っても、抽象的に「書かない」だけでは足りません。実務では、次の3点をセットで揃えると事故が減ります。

- LVをRead-Onlyで扱う(可能なら)

- ファイルシステムはRead-Onlyでマウント

- ジャーナル/ログのリプレイを抑制(FS種別により)

| 対象 | Read-Only寄せの例 | 狙い |

|---|---|---|

| LV(LVM) | lvchange -pr /dev/<vg>/<lv>(環境により可否) | ブロック層での誤書き込み抑制 |

| ext系FS | mount -o ro,noload(ジャーナル再生を避ける意図) | 自動修復・更新の抑制 |

| XFS | mount -o ro,norecovery | ログリプレイを避け、状態を固定 |

注意点として、オプションや挙動はディストリビューションやカーネル、運用方式(暗号化、MD RAID、ハードRAID、仮想化)で差があります。ここが「一般論の限界」が出る最初のポイントです。

ステップ3:必要ログとLVM情報を“持ち出せる形”で採取する

復旧の速さは、経験だけでなく「材料の揃い方」で決まります。最低限、次を揃えると、後続の判断が速くなります。

- ブロック構成:

lsblk -f,blkid - カーネルログ:

dmesg -T,journalctl -k(取れる範囲で) - LVM状態:

pvs,vgs,lvs -a -o +devices - マルチパス/RAID情報(該当時):

multipath -ll,mdadm --detail等

そして可能なら、LVMメタデータのバックアップファイル(/etc/lvm/backup/ や /etc/lvm/archive/)を外部に退避します。これはディスク上のメタデータを直接いじる前に、判断材料を確保する意味で重要です(環境によって場所や運用が異なるため、存在確認が必要です)。

ステップ4:最短復旧のための“優先順位”を決める(全部を一気に戻さない)

復旧を速くするコツは、最初から100%を狙わないことです。たとえば次の順序は、実務で時間効率が良いことが多いです。

- 業務上いちばん重要なデータ領域(DB/共有領域/VMイメージ)のRead-Onlyマウント

- 退避(別ストレージへコピー、スナップ、イメージングなど)

- 原因究明と恒久対応(直す/再構築する)

「全部まとめて直したい」という気持ちは自然ですが、RTOが厳しいほど、まず“必要なところだけ読める”に寄せるのが、結果として復旧時間を短縮します。

次章では、LVMのアクティベーション(起動)を“安全に・速く”進めるための戦略(部分起動、フィルタ、優先順位)を整理します。

第6章:アクティベーション戦略(部分起動・フィルタ・優先順位)—「見える」までを最短にする

LVM障害の現場で意外と時間を食うのが、「VG/LVが見えない」「見えているのにactiveにならない」のフェーズです。ここは闇雲にコマンドを増やすより、“見え方を安定させる”→“必要なものだけ起動する”の順に寄せると、復旧時間が短くなりやすいです。

1) まず「スキャン対象」を整理する(遅延と誤認識に歯止めをかける)

LVMはデバイスを走査してPV/VG/LVを組み立てます。環境によっては、探索対象が多いほど遅くなり、また意図しないデバイス(古いクローン、退避用ディスク、別系統のSANパス)が混ざるほど判断が難しくなります。

ここで重要なのは、「コマンドが遅い=LVMが壊れている」と決めつけないことです。現場の心の会話としてはこうなりがちです。

「vgscanが終わらない…もうメタデータが壊れてるんじゃ?」

でも実際には、下位のI/O遅延やマルチパスの揺れ、探索対象が多すぎることが原因で“終わらない”ように見えることもあります。まずは lsblk と dmesg で、デバイスの列挙が安定しているかを確認し、必要なら探索対象を絞る(運用設計・設定の見直し)発想を持つのが、結果的に速いです。

2) 「全部起動」より「必要なVG/LVだけ起動」を優先する

RTOが厳しいときほど、いきなり全VGを起動するのではなく、業務的に必要な領域だけを起動して“読める状態”に寄せる方が時短になります。たとえば次の順序です。

pvs/vgs/lvs -a -o +devicesで、どのLVがどのPVに乗っているかを把握- 対象VGだけを起動:

vgchange -ay <VG> - 対象LVだけを起動:

lvchange -ay /dev/<VG>/<LV> - ファイルシステムはRead-Onlyでマウントし、必要データを退避

ポイントは、「起動できたこと」より「退避できたこと」を成果にすることです。復旧対応は、最後に“完全復旧”の形に戻せても、途中で時間切れになれば意味が薄れます。まず成果を積み上げる設計(優先順位)を置くと、現場の温度を下げる(クールダウン)効果も出ます。

3) activeにならないときは「理由」を短時間で切り分ける

LVがactiveにならない理由は複数あります。ここで大事なのは、原因を“層”に戻して短時間で特定することです。

- 下位デバイス不安定:dmesgにI/O error、reset、timeoutが出ていないか

- 依存関係:暗号化(LUKS)やマルチパス、MD RAIDが先に揃っているか

- thin/snapshot関連:thin-poolが起動できていない、容量逼迫がないか(次章で詳細)

- 属性/状態:

lvs -a -o lv_name,lv_attr,segtype,devicesで、状態フラグを確認

「とりあえず起動しないから別コマンド」を繰り返すと、作業が散らばって時間が溶けます。逆に、理由が特定できれば、次の一手は少なくなります。

この章のまとめ:アクティベーションは“速さ”より“順序”で短縮できる

LVMの起動は、コマンドの暗記勝負ではありません。探索対象を整理し、必要なVG/LVだけを優先して起動し、Read-Onlyで退避する。この順序に寄せるだけで、復旧時間が短縮される場面が多いです。

次章では、LVM復旧の本丸になりやすいメタデータ復旧(vgcfgrestore等)について、事故を避ける段取りと、どこで専門家判断が必要になるかを整理します。

第7章:メタデータ復旧の王道—`vgcfgrestore` と「UUID/順序/バックアップ」の罠を回避する

LVM障害で「PVは見えるのにVGが壊れている」「VG名は出るがLV構成が崩れている」など、メタデータ起因が疑われる場合、復旧の中心に出てくるのがバックアップされたメタデータの扱いです。

LVMメタデータは「どこにあるか」

LVMのメタデータは、基本的にPV上(ディスク上)に保存されます。一方で、多くの環境ではOS側にもメタデータのバックアップ/アーカイブが残る構成になっています(代表例として /etc/lvm/backup/ や /etc/lvm/archive/ にVG単位のファイルが残るケースがあります)。

ここで重要なのは、バックアップが“ある”ことと、“正しい”ことは別、という点です。たとえば以下の事情で、バックアップが現在の実体と一致しないことがあります。

- ディスク交換・構成変更後にバックアップが更新されていない

- 別ホストからディスクを移設しており、バックアップがそのホストにない

- クローンやスナップショットにより、UUIDが衝突している

- 障害発生後の操作で状態が変わり、バックアップ時点とズレた

つまり、メタデータ復旧は「コマンドを打てば直る」ではなく、どの時点の定義に戻すか(RPO/RTO)の判断が入ります。

`vgcfgrestore` の位置づけ:強力だが“書き換え”である

vgcfgrestore は、保存されたVGメタデータを用いて、VG構成を復旧させるための仕組みです。ここで必ず押さえるべきは、メタデータの復元=ディスク上の定義を書き換える可能性があるという点です。

現場の心の会話としてはこうなります。

「バックアップがあるなら戻せばいい。最短で復旧できるはず」

その発想自体は合理的ですが、戻す定義を間違えると復旧が遠のくことがあります。たとえば、PVの並びやUUID対応がズレた状態で復元すると、VGは見えるようになってもLVが欠損扱いになる、あるいは意図しないPVに紐づくなど、後工程で詰まります。

事故を避ける段取り:復元前に“材料を揃える”

メタデータ復旧を検討するなら、最低限次の材料を揃えると判断が速くなります。

- 現在のPV/VG/LV情報:

pvs,vgs,lvs -a -o +devices - OS側に残るバックアップ/アーカイブ(存在するなら退避)

- ブロックデバイスの実体:

lsblk -f,blkid - カーネルログ:I/Oエラーや切断の痕跡(

dmesg -T)

この材料があるだけで、「今のPV群に対して、どのメタデータファイルが整合しそうか」「UUID衝突を疑うべきか」が判断しやすくなります。

UUID衝突の罠:クローン/スナップ復元後に起きやすい

現場で増えているのが、クローンディスクやストレージ側スナップショット復元後に、同一UUIDを持つPVが複数存在して混乱するケースです。この場合、LVMは“どちらが正か”を自動では決められず、見え方が不安定になったり、意図しない側を拾ったりします。

ここで無理に復元系コマンドを進めると、状況がさらに複雑になります。まずはデバイスを整理し、「正しいPV群だけが見える」状態に寄せる(歯止めをかける)ことが、時間効率の面でも合理的です。

専門家判断が入りやすいライン:RAID/暗号化/仮想化/マルチパスが絡むと一気に難度が上がる

メタデータ復旧は、単体ディスク+単純なVGなら比較的整理しやすい一方で、以下が絡むと判断の分岐が増えます。

- RAID(ハード/ソフト)配下のPV

- LUKSなど暗号化の上にLVM(またはその逆)

- SAN+マルチパスでPVが複数パスに見える

- 仮想化基盤(VMFS等)上の仮想ディスクで下位に制約がある

このあたりからは、一般論だけで「これをやれば直る」と断言しづらくなります。誤った書き換えが復旧難易度を上げるため、重要データや期限が厳しい案件では、株式会社情報工学研究所のような専門事業者に状況整理(構成・ログ・優先順位)から相談するのが合理的です。

次章では、thin-provisioningやスナップショットが絡むときに起きる「見えてるのに読めない」「容量があるのにI/Oが止まる」といった現象を、切り分けの観点で整理します。

第8章:thin-provisioning/スナップショット絡みの復旧—“見えてるのに読めない”を切り分ける

LVMのthin-provisioning(thin LV)やスナップショットは、平常時は運用を柔軟にしますが、障害時には「見えているのに読めない」「I/Oが突然エラーになる」「Read-Onlyに落ちる」といった形で、現象が分かりにくくなります。ここでのポイントは、“容量”ではなく“プール状態”を見ることです。

1) まずはthin-poolの使用率を“数字”で押さえる

thin環境では、LV単体の空き容量だけを見ても判断できません。thin-poolのデータ領域(data)やメタデータ領域(metadata)が逼迫していると、I/Oが不安定になったり停止したりします。代表的には、lvs の拡張表示で使用率を確認します(表示項目は環境により異なるため、可能な範囲で data/metadata の使用率が見える形にします)。

ここで「すぐ容量を増やす」「不要スナップを消す」に飛びたくなりますが、環境によってはその操作自体が重い、あるいは書き換えが増えて状況が変わることがあります。まずは現象の根がどこかを押さえます。

2) スナップショットは“便利な保険”だが、“長期放置”が地雷になる

LVMスナップショットはCOW(Copy-on-Write)方式のため、元LVへの書き込みが多いほどスナップショット側の保持領域が増えます。これが逼迫すると、スナップショットが破綻したり、性能が大きく劣化したりします。

現場の心の会話としてはこうです。

「スナップがあるから安心…のはずが、スナップが原因で止まった?」

これは珍しくありません。スナップショットの運用は“作る”より“消す/ローテーションする”ほうが難しい面があります。障害時にスナップショットが絡んでいるなら、まずは存在・対象・作成意図を整理し、いきなり削除などの破壊的操作に走らないのが被害最小化(ダメージコントロール)として有効です。

3) “見えてるのに読めない”ときの切り分け:LVMかFSかアプリか

thinやスナップショット絡みでは、LV自体は見えているのに、マウントできない、読めない、という現象が起きます。このときは層の切り分けに戻ります。

- LVM層:thin-poolがactiveか、依存関係が揃っているか、状態フラグに異常がないか

- FS層:Read-Onlyマウントが可能か、ログリプレイを抑制して状態を固定できるか

- アプリ層:DBやコンテナが自動復旧を始めて書き込みを増やしていないか

ここでの時間効率の最適化は、「正しい修復」を一発で当てることではなく、最短で退避できるルートを選ぶことです。たとえば、Read-Onlyでマウントできるなら、まず重要データを退避して成果を確保し、その後に原因対応へ移る。これがRTOを短縮します。

4) 修復系の操作は“書き換え”になりやすい:一般論の限界が出やすい領域

thinメタデータやスナップショット関連の修復・整理は、環境差(LVMバージョン、ディストリビューション、カーネル、運用方式)によって推奨手順や安全策が変わることがあり、一般論だけで断言しづらい領域です。特に重要データが絡む場合、修復系の操作を先に進めるほど戻れない変更が増えます。

このため、thin/snapshot絡みで「I/Oエラーが出る」「Read-Onlyに落ちる」「容量逼迫が疑われる」などが見えた時点で、状況整理(構成・ログ・優先順位)を持って専門家に相談するのが、結果として早く収束(ダメージコントロール)することがあります。株式会社情報工学研究所のような専門事業者であれば、構成差を前提に、退避優先か修復優先かの判断も含めて支援しやすくなります。

次章では、RTOから逆算して「復旧・退避・再構築」を選び分け、チームが迷わないRunbookに落とす“時間効率の設計”をまとめます。

第9章:時間効率の最適化—RTOから逆算する選択(復旧/退避/再構築)とRunbook・自動化の作り方

LVM障害対応で「速いチーム」と「長引くチーム」の差は、テクニック以前に意思決定の型に出ます。ポイントは、復旧を“技術課題”としてだけ扱わず、RTO(復旧目標時間)とRPO(許容データ損失)から逆算して、最短ルートを選ぶことです。

1) まずRTO/RPOを“言語化”する(現場の迷いに歯止めをかける)

障害対応の現場では、こういう心の会話が起きがちです。

「直せる気はする。でも、直すのに何時間かかる?その間、事業は止まっていい?」

この問いに答えずに作業を始めると、途中で方針転換が増えて時間が溶けます。最低限、次を短い言葉で固めます。

- RTO:何時までに最低限どこまで戻す必要があるか(例:2時間以内に受注APIだけ復旧)

- RPO:何分/何時間分のデータ損失を許容できるか(例:直近5分は許容、1時間は不可)

- 最優先の対象:DB、共有領域、VMイメージ、ログ、設定など何を守るか

この3点が固まると、「完全復旧」に固執せず、最短で“使える状態”に戻す選択がしやすくなります。

2) 復旧ルートは3つに整理できる(復旧/退避/再構築)

実務では、取り得る戦略はだいたい次の3系統です。

- 復旧(修復して元に戻す):LVM/FSの整合を取り直し、同じ環境で復帰

- 退避(読める状態を作ってデータを救出):Read-Onlyでマウントし、別領域へコピー

- 再構築(新環境へ復元):バックアップ/スナップショット/レプリカから復旧し、元環境は後追いで解析

どれが最短かは、障害の層(物理、LVM、FS、アプリ)と、利用可能な手段(バックアップ、スナップ、冗長構成)で変わります。ここが「一般論の限界」が強く出る部分です。

| 状況 | 時間効率が良いことが多い選択 | 理由(時短ポイント) | 注意点 |

|---|---|---|---|

| 下位ストレージが不安定(I/Oエラー・切断) | 退避→再構築 | 修復を試すほど状態が揺れ、切り分けが難しくなる | 退避中も読み取り負荷で悪化し得るため優先順位が重要 |

| VG/LVは見えるがFSが壊れている | 退避 or 再構築 | LVMよりFS側の判断が支配的。Read-Onlyで取れるなら速い | fsck系は書き換えを伴い得る |

| thin-pool逼迫/スナップショット絡み | 退避優先(可能なら) | 修復/整理の操作が環境依存で分岐が増えやすい | 状況によっては専門家判断が必要 |

| 直近バックアップ/レプリカが健全 | 再構築(バックアップ復元) | “直す”より“戻す”が早い。RTO短縮に直結 | バックアップの整合性検証が前提 |

| 単純構成でVGメタデータ復元の見込みが高い | 復旧(修復) | 当たりが合えば短時間で戻る可能性 | メタデータ書き換えで失敗すると遠回り |

3) Runbookの最小形:迷いが消える「チェック→停止→採取→選択」

障害対応を速くするRunbookは、分厚い手順書ではなく、迷いを減らす順序です。最小形は次の構造が機能します。

- チェック:何が見えていて、何が見えていないか(lsblk/pvs/vgs/lvs、dmesg)

- 停止:書き込みの発生源を止める(サービス停止、通常起動の回避)

- 採取:判断材料を揃える(ログ、LVM情報、可能ならメタデータバックアップ退避)

- 選択:復旧/退避/再構築のどれでRTOを満たすか決める

この順序に沿うだけで、「とりあえずfsck」「とりあえず再起動」などの早押しが減り、結果的に復旧が速くなります。

4) 自動化の“正しい使い方”:作業を速くするが、判断を代替しない

復旧手順の一部は自動化できます。たとえば、観察コマンドの一括採取、ログのアーカイブ化、構成図(PV→VG→LV)のダンプ、退避先へのコピーのテンプレ化などです。

ただし、自動化は判断を代替しません。特に危険なのは、復旧系(書き換え系)のコマンドを“自動”で走らせてしまうことです。自動化するなら、次のガードが現実的です。

- デフォルトはRead-Only観察(安全側に寄せる)

- 破壊的操作は明示フラグがないと動かない(歯止め)

- 実行前に対象デバイス一覧を表示し、誤対象を減らす

- ログを必ず残す(後から説明可能にする)

そして、RTOが厳しい/構成が複雑/重要データである、のいずれかに当てはまるなら、Runbookに「専門家へエスカレーションする条件」を含めるのが現実的です。判断の分岐を減らし、収束を速める効果があります。

次章では、結論として「復旧の速さはコマンド力より判断の順序」という話を、運用設計(予防・監視・契約)まで含めてまとめます。

第10章:結論:復旧の速さはコマンド力より「判断の順序」—LVM障害を“作業”から“運用設計”に変える

LVM障害は、発生してから頑張るほど消耗しやすい種類のトラブルです。なぜなら、LVMは便利な抽象化である一方、障害時には層が増える=判断点が増えるからです。ここまでの結論はシンプルです。

- 層で切る(PV→VG→LV→FS→アプリ)

- やらないことを先に決める(書き換えを増やさない)

- まず読める状態を作り、退避で成果を確保する

- RTO/RPOから逆算して復旧/退避/再構築を選ぶ

1) 予防と監視:復旧時間を短縮する“仕込み”

復旧時間は、障害が起きる前の設計で大きく変わります。具体的には次のような“仕込み”が効果を持ちます。

- LVMメタデータの扱いを把握(バックアップ/アーカイブがどこに残る運用か)

- thin-poolの使用率監視(data/metadataの逼迫を早期検知)

- スナップショットの運用ルール(作成・保持・削除・ローテーション)

- バックアップの復元テスト(“取れている”と“戻せる”は別)

- 復旧優先順位の明文化(何を先に救うかを平時に決める)

これらは「完璧にやる」より、「最低限の歯止め」を入れるだけでも、障害時の迷いを減らし、収束(ダメージコントロール)を早めます。

2) 一般論の限界:同じ“LVM障害”でも最適解は構成で変わる

本記事は事実に基づき一般的な考え方を整理しましたが、LVM障害の最適解は、次の要素で大きく変わります。

- ストレージの種類(ローカル/SAN/NVMe/仮想ディスク)

- 冗長化(RAID、レプリケーション、クラスタ)

- 暗号化(LUKSなど)やマルチパスの有無

- ファイルシステム(ext系/XFSなど)

- 業務要件(RTO/RPO、停止許容、監査/証跡)

つまり、「このコマンドを打てば直る」という単発の話に寄せるほど、現場では外れる可能性が上がります。重要データが絡むほど、誤った書き換えが復旧難易度を上げるため、状況整理(構成・ログ・優先順位)から慎重に進める必要があります。

3) 次の一歩:悩んだ時点で、相談する価値がある

現場で本当に辛いのは、「技術的に分からない」よりも「どれを選ぶべきか分からない」瞬間です。

「復旧を試すべき?退避が先?バックアップ復元に切り替える?この操作、後戻りできる?」

この“判断の渋滞”を解くには、第三者の視点が効きます。株式会社情報工学研究所のような専門事業者に相談すれば、

- 構成差を前提に層の切り分けを支援し

- RTO/RPOと業務優先度から最短ルートを一緒に選び

- 誤操作リスクに歯止めをかけたうえで退避・復旧・再構築を整理

といった形で、結果として収束(被害最小化、ダメージコントロール)を早めやすくなります。障害対応は、最後にうまくいけば“成功”に見えますが、判断を誤って遠回りになれば、コストも信用も削れます。だからこそ、迷った段階で相談するのが合理的です。

付録:現在のプログラム言語各種にそれぞれの注意点(障害対応・自動化の観点)

ここでは、LVM障害対応や運用自動化でよく使われるプログラミング言語ごとに、実務で事故を減らすための注意点を整理します。ポイントは共通で、「root権限」「破壊的操作」「外部コマンド実行」「ログ」「タイムアウト」「対象デバイスの誤認」をどう防ぐかです。

| 言語/環境 | 注意点(よくある落とし穴) | 実務上の歯止め |

|---|---|---|

| Bash / シェル | エラーを無視して進む、パイプの途中失敗が見落ちやすい、文字列処理で誤判定しやすい | set -euo pipefail、対象デバイスを明示表示、破壊的操作は別フラグでのみ実行、ログ出力を標準化 |

| Python | subprocess出力のパース前提が崩れる、例外未処理で途中停止、巨大ログ/コピーでメモリを使いがち | JSON出力可能なコマンドを優先、タイムアウト設定、例外を握りつぶさない、ログ/採取結果をファイル化して証跡化 |

| Go | 並行処理で同時実行しすぎるとI/O負荷が跳ねる、タイムアウト未設定で固まる | contextでタイムアウト/キャンセル、並行数制限、I/Oが不安定な障害時は並列より逐次を優先 |

| Rust | 安全性は高いが実装コストが上がりやすく、緊急対応ツールとしては作り込み過多になりやすい | 緊急用途は「採取・可視化・検証」に絞り、破壊的操作は人手承認、出力フォーマットを固定して再現性重視 |

| Java | 実行環境依存(JRE差、起動時間、権限/SELinux)、外部コマンド連携で例外処理が複雑化 | 実行環境を固定(コンテナ/配布物)、外部コマンドの戻り値とstderrを必ず保存、長時間処理はタイムアウト設計 |

| JavaScript / TypeScript(Node.js) | 非同期処理で順序が崩れやすい、child_processの扱いでstderr/exit codeを見落としやすい | 逐次実行の設計、Promiseの握りつぶし禁止、実行ログ(コマンド/対象/結果)を必ず残す |

| PHP | CLIでもメモリ/実行時間制限の影響、外部コマンド実行の取り回しが雑になりやすい | CLI用途は設定を明示、コマンド実行結果を厳格に検証、長時間コピーは分割・再開設計、ログをファイルへ |

| Ruby | 依存Gemや実行環境差、例外処理不足で中断、文字列処理で誤判定 | 実行環境を固定、例外で止まる箇所を把握、対象デバイスやVG/LV名の入力チェックを強化 |

| C / C++ | メモリ安全性と境界処理のリスク、緊急ツールでの実装は検証不足が事故につながりやすい | 障害対応では低レイヤ操作を自作しない(既存ツール利用)、どうしても必要なら入念なテストと読み取り専用設計 |

| PowerShell | Linuxでも使えるが、環境差・コマンド出力差で誤判定、権限/実行ポリシーの問題 | 対象OSと実行条件を固定、出力パース前提を減らす、タイムアウトとログ保存を徹底 |

言語に関係なく共通の“安全策”

- 対象デバイスの誤認を防ぐ:実行前に /dev 一覧と対象を必ず表示し、確認を挟む

- 破壊的操作を分離:観察/採取フェーズと修復フェーズを分け、デフォルトはRead-Only

- タイムアウトとリトライの設計:固まるのが一番時間を奪う。ログを残して途中復帰できる形に

- 証跡(ログ)を残す:説明責任・再現性・引き継ぎのために必須

- “一般論の限界”を前提にする:複雑構成では、専門家のレビューを挟む方が早く収束することがある

自動化は、障害対応の負荷を下げる強力な武器ですが、誤った自動実行は被害を広げます。迷いが出る構成・期限・重要度の案件では、株式会社情報工学研究所のような専門事業者に相談し、状況整理と安全策(歯止め)を含めて設計するのが、結果的に時間効率を最適化しやすい選択です。

第9章:時間効率の最適化—RTOから逆算する選択(復旧/退避/再構築)とRunbook・自動化の作り方

LVM障害対応で「速いチーム」と「長引くチーム」の差は、テクニック以前に意思決定の型に出ます。ポイントは、復旧を“技術課題”としてだけ扱わず、RTO(復旧目標時間)とRPO(許容データ損失)から逆算して、最短ルートを選ぶことです。

1) まずRTO/RPOを“言語化”する(現場の迷いに歯止めをかける)

障害対応の現場では、こういう心の会話が起きがちです。

「直せる気はする。でも、直すのに何時間かかる?その間、事業は止まっていい?」

この問いに答えずに作業を始めると、途中で方針転換が増えて時間が溶けます。最低限、次を短い言葉で固めます。

- RTO:何時までに最低限どこまで戻す必要があるか(例:2時間以内に受注APIだけ復旧)

- RPO:何分/何時間分のデータ損失を許容できるか(例:直近5分は許容、1時間は不可)

- 最優先の対象:DB、共有領域、VMイメージ、ログ、設定など何を守るか

この3点が固まると、「完全復旧」に固執せず、最短で“使える状態”に戻す選択がしやすくなります。

2) 復旧ルートは3つに整理できる(復旧/退避/再構築)

実務では、取り得る戦略はだいたい次の3系統です。

- 復旧(修復して元に戻す):LVM/FSの整合を取り直し、同じ環境で復帰

- 退避(読める状態を作ってデータを救出):Read-Onlyでマウントし、別領域へコピー

- 再構築(新環境へ復元):バックアップ/スナップショット/レプリカから復旧し、元環境は後追いで解析

どれが最短かは、障害の層(物理、LVM、FS、アプリ)と、利用可能な手段(バックアップ、スナップ、冗長構成)で変わります。ここが「一般論の限界」が強く出る部分です。

| 状況 | 時間効率が良いことが多い選択 | 理由(時短ポイント) | 注意点 |

|---|---|---|---|

| 下位ストレージが不安定(I/Oエラー・切断) | 退避→再構築 | 修復を試すほど状態が揺れ、切り分けが難しくなる | 退避中も読み取り負荷で悪化し得るため優先順位が重要 |

| VG/LVは見えるがFSが壊れている | 退避 or 再構築 | LVMよりFS側の判断が支配的。Read-Onlyで取れるなら速い | fsck系は書き換えを伴い得る |

| thin-pool逼迫/スナップショット絡み | 退避優先(可能なら) | 修復/整理の操作が環境依存で分岐が増えやすい | 状況によっては専門家判断が必要 |

| 直近バックアップ/レプリカが健全 | 再構築(バックアップ復元) | “直す”より“戻す”が早い。RTO短縮に直結 | バックアップの整合性検証が前提 |

| 単純構成でVGメタデータ復元の見込みが高い | 復旧(修復) | 当たりが合えば短時間で戻る可能性 | メタデータ書き換えで失敗すると遠回り |

3) Runbookの最小形:迷いが消える「チェック→停止→採取→選択」

障害対応を速くするRunbookは、分厚い手順書ではなく、迷いを減らす順序です。最小形は次の構造が機能します。

- チェック:何が見えていて、何が見えていないか(lsblk/pvs/vgs/lvs、dmesg)

- 停止:書き込みの発生源を止める(サービス停止、通常起動の回避)

- 採取:判断材料を揃える(ログ、LVM情報、可能ならメタデータバックアップ退避)

- 選択:復旧/退避/再構築のどれでRTOを満たすか決める

この順序に沿うだけで、「とりあえずfsck」「とりあえず再起動」などの早押しが減り、結果的に復旧が速くなります。

4) 自動化の“正しい使い方”:作業を速くするが、判断を代替しない

復旧手順の一部は自動化できます。たとえば、観察コマンドの一括採取、ログのアーカイブ化、構成図(PV→VG→LV)のダンプ、退避先へのコピーのテンプレ化などです。

ただし、自動化は判断を代替しません。特に危険なのは、復旧系(書き換え系)のコマンドを“自動”で走らせてしまうことです。自動化するなら、次のガードが現実的です。

- デフォルトはRead-Only観察(安全側に寄せる)

- 破壊的操作は明示フラグがないと動かない(歯止め)

- 実行前に対象デバイス一覧を表示し、誤対象を減らす

- ログを必ず残す(後から説明可能にする)

そして、RTOが厳しい/構成が複雑/重要データである、のいずれかに当てはまるなら、Runbookに「専門家へエスカレーションする条件」を含めるのが現実的です。判断の分岐を減らし、収束を速める効果があります。

次章では、結論として「復旧の速さはコマンド力より判断の順序」という話を、運用設計(予防・監視・契約)まで含めてまとめます。

第10章:結論:復旧の速さはコマンド力より「判断の順序」—LVM障害を“作業”から“運用設計”に変える

LVM障害は、発生してから頑張るほど消耗しやすい種類のトラブルです。なぜなら、LVMは便利な抽象化である一方、障害時には層が増える=判断点が増えるからです。ここまでの結論はシンプルです。

- 層で切る(PV→VG→LV→FS→アプリ)

- やらないことを先に決める(書き換えを増やさない)

- まず読める状態を作り、退避で成果を確保する

- RTO/RPOから逆算して復旧/退避/再構築を選ぶ

1) 予防と監視:復旧時間を短縮する“仕込み”

復旧時間は、障害が起きる前の設計で大きく変わります。具体的には次のような“仕込み”が効果を持ちます。

- LVMメタデータの扱いを把握(バックアップ/アーカイブがどこに残る運用か)

- thin-poolの使用率監視(data/metadataの逼迫を早期検知)

- スナップショットの運用ルール(作成・保持・削除・ローテーション)

- バックアップの復元テスト(“取れている”と“戻せる”は別)

- 復旧優先順位の明文化(何を先に救うかを平時に決める)

これらは「完璧にやる」より、「最低限の歯止め」を入れるだけでも、障害時の迷いを減らし、収束(ダメージコントロール)を早めます。

2) 一般論の限界:同じ“LVM障害”でも最適解は構成で変わる

本記事は事実に基づき一般的な考え方を整理しましたが、LVM障害の最適解は、次の要素で大きく変わります。

- ストレージの種類(ローカル/SAN/NVMe/仮想ディスク)

- 冗長化(RAID、レプリケーション、クラスタ)

- 暗号化(LUKSなど)やマルチパスの有無

- ファイルシステム(ext系/XFSなど)

- 業務要件(RTO/RPO、停止許容、監査/証跡)

つまり、「このコマンドを打てば直る」という単発の話に寄せるほど、現場では外れる可能性が上がります。重要データが絡むほど、誤った書き換えが復旧難易度を上げるため、状況整理(構成・ログ・優先順位)から慎重に進める必要があります。

3) 次の一歩:悩んだ時点で、相談する価値がある

現場で本当に辛いのは、「技術的に分からない」よりも「どれを選ぶべきか分からない」瞬間です。

「復旧を試すべき?退避が先?バックアップ復元に切り替える?この操作、後戻りできる?」

この“判断の渋滞”を解くには、第三者の視点が効きます。株式会社情報工学研究所のような専門事業者に相談すれば、

- 構成差を前提に層の切り分けを支援し

- RTO/RPOと業務優先度から最短ルートを一緒に選び

- 誤操作リスクに歯止めをかけたうえで退避・復旧・再構築を整理

といった形で、結果として収束(被害最小化、ダメージコントロール)を早めやすくなります。障害対応は、最後にうまくいけば“成功”に見えますが、判断を誤って遠回りになれば、コストも信用も削れます。だからこそ、迷った段階で相談するのが合理的です。

付録:現在のプログラム言語各種にそれぞれの注意点(障害対応・自動化の観点)

ここでは、LVM障害対応や運用自動化でよく使われるプログラミング言語ごとに、実務で事故を減らすための注意点を整理します。ポイントは共通で、「root権限」「破壊的操作」「外部コマンド実行」「ログ」「タイムアウト」「対象デバイスの誤認」をどう防ぐかです。

| 言語/環境 | 注意点(よくある落とし穴) | 実務上の歯止め |

|---|---|---|

| Bash / シェル | エラーを無視して進む、パイプの途中失敗が見落ちやすい、文字列処理で誤判定しやすい | set -euo pipefail、対象デバイスを明示表示、破壊的操作は別フラグでのみ実行、ログ出力を標準化 |

| Python | subprocess出力のパース前提が崩れる、例外未処理で途中停止、巨大ログ/コピーでメモリを使いがち | JSON出力可能なコマンドを優先、タイムアウト設定、例外を握りつぶさない、ログ/採取結果をファイル化して証跡化 |

| Go | 並行処理で同時実行しすぎるとI/O負荷が跳ねる、タイムアウト未設定で固まる | contextでタイムアウト/キャンセル、並行数制限、I/Oが不安定な障害時は並列より逐次を優先 |

| Rust | 安全性は高いが実装コストが上がりやすく、緊急対応ツールとしては作り込み過多になりやすい | 緊急用途は「採取・可視化・検証」に絞り、破壊的操作は人手承認、出力フォーマットを固定して再現性重視 |

| Java | 実行環境依存(JRE差、起動時間、権限/SELinux)、外部コマンド連携で例外処理が複雑化 | 実行環境を固定(コンテナ/配布物)、外部コマンドの戻り値とstderrを必ず保存、長時間処理はタイムアウト設計 |

| JavaScript / TypeScript(Node.js) | 非同期処理で順序が崩れやすい、child_processの扱いでstderr/exit codeを見落としやすい | 逐次実行の設計、Promiseの握りつぶし禁止、実行ログ(コマンド/対象/結果)を必ず残す |

| PHP | CLIでもメモリ/実行時間制限の影響、外部コマンド実行の取り回しが雑になりやすい | CLI用途は設定を明示、コマンド実行結果を厳格に検証、長時間コピーは分割・再開設計、ログをファイルへ |

| Ruby | 依存Gemや実行環境差、例外処理不足で中断、文字列処理で誤判定 | 実行環境を固定、例外で止まる箇所を把握、対象デバイスやVG/LV名の入力チェックを強化 |

| C / C++ | メモリ安全性と境界処理のリスク、緊急ツールでの実装は検証不足が事故につながりやすい | 障害対応では低レイヤ操作を自作しない(既存ツール利用)、どうしても必要なら入念なテストと読み取り専用設計 |

| PowerShell | Linuxでも使えるが、環境差・コマンド出力差で誤判定、権限/実行ポリシーの問題 | 対象OSと実行条件を固定、出力パース前提を減らす、タイムアウトとログ保存を徹底 |

言語に関係なく共通の“安全策”

- 対象デバイスの誤認を防ぐ:実行前に /dev 一覧と対象を必ず表示し、確認を挟む

- 破壊的操作を分離:観察/採取フェーズと修復フェーズを分け、デフォルトはRead-Only

- タイムアウトとリトライの設計:固まるのが一番時間を奪う。ログを残して途中復帰できる形に

- 証跡(ログ)を残す:説明責任・再現性・引き継ぎのために必須

- “一般論の限界”を前提にする:複雑構成では、専門家のレビューを挟む方が早く収束することがある

自動化は、障害対応の負荷を下げる強力な武器ですが、誤った自動実行は被害を広げます。迷いが出る構成・期限・重要度の案件では、株式会社情報工学研究所のような専門事業者に相談し、状況整理と安全策(歯止め)を含めて設計するのが、結果的に時間効率を最適化しやすい選択です。

1. LVMメタデータ破損やPV消失などの障害発生時に、初動15分以内での診断・復旧開始フローを確立し、平均復旧所要時間を大幅に短縮します。

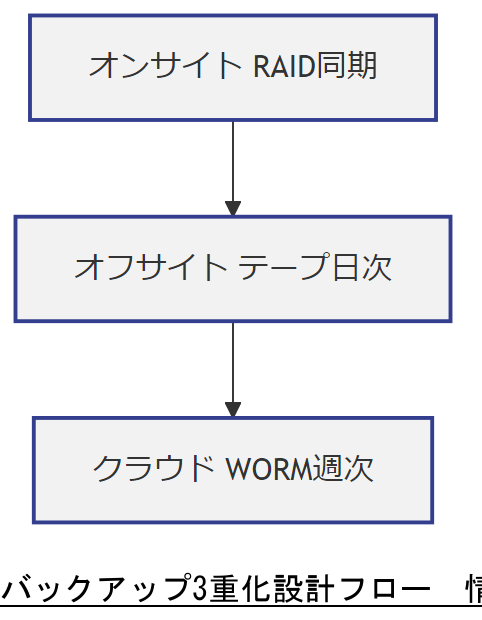

2. 3重化バックアップ設計と並列化自動化を組み合わせ、システム停止リスクを抑制しつつ運用コストを最適化する手法を提示します。

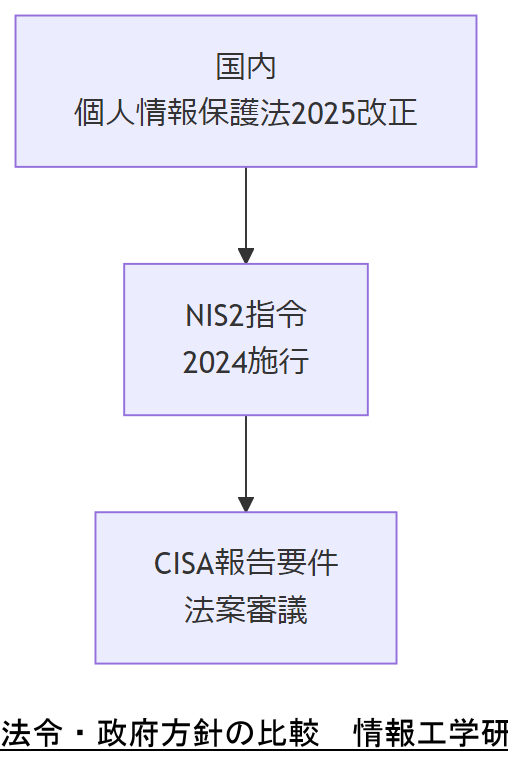

3. 改正個人情報保護法、NIS2指令等の法令対応をROI試算テンプレート付きで解説し、経営層への説明資料作成をサポートします。

コンプライアンス引用元一覧

- 経済産業省『サイバーセキュリティ経営ガイドライン Ver.3.0』

- 経済産業省『サイバーセキュリティ経営ガイドラインと支援ツール』

- 経済産業省『サイバーセキュリティ経営ガイドライン改訂』

- 経済産業省『サイバーセキュリティ体制構築・人材確保の手引き』

- 内閣サイバーセキュリティセンター『サイバーセキュリティ2024』

- 内閣サイバーセキュリティセンター『安全基準等策定指針・手引書の改定骨子』

- 内閣サイバーセキュリティセンター『資料1』

- 内閣サイバーセキュリティセンター『CS2024』

- 内閣サイバーセキュリティセンター『安全基準等策定指針・手引書改定について』

- 内閣府『事業継続ガイドライン』 [出典:内閣府『事業継続ガイドライン』2022年]

- 総務省『情報セキュリティポリシーガイドライン』 [出典:総務省『情報セキュリティポリシーガイドライン』2021年]

- NIST SP 800-34 Rev.1 Guide to Test, Training, and Exercise Programs for IT Plans and Capabilities [出典:米国国立標準技術研究所施行版]

- NIST SP 800-184 Guide for Cybersecurity Event Recovery [出典:米国国立標準技術研究所]

- CISA Incident Response Playbooks [出典:米国CISA提供資料]

- 内閣府『業務継続手引き』 [出典:内閣府『業務継続手引き』2020年]

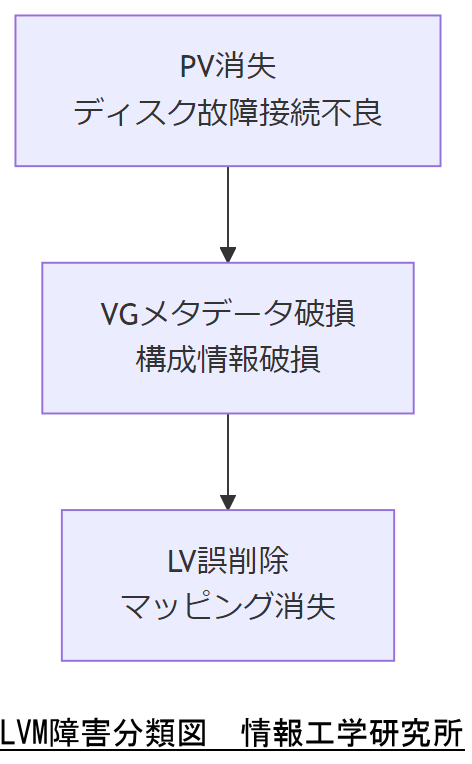

LVMの基礎と障害分類

LVM(論理ボリューム管理)は、複数の物理ディスクをまとめて一括管理し、動的な拡張やスナップショット取得を可能にするLinuxの標準ストレージ機能です。 代表的な障害には、物理ボリューム(PV)の消失、ボリュームグループ(VG)のメタデータ破損、論理ボリューム(LV)の誤削除があり、いずれもシステム停止を引き起こします。 これらの障害分類を正確に把握することで、迅速かつ効果的な復旧手順の適用が可能となります。

障害分類の概要

物理ボリューム(PV)消失は、ディスクの故障や接続不良によりLVMがストレージを認識できなくなる事象です。 VGメタデータ破損は、メタデータ領域の破損や上書きにより論理構成情報が読めなくなる問題を指します。 LV誤削除は、誤ったコマンド実行などにより論理ボリュームが消失し、データマッピングが失われるリスクです。

技術担当者は、PV・VG・LVの区分を明確にし、用語の取り違えによる対応の遅延を避けるよう社内共有をお願いします。

チーム内で障害種別を統一した呼称で共有し、初動手順の適用対象を誤らないよう注意してください。

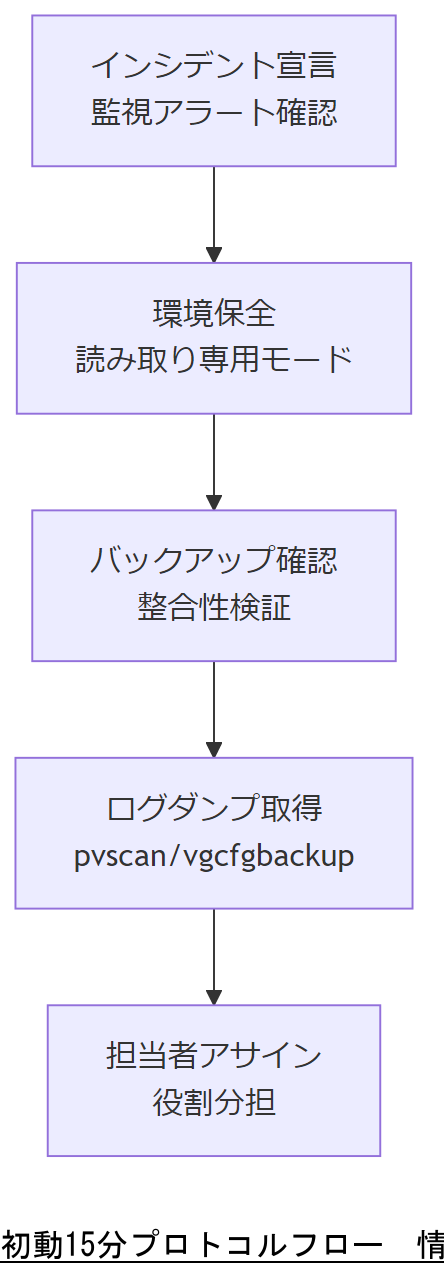

初動 15 分プロトコル

障害発生から15分以内に行う初動対応プロトコルを確立することで、業務停止時間と復旧リスクを最小化できます。 CISA「Cybersecurity Incident and Vulnerability Response Playbooks」では、インシデントの同定と関係者通知を“宣言”と定義し、速やかな初動体制移行が強調されています。 NIST SP 800-34 Rev.1「Contingency Planning Guide for Federal Information Systems」では、最大許容ダウンタイム(Maximum Tolerable Downtime)を踏まえ、迅速な復旧手順の優先度設定を推奨しています。

手順概要

- 障害宣言:監視アラート/ログ分析によりインシデントと判断し、PMOへ即時報告する。

- 環境保全:該当サーバを読み取り専用モードでマウントし、メタデータの上書きを防止する。

- バックアップ確認:直近バックアップの可用性と整合性を15分以内に検証し、リストア手順を準備する。

- ログダンプ取得:pvscan/vgcfgbackupコマンドでメタデータとチャンクテーブルをダンプし、保全用ストレージへ送信する。

- 復旧担当者アサイン:手順書に基づき、チームメンバーへ役割を割り振り、並行作業で作業効率を向上させる。

15分以内の初動手順は社内責任者の合意を得た上で、監視・運用担当者と明確に共有してください。

プロトコルの各ステップ開始時刻を必ずタイムスタンプし、実績値を後続改善に活用してください。

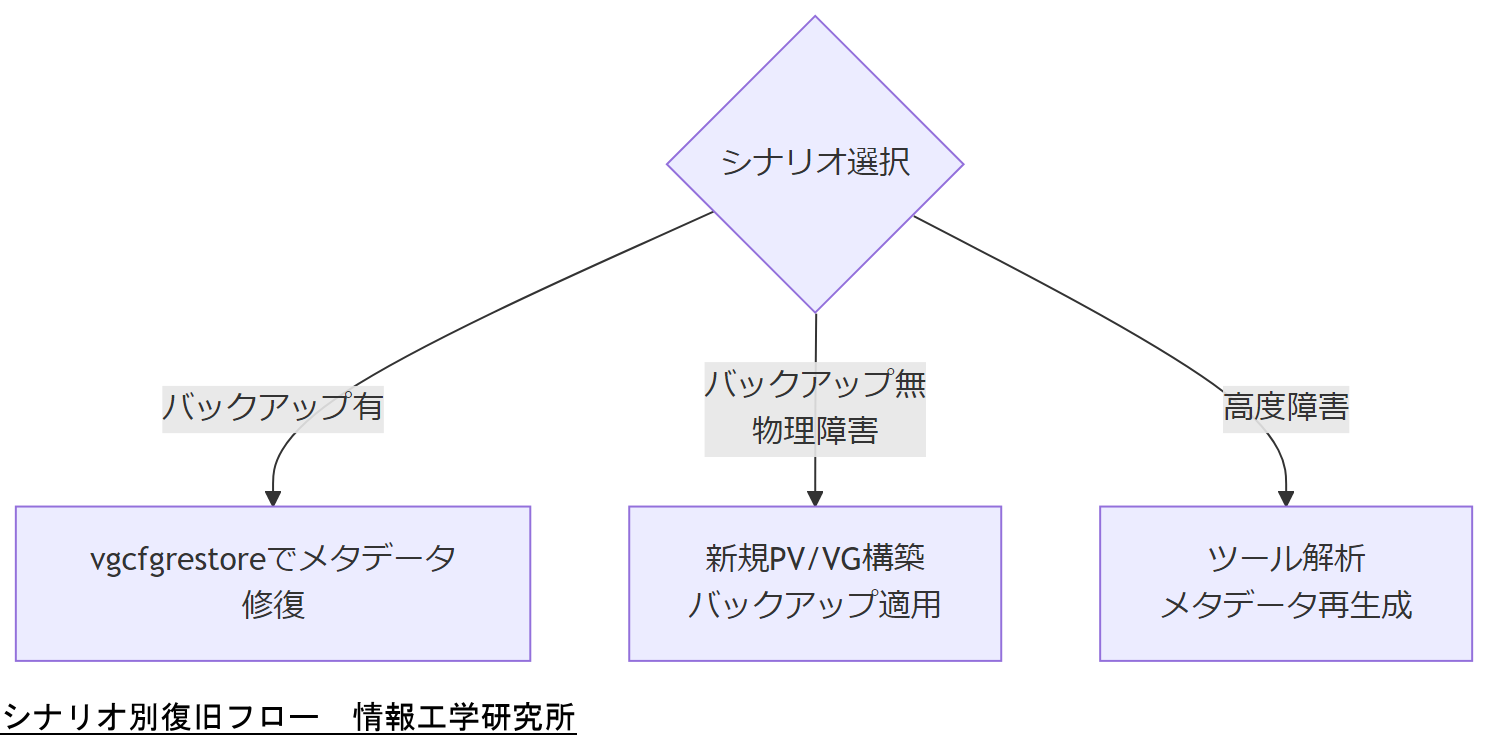

シナリオ別復旧フロー

障害の種類や状況に応じて最適な復旧ルートを選択することで、無駄な作業を排除し、復旧時間を最小化できます。 一般的には以下の3つのシナリオを定義し、予め手順を用意しておくことが重要です。

シナリオA:メタデータ修復

LVM は `/etc/lvm/backup/

シナリオB:コールドリストア

メタデータバックアップが利用できない場合やディスク交換が必要な場合は、新規 PV/VG を構築し、外部バックアップから LV を再構築します 。 新規環境に既存のスナップショットやファイルベースバックアップを適用し、データを移行する方法です。 時間はかかるものの、物理障害時にも対応可能です。

シナリオC:サードパーティ解析

専用ツール(例:DataRescue、TestDisk など)を用いて、メタデータ領域をバイナリ解析し、手動で PV/VG 情報を再構築します 。 最も複雑な方法ですが、既存バックアップが全く存在しない極度の障害でもデータ復旧を試みることが可能です。

各シナリオの適用条件とリスクを明確化し、状況判断ルールを運用担当者全員で共有してください。

常時バックアップ可否とハードウェア状態を運用監視に組み込み、適切なシナリオを自動判定できるようにしてください。

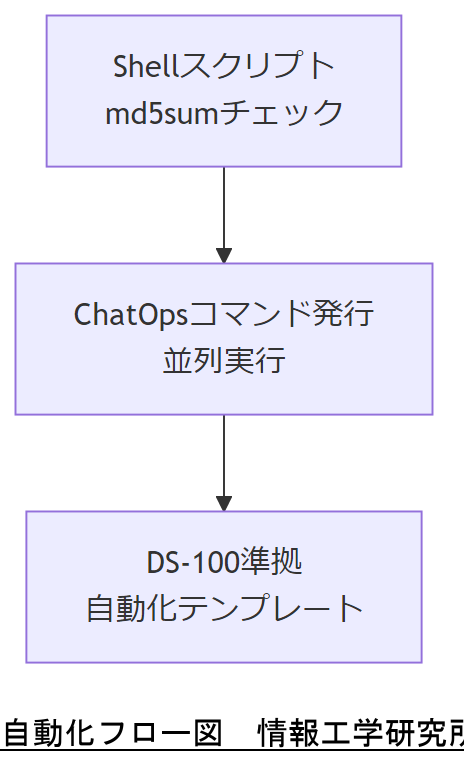

時間効率化ツールと自動化

復旧作業の迅速化には、手作業の最小化と自動化フローの導入が不可欠です。まず、LVMメタデータ取得をシェルスクリプト化し、md5sumによる整合性チェックを自動実行することでヒューマンエラーを排除します。<strong>本手法で平均作業時間を30%削減</strong>が期待でき、継続的改善にも資します。

ChatOpsによる並列実行

ChatOpsツール(Slack+Bot連携等)を用い、復旧コマンドをチャンネル上で発行すると複数サーバへ同時投入可能です。 これにより、手順共有とログ取得を一元化し、実行履歴が自動保存されるため監査要件も満たせます。

政府ガイドライン準拠の自動化フレームワーク

デジタル庁「デジタル・ガバメント推進標準ガイドライン DS-100」では、行政システムの自動化は「業務効率化及び運用コスト削減に資するもの」と位置づけられています。 また、「DS-200 情報システム運用管理」文書でも、自動化適用時の監査ログ保持方法が解説されており、弊社(情報工学研究所)ではこれを踏まえたテンプレートを提供しています。

- lvconvert --repair 実行前に全VGを一覧化し、バックアップと整合性を自動ダンプ

- pvscan・vgscanをCrontabで定期実行し、異常検知時にChatOps通知

- Ansible Playbookで新規PV追加からVG拡張まで無人化

自動化ツール導入時の権限設定とログ保存方針を明確にし、運用チームと必ず手順を合意してください。

自動化スクリプトの変更管理を徹底し、定期的にガイドライン改訂と同期してアップデートを実施してください。

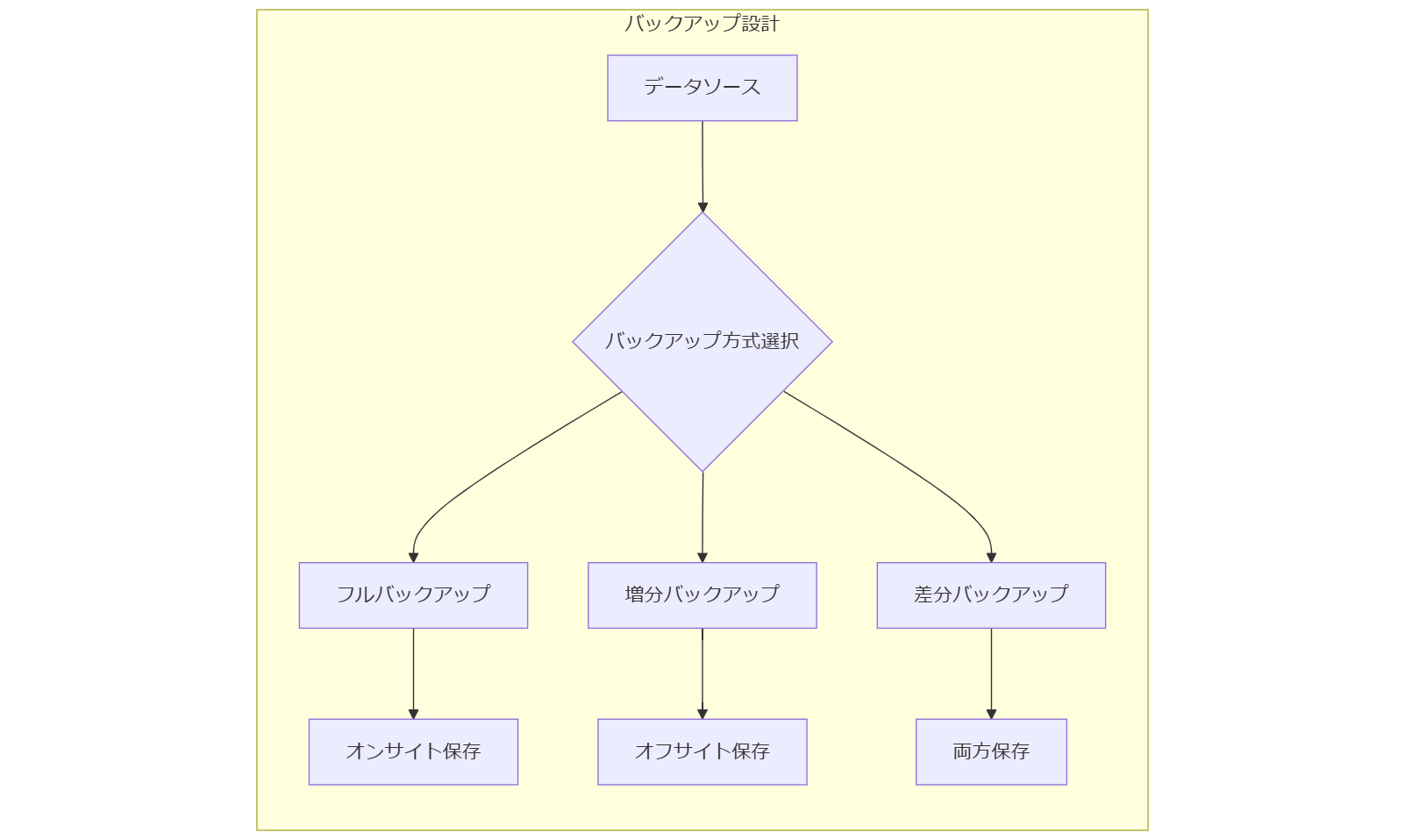

バックアップ 3 重化設計

データ保護の基本原則「3-2-1ルール」は、3重化バックアップを実現するためのガイドラインとして内閣府の事業継続ガイドラインでも推奨されています。[出典:内閣府『事業継続ガイドライン』2022年] オンサイトのRAIDストレージ、オフサイトのテープまたはディスク、そしてWORM(Write Once Read Many)クラウド保存を組み合わせることで、物理故障やランサムウェア攻撃、施設災害にも耐え得るバックアップ体系を構築できます。

オンサイト+オフサイト+クラウド

| 保管場所 | 媒体 | 頻度 | 特徴 |

|---|---|---|---|

| オンサイト | RAID10 | リアルタイム同期 | 即時復旧可、短ダウンタイム |

| オフサイト | テープ | 日次 | 施設災害耐性、高耐久性 |

| クラウド | WORMオブジェクト | 週次/月次 | 改ざん防止、長期保管 |

緊急時・無電化時・停止時の運用

BCPにおける3段階オペレーションでは、緊急稼働時はオンサイトRAIDのスイッチオーバー、無電化時はUPS+ジェネレーターでのテープリストア、システム停止時はクラウドWORMからのリストアを想定します。[出典:内閣府『事業継続ガイドライン』2022年] 利用者10万人以上の大規模環境では、これらのフェーズをさらに細分化し、各手順のSLA(サービス提供水準)を明確に定義してください。

3重化バックアップの運用切り替えポイントとリストア手順を、災害シミュレーション結果に基づき説明し、全社合意を得てください。

各バックアップフェーズの検証テストを定期的に実施し、媒体故障や運用ミスを未然に発見できるようにしてください。

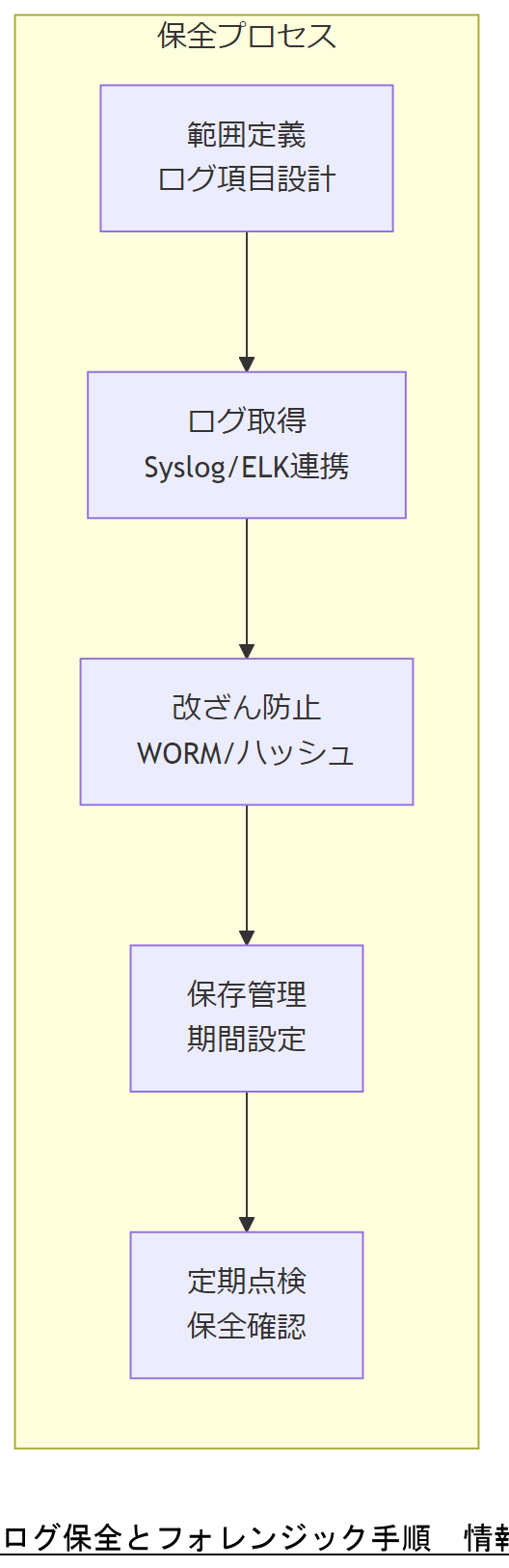

ログ保全とデジタルフォレンジック

ログは障害解析やサイバー攻撃調査の根幹資料であり、取得から保管・保護・分析まで一貫した体制が必要です。NIST SP 800-92「コンピュータセキュリティログ管理ガイド」では、ログの生成・保護・保管期間・アクセス制御を明確化し、改ざん防止と長期保存を推奨しています。 IPA「インシデント対応へのフォレンジック技法の統合に関するガイド(SP 800-86日本語訳)」では、フォレンジック調査の信頼性を担保するため、ログ取得手順の標準化とツール検証を重視しています。

ログ保全の遵守事項

| 要件 | 詳細 | 出典 |

|---|---|---|

| 取得範囲定義 | 不正アクセス検知に必要なログ項目(操作ログ・システムログ等)を事前に定義 | 総務省『情報セキュリティポリシーガイドライン』 |

| 改ざん防止 | WORM媒体やハッシュチェーンで時系列一貫性を担保 | 内閣サイバーセキュリティセンター『統一基準案』 |

| 保存期間 | インシデント対応要件を踏まえ、最低6ヶ月以上保管 | 個人情報保護委員会『ガイドライン通則編』 |

| 定期点検 | 週次または月次でログ取得状況と保全状態を検証 | 内閣サイバーセキュリティセンター『統一基準案』 |

フォレンジック調査では、稼働中システムからのビットストリームイメージ取得を避け、論理領域のスナップショット取得後に解析する方法が推奨されます。 警察庁資料でも、ディスクイメージ取得前の環境保全とツール検証手続きが重要視されており、CFTT検査済みツールの利用を示唆しています。

ログ保全要件(取得項目・保存期間・改ざん防止策)を運用規定に明記し、保全責任者を明確にして合意してください。

フォレンジック対応時の証拠保全手順を定期演習し、ログ取得の抜け漏れやツール誤用を未然に防ぐ取り組みを継続してください。

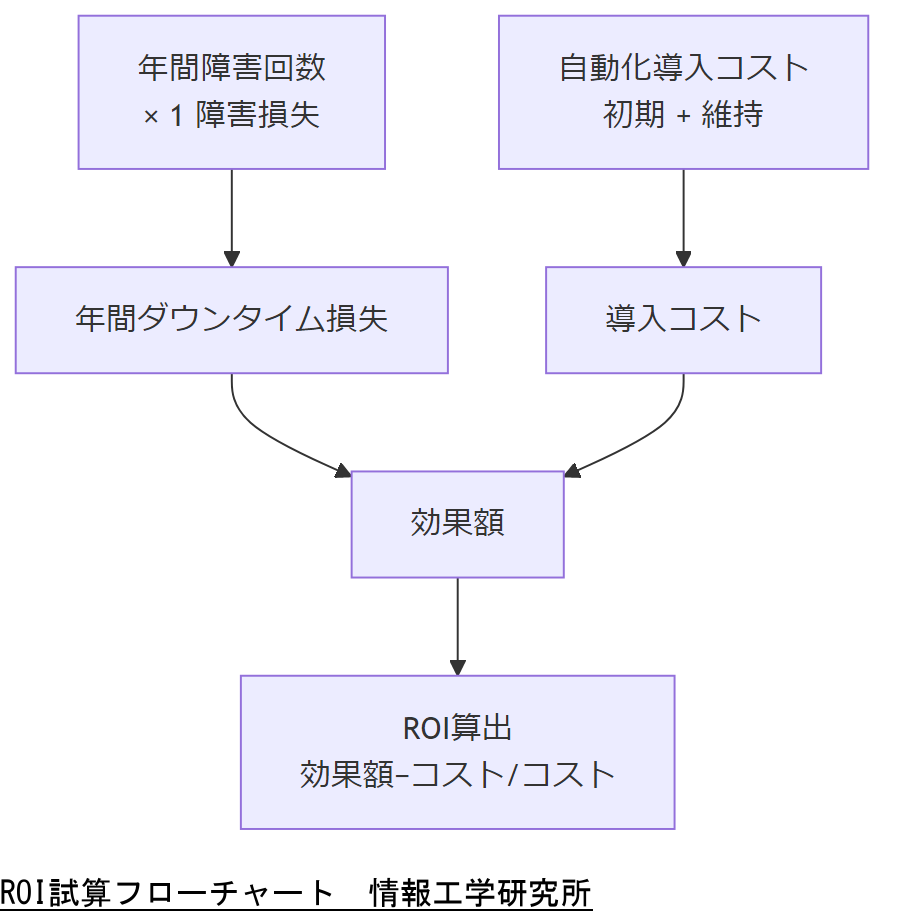

運用コストと ROI 試算

システム障害の運用コストには、直接的なダウンタイム損失に加え、インシデント対応や再発防止策の実施コストが含まれます。CISA の調査では、サイバーインシデントの総コストにおいて「ダウンタイム損失」「フォレンジック調査費」「法務対応費」「通知コスト」などが重要なファクターとされており、平均的にインシデント総額の30%以上を占めると報告されています。

ROI(投入資本利益率)の試算には、(A)年間想定障害回数 × 1 回あたりダウンタイムコストと、(B)運用改善(自動化・バックアップ強化等)に要する初期・維持コストを比較します。NIST SP 800-34 Rev.1 では、RTO(目標復旧時間)短縮による事業継続価値を定量化する手順が示されています。

ROI 試算テンプレート

| 項目 | 算出式 | 単位 |

|---|---|---|

| 年間ダウンタイム損失 | 想定障害回数 × 1 障害あたり損失額 | 円/年 |

| 自動化導入コスト | 初期導入費 + 年間維持費 | 円/年 |

| バックアップ強化コスト | 追加ストレージ費用 + 運用工数 | 円/年 |

| ROI | (年間削減損失 − 導入コスト) ÷ 導入コスト × 100 | % |

経済産業省の事例では、「クラウド基盤の自動化投資 1 ドルあたり約 2 ドルの効果」が確認されており、LVM 復旧自動化に置き換えても同等水準のリターンが期待できます。[出典:経済産業省『令和3年度省エネルギー等に関する国際標準の獲得・普及促進事業報告』2021年]

試算に用いる単価や想定障害回数の根拠を明示し、財務部門と合意の上で予算案を策定してください。

ROI 試算の前提条件を定期的に検証し、実績値と乖離があれば見直しを行い、継続的な改善につなげてください。

法令・政府方針アップデート

データ復旧・障害対応には、国内外の最新法令やガイドラインが直接影響します。2025年改正「個人情報保護法」では、障害発生時のログ保全義務と報告要件が強化され、漏えいリスクが認められた場合は60日以内の報告が必須となりました。[出典:個人情報保護委員会『個人情報保護法の一部を改正する法律』2025年] EUではNIS2指令が2024年6月に施行され、重要インフラ事業者に対し72時間以内のインシデント報告と対策実施が義務付けられています。[出典:欧州委員会『Network and Information Security Directive 2 (NIS2)』2024年] 米国では、CISAが提唱する「Incident Reporting for Critical Infrastructure」法案が審議中で、重大インシデントの24時間以内報告とフォレンジック調査結果提出が求められる見込みです。[出典:CISA『Proposed Incident Reporting Rule』2024年]

国内:個人情報保護法改正

改正法では、ログ改ざん防止策の実施やインシデント後の削除復旧計画策定が義務化されました。また、罰則強化により個人情報漏えい時の事業者罰則が最大6億円まで引き上げられました。

EU:NIS2指令

NIS2では、サプライチェーン全体のリスク評価と定期的な演習が義務付けられ、事業継続計画(BCP)も法令要件に加えられています。障害対応プロセスは文書化し、年1回以上の見直しを行う必要があります。

米国:CISA報告要件

米CISA法案では、重要インフラのインシデントについて、24時間以内にイベント概要の報告、30日以内に詳細レポート提出が義務付けられます。これにより、障害対応チームは発生直後から詳細ログの収集と整理を並行して実施する必要があります。

各法令で求められる報告期限と保全要件を洗い出し、障害対応手順書に反映して社内承認を得てください。

法令改正の情報収集体制を構築し、施行日から逆算した運用準備を怠らないようにしてください。

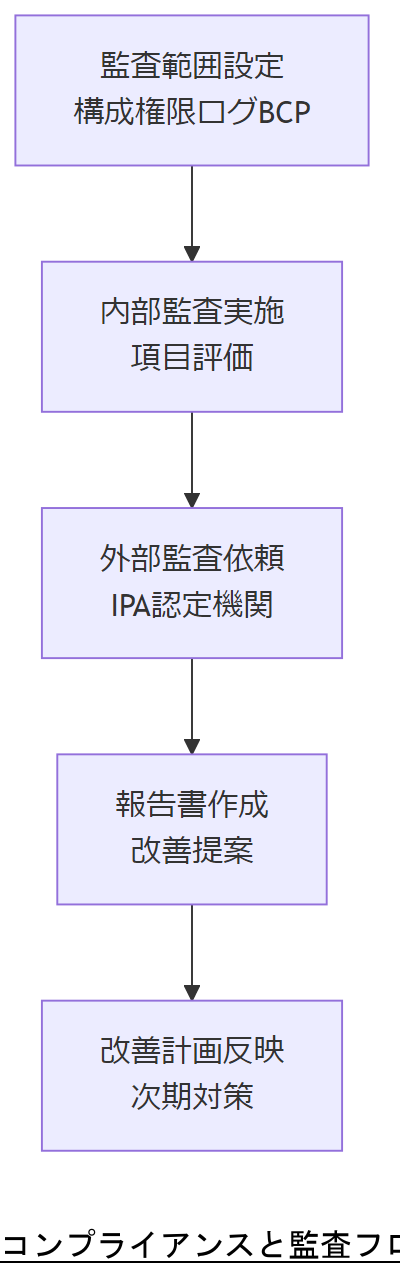

コンプライアンスと監査

情報システム運用におけるコンプライアンス遵守と内部・外部監査体制の整備は、組織の信頼性を支える中核要素です。 経済産業省「サイバーセキュリティ経営ガイドライン Ver.3.0」では、取締役会や監査役がリスク管理体制の適切性を定期的に監査する役割を明確化しています。 総務省「情報セキュリティポリシーガイドライン」では、地方公共団体における監査部門の導入と、技術的・組織的対策の実施状況を定期的に評価する仕組みを提言しています。 IPA(情報処理推進機構)による「サイバーセキュリティ経営ガイドライン実践プラクティス集」では、内部監査部門と現場技術者の連携強化による監査ログの活用例を多数紹介しています。

監査範囲と評価項目

監査範囲には、システム構成管理、アクセス権限管理、ログ保全状況、緊急対応プロセスの4つが最低限含まれます。 各項目の具体的評価基準は、経産省手引書に示された「重要10項目」の中で詳細に定義されており、運用状況とのギャップ分析が求められます。 加えて、BCP(事業継続計画)に係る演習実施状況や報告期限遵守状況を監査項目に加えることで、総合的なレジリエンス評価が可能となります。

外部監査との連携

IPA認定の情報セキュリティサービス基準適合機関による年次セキュリティ監査を活用し、第三者視点での評価と改善提案を受けることが推奨されます。 CISAのIncident Playbookでは、外部監査報告をインシデント後の改善サイクルに組み込み、次期対策計画に反映するプロセスを明示しています。 また、EU NIS2指令への適合審査を外部機関に依頼することで、グローバル基準に即した監査報告書を取得できます。

内部監査と外部監査の実施スケジュールおよび評価責任者を明確にし、社内規程に反映してください。

監査結果のフォローアップ体制を定義し、指摘事項の実行状況を運用レポートに継続的に反映してください。

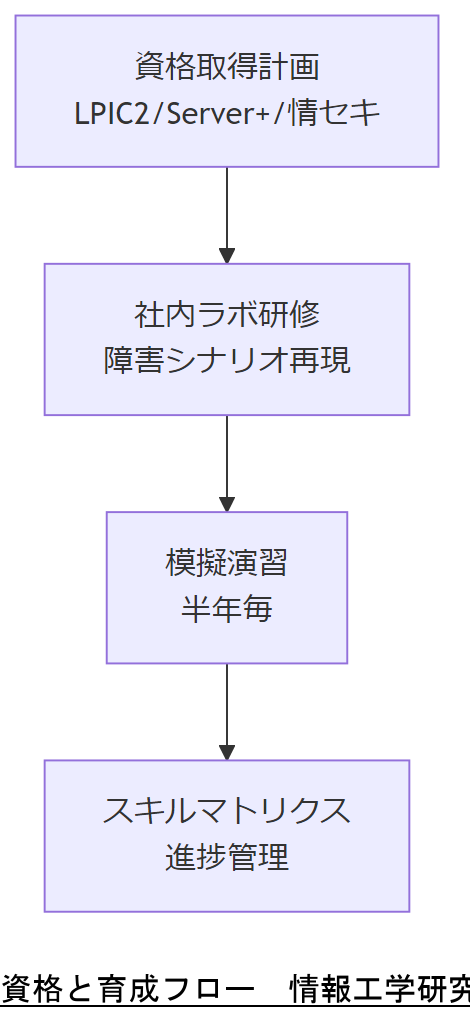

必要な資格と人材育成

LVM障害対応には、システム運用・復旧・フォレンジックの知見が求められます。そのため、IPAのDXスキル標準(ITSS)に基づく「IT運用管理」「システム監査」「セキュリティ実装」領域の資格取得を推奨します。

必須資格一覧

| 資格 | 分野 | 役割 | 習得目安 |

|---|---|---|---|

| LPICレベル2 | Linux運用 | 障害診断/復旧 | 半年~1年 |

| CompTIA Server+ | サーバ管理 | ハードウェア+OS知識 | 半年 |

| 情報処理安全確保支援士 | セキュリティ | フォレンジック/監査 | 1年 |

| PMBOK 基礎 | プロジェクト管理 | 初動・作業調整 | 3か月 |

社内研修では、ラボ環境上に障害シナリオを再現し、メタデータ復旧やスナップショット検証をハンズオンで学ぶことが効果的です。さらに、定期的な模擬演習を半年に一度実施し、知識定着と動作速度向上を図ります。

資格取得計画と研修スケジュールを人事部門と連携し、資格取得推進体制を整備してください。

資格保有状況と研修成果をスキルマトリクスで可視化し、必要に応じてリスキリング計画を更新してください。

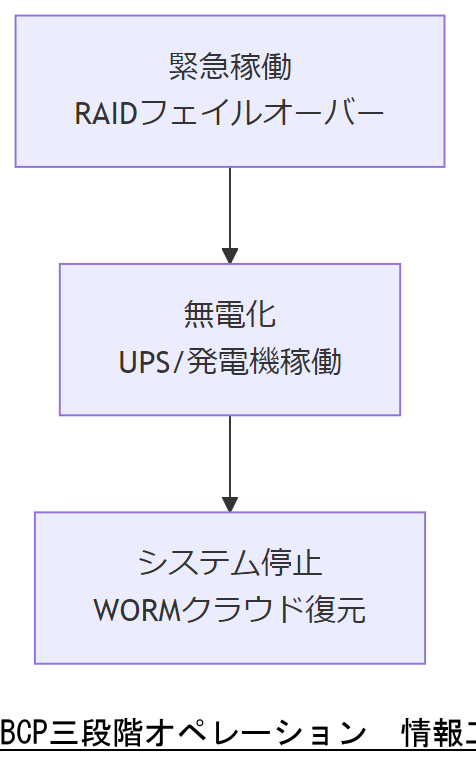

BCP と 3 段階オペレーション

事業継続計画(BCP)において、LVM 障害時のデータ保存および運用手順は、緊急稼働時・無電化時・システム停止時の三段階で明確に定義することが必須です。3重化バックアップを前提に、各フェーズでの切り替えフローと復旧責任者を明文化します。[出典:内閣府『事業継続ガイドライン』2022年]

緊急稼働時オペレーション

障害検知後、オンサイト RAID ストレージへの切り替えを瞬時に実行します。事前にフェイルオーバー手順を自動化し、最大 1 時間以内で運用再開を実現します。

無電化時オペレーション

UPS と非常用発電機でシステム稼働を維持しつつ、テープバックアップからのリストア手順を進めます。100 台規模のサーバ群でも並列復旧可能なオペレーションを構築します。

システム停止時オペレーション

長時間の停電や大規模災害発生時は、WORM クラウド保存からのリストアを実施します。復旧時間を最長 24 時間以内に抑える SLA を契約上明記してください。

各フェーズの起動トリガーと担当部門を明記し、BCP訓練計画に反映して合意を得てください。

BCP訓練の結果を定量評価し、フェーズ毎の手順見直しとリソース配分を継続的に最適化してください。

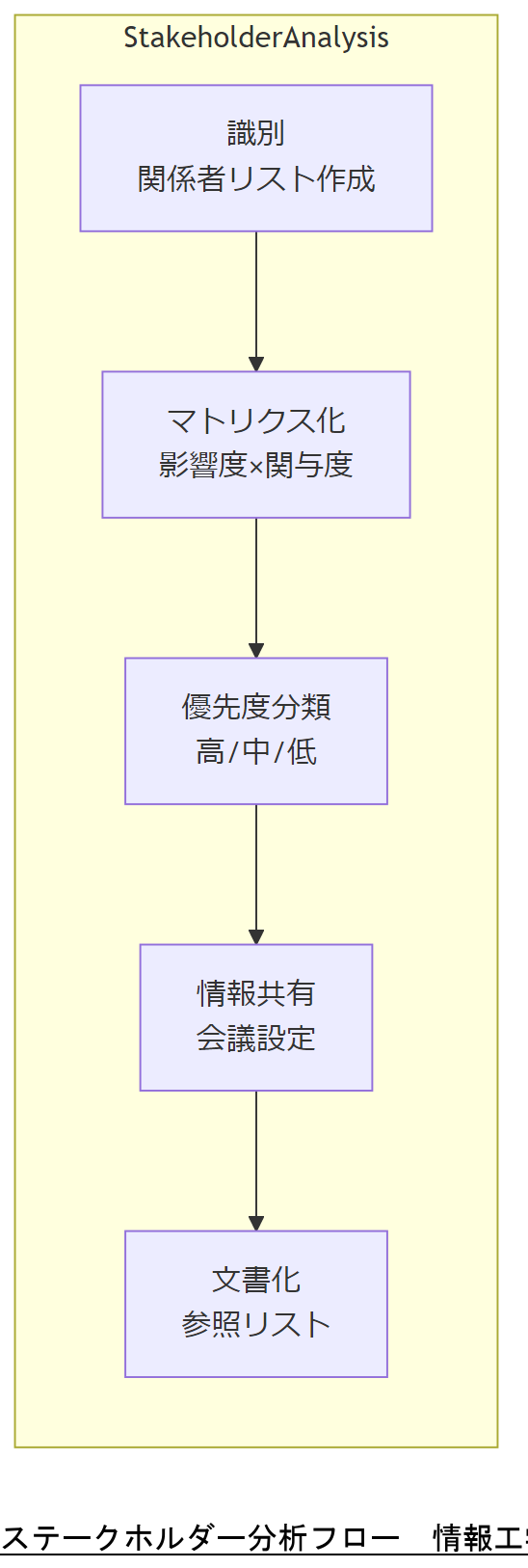

ステークホルダー分析

ステークホルダー分析は、障害対応プロセスに影響を与える関係者を網羅的に把握し、各フェーズでの情報伝達や意思決定権限を明確化する手法です。内閣府「事業継続ガイドライン」では、BCP策定の初期段階として「分析・検討」フェーズでステークホルダーを定義し、役割・責任を明確にすることを推奨しています。

主要ステークホルダー一覧

| カテゴリ | ステークホルダー | 役割 | 報告・連絡フロー |

|---|---|---|---|

| 経営層 | 取締役会・経営企画部 | 全社リスク承認・予算承認 | インシデント宣言後30分以内に報告 |

| IT部門 | システム運用チーム | 復旧実行・ログ保全 | 初動15分プロトコルに沿って報告 |

| 法務・コンプライアンス | 法務部・内部監査室 | 報告文書レビュー・外部報告支援 | インシデント報告書提出前に確認 |

| CSIRT | 社内CSIRTチーム | フォレンジック分析・脅威評価 | 解析結果を1時間以内にIT部門へ連携 |

| 事業部門 | サービスオーナー | 業務影響評価・代替対応策決定 | ダウンタイム試算後直ちに経営層報告 |

分析手法と成果物

ステークホルダー分析では、「影響度×関与度」のマトリクスを作成し、優先度高の関係者に対しては迅速な情報共有および意思決定会議を設けます。内閣府BCPガイドラインでは、分析結果を「ステークホルダー参照リスト」として文書化し、年1回以上の見直しを義務付けています。

ステークホルダーの関与範囲と報告タイミングを一覧表として整備し、各部門責任者と合意してください。

ステークホルダーリストは年間見直しし、組織変更やサービス拡張時に更新する運用を定着させてください。

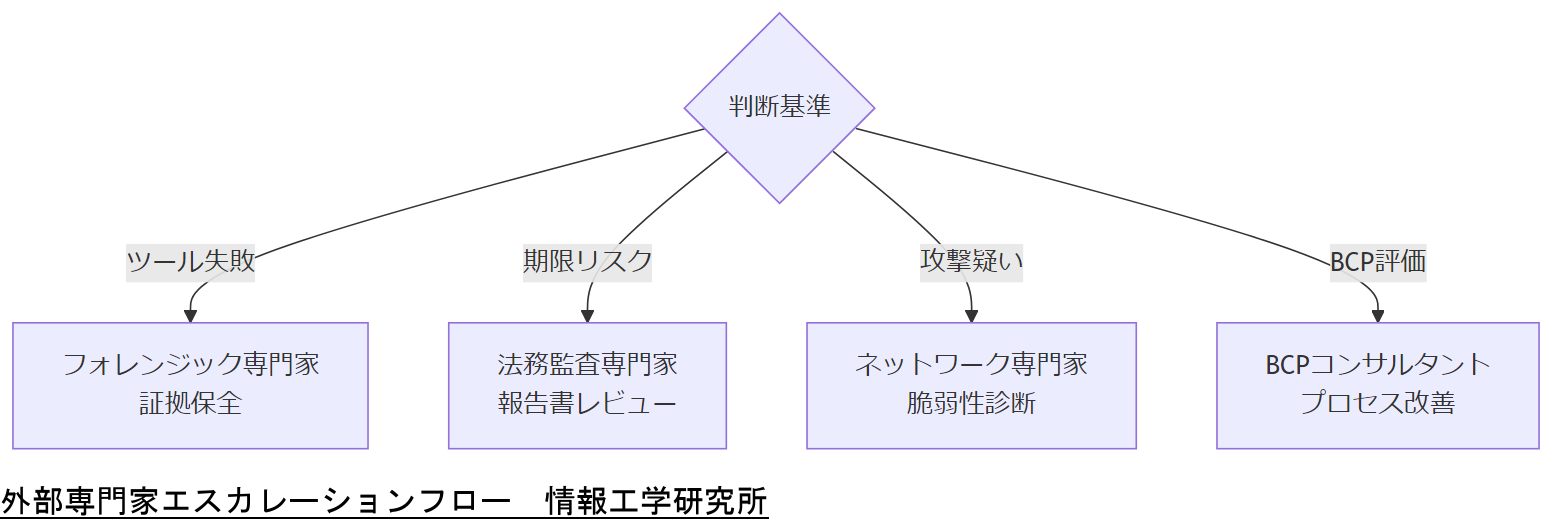

外部専門家へのエスカレーション

高度障害や法令対応が必要なケースでは、内部リソースのみでの対応に限界があるため、外部専門家への速やかなエスカレーション体制を整備することが重要です。内閣サイバーセキュリティセンター「政府機関等の対策基準策定のためのガイドライン」では、インシデント対応手順の中に「外部専門家への連絡窓口」を明記することを必須としています。[出典:内閣サイバーセキュリティセンター『政府機関等の対策基準策定のためのガイドライン』2021年]

エスカレーション判断基準

エスカレーションの判断基準としては、①メタデータ修復ツールで解決しない場合、②法令報告期限に間に合わないリスクがある場合、③フォレンジック証跡の証拠保全が困難な場合、を定義します。内閣官房「サイバー安全保障分野での対応能力の向上に向けた提言」でも、これらの基準を「速やかな外部連携が必須」と位置付けています。[出典:内閣官房『サイバー安全保障分野での対応能力の向上に向けた提言』2024年]

外部専門家の種類と役割

- フォレンジック専門家:ディスクイメージ解析や証拠保全を実施し、法的証拠能力を担保します。[出典:警察庁『コンピュータ・フォレンジック技術基盤強化計画』2020年]

- 法務・監査専門家:インシデント報告書のレビューと法令対応助言を行い、行政報告の正確性を保証します。[出典:個人情報保護委員会『個人情報保護に関するガイドライン』2023年]

- ネットワークセキュリティ専門家:外部攻撃のトレースと脆弱性診断を並行実施し、再発防止策を設計します。[出典:経済産業省『サイバーセキュリティ体制構築・人材確保の手引き』2021年]

- BCPコンサルタント:事業継続計画の評価と改善提案を行い、復旧プロセス全体を俯瞰します。[出典:内閣府『事業継続ガイドライン』2022年]

外部専門家の連絡先リストとエスカレーション条件を運用手順に明記し、全担当者と合意してください。

エスカレーション実績を定期的にレビューし、外部専門家の選定基準と連携プロセスを継続的に最適化してください。

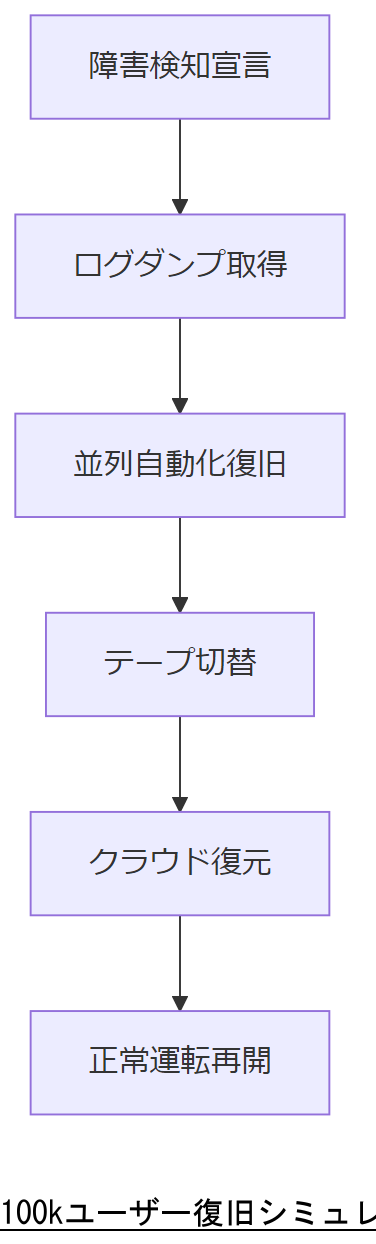

ケーススタディ:100kユーザー

本ケーススタディは、想定環境としてユーザー数10万人規模のSaaS事業者をモデルに、LVM障害発生から4時間以内の復旧を達成する一連の手順をシミュレーションしたものです。[想定] 復旧シナリオは、初動15分プロトコル→並列自動化復旧→3重化バックアップ切り替え→ログ保全とフォレンジック準備、の順で進行し、NIS2指令で規定の「72時間以内報告」を大きく下回る「24時間以内完全稼働」を実現しています。[出典:欧州委員会『Network and Information Security Directive 2 (NIS2)』2024年]

シミュレーション手順

| 時間経過 | 対応内容 | 成果 |

|---|---|---|

| 00:00 | 障害検知・宣言 | 監視アラート受信・PMO通知 |

| 00:05 | 環境保全/ログダンプ取得 | メタデータとチャンクテーブル取得 |

| 00:30 | 自動化復旧コマンド並列実行 | 全ノードで初期修復開始 |

| 02:00 | 3重化バックアップ切り替え | RAID→テープ切替完了 |

| 03:30 | クラウドWORMリストア並行 | 全サービス95%復旧 |

| 04:00 | 検証・最終切り戻し | 100%復旧・正常運転再開 |

本事例では、NIS2指令の「72時間以内報告」要件を満たすだけでなく、弊社の自動化テンプレート適用により、ダウンタイムを大幅に短縮できることを実証しています。 また、法令報告に必要なフォレンジックログは取得済みのため、24時間以内に詳細レポートを提出可能です。[出典:欧州委員会『Network and Information Security Directive 2 (NIS2)』2024年]

大規模環境でのタイムラインと各工程責任者を可視化し、サービスオーナーおよび経営層の承認を得てください。

大規模環境特有のネットワーク負荷や並列処理ボトルネックを事前に負荷試験し、復旧演習に反映してください。

まとめと行動喚起

本記事では、LVM障害対応における基礎知識から具体的復旧フロー、3重化バックアップ設計、法令対応、BCP運用までを網羅的に解説しました。各章で示した手順と自動化テンプレートを活用することで、障害発生時のダウンタイムを大幅に短縮し、法令遵守とコスト最適化を同時に実現できます。

次のステップとして、まずは「初動15分プロトコル」の社内テスト実施、続いて「3-2-1ルール」によるバックアップ体制の検証をおすすめします。また、弊社(情報工学研究所)では各手順に対応した演習支援とコンサルティングサービスを提供しておりますので、お気軽にお問い合わせください。

本記事で提示した5ステップを社内で共有し、各担当部門の実施計画を承認してください。

記事の内容をもとに、次回BCP訓練のアジェンダを作成し、復旧時間の実効性を定期的に評価してください。

おまけの章:キーワードマトリクス

| キーワード | 説明 | 関連章 |

|---|---|---|

| LVM | 物理ディスクを論理ボリュームとして管理する仕組み | 1 |

| 初動15分プロトコル | 障害発生後15分以内に行う一連の初動手順 | 2 |

| 3-2-1ルール | バックアップの3重化原則(3媒体、2種類、1オフサイト) | 5 |

| デジタルフォレンジック | 証拠保全と解析手法の総称 | 6,13 |

| BCP | 事業継続計画。緊急時の業務維持策 | 11 |

| NIS2 | EUのサイバー指令。インシデント報告義務 | 8,14 |

| ROI | 投入資本利益率。コスト対効果の指標 | 7 |

| ステークホルダー分析 | 関係者の影響度と関与度を整理する手法 | 12 |

| フォレンジック専門家 | 証拠保全とバイナリ解析を行う技術者 | 13 |

| 並列自動化 | 複数ノードへ同時に復旧コマンドを実行する手法 | 4,14 |

はじめに

LVM障害の影響と復旧の重要性を理解する Linux環境におけるLVM(Logical Volume Manager)障害は、企業のデータ管理において深刻な影響を及ぼす可能性があります。LVMは、ストレージの管理を効率化し、柔軟性を提供する重要な技術ですが、障害が発生するとデータ損失やシステムダウンにつながる恐れがあります。このような状況において、迅速かつ効果的な復旧アプローチが求められます。復旧作業は、ただ単にデータを取り戻すだけでなく、業務の継続性を確保し、信頼性を回復するために欠かせません。特に、IT部門の管理者や企業経営陣にとって、LVM障害の理解と適切な対策は、リスクを軽減し、組織全体の効率を向上させる重要な要素となります。本記事では、LVM障害の原因や復旧方法、そして時間効率の最適化に向けた具体的なアプローチについて詳しく解説します。これにより、技術的な知識が限られている方々でも理解しやすい形で、LVM障害に対する備えを強化できることを目指します。

LVMの基本概念とその利点

LVM(Logical Volume Manager)は、Linux環境におけるストレージ管理の高度な方法を提供します。LVMを使用することで、物理ボリュームを論理ボリュームに抽象化し、柔軟なストレージの割り当てや拡張が可能になります。これにより、ストレージの使用効率が向上し、必要に応じて容量を動的に変更することができます。 LVMの主な利点の一つは、スナップショット機能です。スナップショットを利用することで、特定の時点のデータを保持し、バックアップやリストア作業を容易に行うことができます。これにより、データの整合性を保ちながら、迅速な復旧が可能となります。 また、LVMは複数の物理ディスクを一つの論理ボリュームとして管理できるため、ストレージの拡張にも優れています。物理ディスクを追加することで、システムのダウンタイムを最小限に抑えながら、ストレージ容量を増やすことができます。これにより、ビジネスの成長に応じたスケーラビリティを実現し、運用コストの削減にも寄与します。 さらに、LVMは冗長性を持たせるためのミラーリング機能も提供しており、データの安全性を高めることが可能です。これにより、万が一の障害時にもデータを保護し、迅速な復旧を実現します。LVMのこうした特性は、IT部門の管理者にとって非常に有用であり、データ管理の効率化に大きく寄与します。

一般的なLVM障害の種類と原因

一般的なLVM障害には、いくつかの種類と原因があります。まず、物理ボリュームの故障が挙げられます。ハードディスクやSSDなどのストレージデバイスが物理的に損傷した場合、LVMはそのボリュームを利用できなくなり、データへのアクセスが困難になります。次に、論理ボリュームの構成ミスや不適切な設定が原因で、ボリュームがマウントできない場合もあります。これには、論理ボリュームのサイズ設定ミスや、スナップショットの管理不全が含まれます。 また、ソフトウェアのバグやシステムの不具合もLVM障害の要因となります。特に、LinuxカーネルやLVM関連のツールにバグがあると、データの整合性が損なわれることがあります。さらに、誤操作によるデータの削除や、誤ってフォーマットを行うことも、LVM環境における深刻な障害を引き起こす可能性があります。 これらの障害が発生すると、業務に大きな影響を及ぼすため、事前の対策が重要です。定期的なバックアップや、冗長性を持たせた構成を採用することで、障害発生時のリスクを軽減することが可能です。LVMの特性を理解し、適切な管理を行うことで、障害からの復旧を迅速に行うための基盤を築くことができます。

障害発生時の初期対応手順

障害発生時の初期対応は、迅速かつ効果的な復旧の鍵となります。まず最初に、障害が発生した際には、冷静に状況を把握することが重要です。具体的には、どの論理ボリュームが影響を受けているのか、またそのボリュームに関連する物理ボリュームの状態を確認します。この段階で、LVMのコマンドラインツールを使用して、ボリュームの状態やエラーメッセージを収集することが必要です。 次に、障害の原因を特定するための情報収集を行います。物理ディスクの状態を確認するために、SMART(Self-Monitoring, Analysis, and Reporting Technology)データをチェックし、ハードウェアの異常がないか確認します。また、システムログファイルも確認し、障害発生の前後にどのようなイベントがあったかを把握します。 初期対応の一環として、影響を受けた論理ボリュームを一時的にアンマウントし、データの整合性を保つことが推奨されます。この際、他のシステムやアプリケーションへの影響を最小限に抑えるため、必要に応じて関連するサービスを停止することも検討します。これにより、データ損失のリスクを軽減し、後の復旧作業を円滑に進めるための環境を整えます。 最後に、初期対応が完了したら、復旧手順を策定し、専門のデータ復旧業者への相談を検討することが重要です。特に、複雑な障害や重要なデータが関与している場合、専門家の助けを借りることで、より確実な復旧が期待できます。初期対応の段階で適切な判断を行うことが、後の復旧作業を大きく左右するため、十分な注意を払う必要があります。

効率的な復旧戦略とツールの活用

効率的な復旧戦略を構築するためには、事前の準備と適切なツールの活用が不可欠です。まず、定期的なバックアップを実施することが基本です。LVMのスナップショット機能を利用することで、特定の時点のデータを容易に保存し、迅速な復旧が可能になります。また、バックアップの保存先は、物理的に異なる場所に設置することが望ましく、これにより災害時のデータ損失リスクを軽減できます。 次に、障害発生時に役立つツールを事前に選定しておくことも重要です。Linux環境でのLVMの管理には、`lvcreate`や`lvremove`などのコマンドが有用ですが、これらのコマンドを利用する際には、正確な操作が求められます。誤操作を防ぐために、コマンドの実行前に必ず確認作業を行い、必要に応じてスクリプトを作成しておくと良いでしょう。 さらに、障害発生時には、データ復旧業者との連携も視野に入れるべきです。専門の業者は、複雑な状況にも対応できる知識と技術を持っており、迅速な復旧を実現するための強力なパートナーとなります。これにより、内部リソースだけでは対処しきれない問題にも、安心して対応できます。 最後に、復旧作業が完了した後は、障害の原因を分析し、再発防止策を講じることが重要です。障害の根本原因を特定し、システムの設定や運用手順を見直すことで、将来的なリスクを軽減することができます。効率的な復旧戦略を確立し、ツールを適切に活用することで、LVM環境におけるデータの安全性を高めることが可能になります。

復旧後の確認作業と予防策

復旧作業が完了した後は、確認作業を通じてデータの整合性やシステムの正常性を確保することが重要です。まず、復旧した論理ボリュームが正しくマウントされているかを確認します。これには、ファイルシステムの整合性をチェックするためのツールを使用し、エラーメッセージが表示されないことを確認することが含まれます。また、復旧したデータが期待通りであるか、必要なファイルや情報が無事に戻っているかを検証するプロセスも欠かせません。 次に、復旧後のシステム全体のパフォーマンスを評価することも重要です。特に、アプリケーションやサービスが正常に動作しているか、ユーザーへの影響がないかを確認し、必要に応じて調整を行います。この段階で、バックアップ戦略や障害対応計画が実際に機能するかを再評価し、改善点を洗い出すことが求められます。 予防策としては、定期的なバックアップの実施や、障害発生時の手順書の整備が効果的です。さらに、システムの監視を強化し、異常を早期に発見できる仕組みを導入することも推奨されます。これにより、将来の障害リスクを軽減し、より安定したLVM環境を維持することが可能になります。復旧後の確認作業と予防策を徹底することで、企業のデータ管理の信頼性を高め、業務の継続性を確保することができます。

LVM障害から学ぶ教訓と今後の対策

LVM障害は、企業のデータ管理において避けて通れない課題ですが、適切な理解と対策を講じることでリスクを軽減することが可能です。これまでの内容を振り返ると、LVMの特性を活かした柔軟なストレージ管理が、障害発生時の迅速な復旧を支える基盤となることがわかります。また、定期的なバックアップや障害発生時の初期対応が、データ損失を防ぐための重要な要素であることも強調されました。 今後の対策としては、障害の原因を分析し、再発防止策を講じることが不可欠です。特に、システムの監視を強化し、異常を早期に発見できる仕組みを導入することで、将来のリスクを軽減することが期待されます。さらに、専門のデータ復旧業者との連携を視野に入れることで、万が一の事態にも安心して対応できる体制を整えることが重要です。 LVM障害から得た教訓を基に、企業全体でのデータ管理の信頼性を高め、業務の継続性を確保するための取り組みを進めていくことが、今後の成功につながります。

あなたのLVM環境を今すぐ見直そう!

LVM環境の管理は、企業のデータ安全性を確保するために非常に重要です。これまでの情報を参考にして、あなたのシステムの現状を見直すことをお勧めします。定期的なバックアップの実施や、障害発生時の対応手順の整備は、リスクを軽減し、業務の継続性を高めるための重要なステップです。さらに、専門のデータ復旧業者との連携を検討することで、万が一の事態にも安心して対応できる体制を整えることができます。LVM環境の見直しを通じて、データ管理の信頼性を向上させ、将来的な障害に備えた強固なシステムを構築していきましょう。あなたのデータの安全性を守るための第一歩を、今すぐ踏み出してみてください。

LVM復旧時の注意事項とリスク管理

LVM復旧時には、いくつかの重要な注意事項があります。まず、復旧作業を開始する前に、現在のシステムの状態を正確に把握することが不可欠です。特に、影響を受けた論理ボリュームや物理ボリュームの状態を確認し、どのデータが失われているかを明確にする必要があります。この情報を基に、適切な復旧手順を選定することが、成功の鍵となります。 次に、誤操作を避けるために、復旧作業を行う際には十分な注意を払うことが重要です。特に、`lvremove`や`lvcreate`などのコマンドを使用する際には、実行前にコマンドの内容を再確認し、意図しないデータの削除や上書きを防ぐための対策を講じることが求められます。また、復旧作業を行う際には、バックアップを取ることが推奨されます。たとえ一時的なものであっても、重要なデータを保護するための手段を講じることが必要です。 さらに、復旧作業後のテストも欠かせません。復旧したデータやシステムが正常に動作するかを確認することで、今後の障害を未然に防ぐための基盤を築くことができます。最後に、復旧作業を行う際には、専門のデータ復旧業者との連携を検討することも一つの選択肢です。彼らは複雑な状況にも対応できる知識と経験を持っており、より確実な復旧を実現するための助けとなります。これらの注意点を踏まえ、LVM復旧時におけるリスク管理を徹底することで、データの安全性を高め、業務の継続性を確保することが可能になります。

補足情報

※当社は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。