- いま Read-only になっているか/再マウントが起きているか

- 直近の変更(容量逼迫、再起動、ストレージ交換、RAID/LVM操作、カーネル更新、コンテナ運用変更)

- ログに I/O エラー系が出ているか、メタデータ整合性系が出ているか

選択と行動 まず「書き込みが増える操作」を避け、現状の情報(ログ/SMART/RAID状態)を固める 影響範囲を小さく保ったまま、データ確保(クローン/イメージ)を軸に計画する 下層が不安定なら、Ext4側の“修復”より先に土台の安定化を優先する

選択と行動 まず「何が壊れているか」をログで言語化し、影響範囲(どのマウントポイント/サービスか)を確定する 変更を最小化しつつ、復旧に要する時間(停止時間/リトライ)を見積もる 本番データや監査要件が絡む場合は、証跡を残しながら手順を選ぶ

選択と行動 「容量」「権限」「運用変更」のどれが引き金かを切り分け、再発条件を潰す 目に見える症状だけで判断せず、ログと差分(直前変更)で整合させる 影響範囲が小さいうちに、運用の戻し方(ロールバック/バックアップ復元)を並走で検討する

選択と行動 影響は「単体ホスト」より広がりやすい前提で、依存関係(共有/レプリカ/ジョブ)を先に棚卸しする 変更は最小にして、範囲を限定できる手から着手する 収束が遅れそうなら、早めに復旧計画と手順の監査適合まで含めて整理する

- 対象のマウントポイントと、その上で動くサービス(DB/アプリ/バッチ)の優先順位

- コンテナ(ボリューム/overlay)や共有ストレージ(NFS/iSCSI/クラスタ)への波及

- バックアップの最終成功時刻と、復元の現実的な所要時間

- 監査・証跡(ログ/変更履歴/保全要件)が必要か

- 症状だけで決め打ちして触ってしまい、復旧の選択肢が狭まる

- 下層(ディスク/RAID/LVM)の不安定さを見落とし、途中で再発して作業が長期化する

- 影響範囲の把握が遅れて、コンテナや共有側へ波及し、説明と調整コストが跳ね上がる

- 証跡や判断根拠が残らず、監査・社内報告で手戻りが発生する

- Read-only化の原因が追えない。

- I/Oエラーとメタデータ破損の見分けが付かない。

- 復旧に必要な停止時間の見積もりができない。

- バックアップはあるが、戻す順番と影響が読めない。

- 共有ストレージ、コンテナ、本番データ、監査要件が絡む場合は、無理に権限を触る前に相談すると早く収束しやすいです。

- RAID/LVMが絡んでいて、どこまでが論理障害か判断できない。

- 現場説明用に「いま分かっている事実」を整理したい。

もくじ

- 第1章:突然のRead-only化、その1分で復旧時間が決まる

- 第2章:Ext4を“障害の言葉”で理解する(inode・ブロック・ジャーナル)

- 第3章:症状を3分類する:I/Oエラー/メタデータ破損/容量・運用要因

- 第4章:30秒で事実を集める:ログ・マウント状態・直前変更

- 第5章:最小変更で守る:証跡と影響範囲を崩さない初動設計

- 第6章:争点A:下層(ディスク/RAID/LVM)かExt4かを切り分ける

- 第7章:争点B:ジャーナル再生と整合性チェックの“時間コスト”を読む

- 第8章:争点C:コンテナ・共有ストレージ・監査要件が絡む分岐

- 第9章:復旧時間を短くする運用:監視・バックアップ検証・手順書

- 第10章:まとめ:成否より“収束”を早める相談の使い方

【注意】 Ext4障害は「原因が確定していない状態での自己判断による修復・復旧作業」が、データ消失や復旧コスト増大につながることがあります。まずは被害最小化(ダメージコントロール)を優先し、書き込みが増える操作を避けつつ状況を整理してください。判断に迷う場合や本番データ・監査要件・共有ストレージ/仮想化/コンテナが絡む場合は、株式会社情報工学研究所のような専門事業者へ相談し、現実的な収束プランを立てることを推奨します(無料相談フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

突然のRead-only化、その1分で復旧時間が決まる

「ログインはできるのに、急に書き込めない」「サービスが次々に落ちる」「再起動したら戻ると思ったのに状況が悪化した」──Ext4の障害でよくあるのは、“現場が一番忙しい瞬間”に、静かに致命傷へ近づくことです。特に本番系では、焦って操作を増やすほどログが流れ、状況が変化し、後から原因も説明も難しくなります。

Ext4は堅牢なファイルシステムですが、下層のI/O異常(ディスクやRAID、ケーブル、HBA、仮想基盤のストレージ経路)や、容量逼迫、突然の電源断、運用変更の副作用が重なると、「守るための動き」として読み取り専用(Read-only)へ移行することがあります。ここで大切なのは、いきなり“直す”より先に、被害最小化の観点で「現状をこれ以上動かさない」判断ができるかどうかです。

冒頭30秒:症状から“いまやるべきこと”を決める

以下は、現場が最初に迷いやすい「症状 → 取るべき行動」を、危険な作業を煽らない形で整理したものです。狙いは、復旧の成否より先に“収束”を早めることです。

| 症状(見えていること) | 背景の可能性(決め打ちしない) | 安全な初動(被害最小化) | 早めに相談したい条件 |

|---|---|---|---|

| 書き込みで失敗、Read-only になる | I/O異常・整合性問題・運用要因が混在 | 新規書き込みを増やさず、症状・時刻・直前変更を整理 | 本番、共有、監査、復旧時間の説明が必要 |

| I/O error、timeout、reset系のログが増える | ディスク/RAID/経路/HBA/仮想ストレージの不安定 | 土台の健全性を疑い、上位の操作を増やさない | 再発を繰り返す、遅延が長い、台数が多い |

| 容量が逼迫、突然の停止/再起動後に不整合 | 運用負荷・容量設計・突発停止の影響が表面化 | 原因の再現条件を整理し、再発条件を潰す計画を優先 | 復旧と再発防止を同時に要求される |

| コンテナ/仮想化/共有ストレージで波及が読めない | 影響範囲が単体ホストを超えて拡大しやすい | 依存関係を棚卸しし、範囲を限定できる手から収束 | 復旧の説明責任が重い、監査や証跡が必須 |

「修理手順」を探して来た人ほど、最初に知るべきこと

検索でたどり着く多くの人は、「この手順で直る」という答えを期待します。しかしExt4の障害は、症状が似ていても原因が異なることが珍しくありません。たとえば“ファイルシステムが壊れた”ように見えて、実は下層I/Oの不安定さが引き金で、表層の整合性が崩れているだけ、というケースもあります。ここで操作を増やすと、状況の変化が加速して判断材料が失われがちです。

だから冒頭で伝える結論はシンプルです。自分で修復・復旧作業を進める前に、まず安全な初動で「状況を固定」し、収束シナリオを作る。本番データや契約、監査、対外説明が絡む場合は、一般論の手順だけではリスクの方が大きくなるため、早い段階で専門家に相談したほうが結果的に速く落ち着きます。

迷ったら 株式会社情報工学研究所へ無料相談(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。「何をしたらよいか」だけでなく、「何をしないほうがよいか」「どこまで影響が及ぶか」を案件の前提に沿って整理できると、社内調整も一気に楽になります。

Ext4を“障害の言葉”で理解する(inode・ブロック・ジャーナル)

Ext4の障害対応が難しく感じられる理由は、現場で起きていることが「アプリの失敗」に見えても、実態はファイルシステムの内部構造(メタデータ)と、下層のI/O、運用状況が絡み合うからです。まずは用語を“暗記”ではなく、“障害の言葉”として押さえると、ログや現象が読みやすくなります。

inode:ファイルの「身分証」と参照の中心

inodeは、ファイルそのものの内容ではなく、所有者・権限・タイムスタンプ・データ位置(どのブロックにあるか)などを管理するメタデータの要です。障害時に「ディレクトリが読めない」「ファイル名はあるのに開けない」「権限や属性が不自然」といった症状が出るとき、inodeやディレクトリエントリ(名前とinodeの対応関係)が疑われます。

ここで重要なのは、症状から“直感的に”修復へ進むのではなく、「inode周りの不整合なのか」「実体のブロックが読めないのか」を切り分ける視点です。前者と後者では、必要な確認と復旧の時間コストが大きく変わります。

ブロック:実データの格納単位と、下層I/Oの影響

Ext4は、ファイルの内容をブロックに分割して格納します。ブロックが読めない(I/O errorが出る)場合、ファイルシステムだけを見ていても本質に届きません。ディスクの不良、RAIDのデグレード、ケーブルやコントローラの不調、仮想化基盤のストレージ遅延など、下層に起因することが多いからです。

「一部だけ読めない」「特定の領域で遅い」「時間帯で揺れる」といった現象は、下層の不安定さが関与しているサインになり得ます。このタイプは、操作を増やすほど状態が揺れ、症状が拡大しやすい傾向があります。復旧の議論は、ファイルシステム単体の話に閉じないことが大切です。

ジャーナル:壊れにくさの源泉だが、万能ではない

Ext4はジャーナリングにより、突然の停止やクラッシュがあっても整合性を戻しやすい設計です。ジャーナルは「これから行う更新」を記録し、途中で止まっても“やり直せる”ようにします。これにより、整合性の崩れが軽減される場面は多い一方、下層I/Oが不安定だったり、運用上の変更が絡んでいたりすると、ジャーナルがあっても症状が残ることがあります。

現場で効いてくるのは、「ジャーナルがあるから大丈夫」ではなく、「ジャーナルが働く前提条件が崩れていないか」という発想です。たとえば書き込みが正常に完了しない状況では、ジャーナルの恩恵は限定的になり得ます。そのため、障害対応の序盤では“直す”より“壊しに行かない”設計が重要になります。

専門家に相談するとき、説明が一気に進む整理の仕方

Ext4は内部構造がはっきりしている分、事実の整理ができると収束が速くなります。たとえば「いつから」「どのマウントポイントで」「Read-onlyになったか」「I/O errorがあるか」「容量逼迫があったか」「直前に何を変えたか」を、時系列で揃えるだけでも原因の候補が絞れます。

この整理を、契約・システム構成・復旧目標(RTO/RPO)と結びつけて判断するのが難しいときは、株式会社情報工学研究所のような専門家に相談するのが現実的です。一般論の“手順”ではなく、あなたの前提に沿った“収束プラン”が必要になる領域だからです。

症状を3分類する:I/Oエラー/メタデータ破損/容量・運用要因

Ext4障害の対応で最も時間を浪費するのは、「同じ症状に見えるもの」を同じ扱いで進めてしまうことです。収束を早めるコツは、原因を断定するのではなく、症状を“3分類”して優先順位を決めることです。ここでは、現場で実用的な分類として「I/Oエラー寄り」「メタデータ寄り」「容量・運用要因寄り」に分けます。

分類A:I/Oエラー寄り(下層が不安定な可能性が高い)

ログにI/O error、timeout、reset、pathの異常が見える、あるいは体感として読み取りが極端に遅い場合、ファイルシステムの“上”で何をしても改善しないことがあります。これは、土台が揺れている状況で、操作を増やすほど悪化リスクが上がりやすいタイプです。

この分類では、被害最小化の観点で「状況の固定」と「影響範囲の切り分け」が先になります。単体の障害に見えても、RAIDや仮想ストレージ、共有ストレージに波及していると、社内調整・対人調整のコストが急増します。技術だけでなく“説明責任”が絡む場合は、早めに専門家へ相談したほうが収束が速くなりがちです。

分類B:メタデータ寄り(整合性の崩れが前面に出ている)

ディレクトリの参照不全、リンク関係の崩れ、属性の不自然さなど、メタデータの整合が疑われる場合は、復旧の可否だけでなく「どれくらい時間がかかるか」「停止時間をどう確保するか」が争点になります。本番系では、技術的に可能でも、業務停止の許容がないと成立しません。

この分類で重要なのは、復旧の成否を“その場”で判断しないことです。復旧目標、監査要件、バックアップ状況、関係者の合意形成まで含めて「どのルートなら軟着陸できるか」を考えます。一般論の手順が通用しにくいのは、ここに“個別案件”の前提が強く乗るからです。

分類C:容量・運用要因寄り(再発条件を潰さないと落ち着かない)

容量逼迫、ログの過剰生成、バッチの集中、運用変更の影響などが重なると、障害は“直したつもり”でも再発します。現場では「復旧したのにまた落ちた」が最もつらく、信頼も削れます。この分類は、復旧と同時に「再発条件の潰し込み」が必要になりやすいのが特徴です。

特に、コンテナやジョブ基盤、共有ストレージが絡むと、単体の対処では場が落ち着かないことがあります。ここで求められるのは、技術だけでなく、運用・監視・バックアップ検証・変更管理まで含めた“収束設計”です。

3分類を“判断の材料”として使うための対応関係

| 分類 | 収束を早める考え方 | 一般論の限界が出やすい点 |

|---|---|---|

| A:I/Oエラー寄り | 土台の健全性を疑い、操作を増やさず影響範囲を限定 | 下層構成(RAID/仮想/共有)次第で手が変わる |

| B:メタデータ寄り | 停止時間・説明責任・証跡を含めてルートを選ぶ | 復旧目標(RTO/RPO)と監査要件で最適解が変わる |

| C:容量・運用要因寄り | 再発条件を潰し、運用設計まで含めて場を整える | 監視・バックアップ検証・変更管理の前提が案件で異なる |

この3分類は、原因を断定するためではなく、「次に何を整理すべきか」を決めるための地図です。契約、システム構成、重要データの範囲、関係者の合意形成が絡むほど、一般論だけでは判断が難しくなります。そういうときは、株式会社情報工学研究所のような専門家へ相談し、個別前提に沿って収束の道筋を作るほうが、結果として時間も損失も抑えられます(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

30秒で事実を集める:ログ・マウント状態・直前変更

Ext4障害の現場で最初に起きがちなのは、「原因が分からない不安」を埋めるために操作が増えることです。しかし、復旧の成否や時間は“最初に揃えた事実”で大きく左右されます。ここでいう事実とは、推測や体感ではなく、時刻と対象が結びついた情報です。まずは被害最小化(ダメージコントロール)として、書き込みを増やす行為を避けつつ、短時間で説明可能な材料を揃えます。

最初に揃える「5点セット」

現場で最も効くのは、次の5点を“同じ時刻軸”で揃えることです。これだけで、下層I/Oか、ファイルシステム整合性か、運用要因かの当たりが付きやすくなります。

- いつから異常が始まったか(ユーザ影響の開始時刻/アラート時刻/最初のエラー時刻)

- どのマウントポイントで異常が出ているか(単一か複数か、重要データの位置)

- 現在のマウント状態(Read-only化、再マウント、オプション変更の有無)

- ログの種別ごとの状況(カーネル系、ストレージ系、サービス系のどこが先に崩れたか)

- 直前変更(容量・ジョブ・デプロイ・再起動・ストレージ交換・仮想基盤変更・コンテナ設定変更など)

この「5点セット」は、修理のためではなく、収束のための整理です。状況説明が必要な現場ほど、事実が揃うだけで社内調整が進み、不要な操作が減ります。

ログを見るときの要点:順番と“先に壊れたもの”

ログは多いほど良いわけではありません。見るべきは「どれが最初に壊れたか」「連鎖はどの方向か」です。たとえば、ストレージ経路の異常が先に出て、その後にExt4の警告やRead-only化が出るなら、土台の不安定さが疑われます。逆に、運用上の逼迫(容量やI/O集中)が先にあり、その後にサービス遅延や整合性警告が出るなら、負荷・運用要因が引き金の可能性が高まります。

| 見え方(例) | 読み取り方(決め打ちしない) | 次に揃える事実 |

|---|---|---|

| ストレージ経路の異常 → I/O遅延 → Ext4がRead-only | 下層I/O寄りの可能性が上がる | RAID/LVM/仮想基盤/共有ストレージ側の状態 |

| 容量逼迫やジョブ集中 → サービス異常 → 整合性警告 | 運用要因寄りの可能性が上がる | 容量推移、I/Oピーク、直前変更、再発条件 |

| 特定ディレクトリだけ不自然 → 参照が崩れる | メタデータ寄りの可能性が上がる | 影響範囲(どのデータが対象か)、バックアップ最終時刻 |

「直前変更」を責めない形で集める

直前変更は、責任追及に使うと現場が萎縮し、情報が出なくなります。収束を早める観点では「何が変わったか」を淡々と集めるほうが得です。変更は“正しい施策”でも副作用が出ることがありますし、変更がなくても潜在不良が表面化することがあります。時刻と対象が揃えば、議論の温度を下げ、合理的に優先順位を付けられます。

この段階で判断が難しい、または本番・監査・共有基盤が絡んで影響範囲の説明が必要な場合は、株式会社情報工学研究所のような専門家に状況整理から相談し、最小変更での収束プランを作るほうが現実的です(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

最小変更で守る:証跡と影響範囲を崩さない初動設計

Ext4障害で現場が苦しくなるのは、「直すこと」と同時に「説明すること」が求められるからです。しかも説明は、復旧後に“なぜそう判断したか”を問われます。ここで効くのが、最小変更という考え方です。最小変更とは、手数を減らすことではなく、変更の影響範囲を限定し、判断根拠(証跡)を残しながら、収束へ向かう道筋を作ることです。

証跡が必要になる場面:本番・契約・監査・対外説明

本番データ、個人情報、医療・介護、金融、公共など、監査や契約が絡む領域では「何をしたか」だけでなく「何をしなかったか」「なぜその順番にしたか」が重要になります。障害時は判断が揺れやすいので、後から整合する説明を作るのは難しくなります。だから最初から、証跡を“後付け”にしない設計が有効です。

- 時系列:最初の兆候、影響の拡大、対応の判断点(いつ何を切り替えたか)

- 範囲:対象のマウントポイント、関連サービス、依存する基盤(仮想化/共有/コンテナ)

- 根拠:ログ、アラート、容量推移、構成情報、直前変更

この3点が揃うと、議論の過熱を抑え込み、関係者が同じ地図を見て話せるようになります。

「影響範囲」を先に固定する理由

障害対応は、対象が広がった瞬間に難易度が跳ね上がります。Ext4単体の問題に見えても、実は別ホストの共有領域や、コンテナの永続ボリューム、バックアップジョブの再実行などが絡むと、二次被害が増えやすくなります。最小変更の初動では、復旧の前に「どこまでが同じ障害として扱う範囲か」を固定します。

| 確認対象 | 影響が広がりやすい例 | 最小変更の観点 |

|---|---|---|

| 共有ストレージ | 別ホストの同一領域にも波及、整合性が崩れる | 単体判断を避け、依存関係を棚卸ししてから収束ルートを選ぶ |

| 仮想化/コンテナ | ホスト/ゲストの責任境界が曖昧で調整が難航 | 層ごとの事実(どこで何が起きたか)を分けて整理する |

| バックアップ/レプリカ | 復旧のつもりが再同期で負荷増大、遅延が拡大 | 復旧目標(RTO/RPO)と所要時間を先に見積もる |

「やらない判断」を言語化すると収束が速い

検索で来た人が期待する“手順”は、状況次第で逆効果になることがあります。だから最小変更の初動では、やること以上に「やらないこと」を言語化しておくと強いです。たとえば、原因が固まる前に操作を増やさない、影響範囲が読めないまま再起動に踏み切らない、というように、判断をブレーキとして機能させます。

個別の案件・契約・構成によって最適解が変わる場面ほど、一般論の限界が出ます。迷う材料が揃っているのに結論が出ないときは、株式会社情報工学研究所へ相談し、事実整理から収束ルート設計まで一緒に進めるほうが損失と流出を抑えやすくなります(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

争点A:下層(ディスク/RAID/LVM)かExt4かを切り分ける

Ext4障害の議論が長引く典型は、「ファイルシステムが壊れたに違いない」と決め打ちしてしまうことです。現場では確かにファイルが読めない、書けない、サービスが落ちるので、Ext4に意識が集中します。しかし実務上は、下層(ディスク/RAID/LVM/仮想基盤/共有ストレージ)の不安定さが先にあり、その結果としてExt4がRead-only化したり、整合性警告が出たりするケースが少なくありません。

切り分けの基本:症状ではなく“連鎖の方向”を見る

切り分けは原因の断定ではありません。「どちらの可能性が高いか」を先に当たり付けし、次に集める事実を決める作業です。ポイントは、どちらが先に揺れたかです。下層の揺れが先なら、Ext4側の操作を増やしても収束しにくい。逆に、下層が安定しているのにメタデータの不整合が目立つなら、ファイルシステム側の整合性が争点になりやすい、という読み方です。

| 観測されやすい事実 | 下層寄りの見立て | Ext4寄りの見立て | 次に集める材料 |

|---|---|---|---|

| I/O遅延、timeout、経路リセットが先行 | 可能性が上がる | 可能性は相対的に下がる | RAID状態、物理ディスク健全性、仮想/共有の基盤ログ |

| 特定ディレクトリだけ参照不全が目立つ | 可能性は相対的に下がる | 可能性が上がる | 影響範囲、バックアップ最終時刻、変更履歴 |

| 容量逼迫やI/O集中が先行 | 混在しやすい | 混在しやすい | 容量推移、ジョブ、監視、再発条件 |

本番で効く判断:先に「土台の安定」を疑うべき場面

本番で最も怖いのは、復旧に向けて操作した結果、I/O不安定が再発して状況が振り出しに戻ることです。下層が怪しいときは、表層の整合性をいじるほど状態が揺れやすくなります。だから現実的には、土台の安定性が疑われる段階では、操作を増やさない判断が“歯止め”として機能します。

この判断が難しいのは、構成が案件ごとに違うからです。単体サーバか、RAIDか、LVMか、仮想化か、共有ストレージかで、揺れ方と波及範囲が変わります。一般論のチェックだけでは説明責任を満たせない場合、株式会社情報工学研究所のような専門家に相談し、層ごとに事実を整理して収束へ導くほうが、結果として速く落ち着くことが多いです(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

争点B:ジャーナル再生と整合性チェックの“時間コスト”を読む

Ext4障害の対応で、現場の意思決定を最も難しくするのが「正しさ」ではなく「時間」です。整合性の問題は、理屈の上では“戻せる”場面があっても、停止時間・再起動回数・関係者の合意・バックアップ復元の所要時間など、現実の制約に引っ張られます。ここで重要なのは、作業の中身を細かく知ることよりも、どの選択がどれくらいの時間コストを持つかを、早い段階で見通すことです。

ジャーナルが効く場面/効きにくい場面

Ext4のジャーナルは、突然の停止やクラッシュ後でも整合性を戻しやすくするための仕組みです。更新の途中で止まっても、再開時に整合が取れる方向へ寄せられるため、軽微な不整合は吸収されることがあります。一方で、下層I/Oが不安定だったり、容量逼迫や強い負荷が継続していたり、そもそも読み取りが安定しない状況では、ジャーナルが期待通りに働きにくくなります。

現場の混乱は、「ジャーナルがあるから大丈夫」という期待と、「実際は落ち着かない」という現象のギャップから生まれます。ギャップを埋めるには、作業の是非を議論する前に、状況を“落ち着かせる”条件が揃っているか(下層の安定・負荷の抑え込み・影響範囲の限定)を確認し、収束に必要な材料を先に揃えることが有効です。

整合性チェックに伴う現実的なコスト

整合性の確認や修復の議論では、技術的な正否より「どれくらい止められるか」「どれくらい待てるか」が争点になります。本番系では、停止時間が短いほど、選べる手は限られます。逆に、停止時間を確保できるなら、確認できる範囲が増え、再発の芽も潰しやすくなります。

| 選択の方向性 | 時間コストの見立て | 向いている状況 | 一般論の限界 |

|---|---|---|---|

| 短時間で場を整える(被害最小化を優先) | 停止は短いが、根本原因の特定は後回しになりやすい | 対外影響が大きく、まず鎮火が必要 | 構成や依存関係で“短時間”の定義が変わる |

| 停止時間を確保して整合性を深く確認 | 時間はかかるが、再発条件まで含めて潰し込みやすい | 業務都合でメンテ枠が確保でき、説明責任が重い | 停止時間の合意形成が案件ごとに異なる |

| バックアップ/レプリカ復元を軸に収束 | 復元時間とデータ欠損許容(RPO)で決まる | 復元手順が検証済みで、復旧目標が明確 | バックアップの状態や復元手順の成熟度が案件依存 |

意思決定を速くする「3つの質問」

議論が過熱しやすい場面でも、次の3つを揃えると、温度を下げつつ合理的に前へ進めます。

- 停止時間はどれくらい確保できるか(今すぐ/今夜/週末など、現実の枠)

- データ欠損の許容はどこまでか(最新分が必須か、何時間分まで許容できるか)

- 説明責任の強さはどれくらいか(監査・契約・対外説明・医療/介護などの要件)

この3つは、技術の議論というより、案件の前提です。前提が固まらないまま手を進めると、後で合意が崩れて手戻りし、復旧時間が伸びます。

個別案件で「一般論の限界」が出るところ

整合性の問題は、表面だけ見ると似ていますが、最適解はシステム構成と契約条件で変わります。単体サーバで完結しているのか、共有ストレージやクラスタで波及するのか、コンテナの永続ボリュームが絡むのか、監査要件があるのかで、必要な証跡も停止の合意形成も違います。

この段階で迷いが消えない場合は、株式会社情報工学研究所のような専門家に相談し、「停止時間・復旧目標・証跡」を含めた収束プランとして整理するほうが、結果的に被害最小化につながります(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

争点C:コンテナ・共有ストレージ・監査要件が絡む分岐

Ext4障害が“難案件”になるのは、ファイルシステムそのものより、影響範囲が単体ホストを超えるときです。コンテナ、仮想化、共有ストレージ、バックアップ連携、監査要件が絡むと、復旧の議論は「直るかどうか」から、「誰がどこまで責任を持つか」「何を証跡として残すか」「どの順で合意を取るか」へ広がります。ここで大切なのは、議論が過熱して手が増える前に、層ごとに整理して“場を整える”ことです。

コンテナ環境で起きる「見え方のズレ」

コンテナでは、アプリのログやエラーが最初に目に入るため、「アプリが壊れた」「イメージが壊れた」と誤認しやすくなります。しかし永続データがどこにあるか(ホスト側のマウント、ボリューム、ネットワークストレージ、クラスタのPVなど)によって、障害の層が変わります。層が違えば、必要な事実も、関係者も変わります。

収束を早めるには、次のように“層の地図”を作り、会話の対象を揃えます。

- アプリ層:どの機能がどのデータに依存し、どの時刻から異常か

- コンテナ層:永続データの置き場(ボリューム/PV)と、変更履歴(デプロイや設定変更)

- ホスト層:該当マウントポイントの状態、Read-only化の有無、I/O遅延の兆候

- ストレージ層:共有/NAS/SAN/仮想ストレージの遅延や障害兆候

この地図がないまま議論すると、話が行き来し、社内調整・対人調整だけで時間が溶けやすくなります。

共有ストレージが絡むときの分岐:影響範囲が跳ねる

共有ストレージ(NFS、iSCSI、クラスタストレージなど)が絡むと、単一ホストのExt4障害に見えても、実際は複数ホスト・複数サービスへ波及することがあります。特に「同じデータを複数が参照している」場合、片側だけの判断で動くと、他側の整合性や可用性に影響が出る可能性があります。

この分岐で効くのは、「単体で直す」より「波及を止める」視点です。つまり、誰がどの範囲の判断を持つのか、どの順で影響範囲を限定するのかを先に固め、収束へ向けた合意形成を先行させます。

監査要件が絡むとき:証跡と説明責任が主戦場になる

監査や契約が絡む現場では、障害対応は“技術だけ”で終わりません。事後に「なぜその判断をしたか」「どんなリスクを避けたか」「どの証跡があるか」を求められます。ここで作業が増えるほど、証跡が散らばり、説明が難しくなります。だからこそ、最小変更で証跡を残し、判断点を明確にしておくことが重要です。

| 求められやすい説明 | 揃えておくと強い材料 | 収束のための工夫 |

|---|---|---|

| 影響範囲はどこまでか | マウントポイント、依存サービス、共有/クラスタの関係図 | 層ごとに分解して説明する |

| 判断根拠は何か | 時刻付きログ、アラート、直前変更、容量推移 | 判断点(いつ何を切り替えたか)を残す |

| 再発防止はどうするか | 再発条件、運用手順、監視項目、復元検証の結果 | 短期(鎮火)と中期(再発防止)を分けて提示する |

相談が効く条件:構成が複合で、説明責任が重いとき

共有ストレージ、コンテナ、本番データ、監査要件が絡む場合は、技術的な最適解より「収束の最短ルート」を作ることが重要になります。ここで無理に権限や設定を触る前に相談すると、結果として早く落ち着くことが多いです。

個別案件では、一般論のチェックリストだけでは判断が割れます。構成、契約、復旧目標、影響範囲、証跡の取り方をまとめて設計する必要があるため、株式会社情報工学研究所のような専門家へ相談し、状況整理から依頼判断まで一気通貫で進めるほうが、損失・流出の抑え込みにつながります(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

復旧ルートの選び方:バックアップ/スナップショット/代替系で軟着陸する

Ext4障害の現場で「直す」より先に効くのは、「どのルートなら早く収束するか」を選ぶことです。復旧ルートは技術の好みではなく、停止時間、データ欠損許容、説明責任、そして構成の複雑さで決まります。ここで無理に一発逆転を狙うと、状況が揺れ続け、社内調整も対外調整も難しくなります。

まず押さえる3軸:RTO/RPO/説明責任

復旧ルートの議論がまとまらないときは、論点が混ざっていることが多いです。次の3軸を先に揃えると、議論の温度を下げつつ合意が取りやすくなります。

- RTO:どれくらいで復旧(業務再開)したいか。現実の停止枠とセットで考える。

- RPO:どこまでデータ欠損を許容できるか。最新が必須か、数時間の差分まで許容できるか。

- 説明責任:監査・契約・対外説明の強さ。証跡の粒度や判断根拠の求められ方を含む。

この3軸が揃えば、「最短で鎮火する」か「深く確認して再発まで潰す」か、「復元でリセットする」かの方向性が決まりやすくなります。

復旧ルートを3つに分けて考える

Ext4障害では、現実的な収束ルートは大きく3つに整理できます。目的は“正解探し”ではなく、あなたの前提に合う軟着陸の道を選ぶことです。

| ルート | 強み | 難しさ | 向いている状況 |

|---|---|---|---|

| A:バックアップ/レプリカ復元 | 復旧の見通しが立てやすく、説明が通しやすい | 復元時間・差分・検証の成熟度に依存 | 復元手順が検証済み、RPOが許容できる |

| B:スナップショット/ポイントインタイムへ戻す | 比較的短時間で“場を整える”方向に寄せやすい | 対象範囲と依存関係を誤ると再発・不整合が残る | 復元点が明確、依存関係が把握できている |

| C:代替系へ切り替えて収束(フェイルオーバー等) | 停止時間を抑えやすく、対外影響を抑え込みやすい | 整合性・差分同期・戻しの計画が要る | 可用性設計があり、復旧後の戻しも運用できる |

「復旧できる」より「再開しても落ち着く」ことが重要

復旧ルートの失敗で多いのは、再開できたのに“落ち着かない”状態が続くことです。下層I/Oの揺れ、容量逼迫、ジョブ集中、監視やバックアップの再実行などが重なると、再開後に再び異常が出て、現場の疲弊と不信が増えます。だからルート選びでは、復旧後に再発条件を潰せるか(少なくとも当面の沈静化ができるか)をセットで考えます。

依頼判断に直結するポイント:構成が複合なほど一般論が効きにくい

単体サーバで完結するなら判断が比較的シンプルでも、共有ストレージ、コンテナ、仮想化、監査要件が絡むと、復旧ルートは“技術”だけで決まりません。どの範囲を誰が判断するか、証跡をどう残すか、対外説明をどう組み立てるかが絡み、一般論だけではブレーキが効かなくなります。

具体的な案件・契約・構成の前提で迷いが残る場合は、株式会社情報工学研究所へ相談し、復旧ルートを「収束シナリオ」として整理するほうが、結果的に損失・流出の抑え込みにつながります(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

一般論の限界と依頼判断:収束シナリオを“案件仕様”に落とす

Ext4障害の記事で「手順」を探して来た人ほど、最後にぶつかるのが一般論の限界です。なぜなら、障害対応は“同じOS・同じExt4”でも、契約、システム構成、重要データの範囲、停止時間、監査要件、関係者の合意形成で、最適解が変わるからです。ここを無視して進めると、技術的には筋が通っていても、現場としては収束しません。

依頼判断ページとしての結論:迷いが残るなら早めに相談が合理的

判断に迷ったとき、「もう少し調べてから」と先送りすると、ログが流れ、状況が変化し、説明が難しくなりがちです。特に本番、共有ストレージ、コンテナ、監査要件が絡む場合は、無理に権限や設定を触る前に相談したほうが、結果として早く落ち着くことが多いです。

次のような条件が一つでも当てはまるなら、株式会社情報工学研究所のような専門家へ相談し、最小変更での収束プランを作るのが現実的です。

- 本番データで、停止時間の合意が難しい(業務側・役員・顧客説明が絡む)

- 共有ストレージ、仮想化、コンテナが絡み、影響範囲の説明が重い

- 監査・契約・個人情報等で、証跡と判断根拠が求められる

- 下層I/Oの揺れが疑われ、状況が安定しない/再発を繰り返す

- バックアップや復元が“ある”だけで、復元検証が十分でない

相談を有効にする「伝えると早い材料」

専門家への相談は、手順を聞くことではなく、案件前提に沿って収束へ導くことです。次の材料が揃うと、初動の段階でも整理が速く進みます。

| 材料 | なぜ効くか | 最低限の粒度 |

|---|---|---|

| 時刻(開始・悪化・判断点) | 連鎖の方向が見える、説明の軸になる | 分単位でもよいので一貫したタイムライン |

| 影響範囲(マウントポイント・サービス) | 波及を止める設計が立てやすい | 単体か複数か、重要データの位置 |

| 構成(単体/RAID/LVM/仮想/共有/コンテナ) | 一般論の限界点が分かり、現実的なルートを選べる | 層ごとの責任境界が分かる程度 |

| バックアップ状況(最終成功時刻・検証の有無) | 復旧ルートの選択が速くなる | 最終成功と、復元が試せるかどうか |

終盤の落としどころ:収束の後に“次の不安”を残さない

障害が落ち着いた後、現場に残る不安は「また起きるのでは」「次は説明できないのでは」という感情です。これを残すと、改善投資の合意形成が難しくなり、同じ構造が繰り返されます。だから締めくくりは、原因の断定よりも、再発条件の芽を潰す方向で「何を改善すれば場が整うか」を共有することが重要です。

ただし、改善の打ち手も、契約や構成で最適解が変わります。監査要件のある環境での証跡設計、コンテナや共有ストレージを前提にした影響範囲の切り分け、バックアップの復元検証の運用化などは、一般論だけでまとめるほど危うくなります。

具体的な案件・契約・システム構成の悩みがあるときは、株式会社情報工学研究所へ相談し、現場の前提に沿って「鎮火 → 収束 → 再発防止」まで一本の線で設計するのが、最も合理的な選択になり得ます(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

付録:プログラム言語別の注意点(障害時のツール/運用コードが招く二次被害を避ける)

Ext4障害の現場では、調査や運用のためのスクリプト、ログ収集ツール、バックアップ/同期ツールが“いつも通り”動くとは限りません。言語やランタイムごとの特性を理解しておくと、障害時に不要な書き込みや負荷を増やさず、被害最小化に寄せられます。

C / C++

- 戻り値と

errnoを見落とすと、部分成功や短い書き込みを成功扱いして状態を悪化させやすい。 - バッファリングや

fsyncの扱いを誤ると、「書けたつもり」が発生し、障害調査の証跡が不整合になることがある。 - 大きなファイル走査はI/Oを押し上げるため、障害時は対象範囲を絞る設計が効く。

Rust

- 安全性は高いが、I/Oエラーは普通に起きるため、

Resultの伝播だけでなく“どこまで成功したか”を設計に含めると強い。 - 並列処理を入れると一気にI/Oを押し上げるため、障害時はスロットリングや対象限定が重要になる。

Go

- 並行処理が容易な反面、goroutineの増やし過ぎでI/Oが飽和しやすい。障害時の収集・走査は同時実行数の制限が効く。

- ファイルI/Oのエラーをまとめて握り潰すと、途中で欠けたログや証跡が“完全”に見えてしまう。

Java / JVM系(Kotlin含む)

- ログ出力が多いと、障害時に「ログが状況を悪化させる」ことがある。ログの出し先や量を障害時モードで抑える設計が有効。

- ファイルI/Oで例外が出たとき、上位で再試行が暴走すると負荷が増える。再試行は回数・間隔・中止条件が重要になる。

Python

- 小さなスクリプトが量産されやすく、障害時に“収集のつもりの走査”がI/Oを増やしがち。対象ディレクトリやファイル種別の絞り込みが効く。

- 例外処理でエラー詳細を落とさないと、後から原因の説明が難しくなる。時刻・対象・エラー内容を最低限残す設計が望ましい。

JavaScript / Node.js

- 非同期I/Oが前提なので、同時処理数が増え過ぎるとディスクI/Oやファイルディスクリプタが逼迫しやすい。キューイングや上限設定が有効。

- ログや一時ファイルを同じ障害ディスクへ吐く設計だと、二次的に不安定さが増えることがある。

PHP

- Webアプリ側のログやセッション、キャッシュが同一ストレージにあると、障害時に書き込みが増えて状況が揺れやすい。出し先の分離や抑制が効く。

- エラー表示を表に出し過ぎると対外影響が増えるため、障害時は情報の扱い(表示/保存/アクセス権)を設計しておくとよい。

Ruby

- ジョブ基盤やログが増える構成だと、障害時に書き込みが急増しやすい。障害時のログレベルや出力先の調整が効く。

- ファイル操作の例外を握り潰すと、部分成功が“成功”に見えてしまうため、欠けた証跡を生むことがある。

C# / .NET

- 例外処理は強いが、再試行ポリシーが過剰だと障害時に負荷が跳ねる。リトライは間隔と打ち切り条件が重要になる。

- Windows連携の混在環境では、権限やパス表現の差でログ収集や退避が失敗しやすい。対象の統一と検証が効く。

Shell(bash等)

- 短いワンライナーが便利な反面、リダイレクトやパイプで意図せず大量の読み書きを発生させやすい。対象範囲の確認と乾式の確認が重要になる。

- エラー時に途中で止まったかどうかが分かりにくいことがあるため、時刻と対象をログとして残す工夫が効く。

SQL(運用スクリプト)

- 障害時にDBへ重い集計や全件走査をかけると、I/Oが増えて復旧が遅れることがある。必要な範囲だけを取る設計が効く。

- ログや監査の要件がある場合、SQL実行履歴や結果の保存方法が後から問われることがある。

言語やツールの違いは、平常時には表に出にくくても、障害時には「負荷の出方」「エラーの見え方」「証跡の残り方」として差になります。個別のシステム構成・契約・監査要件の前提によって、最小変更での収束ルートは変わります。具体的な案件で迷う場合は、株式会社情報工学研究所へ相談し、状況整理から収束プランまでを前提に合わせて設計するのが、最も安全に落ち着かせやすい選択肢になります(フォーム:https://jouhou.main.jp/?page_id=26983/電話:0120-838-831)。

設計方針:読むだけで判断できる層を最優先。実行手順は折りたたみ(必要な人だけ)に分離。

・異音、SMART警告、NVMeエラー、読み取りが極端に遅い

・RAID / LVM / LUKS / 仮想化 / 共有 配下で構成が複雑

・業務停止が許されない(BCP優先)、監査・証跡が必要

・対象が本番データで「失敗が許されない」

②論理だけの問題か(read-only remount / journal abort など)

③構成が複雑か(RAID/LVM/LUKS/仮想化/共有)

──この3つで、復旧の「手順」と「時間」がほぼ決まります。

読み取り中心の確認コマンド(必要な人だけ)

whoami; id pwd findmnt -T . mount | grep -E ' type ext4 | on /' lsblk -f df -hT; df -i dmesg -T | tail -n 60 journalctl -k -n 120 --no-pager

もくじ

- 第1章:その「fsck一発」は本当に正解?――“時間が増える分岐”から逆算する

- 第2章:Ext4は何を守っているのか――ジャーナリングとメタデータ(一次情報リンク付き)

- 第3章:障害は3系統――「論理破損」「媒体劣化」「構成由来(RAID/LVM/LUKS)」

- 第4章:最初の10分で決まる――ログ採取・read-only・影響範囲の切り分け

- 第5章:I/O error が見えたら“復旧”の前に――イメージングで時間を買う

- 第6章:e2fsckを安全に使い分ける――検査→判断→危険域で止める

- 第7章:ジャーナルを味方にする/敵にしない――リプレイの意味と限界

- 第8章:ファイル単位のサルベージ――“できること・できないこと”

- 第9章:復旧に“何時間かかるか”――速度・エラー率・層で見積もる

- 第10章:帰結――復旧より重要な設計判断(バックアップ/監視/BCP)

- 第11章:よくある質問(再起動は?fsckは?暗号化は?)

第1章:その「fsck一発」は本当に正解?――“時間が増える分岐”から逆算する

正統派の初動はいつも同じです。①媒体 ②論理 ③構成の順に「当たり」をつけ、危険域なら早めに止めます。

第2章:Ext4は何を守っているのか――ジャーナリングとメタデータ(一次情報リンク付き)

重要なのは、ジャーナルが助けになる場面と、媒体劣化が混ざって逆に悪化する場面があることです。 「直すコマンド」を先に当てるのではなく、直してよい局面かを先に確定させます。

第3章:障害は3系統――「論理破損」「媒体劣化」「構成由来(RAID/LVM/LUKS)」

媒体:I/O error、timeout、リセット、SMART異常、読取速度低下。

構成:RAID/LVM/LUKS/仮想化/共有で、層が増えるほど手戻りが増えます。

「時間が伸びる」のは、媒体と構成が混ざるときです。論理だけなら短期で収束しやすい一方、媒体が怪しいときは“イメージ取得で時間を買う”が王道になります。

第4章:最初の10分で決まる――ログ採取・read-only・影響範囲の切り分け

ここで“影響範囲”を見誤ると、復旧ではなく二次障害(停止範囲の拡大)に繋がります。

引継ぎが早くなる:ログ採取パック(触る前に保存)

TS=$(date +%Y%m%d_%H%M%S)

OUT="/root/ext4_triage_${TS}"

mkdir -p "$OUT"

( uname -a; echo; cat /etc/os-release 2>/dev/null ) > "$OUT/system.txt" 2>&1

( whoami; id; echo; pwd ) > "$OUT/who.txt" 2>&1

( mount; echo; findmnt -a ) > "$OUT/mount.txt" 2>&1

( lsblk -o NAME,TYPE,SIZE,FSTYPE,MOUNTPOINTS,MODEL,SERIAL; echo; blkid ) > "$OUT/block.txt" 2>&1

( df -hT; echo; df -i ) > "$OUT/df.txt" 2>&1

( dmesg -T | tail -n 400 ) > "$OUT/dmesg_tail.txt" 2>&1

( journalctl -k -n 400 --no-pager ) > "$OUT/journal_k_tail.txt" 2>&1

tar -czf "${OUT}.tar.gz" -C "$(dirname "$OUT")" "$(basename "$OUT")"

echo "Saved: ${OUT}.tar.gz"

第5章:I/O error が見えたら“復旧”の前に――イメージングで時間を買う

代表例として GNU ddrescue は、再開や読み取り戦略を mapfile で管理できることが公式マニュアルに示されています: GNU ddrescue Manual。

第6章:e2fsckを安全に使い分ける――検査→判断→危険域で止める

正統派の考え方はシンプルです。いきなり修復しない。 まず「検査(読むだけ)」で状況を掴み、対象デバイスが正しい/媒体が安定/停止時間が確保を満たせないなら、そこで止めます。

・媒体劣化が疑わしいのに、書き込みが増える操作を続ける

・停止時間や影響範囲を確保せず、復旧を本番上で強行する

・再起動を繰り返し、決定打のログを失う

第7章:ジャーナルを味方にする/敵にしない――リプレイの意味と限界

第8章:ファイル単位のサルベージ――“できること・できないこと”

重要なのは「復元できるか」だけでなく、業務として使える形で戻せるかです。

第9章:復旧に“何時間かかるか”――速度・エラー率・層で見積もる

ここを言語化できるほど、復旧の意思決定がブレません。

・実測MB/s:読み取りが安定して出る速度

・再試行係数:エラーが増えるほど上がる(読み直し・待ちが増える)

・層(RAID/LVM/LUKS/仮想化):解析と手戻りの時間が乗る(作業設計が必要)

| 系統 | 兆候 | 時間が増える要因 | 目安 |

|---|---|---|---|

| 論理 | read-only / journal / 整合性 | 対象誤り、停止時間不足 | 数十分〜半日 |

| 媒体 | I/O error / timeout / SMART | エラー率、再試行、容量 | 半日〜数日 |

| 構成 | RAID/LVM/LUKS/仮想化 | 層の解析、手戻り | 半日〜数日(複合で延伸) |

第10章:帰結――復旧より重要な設計判断(バックアップ/監視/BCP)

今回が「本番で止まった」「二度と起こせない」障害なら、復旧だけで終わらせず、BCPの観点で“戻し方・守り方”までまとめて設計するのが最短です。

第11章:よくある質問(再起動は?fsckは?暗号化は?)

・対象マウントポイントとデバイス(findmnt / lsblk の結果):

・直前のイベント(停電/再起動/容量枯渇/更新/交換):

・dmesg/journalctl の末尾(I/O error 有無):

・RAID/LVM/LUKS/仮想化/共有の有無:

・最優先(データ復旧/復旧優先/稼働(BCP)優先):

・RAID/LVM/LUKS/仮想化など層の解析を含めて、手戻りを減らしやすい

・停止や監査が絡むときに、復旧とBCPを同時に設計しやすい(暫定復旧→恒久対策)

・「何時間かかるか」を、容量だけでなく速度・エラー率・層で整理し、合意形成を作りやすい

・復旧優先:原因の層(媒体/論理/運用)を切り分けてから、オフラインで整合性・復旧手順へ

・稼働(BCP)優先:別系統へ逃がす/切替→その後に復旧と根本復旧(本番での無理な操作を避ける)

whoami; id pwd mount | grep -E ' type ext4 | on /' findmnt -T . dmesg -T | tail -n 30 journalctl -k -n 50 --no-pager df -hT; df -i lsblk -f

TS=$(date +%Y%m%d_%H%M%S)

OUT="/root/ext4_triage_${TS}"

mkdir -p "$OUT"

( uname -a; echo; cat /etc/os-release 2>/dev/null ) > "$OUT/system.txt" 2>&1

( whoami; id; echo; pwd ) > "$OUT/who.txt" 2>&1

( mount; echo; findmnt -a ) > "$OUT/mount.txt" 2>&1

( lsblk -o NAME,TYPE,SIZE,FSTYPE,MOUNTPOINTS,MODEL,SERIAL; echo; blkid ) > "$OUT/block.txt" 2>&1

( df -hT; echo; df -i ) > "$OUT/df.txt" 2>&1

( dmesg -T | tail -n 400 ) > "$OUT/dmesg_tail.txt" 2>&1

( journalctl -k -n 400 --no-pager ) > "$OUT/journal_k_tail.txt" 2>&1

# 可能なら(入っていれば)

smartctl -a /dev/sdX > "$OUT/smart_sdX.txt" 2>&1

smartctl -a /dev/nvme0 > "$OUT/smart_nvme0.txt" 2>&1

tar -czf "${OUT}.tar.gz" -C "$(dirname "$OUT")" "$(basename "$OUT")"

echo "Saved: ${OUT}.tar.gz"

mount | grep ' on /' dmesg -T | grep -iE 'ext4|remount|journal|error' | tail -n 50 cat /proc/mounts | grep ' ext4 '

dmesg -T | grep -iE 'I/O error|blk_update_request|reset|timeout|nvme|ata' | tail -n 80 lsblk -o NAME,TYPE,SIZE,FSTYPE,MOUNTPOINTS,MODEL,SERIAL smartctl -a /dev/sdX 2>/dev/null | sed -n '1,120p' NVMeの場合: smartctl -a /dev/nvme0

df -hT df -i du -xhd1 /var 2>/dev/null | sort -h journalctl --disk-usage find /var/log -type f -printf '%s %p\n' 2>/dev/null | sort -n | tail -n 10

dmesg -T | grep -iE 'EXT4-fs|orphan|recovery|journal' | tail -n 80 tune2fs -l /dev/sdXN 2>/dev/null | grep -E 'Filesystem state|Last mount time|Last write time|Mount count|Check interval' blkid /dev/sdXN

# 影響の当たりを見る(対象マウントポイントを /mnt/data に置き換え)

findmnt -T /mnt/data

lsof +f -- /mnt/data 2>/dev/null | head -n 30

fuser -vm /mnt/data 2>/dev/null

コンテナ/仮想化が絡むか(ある環境だけ)

docker ps --format 'table {{.Names}}\t{{.Status}}\t{{.Mounts}}' 2>/dev/null | head -n 20

systemctl --no-pager --failed

共有/NFSの気配

mount | grep -iE 'nfs|cifs|gluster|ceph'

・RAID/LVM/暗号化(LUKS)配下:層が増えるほど切り分けと手戻りが増える

・fsck を急ぐ/対象を誤る:戻せない改変で長期化(最悪、復旧難度が上がる)

・容量/inode 枯渇:復旧ではなく運用問題。原因を見誤るほど遠回りになる

・原因が媒体なのに書き込みを続けて、読める範囲が減る

・rw で無理に復帰してログ/ジャーナル破綻を拡大し、復旧難度が上がる

・再起動を連打して症状を悪化させ、原因ログ(決定打)を失う

・権限やマウント設定を広げて、想定外のサービス停止や監査NGに繋がる

・復旧の前段情報(ログ/状態)を取らずに触って、復旧時間が長期化する

・I/O error が混ざるのに、どこまで触ってよいか迷ったら。

・fsck の対象デバイスや実行タイミングの診断ができない。

・LVM/RAID/暗号化(LUKS)配下で、切り分け順が決めきれない。

・NFS/CIFS/コンテナのどれが影響元か迷ったら。

・復旧優先か、業務継続優先かの線引きで迷ったら。

・ログは取れたが、復旧に必要な追加情報が分からない。

・作業時間が伸びる兆候(再起動ループ/遅延/再同期)で迷ったら。

もくじ

- 第1章:その「fsck一発」は本当に正解?――現場が抱えるExt4障害の“怖さ”から始める

- 第2章:Ext4は何を守っているのか――ジャーナリングとメタデータの基本を押さえる

- 第3章:障害の見え方はだいたい3系統――「論理破損」「I/O劣化」「構成由来(RAID/LVM)」

- 第4章:最初の10分で決まる――ログ採取・マウント方針(read-only)・影響範囲の切り分け

- 第5章:I/Oエラーが見えたら“復旧テクニック”の前にやること――イメージングと保全(時間を買う)

- 第6章:e2fsckを安全に使い分ける――-nから始める検証、-b(代替スーパーブロック)まで

- 第7章:ジャーナルを味方にする/敵にしない――リプレイの意味と「やって良い局面・悪い局面」

- 第8章:ファイル単位のサルベージ手段――extundelete / debugfs / TestDisk・PhotoRecの現実解

- 第9章:復旧に“何時間かかるか”を説明できるようになる――速度・エラー率・手順で見積もる

- 第10章:帰結――「復旧できる/できない」より重要な設計判断(バックアップ、監視、運用ルール)

【注意書き】本記事は、LinuxのExt4ファイルシステム障害に関する一般的な情報提供を目的としています。実際の復旧可否や最適手順は、障害原因(論理破損/物理I/O劣化/RAID・LVM等の構成要因)、ディスク状態、ログの内容、停止できる時間、バックアップ有無などで大きく変わります。誤った操作(安易なfsck実行や書き込み継続など)は損傷を拡大し、復旧難度とコストを急増させることがあります。個別案件の判断が必要な場合は、株式会社情報工学研究所のような専門家へご相談ください。

その「fsck一発」は本当に正解?――現場が抱えるExt4障害の“怖さ”から始める

「またストレージか…」「今このタイミングで?」――障害が起きる瞬間って、だいたい最悪の忙しさの中ですよね。Ext4の障害は“直せそうに見える”のが厄介です。ログにEXT4-fs errorが出ている、マウントがread-onlyに落ちた、I/O errorが混じる。こういう状況で、つい「fsckを回して直すか」と考えがちですが、ここが最初の分岐です。

Ext4の障害は大きく分けると、(1)論理破損(メタデータ不整合)、(2)物理I/Oの劣化(読み書きそのものが危険)、(3)構成由来(RAID/LVM/仮想化/コントローラ)の3系統が絡みます。見た目が似ていても“正解の初動”が違います。fsckは強力ですが、強力だからこそ「原因がI/O劣化だった場合」に悪化させることがあります。読めていたものが読めなくなる、再配置や再書き込みで痕跡が消える、ということが現実に起きます。

心の会話:現場の本音は「止めたくない」

「止めたら怒られる」「止めないと壊れる」――この板挟みが、復旧現場の一番しんどいところです。特にレガシー環境だと、サービス停止=売上・業務停止に直結します。だから“今すぐ直す”方向に寄りやすい。でもExt4障害では、まず「これ以上壊さない」方針が結果的に最短ルートになることが多いです。

この章の結論:最初に決めるのは「修復」ではなく「保全」

いきなり修復に飛び込むのではなく、(a)書き込み停止(または最小化)、(b)ログと状態の確保、(c)影響範囲の切り分け、(d)必要ならディスクイメージ取得――この順に「時間を買う」ことが重要です。復旧は“技術”でありつつ、“判断”でもあります。判断材料がない状態でのfsckは、当たり外れが大きい賭けになります。

以降の章では、Ext4が何をどう守っているのかを押さえた上で、障害タイプ別に初動と復旧テクニックを、時間見積もりまで一本の線でつなげていきます。

Ext4は何を守っているのか――ジャーナリングとメタデータの基本を押さえる

Ext4の復旧を“腹落ち”させる近道は、構造をざっくり掴むことです。Ext4は「データ本体(ファイルの中身)」と「メタデータ(どこに何があるか)」で成り立ちます。メタデータの代表は、スーパーブロック、グループディスクリプタ、inode、ディレクトリエントリ、ビットマップ(ブロック/ inodeの使用状況)などです。障害時に壊れやすいのは、多くの場合このメタデータ側です。

ジャーナリング(JBD2)の意味:壊れにくくするが、万能ではない

Ext4はジャーナリング(JBD2)により、更新途中で電源断やクラッシュが起きても、整合性を取り戻しやすくしています。典型例は「停電後にマウントできる/fsckで直る」系の障害です。ただし、ジャーナルは“更新の記録”であって“バックアップ”ではありません。物理I/Oが不安定なディスク上で、ジャーナルの読み書き自体が失敗すると、整合性回復がうまくいかないことがあります。

スーパーブロックと代替スーパーブロック:復旧の入口になる

Ext4にはファイルシステム全体の情報(サイズ、機能フラグ、inode数など)を持つスーパーブロックがあり、破損するとマウントできません。ただし、Ext系は代替(バックアップ)スーパーブロックを複数持てる設計です。このため「スーパーブロック破損」でも復旧の糸口が残ることがあります。e2fsckで-bを使う“あの手”は、こうした設計に基づきます。

inodeとディレクトリ:ファイルが“消えたように見える”理由

ファイルの中身がディスク上に残っていても、inodeやディレクトリエントリが壊れると「ファイルが消えた」ように見えます。逆に言えば、inode情報やリンク関係を辿れれば、内容を救い出せる可能性があります。extundeleteやdebugfsなどのツールは、ここを突いて“見えなくなったファイル”を拾おうとします。

この章の結論:復旧は「どの層が壊れたか」を当てるゲーム

Ext4復旧の本質は、(1)物理I/Oが安全か、(2)メタデータの整合性が崩れているのか、(3)その崩れはどの層か――を見立てて、最小の変更で最大の情報を回収することです。以降は、障害がどの系統に近いかを“見え方”で切り分ける方法から入ります。

障害の見え方はだいたい3系統――「論理破損」「I/O劣化」「構成由来(RAID/LVM)」

Ext4障害と一口に言っても、現場での“見え方”は大きく3系統に分かれます。ここを外すと、同じコマンドでも結果が真逆になります。とくに怖いのは、I/O劣化を論理破損だと思い込んでfsckを回すケースです。ディスクに追加の負荷と書き込みが発生し、状況が雪崩れることがあります。

| 系統 | よくある兆候(例) | まずやるべき方針 |

|---|---|---|

| 論理破損 | 突然の電源断後にマウント不可、EXT4-fs warning/error、fsck要求、I/O errorは少ない | まずはread-onlyで状態確認、e2fsckは-n(変更なし)で検証、慎重に修復計画 |

| I/O劣化 | Buffer I/O error、blk_update_request、タイムアウト、SMART警告、読み取り速度低下 | 修復より先に保全(イメージ取得)を検討、書き込みを止め、負荷を下げる |

| 構成由来 | RAIDのdegraded、再同期中、LVMスナップ枯渇、仮想化ストレージの遅延 | 上位層(mdadm/LVM/ストレージ)から整合を確認し、正しい“元デバイス”を確定 |

ログの見どころ:同じ「エラー」でも意味が違う

たとえばEXT4-fs errorは、Ext4がメタデータ矛盾を検知したサインです。一方でBuffer I/O errorやタイムアウトは、ブロックデバイス層での読み書き失敗を示します。両方が出るケースもありますが、その場合は「論理破損が原因」というより「I/O失敗が引き金でメタデータが壊れていった」と見る方が安全です。つまり、修復より保全が優先になります。

“構成由来”の罠:正しい対象を間違えると復旧が破綻する

RAID(mdadm)やハードウェアRAID、LVM、暗号化(LUKS)などが挟まっている場合、「どのデバイスに対して」診断・修復するかが最重要です。たとえばdegraded状態のRAIDで再同期を走らせると、残っている良データを上書きする方向に進むことがあります(どちらが正しいか確定できない状態での再構築は危険です)。構成が絡むと、Ext4の話の前に“ストレージの正体”を確定させる必要があります。

この章の結論:まず分類、次に手順。逆にすると事故る

「何が壊れているか」を荒くでも分類できると、初動のミスが激減します。以降の章では、最初の10分で取るべき行動(ログ採取、read-only方針、影響範囲の切り分け)を、具体例込みで整理します。

最初の10分で決まる――ログ採取・マウント方針(read-only)・影響範囲の切り分け

Ext4障害対応で最初にやるべきことは、「直す」ではなく「状況を固定して、判断材料を集める」です。ここでのポイントは2つあります。(1)書き込みを止める(損傷拡大の防止)、(2)後から検証できる証拠(ログ・状態)を残す(説明責任と再現性)。この2つが揃うと、復旧の成功率と、復旧時間の見積もり精度が上がります。

まずは“書かない”:read-onlyの徹底

可能ならサービスを止め、該当ファイルシステムをアンマウントします。止められない場合でも、少なくとも対象をread-onlyで扱う設計に寄せます。典型的には、(a)緊急退避用の別領域を用意する、(b)ログ採取とダンプを先に取る、(c)やむを得ずマウントするなら「読み取り専用」で、という順序です。障害中に書き込みが続くと、ジャーナルやビットマップ、inode周りが追加で変化し、復旧対象が動いてしまいます。

ログ採取:dmesg/journalctlで“いつから何が起きたか”を取る

最低限、カーネルログ(dmesg)とsystemd環境ならjournalctl(特に該当期間)を確保します。ストレージ層のエラー(タイムアウト、リトライ、reset)と、Ext4層のエラー(EXT4-fs error/warning)の両方が出ているかが分岐点になります。また、マウントがread-onlyに切り替わったなら、その直前に何が起きたか(I/O errorの連発、ジャーナルエラーなど)を追います。

構成情報:RAID/LVM/暗号化の状態を“文字で残す”

RAID(mdadm)の場合はアレイ状態、degradedか、どのメンバが外れているか、再同期が走っていないかを確認します。LVMがある場合はVG/LVの状態、スナップショットの有無や残量、thin poolの逼迫などを確認します。暗号化(LUKS)がある場合は、マッピング名やUUIDなど、後から同じ構成を再現できる情報が重要です。「目で見た」だけだと、復旧中に状況が変わったときに説明ができなくなります。

切り分けの最短ルート:I/Oエラーがあるかを先に決める

心情的には「マウントできない=論理破損」と考えたくなりますが、I/O劣化が混ざっていないかを先に見ます。I/O劣化が疑われるなら、復旧テクニックに入る前に“保全(イメージング)”へ舵を切るのが安全です。逆にI/Oが安定していて論理破損が主因なら、検証(変更なし)→限定的修復→回収、という順で進められます。

この章の結論:判断材料が揃えば、復旧は「怖い賭け」から「再現可能な作業」に変わる

最初の10分の動きが、復旧の成功率だけでなく、説明のしやすさ(上司・顧客への報告)と、見積もりの妥当性を左右します。次章では、I/O劣化が疑われるときに“復旧テクニックの前にやるべきこと”――イメージングと保全の考え方に進みます。

I/Oエラーが見えたら“復旧テクニック”の前にやること――イメージングと保全(時間を買う)

Buffer I/O error、timeout、reset、ATA error、NVMeのmedia error、SMARTでReallocated/Pendingが増えている――こうした兆候があるとき、Ext4の修復(fsck)より先に考えるべきは「これ以上読めなくなる前に、読める範囲を確保する」です。ここでいう確保は、ファイルコピーではなく“ブロックレベルの保全(イメージング)”を指します。ファイルコピーは、ディレクトリやinodeが壊れていると失敗しやすく、さらに読み取りが偏ってディスクへ負荷を集中させることがあります。

心の会話:でも、イメージングって時間かかるんでしょ?

「今すぐ復旧しろと言われているのに、丸ごとコピーなんて…」と思うのは自然です。ただ、I/O劣化が絡むと“先に直す”は失敗しやすく、結果的に時間が何倍にも膨らむことがあります。イメージングは遠回りに見えて、実は「ディスクが死ぬまでの残り時間」を“自分の味方につける”作業です。

イメージングの基本方針:読み取り優先、書き込みは絶対にしない

原則として、障害ディスク(または障害領域)には追加の書き込みをしません。やるべきは、別媒体へ読み出せたブロックを順に退避し、読めない箇所は“後回し”にすることです。読めない箇所に粘ると、同じセクタへリトライが集中して状態が悪化し、他の読めたはずの領域まで巻き込むことがあります。

このため、現場では「まずは大きくコピーして穴を残す→次に穴を埋める」方式が一般的です。Linuxではddrescue(GNU ddrescue)が代表的で、ログファイル(mapfile)で進捗と未読領域を管理できます。ポイントは、再試行回数や読み方針を段階的に上げることです。最初から強いリトライをかけると、ディスクが熱やエラーで一気に悪化することがあります。

RAID/LVM環境での注意:どこをイメージするかが難易度を左右する

RAIDやLVMの上にExt4がある場合、「物理ディスク単体を保全する」のか「論理ボリューム(/dev/mdX や /dev/mapper/xxx)を保全する」のかで戦略が変わります。I/O劣化が単一ディスクに偏っている場合、RAIDの論理デバイスを読む行為自体が、問題ディスクへ負荷を集中させることがあります。一方で、RAIDメンバ単体のコピーだけでは、後段で正しく再構成できないこともあります。

ここは一般論だけで決めると事故りやすい領域です。ディスク本数、RAIDレベル、degradedの有無、再同期の状態、LVMの構成、暗号化の有無、そして“止められる時間”で最適解が変わります。たとえば「いまRAIDがdegradedで、残りのディスクに負荷をかけると全滅する」状況なら、無理に論理側を読みにいかず、まず問題ディスクの保全を優先する判断が出ることもあります。

保全が終わったら、初めて“安全に”復旧テクニックへ進める

イメージ(またはクローン)を作れたら、以降のfsckや解析は“コピー側”で行えます。ここが大きい。失敗しても、やり直せます。現場エンジニアが一番欲しいのはこの「やり直し可能性」です。保全があるだけで、復旧はギャンブルから工学になります。

次章では、いよいよe2fsckを“事故らせずに”使うための実践的な考え方(-nから始める、代替スーパーブロック、修復の副作用の見積もり)を整理します。

e2fsckを安全に使い分ける――-nから始める検証、-b(代替スーパーブロック)まで

e2fsck(fsck.ext4)はExt4修復の中核ツールですが、扱いを誤ると状況を悪化させます。特に“原因がI/O劣化”だった場合、修復処理が大量の読み書きを伴い、ディスクの寿命を縮めます。したがって、前提として「I/Oが安定しているか」「保全(イメージ)を取ったか」を確認したうえで、段階的に使うのが基本方針です。

最初は「変更しない」検証:-nの意味

まず推奨されるのが、変更を行わないモードでの検証です。e2fsckには「修復提案はするが、実際には書き込まない」動作があり、これにより“どの程度の不整合があるか”の見立てを作れます。ここで重要なのは、検証結果をそのまま実施して良いとは限らないことです。e2fsckは整合性を取り戻すために、孤児inodeをlost+foundへ移したり、ディレクトリ構造を再構成したりします。これは「整合性回復」には有効ですが、「元どおり」に戻ることを保証しません。

たとえば、ディレクトリエントリが壊れている場合、ファイル自体は残っていても“元のパス”を復元できないことがあります。業務上は「ファイルが読める」だけで十分な場合もあれば、「このパスに、この名前で存在する必要がある」場合もあります。どちらが求められているかで、修復方針が変わります。

よくある分岐:マウントできない原因がスーパーブロックかどうか

「bad superblock」等が出るケースでは、代替スーパーブロックを用いた修復が検討されます。Ext系は複数の場所にスーパーブロック情報を保持できる設計があり、破損が局所的なら復旧の入口になります。ただし、代替スーパーブロックの位置はファイルシステム作成時の設定(機能フラグ、ブロックサイズ等)に依存します。やみくもに値を当てるのではなく、ファイルシステム情報を確認し、整合する候補を選ぶ必要があります。

修復の副作用:lost+foundは“失敗”ではなく仕様だが、業務影響は出る

e2fsckで修復を進めると、リンクを失ったinode(孤児)がlost+foundへ回収されることがあります。これは「ファイル内容を救う」観点では合理的ですが、現場運用では「どれがどれか分からない」「アプリが参照できない」という二次問題になります。たとえばWebアプリやDB、メールサーバなどは、パスや権限、所有者、関連ファイルの整合が重要で、ファイル単体が残ってもサービスが復旧しないことがあります。

このため、e2fsckで整合性を回復させる前に「何をゴールにするか」を決めます。ゴールが“サービス復旧”なのか、“証拠保全”なのか、“ファイル救出”なのかで、最初に取るべき手段は変わります。特にBtoBの現場では、サービス復旧と同時に「説明責任」「再発防止」が求められます。ここを雑にすると、復旧後に炎上します。

安全運用のコツ:修復は「小さく試して、結果を見て、次へ進む」

修復は一気にやり切るのではなく、段階的に進めるのが現実的です。検証結果を読み、影響が小さい修復から着手し、マウントテストや読み取りテストを挟みます。ここで“コピー側(イメージ側)で作業できている”と、試行錯誤が安全になります。逆に本番ディスクへ直接修復を当て続けると、取り返しがつかない局面に入りやすいです。

次章では、Ext4の特徴であるジャーナルをどう扱うか――リプレイの意味、どんな時に味方になるか、どんな時に敵になるか――を整理します。

ジャーナルを味方にする/敵にしない――リプレイの意味と「やって良い局面・悪い局面」

Ext4のジャーナリングは、「更新途中で止まっても整合性を取り戻しやすい」ための仕組みです。一般的には、クリーンにアンマウントされなかったファイルシステムを次回マウントする際、未反映の更新(トランザクション)をリプレイして整合を回復します。ここまでは“良い話”です。しかし障害対応では、ジャーナルのリプレイが必ずしも歓迎されない局面があります。

やって良い局面:停電・クラッシュ後で、I/Oが安定している

典型的には、突然の電源断やカーネルパニック後に「ファイルシステムがdirty扱いになっている」ケースです。物理ディスクが健全で、I/Oエラーが見えず、障害が“未完了の更新”に起因するなら、ジャーナルリプレイやfsckで整合が戻り、通常運用に復帰できることがあります。この場合、復旧時間は比較的短く見積もれます(ただし容量やinode数、サーバ性能によりfsck時間は伸びます)。

注意が必要な局面:I/O劣化が疑われる、または証拠性が重要

I/O劣化が疑われる場合、ジャーナルリプレイはディスクへの書き込みを伴い得ます。書き込みが走ると、(1)劣化部位への負荷で状態が悪化する、(2)残っていた痕跡が上書きされる、というリスクが出ます。また、フォレンジックや監査、紛争対応などで“証拠性”が重要な案件では、障害発生後にファイルシステムへ書き込みが入ること自体が後工程の説明を難しくします。こうした案件では「まずは保全してから解析」が原則になります。

「敵にしない」ための実務:勝手にリプレイさせない

現場でよくある事故が、「とりあえずマウントしたら、裏で処理が進んでしまった」というパターンです。自動マウントや起動時のfsck、自動復旧処理が働く環境では、意図せず状態が変わります。したがって、障害対応では“勝手に進む仕組み”を止める、または対象を切り離して検証環境へ持っていく設計が重要です。ここは運用設計の範囲であり、単なるコマンド知識だけでは安全に進めにくい領域です。

心の会話:結局、何を信じればいいの?

「ジャーナルって直してくれるんじゃないの?」「じゃあ、何も触らない方がいいの?」――この揺れは、判断材料が不足しているときに起きます。答えはシンプルで、“I/Oが安定していて、目的がサービス復旧なら、ジャーナルは味方になりやすい”。逆に、“I/Oが不安定、または証拠性・完全性が重要なら、まず保全してから”です。この二軸で整理すると、迷いが減ります。

この章の結論:ジャーナルは万能薬ではなく、条件付きの強力な道具

Ext4の設計は堅牢ですが、現実の障害は「物理」「構成」「運用」が絡み合います。ジャーナルを活かせる条件を満たしているかを見極め、満たさないなら“先に守る(保全する)”へ寄せる。ここまでができると、次の章で扱う「ファイル単位のサルベージ」も、より確度高く進められます。

ファイル単位のサルベージ手段――extundelete / debugfs / TestDisk・PhotoRecの現実解

ここまでで「壊し方(論理/I/O/構成)」と「最初に守る(保全)」の重要性を押さえました。ここからは“欲しいものを取り出す”フェーズです。ただし、Ext4のサルベージは万能ではありません。目的は大きく2つに分かれます。1つはファイル名やディレクトリ構造をできるだけ保った回収、もう1つは中身だけでも救う(ファイル名は諦める)回収です。どちらが必要かで、選ぶ手段が変わります。

心の会話:「ファイルは残ってるんでしょ?取り出せば終わりでは?」

気持ちはすごく分かります。ただ、業務データは「中身」だけでなく「どのフォルダに」「どんな名前で」「どの権限で」置かれていたかが価値の一部です。アプリはパスで参照しますし、バックアップもパス単位で差分を取ります。つまり、ファイル単体が残っても“業務として復旧した”にならないことがある。ここがBtoBの復旧で難しいところです。

extundelete:条件が合うと強いが、条件がズレると厳しい

extundeleteは、削除されたファイルを回収する目的で知られるツールの一つです。ただし、Ext4の運用状況や障害状況によって成功率が大きく変わります。一般に、削除後にブロックが上書きされていないこと、対象のメタデータが追跡できること、などが重要になります。特に“削除してから時間が経っている”“障害後も書き込みが続いた”“大容量の書き込みが走った”といった条件では、復旧できる範囲が狭くなりがちです。

実務では、extundeleteは「試せるなら試すが、これだけに賭けない」位置づけになります。成功したときのリターンは大きい一方で、失敗した場合に別ルート(debugfsやシグネチャ回収)へすぐ移れるように、最初から二段構えにしておくのが安全です。

debugfs:Ext4を“直接覗く”ための道具(ただし使い方次第)

debugfsはExt系ファイルシステムの内部情報を参照したり、状況によってはデータを取り出したりできる低レベルツールです。復旧の現場では、「マウントできない」「ディレクトリが壊れている」「通常のコピーができない」といった状況で、inodeやブロックの情報を辿って回収を試みる際に使われます。

ただし、ここで注意したいのは、debugfsは“強い”がゆえに、運用を誤ると状態を変えてしまう可能性がある点です。原則は、保全したイメージ(コピー)側で試すこと、そして読み取り中心で使うことです。特に争点になり得る案件(監査、訴訟、社内不正等)では、「いつ、誰が、どの媒体に、何をしたか」を後から説明できる形で進める必要があります。

TestDiskとPhotoRec:メタデータが壊れても“中身”を拾えるが、代償がある

メタデータ(inodeやディレクトリエントリ)が大きく壊れている場合、ファイル名やフォルダ構造を保った復旧は難しくなります。そのとき現実的になるのが、シグネチャ(ファイル形式の特徴)に基づいて中身を回収する手段です。代表例としてTestDisk/PhotoRec系のアプローチが挙げられます。

この方式の強みは、ファイルシステムの整合性が崩れていても、ディスク上にデータの塊が残っていれば拾える可能性があることです。一方で、代償としてファイル名・フォルダ構造・タイムスタンプなどのメタ情報は失われやすいです。結果として「大量のファイルは出てきたが、どれが必要なものか分からない」という二次作業が発生します。業務復旧の観点では、ここが復旧コストを押し上げます。

手段の選び方:目的別の“現実的な落としどころ”

| 目的 | 向きやすい手段 | 現実的な注意点 |

|---|---|---|

| パスや名前を保って回収したい | 軽度ならfsck後のコピー、条件が合えばextundelete、低レベルならdebugfs | 上書きが進むと難易度が跳ねる/「整合性回復=元通り」ではない |

| 中身だけでも救いたい | PhotoRec等のシグネチャ回収 | ファイル名や階層を失いがち/仕分けコストが増える |

| 業務サービスを元に戻したい | 復旧用環境へリストア+整合性検証(DB/アプリ含む) | ファイル回収だけでは足りない/アプリ整合・運用手順が鍵 |

この章の結論:サルベージは「どこまで元に戻したいか」で手段が変わる

Ext4のサルベージには複数の道がありますが、どれも万能ではありません。だからこそ、目的(ファイル救出/証拠性/サービス復旧)を先に固定し、条件(I/Oの安定性、上書き状況、構成)に合わせて手段を組み合わせる必要があります。次章では、現場で必ず聞かれる「で、何時間かかるの?」に答えるための、復旧時間の見積もりロジックを整理します。

復旧に“何時間かかるか”を説明できるようになる――速度・エラー率・手順で見積もる

Ext4障害対応で、技術と同じくらい重要なのが「見積もり」と「説明」です。現場では必ず聞かれます。「いつ直る?」「何時間で復旧できる?」。ここで雑に答えると、復旧作業そのものより、後の信頼を失います。一方で、正確な見積もりは簡単ではありません。だからこそ、見積もりを“分解”して説明できる形にするのが実務的です。

時間が伸びる要因トップ3:I/O劣化、容量、そして「上書き回避」

復旧時間を支配する要因はだいたい次の3つです。

- I/O劣化(読み取りエラー、リトライ、タイムアウト):ここがあると桁で伸びます。順次読みが100MB/s出るはずが、リトライ地獄で数MB/s以下になることがあります。

- 対象容量(およびファイル数/ inode数):fsckやメタデータ検査は、単純な容量だけでなく、inodeやディレクトリの数に影響されます。

- “壊さないための手順”を踏むこと:保全(イメージング)を挟む、検証を挟む、試行錯誤を安全側で行う――これは時間を使いますが、失敗を減らし、トータルでは短くなることが多いです。

見積もりは「工程別」に出すと、現場も納得しやすい

復旧の時間は一括で出すより、工程ごとに“幅”を持って提示すると、現実に即した説明になります。

| 工程 | 主なボトルネック | 見積もりの考え方(例) |

|---|---|---|

| ① 状態確認・切り分け | ログ収集、構成把握、停止判断 | 短いが重要。情報が揃わないと後工程が崩れる |

| ② 保全(イメージング) | 読み取り速度、エラー率、リトライ方針 | 「実効スループット×容量」で概算。ただしエラーが多いと急増 |

| ③ メタデータ検証(fsck検証など) | inode数、ディレクトリ規模、CPU/メモリ/ストレージ | 容量だけでなくファイル数が効く。環境差が大きい |

| ④ 回収(コピー/サルベージ) | どこまで“元の形”を要求するか | ファイル名維持が必要だと難易度が上がる。仕分けも含める |

| ⑤ サービス復旧・整合性検証 | アプリ/DB整合、再起動手順、再発防止 | “データがある”と“業務が戻る”は別。ここで詰まることが多い |

「時間=容量÷速度」だけでは危険:エラーの“質”が違う

同じ1TBでも、状態によって所要時間は大きく変わります。I/Oエラーが無く順次読みが出るなら、概算は比較的当てやすいです。しかし、タイムアウトやリセットが頻発するディスクは、読み取りが“止まる”時間が長くなります。さらに、読めない領域に粘るほど悪化することもあるため、読み方針(後回し、段階的リトライ)で時間が変動します。

このため、見積もりでは「最短(理想)」「現実(平均)」「最悪(エラー多発)」の3つを用意し、何が起きると最悪側に寄るのかを明確にします。現場や上長が納得するのは、根拠がある“幅”です。断言は危険です。

説明責任を助けるコツ:途中経過を“数値”で示す

復旧作業はブラックボックスに見えがちです。だからこそ、途中経過を数値で示すと安心感が増えます。たとえば、保全なら「何%読めたか」「未読領域はどのくらいか」、回収なら「回収できたファイル数」「重要フォルダの整合が取れたか」、といった具合です。これがあると、顧客や社内の意思決定(どこで打ち切るか、どこまで追加費用を許容するか)が現実的になります。

この章の結論:見積もりは“工程分解”すれば、技術者の言葉で説明できる

復旧時間は運と環境に左右されますが、分解して説明すれば、根拠ある見通しを作れます。そしてこの「説明できる」ことが、BtoBの復旧では技術と同じくらい価値になります。次章では、ここまでの伏線を回収し、Ext4障害対応の帰結――「復旧できる/できない」より重要な設計判断と、一般論の限界――へ進みます。

帰結――「復旧できる/できない」より重要な設計判断(バックアップ、監視、運用ルール)

ここまで、Ext4障害を「論理破損」「I/O劣化」「構成由来」に分け、初動→保全→修復→サルベージ→時間見積もりへ一本の線で繋げてきました。ここで回収したい伏線はひとつです。Ext4障害の現場で本当に難しいのは、ツール選定やコマンドの暗記ではなく、“どこで一般論を捨てて、個別案件として判断するか”です。つまり、復旧そのものより、復旧の前後にある設計・運用の意思決定が、結果(損失額・停止時間・再発率)を大きく左右します。

心の会話:結局「壊れたら直せる」じゃダメなんですか?

「Ext4は堅牢だし、障害が起きてもfsckで戻ることもある。だから大丈夫」――そう言いたくなる気持ちは自然です。でもBtoBの現場では、“戻ることがある”では足りません。必要なのは、戻らないケースの損失を最小化できる設計です。復旧が成功しても、その間に業務が止まり、顧客対応や信用毀損が起きれば、技術的な勝利は経営的には敗北になり得ます。

設計判断1:バックアップは「ある/ない」ではなく「復旧できる形か」

バックアップは“存在”より“復元可能性”が本質です。よくある落とし穴は、(1)バックアップが最新でない、(2)復元手順が未検証、(3)アプリ整合(DB/設定/鍵/依存ファイル)が取れない、(4)復元先の容量や権限、ネットワークが整っていない、です。Ext4障害でファイルを回収できても、アプリ側の整合が崩れていればサービスは戻りません。逆に、復元手順が検証済みなら、ディスク障害は“復旧作業”ではなく“復元作業”に落とし込めます。ここで停止時間の桁が変わります。

設計判断2:監視は「障害検知」ではなく「劣化の早期発見」に寄せる

I/O劣化が絡むと、復旧時間は急増し、成功率も落ちます。だからこそ、SMARTの異常やリトライ増加、I/O待ちの増加、ファイルシステムエラーの兆候を“止められるタイミングで”拾うことが効きます。Ext4のエラーは、突然の論理破損だけでなく、I/O劣化が引き金で増えていくことがあります。「障害になってから通知」では遅いのが現実です。監視のKPIは「落ちたか」ではなく、「落ちる前に止められる兆候が出たか」に寄せる方が、運用として合理的です。

設計判断3:運用ルールは「現場の心理」を前提に作る

障害時、人は焦ります。焦ると“最短に見える道”を選びがちです。Ext4障害で言えば「とりあえずfsck」「とりあえず再起動」「とりあえずRAID再構築」などが典型です。だから運用ルールは、理想論ではなく、焦った人が守れる手順として設計する必要があります。具体的には、最初の10分の行動(書き込み停止、ログ採取、構成情報の確保、保全の判断)をチェックリスト化し、誰が見ても同じ行動が取れる状態にします。ここが整っていると、復旧の質が個人依存になりにくいです。

一般論の限界:RAID/LVM/仮想化/暗号化が絡むと「安全な一手」が変わる

Ext4単体の障害なら、ある程度“型”で語れます。しかし実務では、RAID(ソフト/ハード)、LVM(thin含む)、仮想化基盤、暗号化(LUKS)、分散ストレージ、バックアップ製品などが重なります。このとき、同じ症状でも最適手順が変わります。たとえば、degradedなRAIDでの再同期の扱い、thin poolの逼迫、スナップショットの運用、仮想ディスクの下層障害など、判断を誤ると「復旧可能だったものを壊す」方向に進み得ます。ここが一般論の限界であり、個別案件の設計判断が必要になる理由です。

この章の結論:復旧は“技術”だけでなく“経営リスクの制御”である

Ext4障害の復旧テクニックは重要です。しかしBtoBでは、停止時間、説明責任、再発防止、そして「次に同じ夜勤を繰り返さない」仕組みづくりが同じくらい重要です。もしあなたの環境が、レガシーで止めづらく、構成が複雑で、バックアップや監視が“あるが不安”な状態なら、障害が起きてから考えるのでは遅いことがあります。一般論を踏まえたうえで、個別案件としての最適解を詰めたいと感じたタイミングで、株式会社情報工学研究所のような専門家に相談する価値が出ます。復旧のその場だけでなく、設計・運用まで含めて損失を最小化するためです。

付録:現在のプログラム言語各種で「Ext4障害を増やしやすい落とし穴」と注意点

最後に、アプリケーション側の視点です。Ext4障害そのものはディスク・構成・運用に強く依存しますが、アプリの書き方やI/Oの扱いが、障害時の“被害の見え方”を変えるのも事実です。ここでは、特定言語を批判するのではなく、「データを失いにくい」「障害時に切り分けしやすい」実務上の注意点を、言語・実行環境ごとに整理します(最終的にはOS設定、マウントオプション、ストレージ特性、運用ルールとセットで評価が必要です)。

共通原則:I/Oエラーを“握りつぶさない”、永続化を“思い込みで語らない”

- 書き込みが成功した=永続化されたとは限りません。OSのページキャッシュやストレージのキャッシュ、ライトバック設定で遅延します。

- 重要データは、要件に応じてfsync / fdatasync 相当の同期や、ジャーナリング/トランザクション設計が必要です。

- I/Oエラー(EIO等)やディスクフル(ENOSPC)、一時エラー(EAGAIN等)をログに残し、上位へ伝播させる設計が切り分けを助けます。

C / C++:自由度が高い分「永続化」と「エラー処理」が自己責任になる

C/C++は低レベルI/Oを直接扱えるため、性能最適化や特殊要件に強い一方、障害耐性は設計・実装の差が大きく出ます。注意点は、(1)戻り値の未確認(write/fsync/rename等)、(2)部分書き込み(partial write)や中断(EINTR)の扱い漏れ、(3)テンポラリ→renameの“原子性”に依存した更新設計でディレクトリ同期を忘れる、(4)独自フォーマットでチェックサムや世代管理が無い、などです。Ext4上での安全な更新は「書く」「同期する」「(必要なら)ディレクトリも同期する」のように、要件に合わせた手当てが必要になります。

Java / JVM系:例外は拾えても「永続化の保証」を誤解しやすい

Javaは例外処理や抽象化が整っていますが、FileOutputStream等でflushしただけで安心してしまう誤解が起きがちです。flushはバッファをOSへ渡すだけで、ストレージへの確定とは別問題になり得ます。重要データはFileChannel.force等、要件に応じた同期が必要です。また、ログ出力も非同期・バッファリングされることがあるため、障害時の痕跡を残したい場合はログのフラッシュ方針、ローテーション、保存先(別ディスク/リモート)を設計します。

Python:手軽さの裏で「例外処理と運用境界」が曖昧になりやすい

Pythonは運用自動化やバッチに強い反面、スクリプトが増えると“誰が責任を持つか”が曖昧になりやすいです。注意点は、(1)例外を大雑把に握りつぶす(except: pass)、(2)一時ファイルや中間ファイルが増え、ディスクフルやinode枯渇を招く、(3)ログが標準出力だけで永続化されず、障害時の切り分けが難しくなる、(4)並列処理(multiprocessing等)で同一ファイル更新の競合が起きる、などです。運用自動化ほど「ログの保全」「失敗時の停止条件」「リトライ方針(過剰リトライでI/Oを悪化させない)」が重要です。

Go:並行処理が書きやすい分、I/Oの集中とログ爆発に注意

Goはgoroutineで並行処理が容易なため、I/Oを並列化しすぎてストレージに負荷を集中させる事故が起きがちです。障害兆候が出ているディスクに対して、並列リトライが走ると状況を悪化させることがあります。注意点は、(1)I/Oの並列度制御、(2)リトライの指数バックオフ、(3)コンテキストキャンセルで“止められる設計”、(4)ログのレート制限、です。障害時に「止められる」ことは、復旧の成功率に直結します。

Rust:安全性は強いが「永続化と運用」は別の問題

Rustはメモリ安全性の面で強みがありますが、ファイルI/Oの永続化保証や障害耐性は言語だけで決まりません。注意点は、(1)Resultの適切な伝播とログ化、(2)原子更新(temp+rename)の設計と同期、(3)データフォーマットのバージョニングやチェックサム設計、です。安全に“壊れない”設計は、型安全だけでなく、ストレージ障害時の破損モデルを前提に作る必要があります。

JavaScript / Node.js:イベントループと非同期I/Oで「順序」と「完了」を誤解しやすい

Node.jsは非同期I/Oが基本のため、「書いたつもり」「閉じたつもり」が起きやすい領域があります。注意点は、(1)コールバック/Promiseの完了を待たずにプロセス終了、(2)ログやファイル書き込みのバッファが残ったまま終了、(3)例外がグローバルで落ちて中途半端に残る、です。運用ではプロセス監視(再起動)だけでなく、「中途半端な状態から再開できる」設計(冪等性、チェックポイント、ジャーナル的ログ)が重要です。

PHP:共有ホスティングや権限制約の中で「容量・inode・権限」の問題が出やすい

PHPはWeb運用で広く使われますが、共有環境ではディスク容量・inode制限・権限・バックアップ運用がボトルネックになりやすいです。注意点は、(1)ログやセッション、キャッシュが肥大化してディスクフル、(2)権限ミスで復旧時に読み出せない、(3)プラグイン等の更新でファイルが増え、inode枯渇、です。特にWordPress運用では、バックアップと復元テスト、ログの退避先、更新手順(メンテナンスモード)を固めることが、障害時の復旧を現実的にします。

シェルスクリプト:小さな自動化が積み重なると「破壊力」が大きくなる

シェルは強力ですが、rmやmv、リダイレクト一つで大事故になります。注意点は、(1)set -e / pipefail等を使わず失敗を見逃す、(2)ワイルドカードや変数展開の想定外、(3)ログが残らない、(4)cronで無限リトライ的に動いてI/Oを悪化させる、です。障害兆候(I/O error等)が出たら自動処理が止まる仕組み(フェイルセーフ)を入れると、Ext4障害の拡大を防げます。

この付録の結論:言語の問題に見えて、実は「I/O要件定義」と「運用設計」の問題

「どの言語が安全か」ではなく、「そのデータはどこまで永続性が必要か」「障害時に何を優先するか(サービス継続/証拠性/整合性)」「失敗を検知して止められるか」という要件が先にあります。ここが曖昧なまま実装・運用が積み上がると、Ext4障害が起きたときに“復旧の難易度”が跳ねます。一般論では語り切れない領域だからこそ、システム構成・運用・復旧手順まで含めて個別最適を詰めたい場合は、株式会社情報工学研究所のような専門家への相談が現実的な選択肢になります。

1. Ext4障害時の復旧フローを理解し、ダウンタイムを最小化できる体制を構築します。

2. BCPや法令順守を考慮したシステム設計/運用フローを実装できます。

3. 経営層に説明可能なKPIと投資対効果を、資料として提示します。

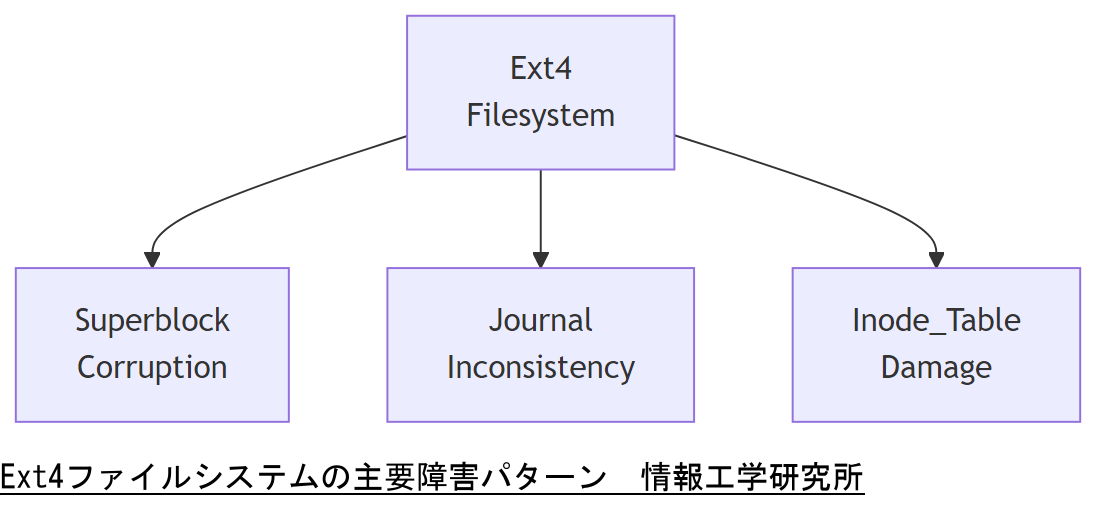

Ext4障害の基礎知識

LinuxのExt4ファイルシステムは、高速化と信頼性確保のためジャーナリング機能を備えています。ジャーナリングとは、ファイル操作前後の状態をログに追記し、障害発生時には一貫性を保った復旧を行う仕組みです。本章では、Ext4がどのようにデータ構造を管理し、代表的な障害パターンがどのように発生するかを整理します。具体的には、スーパーブロックの破損やジャーナル領域の不整合、inodeテーブルの破損など、主要な障害原因と発生メカニズムを解説し、後続章の復旧手順理解に必要な基礎知識を提供します。また、Ext4のファイルシステム構造(ブロックグループ、extents、ガーベジコレクション機能)についても概観し、障害発生時にどの領域を優先的にチェックすべきかを示します。これにより、復旧方法の選択肢や時間見積もりの妥当性を評価する土台を構築できます。

兆候と早期検知

Ext4ファイルシステムの障害は、事前の予兆をいかに捉えられるかが復旧成功の鍵となります。本章では、システムログの読み方とSMARTによるディスク自己診断の導入方法を解説し、障害発生前にアラートを上げる運用体制を構築する手順を示します。具体的には、dmesgや/var/log/kern.logに現れる典型的なエラーサインの例を挙げ、定期的なログ監視スクリプトのサンプルもご紹介します。また、smartmontoolsを使ったSMART値監視の設定例を通じて、ハードディスクの劣化を事前に察知し、計画的な交換やリビルドを実施するフローを示します。

ログ分析

Ext4障害の初期兆候として最も多いのが、カーネルログ中の EXT4-fs error や I/O error の記録です。これらはマウント時やファイル操作時に発生し、以下のパターンで現れます。

- スーパーブロック不整合による再マウント警告

- inodeエラーによるファイル読込失敗ログ

- ディレクトリエントリの破損を知らせるエラー

SMART監視

SMART(Self-Monitoring, Analysis, and Reporting Technology)は、ディスク自身が健康状態を自己監視し、予兆を報告する仕組みです。Linuxでは smartmontools パッケージを導入し、 smartd デーモンで定期チェックを行います。以下の設定例では、毎晩深夜に全ディスクのSMARTテストを実行し、結果をsyslogに出力します。

- /etc/smartd.conf に対象デバイスとテストスケジュールを記載

- smartd.service を有効化し、自動起動設定を実施

- 障害閾値(Reallocated_Sector_Ct等)超過時にメール通知設定

技術担当者は、ログのERRORやSMARTアラートを上司に報告する際、「いつ」「どのログ項目で」「どの閾値を超えたか」を明確に伝えましょう。読み取り専用切替の誤操作を防ぐため、操作手順と影響範囲を事前共有してください。

ログ監視スクリプトやsmartd設定を自動化する際は、誤検知による頻繁なアラートを避けるため、閾値調整とテスト実行結果の人手確認ルーチンを設けることを忘れないようにしましょう。

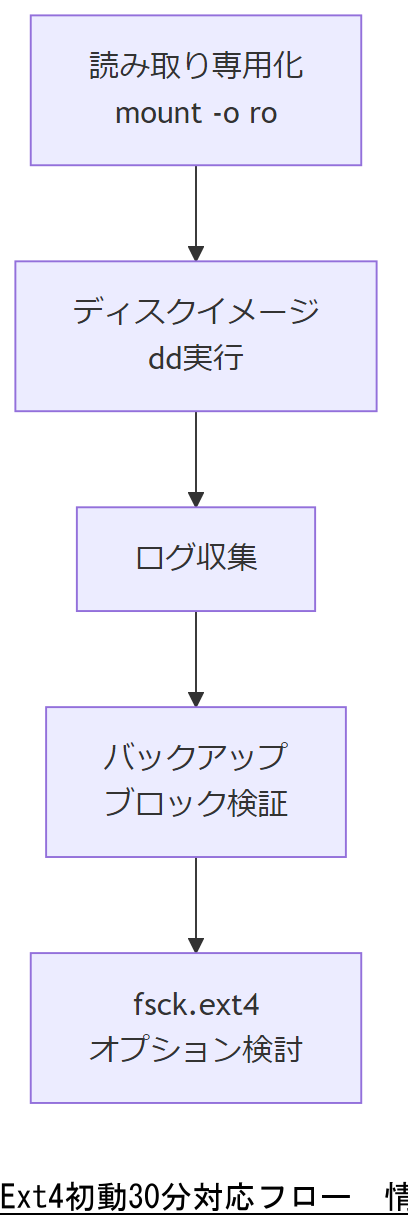

初動30分フロー

Ext4障害発生後の初動30分は、データ損失を最小化し復旧時間を短縮するための極めて重要な時間帯です。本章では、障害検知直後からディスクイメージ取得、読み取り専用化、主要ログの確保、fsck実行準備までの具体的なステップを時系列で解説します。

ステップ概要

以下のチェックリストをもとに、迅速かつ抜け漏れのない初動対応を行います。

初動30分対応チェックリスト| 時間目安 | 作業内容 | 備考 |

|---|---|---|

| 0~5分 | 読み取り専用マウント(mount -o ro) | データ上書き防止 |

| 5~10分 | ディスクイメージ取得(dd if=/dev/sdX of=image.dd) | オリジナル保全 |

| 10~15分 | 主要ログコピー(/var/log/kern.log 他) | 原因解析用に保管 |

| 15~20分 | fsck用パーティションバックアップ | スーパーブロック検証用 |

| 20~30分 | fsck.ext4 実行準備:オプション検討 | -n, -p, バックアップブロック番号検討 |

初動対応時は「読み取り専用化」「イメージ取得」の順序を誤ると、データ上書きリスクが発生します。上司には必ず手順順序と影響範囲を図示して共有してください。

実際の現場では、コマンド実行ミスが発生しやすいです。作業リストを紙または電子化し、一つずつ確実にチェックしながら進めましょう。

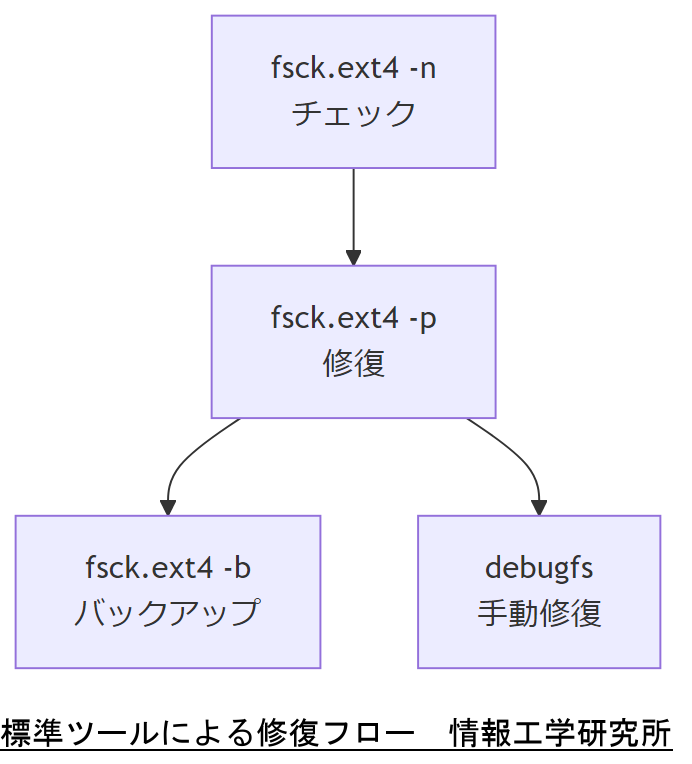

標準ツールによる修復

LinuxにはExt4専用の修復ツールが標準で提供されており、fsck.ext4やdebugfsなどを適切に組み合わせることで、障害からの復旧を効率化できます。本章では、各ツールの役割とオプションの使い分け、実行時の注意点を詳しく解説します。

fsck.ext4 の基本オプション

fsck.ext4はファイルシステム全体の一貫性チェックと修復を行うコマンドです。よく使う主なオプションは以下の通りです。

-n:読み取り専用モードでチェック。自動修復は行わず、安全に検証のみ。-p:自動修復モード。軽微な不整合を自動で修正。-y:すべての修復確認を自動“Yes”で実行。-b バックアップブロック番号:スーパーブロックバックアップを指定して復旧。

-nで障害箇所を特定し、その後-pやバックアップブロックを使って復旧します。 主要オプション比較表 | オプション | 効果 | 使用タイミング |

|---|---|---|

| -n | 読み取り専用チェック | 初回検証時 |

| -p | 自動修復 | 軽微エラー対応 |

| -y | 全自動修復 | 人的確認不要時 |

| -b | バックアップスーパーブロック復旧 | スーパーブロック破損時 |

debugfs を用いた手動操作

debugfsはExtファイルシステムのインタラクティブシェルで、特定inodeの内容確認や修正が可能です。以下の手順で利用します。

debugfs -w image.dd:書き込みモードでディスクイメージを開く。stat:inode情報を表示。clri:破損inodeをクリア。dump:データ抽出。<ファイル名>

fsck.ext4実行時はオプションの誤選択でさらなる破損を招くリスクがあります。上司には、事前検証結果と使用オプションの理由をまとめた資料を提示してください。

自動修復(-p)で進める前に、必ず読み取り専用チェック(-n)を行い、想定外の修復操作を防ぐ手順を遵守しましょう。

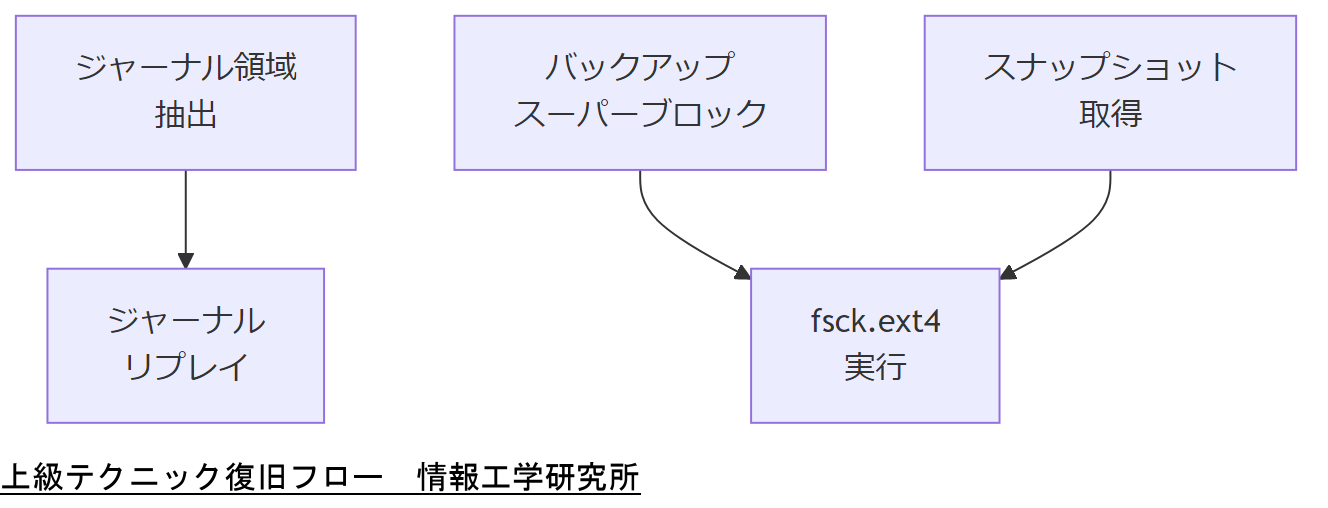

上級テクニック

標準ツールで対応困難な場合や、より精密な復旧を求める際は、ジャーナルの手動リプレイやスーパーブロックの代替復旧、LVM/RAIDとの組み合わせ復旧といった上級テクニックが有効です。本章では、各技法の手順と注意点を詳述します。

ジャーナル手動リプレイ

ジャーナル領域のみを抽出し、安全に再生することで、ファイルシステム全体を壊さずに復旧できます。手順は以下の通りです。

- ディスクイメージからジャーナル領域をオフセット指定で抽出(dd if=image.dd bs=4096 skip=<オフセット> count=<サイズ>)

- debugfsでイメージを読み込み、

journal replayコマンドを実行 - リプレイ後、ファイルシステムの一貫性をfsck.ext4で再チェック

tune2fs -lで確認可能です。リプレイ中にエラーが出た場合は即座に中断し、ログを別途保全してください。 スーパーブロック代替復旧

Ext4は複数のスーパーブロックのバックアップを保持します。メインスーパーブロックが破損した場合は、バックアップから復旧を試みます。

- バックアップブロック番号一覧を取得:

mke2fs -n /dev/sdX - fsck.ext4 -b <バックアップ番号> /dev/sdX

- 復旧後は再度メインスーパーブロックを書き戻し:

e2fsck -f /dev/sdX

LVM・RAIDとの連携復旧

LVMやRAID構成下では、物理デバイス単位ではなく論理ボリュームやアレイ単位で復旧作業を行います。

- RAIDアレイ解体せずに個別ディスクを読み取り専用マウント

- LVM上のスナップショット機能を活用し、論理ボリュームをコピー

- コピー上でfsck.ext4やジャーナルリプレイを実行

上級テクニックは手順ミスでデータをさらに破損するリスクがあります。操作前に必ずテスト環境での手順検証結果を経営層へ報告し、承認を得てから本番実行してください。

ジャーナルリプレイやバックアップブロック指定はオフセット誤りが致命的です。コマンド実行前に必ずパラメータを二重チェックし、ログを逐一保全する運用を徹底してください。

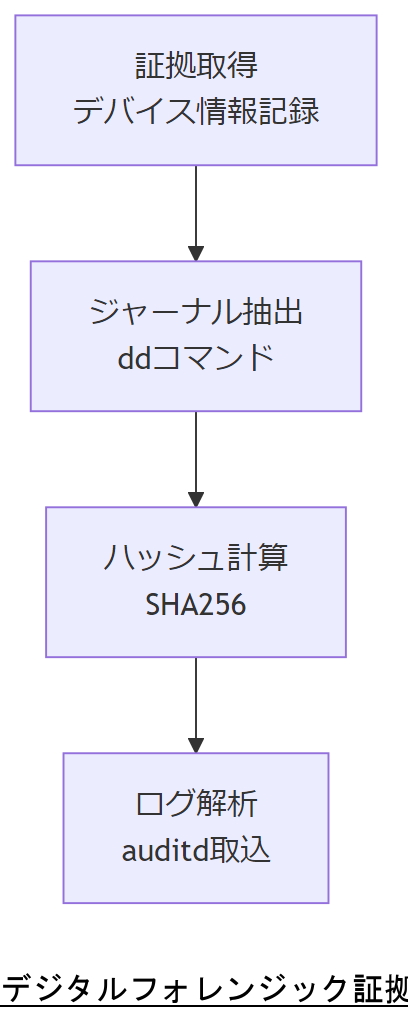

デジタルフォレンジック視点

障害対応において、復旧作業中も証拠保全を同時に行うデジタルフォレンジックの視点が欠かせません。本章では、証拠保全手順(Chain‐of‐Custody)やジャーナル保全、改ざん検知のフローを政府機関向け標準に準拠して解説します。

証拠保全とChain-of-Custody

政府機関等のガイドラインでは、デジタル証拠の信頼性を担保するためにChain-of-Custody(証拠保全連鎖)の厳格な管理を求めています。具体的には、各データ取得時に以下を記録します:

- 取得日時・取得者名

- 対象デバイス情報(シリアル、モデル)

- 取得方法とツールバージョン

- 証拠保管場所とアクセスログ

ジャーナル領域の保全

ジャーナル領域には、直近のファイル操作履歴が格納されており、障害解析の重要な手がかりとなります。以下の手順で保全します:

- ディスクイメージからジャーナルセクタを抽出:

dd if=image.dd bs=4096 skip=<オフセット> count=<サイズ> - 抽出データのハッシュ値計算(SHA256など)による整合性確認

- ログ解析環境へインポートし、操作履歴を解析

マルウェア・内部不正の痕跡管理

内部不正やマルウェア攻撃では、改ざんされたファイルや不審プロセスの履歴を収集・保全し、後日責任追及が可能な形式で保存します。具体的には:

- /proc,/sys フォルダのスナップショット取得

- 実行バイナリのハッシュ収集

- プロセス起動ログ(auditd など)をセキュア転送

フォレンジック作業を開始する前に、必ず証拠保全手順書と取得ログを上司へ提出し、社内規定に沿った承認を得てください。

証拠データの取り扱いは一つのミスで証拠能力を失います。手順書通りの作業ログを逐次記録し、作業後速やかにハッシュ値を二重チェックしてください。

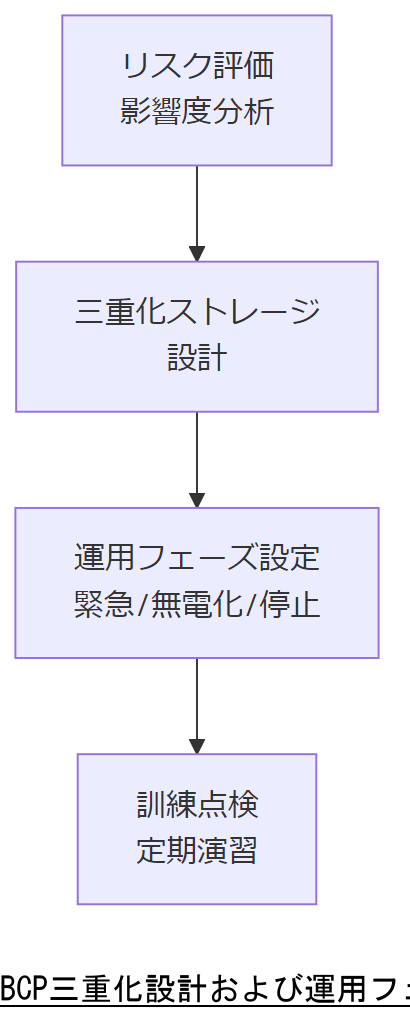

BCPと三重化設計

事業継続計画(BCP)は、企業が災害やシステム障害時にも重要業務を継続するための枠組みです。内閣府「事業継続ガイドライン」では、データ保存の三重化や、緊急時・無電化時・システム停止時の3段階オペレーションを基本とすべきと明記しています【出典:内閣府『事業継続ガイドライン』令和5年3月】。本章では、三重化ストレージ設計の要点と、各段階に応じた運用フローを解説します。

三重化ストレージ設計

データの三重化とは、同じデータを以下のように3箇所に保管する方式です【想定】:

_三重化ストレージ構成例_| 保存先 | 冗長レベル | 特徴 |

|---|---|---|

| オンサイトサーバー | リアルタイム複製 | アクセス高速・障害検知即時 |

| オフサイトバックアップ | 夜間同期 | 災害対策エリア外保管 |

| オフラインアーカイブ | 月次スナップショット | ランサムウェア対策 |

3段階運用フェーズ

運用フェーズは、障害の状況に応じて以下の3段階で想定します【想定】:

- 緊急時:即時復旧が必要な限定機能のみ稼働

- 無電化時:発電機等のバックアップ電源で限定稼働

- システム停止時:完全停止後の再起動・復旧演習

BCPの三重化設計は多層的であるほどコストが増大します。上司には各保存先の冗長レベルと想定コストを整理した概要資料を提示し、合意を得てください。

演習の頻度が低いと、担当者が手順を忘れる恐れがあります。訓練・点検は必ず年2回以上実施し、結果を記録して改善サイクルに組み込んでください。

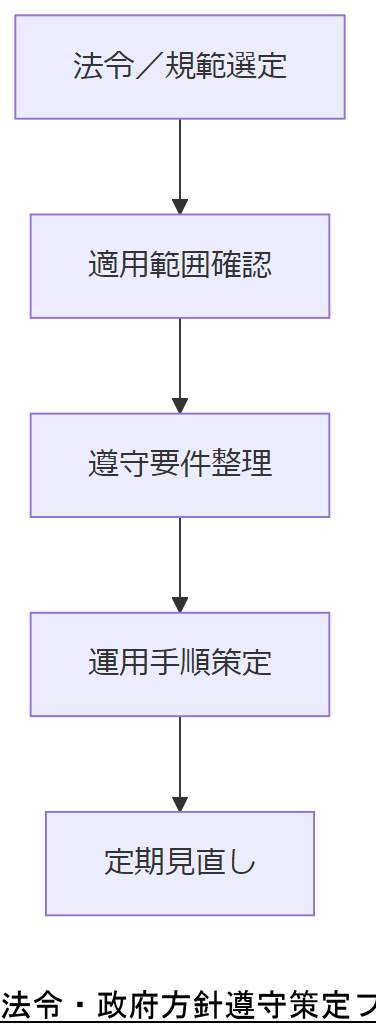

法令・政府方針

データ保護やサイバーセキュリティに関する法令・政府方針は、事業継続や情報資産の保全に直結する重要要素です。本章では、日本の個人情報保護法、EUのNIS2指令、米国のNIST SP 800-123ガイドライン、ならびに政府機関向け統一基準群を比較し、各規範の適用ポイントと遵守策を整理します。[出典:農林水産省『個人情報の保護に関する法律』令和4年]

日本:個人情報保護法

個人情報保護法(平成15年法律第57号)は、行政機関が保有する個人データの適正管理を義務づけ、漏えい時の報告や再発防止措置を求めています。[出典:農林水産省『個人情報の保護に関する法律』令和4年] 違反時には行政処分や罰則が科されるため、データ復旧時にもログ保全・アクセス履歴の保存が必須です。[出典:農林水産省『個人情報の保護に関する法律』令和4年]

EU:NIS2指令

NIS2指令(Directive (EU) 2022/2555)は、重要インフラを含む18分野のサイバーセキュリティ基準を統一し、加盟国の国家戦略策定と跨域連携を義務づけています。[出典:EUR-Lex『Directive (EU) 2022/2555』2022年] 特にインシデント報告の期限短縮や脆弱性管理の強化が求められ、国内外サーバー障害対応でも遵守が必須です。[出典:EUR-Lex『Directive (EU) 2022/2555』2022年]

米国:NIST SP 800-123

NIST SP 800-123「Guide to General Server Security」は、サーバーのセキュリティ管理手順を定義し、構成管理・パッチ適用・ログ監視などの具体策を示しています。[出典:NIST CSRC『SP 800-123』2013年] サーバー障害対応においても、ハードニング手順準拠が復旧後の再発防止に直結します。[出典:NIST CSRC『SP 800-123』2013年]

日本:政府機関等向け統一基準群

内閣サイバーセキュリティセンター(NISC)が策定する「政府機関等の対策基準策定のためのガイドライン(令和5年度版)」は、情報システム運用のベースラインを示す統一規範・統一基準・ガイドラインを体系化しています。[出典:NISC『政府機関等の対策基準策定のためのガイドライン(令和5年度版)』令和5年] また、各機関はこれをもとに組織特性に応じた対策基準を策定することが義務づけられています。[出典:NISC『政府機関等のサイバーセキュリティ対策のための統一基準群(令和5年度版)』令和5年]

法令・政府方針比較表| 規範 | 適用範囲 | 主要要件 |

|---|---|---|

| 個人情報保護法 | 行政機関保有データ | 漏えい報告・再発防止措置 |

| NIS2指令 | EU加盟国の重要インフラ | インシデント報告・脆弱性管理 |

| NIST SP 800-123 | サーバーセキュリティ | ハードニング・ログ監視 |

| 政府統一基準群 | 政府機関情報システム | ベースライン対策・PDCA |

各規範は適用範囲や罰則が異なります。上司には自社対象範囲と遵守要件を一覧にまとめた資料を提示し、統一的な遵守体制を構築してください。

法令改正は頻繁に行われます。定期的(半年ごと)に最新ガイドラインを確認し、運用手順をアップデートする仕組みを整備しましょう。

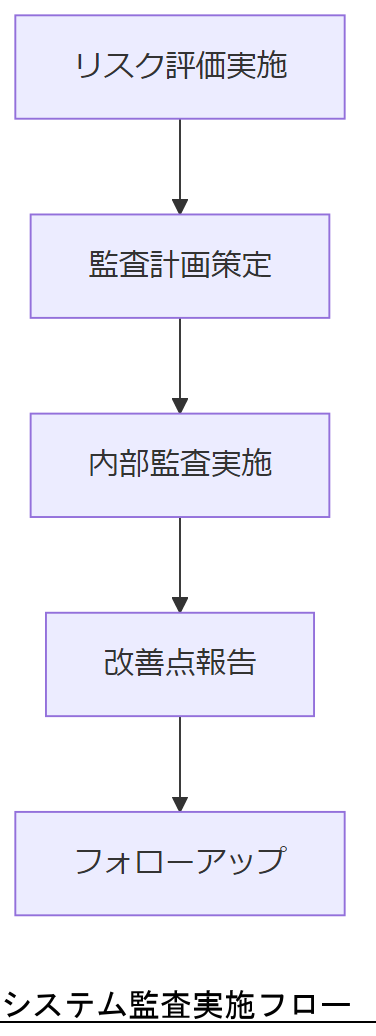

コンプライアンスと監査

システム障害対応では、法令遵守だけでなく定期的な監査によって運用の健全性を確保することが求められます。金融機関等のシステム監査基準では、ITガバナンスやリスク管理体制に関する監査ポイントが詳細に規定されており【出典:金融機関等のシステム監査基準(第2版) 2024年】、IPAの「情報セキュリティ10大脅威 2025」では組織向けセキュリティ課題としてランサム攻撃やサプライチェーン攻撃を挙げ、監査における重点検査項目を示しています【出典:IPA「情報セキュリティ10大脅威 2025」】。本章では、主要な監査基準と、自社システム監査体制の構築ポイントを整理します。

金融機関等のシステム監査基準

金融庁所管のシステム監査基準では、組織のガバナンスから運用管理まで幅広い項目を網羅しています。特に以下の観点が重視されています:

- リスク評価と内部統制の整備

- 業務継続計画との整合性

- 外部委託先の管理体制

組織向け情報セキュリティ10大脅威

IPAが選出する2025年の「組織向け10大脅威」では、ランサム攻撃やサプライチェーン攻撃が上位に位置し、バックアップ運用やログ管理の重要性が指摘されています。監査では、これら脅威に対応した対策実施状況の検証が求められます【出典:IPA「情報セキュリティ10大脅威 2025」組織編】。

監査基準と脅威対応チェック表| 項目 | 主な要件 | 監査視点 |

|---|---|---|

| リスク管理 | 定期リスク評価 | 評価結果の文書化・改善履歴 |

| BCP整合性 | BCPとIT運用の一体化 | 演習記録と課題対応 |

| 委託先監督 | 契約・監査条項 | 監査報告書の有無 |

| 脅威対策 | ランサム対策・サプライチェーン対策 | ログ運用・バックアップ運用状況 |

内部監査部門の体制

証券会社向けチェックリストでは、内部監査部門にシステム専門要員の配置と、IT統制の定期見直しが求められます【出典:証券会社向けシステムリスク管理チェックリスト】。具体的には、職務分掌の明確化と問題発生時の報告フローを文書化し、定期監査でトレーサビリティを確保します。

監査結果を経営層に説明する際は、主要指標の達成状況と未達項目の改善計画を一枚の表にまとめ、迅速な承認を得るようにしてください。

監査項目の網羅性を高めるため、IPA脅威一覧やBCPガイドラインなど外部公的資料を定期的に参照し、チェックリストをアップデートしましょう。

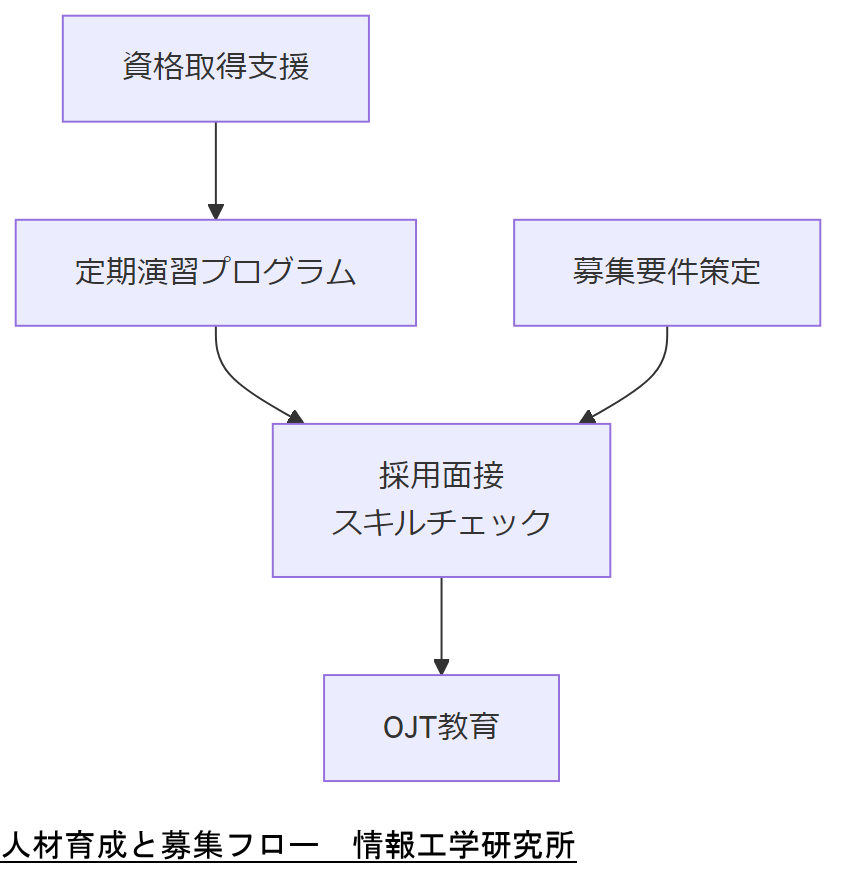

人材育成と募集

Ext4障害対応やBCP実施には、専門的知見を持つ技術者の育成と適切な採用が不可欠です。本章では、政府認定資格や研修プログラム、そして人材募集要件のポイントを整理し、継続的なスキル確保のためのロードマップを示します。

必要資格と認定制度

政府が認定する情報処理安全確保支援士(旧:情報セキュリティスペシャリスト)は、サイバーセキュリティの国家資格として高い信頼を得ています【出典:経済産業省『情報処理安全確保支援士制度ガイド』令和4年】。また、IPAによる高度試験「ネットワークスペシャリスト」「データベーススペシャリスト」なども、システム障害対応力向上に資するとされています。

訓練プログラムと演習

技術研修では、実機演習を重視します。例えば、fsck.ext4操作やジャーナルリプレイ演習、ログ解析ハンズオンを組み合わせ、定期的(半年ごと)な演習を実施します。更に、BCP演習として「緊急時」「無電化時」「完全停止時」各フェーズを通じた復旧演習を行うことで、実践力を養成します【想定】。

募集要件の定義

採用要件では、以下の要素を明示すると良いでしょう。

- Linuxシステム管理経験3年以上

- 資格保有者(情報処理安全確保支援士等)優遇

- fsck/debugfs 等ツールの利用経験

- BCP策定・運用経験

人材育成計画と採用要件をまとめる際、上司には資格保有状況や演習実績を一覧化し、必要人員数と投資計画を示すことが重要です。

採用後の定着率を高めるため、スキルアップパスとキャリアロードマップを明示し、継続的なフォローアップ体制を整備しましょう。

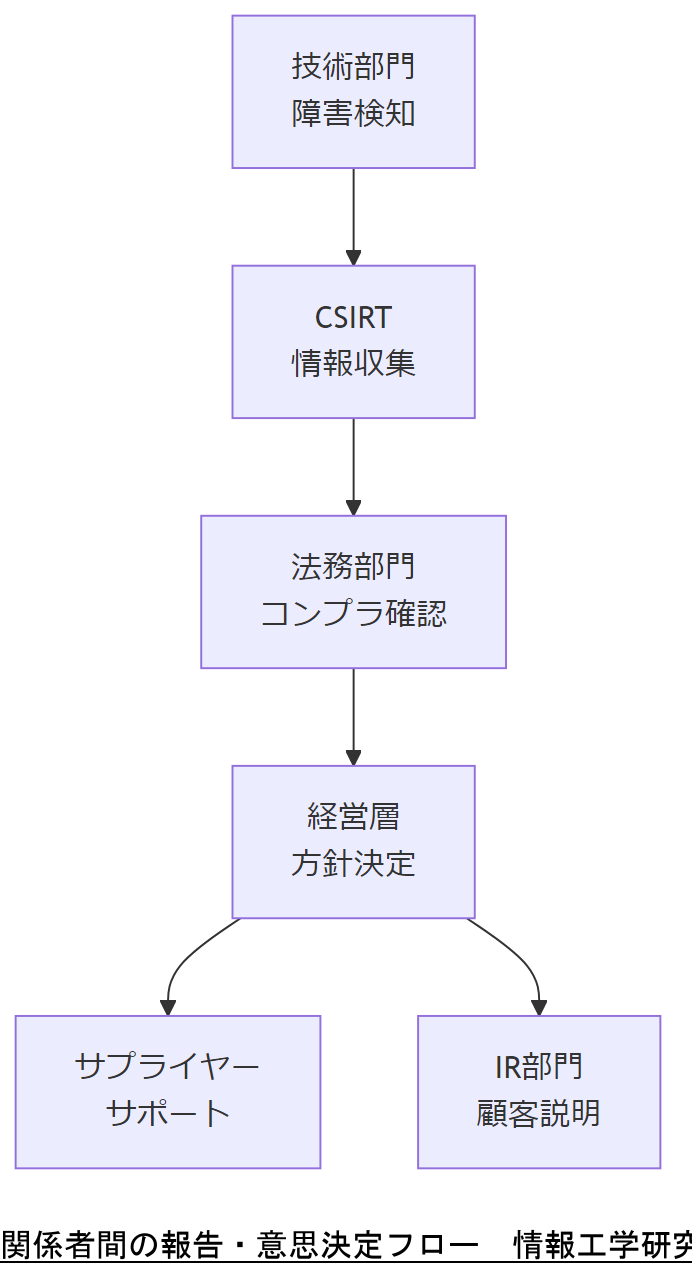

関係者マップと注意点

システム障害やExt4ファイルシステム障害対応では、多様なステークホルダーとの連携が欠かせません。自社内では技術部門、運用チーム、法務部門、内部監査部門、IR部門、経営層などが関与し、外部ではクラウドサービス事業者、CSIRT、サプライヤーなどが挙げられます【出典:内閣府防災情報のページ『知る・計画する』】。 各関係者の役割と注意点を整理し、情報共有ルートと意思決定階層を明示したマップを作成することで、迅速な対応と報告が実現します【出典:IPA『情報システム障害の再発防止のための 組織的マネジメントの調査報告』】。

ステークホルダー一覧表| ステークホルダー | 役割 | 注意点 |

|---|---|---|

| 経営層 | 復旧方針決定/投資承認 | 現状とリスクを可視化して共有 |

| 技術部門 | 初動対応/復旧作業 | 手順書遵守とログ保全 |

| 法務部門 | コンプライアンス監査/報告文書レビュー | 法令要件の抜け漏れ防止 |

| 内部監査 | 運用体制の健全性確認 | 監査記録の保全 |

| CSIRT | 脅威情報提供/エスカレーション受け口 | 迅速な情報共有チャネル設定 |

| サプライヤー | ハードウェア交換/技術サポート | 契約条件・SLAの遵守状況確認 |

| IR部門 | 対外説明/顧客対応 | 事実関係の正確な把握 |

技術部門は各ステークホルダーへ報告する際、「何を」「いつ」「どのように対応したか」を簡潔にまとめ、関係部門間の認識ギャップを防ぐ資料を用意してください【出典:IPA CSIRT Handbook】。

関係者マップは定期的に見直し、新規取引先や組織変更に応じて更新することで、緊急時の混乱を防止してください【出典:内閣府防災情報のページ】。

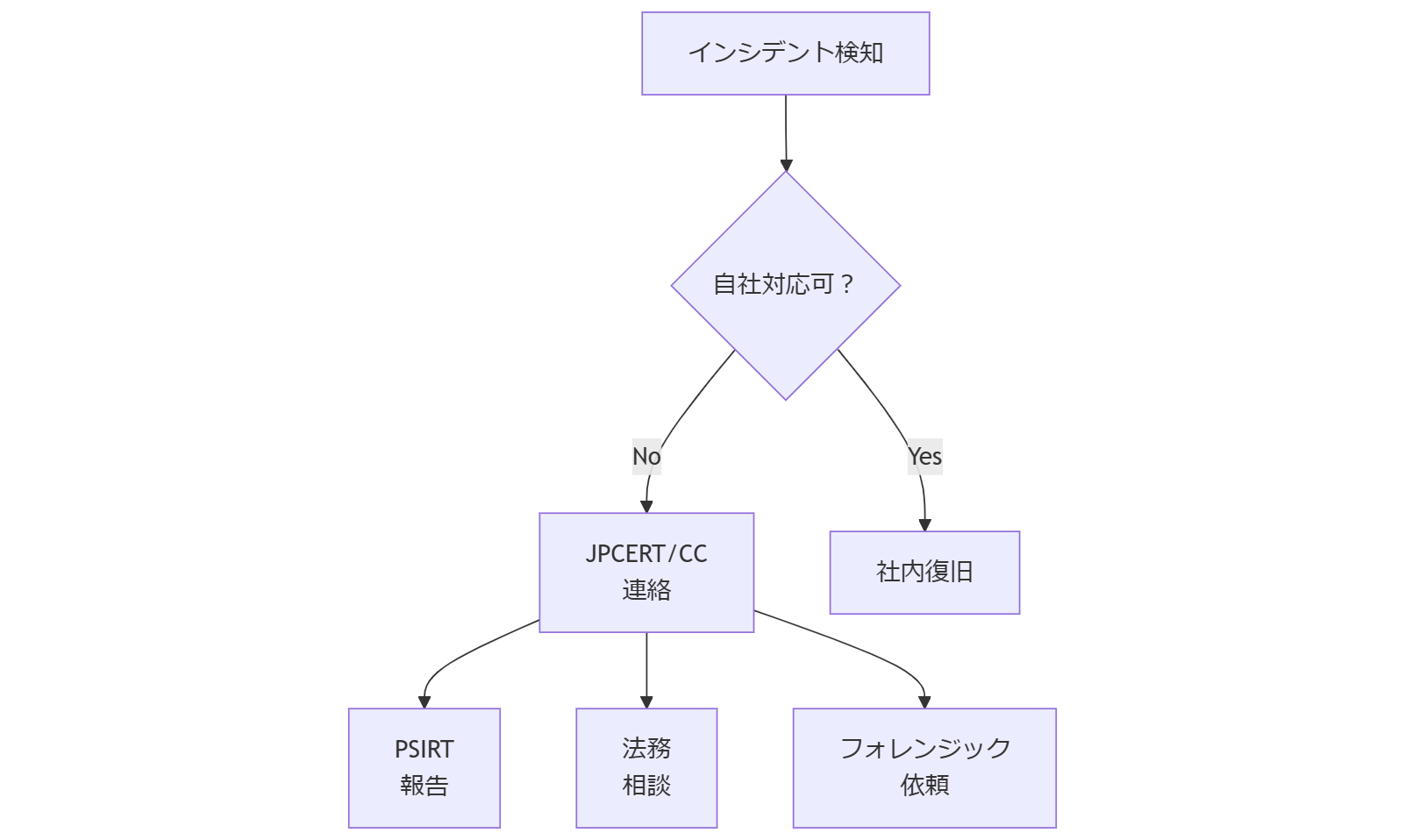

外部専門家へのエスカレーション

障害対応が自社リソースで困難な場合は、適切な外部専門家へエスカレーションを行います。代表的な専門家として、JPCERT/CCやPSIRT、法務専門家、デジタルフォレンジック専門家が挙げられます【出典:JPCERT Handbook】。エスカレーション基準や連絡手順をあらかじめ定義し、迅速な支援を得る体制を構築しておきましょう【出典:JPCERT APTガイド】。

外部専門家一覧表| 専門家 | 役割 | 連絡要件 |

|---|---|---|

| JPCERT/CC | 全体調整/初動支援 | 重大インシデント発生時 |

| PSIRT | 脆弱性対応 | 未知脆弱性検出時 |

| 法務専門家 | 法令順守支援/報告文書作成 | 個人情報漏えい疑い時 |

| フォレンジック専門家 | 証拠保全/調査 | 改ざん・不正の疑い時 |

エスカレーション時は、事前に定義した基準と手順書を遵守し、連絡先リストと認証情報を常に最新化してください【出典:JPCERT PSIRT Services Framework】。

外部専門家との連携では、機密保持契約(NDA)とSLAの整備を事前に行い、支援レベルと責任範囲を明確にしておきましょう【出典:JPCERT ICS Security Guide】。

はじめに

Ext4ファイルシステムの理解と障害の影響 LinuxのExt4ファイルシステムは、その信頼性とパフォーマンスから多くの企業で利用されています。しかし、どんなシステムにも障害は発生する可能性があり、データ損失は業務に深刻な影響を与えることがあります。特に、IT部門の管理者や企業経営陣にとって、データの安全性と復旧手段を理解することは不可欠です。この記事では、Ext4ファイルシステムの基本的な特性や、一般的な障害の原因について触れ、その影響を軽減するための復旧テクニックを紹介します。これにより、万が一の事態に備え、企業のデータ保全に役立てることができるでしょう。データ障害のリスクを理解し、適切な対応策を講じることで、業務の継続性を保つことが可能になります。まずは、Ext4ファイルシステムの構造と、どのような障害が発生する可能性があるのかを見ていきましょう。

Ext4ファイルシステムの基本構造と特徴

Ext4ファイルシステムは、Linux環境において広く利用されているファイルシステムで、いくつかの特徴があります。まず、Ext4は”Fourth Extended File System”の略であり、前のバージョンであるExt3の進化版です。主な特徴の一つは、ジャーナリング機能です。これは、データの書き込みが行われる前に、その操作のログを記録することで、システム障害が発生した際にデータの整合性を保つ役割を果たします。 また、Ext4は大容量のファイルやパーティションをサポートしており、最大で1エクサバイト(EB)のパーティションと、最大で16テラバイト(TB)のファイルを扱うことができます。これにより、大規模なデータベースやファイルサーバーに適した選択肢となっています。 さらに、Ext4は高いパフォーマンスを提供します。特に、ファイルの読み書き速度が向上しており、大量の小さなファイルを扱う際でも効率的です。また、空き領域の管理が最適化されているため、デフラグメンテーションの必要性が低く、ストレージの効率的な利用が可能です。 このように、Ext4ファイルシステムは信頼性、性能、拡張性に優れた特性を持ち、さまざまな用途に対応しています。しかし、これらの利点にもかかわらず、障害が発生する可能性があるため、次の章では具体的な障害の原因について詳しく見ていきます。

一般的な障害の原因と症状

Ext4ファイルシステムにおける一般的な障害の原因は多岐にわたります。まず、ハードウェアの故障が挙げられます。特に、ディスクドライブの物理的な損傷や劣化は、データ損失の主な原因の一つです。これに加えて、電源障害や過熱も、ファイルシステムに悪影響を及ぼすことがあります。電源が急に切れたり、不安定な電源供給が続くと、データの書き込みが途中で中断され、ファイルシステムが破損する可能性があります。 次に、ソフトウェアの問題も重要な要因です。オペレーティングシステムのバグや、ファイルシステムの不適切な操作(例えば、強制終了や不正なシャットダウン)によって、データの整合性が損なわれることがあります。また、ウイルスやマルウェアによる攻撃も、ファイルシステムに深刻な影響を与えることがあります。 障害の症状としては、ファイルの読み込みエラー、データの消失、システムの不安定さなどが見られます。具体的には、特定のファイルにアクセスできなくなったり、システムが起動しなくなるといった事例が報告されています。このような症状が現れた場合、早急な対応が必要です。次の章では、これらの障害に対する具体的な対応方法について詳しく説明します。

効果的な復旧テクニックの紹介

Ext4ファイルシステムにおけるデータ障害が発生した場合、迅速かつ効果的な復旧テクニックを適用することが重要です。まず最初に、バックアップの重要性を強調します。定期的なバックアップを行うことで、万が一の障害時にデータを復元しやすくなります。バックアップは、ローカルストレージだけでなく、クラウドサービスを利用することも検討しましょう。 次に、ファイルシステムの修復ツールを使用することが考えられます。Linuxには、`fsck`(ファイルシステムチェック)というコマンドがあり、これを使ってファイルシステムの整合性を確認し、エラーを修正することができます。このツールは、特に軽微な障害に対して非常に効果的です。 また、データ復旧ソフトウェアの利用も一つの手段です。これらのツールは、削除されたファイルや破損したデータの復元を支援します。ただし、選択する際は、信頼性のあるソフトウェアを使用することが重要です。信頼性の低いソフトウェアは、データのさらなる損失を招く可能性があります。 さらに、専門のデータ復旧業者に依頼することも選択肢の一つです。特に、ハードウェアの故障や深刻なファイルシステムの損傷が疑われる場合は、専門家の手を借りることでより高い復旧率が期待できます。これにより、重要なデータを取り戻す可能性が高まります。 このように、効果的な復旧テクニックを理解し、適切に実行することで、Ext4ファイルシステムの障害に対する備えを強化することができます。次の章では、これらの復旧方法を実際に適用する際の注意点について詳しく説明します。

復旧作業にかかる時間の目安

復旧作業にかかる時間は、障害の種類やデータの損失状況によって大きく異なります。軽微なファイルシステムのエラーであれば、`fsck`コマンドを使用した修復作業は数分から数十分で完了することがあります。これに対して、物理的なハードウェアの故障や、深刻なデータ損失が発生した場合は、数時間から数日を要することもあります。 データ復旧ソフトウェアを使用する場合、復旧にかかる時間はファイルのサイズや数、損傷の程度に依存します。一般的には、数時間で復旧が可能なこともあれば、数日かかる場合もあります。特に、大量のデータが関与している場合や、データが上書きされている場合は、復旧が難航することがあります。 専門のデータ復旧業者に依頼する場合、初期診断に数時間を要し、その後の復旧作業にさらに数日かかることが一般的です。業者によっては、復旧の進捗状況を随時報告してくれるところもありますので、依頼時に確認しておくと良いでしょう。 このように、復旧作業にかかる時間はケースバイケースで異なりますが、事前に時間の目安を理解しておくことで、適切な対応を計画することが可能になります。次の章では、復旧作業を行う際の具体的な注意点について詳しく解説します。

予防策と定期的なメンテナンスの重要性

Ext4ファイルシステムの障害を未然に防ぐためには、予防策と定期的なメンテナンスが不可欠です。まず、定期的なバックアップの実施は最も重要な対策の一つです。バックアップは、データの損失を防ぐだけでなく、障害発生時の迅速な復旧を可能にします。バックアップ先をローカルストレージとクラウドサービスの両方に設定することで、さらなる安全性を確保できます。 次に、ファイルシステムの健全性を保つために、定期的に`fsck`コマンドを使用して整合性チェックを行うことが推奨されます。これにより、潜在的なエラーを早期に発見し、修正することが可能です。また、ハードウェアの状態を監視することも重要です。特に、ディスクドライブの温度や稼働時間を確認し、異常があれば早めに交換することで、物理的な故障を防ぐことができます。 さらに、ソフトウェアのアップデートも忘れてはなりません。オペレーティングシステムやファイルシステムの最新のバージョンを維持することで、既知のバグやセキュリティ脆弱性を解消し、安定性を向上させることができます。これらの予防策を講じることで、Ext4ファイルシステムの障害リスクを大幅に軽減し、業務の継続性を保つことができるでしょう。

Ext4障害からの復旧の総括と今後の展望

Ext4ファイルシステムの障害は、さまざまな要因によって引き起こされる可能性がありますが、適切な理解と対策を講じることで、その影響を最小限に抑えることができます。これまでに述べたように、定期的なバックアップやファイルシステムの整合性チェックは、データ損失を防ぎ、迅速な復旧を可能にする重要な手段です。また、障害が発生した際には、専門のデータ復旧業者への依頼も選択肢となり、より高い復旧率を期待できます。 今後、IT環境はますます複雑化し、データの重要性は増す一方です。企業は、データの安全性を確保するために、継続的な教育や最新の技術への投資を行うことが求められます。これにより、障害発生時にも冷静に対応できる体制を整えることが可能となります。最終的には、データ保全に関する意識を高め、予防策を講じることで、業務の継続性と信頼性を維持することができるでしょう。

今すぐバックアップを始めよう!

データの保護は、企業にとって最も重要な課題の一つです。万が一の障害に備えるためには、今すぐバックアップを始めることが不可欠です。定期的なバックアップを行うことで、データの損失リスクを大幅に軽減できます。ローカルストレージだけでなく、クラウドサービスを併用することで、より安全なデータ保護が実現します。 また、バックアップを行った後は、復旧手順を確認し、実際に復元が可能であるかをテストすることも重要です。これにより、障害が発生した際に迅速に対応できる体制を整えることができます。データの安全性を高めるために、今すぐ行動を起こしましょう。あなたの企業の大切なデータを守るために、適切な対策を講じることが、業務の継続性を支える鍵となります。

復旧作業時の注意事項とリスク管理

データ復旧作業を行う際には、いくつかの重要な注意点とリスク管理が必要です。まず、復旧作業を始める前に、必ず現在のデータ状態をバックアップしてください。これは、復旧プロセス中に新たな損失が発生するのを防ぐためです。特に、物理的なハードウェアの故障が疑われる場合、追加の操作を行うことで状況が悪化する可能性があります。 次に、復旧ソフトウェアを使用する際には、信頼性のあるツールを選択することが重要です。信頼性の低いソフトウェアを使用すると、データがさらに損傷を受けるリスクがあります。使用する前に、他のユーザーのレビューや評価を確認し、実績のあるソフトウェアを選ぶようにしましょう。 また、復旧作業を行う際は、冷静さを保つことも大切です。焦って操作を行うと、誤った手順を踏んでしまうことがあります。特に、コマンドラインツールを使用する場合は、正確なコマンドを入力することが求められます。 最後に、復旧作業が自分の手に負えないと感じた場合は、専門のデータ復旧業者に依頼することを検討してください。専門家による適切な対応が、データの復旧率を高めることにつながります。これらの注意点を守ることで、復旧作業をより安全に進めることができるでしょう。

補足情報

※株式会社情報工学研究所は(以下、当社)は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。