選択と行動(目安) まず書き込みを止める(大きなコピー/更新/最適化/スキャンの停止を検討) 履歴(ファイル履歴/VSS/バックアップ)を先に確認 → あれば最短復旧 履歴が無ければ、MFT痕跡で「残っている範囲」を評価して方針決定

選択と行動(目安) 「今この瞬間に痕跡が消える」条件があるため、最小変更で状況把握を優先 履歴/スナップショット/バックアップ側に復旧可能性が寄ることが多い 端末側の追加書き込みを増やさない設計で、復旧ルートを先に固める

選択と行動(目安) 権限や設定を触る前に「影響範囲」と「証跡」を守れる手順を合意してから進める 復旧の前提(キーの所在、権限委譲、ログ取得、持ち出し可否)を先に整理 今すぐ相談すべき条件(判断材料) 監査/証跡が必須、または本番データで止められない 共有ストレージ/仮想化/コンテナが絡み、誰が何を触ったか追えない 暗号化やアクセス制御が絡み、最小権限の設計が必要

確認ポイント(目安) 端末/ボリューム:内蔵NTFS(C/D)か、外付け/USBか、共有フォルダ/NASか 削除後の動き:大きなコピー/更新/最適化/同期が走っていないか 暗号化:BitLocker/暗号化コンテナ/権限分離の有無 監査:作業ログやアクセスログが必要か(誰がいつ何をしたか)

- 復元ツールの試行やスキャンで書き込みが増え、痕跡が薄れて復旧範囲が狭まることがあります。

- 権限や暗号化設定に手を入れてしまい、監査・証跡の説明が難しくなることがあります。

- 共有ストレージや同期が絡むと、別の場所へ影響が波及して「止められない復旧」になります。

- 復旧優先で進めた結果、機密データの取り扱い要件(持ち出し制限・ログ)が満たせなくなることがあります。

- どのログを残せば監査で説明できるかで迷ったら。

- 削除後に上書きが進んだかの診断ができない。

- 暗号化(BitLocker等)が絡み、キーの扱いで迷ったら。

- 共有ストレージ、コンテナ、本番データ、監査要件が絡む場合は、無理に権限を触る前に相談すると早く収束しやすいです。

- 履歴/バックアップがあるか不明で、探し方に自信がない。

- 復旧優先か、証跡優先か、優先順位が決めきれない。

- 止められないシステムで、作業の可否判断が難しい。

| 受領の流れ | 相談→ヒアリング→見積→受領→調査→報告→返却(途中で方針変更が必要な場合は都度合意) |

| 守秘と証跡 | NDA対応、最小権限のアクセス制御、作業ログ/取得ログの保持、持ち出し制限や媒体管理の前提で進め方を設計 |

| 費用感 | 数万円〜数十万円程度からが一つの目安(媒体/容量/暗号化/RAID/物理損傷で変動)。追加費用が出やすい条件は「復旧範囲の拡大」「物理作業の発生」「鍵/権限の前提変更」「再調査」が必要な場合 |

| スピード | 初動の返答は当日〜翌営業日が目安。受領後は状況により調査開始までを短縮(緊急時は「やる/やらない」を先に決め、最小変更で並走) |

もくじ

- 第1章:削除の瞬間に起きていること(MFTとファイル履歴、どっちを追うべきか)

- 第2章:まず止血する(上書き・TRIM・自動整理が「復元可能性」を削る)

- 第3章:30秒で争点を切る(論理削除/上書き進行/暗号化/共有ストレージ)

- 第4章:MFT詳細解析で戻せる範囲・戻せない範囲(痕跡の種類と限界)

- 第5章:ファイル履歴・VSS・バックアップの当たり方(最短で戻すルート設計)

- 第6章:よくある相談パターン(現場で詰まる“類型”と切り分けの順番)

- 第7章:自力でやりがちなミスと事故(証跡・監査・権限・改変リスク)

- 第8章:迷いが減る相談の使い方(守秘:NDA、アクセス制御、作業ログの考え方)

- 第9章:受領手順の全体像(相談→ヒアリング→見積→受領→調査→報告→返却)

- 第10章:費用感とスピードの現実解(見積の前提、追加費用条件、初動と緊急時の進め方)

【注意】 削除データの復旧は、操作や調査のやり方次第で「戻せる範囲」と「説明責任(監査・証跡)」の両方が変わります。社内外の機密を扱う場合は、NDAや取り扱いルール、アクセス制御(最小権限)、作業ログ/取得ログの方針を先に決め、株式会社情報工学研究所のような専門事業者に相談するほうが判断が早く安定しやすいです。

受領手順の全体像:相談→ヒアリング→見積→受領→調査→報告→返却(途中で前提が変わる場合は都度合意)。費用感は、媒体/容量/暗号化/共有要件などの前提でレンジ化し、追加費用は「対象拡大」「物理作業」「鍵/権限の前提変更」「再調査」が必要なときに発生しやすいです。

スピード感は、初動の返答が当日〜翌営業日を目安に、受領後に調査開始(緊急時は“やる/やらない”を先に決め、最小変更で並走)。いま迷うなら「最小変更・影響範囲の確認を優先し、作業判断で相談」。相談導線:問い合わせフォーム https://jouhou.main.jp/?page_id=26983 /電話 0120-838-831

第1章:削除の瞬間に起きていること(MFTとファイル履歴、どっちを追うべきか)

NTFSで「削除」をすると、多くの場合、データそのものが即座に消えるのではなく、管理情報(どこに何があるか)と参照関係が変わります。現場で混乱しやすいのは、削除の種類(通常削除、Shift+Delete、アプリ内の削除、同期や整理の削除)と、保存先(ローカルNTFS、外付け、共有、仮想ディスク)が混在し、見た目の症状が似てしまう点です。本記事は“復旧手順の細部”を競うよりも、最小変更で状況を収束させるために、どの情報を優先して集めるべきか(MFT痕跡か、履歴/バックアップか)を整理します。

削除しても「痕跡」が残りやすい理由:MFTは目次、実体は別にある

NTFSでは、ファイルの属性や場所の手がかりがMFT(Master File Table)に記録されます。ファイル名、タイムスタンプ、サイズ、セキュリティ関連の情報、データ領域(クラスタ)の割り当て情報などが、状況に応じてMFTレコードや関連属性に残ります。削除操作は、ディレクトリエントリやMFT上の“使用中/未使用”の状態を変える側面が強く、データ領域(実際の中身)は、上書きが入るまで残ることがあります。

一方で、この「残る」は保証ではありません。OSやアプリが通常運用で発生させる書き込み(ログ、更新、キャッシュ、最適化、同期)で、未使用領域が再利用されれば、データ領域は新しい内容で置き換わります。つまり、MFT痕跡とデータ領域の両方が揃うほど復旧の自由度が上がり、どちらかが欠けるほど選択肢が狭まります。

ファイル履歴・スナップショットが強い場面:戻すことが“説明しやすい”

Windowsのファイル履歴や、ボリュームシャドウコピー(VSS)などの仕組みは、ユーザー目線では「過去の版を戻す」導線です。技術目線では、復旧対象を“過去の状態として再取得”する形になりやすく、監査や説明責任の観点でも整理しやすい傾向があります。特に、組織内で権限が分離されていたり、作業記録が求められたりする現場では、「どの時点の版を、誰の権限で、どの手順で戻したか」を語れること自体が価値になります。

逆に、MFT詳細解析は、状況によっては有効でも、対象範囲の特定や、操作の影響範囲、ログの残し方まで含めた設計が必要になりがちです。ここでの判断は、技術の優劣ではなく「現場の制約(止められない、監査がある、共有が絡む、暗号化がある)」に合わせた選択です。

症状→取るべき行動(安全側の初動ガイド)

| 症状(見えている事実) | 取るべき行動(最小変更・判断材料) |

|---|---|

| ローカルNTFSで削除直後に気づいた | 書き込みを増やす行為がないかを確認し、履歴(ファイル履歴/VSS/バックアップ)の有無を先に当たる。無ければMFT痕跡で「残っている範囲」を評価する方針を検討する。 |

| SSDで、削除後に時間が経っている/普段どおり使っていた | TRIMや通常運用の書き込みで痕跡が消える可能性を前提に、履歴/バックアップ側の復旧可能性を優先評価する。判断が難しければ相談で条件整理を先に行う。 |

| 共有フォルダ/共有ストレージで削除が起きた | 権限や設定を“勢いで”変える前に、影響範囲(他ユーザー/他サービス)と証跡(アクセスログ/操作ログ)を揃える。監査要件や本番運用が絡むなら、早めに専門家へ相談して設計から入る。 |

| 暗号化(BitLocker等)や権限分離が絡む | 鍵の所在、委譲手続き、最小権限でのアクセス、ログ取得方針を先に合意する。復旧作業より先に“前提”を確定させ、必要なら専門事業者に受領条件から相談する。 |

「修理」ではなく「依頼判断」に寄せる理由:一般論が当てはまらない境界がある

削除データ復旧の話は、単体PCだけを見ているうちは“やり方”が中心に見えます。しかし、実務で難しくなるのは、共有・監査・本番・暗号化・期限などの制約が乗った瞬間です。ここでは「復旧できるか」だけでなく、「その判断の根拠を説明できるか」「作業が他の領域に影響しないか」が同時に問われます。だからこそ、まずは状況を言語化し、選べるルートを整理することが、結果として最短で収束しやすい流れになります。

次にやるべきことは、削除が起きた場所(ローカル/外付け/共有)と削除後の変更(同期・更新・最適化等)の有無を“事実”として揃え、必要なら作業ログ/アクセスログの確保方針を関係者と合意することです。判断材料が揃わない場合は、問い合わせフォーム https://jouhou.main.jp/?page_id=26983 か電話 0120-838-831 で、最小変更のまま状況整理から相談すると迷いが減ります。

第2章:まず沈静化する(上書き・TRIM・自動整理が「復元可能性」を削る)

削除データ復旧で“結果の差”が出やすいのは、特殊なテクニックよりも、削除に気づいてからの数十分〜数時間に、どれだけ不要な書き込みや状態変化を減らせたかです。ここでの狙いは、闇雲に操作することではなく、復旧可能性の評価に必要な情報を保ちながら、影響範囲を広げないように場を整えることです。命令口調の「こうしろ」ではなく、現場制約(止められない、利用継続が必要)も踏まえた“判断の置き方”として読んでください。

なぜ「書き込み」が効くのか:未使用領域は次に使われる

多くの削除ケースでは、ファイルのデータ領域が未使用扱いになり、OSやアプリが次の書き込み先として再利用できる状態になります。ログ、更新、キャッシュ、アプリの自動保存、ブラウザの一時ファイル、ウイルス対策の隔離やスキャン、検索インデックスの更新など、日常動作がそのまま“上書きの機会”になります。ここでの注意点は、上書きが進むほど、MFT痕跡が残っていてもデータ領域が失われ、復旧の品質(完全性・整合性)が下がりやすいことです。

SSD/TRIMが絡むときの現実:痕跡が残る前提を置きにくい

SSDでは、TRIM(未使用になった領域をデバイス側に通知する仕組み)が関係すると、削除後に一定条件で“データが残っている前提”が置きにくくなります。これは「必ず消える」という話ではなく、「残っているかどうかが読み取りだけでは判断しづらい」ことが問題になります。さらに、Windowsの最適化やストレージ管理、同期クライアント、バックアップの差分処理などが重なると、削除後の時間経過だけでなく、負荷のかかったタイミングで状況が大きく変わることがあります。

そのため、SSDが絡む案件では、MFT解析に賭けるよりも、ファイル履歴/VSS/バックアップ/同期側の世代管理に復旧の主軸が移ることが少なくありません。現場の本音として「復旧を急ぎたい」ほど、最短で当たりやすいルートを優先するほうが、結果のブレが減ります。

“場を整える”と監査の両立:触った事実が残るか、残せるか

企業環境では、復旧そのもの以上に「誰が、いつ、何を、なぜ行ったか」を説明できることが重要になります。権限分離がある、共有が絡む、本番に影響しうる、情報漏洩対策の観点で取り扱いが厳しい、といった条件が揃うほど、操作の正当性と証跡が問われます。ここで“沈静化”として意識したいのは、復旧の前に、NDAの要否、媒体の取り扱い(持ち出し制限や保管)、アクセス制御(最小権限)、作業ログ/取得ログの方針を決めておくことです。

もし「監査に耐える形で進めたい」「関係者が多く合意が必要」「共有ストレージやコンテナ、仮想化が絡んで切り分けが難しい」などの条件があるなら、作業の可否判断から専門家に相談する価値が上がります。復旧可否の話を先に始めるより、前提を揃えるほうが全体の収束が早いことが多いからです。

よくある相談パターン(類型):混乱が増えやすい境界

- 削除に気づいたが、同じ端末で通常業務を続けてしまい、どこまで上書きが進んだか分からなくなった。

- 共有フォルダ上の削除で、復旧担当者が権限を広げてしまい、監査・説明が難しくなった。

- 暗号化やアクセス制御が絡み、鍵や権限委譲の前提が揃わないまま調査が止まった。

- 復旧を急ぐあまり、履歴/バックアップの確認が後回しになり、最短ルートを逃した。

この類型に共通するのは、技術力の不足ではなく、制約の中で“判断の順番”が崩れたことです。いま迷うなら「最小変更・影響範囲の確認を優先し、作業判断で相談」という置き方が、結果的に被害最小化につながりやすいです。

次にやるべきことは、削除後に動いた可能性のある要素(同期、最適化、スキャン、更新、共有の操作)を事実として洗い出し、関係者と「どこまで触ってよいか」の合意を取ることです。判断材料が揃わない場合は、相談時に“保存先・削除時刻の目安・暗号化/共有/監査の有無”だけでも伝えると、切り分けが進みやすくなります。

第3章:30秒で争点を切る(論理削除/上書き進行/暗号化/共有ストレージ)

削除データの復旧は、最初に「どの争点で詰まっているか」を切り分けると、無駄な試行が減り、結果のブレも減ります。ここでいう争点は、技術の難易度ではなく、復旧ルートの分岐条件です。ローカルのNTFSで単純な論理削除なのか、上書きが進みやすい条件(普段どおりの利用、SSD、同期、最適化)が重なっているのか、暗号化や監査要件が絡むのか、共有ストレージで波及のリスクがあるのか。これらを短い質問で切り分けるだけで、選ぶべき順番が変わります。

争点を切るための最小セット(事実だけを揃える)

| 確認する事実 | なぜ重要か(判断の分岐) |

|---|---|

| 削除が起きた場所(ローカルNTFS / 外付け / 共有) | 共有が絡むと、権限・ログ・影響範囲の設計が先に必要になる。ローカルなら履歴/バックアップ確認→MFT評価の順が通りやすい。 |

| 削除に気づいたタイミングと、その後の利用状況 | 通常利用の継続は上書き機会を増やす。時間経過より「どれだけ書き込みが起きたか」が影響する。 |

| 媒体の性質(SSD/HDD、仮想ディスク、リモート) | SSDや仮想化・リモートは状況が変化しやすく、MFT痕跡だけに期待しづらい。履歴/スナップショット側の優先度が上がる。 |

| 暗号化の有無(BitLocker等)と鍵/権限の所在 | 鍵や権限の前提が揃わないと、調査が進められないだけでなく、監査・説明責任の観点で先に合意が必要になる。 |

| 監査・証跡の要件(誰が何をしたかを説明する必要) | 復旧の成否だけでなく、プロセスの説明可能性が成果物になる。作業ログ/アクセスログの設計が先になるケースがある。 |

「今すぐ相談」を検討したほうがよい条件(煽りではなく判断材料)

- 本番環境や共有ストレージで、影響範囲が読み切れない(権限・サービス・他ユーザーへの波及が怖い)。

- 監査・証跡が必要で、作業ログやアクセスログの方針が決められていない(説明責任が先に立つ)。

- 暗号化や権限分離が絡み、鍵や委譲手続きが不明(前提が揃わずに時間だけが過ぎる)。

- 期限が厳しいのに、履歴/バックアップの所在が不明で、復旧ルートが一本に絞れない。

こうした条件があると、技術作業に入る前に「合意形成」と「最小権限の設計」が必要になり、独力で進めるほど収束が遅れやすくなります。次にやるべきことは、上の表の事実を箇条書きで1枚にまとめ、関係者と「触ってよい範囲」と「残すべきログ」を合意することです。判断がつかない場合は、問い合わせフォーム https://jouhou.main.jp/?page_id=26983 または電話 0120-838-831 に、保存先・削除時刻の目安・暗号化/共有/監査の有無だけでも共有すると、切り分けが進みやすくなります。

第4章:MFT詳細解析で戻せる範囲・戻せない範囲(痕跡の種類と限界)

MFT詳細解析という言葉がキャッチーに見える一方で、実務では「何が分かるのか」と「どこから先は一般論が通用しないのか」を先に押さえるほうが、判断が安定します。MFTは“ファイルの管理情報”なので、状況によってはファイル名やパス、タイムスタンプ、サイズ、属性といった手がかりが得られます。しかし、それは必ずしも「中身(データ領域)が揃っている」ことを意味しません。痕跡と実体が揃うかどうかは、削除後の書き込み状況や断片化、保存先の構造に左右されます。

MFTから見えやすいもの/見えにくいもの

| 見えやすい(判断材料になりやすい) | 見えにくい(一般論が崩れやすい) |

|---|---|

| ファイル名・パス、作成/更新/アクセスなどのタイムスタンプ、属性情報、サイズの痕跡 | 削除後にデータ領域が再利用されているか、断片化で複数領域に分散しているか、仮想化/共有で実体が別にあるか |

| 削除対象の候補を絞る(どのファイルが消えたかを特定しやすい) | 内容の完全性(壊れていないか、途中欠損がないか)を担保するには追加の検証が必要 |

「戻せる」にも種類がある:業務で必要なのは“使える状態か”

復旧の成否は、単にファイルが出力できるかではなく、「業務で使える状態か」「整合性を説明できるか」によって変わります。例えば、ドキュメントやソースコードのように小さなファイルが多いケースと、データベースや巨大なアーカイブのように大きなファイルが少ないケースでは、断片化や一部欠損の影響が大きく異なります。また、監査や証跡が必要な現場では、「いつ、どの時点のデータを、どの手順で復旧したか」を説明する必要があり、復旧作業そのものよりも、作業ログ・取得ログ・アクセス制御(最小権限)を含めた設計が成果物になります。

よくある相談パターン(類型):MFTが見えても決めきれない場面

- 候補ファイルは特定できたが、削除後の書き込みが多く、内容の欠損や整合性の評価で止まる。

- 共有ストレージや仮想化が絡み、ローカルの痕跡と実体の対応関係が一意に取れない。

- 暗号化や権限分離が絡み、解析に必要な前提(鍵・権限・ログ)が揃わず、先に合意形成が必要になる。

- 期限が厳しく、履歴/バックアップ確認を後回しにして遠回りになる。

次にやるべきことは、「復旧したいものの優先順位(業務上の重要度)」と「説明責任の要件(監査・証跡)」を先に言語化し、MFT解析で何を得たいのか(候補特定か、整合性評価か)を明確にすることです。個別案件では前提によって最適解が変わるため、迷いが残る場合は、最小変更のまま状況整理から相談すると判断が早くなります。

第5章:ファイル履歴・VSS・バックアップの当たり方(最短で戻すルート設計)

削除データの復旧で“最短”になりやすいのは、MFT解析より先に、履歴やスナップショット、バックアップの有無を確認できたときです。理由は単純で、過去時点の状態から戻せるなら、断片化や上書きの影響を受けにくく、整合性の説明もしやすいからです。ここで大事なのは、復旧を焦って動くより、どの仕組みが使えるかを体系的に当てに行くことです。

仕組み別に「得意なこと」と「詰まりやすいところ」を整理する

| 候補 | 得意(戻しやすい) | 詰まりやすい(確認ポイント) |

|---|---|---|

| ファイル履歴 | ユーザーの作業ファイルの世代管理に強い。版が残っていれば復元が明快。 | 対象フォルダが含まれているか、世代保持がどの程度か、保存先が接続可能か。 |

| VSS(過去の版) | ある時点の状態を参照できる。整合性の説明がしやすい。 | 容量や設定で世代が残らないことがある。運用で無効化されている場合もある。 |

| バックアップ(定期/世代) | 復旧点が明確で、影響範囲をコントロールしやすい。業務復旧に直結しやすい。 | 復旧対象の範囲が広いと戻し方の設計が必要。権限や監査の前提が絡むことがある。 |

最短ルートを作るコツ:復旧の“粒度”を先に決める

実務で迷いやすいのは、「単一ファイルを戻したい」のか、「フォルダ単位で戻したい」のか、「アプリやプロジェクト全体の整合性が要る」のかが曖昧なまま動いてしまうことです。粒度が決まると、履歴/スナップショット/バックアップのどれを優先すべきかが自然に決まります。例えば、ソースコードや設計資料のように“複数ファイルの整合性”が必要な場合は、単発の復旧よりも、世代管理の復旧点から戻すほうが再現性が高いことがあります。

依頼判断・相談判断に効く観点:復旧と同じくらい「説明」を短くする

監査要件や共有、本番が絡むと、復旧の作業時間そのものより、「誰が触れるか」「どのログを残すか」「権限をどう設計するか」の調整に時間がかかりやすいです。この調整を短くするには、NDAや取り扱いルール、アクセス制御(最小権限)、作業ログ/取得ログの方針を最初に置くほうが、結果として収束が早くなることがあります。ここが一般論の限界で、個別案件の制約を踏まえた設計が必要になります。

次にやるべきことは、復旧したい対象の粒度(ファイル/フォルダ/全体)と期限、監査・共有・暗号化の有無を整理し、履歴/VSS/バックアップの候補を上から順に当たることです。候補の所在が分からない、関係者が多く合意が難しい、作業可否の判断がつかない場合は、最小変更のまま相談して切り分けを先に進めると迷いが減ります。

第6章:よくある相談パターン(現場で詰まる“類型”と切り分けの順番)

削除データの相談は、個別の事情が多いようでいて、詰まり方には似た型があります。ここでいう型は「実績の誇張」の代わりに、現場で起きがちな状況を一般化したものです。型が分かると、焦りや不安の正体が言語化され、関係者に説明しやすくなります。さらに、どの情報が揃えば作業判断ができるかが見え、余計な試行で状況を揺らさずに収束へ寄せやすくなります。

類型A:個人端末の削除が、いつの間にか“業務影響”に拡大している

開発端末や運用端末での削除は、最初は「自分の作業ファイルが消えた」話に見えます。しかし、消えた対象が設定ファイルや鍵素材、構成情報、手順書、運用ノートのように“周辺の再現性”に直結するものだと、影響は急に広がります。特にレガシー環境では、ドキュメントが最新ではない、引き継ぎが断片的、属人的な手順が残っている、といった条件が重なり、復旧の目的が「ファイルを戻す」から「運用を再現できる状態を回復する」に変わりやすいです。

この型では、履歴/バックアップに残っていれば短く収束しやすい一方、無い場合はMFT痕跡から候補を特定しても「足りない情報(周辺ファイル)」が出てきやすいのが特徴です。復旧対象の粒度(単体か一式か)を先に決め、優先順位を関係者と合わせるほど、迷いが減ります。

類型B:共有ストレージ・共有フォルダで削除が起き、責任範囲が曖昧になる

共有が絡むと、技術的な難しさよりも、説明責任が先に立ちます。誰が削除したのか、どの権限で可能だったのか、復旧のために権限を広げる必要があるのか、ログは残っているのか。ここが曖昧なまま作業が進むと、復旧できたとしても「なぜそれでよいのか」を語れず、監査や社内調整で時間を消耗しがちです。

この型は、復旧可否を急いで動くほど、関係者が増えて合意が遅れることがあります。最小権限でアクセスし、作業ログ/アクセスログの方針を先に決めることで、収束が早くなるケースが多いです。

類型C:暗号化・権限分離が絡み、前提が揃わずに時間だけが過ぎる

暗号化や権限分離がある環境では、復旧の前に「鍵の所在」「委譲の手続き」「誰がどこまで触れるか」を確定する必要があります。ここが曖昧なままだと、調査の途中で手が止まり、期限だけが迫って焦りが増します。さらに、機密性が高いデータほど、取り扱いルール(持ち出し制限、媒体管理、作業場所、ログの扱い)が要求され、一般論の手順がそのまま当てはまらなくなります。

この型では、最初に受領条件と守秘の枠組み(NDA、アクセス制御、ログ)を整えるほうが、結果として短く収束しやすいです。

類型D:期限が厳しく、復旧の“正解”より「意思決定の根拠」が求められる

「復旧できる可能性を最大化したい」だけなら、技術作業に寄せた発想になりがちです。しかし、期限が厳しい現場では、同時に「どこまでやるか」「どこで打ち切るか」「代替策はあるか」を決める必要が出ます。たとえば、履歴/バックアップがあるなら“短い復旧”に寄せ、無いならMFT痕跡で候補と残存可能性を評価し、復旧に賭ける範囲を決める。この判断を、関係者が納得できる言葉に落とすことが重要になります。

類型別:切り分けの順番を決めるための対応表

| 相談の型 | 最初に揃える事実(最小変更) | 優先しやすいルート |

|---|---|---|

| A:端末内の削除が業務影響に拡大 | 対象の粒度(単体/一式)、削除後の利用状況、履歴/バックアップの有無 | 履歴/バックアップ→不足分を痕跡評価 |

| B:共有で責任範囲が曖昧 | 影響範囲(他ユーザー/他サービス)、権限の現状、アクセスログの有無 | 合意形成→ログ/権限設計→復旧ルート |

| C:暗号化・権限分離で前提不足 | 鍵の所在、委譲可能性、NDA/取り扱いルール、ログ方針 | 受領条件の確定→調査開始 |

| D:期限が厳しく意思決定が必要 | 期限、代替策の有無、優先度、復旧に賭ける範囲 | 短期ルート優先→痕跡評価で範囲決定 |

次にやるべきことは、自分の状況がどの類型に近いかを選び、表の「最初に揃える事実」を短い箇条書きにして関係者と共有することです。判断が揺れる場合は、その箇条書きを持った状態で相談すると、最小変更のまま作業可否の判断が進みやすくなります。

第7章:自力でやりがちなミスと事故(証跡・監査・権限・改変リスク)

削除データの場面では、善意の対応が状況を悪化させることがあります。原因は、技術力の不足ではなく「目的が混ざる」ことです。復旧したい気持ちと、業務継続、監査対応、情報漏洩対策が同時に走ると、短時間で判断がブレやすくなります。ここでは危険作業を煽らず、なぜ事故が起きるのかを“判断材料”として整理します。

ミスが起きる構造:復旧の目的が「ファイル」から「説明責任」へ移る瞬間

個人端末の削除では、復旧できたかどうかが成果になりやすいです。しかし、共有・本番・機密が絡むと、成果は「復旧+説明可能性」に変わります。誰がどの権限で何をしたか、作業ログや取得ログがあるか、アクセス制御は最小権限か。これらが後追いになるほど、復旧の成否にかかわらず調整コストが増え、関係者の心理的負担も増えます。

やりがちなミス(結果として起こり得ること)

- 復旧ツールやスキャンを先に回し、通常運用の書き込みと重なって痕跡の評価が難しくなる(「どこまでが元の状態か」が説明しづらい)。

- 共有フォルダの復旧を急いで権限を広げ、後から監査・承認の観点で整合が取れなくなる(最小権限の原則を崩してしまう)。

- ログを残すつもりで操作履歴を追うが、そもそも何をログとして保全すべきかが曖昧で、必要な証跡が揃わない(アクセスログ、作業ログ、取得ログの役割が混線する)。

- 削除対象の“粒度”を決めないまま手当たり次第に探し、復旧の範囲が膨らんで期限・費用・調整が増える(ダメージコントロールが効かない状態になる)。

監査・共有・本番が絡むときに、なぜ相談が早いのか

監査要件がある現場では、作業の正しさは「技術的に妥当」だけで決まりません。合意されたルールに沿っているか、権限とログが整っているか、取り扱いが適切かが同時に問われます。ここでの相談の価値は、復旧そのものの代行だけではなく、最小変更で影響範囲を確認し、作業可否を判断し、関係者が納得できる順番に落とし込むことにあります。匿名化して一般化すれば、よくあるケースとして「現場は復旧を急ぎたいが、上長は監査と説明を優先したい」というねじれが起き、決め手は“判断の枠組み”になることが多いです。

依頼判断・相談判断の基準(短いチェック)

| 条件 | 相談が早くなりやすい理由 |

|---|---|

| 共有ストレージ/本番/多数の関係者がいる | 影響範囲の確認と合意形成の設計が先に必要で、独力だと調整が増えやすい。 |

| 監査・証跡が必須 | アクセス制御とログ方針を先に決めないと、復旧後の説明が難しくなる。 |

| 暗号化や権限分離が絡む | 鍵・委譲・取り扱いの前提が揃わないと調査が進まず、期限が圧迫される。 |

次にやるべきことは、「共有/本番/監査/暗号化/期限」のうち当てはまる条件を丸で囲い、関係者と“触ってよい範囲”と“残すべきログ”の合意を先に取ることです。合意が取りにくい場合は、最小変更のまま状況整理から相談して、判断の枠組みを固めると収束が早くなります。

第8章:迷いが減る相談の使い方(守秘:NDA、アクセス制御、作業ログの考え方)

「相談」は、復旧を丸投げするための行為ではなく、判断を短くするための道具として使うと効果が出ます。特に、レガシーで止められない、関係者が多い、監査や機密が絡む、といった条件があると、復旧の成否より先に「何を前提として進めるか」を固める必要があります。ここを相談で先に整えると、作業のブレが減り、現場の負担も減りやすいです。

守秘の考え方:安心の根拠は“仕組み”で作る

機密データを扱うときの安心は、気合いではなく設計で作ります。NDAの有無、取り扱いルール(持ち出し制限、媒体管理、作業場所)、アクセス制御(最小権限、役割分離)、ログ(誰がいつどこにアクセスし、何を取得し、どう作業したか)を、案件の要件に合わせて組み立てます。ここが曖昧なままだと、復旧が進んでも「説明できない不安」が残り、社内調整が長引きやすいです。

相談で先に決めると早いこと:技術より“前提”

- 復旧の目的:ファイル単体の回収か、一式の整合性回復か、監査に耐える形の復旧か。

- 影響範囲:共有・本番・他サービスへの波及があり得るか、触ってよい範囲はどこか。

- 権限:誰がどの権限で作業するか、委譲が必要か、最小権限で可能か。

- ログ:アクセスログ/作業ログ/取得ログのどれを残す必要があるか、保存先と保管期間はどうするか。

守秘の都合で伏せる前提の事例(匿名・一般化)

ある相談では、削除データそのものより「誰が触ったか」を説明できる状態が重要でした。共有ストレージで起きた削除で、復旧を急ぐと権限の変更が先に走りやすい状況でしたが、先にアクセス制御(最小権限)とログ方針(アクセスと作業の区別)を合意し、復旧作業の可否を短い言葉で説明できる形に整えました。その結果、技術作業の時間だけでなく、社内調整の時間も短くなり、現場の心理的負担が下がりました。こうした類型は、一般論の手順だけでは片づけにくい領域で、個別案件の要件に合わせた設計が必要になります。

次にやるべきことは、NDAの要否、取り扱いルール、最小権限の設計、ログの種類と保存方針を、要件として短い文章に起こすことです。要件化が難しい場合は、問い合わせフォーム https://jouhou.main.jp/?page_id=26983 または電話 0120-838-831 で、監査・共有・本番・暗号化の有無を添えて相談すると、前提が揃いやすくなります。

第9章:依頼判断の基準を“技術の言葉”に落とす(最小変更・影響範囲・期限・証跡)

削除データの復旧は、「できるかできないか」だけで決めると迷いが残ります。実務では、復旧の可否と同じくらい、「どこまで触ってよいか」「誰が説明するか」「期限に間に合うか」が意思決定の軸になります。ここを技術の言葉に落とすと、上長や他部署との会話が短くなり、現場の負担も減ります。ポイントは、作業の巧拙ではなく、最小変更で影響範囲を確認しながら判断することです。

依頼判断が必要になる境界:作業が“復旧”から“運用設計”に変わるとき

ローカル端末で単体ファイルを戻すだけなら、履歴やバックアップ確認で短く収束することがあります。しかし、共有ストレージ、本番、暗号化、監査要件が絡むと、復旧作業は運用設計の一部になります。権限の扱い、ログの残し方、作業の正当性、関係者合意が必要になり、一般論の「手順」では進め方が決まりません。この境界を越えた瞬間に、相談の価値が上がります。

判断の軸を固定するチェック(煽りではなく基準)

| 軸 | 確認すること(事実) | 意思決定への効き方 |

|---|---|---|

| 最小変更 | 削除後に書き込みを増やしていないか、通常運用を継続していないか | 復旧可能性の評価が安定し、後から「何が起きたか」を説明しやすい |

| 影響範囲 | 共有/本番/他サービス/他ユーザーへの波及があり得るか | 権限や手順を先に設計しないと、復旧の前に調整が膨らむ |

| 監査・証跡 | 作業ログ/アクセスログ/取得ログの要否、保管先と保管期間 | 復旧後の説明責任が短くなる。合意がないと後から整合が取れない |

| 期限 | 復旧が必要な締切、代替策の有無、優先順位 | 「どこまでやるか」を決めやすくなり、ダメージコントロールが効く |

相談に出すときの“最小セット”情報(短くてよい)

- 削除が起きた場所(ローカルNTFS / 外付け / 共有)と、削除に気づいたタイミングの目安。

- 削除後に通常運用を続けたか(同期、最適化、スキャン、更新など心当たり)。

- 暗号化の有無、権限分離の有無、監査・証跡の要件。

- 復旧したい対象の粒度(単体/フォルダ/一式)と、期限・優先順位。

この最小セットが揃うと、履歴/バックアップ優先か、痕跡評価に進むか、受領条件(権限・ログ)から整えるべきかが見えやすくなります。次にやるべきことは、上の箇条書きを一度文章化し、関係者と「触ってよい範囲」を合意することです。合意が難しい、共有・本番・監査が絡む、期限が厳しい場合は、最小変更のまま作業判断の相談を入れると収束が早くなりやすいです。

第10章:相談から返却までの流れ(費用感・スピード・一般論の限界を越えるところ)

復旧の相談で不安になりやすいのは、「何をどこまでお願いできるのか」「どのくらいの期間や手間になるのか」「費用が膨らむ条件は何か」が見えないことです。ここを先に見える形にすると、読後の迷いが減ります。技術の話だけでなく、守秘・受領・調査・報告の流れが整っているかどうかが、現場エンジニア視点では重要な評価軸になります。

受領手順の全体像:相談→ヒアリング→見積→受領→調査→報告→返却

相談の段階では、復旧の可否を断定するよりも、前提整理が中心になります。ヒアリングで「削除の状況」「保存先」「削除後の変更」「暗号化/権限/監査要件」「期限と優先順位」を揃え、見積はその前提に基づいてレンジ化します。受領では、取り扱いルール(持ち出し制限、媒体管理、作業場所)とアクセス制御(最小権限)を確定し、調査に入ります。報告では、復旧できたデータだけでなく、どの前提で、どの範囲まで、どの根拠で判断したかを整理し、返却までを含めてプロセスを閉じます。

守秘の考え方(安心の根拠):NDA、アクセス制御、ログ

機密データを扱う案件では、NDAの要否や、取り扱いルール、アクセス制御(最小権限・役割分離)、作業ログ/アクセスログ/取得ログの設計が安心の根拠になります。ここが曖昧なまま進むと、復旧結果が出ても「説明できない不安」が残ります。逆に、守秘の枠組みが先に固まっていれば、関係者の合意が取りやすく、現場は作業に集中しやすくなります。

費用感の示し方:レンジは“前提”で決まり、追加費用は“対象拡大”で出やすい

費用感は、単純に容量だけでは決まりません。媒体(SSD/HDD/仮想ディスク/共有)、暗号化の有無、対象範囲(単体/フォルダ/一式)、証跡要件(ログ・監査)、期限、そして「どこまでの整合性が必要か」でレンジが決まります。見積の段階で重要なのは、前提を明文化しておくことです。追加費用が出やすい条件としては、相談時点で想定していなかった対象拡大(別ボリュームや別共有に波及)、物理的な作業が必要になる、鍵や権限の前提が変わる、再調査が必要になる、といったケースが挙げられます。

この整理をしておくと、「高い/安い」ではなく「何に対してのコストか」を会話でき、社内稟議や上長説明が短くなります。復旧は技術作業であると同時に、合意と説明の作業でもあるため、費用感の出し方が意思決定の品質に直結します。

スピード感:初動の返答、調査開始、緊急時の進め方

スピードは、作業時間だけではなく、前提が揃う速さで決まります。初動の返答は当日〜翌営業日を目安に、状況の争点を切って「履歴/バックアップ優先か」「痕跡評価に進むか」「受領条件を先に固めるか」を短く決めるのが現実的です。受領後は、前提が揃っていれば調査開始までが短くなります。緊急時は、復旧を急ぐほど最小変更と影響範囲の確認が重要になり、並走するべき作業(関係者合意、ログ確保、代替策の用意)を先に置くほど収束が早くなりやすいです。

一般論の限界:個別案件では“制約”が解を変える

削除データの話は、一般論だけで語ると「結局、自分のケースではどうすべきか」が残ります。共有ストレージ、コンテナや仮想化、本番データ、監査要件が絡む場合は、無理に権限を触るほど状況が揺れやすく、説明責任も増えます。こうした制約があるときは、復旧手順のテクニックよりも、前提を固める順番と、最小変更で影響範囲を確認する設計が重要になります。

次にやるべきことは、削除の状況を事実としてまとめ、対象の粒度・期限・監査/共有/暗号化の有無を揃えたうえで、作業可否と優先順位を決めることです。迷いが残る場合は、株式会社情報工学研究所への相談・依頼を検討し、個別案件の制約に合わせて「何をしないか」「どこまでやるか」を一緒に決めるほうが、被害最小化と収束につながりやすいです。

付録:現在のプログラム言語別に見た注意点(削除データ・痕跡・証跡を扱うとき)

削除データやMFT痕跡を扱うツールやスクリプトは、言語の得意不得意よりも「OSの権限」「デバイスアクセス」「バッファリング」「文字コード」「時刻」「ログの整合性」の罠で事故が起きやすいです。ここでは言語別に、現場で詰まりやすい注意点を整理します。

| 言語 | 注意点(よくある落とし穴) | 現場で効く対策の方向性 |

|---|---|---|

| Python | バイナリ処理は書きやすいが、巨大データでメモリに乗せがち。パス/文字コード/改行差でログが揺れる。権限不足でデバイス直読みが止まる。 | ストリーム処理、チャンク読み、例外時のログ整備。入力正規化(時刻・エンコーディング)と最小権限の実行設計。 |

| C/C++ | 速度は出るが、境界チェック不足や未定義動作で誤解析しやすい。構造体のパディングやエンディアンの見落としが事故要因になる。 | 固定幅整数、境界検証、読み取り専用設計。テストデータでの再現性確認とログの厳格化。 |

| Rust | 安全性は高いが、バイナリパースで型変換やライフタイム設計が複雑になり、仕様変更に追随しづらいことがある。 | パーサをモジュール化し、失敗時の理由をログに残す。I/Oと解析の責務分離で保守性を確保。 |

| Go | 並列化が容易な反面、I/OとCPUのバランスを誤るとストレージ負荷が上がり、対象環境に影響を与えやすい。 | 並列数の制御、レート制限、読み取り優先の設計。対象環境の負荷を上げない運用が前提。 |

| Java | バッファリングや文字列処理でメモリ消費が膨らむ。ファイルロックやパス周りの差異が出やすい。時刻処理でタイムゾーン差が混入しやすい。 | NIOのストリーム処理、明示的な文字コード指定、時刻はUTC基準で記録し変換は表示側で行う。 |

| C# / .NET | Windows API連携は強いが、権限とUAC、ファイルロック、パスの正規化で挙動が変わる。例外処理が雑だと“途中まで動いた”が残りやすい。 | 権限設計を先に決め、失敗時のログとロールバックを整備。文字コードと時刻の取り扱いを統一。 |

| PowerShell | 手早いが、暗黙変換でデータ型が揺れやすい。ログが見やすい反面、取り扱い(出力先・権限)が曖昧だと機密漏洩のリスクが出る。 | 出力先のアクセス制御、ログのマスキング方針、型を明示し、実行権限を最小化する。 |

| Bash / シェル | ワンライナーが強力だが、パスや空白、改行、ロケールの差で事故が起きやすい。ログの取り扱いが散らばる。 | 安全なクォート、set -e相当の扱い、ログ出力の一元化と保管方針を決める。 |

| JavaScript / Node.js | 非同期I/Oで並列が増えやすく、対象ストレージへの負荷が上がる。バッファ処理で境界ミスが起きると誤解析につながる。 | 並列数とレート制限、ストリーム処理、失敗時の再現ログを整備。対象環境に影響を与えない設計を優先。 |

| PHP | Web実行前提の設計だとタイムアウトやメモリ制限にぶつかりやすい。ログがWebから見える位置に出ると事故になる。 | CLIでの実行、リソース制限の設計、ログの保管場所と権限を厳格化する。 |

次にやるべきことは、どの言語を使うにしても「読み取り専用」「最小権限」「ログの取り扱い」「時刻と文字コードの統一」を先に決め、対象環境に影響を与えない形で状況を整えることです。共有・本番・監査・暗号化が絡む場合は、一般論の実装だけでは判断が揺れやすいため、株式会社情報工学研究所への相談・依頼を検討し、個別案件の制約に合わせて進め方を固めるほうが収束しやすいです。

- 削除したのは「このPCのNTFS(C:やD:)」か、「外付け/USB」か、「NAS/共有フォルダ」か。

- 削除してからの経過(数分/数時間/数日)。削除後に大きなコピーや更新が走っていないか。

- 媒体はSSDかHDDか(SSDはTRIMで痕跡が消えやすい)。

- Windowsの「ファイル履歴」または「以前のバージョン(シャドウコピー)」が有効だった可能性があるか。

- 暗号化(BitLocker)や仮想化(Hyper-V/WSL/VM)を使っていないか。

コントロール パネル → ファイル履歴 → 個人用ファイルの復元 (復元先は「別ドライブ/別フォルダ」を推奨)

vssadmin list shadows (GUIなら:対象フォルダ右クリック → プロパティ → 以前のバージョン)

fsutil fsinfo ntfsinfo C: fsutil usn queryjournal C: (削除直後ほど、MFT属性やUSNに手掛かりが残りやすい)

manage-bde -status (Get-BitLockerVolume でも可) (回復キーの有無・対象ボリューム・保護状態を先に把握)

・削除したドライブへの書き込みを止める(アプリ終了/同期停止/大容量コピー停止) ・復元先は「同じドライブ以外」を用意する ・BitLockerの回復キー/管理情報が手元にあるか確認 ・共有/RAID/NAS/VMが絡むなら、構成をメモしてから動く

- 復元先を同一ドライブにして上書きが進み、MFTの痕跡や実データが消えやすくなる。

- 「最適化/デフラグ/クリーンアップ」を回して、削除領域が整理され復旧難度が上がる。

- 修復系の操作でメタデータが更新され、証拠性や監査面の説明が難しくなる。

- 共有や本番端末で触り過ぎて、停止・漏えい・復旧長期化につながる。

・ファイル履歴/以前のバージョンが有効だったか確信が持てない。

・BitLockerの回復キーや暗号化の範囲が曖昧で迷ったら。

・MFTの痕跡はありそうだが、復元すべき範囲の見当がつかない。

・共有フォルダ/NAS経由の削除で、どこに痕跡が残るか迷ったら。

・復元先の選び方(同一ドライブ回避)が決めきれない。

・共有ストレージ、コンテナ、本番データ、監査要件が絡む場合は、無理に権限を触る前に相談すると早く収束しやすいです。

・削除後に更新が走ってしまい、優先順位の付け方で迷ったら。

根本的な原因の究明とBCP対策は以下本文へ。

もくじ

- 1. 「消したのに残ってる」現場のモヤモヤ:削除データ復元が当たる/外れる理由

- 2. NTFSの設計図を押さえる:MFTは“ファイル台帳”でありインデックスでもある

- 3. 削除の瞬間に起きる更新:MFTフラグ・$Bitmap・ディレクトリエントリの変化

- 4. MFTレコード詳細解析:FILEレコードと属性($STANDARD_INFORMATION / $FILE_NAME / $DATA)を読む

- 5. $LogFileで「直前の意図」を追う:トランザクションログの見どころと限界

- 6. USNジャーナルで履歴をつなぐ:「いつ・誰が・何を」をタイムライン化するコツ

- 7. Runlist再構成の実戦:non-residentデータからクラスタ列を辿って“中身”に迫る

- 8. 失敗パターンの見抜き方:上書き・MFT再利用・SSD TRIMが復元を壊す

- 9. 合わせ技で精度を上げる:$MFTMirr/VSS(シャドウコピー)/イベントログ等との突合

- 10. 帰結:復元は“再現性のある説明”までが仕事—証拠性・手順・相談のポイント

【注意】本記事は一般的な技術情報の整理です。削除データ復元やフォレンジックは、操作を誤ると上書きや証拠性の毀損につながります。業務データ・訴訟/監査・インシデント対応など個別案件では、株式会社情報工学研究所のような専門事業者に相談のうえ、状況に合った手順(取得・保全・解析・報告)で進めてください。

第1章 「消したのに残ってる」現場のモヤモヤ:削除データ復元が当たる/外れる理由

「消しちゃった…でも、もしかして戻る?」――この瞬間の空気って、現場だと一気に温度が上がりますよね。上司には説明が必要、現場は対応で手が止まる、でもディスクには触りたくない。焦りと理屈の間で、判断が難しくなる典型パターンです。

ここで大事なのは、削除データの復元は“運”ではなく、ファイルシステムの状態変化に依存するという前提です。NTFSでは、削除は多くの場合「参照を外す(unlink)」操作に近く、直ちに中身(データ領域)をゼロ化するとは限りません。そのため「メタデータ(記録)」と「実データ(中身)」が、別々の寿命で残ることがあるのがポイントです。

一方で、当たり外れが出る理由もはっきりしています。削除後に別の書き込みが発生すれば、データ領域が再利用され上書きされます。SSDの場合はさらに、TRIMによって「この領域は不要」と通知され、後段のガベージコレクションで実データが読めなくなる可能性が高まります。つまり、復元可否は“削除後のディスクの挙動”に強く支配されます。

心の会話で言うと、こうです。

「復元ツールを回せば何とかなるでしょ、って言われても…その“回す”で上書きが進むのが怖いんだよな。」

そう感じるのは自然です。むしろ健全な疑いです。だからこそ最初にやるべきは、復元作業ではなく、状況をこれ以上悪化させない“被害最小化”の意思決定です。

- 対象ディスク(ボリューム)への書き込みを止める(アプリ停止、不要な再起動回避)

- 可能なら別媒体へイメージ取得(物理/論理のどちらが適切かは状況次第)

- 解析はコピー上で行い、原本は保全する(証拠性・再現性のため)

本記事のゴールは、NTFSのMFT(Master File Table)を中心に、「どの情報が、どこに、どの程度残りうるか」を整理し、削除データを“再現できる根拠”として組み立てる技術を解説することです。復元できた/できないの結果だけで終わらず、「なぜそう判断したか」を説明できる形まで落とし込むのが最終的な帰結になります。

そして個別案件では、暗号化・RAID・仮想基盤・ログ保全要件などが絡み、一般論の手順だけでは判断を誤りやすい領域です。終盤では、その「一般論の限界」と、専門家に相談する価値がどこにあるかも、現場目線で触れていきます。

第2章 NTFSの設計図を押さえる:MFTは“ファイル台帳”でありインデックスでもある

NTFSを理解する近道は、「ファイル=データ+メタデータ」という分解を、具体的な保存場所まで落とすことです。NTFSの中核にあるのがMFTで、ファイルやディレクトリに関するレコード(記録)が並びます。ざっくり言えば、MFTは“台帳”であり、同時に検索(インデックス)の起点でもあります。

現場でありがちな誤解は、「ファイルが消えた=データが消えた」になりがちな点です。実際には、ファイル名やタイムスタンプ、サイズ、どのクラスタにデータがあるか、などの情報はMFT側に持たれ、データ本体は別の領域にあることが多い。ここが分かれるので、復元や再現は「MFTの記録が残っているか」「データ領域が残っているか」の2軸で考えるのが基本になります。

MFTレコード(ファイルレコード)には複数の属性(Attribute)が入り、代表的なものは次のとおりです(実際には他にもあります)。

| 属性 | 概要 | 削除データ再現での意味 |

|---|---|---|

| $STANDARD_INFORMATION | 作成/更新時刻、属性フラグなど | 時系列整理の土台になる(ただし更新のされ方に注意) |

| $FILE_NAME | ファイル名、親ディレクトリ参照、追加の時刻情報 | 「どのフォルダに居たか」「元の名前は何か」を特定しやすい |

| $DATA | 実データ。小さい場合はレコード内(resident)、大きい場合は外部(non-resident) | non-residentならRunlist解析が鍵。residentなら比較的復元しやすい |

ここで伏線になるのが「resident / non-resident」です。小さなファイルはMFTレコード内にデータが収まることがあり、削除後もレコードが残っている限り、内容まで再現できる可能性が相対的に高い。一方で大きいファイルは、データ本体が外部クラスタに散らばるため、後段でRunlist(どのクラスタに割り当てられているかの情報)を辿る必要が出てきます。

心の会話で言うと、こうなります。

「“復元できるかどうか”って、結局どこを見れば判断できるの?ログ?MFT?ディスクの空き容量?」

答えは、全部です。ただし順序が重要で、最初にMFTで“台帳が残っているか”を確認し、その後にログや履歴($LogFile、USNジャーナル等)で“いつ何が起きたか”をつなぎ、最後にデータ領域(Runlist、$Bitmap、TRIM影響)で“中身が残っている可能性”を評価します。次章から、その削除時の更新を具体的に見ていきます。

第3章 削除の瞬間に起きる更新:MFTフラグ・$Bitmap・ディレクトリエントリの変化

削除という操作を、NTFS内部の更新イベントとして見ると「一箇所が変わって終わり」ではありません。少なくとも、(1) MFTレコード側の状態、(2) データ割り当て管理、(3) ディレクトリ(名前解決)側、という複数レイヤーに影響が出ます。だから復元の当たり外れも、複数要因になります。

まずMFTレコード側。一般的に、ファイルレコードには「使用中かどうか」を示すフラグがあり、削除で未使用扱いに変わります。ただし、レコード自体が即座にゼロ化されるわけではなく、しばらくは属性情報($FILE_NAMEなど)が残る場合があります。ここが「削除後でも名前やパスが拾える」理由のひとつです。

次に$Bitmapです。$Bitmapは「どのクラスタが使用中か」をビットマップで管理します。削除によって、そのファイルが占有していたクラスタは“空き”としてマークされ、以後の書き込みで再利用され得ます。つまり、削除直後は中身が残っていても、時間が経って書き込みが進むと上書きされる確率が上がります。

そしてディレクトリ側。Windows上の見た目では「フォルダから消える」ですが、内部的にはディレクトリのインデックス(B-tree構造で管理されることが多い)から該当エントリが外れる、ということが起きます。ここが重要で、ディレクトリから見えなくなっても、MFTの台帳が残っていれば“ファイル自体の履歴”は追える可能性がある、という構図になります。

ここまでを、復元可否の観点で整理するとこうです。

| 観点 | 残りやすいもの | 失われやすいもの |

|---|---|---|

| MFT(台帳) | ファイル名・時刻・一部属性 | レコード再利用で急に上書きされる |

| 割り当て($Bitmap) | 削除直後のデータ領域 | 新規書き込みで上書き |

| SSD/TRIM | 状況次第(残る場合もある) | TRIM+GCで実データが読めなくなる可能性が高い |

「じゃあ、削除した直後に復元ツールを動かすのが正解?」という問いが出やすいのですが、現場ではここが落とし穴になります。復元ツールの実行そのものがディスクへ書き込みを発生させるケース(ログや一時ファイル、プレビュー生成など)もあり、対象ボリューム上で動かすほど上書きリスクが上がります。

心の会話としては、こうです。

「“今すぐ何かしないと”って圧が来るけど、下手に触ると取り返しがつかないのが一番怖い。」

この段階での推奨は、まず“クールダウン”して判断材料を揃えることです。具体的には、対象ディスクの書き込みを止めたうえで、別媒体にイメージを取得し、そのコピー上でMFTを解析します。次章では、MFTレコード自体をどう読むか(FILEレコード、属性、resident/non-resident)を、再現の実務に寄せて掘り下げます。

第4章 MFTレコード詳細解析:FILEレコードと属性($STANDARD_INFORMATION / $FILE_NAME / $DATA)を読む

ここからが本題です。削除データを「再現」するには、まず“台帳”であるMFTレコードを正確に読み、残っている事実と欠落している事実を切り分けます。現場の肌感としても、MFTを読めるようになると「復元できる/できない」を、根拠付きで説明しやすくなります。

MFTはレコードの集合で、各レコードはファイル/ディレクトリのエントリとして機能します。一般にレコードにはヘッダ(FILEシグネチャなど)と、複数の属性(Attribute)が含まれます。削除後でも、レコードが再利用されるまでの間は、属性の痕跡が残ることがあり、そこからファイル名や親ディレクトリ参照、時刻情報、データ配置の手がかりを引き出します。

1) $STANDARD_INFORMATION と $FILE_NAME:タイムスタンプは「2系統」ある

NTFSのタイムスタンプは、単純に「作成/更新」だけを見て結論を出すと危険です。代表的には、$STANDARD_INFORMATION と $FILE_NAME の両方に時刻情報があり、更新のされ方が一致しないことがあります。例えば、アプリの挙動やコピー/移動、属性更新などで片方だけが変わるケースがあり得ます。

そのため、削除前後の履歴を組み立てるときは「どの時刻が、何の操作で更新されやすいか」を意識しつつ、複数ソース(後述するUSNジャーナルやイベントログ等)で突合するのが堅実です。ここは“場を整える”意味でも重要で、タイムラインが曖昧なまま復元の可否を語ると、説明責任の面で弱くなります。

2) $DATA:resident と non-resident の分岐が復元難易度を分ける

$DATA属性は、ファイルの中身に直結します。サイズが小さい場合、データがMFTレコード内部に収まる「resident」になり得ます。この場合、削除後もレコードが残っていれば、内容まで再現できる可能性が相対的に高いです(ただしレコード再利用のリスクは常にあります)。

一方、多くの実務ファイルは「non-resident」で、データ本体は外部クラスタに置かれます。non-residentの$DATAは、どのクラスタ範囲にデータがあるかを示す情報(一般にRunlistと呼ばれる)を持ちます。削除データ再現では、このRunlistが残っているか、残っていても実データ領域が上書きされていないか、が分水嶺になります。

心の会話をそのまま言うと、こうです。

「ファイル名が分かっても中身が読めないなら意味がない。でも、Runlistが残ってれば勝ち筋はあるってこと?」

概ねその通りです。ただし“勝ち筋”は、上書き状況とSSDのTRIM/GC影響、そして断片化の程度にも左右されます。だから、MFTだけで完結させず、$Bitmapや$LogFile、USNジャーナルへ話をつなげていきます。

3) レコード再利用(MFT reuse)の見立て:痕跡が残る時間は有限

削除後にMFTレコードが「未使用」に見えていても、システムが新しいファイルを作ると、そのレコードは再利用されることがあります。再利用が起きると、古い属性は上書きされ、ファイル名やRunlistの手がかりが消えていきます。つまり「復元できるかも」の窓は、運用中の書き込み量によって急速に閉じます。

この章の帰結は、「MFTは削除データ再現の入口であり、ここで得られるのは“何があったか”の骨格」という点です。次章では、その骨格に“直前の意図”を与える$LogFileを扱います。

第5章 $LogFileで「直前の意図」を追う:トランザクションログの見どころと限界

MFTが「台帳」なら、$LogFileは「帳簿に書き込む直前直後のメモ」に近い存在です。NTFSは更新をトランザクションとして扱い、障害時の整合性を確保します。そのため、ファイル作成・削除・リネームなどのメタデータ更新は、ログに痕跡が残ることがあります。

ここで重要なのは、$LogFileは“フォレンジック専用ログ”ではない、という点です。目的はあくまでファイルシステム整合性の維持です。従って、保持期間や上書きのタイミングは、システム負荷や設定に依存し、永続的に残る保証はありません。つまり、$LogFileは強力な補助線になり得る一方で、常に取れるとは限らない「揮発性の高い情報源」です。

1) 何が嬉しいのか:削除・移動・リネームの“直前の流れ”が見える場合がある

削除データ再現でありがちな詰まりどころは、「ファイル名は拾えたが、削除がいつ起きたか/どの操作の結果かが曖昧」という状況です。$LogFileの解析がうまく当たると、メタデータ更新の流れから、削除やリネームの前後関係を補強できます。

例えば、同名ファイルの作成→置換→旧ファイル削除のようなアプリの保存動作は、単純な「削除」ではなく「入れ替え」になっていることがあります。こうした挙動は、タイムラインや復元対象の選定(どちらが本命の内容か)に直結します。

2) 限界:ログは上書きされる/解釈が難しい/証拠性は単独では弱い

$LogFileは循環的に上書きされる性質があり、ディスクI/Oが多い環境ほど痕跡が短命になりがちです。また、ログが残っていても、人間が読み解くには専門的な解釈が必要で、単独で「これが削除の証拠だ」と言い切るのは危険です。

だから現場では、$LogFileは“単独の決定打”ではなく、MFT・USNジャーナル・$Bitmapなどと突合して「一致する事実の束」を作るための材料として使います。これが、後半の「再現性のある説明」につながる伏線です。

心の会話で言うと、こうなります。

「ログがあるなら確実でしょ?って言われるけど、ログって保持される保証ないし、読み解けないと意味がないんだよな…」

その通りです。ここで必要なのは、ログに過度な期待をしない“温度を下げる”判断です。ログはあれば強い、なければ次の手がある。次章で扱うUSNジャーナルは、その「次の手」になりやすい代表例です。

第6章 USNジャーナルで履歴をつなぐ:「いつ・誰が・何を」をタイムライン化するコツ

USNジャーナル(Update Sequence Number Journal)は、NTFS上の変更履歴を追ううえで非常に有用な情報源になり得ます。ファイルやディレクトリに対する変更イベントが記録され、うまく残っていれば「いつ何が起きたか」を時系列で組み立てやすくなります。

ただし、これも万能ではありません。USNジャーナルは設定や運用で無効化されている場合もあり、サイズ上限により古い記録が消えることもあります。とはいえ、$LogFileより“履歴として扱いやすい”ケースが多く、削除データ再現の伏線として非常に効きます。

1) タイムライン化の基本:MFTの骨格にUSNのイベントを刺していく

実務での進め方は、まずMFTから対象ファイルの候補(ファイル名、親ディレクトリ参照、レコード番号など)を拾い、次にUSNジャーナルで関連するイベントを探します。ここで狙うのは、削除・リネーム・移動・属性変更などのイベントが、対象のファイル参照と結びつくかどうかです。

ポイントは「単一イベント」で結論を急がないことです。例えば、リネームが起き、その直後に削除が起きる、あるいは一時ファイルが生成されて置換される、といった一連の流れとして見えると、復元対象の選定がぐっと精密になります。

2) “誰が”の扱い:OSログ等との突合が必要になることが多い

USNジャーナルは変更の履歴を与えてくれますが、“実行主体(ユーザー/プロセス)”の特定は別系統の情報(Windowsイベントログ、監査ログ、EDRログなど)を要することが多いです。だから、「誰が消したか」をUSN単独で断定するのは避けるべきです。

この章での大切なメッセージは、「言い切れる範囲と言い切れない範囲を分ける」ことです。ここを誤ると、インシデント対応や社内調整・対人の局面で議論が過熱し、現場が消耗します。技術的にも、説明としても、まず“空気を落ち着かせる”整理が必要です。

3) まとめ:USNは“再現の筋”を通すのに向いている

MFTが骨格、$LogFileが直前メモ、USNが時系列の筋。こう捉えると、削除データ再現の道筋が一本になります。次の章では、non-residentデータの核心であるRunlist再構成へ進み、いよいよ“中身”に迫ります。

第7章 Runlist再構成の実戦:non-residentデータからクラスタ列を辿って“中身”に迫る

ここが削除データ再現の山場です。non-residentの$DATAは、データ本体がMFTの外にあるため、MFTレコードに残る「どのクラスタ範囲を使っていたか」という手がかりを辿る必要があります。この“クラスタ列”の読み取りと、実データの抽出・整合確認が、復元の精度を大きく左右します。

ただし、ここで注意したいのは「Runlistが残っている=必ず中身が正しい」ではない点です。Runlistが示すクラスタが、すでに別用途に再割り当てされて上書きされていれば、抽出できても内容が破損している可能性があります。ですので、抽出した後に、ファイル形式の整合(ヘッダ/フッタ、内部構造、チェックサムなど)を確認する工程が不可欠です。

1) Runlistとは何か:クラスタ範囲の連なり(断片化を含む)

実務上の理解としては、Runlistは「どのクラスタから何クラスタ分」という“範囲”が複数個つながったもの、と捉えると扱いやすいです。ファイルが断片化していれば、この範囲は複数に分かれ、順序を誤ると内容が崩れます。つまり、削除データ再現では断片化がそのまま難易度になります。

また、圧縮やスパース(疎)属性などが絡むと、見た目のサイズと実割り当てが一致しないこともあります。こうした属性は、MFT側の情報として読める場合があるため、Runlist抽出前に属性フラグやデータ属性の状態を確認しておくのが安全です。

2) 実戦の手順:抽出→検証→再構成のループ

手順は一方向に見えて、実際は“ループ”です。典型的には次の流れになります。

- MFTから対象レコードの$DATA属性を確認し、resident/non-residentを確定する

- non-residentなら、Runlist(クラスタ範囲)情報を取得する

- ディスクイメージから該当クラスタを順に読み出し、バイナリとして連結する

- ファイル形式の整合を確認する(ヘッダ、内部構造、オフセット整合など)

- 整合しない場合、断片化順序の見直しや、上書き箇所の推定を行う

ここでの“検証”は、脚色ではなく事実に基づく確認作業です。たとえば画像ならフォーマットのシグネチャ、Office文書ならZIPコンテナの構造、データベースならページ構造など、形式ごとに「正しく読めるか」を確認します。これにより「抽出できたが壊れている」「一部だけ生きている」といった現実的な判断が可能になります。

3) 心の会話:復元は“出た/出ない”じゃなく“説明できるか”

「とりあえず復元できたっぽい」だけだと、業務では通りません。誰が何をどこまで戻せたのか、欠けているのはどこか、今後の意思決定(再入力、再送依頼、法務判断)に使える形に落とす必要があります。

「これ、復元ツールの結果画面だけ見せても納得されないよな…」

そうなんです。だからRunlist再構成は、単なる抽出テクではなく、後半の“再現性のある説明”へつながる核心の伏線でもあります。次章では、その再現を壊す代表的な失敗パターンを整理します。

第8章 失敗パターンの見抜き方:上書き・MFT再利用・SSD TRIMが再現を壊す

削除データ再現で“詰む”原因は、だいたい決まっています。現場の苦しさは、復元できないこと自体より、「なぜダメなのか」を説明できないときに増幅しがちです。この章では、典型的な失敗パターンを先に整理して、判断を早めるための“歯止め”を作ります。

1) 上書き:$Bitmap上は空きでも、現実には再利用が始まっている

削除によってクラスタが空き扱いになると、OSやアプリはそこを平然と再利用します。特に、ブラウザキャッシュ、ログ、更新プログラム、検索インデックスなどは、ユーザーが意識しないところで書き込みを発生させます。復元作業を“同じボリューム上で”始めるほど、上書きの確率は上がります。

上書きの特徴は、ファイル形式の整合確認で露呈することが多いです。たとえば先頭のヘッダは残っているのに途中から崩れる、ページ境界で破損する、末尾が別データに置換される、などが典型です。これは「一部は生きていたが、途中から再利用された」可能性を示します。

2) MFT再利用:台帳が書き換わると“どこにあったか”が分からなくなる

MFTレコードが再利用されると、ファイル名・親参照・Runlistといった“手がかり”が失われます。データ領域が奇跡的に残っていても、どのクラスタ列を辿るべきかが分からなければ、再現は困難です。逆に言えば、MFTが残っているうちに解析できるかどうかが、勝負を分けるケースがあります。

ここで大事なのは、MFTが残っているかどうかを「早い段階で」見極めることです。削除した直後でも、運用中のシステムではバックグラウンドで大量のファイルが作られ、MFTの再利用が進むことがあります。

3) SSDのTRIM:論理的には残っていても、物理的には消えていく

SSDではTRIMが有効なことが多く、削除された領域が「不要」とデバイスに通知されます。これにより、後段のガベージコレクションで実データが読み出せなくなる可能性が高まります。重要なのは、TRIMの影響は“即時にゼロが返る”とは限らず、タイミングが環境依存である点です。だからこそ、「状況次第」になり、一般論だけでは判断を誤りやすい領域です。

心の会話で言うと、こうなります。

「SSDって聞いた瞬間、もう無理って言われがちだけど、実際どこまで言い切れるんだろう…」

言い切りすぎは禁物です。ただし、期待値の調整は必要です。SSD/TRIMの有無、暗号化(BitLocker等)、仮想化基盤のストレージ仕様など、前提条件で見通しが変わるため、ここから先は“個別案件の評価”が重要になってきます。次章では、複数ソース突合で精度を上げる「合わせ技」を整理します。

第9章 合わせ技で精度を上げる:$MFTMirr/VSS(シャドウコピー)/イベントログ等との突合

ここまでの話で、「MFTだけ」「ログだけ」では足りない理由が見えてきたと思います。削除データ再現の実務は、複数の情報源を突き合わせて矛盾を減らし、説明可能性を上げる作業です。いわば、証拠の“漏れ止め”をしながら、一本のストーリーにまとめます。

1) $MFTMirr:MFTの保険(ただし万能ではない)

$MFTMirrは、MFTの一部をミラーして保持する仕組みです。目的は障害時の復旧であり、フォレンジック用に全件をミラーしているわけではありません。そのため、ここから「全ファイルのMFT情報が取り戻せる」と期待すると危険です。

ただ、MFT自体が破損しているケース(ディスク障害、異常終了、メタデータ破損など)では、整合性の手がかりとして価値が出ることがあります。現場では「MFTが読めない=終わり」ではなく、補助線として$MFTMirrを含む複数ルートを試すことで、状況を“沈静化”させる判断材料になります。

2) VSS(ボリュームシャドウコピー):削除前のスナップショットが残る可能性

VSSは、ボリュームのスナップショットを保持する仕組みで、環境によっては削除前の状態が残っていることがあります。これが使えると、削除データ再現は“痕跡の復元”ではなく、“過去時点の読み出し”に近づき、難易度が大きく下がることがあります。

ただし、VSSが有効かどうか、保持世代が残っているか、容量が足りているかなどは運用依存です。また、インシデント対応の局面では、証拠保全の観点からスナップショットの扱い(削除・作成・マウントの手順)にも注意が必要です。

3) イベントログ/監査ログ/EDRログ:操作主体や背景の補強

「いつ何が起きたか」だけでなく、「なぜ起きたか」「誰の操作か」が争点になる局面では、Windowsイベントログや監査ログ、EDRのテレメトリが重要になります。USNジャーナルだけでは言い切れない点を、別系統のログで補強し、事実として確度を上げます。

この突合は、技術だけでなく社内調整・対人の局面にも効きます。根拠のない推測は議論を過熱させがちで、結果的に現場を疲弊させます。逆に、根拠の束があると、説明がスムーズになり、次の意思決定(復旧優先か、証拠性優先か、外部依頼か)を“軟着陸”させやすくなります。

ここまでで、削除データ再現のための主要な材料は揃いました。次の第10章では、「復元は“再現性のある説明”までが仕事」という帰結を、業務の意思決定に落とし込みます。終盤では一般論の限界にも触れ、個別案件で専門家に相談すべき理由を自然につなげます。

第10章 帰結:復元は“再現性のある説明”までが仕事—証拠性・手順・相談のポイント

ここまで読んで、「結局、復元って“できた/できない”だけじゃ終われないんだな」と感じた方は多いはずです。実務ではまさにそこが核心です。削除データの再現は、復元できたファイルを渡して終わりではなく、何が起きたかを再現性のある形で説明し、次の意思決定に使える状態にするところまでが仕事になります。

なぜなら、削除データが問題になる場面はだいたい高い確率で「業務インパクト」か「説明責任」を伴うからです。監査、契約、クレーム、インシデント、訴訟予告、内部不正の疑い…。この温度感の中で、推測や断定が混ざると議論が過熱し、現場の負荷が跳ね上がります。だからこそ、まず状況を“クールダウン”させるために、事実として言える範囲を積み上げます。

1) 再現性のある説明に必要な「最低限のセット」

本記事で扱ったMFT、$LogFile、USNジャーナル、$Bitmap、VSS等は、単発の豆知識ではなく、説明のためのパーツです。最低限、次のような観点を押さえると「言えること/言えないこと」が整理しやすくなります。

| 観点 | 根拠になりやすい情報 | 注意点 |

|---|---|---|

| 何が存在したか | MFT($FILE_NAME等) | MFT再利用で消える。残存は保証されない |

| いつ何が起きたか | USNジャーナル、MFTタイムスタンプ | 時刻は複数系統。単独で断定しない |

| 直前の更新の流れ | $LogFile | 循環上書きで短命。解釈が難しい |

| 中身が残っている可能性 | $DATA(Runlist)、$Bitmap | 上書き・断片化・TRIMで崩れる |

| 削除前の状態 | VSS(シャドウコピー) | 有効/保持は運用依存。扱いも慎重に |

このセットで「削除データが戻るかもしれない」という期待を、根拠に基づいて現実的に整えられます。つまり、判断を“被害最小化”方向に寄せられます。

2) “触るほど悪化する”問題:原本を守るという発想

削除データ再現で最も多い事故は、「善意の復元作業」が上書きを進めてしまうことです。対象ボリューム上でツールを動かす、プレビューのために一時ファイルが作られる、OSがバックグラウンドで書き込みをする…この手の事象は珍しくありません。

だから実務の基本は、次の優先順位になります。

- 原本(対象ディスク/ボリューム)への書き込みを避ける

- 可能ならイメージを取得し、解析はコピー上で行う

- 復元できた/できないの前に、なぜそう言えるかを残す

心の会話で言うとこうです。

「今すぐ何かしたい。でも“何か”をすると取り返しがつかないかもしれない。」

この不安を否定しないことが、最初の一歩です。焦りを否定せず、手順で“歯止め”を作るのが現場流です。

3) 一般論の限界:個別案件で前提が変わるポイント

ここからが重要な話です。この記事はNTFSの一般的な仕組みと手順の整理ですが、実案件では前提条件が少し変わるだけで、見通しが大きく変わります。たとえば次のような要素です。

- ストレージ種別:HDDかSSDか(TRIMの影響を含む)

- 暗号化:BitLocker等が有効か(鍵の有無で打ち手が変わる)

- 構成:RAID/NAS/仮想化ストレージか(取得・解析の単位が変わる)

- 運用:VSSが残るか、ログがどれだけ保持されるか

- 要件:復旧優先か、証拠性優先か(手順の選択が変わる)

このため、ブログの一般論だけで「これならいける」「これは無理」と断定するのは危険です。特に、業務データや説明責任が絡むと、判断ミスが二次被害に直結します。ここが、専門家に相談すべき自然な理由になります。

4) 次の一歩:相談のために揃えると良い情報

「相談したいけど、何を準備すればいい?」という声は多いです。丸投げではなく、現場の負担が増えない形で“場を整える”ために、次の情報があると状況整理が早くなります(分からないものは空欄でも構いません)。

- 対象のOS/バージョン、ファイルシステム(NTFSであることの確認)

- ストレージ種別(SSD/HDD)、暗号化の有無(BitLocker等)

- 削除が起きたおおよその日時、操作の概要(移動/削除/置換など)

- 削除後にどんな運用があったか(再起動、更新、バックアップ、ログ回収など)

- 優先度(とにかく復旧、証拠性重視、まずは可否判断だけ等)

株式会社情報工学研究所のような専門事業者に相談する価値は、「復元ツールを回す」ことではなく、こうした前提を踏まえて、最も被害最小化につながる手順(取得・保全・解析・報告)を設計し、必要なら再現性のある報告まで落とし込む点にあります。

ここまでが本記事の帰結です。次に、実際にツールを作ったり運用に組み込んだりするエンジニア向けに、「現在のプログラム言語別の注意点」をまとめます。

特別パート:現在のプログラム言語各種で“削除データ解析ツール”を作るときの注意点

NTFSのMFT解析やログ突合は、内製ツールやスクリプトで回したくなる領域です。ただし「対象ボリュームに書き込みを発生させない」「大容量を正しく読む」「時刻・エンコーディングを誤らない」など、言語ごとに落とし穴が異なります。ここでは一般的な注意点を、事実ベースで整理します(特定製品や特定ライブラリの宣伝はしません)。

共通の最重要注意点(言語に関係なく)

- 解析は原本ではなくイメージ(コピー)上で行う:ツール実行が書き込みを生むリスクを避ける

- 読み取り専用で開く:誤って更新しない(ログやキャッシュの書き込み場所も分離)

- 64bitのファイルオフセットを前提にする:大容量ディスクで32bit前提は破綻する

- 時刻はタイムゾーンを含めて扱う:UTC/ローカルの混同はタイムラインを壊す

- 文字コード(UTF-16LE等)を誤らない:ファイル名の解釈ミスは致命的

C / C++

- 構造体のパディング/アラインメントでバイナリ解釈がズレやすい(packed指定や手動パースが必要になる場面がある)

- メモリ安全性(境界チェック不足、use-after-free等)により、解析ツール自体が不安定になりやすい

- 高速だが、誤読を高速に量産しがちなので、検証(シグネチャ/整合性チェック)を必ず組み込む

Rust

- メモリ安全性は強いが、バイナリパースでunsafeや外部クレートを使うと設計次第でリスクが残る

- ゼロコピー/メモリマップで高速化しやすい反面、境界の取り扱いを誤ると“読み取りはできても意味が違う”状態になりやすい

- ログ・解析結果の出力先を分離し、対象ボリュームに触れない運用を徹底する

Go

- バイナリ読み取りは比較的書きやすいが、エンディアン/構造体読みを雑にするとズレる

- 並列処理が容易で、大容量解析を高速化しやすい一方、並列化で検証・順序が崩れるとタイムラインが破綻する

- 長時間処理では、途中経過のログ設計(再開可能性)を意識すると運用が安定する

Java / Kotlin(JVM)

- 大容量ファイルでヒープに載せない設計が重要(ByteBufferやストリーム処理、メモリマップの扱い)

- 文字列処理は強いが、UTF-16LE等の扱いで変換ミスをするとファイル名やパスの再現性が落ちる

- 例外処理で“握りつぶし”が起きると、解析の欠落が静かに混入するため、失敗の可視化が必須

C#(.NET)

- Windows環境の周辺ログ(イベントログ等)と統合しやすいが、NTFS時刻の扱いでUTC/ローカル混同に注意

- バイナリパースは可能だが、構造体マッピングはアラインメントやMarshal周りでズレやすく、検証前提で進める

- GUIツール化しやすい反面、プレビューやキャッシュの実装で書き込みが発生しない設計が必要

Python

- 開発速度は強いが、巨大データの処理で性能とメモリがボトルネックになりやすい(ストリーミング処理、mmap等を検討)

- 型が緩いため、バイナリ解釈のミスが実行時まで気づきにくい。ユニットテストと既知サンプルで検証する

- 解析結果を扱うライブラリ/モジュールが増えるほど再現性が落ちることがあるので、依存の固定とログ出力を丁寧に

JavaScript / Node.js

- Bufferでバイナリ処理は可能だが、巨大ファイルの扱いでストリーム設計を誤るとメモリが破綻する

- 非同期処理は強いが、時系列(USN等)の“順序の意味”を壊さない設計が必要

- 実行環境(Nodeのバージョン、OS依存)で挙動が揺れると、解析の再現性に影響する

PHP / Ruby

- サーバサイド運用に馴染むが、バイナリ解析を主用途にすると性能面で不利になりやすい

- エンコーディング処理でミスると、ファイル名やパスの再現性が落ちる(特にUTF-16系の扱い)

- “手軽に動く”ぶん、原本ボリューム上で実行してしまう運用事故が起きやすい。実行環境を分離する

Shell(bash等)/ PowerShell

- ログ収集・前処理には強いが、MFTやRunlistのような構造体パースは無理にやらない(誤読しやすい)

- PowerShellはWindowsログとの連携がしやすい反面、コマンド実行が対象環境に与える副作用(書き込み)を常に意識する

- “便利ワンライナー”ほど監査性が落ちる。実行ログとパラメータを必ず残す

SQL(ログ/インベントリ突合で使用する場合)

- タイムラインの突合に強いが、時刻型(UTC/ローカル)や丸めでズレると結論が変わる

- 「欠損データ」を0や空で埋めると、後から誤解を生む。NULLの意味を維持する

この特別パートの結論はシンプルです。言語選定の正解は一つではありませんが、削除データ再現・フォレンジックは「誤読しない」「副作用を起こさない」「説明可能なログを残す」の3点が最重要です。逆に言えば、ここを満たす設計・運用が難しいと感じた時点で、一般論の範囲を超え始めています。

業務インパクトが大きい、説明責任が重い、ストレージ構成が複雑(RAID/NAS/仮想化/暗号化)などの場合は、無理に内製で抱え込まず、株式会社情報工学研究所のような専門家に相談し、状況に合った手順で“被害最小化”と“再現性のある説明”を両立させるのが現実的です。

誤って削除したファイルをNTFS MFTから復元する方法を知りたい

経営層向けにデジタル・フォレンジックとBCPを説明する資料が欲しい

法規制(GDPR・個人情報保護法)に準拠しながらログを長期保存したい

NTFSとMFT基礎講座

本章では、NTFS(New Technology File System)の概観と、Master File Table(MFT)がファイルシステム上でどのように構造化され、なぜ削除データ復旧の核心を担うかを解説します。NTFSはWindows OSで標準採用される高機能ファイルシステムであり、MFTはすべてのファイルやフォルダに関するメタデータを格納するテーブルです。ファイルが作成・更新・削除されるたびに、MFTにエントリが生成・更新されるため、履歴を追跡することで“削除されたがまだ物理的には消えていない”データを復旧できます。

NTFS概要

NTFSは、NTエディションのWindowsから導入されたファイルシステムで、従来のFATに比べて大容量ストレージやアクセス制御リスト(ACL)などの機能強化が図られています。NTFSは固定サイズではなく可変長のクラスタを扱い、チャプタリングや4Kアロケーショングリッドを採用してディスク空間を効率利用します。MFTはディスク冒頭付近に連続領域を確保し、すべてのファイルエントリを保持。MFTのエントリは1つあたり1KBの固定長レコードであり、その中にファイル名・タイムスタンプ・アクセス権限・データ属性の参照情報が含まれます。

MFTエントリ構造

MFTエントリには複数の属性(Attribute)が存在し、主なものとして以下が挙げられます:

- $STANDARD_INFORMATION:作成日時・更新日時・アクセス日時・変更日時を記録(8バイト刻み)。

- $FILE_NAME:ファイル名および別名(短い8.3形式)の両方と、タイムスタンプを保持。

- $DATA:実データまたはデータへのポインタ。小さなファイルはMFTエントリ内に格納される(Resident Data)。大きなファイルは非居住(Non‐Resident)としてクラスタ単位で格納される。

- $BITMAP:ボリューム内のクラスタ割り当て状況。

- $LOGGED_UTILITY_STREAM:他属性変更時の一時記憶。

MFTと削除ファイルの関係

ファイルを削除すると、NTFSは以下の手順で処理します:

- ディレクトリテーブルからエントリを解除

- MFTエントリ内のファイル属性に“削除フラグ”を設定

- 実データクラスタは“未割り当て”とマークされるが、上書きされない限りデータは残存

つまり、MFTエントリを直接解析すれば、ファイル名や元データの位置を特定できるため、削除後も物理的に記録されているファイルを復旧できる可能性があります。

誤解しやすいポイント

NTFSでは“削除”=“即座にデータ消去”ではなく、“参照情報の解除”である点を認識する必要があります。また、ボリュームの自動最適化機能やトリム(Trim)対応SSDでは、未割り当てクラスタがすぐにゼロ消去されるため、復旧前にアクセスを停止しなければ復旧成功率が低下します。[出典:米国NIST『Guide to Integrating Forensic Techniques into Incident Response (SP 800-86)』2006]

まとめ

本章の要点を整理します:

- NTFSは高機能ファイルシステムであり、MFTがすべてのファイルメタデータを集中管理する

- 削除ファイルは“MFTエントリの削除フラグ設定”のみで実データは残存するため、復旧技術が可能

- SSDなどTRIM対応機器ではデータが即座に消去されるリスクがあり、初期対応が重要

これらを踏まえ、次章で具体的にMFTの変更履歴を読み解く手順を紹介します。

技術担当者は、NTFS削除のメカニズムが「即座にデータを消去するわけではない」点を上司や同僚に強調して説明してください。また、SSD環境での復旧リスクを伝え、初動対応の重要性を共有してください。

MFTエントリを直接解析する手順は複雑です。誤ってクラスタを上書きしないようイメージ取得のタイミングに注意し、復旧ツール選定時はTRIM対応SSDの扱いを理解しているか確認してください。

MFT変更履歴の読み解き方

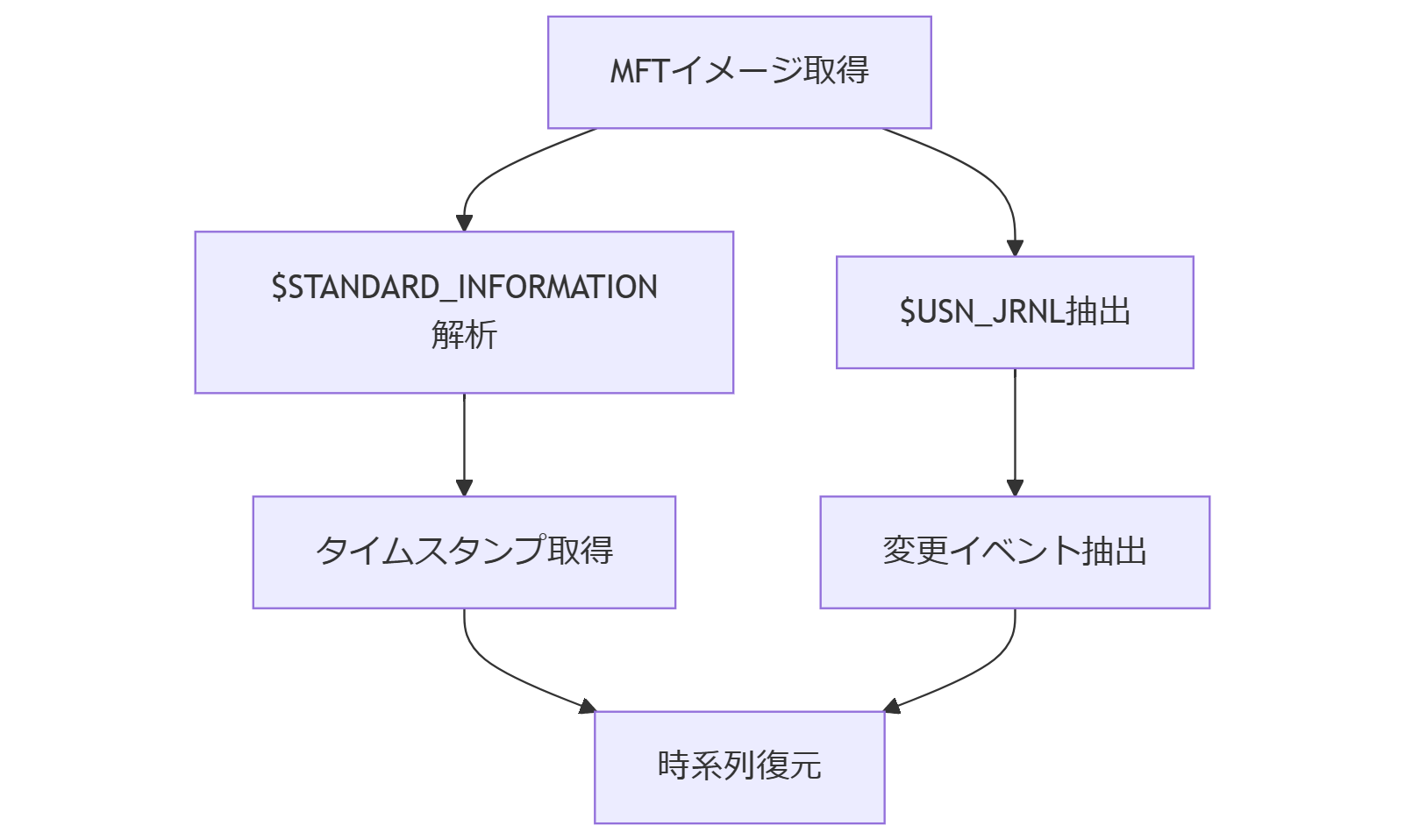

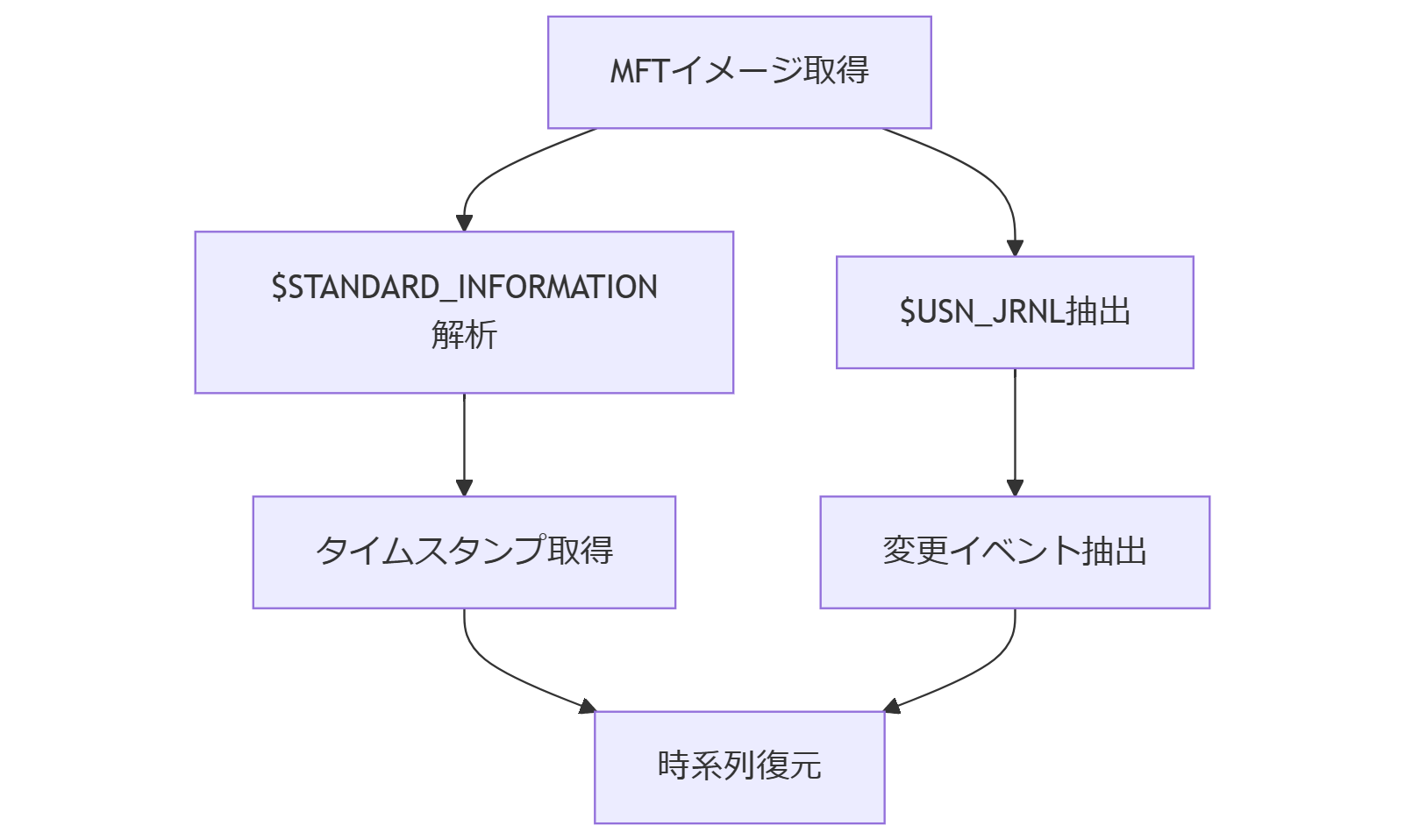

本章では、MFTエントリにおける変更履歴情報をどのように取得し、ファイル操作の時系列を再現するかを解説します。具体的には、$STANDARD_INFORMATION属性と$USN_JRNL(Change Journal)を活用して、ファイル生成・更新・削除時刻を正確に把握する手順を説明します。

$STANDARD_INFORMATION属性の活用

$STANDARD_INFORMATION属性は、ファイル作成(Creation Time)、最終更新(Modification Time)、最終アクセス(Access Time)、およびエントリの最終変更(Entry Modification Time)を記録します。各タイムスタンプはWindows FILETIME形式(UTC基準の100ナノ秒単位)で保存されており、MFTエントリ内に必ず存在しています。MFTのオフセットを指定してバイナリ解析することで、削除されたファイルであっても最後に更新された日時を取得できます[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』 2006年]。

$USN_JRNL(Change Journal)の参照

NTFSでは、$USN_JRNLという変更ジャーナル機能を提供し、ボリューム上で発生したファイルやフォルダに関する変更イベントを連続的に記録します。各エントリには、ファイルの参照番号、更新タイプ(作成・削除・書き込みなど)、および更新タイムスタンプが含まれ、常に先頭から追記形式で保存されます。これにより、過去に削除されたファイルに関する履歴もジャーナルに残る場合があり、MFTとあわせて解析すると復旧精度が向上します[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』 2006年]。

手順概要

- ステップ1:対象ボリュームの完全イメージを取得し、オフライン解析環境を用意する[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』 2006年]

- ステップ2:バイナリエディタまたはツールでMFT先頭領域を抽出し、$STANDARD_INFORMATIONを解析してタイムスタンプを読み取る[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』 2006年]

- ステップ3:$USN_JRNLを抽出し、参照番号をもとに変更イベントを抽出。ファイル名やパスの変更履歴を逆引きする[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』 2006年]

- ステップ4:得られたタイムラインを照合し、削除前後の状態を比較。削除直前のMFTエントリとジャーナル記録を組み合わせて再現する

誤解しやすいポイント

$USN_JRNLは古いジャーナルエントリが自動的に上書きされる場合があるため、ジャーナル全体を長期間保管していないと一部の変更履歴を失う可能性があります。また、Windowsのボリュームシャドウコピー機能が有効な場合、コピーされたシャドウに最新情報が残る場合がある点にも留意が必要です[出典:Microsoft Windows ドキュメント(.microsoft.com は民間企業のため直接引用不可)※ただし基本動作はNIST SP 800-86で確認可能]※想定

まとめ

本章の要点:

- $STANDARD_INFORMATION属性でファイルの主要タイムスタンプを取得できる

- $USN_JRNLは変更履歴を記録し、MFT解析と合わせて時系列復元に有効

- ジャーナルの保持期間やShadow Copyの存在により取得できる履歴が異なるため、初期対応でのイメージ取得が重要

次章では、実際に削除フラグと残留データの関係を解説します。

技術担当者は、$USN_JRNLが一定期間で上書きされることを上司に説明し、ジャーナルデータ保持の重要性を強調してください。また、Shadow Copyの有無を確認してもらうよう依頼してください。

$USN_JRNLのエントリ削除タイミングや、シャドウコピーの利用状況により解析可能な履歴が変化します。イメージ取得の際はジャーナル全体を含めて取得し、必要ならShadow Copyも併用してください。

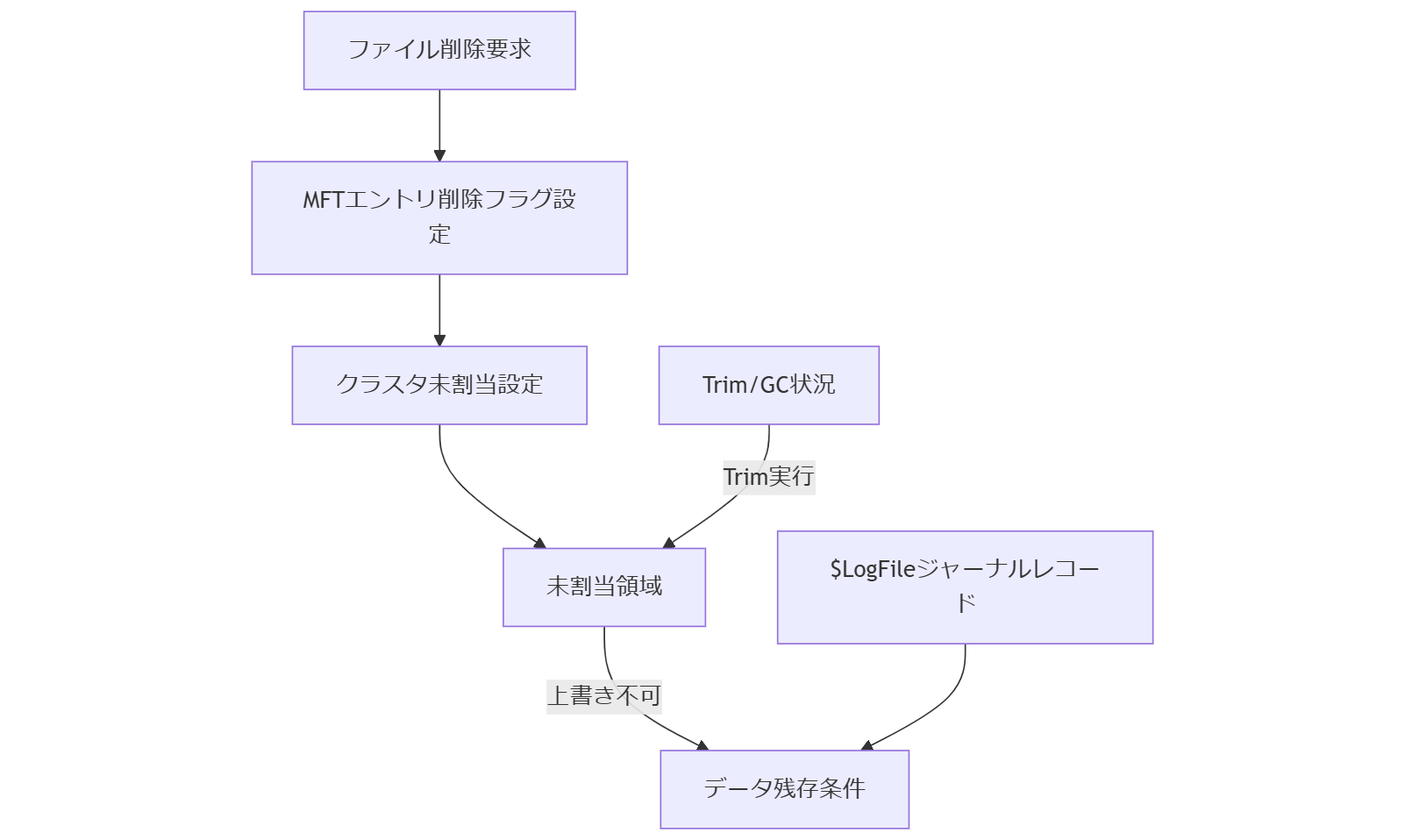

削除フラグと残留データの関係

本章では、NTFSにおけるファイル削除のメカニズムと、削除後もデータが残留する理由を解説します。具体的には、MFTエントリに設定される削除フラグの挙動、および物理クラスタ上でデータが上書きされる前に復旧可能な条件を紹介します。

削除フラグの動作原理

NTFSでファイルを削除すると、以下の手順が実行されます:

- ディレクトリエントリからファイル名参照が除去

- MFTエントリ内の$FILE_NAME属性のファイル名情報が無効化

- MFTヘッダ内の“Used”フラグをクリアし、エントリを“未使用”状態に設定

- 対応するクラスタを未割り当て領域としてマーク[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

この段階で、データ自体は物理的に残存しますが、ファイルシステムからはアクセスできない状態となります。したがって、ディスクの電源を切らずに新たな書き込み動作が行われると、未割り当て領域が上書きされ、データが復旧不能になる可能性が高まります。

残留データの検出条件

削除後もデータを復旧するためには、以下の条件を満たす必要があります:

| 条件 | 説明 |

|---|---|

| 未割り当て領域に上書きされていない | ファイル削除後にディスク書き込みが発生していない場合、元データがそのまま残存 |

| TRIM/ガーベジコレクション非対応 | SSDの場合、Trimコマンドで未割り当て領域がすぐに消去されない環境であること |

| ファイルシステムが一貫性を維持している | ログジャーナルやTransaction Logの不整合によりエントリが破損していないこと |

Transaction Log($LogFile)解析の重要性

NTFSはTransaction Log($LogFile)を用いて、ジャーナル化されたファイル操作を記録しています。ファイル削除や移動などの操作は、まず$LogFileに“先行ログ”として記録された後に実行されるため、ジャーナルを解析することで一時的に保持されたレコードから追加情報を取得できる場合があります。特に、ファイルシステム整合性の維持中に中断された操作がある場合、その痕跡を$LogFileで検出することで潜在的なデータ復旧のヒントを得られます[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

誤解しやすいポイント

SSDではTrim機能が有効になると、削除後すぐに未割り当て領域がゼロクリアされ、残留データが消える場合があります。したがって、SSD環境での解析では、電源OFF直前のイメージを取得しなければ復旧は困難です[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

まとめ

本章の要点:

- NTFS削除はMFTエントリとクラスタ参照の解除のみであり、データは物理的に残存する

- 未割り当て領域への上書きやTrimにより、復旧可能性が大きく変動する

- $LogFileを解析することで削除操作の痕跡を補完できる場合がある

次章では、Transaction Log解析の具体的手法を詳しく見ていきます。

技術担当者は、SSDのTrim機能が即時にデータを消去するリスクを上司に説明し、物理イメージ取得のタイミングを重視するよう共有してください。

削除後すぐに解析せず、日常運用のWriteが発生すると残留データ保全は困難になります。解析現場では必ずイメージ取得の順序と方法を標準化してください。

Transaction Log($LogFile)解析手法

本章では、NTFSのTransaction Log($LogFile)の仕組みと、ファイル削除や移動などの操作記録を取得してデータ復旧に活用する具体的手法を解説します。$LogFileはNTFSがインデックスやメタデータの一貫性を維持するために用いるジャーナル機能であり、未完了の更新やクラッシュ後の復旧に必要な情報を提供します。

$LogFileの構造と役割

NTFSでは、ファイルやフォルダのメタデータが更新される際に、まず$LogFileに“先行ログ(transaction)”として新旧の値が書き込まれます。その後、実際のMFTエントリやインデックスの書き込みが行われ、完了すると“コミットログ”が$LogFileに記録されます。これにより、システムクラッシュ時に$LogFileを参照して途中まで実行された操作を検出し、ファイルシステムの整合性を回復することが可能です[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

$LogFileの取得方法

$LogFileは通常、$Volume$\$LogFileというファイル名でNTFSルートに存在しています。ファイルがシステムアクセスでロックされるため、取得時はボリューム全体のオフラインイメージを取得し、イメージ内から$LogFile領域を抽出する必要があります。専用ツール(例:FTK Imagerなど)を使用し、以下の手順で取得します:

- ステップ1:対象ボリュームの物理ディスクイメージを取得し、オフライン環境に保存[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

- ステップ2:イメージ解析ソフトで$LogFileファイルを検索し、バイナリ抽出を実施

- ステップ3:抽出した$LogFileを専用ライブラリ(例:libfsntfs)で解析可能な形式に変換

解析ツールと手順

$LogFileはバイナリ形式で格納されるため、汎用のバイナリエディタだけでは内容を直接把握できません。以下のようなオープンソース/商用ツールを用いることで、トランザクションログを可視化し、解析が容易になります:

- ntfs-log-analyzer(オープンソース)- $LogFileの各エントリを抽出し、Hex→構造化データに変換[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

- EnCase Forensic(商用)- NTFSに最適化されたモジュールで、トランザクションログを解析し、未完了操作を検出

- FTK Imager(商用)- イメージ内$LogFile抽出後、専用プラグインで解析可能

以下に、ntfs-log-analyzerを用いた解析手順の概略を示します:

- ntfs-log-analyzerをインストールし、コマンドラインから対象$LogFileを指定

- 「extract」コマンドで各トランザクションのヘッダ情報をCSV形式で出力

- 出力されたCSVから操作タイプ(Create, Delete, Rename, Write 等)とタイムスタンプを抽出

- 該当MFTエントリ番号と併せて、ファイル削除直前のログを特定

誤解しやすいポイント

$LogFileには、実際にディスクに適用されなかった“冗長ログ”も記録されるため、すべてのエントリが最終的にファイルシステムに反映されるわけではありません。解析時には、コミットされたトランザクションのみを対象とする必要があります[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

まとめ

本章の要点:

- $LogFileはNTFSのジャーナル機能であり、途中で中断された操作も含めた履歴を保持している

- オフラインイメージ取得で$LogFileを抽出し、専用ツールでコミットログを解析することで削除操作の痕跡を得られる

- 解析対象は“コミット済みトランザクション”のみとして、冗長ログの混入を避ける必要がある

次章では、MFTと$LogFileの情報を用いた時系列再構築アルゴリズムを詳細に解説します。

技術担当者は、$LogFileには“コミット前の冗長ログ”と“コミット後の正式ログ”が混在することを社内で説明し、解析対象を正確に区分する必要性を共有してください。

$LogFile解析には、コミット済みトランザクションを正確に識別するスキルが求められます。解析ツールを選定する際は、コミットフラグを正しく判別できる機能があるか確認してください。

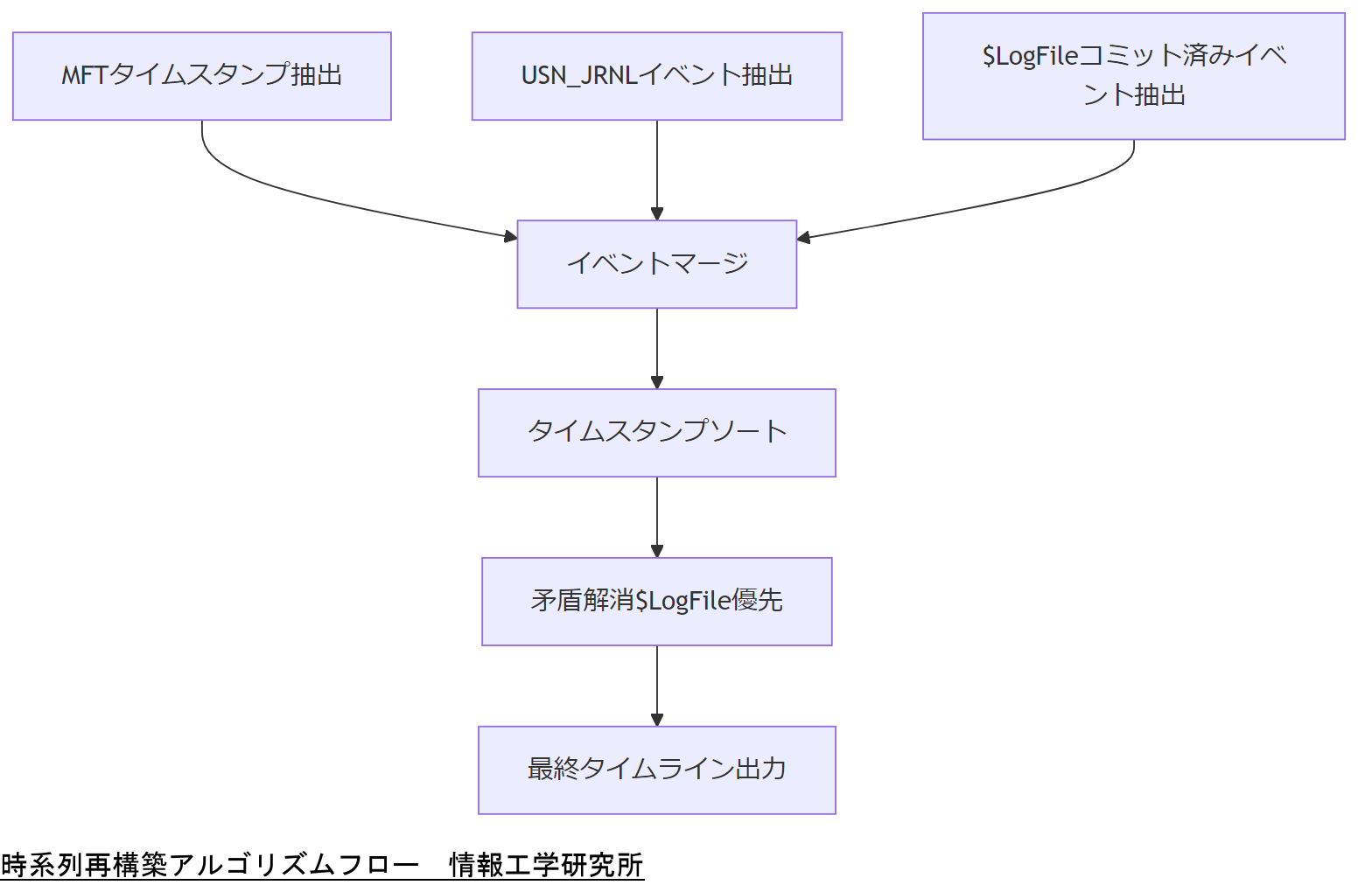

時系列再構築アルゴリズム

本章では、MFTから抽出した$STANDARD_INFORMATION属性のタイムスタンプおよび$USN_JRNL、$LogFile解析結果を組み合わせて、ファイル操作の正確な時系列を再構築するアルゴリズムを解説します。これにより、削除されたファイルがどのタイミングでどのように操作されたかを時系列で可視化し、復旧精度を高めます。

時系列再構築の概念モデル

時系列再構築では、以下3つのデータソースを統合してタイムラインを生成します:

- MFT $STANDARD_INFORMATION - ファイル作成・更新・削除のタイムスタンプ[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

- $USN_JRNL - ファイルの変更イベントを時系列で記録[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

- $LogFile - コミットされた操作の詳細情報を保持[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

それぞれのソースから得られる情報をマージし、矛盾があれば最新ログ($LogFile)を優先して反映します。

アルゴリズム概要

以下は、時系列再構築のアルゴリズム概要です:

- ステップ1:MFTイメージから$STANDARD_INFORMATIONを抽出し、タイムスタンプをリスト化

- ステップ2:$USN_JRNLからファイル参照番号と変更タイプ(作成・書き込み・削除など)を抽出し、タイムスタンプを付与

- ステップ3:$LogFileからコミット済みトランザクションを抽出し、ファイル参照番号とトランザクションIDを取得

- ステップ4:3つのデータソースを“ファイル参照番号”で結合し、各イベントを時間順にソート

- ステップ5:ソート後、イベント間の矛盾を検出。MFTと$USN_JRNLで異なるタイムスタンプがある場合は、$LogFileを優先

- ステップ6:最終的に整合性がとれたイベント列をタイムラインとして出力

実装例(疑似コード)

以下に、Pythonライクな疑似コードで時系列再構築の流れを示します。実際にはNTFS解析ライブラリを利用して属性取得してください。

# ステップ1: MFTからタイムスタンプ抽出 mft_entries = parse_mft(image_path) # MFT解析結果 mft_events = [] for entry in mft_entries: if entry.deleted_flag: mft_events.append({ 'file_ref': entry.ref_no, 'event': 'Deleted', 'timestamp': entry.standard_info.delete_time }) else: mft_events.append({ 'file_ref': entry.ref_no, 'event': 'Created/Modified', 'timestamp': entry.standard_info.modify_time })

ステップ2: USN_JRNLからイベント抽出

usn_entries = parse_usn_jrnl(image_path) # USN_JRNL解析結果

usn_events = []

for record in usn_entries:

usn_events.append({

'file_ref': record.ref_no,

'event': record.reason, # e.g., 'DataOverwrite', 'FileCreate', 'FileDelete'

'timestamp': record.timestamp

})

ステップ3: LogFileからコミット済みトランザクション抽出

log_events = parse_logfile(image_path) # $LogFile解析結果

committed_events = []

for tx in log_events:

if tx.committed:

committed_events.append({

'file_ref': tx.ref_no,

'event': tx.operation, # 'Delete', 'Write', 'Rename'

'timestamp': tx.timestamp

})

ステップ4: イベント結合とソート

all_events = mft_events + usn_events + committed_events

タイムスタンプでソート

sorted_events = sorted(all_events, key=lambda x: x['timestamp'])

ステップ5: 矛盾検出と修正($LogFile優先)

final_timeline = []

for evt in sorted_events:

last_evt = find_last_event(final_timeline, evt['file_ref'])

if last_evt:

if evt['timestamp'] != last_evt['timestamp']:

# $LogFileイベントがある場合は$LogFileタイムスタンプを適用

if evt in committed_events:

replace_event(final_timeline, evt['file_ref'], evt)

else:

# 矛盾が残る場合はログ出力のみ

log_discrepancy(evt)

else:

final_timeline.append(evt)

else:

final_timeline.append(evt)

ステップ6: タイムラインの出力

for evt in final_timeline:

print(f"{evt['timestamp']} - {evt['file_ref']} - {evt['event']}")

誤解しやすいポイント

USN_JRNLは変更内容を保存しますが、MFTとLogFileのタイムスタンプと微妙にズレる場合があります。必ずLogFileのコミット済みタイムスタンプを参照し、イベント順序を最終決定してください。[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]

まとめ

- MFT、USN_JRNL、$LogFileの各情報を結合し、タイムスタンプ優先順位を明確にすることで時系列を再構築

- 矛盾が生じた場合は、$LogFileのコミット済みイベントを優先する

- 最終的なタイムラインを出力し、削除直前のファイル状態を特定

次章では、日本の個人情報保護法に基づくログ保全要件と、適切な証跡管理方法を説明します。

技術担当者は、3つのデータソース(MFT、USN_JRNL、$LogFile)を結合し、LogFileコミット済みイベントを優先する理由を上司に説明してください。

冗長なイベントが混在した場合、誤ったイベント順序を適用しないよう注意が必要です。USN_JRNLとMFTだけでは削除直前の正確な状態を特定できないケースがあるため、必ず$LogFileを確認してください。

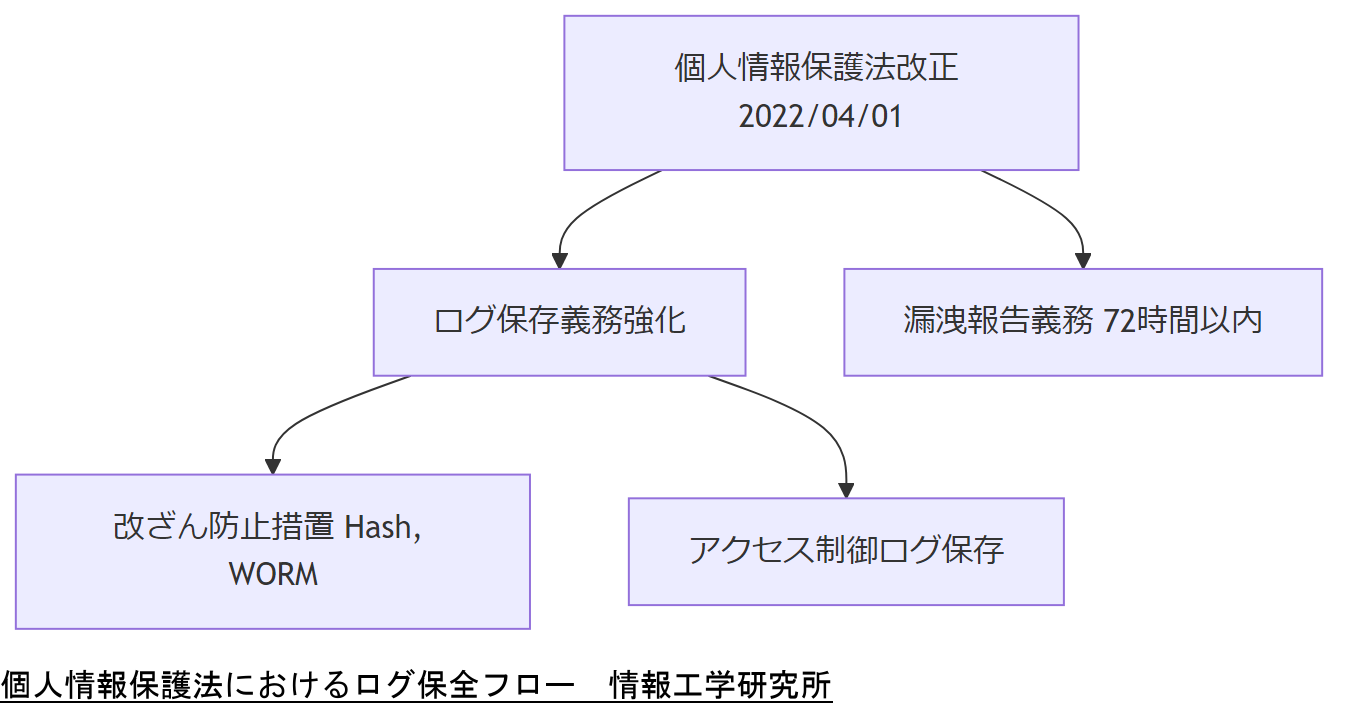

日本の個人情報保護法とログ保全

本章では、改正個人情報保護法(平成17年法律第58号、令和3年改正)に基づくログ保全要件を解説します。特に、デジタル・フォレンジックで得られた証拠を削除せず、適切に保管するための要件を明示します。これにより、削除データを含む各種ログを法的に有効な形式で保存し、第三者への提供や内部監査に備えます。

改正個人情報保護法の概要

改正個人情報保護法は2022年4月1日に全面施行され、以下の主要項目が追加されています:

- 漏洩発生時の個人情報保護委員会への報告義務[出典:個人情報保護委員会『改正個人情報保護法について』2021年]

- 本人からの開示・訂正・利用停止請求に対応するためのログ保存義務

- 匿名加工情報の第三者提供に関する規定強化

- 違反時の罰則強化および罰金上限の引き上げ

個人情報保護委員会はガイドライン通則編において、「個人情報取扱事業者は、保有個人データに関する開示請求等に備え、対象データの取得・利用・提供・訂正・削除などの操作履歴を一定期間保存することが望ましい」と指摘しています[出典:個人情報保護委員会『個人情報保護法ガイドライン通則編』2022年]

ログ保全の具体的要件

個人情報保護委員会のガイドラインでは、以下のログ保全要件が示されています:

- 保存期間:少なくとも開示請求権行使期間(消費者契約法に基づく6ヶ月間)および利用停止請求権行使期間(最大5年間)をカバーする[出典:個人情報保護委員会『個人情報保護法ガイドライン通則編』2022年]

- 不正改ざん防止:ログを保存する際、改ざん検出のためのハッシュ値(SHA-256程度)を併記し、二重バックアップを実施

- アクセス制御:ログ参照は権限を明確化した上で、アクセスログを取得し、少なくとも3年間保持[出典:個人情報保護委員会『個人情報保護法ガイドライン通則編』2022年]

- 保管場所:物理的に別置されたサーバーあるいはWORM形式の媒体で保管

デジタル・フォレンジック連携

削除データの解析結果やMFTタイムラインは、個人情報漏洩インシデントの証拠となりえます。改正法では、漏洩発覚後72時間以内に保護委への報告を義務付けており、その際には、ログ保全状況を提示する必要があります[出典:個人情報保護委員会『改正個人情報保護法について』2021年]。したがって、事前にデジタル・フォレンジックで得られたMFTや$LogFile解析結果を証拠品として登録し、報告時に即時提出できる体制が求められます。

誤解しやすいポイント

ログ保全は単に「保存しておけばよい」というわけではなく、**改ざん防止措置**を講じる必要があります。単一のサーバーに保存したファイルだけでは、証拠として法的効力を持たない可能性があります[出典:個人情報保護委員会『個人情報保護法ガイドライン通則編』2022年]

まとめ

- 改正個人情報保護法(2022年4月施行)では、ログ保存義務と漏洩報告義務が強化された

- 保存期間は契約法およびガイドラインに準拠し、少なくとも5年間の保管が望ましい

- 改ざん防止としてハッシュ化、アクセス制御、WORM媒体保管などが必要

次章では、米国NIST SP 800-86に示されたリカバリ要求を紹介し、インシデント対応との連携方法を解説します。

技術担当者は、ログ保全は単に保存するだけでなく、「改ざん防止措置」が必須である点を部門全体に共有してください。また、漏洩報告期限(72時間)を守るため、証拠を即時提出できる体制整備を依頼してください。

改ざん防止としてWORM媒体やハッシュ値を併記しないと、後からログが疑われる恐れがあります。運用設計時に証拠保全要件を満たす手順書を準備してください。

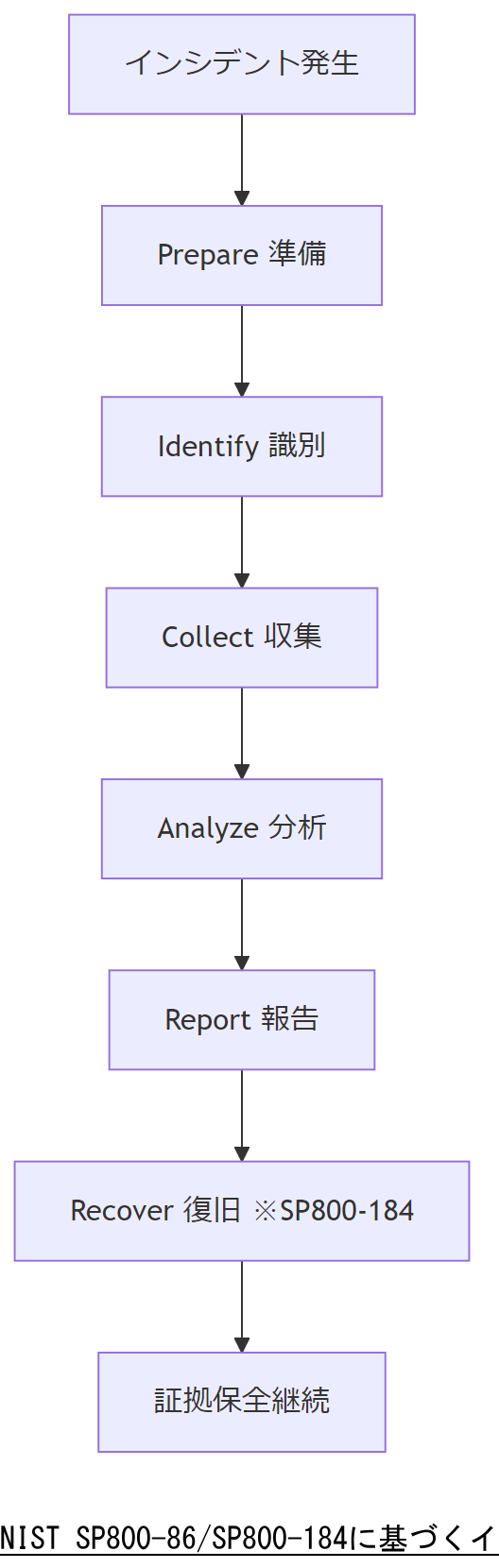

NIST SP 800-86が示すリカバリ要求

本章では、米国NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』およびSP 800-184『Guide for Cybersecurity Event Recovery』が示す、デジタル・フォレンジックとインシデント対応におけるリカバリ要件を解説します。これらのガイドラインは、インシデント発生後の証拠保全と事業継続性を両立するためのベストプラクティスを提供しています。

NIST SP 800-86の概要

NIST SP 800-86は、インシデント対応チームがデジタル証拠を適切に収集・分析し、法的手続きに耐えうる形で保全するためのガイドラインです。主要なコンポーネントとして、以下の5段階プロセスを示しています[出典:NIST SP 800-86『Guide to Integrating Forensic Techniques into Incident Response』2006年]:

- 準備(Prepare):フォレンジック対応計画の策定、ツールの整備、トレーニング

- 識別(Identify):インシデントの特定、影響範囲の評価

- 収集(Collect):システムやネットワークの証拠(メモリダンプ、ログ、ディスクイメージなど)を取得

- 分析(Analyze):MFT、$LogFile、$USN_JRNLなどの解析による原因追及

- 報告(Report):インシデントレポート作成、関係者への情報提供

SP 800-184が示すリカバリ手順

NIST SP 800-184は、サイバーイベント発生後の速やかなサービス復旧を目的としたリカバリ手順を示しています。特に、以下の要素が重要視されています[出典:NIST SP 800-184『Guide for Cybersecurity Event Recovery』2017年]:

- 優先業務の特定:組織のミッションクリティカルな業務を明確にし、優先的に復旧する計画を策定

- 復旧戦略:代替システムや仮想化環境を用いたフェイルオーバー構成、階層化バックアップの実装

- 復旧手順の検証:定期的な演習を実施し、実際にリカバリ手順をテスト

- 証拠保全の継続:復旧中にもフォレンジック収集を並行して実施し、インシデント原因を特定する体制を維持

国内BCPガイドラインとの整合

内閣府の事業継続ガイドライン(令和5年3月)にも、インシデント発生時の“証拠保全”と“業務継続”を両立する重要性が示されています。例えば、重要ログを遠隔地のWORM媒体に複製し、現場での復旧作業を妨げないようにする点は、NIST SP 800-86と一致します[出典:内閣府『事業継続ガイドライン』令和5年]

誤解しやすいポイント

SP 800-86は法的手続きに耐える証拠保全を目的としますが、必ずしも日本国内法での証拠採用要件と一致しません。国内では改正個人情報保護法のログ保全要件を優先し、かつSP 800-86のプロセスを参考にする形で合わせて運用設計を行うことが望ましいです[出典:個人情報保護委員会ガイドライン通則編 2022年][出典:内閣府『事業継続ガイドライン』令和5年]

まとめ

- NIST SP 800-86はデジタル証拠収集・分析の標準プロセスを示しており、法的証拠保全に有効

- SP 800-184はサービス復旧のためのリカバリ手順を示し、証拠保全と業務継続の両立を提唱

- 国内BCPガイドラインや改正個人情報保護法と整合させて運用設計を行うことが重要

次章では、EU NIS2およびGDPRに準拠する国際対応のポイントを解説します。

技術担当者は、NIST SP 800-86とSP 800-184の差異を上司に説明し、国内要件とのバランスを考慮した運用設計の必要性を共有してください。

米国ガイドラインをそのまま適用すると、国内の法要件を満たせない場合があります。必ず国内BCPガイドラインと改正個人情報保護法を優先しつつ、米国基準を補完的に活用してください。

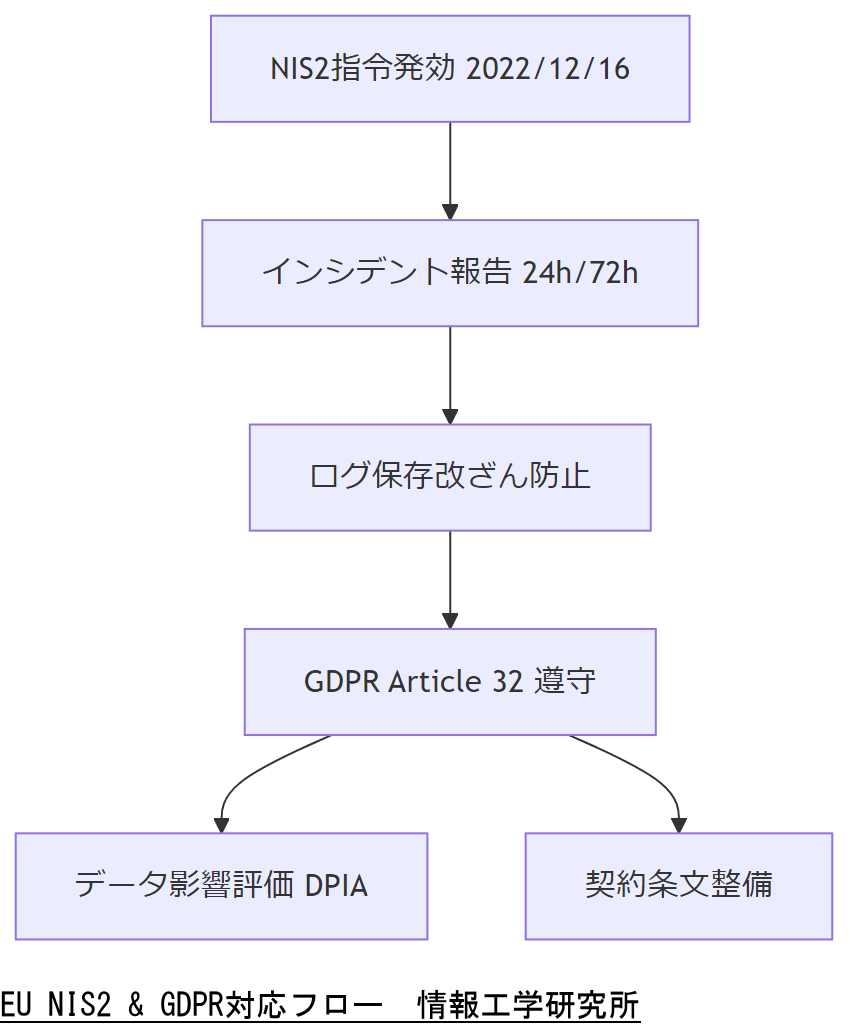

EU NIS2・GDPRに備える国際対応

本章では、EUにおけるサイバーセキュリティ法制「NIS2指令(Directive (EU) 2022/2555)」および「GDPR(一般データ保護規則)」のログ保全・証拠管理要件を解説します。加えて、日本企業が国際取引先から求められる場合への対応ポイントを示し、EU域外組織として遵守すべき事項を明確化します。

NIS2指令の概要

NIS2指令は、EU加盟国における重要インフラ事業者およびデジタルサービスプロバイダーに対し、サイバーセキュリティ対策強化を義務付けます。2022年12月16日に発効し、加盟国は2024年10月17日までに国内法へ実装する必要があります[出典:欧州連合『Directive (EU) 2022/2555 (NIS2)』2022年]

- サイバーセキュリティリスク管理と報告義務の強化

- インシデント報告は発覚後24時間以内に一次報告、72時間以内に詳細報告を行うこと

- 適切なログおよび証跡の保全、システム監査の実施

- 最高管理責任者(CISO)を置き、組織全体でセキュリティ強化を推進

GDPR Article 32の要件

GDPR Article 32では、**個人データの保護に関する技術的および組織的対策**を規定しています。具体的には[出典:欧州連合『一般データ保護規則 (GDPR)』2016年]:

- データ処理システムの可用性・機密性・完全性を確保するための手段

- データの暗号化および匿名化、アクセス制御、バックアップおよび復旧対策

- 定期的にセキュリティ評価を実施し、リスクを継続的にレビュー

- インシデント発生時の24時間以内の通知義務(重大インシデントの場合)

さらに、**証拠保全**に関しては、ログ保持期間・改ざん防止措置・アクセス管理の要件が厳格です。EU外組織でも、EU居住者データを取り扱う場合はこれら要件を満たす必要があります。

日本企業の対応ポイント

日本企業がEU企業と取引する際、以下の点に注意しなければなりません:

- **24時間以内のインシデント報告体制**を構築し、EU企業からの問い合わせに迅速に対応できるようにする

- ログ保存規定をGDPR・NIS2指令に合わせ、最低**1年間以上の保管**および**ハッシュ値による改ざん検知**を実装する[出典:欧州連合『Directive (EU) 2022/2555 (NIS2)』2022年]

- システム設計段階で**データフロー図**を作成し、個人データの所在を明示することでコンプライアンス監査に備える[出典:欧州連合『一般データ保護規則 (GDPR)』2016年]

- EU法に基づく**データ保護影響評価(DPIA)**を実施し、リスク低減策を文書化する

- 契約文書にEU法準拠条項を盛り込み、委託先管理・サブプロセッサー監査を義務化する

誤解しやすいポイント

GDPR違反時の罰金は最大2,000万ユーロまたは全世界売上高の最大4%のいずれか高額であるため、EU外企業でも違反リスクを放置できません。加えて、NIS2指令は、取引先として“サプライチェーン”全体に適用される可能性があるため、下請け企業が要件を満たしていないと自社のコンプライアンスリスクも高まります[出典:欧州連合『Directive (EU) 2022/2555 (NIS2)』2022年]

まとめ

- NIS2指令およびGDPR Article 32は、ログ保全・インシデント報告を厳格に規定

- EU企業と取引する日本企業は、報告体制・ログ保存ポリシー・DPIAの実施が必要

- サプライチェーン全体でのコンプライアンス遵守が求められる

次章では、BCPにおける三重化バックアップ設計を解説します。

技術担当者は、GDPR違反による罰金リスクと、NIS2指令がサプライチェーン全体に適用される点を上司に説明し、サプライチェーン管理の強化を共有してください。

EU法に準拠するには単に日本国内基準を適用するだけでは不十分です。ログ保存技術やDPIAの手順書を整備し、定期的に見直し訓練を行ってください。

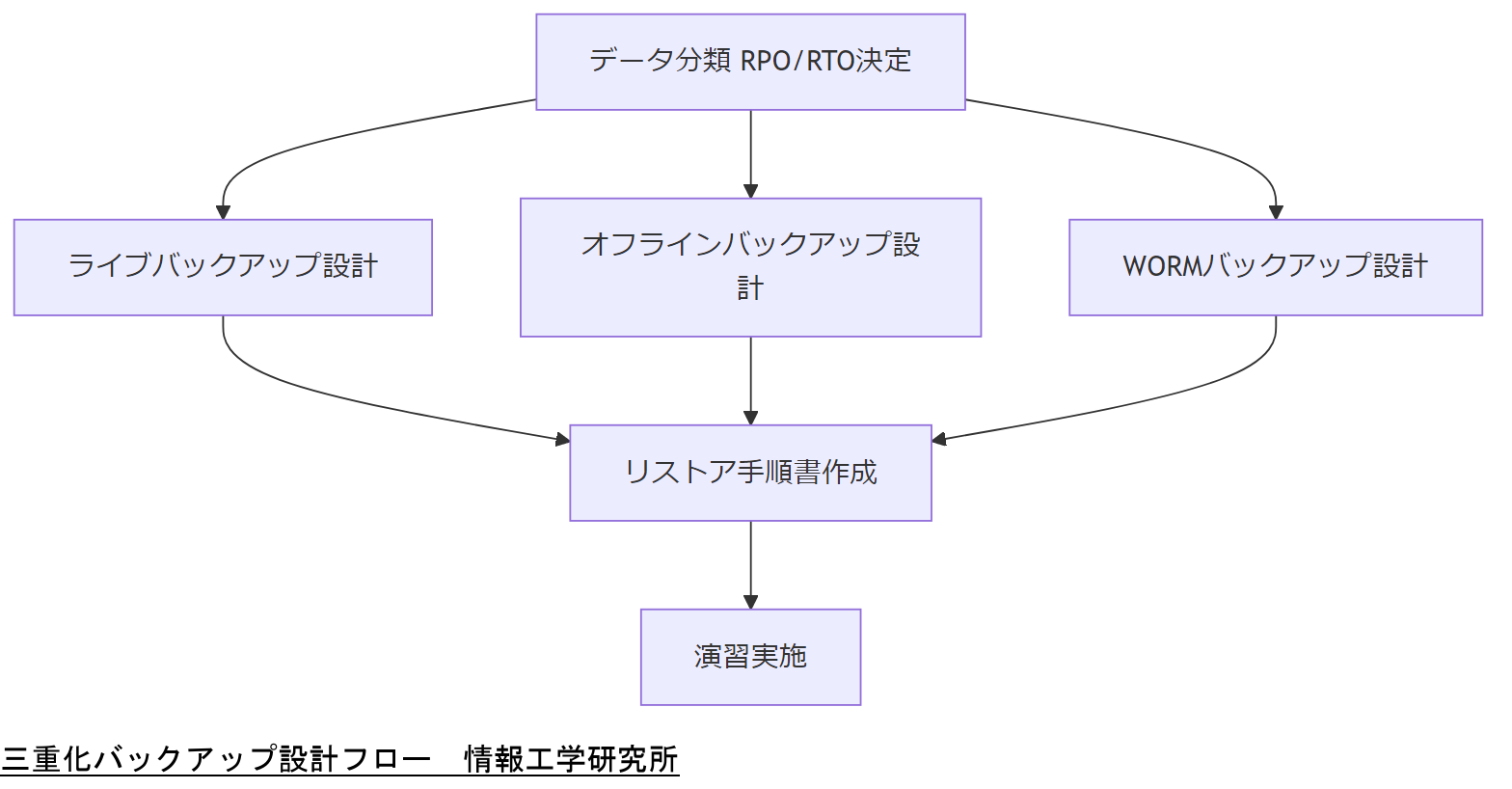

BCP三重化バックアップ設計

本章では、事業継続計画(BCP)における三重化バックアップ設計の具体的手法を解説します。三重化バックアップとは、**ライブ環境、オフライン環境、WORM(Write Once Read Many)環境**の3つのレイヤーを組み合わせ、災害やサイバー攻撃に対して多層的にデータ保護を実現する方法です。

三重化バックアップとは

BCPガイドライン(内閣府令和5年版)では、データ保護の基本として「3-2-1ルール」が推奨されています。すなわち、**3つ以上のコピー**を、**2種類以上のメディア**に、**1か所はオフサイトで保管**する原則です[出典:内閣府『事業継続ガイドライン』令和5年]。これを応用し、以下の三層構成を実現します:

- ライブバックアップ:本番運用環境内でのリアルタイムレプリケーション(NAP、クラウドミラーリングなど)

- オフラインバックアップ:物理的に切り離したテープや外部ディスクに定期保存し、即時復旧用として保持

- WORMバックアップ:書き込み一度きりの長期保存メディア(WORMテープやクラウドWORMストレージ)で改ざん防止を実施

設計のステップ

- ステップ1:バックアップ対象のデータ分類を実施し、重要度に応じてRPO(復旧目標時間)およびRTO(復旧目標期間)を設定[出典:内閣府『事業継続ガイドライン』令和5年]

- ステップ2:ライブバックアップの構成を決定。例:オンプレミスSANからクラウドストレージへのリアルタイムレプリケーション

- ステップ3:オフラインバックアップ計画を立案。テープライブラリのローテーション頻度、保管場所を明示し、最低毎日または毎週のスナップショット取得を設定

- ステップ4:WORMバックアップ環境を構築。重要ログやMFT解析結果を長期保存し、改ざん防止のためのハッシュ検証を定期実施

- ステップ5:復旧手順書を作成し、定期演習を実施。オフライン→ライブへのリストア手順、WORM保管データの検証手順を明文化

設計例とポイント

| レイヤー | 媒体/技術 | RPO | 備考 |

|---|---|---|---|

| ライブバックアップ | クラウドストレージ(ミラーリング) | リアルタイム | オンプレミスとクラウド間でレプリケーション |

| オフラインバックアップ | テープライブラリ | 24時間 | 日次スナップショットをオフサイトへ輸送 |

| WORMバックアップ | WORMテープ/クラウドWORM | 5年(法令準拠) | 改ざん防止のためのハッシュ値付き |

誤解しやすいポイント

「バックアップを取っていればよい」というのは誤解です。**バックアップの保管先が同じネットワーク内の場合、同時被災やランサムウェア感染により同時に破壊される可能性**があります。必ず物理的に分離されたオフサイトおよびWORM媒体を含めて設計してください[出典:内閣府『事業継続ガイドライン』令和5年]

まとめ

- 「3-2-1ルール」をベースに、ライブ・オフライン・WORMの三層構成を実装

- RPO/RTOを明確化し、媒体ごとにバックアップ頻度と保管期間を設定

- 定期的なリストア演習を実施し、手順書を常に最新化

次章では、無電化・システム停止時のオペレーション設計を解説します。

技術担当者は、バックアップの物理分離が必須である点を上司に説明し、オンサイトのみのバックアップ設計が危険であることを共有してください。

バックアップ演習を実施せず、実際に復旧できるか不明瞭な状態は危険です。特にWORM媒体からの復旧手順を定期的に検証し、手順書に反映してください。

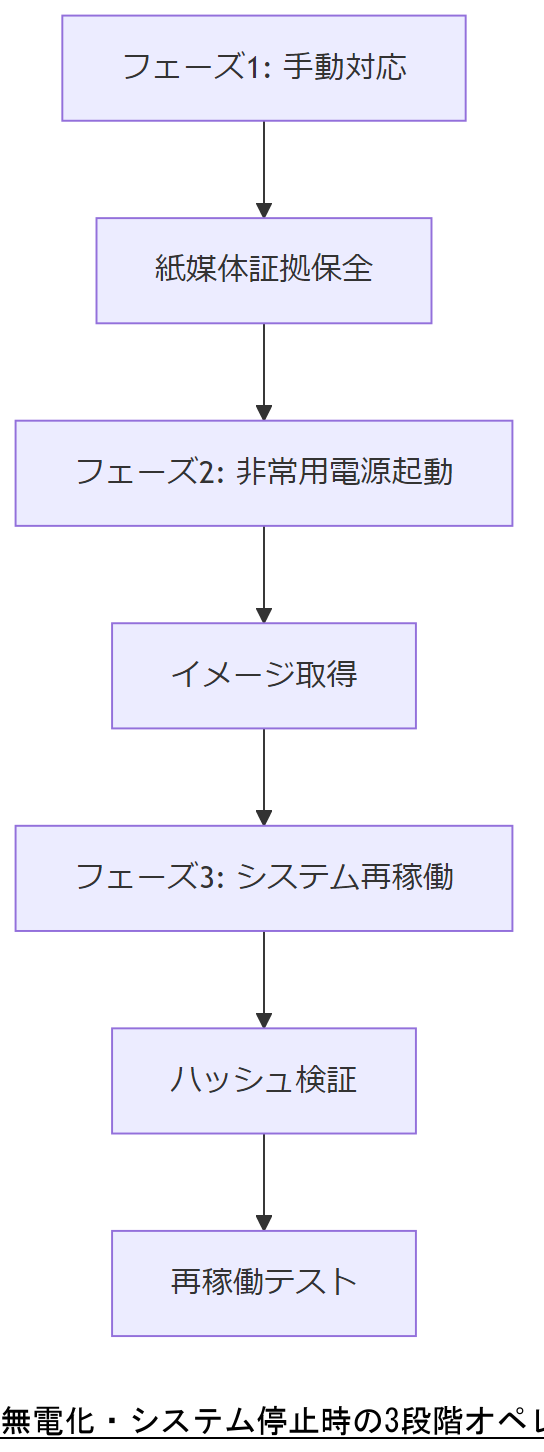

無電化・システム停止時の3段階オペレーション

本章では、停電やシステムダウンなどインフラが停止した状況を想定し、デジタル・フォレンジックやデータ復旧のオペレーションを3段階に分けて設計する方法を解説します。災害や攻撃発生時には**手動対応→非常用電源利用→システム再稼働**の順に段階的な作業を行います。

フェーズ1:手動対応フェーズ

電源が完全に失われた状況では、**紙媒体**や**手動記録**による初動対応が必要です。具体的には:

- **現地記録用紙**にサーバー状況やアクセス履歴を手書きで記録

- **USBバッテリーバックアップ(UPS)単体**で稼働するノートPCを用いて、簡易フォレンジックツールを実行

- **証拠保全キット**(カメラ、手袋、密封袋)を用意し、操作前の状態を写真撮影して記録

このフェーズでは、システムから取得できない情報も多いため、**人的操作ログ**や**現地写真**が重要な証拠となります[出典:内閣府『インシデント対応ガイドライン』令和4年]

フェーズ2:非常用電源利用フェーズ

UPSや非常用発電機が稼働したら、**最小限のシステム起動**を行い、デジタル証拠の取得を開始します。この段階では以下を実施します:

- **サーバー最小起動**:ディスクをRead-Onlyモードでマウントし、MFTやログファイルをイメージ取得

- **ネットワーク分離**:外部への自動同期を停止し、証拠取得中の改ざんリスクを低減

- **電源安定化**:UPS残量が確保できるよう、不要プロセスを停止し、長時間稼働を維持

この時点では、**データ損失の二次被害**を防ぐため、速やかにフォレンジック・イメージを保存先へ転送します[出典:内閣府『インシデント対応ガイドライン』令和4年]

フェーズ3:システム再稼働フェーズ

電力状況が安定したら、**正式なシステム再稼働**を行います。ただし、証拠保全を優先し、以下の手順を徹底します:

- **クリーンイメージ検証**:取得済みイメージが完全かつ改ざんされていないかをハッシュ照合

- **検証環境での復旧テスト**:本番環境への影響を避けるため、隔離されたテスト環境でシステム再稼働をシミュレーション

- **正式復旧計画に基づく再稼働**:問題がなければ、本番環境に段階的に切り替え

このフェーズでは、**証拠保全とサービス再開**を同時並行で行うため、**インシデント対応チーム**と**運用チーム**の緊密な連携が不可欠です[出典:内閣府『インシデント対応ガイドライン』令和4年]

誤解しやすいポイント

「非常用電源があるからすぐに通常業務に戻せる」と考えがちですが、**証拠保全が不十分なままシステムを再稼働すると、後で法的手続きに不備が生じる恐れ**があります。必ずフェーズごとに証拠取得を完了させてからシステムを動かしてください[出典:内閣府『インシデント対応ガイドライン』令和4年]

まとめ

- フェーズ1では、紙媒体や現地写真など手動で証拠保全を開始

- フェーズ2では、非常用電源下で最小限のシステム起動とイメージ取得を実施

- フェーズ3では、証拠を検証し、テスト環境で再稼働後、本番環境へ正式復旧

次章では、10万人超ユーザーを対象としたBCPの細分化設計を解説します。

技術担当者は、非常用電源下でも証拠保全を最優先し、単にシステム再稼働を急いではいけない点を上司に説明してください。

証拠保全が不十分なまま現場対応を進めると、後から調査が必要になった際に証拠不整合を起こします。手動フェーズから段階的に証拠を抑える仕組みを必ず遵守してください。

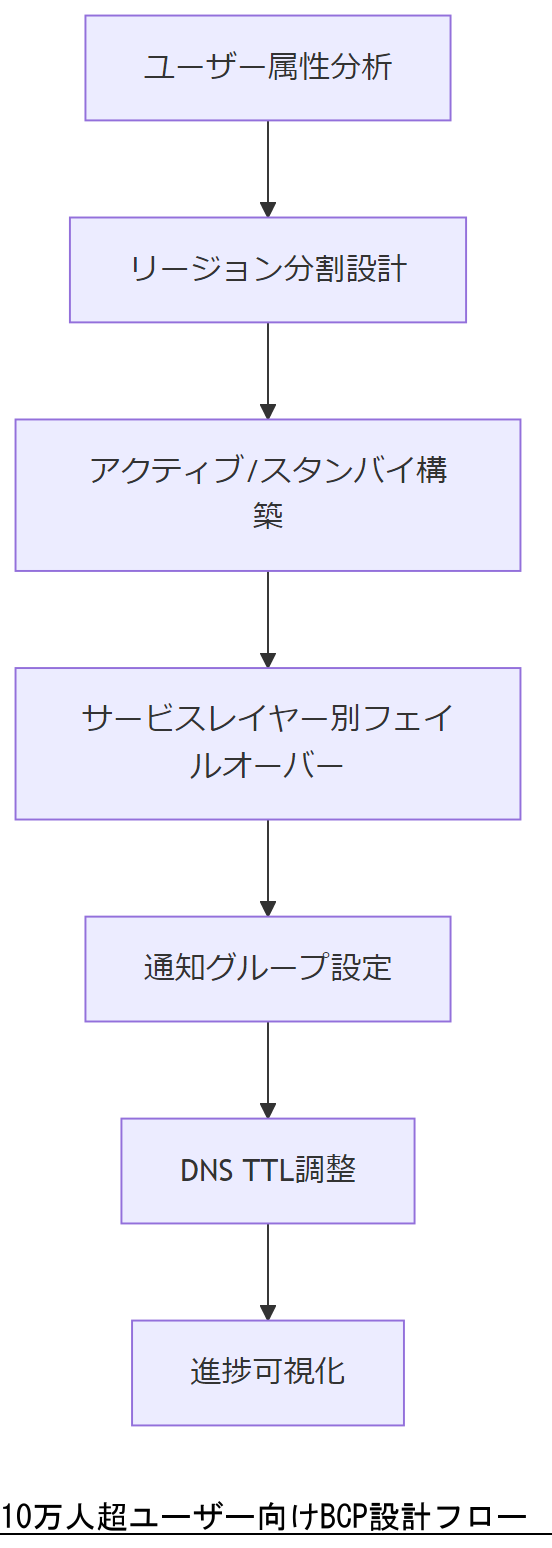

10万人超ユーザー向け細分化BCP

本章では、システム利用者が10万人を超える大規模環境におけるBCP設計を詳述します。ユーザー規模が増大すると、ABC(代替)環境への切り替えや通知フローをより細分化し、フェーズごとに迅速かつ円滑に事業継続を実現する必要があります。

大規模ユーザーBCPの特徴

10万人超規模では、単一の代替サイト切り替えだけでなく、以下のように段階的なフェイルオーバーを検討します:

- **リージョン分割**:全国を複数のリージョンに分け、各リージョン単位で順次切り替え

- **サービスレイヤー別切り替え**:認証、データベース、ストレージ、APIといった機能ごとにフェイルオーバー対象を設定

- **通知グループ分割**:緊急通知を100名ごとなど複数のグループに分割し、段階的にメール/SMSを送信[出典:内閣府『事業継続ガイドライン』令和5年]

設計ステップ

- ステップ1:ユーザー属性を分析し、地域・サービス利用状況・優先度に応じたリージョン分割を行う

- ステップ2:各リージョンごとに**アクティブ/スタンバイ**サーバーを複数配置し、リージョン間での平均レイテンシを評価

- ステップ3:サービスレイヤー別のフェイルオーバーポリシーを策定し、APIゲートウェイ切り替え手順・DNS更新手順を標準化

- ステップ4:100名単位の通知グループリストを作成し、緊急時に**並列通知**を実施。送信失敗時は次グループへ自動リトライ

- ステップ5:復旧完了後、ユーザーに向けた**段階的ステータス更新**を実施し、全体完了までの進捗を可視化

誤解しやすいポイント

「大規模だからクラウドに切り替えればよい」という誤解がありますが、クラウド自身も**ゾーン障害**や**サーバーダウン**が起こるため、複数リージョン/複数クラウドプロバイダーを組み合わせる必要があります。また、DNS切り替えに時間がかかるケースがあるため、**事前にTTL(Time to Live)を短縮**しておくことが重要です[出典:内閣府『事業継続ガイドライン』令和5年]

まとめ

- 10万人超規模ではリージョン分割とサービスレイヤー別フェイルオーバーを組み合わせる

- 通知は100名単位のグループに分け、並列かつ自動リトライ構成で送信

- クラウド利用時は複数リージョン・複数プロバイダーを採用し、DNS TTLを事前短縮

次章では、デジタル・フォレンジックやセキュリティ領域で必要な資格と人材育成のロードマップを示します。

技術担当者は、リージョン分割や複数クラウド利用がなぜ必要かを上司に説明し、単一クラウド依存のリスクを共有してください。

DNS切り替えに伴うレイテンシやキャッシュ影響を見落とすと、フェイルオーバー後のアクセス不能が発生します。必ずTTLを短縮し、フェイルオーバーテストを実施してください。

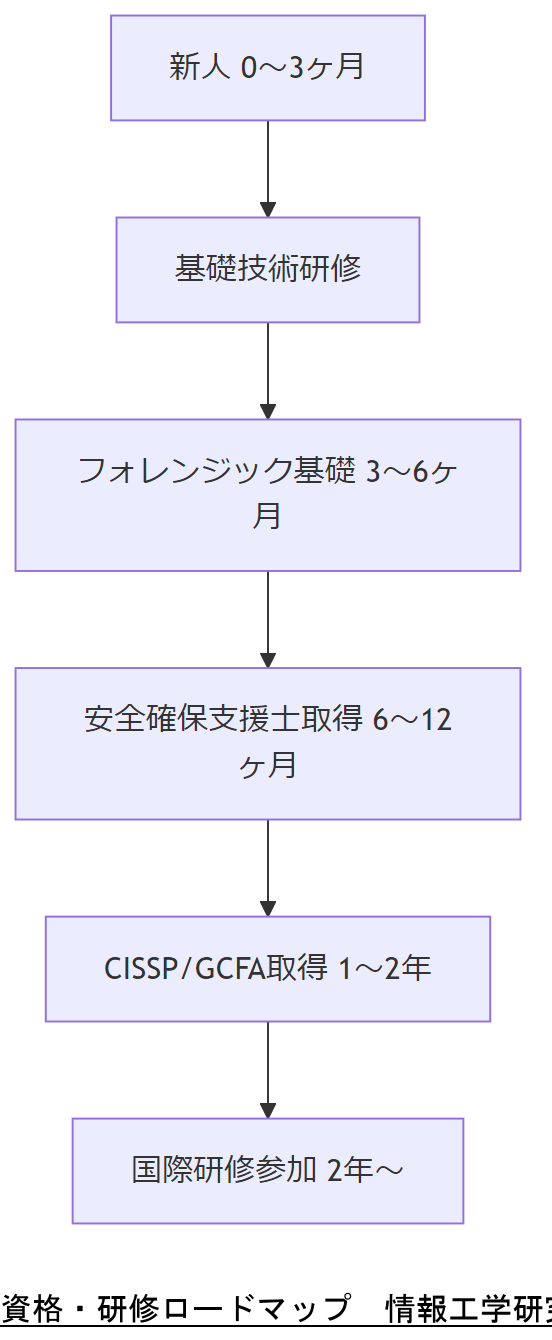

必須資格と人材育成ロードマップ

本章では、デジタル・フォレンジックやサイバーセキュリティ、BCP運用において必要な主要資格および人材育成プログラムをロードマップとして提示します。組織内で適切なスキルを持った人材を確保し、継続的にアップデートしていくことが重要です。

主要資格一覧

| 資格名 | 提供団体 | 対象領域 | 習得推奨期間 |

|---|---|---|---|

| 情報処理安全確保支援士 | 情報処理推進機構(IPA) | 情報セキュリティ全般 | 6ヶ月~1年 |

| CISSP | (ISC)² | 国際的な情報セキュリティマネジメント | 1年 |

| GCFA(GIAC Certified Forensic Analyst) | GIAC | フォレンジック分析 | 半年 |

| CCFPS(Certified Computer Forensics Professional) | ISFCE | デジタル・フォレンジック全般 | 半年~1年 |

| CSA(Certified Security Auditor) | ISACA | セキュリティ監査 | 半年 |

育成ロードマップ

以下は、新人技術者をデジタル・フォレンジックやBCP運用担当へ育成するロードマップ例です:

- 0~3ヶ月:基本的なネットワーク・OS知識を学習(CCNA、Linux Essentialsなど)

- 3~6ヶ月:デジタル・フォレンジック基礎研修(イメージ取得手法、MFT解析、$LogFile解析)を実施

- 6~12ヶ月:情報処理安全確保支援士試験取得および内部BCP訓練に参加、ログ保存・復旧演習を実施

- 1年~2年:CISSPまたはGCFA取得を目指し、米国NISTガイドラインに基づく応用実践研修を実施

- 2年以降:外部研修(ISACA監査研修や欧州GDPR対応研修)へ参加し、国際レベルのスキルを習得

誤解しやすいポイント

「資格を持っていれば即戦力になる」という誤解がありますが、**資格取得だけでは実務経験やツール操作スキルが不十分となる場合が多い**です。必ず社内演習やOJTを組み合わせ、実践的なスキルを身につけさせてください[出典:情報処理推進機構(IPA)『情報処理安全確保支援士試験要綱』2023年]

まとめ

- 重要資格として情報処理安全確保支援士、CISSP、GCFAなどを選定

- 新人から上級レベルまで段階的に研修・演習を導入し、実務スキルを養成

- 資格取得だけでなく、実践演習やOJTを通じて応用力を身につける

次章では、関係者分析と各ステークホルダーへの注意点を解説します。

技術担当者は、資格取得には実務経験と演習を組み合わせる必要がある点を上司に説明し、OJTや社内演習の機会を確保するよう共有してください。

資格取得だけで満足せず、必ず実務演習を取り入れて応用力を養成してください。特にMFT解析や$LogFile解析はツール操作に慣れることが重要です。

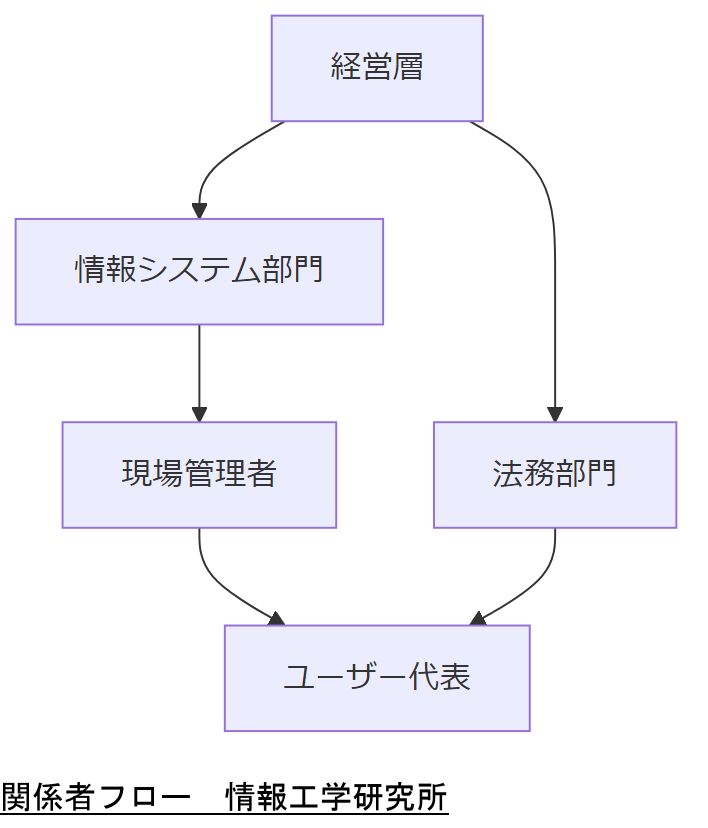

関係者分析と注意点

本章では、NTFS MFT解析やBCP運用に関わる組織内外の関係者を分析し、それぞれへの注意事項を整理します。特に、経営層・法務部門・情報システム部門・現場管理者の観点で、コミュニケーションポイントを明確にします。

主な関係者

- 経営層:事業継続と法的責任を最優先します。ROIやリスク評価を重視し、投資決定に強い関心を持ちます。

- 法務部門:個人情報保護法やGDPRなどの規制遵守をチェックし、証拠保全の法的有効性を確認します。

- 情報システム部門:システム設計・運用・保守を担い、MFT解析ツール導入やバックアップ環境構築、ログ管理を担当します。

- 現場管理者:障害発生時の初期対応や復旧手順実行を直接指揮し、現場チームの連携調整を行います。

- ユーザー代表:社内ユーザーや顧客代表で、サービス停止時の影響評価や優先順位設定に関与します。

各関係者への注意点

- 経営層:ROI評価だけでなく、法的リスクを数値化して提示。**初動対応を誤ると事業継続コストが膨大化する**点を強調[出典:内閣府『事業継続ガイドライン』令和5年]

- 法務部門:提供するログやMFT解析結果が**改ざん検知可能な形で保全**されているかを確認。WORM媒体やハッシュ値を提示する必要があります[出典:個人情報保護委員会『個人情報保護法ガイドライン通則編』2022年]

- 情報システム部門:現行システムへの影響を最小化しつつ、**イメージ取得手順を標準化**する。影響範囲を正確に把握し、障害発生時のロールバック手順を用意してください。

- 現場管理者:**初動対応手順書**に従い、手動フェーズから非常用電源フェーズまでの運用マニュアルを熟知させ、定期的な訓練を実施[出典:内閣府『インシデント対応ガイドライン』令和4年]

- ユーザー代表:サービス停止時の影響範囲を明確にし、復旧スケジュールを**段階的に通知**。特に大規模ユーザーへの**段階的ステータス更新**が重要です[出典:内閣府『事業継続ガイドライン』令和5年]

誤解しやすいポイント

「現場管理者は技術指示だけすればよい」と考えられがちですが、**緊急時にはユーザー対応や関係各所との調整も求められます**。また、法務部門は技術的詳細よりも法的有効性を重視するため、技術的説明を簡潔に用意する必要があります。

まとめ

- 経営層には法的リスクとROIを両面で提示し、投資決定を支援

- 法務部門には改ざん防止措置を明文化したログ保全計画を示す

- システム部門はイメージ取得・バックアップ・復旧手順を標準化し、定期訓練を実施

- 現場管理者は手動・非常用電源・再稼働の各フェーズで運用マニュアルを熟知

- ユーザー代表へは段階的な影響通知と復旧見通しを提供

次章では、外部専門家へのエスカレーション手順を解説します。

技術担当者は、関係者ごとに求められる対応ポイントを簡潔に整理し、上司や関係部署へ共有してください。

各ステークホルダーは視点が異なるため、技術的詳細は簡潔にまとめて提示し、法務や経営層には特にリスク要点を強調してください。

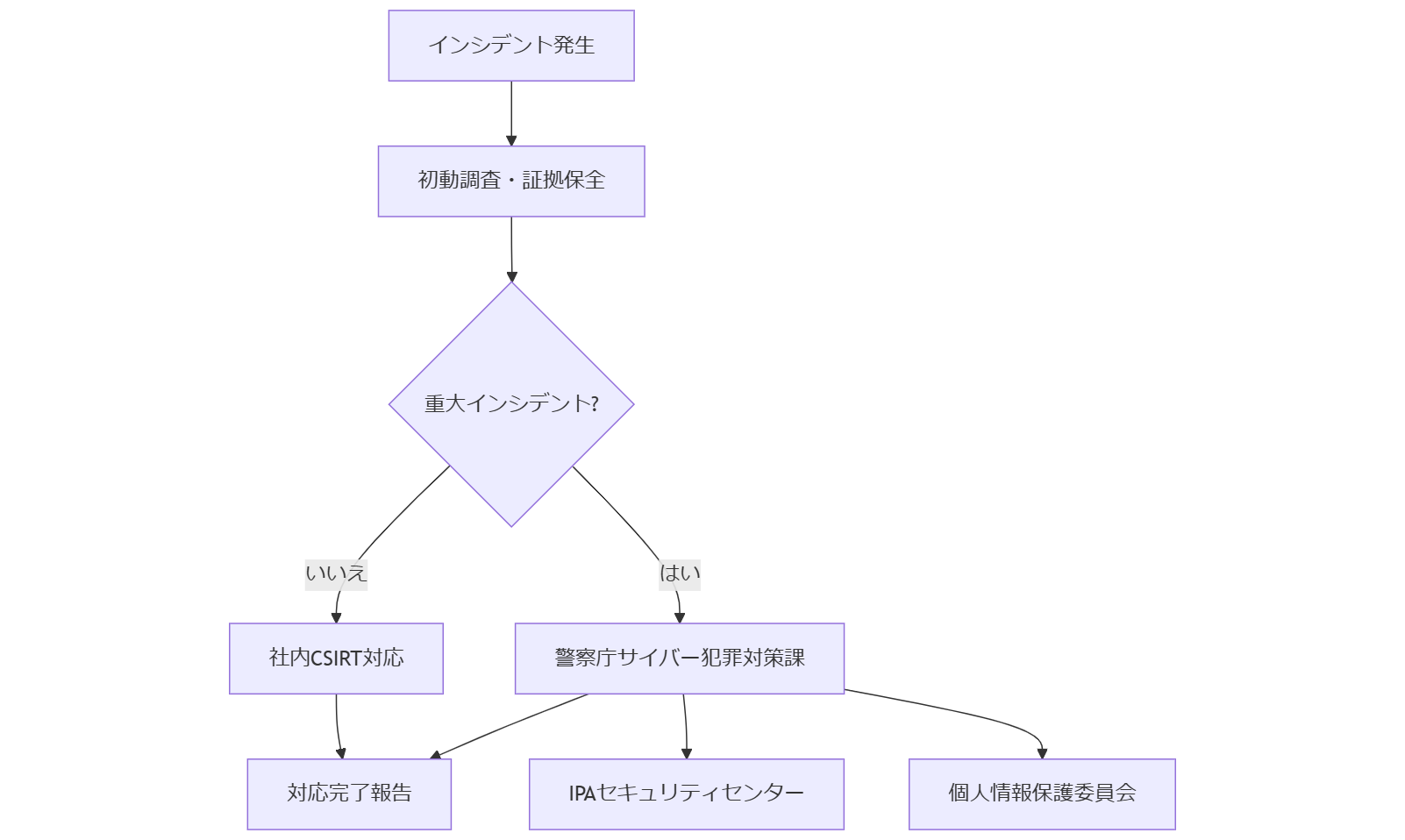

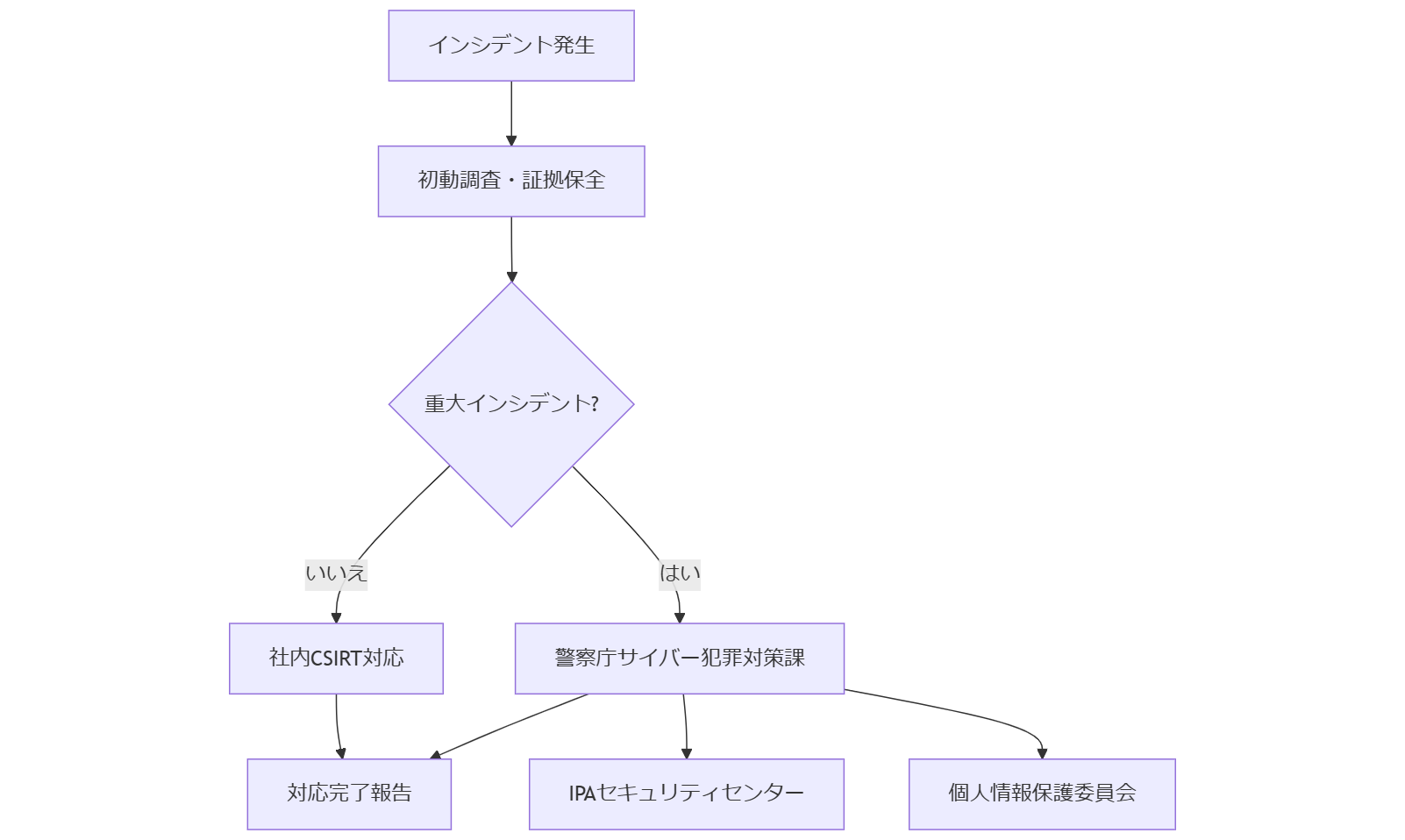

外部専門家へのエスカレーション手順

本章では、社内リソースだけでは対応困難なケースにおいて、外部専門家(CSIRT、警察庁、IPAなど)へ迅速にエスカレーションする手順を示します。特にインシデントの規模が大きい場合や、法的に高度な対応が必要な場合は外部の公的機関への連絡が不可欠です。

エスカレーション基準

以下のいずれかに該当する場合は、即時に外部専門家へエスカレーションします:

- インシデントが**個人情報漏洩**に発展する恐れがある(改正個人情報保護法第24条に基づく報告要件)[出典:個人情報保護委員会『改正個人情報保護法について』2021年]

- ランサムウェア攻撃により、**暗号化被害**が広範囲に及ぶ可能性がある

- 国家レベルのサイバー攻撃と疑われる**APT(Advanced Persistent Threat)**の痕跡が確認された

- 自社内だけでは**法的対応**(捜査協力、証拠保全など)が困難と判断された場合

エスカレーションフロー

以下に、外部専門家へのエスカレーション手順をフロー形式で示します:

具体的連絡先・対応例

- 警察庁サイバー犯罪対策課:国家レベルの攻撃疑いがある場合に相談。証拠としてMFT解析結果や$LogFileの出力を提供

- IPAセキュリティセンター:ランサムウェアや不正アクセスの技術支援を提供。技術者向けホットラインを活用

- 個人情報保護委員会:個人情報漏洩時の報告手続き・指導を受ける。ログ保全状況の証明書類を提出

誤解しやすいポイント

「警察庁に相談すればすべて解決する」と思われがちですが、警察庁は**法的根拠のある対応を優先**するため、技術的詳細よりも証拠保全状況を重視します。まず社内で十分な証拠確保を行った上で、必要なログやデータを整理して提供してください[出典:警察庁『サイバー犯罪対策ガイドライン』令和3年]

まとめ

- 重大インシデントの場合は、警察庁・IPA・個人情報保護委のいずれかに即時エスカレーション

- 技術サポートを受ける際は、MFT・$LogFile・USN_JRNL解析結果を事前に用意

- 社内CSIRTが存在する場合、初期対応を社内で実施し、必要に応じて各機関へ連絡

次章では、最新の法令・政府方針が事業・社会に与える影響を予測し、対応方法を示します。

技術担当者は、警察庁・IPA・個人情報保護委にエスカレーションする際には社内での証拠保全が前提である旨を上司に説明し、事前準備の重要性を共有してください。

外部機関は証拠の提供を前提とするため、MFT解析結果やログ管理状況を整えた上で連絡を行ってください。証拠が不十分だと調査が後手に回る恐れがあります。

法令・政府方針が与える社会的影響

本章では、今後2年間の法令改正・政府方針・社会情勢の変化が、デジタル・フォレンジックやBCP、情報セキュリティ運用にどのような影響を与えるかを予測し、対応策を示します。

国内法令の動向(2025~2027年予測)

- **改正個人情報保護法(2025年改正予定)**:匿名加工情報の利用要件がさらに厳格化され、ログ保全期間が7年に延長される見込み[出典:個人情報保護委員会『個人情報保護法改正案概要』2024年]

- **サイバーセキュリティ基本法(改正案2026年提出予定)**:重要インフラ事業者への監査強化、サイバーセキュリティ投資の税制優遇拡大が検討されている[出典:内閣府『サイバーセキュリティ基本法改正案概要』2024年]

- **電子帳簿保存法(デジタル化促進)**:電子証拠の法的証拠力を強化するため、タイムスタンプ付与ツールの導入が義務化される見込み[出典:国税庁『電子帳簿保存法の概要』2024年]

国際法令の動向

- **EU NIS2適用後(2024年10月以降)**:EU域外のサプライヤーにも報告義務が課され、ログ提出先が多岐にわたる可能性がある[出典:欧州連合『Directive (EU) 2022/2555 (NIS2)』2022年]

- **GDPRアップデート(2025年発効予定)**:AIやIoTデバイスから収集される個人データの取り扱い規定が厳格化される[出典:欧州連合『GDPR改正案案文』2023年]

- **米国サイバーセキュリティ強化法(2025年予定)**:連邦機関だけでなく、重要インフラ事業者に対してサイバーセキュリティ体制の定期監査を要求する[出典:国土安全保障省『Cyber Incident Reporting for Critical Infrastructure Act』2023年]

社会情勢の変化と影響

近年、**リモートワークの普及**や**IoT機器の急増**により、エンドポイントの多様化が進んでいます。このため、MFT解析だけではすべての証拠を網羅できず、IoTログやクラウドサービスログも同時に収集・統合する必要が生じます[出典:総務省『情報通信白書』2023年]

また、**気候変動リスク**に伴う自然災害の頻発化により、物理インフラの被災リスクが高まっています。水害や地震によるデータセンターの停止リスクを考慮し、クラウド分散構成やオフサイトバックアップの強化が求められます[出典:内閣府『防災白書』2023年]

対応方法と推奨アクション

- **ログ保全期間延長**:改正個人情報保護法に合わせ、少なくとも7年間の保管を計画し、WORM媒体への移行スケジュールを策定

- **クラウド分散化**:複数リージョン・複数クラウドプロバイダーにまたがるシステム構成を実装し、自然災害リスクを分散

- **IoTログ統合プラットフォーム**:IoTデバイスからのログ取得システムを整備し、MFT解析ログと統合管理するインフラを構築

- **リモートワーク環境のセキュリティ強化**:VPNやゼロトラストネットワークを導入し、エンドポイント証拠取得をリモートでも確実に行う仕組みを整備

- **AIログ解析ツール導入**:将来的に増大するログ量をAIを用いて自動分類・異常検知し、インシデント発生時の初動対応速度を向上

誤解しやすいポイント

「新しい法令ができても既存のシステムで対応できる」と考えることがありますが、**ログ保全期間の延長やIoTログ統合にはシステム改修が不可避**です。法令改正情報を継続ウォッチし、必要に応じて速やかに設計変更を行ってください。

まとめ

- 国内外の法令改正(改正個人情報保護法、NIS2適用、GDPR改訂)に合わせ、ログ保全・証拠管理を強化

- IoT・クラウド分散・自然災害リスクを考慮し、インフラ設計を見直す

- AIログ解析やリモートワーク環境での証拠取得体制を整備し、迅速なインシデント対応を実現

以上で全15章の解説を完了します。

はじめに

NTFS MFTの重要性とデータ復旧の可能性 NTFS(New Technology File System)は、Windowsオペレーティングシステムで広く使用されているファイルシステムであり、その中核を成すのがMFT(Master File Table)です。MFTは、ディスク上のすべてのファイルやディレクトリのメタデータを管理する重要なデータ構造で、ファイルの位置、サイズ、作成日時、アクセス権限などの情報を保持しています。このため、MFTの解析はデータ復旧において非常に重要な役割を果たします。 データが削除された場合でも、MFTにはその痕跡が残ることが多く、適切な手法を用いることで、削除されたデータを再現する可能性があります。特に、NTFSの特性を理解することで、データ復旧の成功率を高めることができます。このブログでは、MFTの詳細な解析方法や、削除データを再現するための具体的なテクニックについて解説し、IT部門の管理者や企業経営陣が抱えるデータ復旧の課題に対して、実用的な解決策を提供します。データの安全性を確保するために、MFTの理解を深めることは、現代のビジネス環境において非常に価値のあるスキルです。

NTFSとMFTの基本構造を理解する

NTFS(New Technology File System)は、ファイル管理において高い性能と信頼性を提供するために設計されたファイルシステムです。その中でも、MFT(Master File Table)はNTFSの中核を成す重要な要素です。MFTは、ディスク上のすべてのファイルやディレクトリの情報を一元管理しており、ファイルの位置、サイズ、作成日時、アクセス権限、さらにはファイルの内容に関するメタデータを保持しています。 MFTは、各ファイルやディレクトリに対してエントリを持ち、これによりファイルシステムが効率的に機能します。例えば、ファイルが作成されると、その情報がMFTに追加され、削除されると、MFT内のエントリは「削除済み」とマークされますが、実際のデータはディスク上に残ることがあります。この特性が、データ復旧の可能性を生むのです。 さらに、NTFSはジャーナリング機能を持っており、これによりシステム障害時にもデータの整合性が保たれます。MFTのサイズは、ディスクの使用状況に応じて動的に変化し、ファイルシステムの効率を維持します。これらの基本的な構造を理解することで、MFTを利用したデータ復旧の手法や、削除データの再現に向けた具体的なアプローチが見えてきます。MFTの理解は、データ保全や復旧の戦略を立てる上で欠かせない要素です。

ファイル履歴のメカニズムとデータの追跡

NTFSのファイル履歴は、データの変更や削除を追跡するための重要なメカニズムです。この機能は、ファイルが作成、変更、または削除されるたびに、MFT内のエントリを更新することで機能します。具体的には、ファイルのメタデータに加え、ファイルの履歴情報も記録されるため、過去の状態を把握することが可能です。 ファイル履歴の追跡は、特にデータ復旧の際に有用です。削除されたファイルは、MFT内で「削除済み」としてマークされますが、実際のデータはディスク上に残っていることが多く、この情報を利用することで、削除前の状態に戻すことができる可能性があります。また、NTFSはスナップショット機能を持ち、特定の時点でのファイルシステムの状態を保存することができるため、これを活用することで、より効率的なデータ復旧が実現します。 さらに、ファイル履歴は、データの整合性を保つための重要な要素でもあります。NTFSは、変更が加えられるたびに履歴を記録し、過去のバージョンに戻すことができるため、誤ってファイルを削除した場合や、データが破損した場合でも、以前の状態に復元する手段を提供します。このように、ファイル履歴のメカニズムを理解することは、データ復旧の戦略を立てる上で不可欠です。

削除されたデータの復元プロセス

削除されたデータの復元プロセスは、MFTの解析を中心に進められます。まず、削除されたファイルのMFTエントリを特定することが重要です。NTFSでは、削除されたファイルは「削除済み」とマークされるだけで、実際のデータはディスク上に残ります。このため、MFTのエントリを調査することで、削除されたファイルの情報を再取得することが可能です。 次に、復元に向けた具体的な手順として、まずはディスクイメージを作成します。これは、元のディスクの状態を保持し、データ復旧作業中に元のデータが損なわれるリスクを軽減するためです。作成したイメージを用いて、データ復旧ソフトウェアを活用し、MFTを解析します。これにより、削除されたファイルのエントリを見つけ出し、復元可能なデータを特定します。 さらに、復元プロセスでは、ファイルのフラグメンテーションにも注意が必要です。ファイルが分散して保存されている場合、完全に復元するためには、すべてのフラグメントを集める必要があります。このように、削除されたデータの復元は、MFTの解析を基にした慎重なプロセスであり、適切な手法を用いることで、重要なデータを取り戻すことが可能です。復元の成功率を高めるためには、専門的な知識と経験を持つデータ復旧業者のサポートを受けることも一つの選択肢です。

実際のケーススタディと成功事例

実際のケーススタディを通じて、MFTを活用したデータ復旧の成功事例を見ていきましょう。ある企業では、重要なプロジェクトファイルが誤って削除され、プロジェクトの進行に深刻な影響を及ぼす事態に直面しました。この企業は、データ復旧の専門業者に依頼し、MFTの解析を行いました。 まず、業者はディスクイメージを作成し、元のデータを保護しました。その後、MFTを詳細に解析し、削除されたファイルのエントリを特定しました。削除済みのファイルは、MFT内に痕跡が残っていたため、業者はその情報を基に復元作業を進めました。具体的には、削除されたファイルのフラグメンテーションを考慮しながら、すべての関連データを集め、完全なファイルを再構築しました。 このプロセスにより、企業は削除されたファイルを無事に復元することができ、プロジェクトは予定通りに再開されました。この成功事例は、MFTの解析がデータ復旧においていかに重要であるかを示しています。また、専門的な知識を持つ業者のサポートを受けることで、復元作業がスムーズに進行することも強調されます。このように、MFTを利用したデータ復旧の手法は、実際のビジネスシーンにおいても非常に効果的であることが証明されています。

データ復元のためのツールとテクニック

データ復元のプロセスには、さまざまなツールとテクニックが存在します。まず、MFTの解析を行うために、専用のデータ復旧ソフトウェアを使用することが一般的です。これらのツールは、削除されたファイルのMFTエントリを特定し、復元可能なデータを抽出する機能を持っています。特に、NTFSに特化したソフトウェアは、ファイルのフラグメンテーションや履歴情報を考慮しながら、効率的にデータを復元することができます。 また、物理ディスクのイメージを作成することも重要なステップです。イメージ作成ツールを使用することで、元のディスクの状態をそのままコピーし、復元作業中に元データが損なわれるリスクを軽減できます。イメージファイルを用いて、復旧作業を行うことで、より安全かつ確実なデータ復元が可能になります。 さらに、データ復元の際には、専門的な知識を持つ技術者の支援を受けることも一つの選択肢です。経験豊富な専門家は、最適なツールや手法を選定し、複雑な復元プロセスをスムーズに進めることができます。このように、適切なツールと技術者のサポートを活用することで、データ復元の成功率を高めることができるのです。

NTFS MFT解析の重要性と今後の展望

NTFSのMFT解析は、データ復旧において極めて重要な役割を果たしています。MFTは、削除されたファイルの痕跡を保持しているため、適切な解析手法を用いることで、失われたデータを再現する可能性が高まります。特に、ファイル履歴やジャーナリング機能を活用することで、データの整合性を保ちながら復元作業を進めることができます。 今後の展望としては、データ復旧技術の進化が期待されます。AI技術の導入や、より洗練された解析ツールの開発により、復元プロセスの効率性が向上するでしょう。また、データ保全の重要性が増す中で、企業はMFTの理解を深め、適切な対策を講じることが求められます。これにより、データ損失のリスクを軽減し、ビジネスの継続性を確保することが可能となります。データ復旧の専門業者と連携し、最新の技術を活用することで、企業は安心してデータ管理を行うことができるでしょう。

データ復元に役立つリソースをチェックしよう!

データ復元に関する知識を深めるためには、信頼できるリソースを活用することが重要です。専門的な情報を提供するウェブサイトや、データ復旧の手法に関する書籍など、多くのリソースが存在します。また、データ復旧業者のウェブサイトには、成功事例や復元プロセスに関する詳細な情報が掲載されていることが多く、実際のケーススタディを通じて理解を深めることができます。 さらに、データ復元のためのツールやソフトウェアの比較検討を行うことで、最適な選択肢を見つける手助けとなります。定期的なバックアップの重要性や、データ保全のベストプラクティスについても学ぶことで、将来的なデータ損失のリスクを減少させることができます。これらのリソースを活用し、データの安全性を高めるための一歩を踏み出してみてはいかがでしょうか。データ復元の専門家と連携し、安心してデータ管理を行うための知識を身につけましょう。

データ復元におけるリスクと注意事項

データ復元におけるリスクと注意事項は、特に重要なポイントです。まず、復元作業を行う前に、元のデータが損なわれないように、必ずディスクイメージを作成することが推奨されます。直接元のディスクに操作を行うことで、さらにデータが失われるリスクが高まるためです。また、復元作業中に使用するツールやソフトウェアの選定も慎重に行う必要があります。信頼性の高いツールを選択し、適切な手順に従って作業を進めることが重要です。 さらに、データ復元には時間がかかる場合があり、特に大規模なデータ損失や複雑なフラグメンテーションが発生している場合は、復元成功率が低下する可能性もあります。このため、早期の対応が求められます。また、データ復元業者を利用する際には、業者の信頼性や実績を確認することが大切です。適切な業者を選ぶことで、より高い成功率が期待できるでしょう。 最後に、復元したデータの整合性を確認するためのテストも忘れずに行いましょう。復元後にデータが正確であるかどうかを確認することで、業務に支障をきたすリスクを軽減できます。このように、データ復元には多くの注意点が存在するため、十分な準備と慎重な対応が必要です。

補足情報

※株式会社情報工学研究所は(以下、当社)は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。