ext4ジャーナルから削除ファイルを戻せるか、最短で見極める

まずは「今の状態」で回収できる可能性があるかを確認して、触るなら最小変更で進めます。迷う要素があるなら早めに切り替えるほうが結果が安定しやすいです。

まず「どのユーザーで」「どこまで到達できるか」を固定します。削除直後か、追記が進んでいないかが最初の分かれ目です。

# 対象FS/デバイスの特定(rootでなくても可) mount | grep -E ' type ext4 |/対象パス' df -hT /対象パス # 影響が大きい追記が起きていないか(目安) dmesg -T | tail -n 80 journalctl -k -n 200 --no-pager

状況に合わせて「読むだけ」で可能性を確認し、次の一手を選びます。コマンドはコピーしてそのまま使える形にしています。

# まず読むだけ:inode/削除痕跡の探索(例:extundelete / debugfs) # ※ツール未導入なら導入前に影響範囲を確認(③へ) sudo extundelete /dev/対象 --inode 0 --ls 2>/dev/null | head sudo debugfs -R "lsdel" /dev/対象 2>/dev/null | head

# 最終アクセス/更新の手がかりを拾う(読み取り中心) sudo find /対象パス -xdev -type f -mmin -120 -printf '%TY-%Tm-%Td %TH:%TM %s %p\n' 2>/dev/null | tail -n 30 sudo ls -ltu /対象パス 2>/dev/null | head

# まずはログとメタ情報を確保(読み取りのみ) sudo journalctl --since "2 hours ago" --no-pager | tail -n 200 sudo lsof +D /対象パス 2>/dev/null | head sudo fuser -vm /対象パス 2>/dev/null | head

# 可能なら「書き込みを増やさず」イメージを優先(例:ddrescue) # /dev/対象 → 退避先ストレージへ(十分な空き容量が必要) sudo ddrescue -n /dev/対象 /退避先/target.img /退避先/target.log sudo ddrescue -d -r3 /dev/対象 /退避先/target.img /退避先/target.log

ジャーナル周りは「触るほど復旧が遠のく」場面があります。まずは停止可否・共有有無・監査要件の有無を確認してから進めると安全です。

# 本番/共有の気配(読み取り中心) systemctl --type=service --state=running | head ss -lntup | head exportfs -v 2>/dev/null grep -E ' nfs|cifs|ceph|gluster|lustre ' /proc/mounts 2>/dev/null | head # ext4の状態確認(読める範囲で) sudo tune2fs -l /dev/対象 2>/dev/null | egrep -i 'Filesystem state|Features|Last mount time|Mount count' || true

- 復旧を急いで書き込みを増やし、痕跡が上書きされて回収率が落ちる。

- 本番稼働のまま深追いして、サービス停止や性能劣化が起きる。

- 権限・所有者を広範囲に変えて、監査や証跡の要件に抵触する。

- ジャーナル/メタ情報の扱いを誤り、復旧が長期化して復元範囲が縮む。

・対象がLVM/RAIDの上で、デバイスの切り分けに迷ったら。

・ジャーナル解析ツールを入れる前に、本番への影響を見積もれない。

・バックアップとスナップショットのどちらを先に確認すべきか迷ったら。

・inode/パスの手掛かりが薄く、探索が空振りしそうで迷ったら。

・共有ストレージ、コンテナ、本番データ、監査要件が絡む場合は、無理に権限を触る前に相談すると早く収束しやすいです。

・証跡を残しながら復旧したいが、手順の順番に迷ったら。

・復旧優先か業務継続優先かの判断がつかない。

もくじ

- 消えたはずのファイルが“まだそこにある”気がしてしまう夜:ext4ジャーナルに期待してしまう理由

- 心の会話:『rmしただけで終わるなら、復旧屋はいらないんだよな…』という現場の本音

- ext4の設計前提を押さえる:ジャーナリングは「ファイル復旧機能」ではなく「整合性の保険」

- 伏線①:削除の正体は“unlink”——データが消える前に消えるもの/残るもの

- 伏線②:journalが記録するのは何か(metadata / data / ordered / writeback)と「当たり外れ」の構造

- Linux Journalを“証拠”として読む:jbd2 / transaction / descriptor / commit が語る時間軸

- 再構成の実務フロー:安全なイメージ化→読み取り専用→journal抽出→候補inodeの探索

- よくある落とし穴:上書き・TRIM・logのローテーション・mount回数が“確率”を削っていく

- 技術で腹落ちさせる:成功するケース/失敗するケースを分ける条件式(判断基準の言語化)

- 帰結:ext4ジャーナル解析は「魔法」じゃない——それでも最後の1%を拾う“設計された執念”である

【注意】 ext4の削除ファイル再構成(ジャーナル解析を含む)は、操作を誤ると上書き・TRIM・整合性処理で復旧可能性が急落します。自己判断で「復旧作業」や通電の繰り返し、同一ディスクへのツール導入、安易なfsck実行は避け、まずは書き込みを止めて状況を固定し、必要なら株式会社情報工学研究所のような専門事業者に相談してください。

第1章:消えたはずのファイルが“まだそこにある”気がしてしまう夜——現場のモヤモヤから始める

障害対応の現場で、いちばん胃が痛いのは「何が起きたか分からない」状態です。ログは断片的、関係者は増える、復旧の期待値だけが上がっていく。そこに“削除”が絡むと、さらに厄介になります。ファイルは見えないのに、ディスク使用量が急に変わったわけでもない。すると、つい考えてしまうんですよね。「これ、どこかに残ってるんじゃないか?」と。

ここで重要なのは、その直感が半分は正しいことです。ext4では、削除は多くの場合「参照を外す(unlink)」であって、即座に全データをゼロ埋めする操作ではありません。一方で、半分は危険でもあります。残っている“可能性”があるからこそ、誤った操作が“残っていた可能性”を潰します。

心の会話、ありますよね。

「消しただけなんだから、ちょっとツール回せば戻るでしょ……?」

この“ちょっと”が曲者です。復旧は、運用・ストレージ特性・負荷・削除後の活動量で難易度が激変します。この記事は、ext4のジャーナル(jbd2)をどう“証拠”として読み、削除ファイル再構成が成立する条件をどう見極めるかを、事実ベースで整理します。魔法の手順ではなく、現場が納得できる判断の軸を作るのが狙いです。

最終的に読者が得るべきものは、「いま自分がやるべきは何か/やらないべきは何か」を説明できる状態です。そして、一般論では埋まらない案件(契約・監査・大規模環境)では、株式会社情報工学研究所のような専門家に相談する判断が自然にできることです。

第2章:まず“温度を下げる”——復旧より先にやるべき初動(書き込み停止と保全)

削除ファイルの再構成において、技術以前に勝負を決めるのが「削除後にどれだけ書き込んだか」です。ext4は高速化のために遅延割り当て(delayed allocation)などの仕組みを持ちます。つまり、アプリが“書いたつもり”のデータが、後からまとめてディスクへ降りることもあります。削除直後に平常運転へ戻すほど、復旧の土台は崩れていきます。

やること(安全な初動)

- 対象ボリュームへの書き込みを止める(サービス停止、対象VM停止、対象コンテナ停止など)

- 可能ならアンマウント。難しい場合でも、解析は読み取り専用で行う方針に寄せる

- ログ・時刻・操作履歴を残す(誰がいつrmしたか、どのパスか、削除後に何が動いたか)

- “解析は別媒体へコピーしたイメージで行う”を基本にする(原本を触る回数を減らす)

やらないこと(よくある事故)

- 同一ディスクへのツール導入、パッケージ更新、再起動の連発(どれも書き込み要因)

- 「とりあえずfsck」や自動修復(整合性は戻っても痕跡が失われることがある)

- 復旧結果を元の場所に書き戻す(上書きの自己破壊になりやすい)

ここでのポイントは、復旧の成否を“努力量”で決めないことです。復旧は根性論ではなく、条件の問題です。条件を良くする最短手は、被害最小化(=追加書き込みを抑え込む)です。現場の負荷が高いほど、ここが疎かになりがちですが、だからこそ最初に“歯止め”をかける価値があります。

そして業務的に重い案件ほど、初動は技術だけでなく説明責任も含みます。たとえば「なぜ停止したのか」「なぜ原本を触らないのか」を言語化できると、上司・法務・顧客への説明がスムーズになります。一般論のテンプレでは追いつかない場合は、株式会社情報工学研究所のような専門家の関与を前提に設計した方が、結果として軟着陸しやすいです。

第3章:ext4ジャーナルの前提——“復旧機能”ではなく“整合性の保険”としてのjbd2

タイトルに「Linux Journal解析」とありますが、ここで言う“Journal”は雑誌ではなく、またsystemdのジャーナル(journalctl)でもありません。対象はext4のジャーナル機構(jbd2)です。ext4は、クラッシュや電源断が起きてもファイルシステムの整合性を素早く戻すために、メタデータ更新をトランザクションとして記録します。

ここを誤解すると、「ジャーナルに全部入ってるなら、消したファイルも丸ごと戻るよね?」という期待が生まれます。しかし多くの環境で、ジャーナルに入るのは主にメタデータです。つまり“どのブロックがどのファイルに属するか”や“ディレクトリエントリ”など、構造の情報が中心になります。ファイル本体のデータブロックまで常に記録されるわけではありません。

ジャーナリングモードの違い(当たり外れを決める要因)

| モード | 意味(事実ベース) |

|---|---|

| data=ordered(多くの既定) | メタデータはジャーナル化し、データ本体はジャーナル化しない。ただし「メタデータのコミット前に、対応するデータを書き出す」順序制約で整合性を高める。 |

| data=writeback | メタデータはジャーナル化するが、データ書き出し順序の保証が弱い。クラッシュ後に“古いデータが新しい名前で見える”類の不整合が起き得る。 |

| data=journal | データ本体もジャーナルへ記録する。整合性は強いが性能コストが大きく、一般的な運用では限定的。 |

削除ファイル再構成は、このモード差や負荷条件、ジャーナルサイズ、削除後のトランザクション進行量に影響されます。つまり「技術があれば必ず戻る」ではなく、「条件が揃えば、痕跡を手がかりに“再構成できることがある”」が正確な表現です。

jbd2を“時間軸”として見る

jbd2は更新をトランザクションとして扱い、ディスク上のジャーナル領域に「この更新は完了した(コミットされた)」という痕跡を残します。解析では、この“順序”が非常に重要です。どの変更がいつ適用されたか、どこまでが確定か、そしてジャーナルが巡回して過去ログが上書きされる前に何を拾えるか。ここが、次章以降の伏線になります。

第4章:伏線①——削除の正体は“unlink”。消える前に消えるもの/残るもの

ext4でファイルを削除するとき、直感的には「データが消える」と思いがちです。しかしファイルシステムの内部では、まず“参照”が外れます。ディレクトリは「ファイル名→inode番号」の対応表のようなものを持っており、削除はこの対応を外す(ディレクトリエントリを消す/無効化する)操作です。

同時に、inodeのリンク数が減り、最終的に参照が0になれば、そのinodeやデータブロックが“再利用可能”として管理情報(ビットマップ等)で空き扱いになります。ここで大事なのは、空き扱いになった瞬間にデータブロックが必ずしも即座にゼロ化されるわけではない、という点です。だから「残っている可能性」は確かにあります。

削除後に起きる“現実”

- ディレクトリエントリが消える(ファイル名から辿れなくなる)

- inodeやブロックが空きとして再利用候補になる(上書きされるリスクが上がる)

- 削除後の書き込みが多いほど、空き領域が再利用され、復旧可能性が下がる

なぜジャーナル解析が話題になるのか

ここで「じゃあ、ジャーナルにディレクトリの変更が記録されているなら、消える前の状態を拾えるのでは?」という発想が出てきます。これがジャーナル解析の核心です。ディレクトリブロックやinodeテーブル、ビットマップといった“構造のブロック”はジャーナルに載りやすく、削除直後のトランザクションがまだジャーナルに残っていれば、ファイル名とinodeの手がかりが得られる可能性があります。

ただし、ここにも条件があります。ジャーナルは無限に保存するログではなく、固定サイズのリングバッファ的に巡回し、古い記録は上書きされます。削除後にシステムが忙しく動けば動くほど、手がかりは早く消えます。だからこそ、第2章の「温度を下げる(書き込みを抑え込む)」が伏線として効いてきます。

第5章:伏線②——ジャーナルが記録するのは何か。“当たり外れ”を構造で理解する

ext4のジャーナル(jbd2)が記録する中心は、メタデータ更新です。削除の場面で言うと、ディレクトリエントリ変更、inode更新、ブロックビットマップ更新などが対象になります。つまり、ジャーナル解析で狙うのは「消える直前のディレクトリブロック」や「消える直前後のinode情報」といった“構造”です。

ジャーナル解析で期待できるもの/期待しにくいもの

| 項目 | 現実的な見立て |

|---|---|

| ファイル名→inodeの手がかり | ディレクトリブロックの更新がジャーナルに残っていれば可能性あり。削除直後に書き込みが多いと上書きされやすい。 |

| inodeの属性(サイズ、時刻、extent情報) | inodeテーブル更新が残っていれば手がかりになり得る。ただし再利用や追記更新で変化していることもある。 |

| ファイル本体データ | 多くの運用(data=ordered等)ではジャーナルに全データが載るわけではない。データ領域に残存しているか、上書きされていないかが別問題として残る。 |

「ジャーナルにある=復旧できる」ではない理由

仮にディレクトリエントリの痕跡が見つかっても、次に必要なのは“そのinodeが指していたデータブロックがまだ残っているか”です。ここで、削除後のアプリ稼働やログ出力、パッケージ更新、監視のスキャンなど、日常の“細かい書き込み”が効いてきます。しかも、書き込みは必ずしも巨大ファイルだけではありません。小さな更新でも、空き領域やメタデータ周辺をじわじわ再利用して、結果的に復旧の前提を崩します。

だから、ジャーナル解析は「やれば戻る」ではなく、「条件が良いときに、失われた構造の一部を取り戻すための手段」です。ここを現場に説明できると、無理な期待を抑え込みつつ、やるべきこと(イメージ化、解析、必要なら専門家相談)に集中できます。次章では、この“手段”を実務フローとしてどう組み立てるかに入っていきます。

/

第6章:Linux Journalを“証拠”として読む——jbd2のtransactionが語る時間軸

ここからは「解析」の話に入ります。ただし前提として、ext4のジャーナル(jbd2)は“復旧のためのログ”ではなく、“整合性を戻すためのログ”です。だから、読むべきものは「ファイル内容そのもの」ではなく、「その時点でファイルシステムがどんな更新を確定させたか」という事実です。言い換えると、ジャーナルは“タイムラインの断片”です。

jbd2は更新をtransaction(トランザクション)としてまとめます。トランザクションには、変更対象ブロックの情報(どのブロックを更新するか)と、その更新が確定したことを示すcommit(コミット)があり、これがクラッシュ後のリプレイ(適用/巻き戻し)の基礎になります。解析では、この「どこまでが確定で、どこからが未確定か」を見ていきます。

“読む”とは何をすることか

現場の心の会話としては、こういう気持ちが出ます。

「で、結局どこを見れば“消した瞬間”が分かるの?」

結論から言うと、ジャーナル内に残っている更新のうち、削除操作に関係しやすいのは次の領域です。

- 削除対象が存在していたディレクトリのブロック(ディレクトリエントリの更新)

- 削除対象のinode(リンク数・タイムスタンプ・extent情報などの更新)

- ブロックビットマップ/inodeビットマップ(空き扱いの更新)

“確定した更新”が重要な理由

ジャーナルには、変更の途中経過も存在し得ます。しかし復旧や説明責任において重要なのは、「その更新がコミットされてディスク上の整合性として成立したか」です。未コミットの更新は、クラッシュ時には破棄される前提で扱われることがあり、解析上の扱いも慎重になります。つまり、コミット済みトランザクションは“当時の事実”としての強度が高い、という整理になります。

この章のポイントは、ジャーナルを“復旧の魔法”ではなく“証拠の層”として扱うことです。証拠として扱うなら、次に必要なのは「安全な取り出し方」です。次章では、原本を傷つけずに解析を進めるための実務フローに入ります。

第7章:再構成の実務フロー——安全なイメージ化→抽出→候補探索→整合性確認

削除ファイル再構成で失敗が多いのは、「復旧ツールの選定ミス」より「手順が原本を汚した」ケースです。とくに業務データでは、復旧ができても“説明できない復旧”は後から火種になります。ここでは、一般論として安全側に倒したフローを示します。個別の環境(RAID、LVM、暗号化、仮想化)で最適解は変わるため、迷うなら株式会社情報工学研究所のような専門家に最初から相談し、場を整えた上で進めるのが現実的です。

ステップ0:状況固定(被害最小化)

- 対象ボリュームへの書き込み停止(業務停止が難しい場合は、影響範囲を切って停止する)

- 削除後に動いていた処理の棚卸し(ログローテーション、監視、バックアップ、バッチ、デプロイ等)

- SSD/NVMeの場合、TRIMが走り得る運用か確認(discard mount、fstrim、ストレージ設定)

ステップ1:取得(原本のコピーを作る)

解析は、原則として別媒体に取得したイメージで行います。これは「復旧確率を上げる」だけでなく、「後から説明できる」形にするためです。原本で試行錯誤すると、結果が良くても“再現性のない偶然”に見えてしまい、監査や顧客説明で詰みやすいです。

この段階での注意点はシンプルです。取得先は必ず別ディスク、取得中も原本に書き込まない、取得後は原本は触らない。必要に応じてハッシュ(例:取得したイメージの整合性確認)を取ることも、BtoB案件では有効です。

ステップ2:ジャーナル領域の把握と抽出

ext4のジャーナルは、ファイルシステム内部のジャーナル領域として存在します(外部ジャーナル構成もあり得ますが一般的ではありません)。解析では、ジャーナルがどれだけ残っているか(サイズ、循環状況)、削除後にどれだけトランザクションが進んだかが効きます。ここを見誤ると「何も出ない=不可能」と早合点したり、逆に「出た=確実」と誤認したりします。

ステップ3:候補探索(ディレクトリ→inode→extent)

狙いは一貫していて、ファイル名の手がかりがあるならディレクトリから辿り、inodeが特定できるならinodeからextent(データブロック範囲)を推定し、データ領域が残存しているかを確認します。ここで大事なのは、復旧の“成否”を1回のツール実行で決めないことです。痕跡は断片になりやすく、複数の手がかりを突き合わせて整合性を取る作業になります。

ステップ4:整合性確認(復旧“っぽいもの”を捨てる)

削除ファイル再構成では、“それっぽい断片”が出ることがあります。しかしBtoBの現場では、復旧できたかどうかは「開けた」だけでなく「内容が正しい」まで必要です。たとえばDBファイルならヘッダ、ログ、整合性チェック、アプリケーションレベルでの検証が必要になります。ここで“確からしさ”を上げるのが、専門家が強いポイントです。一般論の限界は、まさにこの検証設計で露呈します。

次章では、復旧の確率を一気に下げる“落とし穴”を整理します。ここは脚色できない、現場で何度も見てきたパターンです。

第8章:よくある落とし穴——上書き・TRIM・ローテーション・“善意の修復”が手がかりを消す

削除ファイル再構成が難しい理由は、ext4が賢いからでも、ツールが弱いからでもありません。多くは「削除後の通常運用」が、復旧に必要な痕跡を自然に上書きするからです。ここは、責任追及の話ではなく、現実の仕組みの話として押さえておくべきです。

落とし穴1:削除後の“少しだけ”書き込み

ログ出力、監視エージェント、パッケージ更新、コンテナのレイヤ更新、アプリのキャッシュ更新。どれも1回1回は小さいのに、積み重なるとジャーナルは巡回し、空き領域が再利用されます。結果として、ディレクトリブロックの過去状態や、inode周りの痕跡が薄れます。「復旧を急いだ結果、復旧が遠のく」典型です。

落とし穴2:SSD/NVMeのTRIM(discard/fstrim)

SSDでは、論理削除が物理消去に近づきやすい要因としてTRIMがあります。運用でdiscardマウントを使っている、定期的にfstrimが走っている、ストレージ側が積極的に回収する、といった条件があると、削除後の回収可能性は大きく変わります。ここは「ext4の理屈」だけでは決まらず、ストレージと運用の組み合わせで決まります。

落とし穴3:ログローテーション・バッチ・バックアップ

削除直後に“いつも通り”夜間バッチが走る、バックアップが走る、ログローテーションが走る。これらはディスクにまとまった書き込みを発生させ、ジャーナルの循環と空き領域の再利用を一気に進めます。削除に気づいたら、まず温度を下げる(場を整える)べき理由がここにあります。

落とし穴4:善意のfsck・自動修復・再起動の連発

壊れているかもしれないから整合性チェックをする、という発想自体は自然です。ただ、削除ファイル再構成の観点では、整合性回復のための処理が痕跡を整理してしまうことがあります。また、再起動に伴うサービス立ち上げやログ生成も書き込み要因です。焦りを抑え込み、まず“安全な初動”に寄せる方が結果が良いことが多いです。

ここまでの8章で、伏線(初動→痕跡→時間軸)が一本につながってきたはずです。次章では、これらを「判断基準」として言語化し、成功するケース/難しいケースを分ける条件式として整理します。

第9章:技術で腹落ちさせる——成功/難航を分ける条件式(判断基準の言語化)

ここまで読んで、「結局、復旧できるの?できないの?」という気持ちが残っていると思います。正直、それが健全です。なぜなら、ext4ジャーナル解析は“やれば必ず戻る手順”ではなく、“条件が揃えば手がかりを拾える可能性がある手段”だからです。だからこそ、現場で必要なのは「期待値のコントロール」ではなく、「判断基準の言語化」です。

心の会話、こうなりがちです。

「上に説明するとき、何を根拠に“今すぐ止める”“専門家に出す”を決めればいいんだろう…」

ここでは、復旧の見立てを“条件式”として整理します。これは一般論であり、個別案件では例外があります。ですが、現場の意思決定をブレなくする枠組みとして有効です。

条件式①:削除後の“追加書き込み量”は少ないか

| 観点 | 見立て(一般論) |

|---|---|

| 削除後すぐ停止できた | ジャーナルが上書きされにくく、ディレクトリ/inodeの痕跡が残る可能性が相対的に上がる。 |

| 削除後も通常運用が継続 | ジャーナル循環・空き領域再利用が進み、手がかりが薄れる。見込みは時間とともに下がる。 |

条件式②:ストレージ特性(特にTRIM)が復旧可能性を削っていないか

SSD/NVMeでdiscardや定期fstrimがある場合、論理削除が物理的な回収につながりやすくなります。ext4の理屈上「ブロックは残っているはず」という前提が崩れることがあるため、見込みを過大評価しないのが重要です。ここは“復旧作業の腕”で覆すのが難しい領域です。

条件式③:対象ファイルの種類は“検証可能”か

復旧できたかどうかは、最終的には「中身が正しいか」です。テキストや画像なら目視でも判断しやすい一方、DB・仮想ディスク・メールストア・アーカイブなどは、ヘッダや整合性・アプリ層での検証が必要です。つまり、復旧の価値は「取り戻せた断片」ではなく「業務として使える形で再現できたか」で決まります。

条件式④:環境の複雑さ(RAID/LVM/暗号化/仮想化)は一般論を超えていないか

RAIDやLVM、暗号化、VM基盤では、“どの層で削除が起きたか”が復旧の難易度を決めます。たとえばゲストOSのext4だけ見ていても、ホスト側のストレージ最適化やスナップショット運用が影響することがあります。ここで一般論の限界が出やすい。設計や運用の背景を含めて見立てる必要があるため、専門家に相談する合理性が高い領域です。

判断基準としてのまとめ(現場で使える形)

- 削除に気づいた時点で書き込みを抑え込みできたか(できていないなら急いで止める)

- SSD/TRIMの条件が厳しいなら、早期に専門家へ(時間が味方になりにくい)

- 復旧後の検証が難しい形式(DB/VM等)なら、最初から検証設計まで含めて相談する

- 環境が複雑なら、一般論で“ツールの当てずっぽう”をしない

この条件式を持っているだけで、現場の説明が変わります。「気合でやる」から「条件で判断する」に切り替わり、無駄な試行が減ります。次章で、この記事の帰結として“魔法ではないが価値がある”を着地させます。

第10章:帰結——ext4ジャーナル解析は魔法ではない。それでも“最後の1%”を拾う設計された実務である

ext4ジャーナル解析は、誤解されやすい領域です。「ジャーナルがあるなら戻るはず」「削除は参照を外しただけだから全部残っているはず」。どちらも半分は正しく、半分は危険です。正確には、ジャーナルは整合性を戻すための仕組みであり、削除後の痕跡は“条件が良いときに”断片として残り得る、という話です。

ここで“腹落ち”させたいポイントは2つあります。

ポイント1:一般論では決められない部分が必ずある

削除後の書き込み量、ジャーナルの巡回状況、TRIM、運用バッチ、ストレージ層、仮想化、暗号化、バックアップ体系。これらの組み合わせで、同じ「rm」でも結果が変わります。つまり、ネット記事の手順をなぞって成功するとは限りません。むしろ、一般論をそのまま実行すると“上書き”という取り返しのつかない方向に進むことがあります。

ポイント2:それでも専門的な解析が意味を持つ理由

ジャーナル解析やメタデータ解析は、“運が良いときだけ効く裏技”ではありません。条件が良いときに確率を最大化し、条件が悪いときに「どこまでが可能で、どこからが不可能か」を切り分け、無駄な時間を減らすための実務です。現場にとって価値があるのは、成功の可能性だけではなく、失敗の可能性を早く確定させて意思決定を前に進めることでもあります。

終盤の自然な結論:個別案件は、専門家に相談した方が“結果が良い”だけでなく“説明がラク”になる

BtoBの現場では、復旧は技術問題であると同時に、契約・監査・説明責任の問題です。「なぜ止めたのか」「なぜ原本を触らないのか」「なぜこの手順なのか」。この問いに答えられる形で進めるには、経験と手順の設計が要ります。

だからこそ、読者が具体的な案件・契約・システム構成で悩んだときは、一般論で抱え込まず、株式会社情報工学研究所への相談・依頼を検討してください。状況固定から解析方針、復旧後の検証まで含めて設計することで、被害最小化(ダメージコントロール)と軟着陸につながります。

問い合わせフォーム:https://jouhou.main.jp/?page_id=26983 / 電話番号:0120-838-831

付録:現在のプログラム言語各種での注意点(“復旧ツールを書く/使う”前に知っておくこと)

ここからは、削除ファイル再構成や証拠保全に関わるツール開発・運用で、現場が踏みやすい注意点を言語別に整理します。特定言語を推す意図ではなく、「やりがちな事故を減らす」観点です。実際の案件では、環境・権限・セキュリティ要件が絡むため、一般論の範囲を超える場合は株式会社情報工学研究所に相談して進めるのが安全です。

Python

- 手軽さゆえに“原本を触るスクリプト”が作られやすい:解析対象は必ずイメージ上で扱い、マウントオプションや出力先に注意。

- ライブラリ依存が多い:環境差で挙動が変わる(特にバイナリ解析系、OS依存のI/O)。要件を固定し、再現性を担保する。

- 例外処理の雑さが事故に直結:途中失敗で中途半端に書き込みが走る設計を避ける。

Go

- 並行処理が書きやすいが、I/Oの並列化が“余計な負荷”になり得る:原本へのアクセスは抑制し、読み取り専用・帯域制御を意識する。

- バイナリ処理は強いが、境界チェックが甘いと誤解釈が静かに進む:検証用のテストデータセット(既知の正解)を用意する。

Rust

- 安全性の恩恵は大きいが、開発速度と実装難易度が上がりやすい:短納期案件で“途中まで”のツールが運用されるリスクに注意。

- 低レベルI/Oは強力だが、要件が曖昧だと過剰最適化しがち:まずは手順と検証設計を固める。

C / C++

- 最も自由度が高い反面、メモリ破壊や境界バグが“誤った復旧結果”を生む:結果の正しさを担保する仕組み(ハッシュ、二重実装比較など)が必要。

- 権限・デバイスアクセスを扱いやすいが、誤って原本へ書き込む実装も起きやすい:read-onlyを強制する設計を優先。

Java / Kotlin(JVM系)

- “生ディスク”や低レベルI/Oの扱いが環境依存になりやすい:結局ネイティブ依存が入り、運用が複雑化することがある。

- 大容量データ処理でGCやメモリ設定がボトルネックになる:ストリーミング設計と検証を前提にする。

JavaScript / TypeScript

- ブラウザ上での本格的なブロックデバイス解析は制約が大きい:UIやワークフロー、可視化に向く一方、低レベル復旧は不向き。

- Node.jsでもファイルI/Oはできるが、OS依存・権限・性能要件で壁が出やすい:本番用途は設計段階で現実性を見極める。

Shell(bash等)

- ワンライナーが強いが、“思った以上に破壊的”になりやすい:対象パス・リダイレクト先・sudoの扱いを誤ると事故が即発生する。

- ログや証跡を残す設計が弱くなりがち:実行履歴、引数、ハッシュ、タイムスタンプの採取をセットにする。

言語共通の注意点(最重要)

- 解析は原本ではなくイメージ上で行う(原本を触る回数を減らす)

- 出力先を同一ディスクにしない(上書きの自己破壊を避ける)

- 復旧結果は“開けた”だけでなく“正しい”を検証する(BtoBはここが本番)

- 個別案件(契約・監査・複雑な構成)は一般論で抱え込まず、専門家に相談する

削除ファイル再構成は、現場の努力を“成果”につなげるために、最初に場を整え、条件で判断し、検証まで設計する領域です。もし今まさに案件として悩んでいるなら、遠回りを避けるためにも、株式会社情報工学研究所への相談・依頼を検討してください。

問い合わせフォーム:https://jouhou.main.jp/?page_id=26983 / 電話番号:0120-838-831

もくじ

- 「rmしただけ」なのに、なぜ復元は難しくなるのか――ext4の“消え方”から考える

- まずは地図を描く:ext4のメタデータ(inode / dentry / block group)とジャーナルの役割

- ジャーナルは“ログ”ではない:ordered / writeback / data=journal が意味するもの

- 伏線①:unlink後に何が残る?――dentry消失とinodeの寿命(再利用)のタイムライン

- 伏線②:復元の鍵は「データ本体」より「参照の痕跡」――トランザクション境界を読む

- まず止めるべきこと:mount継続・fsck・再起動が“手掛かり”を上書きする理由

- 実務手順の骨格:イメージ取得→スナップショット→読み取り専用解析の最短ルート

- ext4ジャーナル解析の勘所:commit/descriptor/revokeを追って“更新意図”を復元する

- 再構成の現実解:失われたパス名・断片化・暗号化(fscrypt)の壁と、成功率を上げる設計

- 帰結:ジャーナルは「復元ツール」ではなく「再現性のある調査手掛かり」――だから設計で勝てる

【注意】 削除ファイルの復元は「上書き」を一度でも起こすと成功率が大きく下がります。安易な再起動・fsck・マウント継続は状況を悪化させることがあるため、まずは被害最小化(ダメージコントロール)を優先し、個別環境の要件(暗号化・RAID・仮想化・SSDのTRIM等)を確認できる株式会社情報工学研究所のような専門事業者へ相談してください。

「rmしただけ」なのに、なぜ復元は難しくなるのか――ext4の“消え方”から考える

現場でよくあるのが、「消したのは一つのファイルだけ」「ログを整理しただけ」「容量が足りなかったからrmしただけ」という状況です。ところが ext4 では、ファイル名(ディレクトリエントリ)を外す操作と、実データが上書きされることは別の話になります。rm(unlink)はまず“参照”を外し、inodeのリンク数を減らし、必要に応じてメタデータを更新します。ここで困るのは、復元に必要な「どのブロックがそのファイルだったか」という対応関係(extent など)が、メタデータ更新の連鎖の中で失われたり、再利用されたりする点です。

もう少し具体的に言うと、削除後に残る可能性があるのは、主に次の2種類です。

- データ本体:ブロック(またはextentに紐づく領域)自体は、すぐにはゼロ化されないことが多い

- 手掛かり(メタデータの痕跡):どのinodeがどのブロックを指していたか、どのディレクトリに居たか、更新の順序はどうだったか

しかし復元で本当に難しいのは、前者より後者です。データ本体が残っていても、参照関係が失われると「それが何のデータか」を特定できないからです。逆に言えば、参照の痕跡を拾えれば再構成の道が開けます。ここで登場するのが ext4 のジャーナル(JBD2)です。

ただし誤解してはいけないのは、ext4ジャーナルは一般に「アプリのログ」ではなく、ファイルシステム更新を整合させるためのトランザクション記録だという点です。ジャーナルに“ファイルの中身”が常に入っているわけではありません(例外は data=journal 構成)。それでも、メタデータ更新の断片が残ることで、「いつ・どのinodeが・どう更新されたか」を追跡できる場合があります。この記事は、そこを過度に美化せず、現実の制約と成功率を上げる実務手順までを一気通貫で整理します。

心の会話で言うなら、こうです。

「また復旧案件か……。しかも“rmしただけ”って言われても、こっちは“その後に何したか”が一番怖いんだよな。」

その感覚は正しいです。削除直後よりも、運用を続けた数分〜数時間後の方が、上書き・再利用・TRIMなどの要因で状況が悪化しやすいからです。以降の章では、まず“地図(構造)”を描き、その上でジャーナルをどう読むか、どこで諦めがつくか、判断軸を作っていきます。

まずは地図を描く:ext4のメタデータ(inode / dentry / block group)とジャーナルの役割

復元やフォレンジックでまず必要なのは、「何がどこにあるか」を言語化できる地図です。ext4は大雑把に言うと、データ本体と、それを指し示すメタデータで成り立ちます。削除ファイル再構成では、データ本体よりもメタデータ側(inode・ディレクトリエントリ・extent木)をどう扱うかが勝負になります。

主要要素を整理すると次のとおりです。

| 要素 | 役割 | 復元観点のポイント |

|---|---|---|

| inode | 所有者/権限/時刻/サイズ/データ位置(extent等)を持つ | リンク数が0になっても、再利用されるまで内容が残る場合がある |

| dentry(ディレクトリエントリ) | ファイル名→inode番号の対応 | unlinkで消えやすい。ファイル名復元の最難所になりがち |

| extent | 連続領域をまとめて表す(ブロック範囲の木構造) | 断片化や再利用で追跡が難しくなる。痕跡があれば再構成に有利 |

| block group | inode tableやビットマップ等をグルーピング | どのグループのビットが更新されたかが手掛かりになる |

| ジャーナル(JBD2) | 更新をトランザクションとして記録し、クラッシュ時整合を担保 | 更新順序・対象ブロックの痕跡から“何が起きたか”を推測できる場合がある |

ext4ジャーナル(JBD2)は、ざっくり言えば「更新のやり直し(リプレイ)で整合を取るための領域」です。ここで重要なのは、ジャーナルが記録しているのは“更新そのもの”であって、必ずしも“元の状態”ではないことです。削除後にジャーナルを見るのは、タイムマシンとして期待するためではなく、どのメタデータがいつ更新されたかを辿って、ファイルの痕跡を再接続するためです。

さらに実務では、ファイルシステム単体ではなく、構成要素が絡みます。

- RAID/仮想化(LVM、mdadm、ハイパーバイザのスナップショット)

- SSDのTRIM/discard(未使用領域の解放が“物理的な消去”に近づく)

- 暗号化(LUKS、fscryptなど。復元可能でも内容解読が別問題)

この段階で「一般論の限界」が見えてきます。復元の設計は、ディスク種別・マウントオプション・上位レイヤ(RAID/VM)まで含めた“全体の地図”が必要です。次章では、その地図の中でジャーナリング方式が何を意味するかを整理します。

ジャーナルは“ログ”ではない:ordered / writeback / data=journal が意味するもの

ext4のジャーナリングを語るとき、必ず出てくるのが data=ordered / data=writeback / data=journal です。ここを曖昧にすると、復元の期待値がズレます。結論から言うと、一般的なサーバでは data=ordered が多く、「メタデータはジャーナルに入るが、ファイル内容(データ本体)は基本的に入らない」という理解が出発点になります。

3つの違いを整理します(実装や状況により例外はありますが、考え方の軸として)。

| モード | データ本体の扱い | 復元・再構成への含意 |

|---|---|---|

| data=ordered | データ本体を先に書き出してからメタデータをコミットするよう順序を保証 | クラッシュ整合性は高め。ジャーナルからは主にメタデータ痕跡を追う |

| data=writeback | 順序保証が弱い(メタデータが先に出る可能性) | クラッシュ時に古いデータが新しいメタデータに紐づくリスク。解析はより慎重に |

| data=journal | データ本体もジャーナルに書き、後で本体領域に反映 | 条件が合えば“データ本体”がジャーナルに残り得るが、性能コストが高く一般的ではない |

ここで現場あるあるの勘違いが一つあります。

「ジャーナルがあるなら、消したファイルもジャーナルに残ってるはず」

残念ながら、通常構成(data=ordered等)では、それは成り立ちません。ジャーナルは“更新の整合”が目的なので、長期保管や監査ログのように過去を保持し続ける設計ではありません。ジャーナル領域は循環利用され、時間が経つほど古いトランザクションは上書きされます。したがって、復元の可否は「削除からの経過時間」だけでなく、ジャーナルサイズ・更新頻度・その後のI/O負荷に強く依存します。

さらに、ジャーナル解析で重要な概念が トランザクション と コミット です。更新は複数のブロック(inodeテーブル、ビットマップ、ディレクトリブロックなど)に跨ります。どこまでが1回の更新としてまとまっているかを見誤ると、「それっぽい痕跡」を別ファイルのものとして誤結合し、誤復元を誘発します。次章では、unlink後のタイムライン(何が先に消えるか、何が残り得るか)を“伏線”として整理します。

伏線①:unlink後に何が残る?――dentry消失とinodeの寿命(再利用)のタイムライン

削除ファイル再構成で、最初にぶつかる壁は「ファイル名が分からない」問題です。ext4では、ファイル名はディレクトリエントリ(dentry)側にあり、inodeはあくまで属性とデータ位置を持つだけです。つまり、inodeが見つかっても名前が戻らないことは普通に起きます。

unlink(rm)直後に起きる代表的な変化を、タイムラインとして捉えます。

- ディレクトリからエントリが外れる(名前→inode番号の対応が消える)

- inodeのリンク数が減り、0になれば「参照が無い」状態になる

- 空き領域として扱えるようになり、inodeやデータブロックが将来再利用され得る

ポイントは「削除=即ゼロ化」ではなく、「削除=再利用可能になった」という状態遷移だということです。ここから先は、運用が続けば続くほど、再利用や上書きが進み、復元は難しくなります。

さらにSSD環境では、TRIM/discard が状況を一気に変えます。ファイルシステムが「ここは未使用」と判断した領域が、ストレージ側で解放・整理され、結果として読み出し可能性が下がるケースがあります(挙動はデバイスや設定に依存します)。仮想基盤やクラウドでも、ストレージ層が同様の最適化を行うことがあり、論点はディスク単体に閉じません。

現場目線の“心の会話”を入れるなら、こうなります。

「削除した直後に言ってくれれば…いや、今からでも“追記しない”だけで違う。とにかく温度を下げて、書き込みを止めたい。」

この「温度を下げる」判断が、技術的には書き込み停止(被害最小化)です。以降の章で扱うジャーナル解析は、前提としてディスク(またはボリューム)のイメージ取得と読み取り専用での解析が必要になります。マウントしたまま解析ツールを回すだけで、アクセス時刻更新やログ出力などの副作用が起き得るためです。

次の伏線は、「ジャーナルのどこを見れば“更新意図”が分かるのか」です。具体的には descriptor / commit / revoke といった要素をトランザクション単位で追い、メタデータの更新ブロックを再接続していきます。ここを誤ると、復元できたように見えて中身が別物(誤結合)という事故が起きます。次章でそこに踏み込みます。

伏線②:復元の鍵は「データ本体」より「参照の痕跡」――トランザクション境界を読む

ext4ジャーナル解析で最初に腹落ちさせたいのは、「ジャーナルを掘ればファイルが丸ごと出てくる」という発想を捨てることです。一般的な構成(data=ordered 等)では、ジャーナルが持つ主役はメタデータ更新の痕跡です。削除ファイル再構成の現場で効くのは、データ本体が残っているかどうかよりも、そのデータ本体を“どのファイルとして扱うべきか”を裏付ける参照情報がどれだけ残っているか、です。

ジャーナル(JBD2)はトランザクション単位で更新を扱い、典型的には次のような要素を持ちます。

- descriptor:このトランザクションで更新される“本体ブロック”がどれかを列挙する手掛かり

- data blocks:実際の更新内容(多くはメタデータブロックの新しい状態)

- commit:トランザクションが確定したことを示す境界

- revoke:特定ブロックを“リプレイ対象から外す”意図を示す(誤リプレイ回避)

ここで重要なのが、commitを境にして整合性の前提が変わることです。commitの無い更新断片は、クラッシュ時に反映されない可能性がある=「確定していない」扱いです。一方、commitされた更新は、原則としてファイルシステムに反映される前提で設計されています。削除再構成でジャーナルを読むときは、“どこまでが1回の更新として確定したか”を外すと、痕跡の結び付けが崩れます。

では「参照の痕跡」とは何か。削除(unlink)や追記・移動・リネームの周辺で更新されやすいメタデータは、概ね次の領域です。

- 対象ディレクトリのブロック(ディレクトリエントリの追加・削除)

- 対象inode(リンク数、時刻、フラグ、extent情報など)

- ブロック/ inode のビットマップ(割当・解放)

- extent tree を格納するメタデータ(深い木になっている場合)

つまり、削除直後のジャーナルには、「このディレクトリブロックがこう変わった」や「このinodeがこう更新された」といった“更新後の姿”が残り得ます。更新前(削除前)の姿が必ず残るわけではありませんが、更新後の姿だけでも「どのinodeが関わったか」「どのブロック群が動いたか」を推測できる場合があります。

ここで現場が一番やりがちな失敗が、“それっぽい断片を勝手に繋ぐ”ことです。例えば、あるinodeのextentっぽい情報が見えたとしても、それが別のファイルに再利用された後の状態かもしれません。だからこそ、ジャーナル解析では「トランザクション境界」を軸にして、

- いつ確定した更新か(commit)

- どのブロック群が同じ更新として束ねられているか(descriptor)

- 除外された更新はないか(revoke)

を押さえ、“ストーリーとして一貫する更新”だけを採用していきます。言い換えると、ジャーナルは「更新の物語」を読むための資料であり、単なるバイト列の発掘ではありません。

心の会話としては、こうです。

「復元できたっぽいファイルが出た。でも、これ…本当にあのファイル?中身が“それっぽい”だけで、別物だったら事故だよな。」

この疑いは健全です。BtoB案件では、誤復元は“復旧失敗”より重いことがあります。以降の章では、その事故を避けるために、まず現場で最優先にすべき被害最小化(ダメージコントロール)の手順、次にイメージ取得と読み取り専用解析の設計を具体化し、最後にジャーナル解析の実際の勘所へ進みます。

まず止めるべきこと:mount継続・fsck・再起動が“手掛かり”を上書きする理由

削除ファイル再構成の相談で、最初に確認したいのは「その後、何をしましたか?」です。ここでいう“何”は、派手な操作ではありません。むしろ、普段の運用で自然に起きる動き――ログローテート、監視エージェント、cron、バックアップ、パッケージ更新――が、復元の手掛かりを削っていくことがあります。だから最初にやるべきは、精神論ではなく環境の温度を下げること、つまり書き込みを止めることです。

特に避けたい行為を、理由とセットで整理します。

| 避けたい行為 | なぜ危ないか(復元観点) |

|---|---|

| マウント継続(通常運用のまま) | ログ・一時ファイル・DB更新などで未使用領域が再利用され、データ本体やメタデータが上書きされる |

| fsck の実行 | 整合性修復の過程でメタデータを書き換え、痕跡が改変される可能性がある(復元目的とは相性が悪い) |

| 再起動 | 起動時サービスが大量に書き込みを行う場合がある。ジャーナルリプレイが走るケースもあり、状況が変わる |

| 当該ボリュームへの新規インストール/更新 | 大きな書き込みが発生し、未使用領域が急速に消費される。ジャーナルも循環上書きされやすい |

| 同一ディスク上への復旧先出力 | 復元作業そのものが上書きになり得る(復旧先は別媒体が原則) |

「でも、止めるとサービスが落ちるじゃないですか」という現実もあります。ここがBtoBの難しさです。だからこそ、いきなり全停止ではなく、被害最小化の優先順位を決めます。例えば次のように段階化します。

- 当該ボリュームへの書き込みを止める(可能なら read-only remount、難しければ対象プロセス停止)

- スナップショットやLVMのコピーを取れるなら、まずそれを取る

- 取れないなら、物理/論理イメージ取得を最優先で実施する

大事なのは、復元を「今の本番ボリューム上で頑張る」発想を捨てることです。解析はコピー上でやる、復旧出力も別媒体へ出す。これが基本です。

ここで、よくある“心の会話”をそのまま書きます。

「また新しい手順増やすの?って言われそうだな……。でも、ここで止めないと、後で“なんで戻らないの”って責められるのも現場なんだよな。」

この板挟みも、現場あるあるです。だから、次章では「止める」の次にやるべきこと――イメージ取得→読み取り専用解析を、手順として具体化します。ここを設計できると、上司や顧客への説明も一段ラクになります。「何を根拠に、どこまでが確実で、どこからが推測か」を分離して話せるようになるからです。

実務手順の骨格:イメージ取得→スナップショット→読み取り専用解析の最短ルート

ext4ジャーナル解析による再構成は、テクニック以前に“段取り”で勝負が決まります。段取りが悪いと、解析を始めた瞬間に状況が変わり、結果の信頼性が落ちます。逆に段取りが固まっていれば、難しいケースでも「どこまでが確実か」を守りながら進められます。ここでは、現場で再現しやすい骨格を提示します。

1) まず“写し”を作る(スナップショット or ディスクイメージ)

最優先は、対象状態を固定することです。LVMを使っているならスナップショット、仮想基盤ならハイパーバイザ側スナップショットが取れる場合があります。取れない場合は、ディスク(または論理ボリューム)のイメージ取得に進みます。重要なのは、取得対象が「ファイル」ではなく「ブロックデバイス」である点です。ファイル単位コピーでは、削除領域やメタデータの痕跡を含められません。

2) 解析は読み取り専用で(マウントするなら ro、可能ならマウントしない)

解析環境に持ち込んだら、原則として読み取り専用で扱います。マウントが必要でも ro で行い、可能であればマウントせずにツールが直接イメージを参照できる形を選びます。理由は単純で、マウントは副作用(時刻更新など)を起こし得るからです。副作用がゼロとは限りません。

3) “事実”と“推測”を分けてログ化する

削除ファイル再構成は、常に確率と制約の話です。だから、作業の途中からでも報告できるように、「何が観測事実で、何が推測か」を分けて記録します。例えば、

- 観測:このinode番号に、特定のextent範囲が設定されていた痕跡がある

- 推測:それが目的ファイルである(可能性が高い/中/低)

のように分離します。BtoBでは、この分離が後で効きます。説明責任が求められるからです。

ここまでが“骨格”です。次章では、いよいよジャーナル解析の具体的な勘所に入ります。descriptor/commit/revoke をどう扱い、どこで誤結合を避けるか。さらに、終盤では「一般論の限界」と「個別案件では専門家に相談すべき理由」へ自然につなげていきます。

ext4ジャーナル解析の勘所:commit/descriptor/revokeを追って“更新意図”を復元する

ここからが「Linux Journal解析」と呼べる核心です。ただし、いきなり難しい話に飛ぶ前に前提を1つだけ。ジャーナルは“過去の状態の保存庫”ではなく、整合性のための更新記録です。したがって解析のゴールは「ジャーナルから削除前の完全な姿を取り出す」ではなく、更新の流れを再構成して、誤結合を避けながら手掛かりを繋ぐことになります。

JBD2の解析で見るべき観点を、実務で使える形に落とすと次の3点です。

- descriptor:このトランザクションで“どの本体ブロック”が更新対象になっているか

- commit:更新が確定した境界(ここを跨いだ解釈を誤ると事故る)

- revoke:特定ブロックをリプレイ対象から外す意図(「見えている=採用」ではない)

削除ファイル再構成で危ないのは、「それっぽいブロックが見えたから採用する」という短絡です。descriptor→data→commit のまとまりが揃って初めて、その更新が“確定した変更”として扱える可能性が出ます。

トランザクション境界で“同じ出来事”を束ねる

例えば、unlinkは1箇所だけの更新では終わりません。典型的には、

- ディレクトリブロック(エントリ削除/無効化)

- 対象inode(リンク数、時刻、フラグ等)

- ビットマップ(inode/ブロック解放の反映)

のように、複数ブロックが同じ“出来事”として更新されます。ジャーナル解析では、これらが同一トランザクション内で一貫しているかを必ず確認します。別トランザクションの断片を混ぜると、「ファイルっぽいもの」が出来てしまい、後で中身が破綻します。

revokeは「見えた更新を捨てる」判断材料になる

revokeは直感に反します。多くの人は「ジャーナルにある=復元に使える」と思いがちですが、revokeは“そのブロックはリプレイしない”という意図を示します。解析としては、revokeがある場合、

- その更新は確定していない可能性

- 別の更新で上書きされる前提

- あるいは回避すべき誤リプレイ

などを疑う必要があります。つまり、revokeは「手掛かり」ではありますが、手掛かりの採用可否を左右する“赤信号”になり得ます。

実務での“確認ポイント”をチェックリスト化する

ここは実務で使えるように、確認観点をチェックリストとして置いておきます。

- 対象の更新は commit まで揃っているか(境界が曖昧な断片に飛びついていないか)

- 同一トランザクション内の更新ブロック群に矛盾がないか(ディレクトリ/ inode/ ビットマップが整合しているか)

- revoke が絡む場合、そのブロックを“採用してよい理由”を説明できるか

- その後の運用で再利用が起きていないか(別トランザクションで同じ領域が別用途になっていないか)

心の会話で言うと、こんな感じです。

「ジャーナルって万能じゃない。でも、更新の筋道を外さなければ、“何が起きたか”は説明できる。説明できるなら、判断できる。」

この“説明できる状態”を作るのが、ジャーナル解析の価値です。次章では、その価値がどこで頭打ちになるか――失われたパス名、断片化、暗号化、TRIMなどの壁を正面から整理します。

再構成の現実解:失われたパス名・断片化・暗号化(fscrypt)の壁と、成功率を上げる設計

ここは“夢を壊す章”になりがちですが、BtoBではむしろ重要です。なぜなら、削除ファイル再構成は「できる/できない」の二択ではなく、どこまでが確実で、どこからが推測かの境界線を引く仕事だからです。そして、その境界線は環境の条件で大きく動きます。

代表的な壁を、現象→なぜ厳しいか→現実的な打ち手、の順で整理します。

1) パス名(ファイル名/ディレクトリ階層)が戻らない

現象:データ本体やinodeの痕跡が見つかっても、元のファイル名が特定できない。

理由:ファイル名はディレクトリエントリ側にあり、unlinkで失われやすい。さらにディレクトリブロック自体が更新・再利用されると、痕跡が薄れる。

打ち手:復元結果は「名前未確定の候補データ」として扱い、アプリケーション側の構造(ヘッダ、マジック、ログフォーマット)で照合して確度を上げる。BtoBでは“確度”を明示し、誤復元リスクを抑える。

2) 断片化で“1ファイル=1連続領域”が崩れる

現象:ファイルが複数のextentに分かれ、順序や結合が難しくなる。

理由:extentは連続領域を効率よく表しますが、断片化が進むほど木構造が深くなり、痕跡が欠けると再構成が困難になる。

打ち手:「完全復元」をゴールに固定しない。ログなら“有意な区間”だけ取り出して説明可能にする、DBならページ単位で整合性検査する等、目的に合わせて復元単位を設計する。

3) SSDのTRIM/discardで“物理的な読み出し可能性”が落ちる

現象:未使用領域が解放され、読み出してもゼロ・無効値のように見えるケースがある。

理由:ストレージ側最適化により、未使用と判断された領域が保持されないことがある(挙動は機種・設定に依存)。

打ち手:削除が発覚したら、まず被害最小化(書き込み停止)を最優先にし、可能なら即座にイメージ取得へ。そもそも運用設計として、スナップショット/バックアップと組み合わせて「削除復旧をジャーナル頼み」にしない。

4) 暗号化(LUKS / fscrypt)で“復元=読める”にならない

現象:領域からデータが取れても、鍵が無ければ内容が解釈できない。

理由:暗号化は設計上“第三者が読めない”ことが目的。復元はできても復号は別問題になる。

打ち手:鍵管理(KMS、バックアップキー、運用手順)を含めて復旧計画を作る。事故時に「鍵がどこにあるか分からない」を起こすと、技術的に詰むことがある。

ここまで読むと、こんな独り言が出るはずです。

「結局、運が良ければ戻る、じゃ困るんだよな。案件として“再現性”が欲しいんだ。」

その通りです。だから現実解は、ジャーナル解析を“最後の手段”として温存できる設計に寄せることです。具体的には、

- 削除に強い運用(スナップショット/世代バックアップ/リカバリ手順)

- インシデント時の初動(書き込み停止→写し→読み取り専用解析)

- 暗号鍵の保全(鍵管理の手順化と監査)

を、システム構成や契約(RTO/RPO、保全範囲)に落とし込む必要があります。次章では、それでも起きる「個別案件の判断」へ進み、一般論の限界と、専門家に相談すべき理由を自然につなげて締めます。

帰結:ジャーナルは「復元ツール」ではなく「再現性のある調査手掛かり」――だから設計で勝てる

ここまでの話を、最後に一本の線にまとめます。ext4のジャーナル解析は、魔法の復元術ではありません。けれど、現場が求めるのは魔法ではなく、説明できる判断です。ジャーナルが価値を持つのは、「削除前の完全な過去」を保存するからではなく、更新がどう起きたかをトランザクション単位で追えるという“調査の再現性”を与えるからです。

BtoBの現場では、復元そのものよりも次の問いが重くなります。

- 本当に必要なデータは何か(全部か、期間か、特定テーブルか、ログの一部か)

- 復旧の確度とリスクはどれくらいか(誤復元・情報漏えい・証跡改変のリスク)

- 復旧の手段は何があるか(バックアップ/スナップショット/ジャーナル解析/アプリ側再生成)

- 誰が何を判断し、どこまで責任を持つか(契約、SLA、監査)

ジャーナル解析は、この問いに対して「観測事実」と「推測」を切り分け、根拠ある説明を可能にします。だからこそ、技術的には“最後の一撃”でありながら、意思決定の場では“最初に必要な材料”になり得ます。

そして、ここで一般論の限界がはっきりします。TRIMの挙動、仮想化レイヤのスナップショット可否、暗号鍵の所在、RAIDの構成、I/O負荷、ログローテートのタイミング――これらは現場ごとに違い、正解は1つではありません。つまり、ブログで語れるのは「考え方」と「最短の骨格」までで、復旧手段の選択・順序・停止判断は個別設計になります。

心の会話で締めるなら、こうです。

「“こうすれば必ず戻る”って言えないのは分かってる。でも、“何をやると悪化するか”と“何を先に固定すべきか”は、ちゃんと設計でコントロールしたい。」

この発想に立てた時点で、現場は一段前に進んでいます。もし今、

- 削除が起きていて、止めるべきか迷っている

- バックアップはあるが、RPO/RTOや整合性で不安がある

- 暗号化・仮想化・RAIDが絡み、手順が複雑で判断に困っている

という状況なら、案件の条件を棚卸しして“最短で被害最小化(ダメージコントロール)できる手順”を作る価値があります。株式会社情報工学研究所では、環境条件(暗号化・ストレージ・仮想化・運用制約)を前提に、止め方・写し方・解析の進め方を整理し、必要なら復旧作業まで含めて伴走できます。一般論で無理に押し切らず、個別条件に合わせて安全側に倒す――その方が結果的にコストも損失も抑えられます。

付録:現在の主要プログラミング言語で実装する際の注意点(ディスク/ジャーナル解析・削除ファイル再構成)

最後に、ext4(JBD2)ジャーナル解析や削除ファイル再構成のような「ブロックデバイス/バイナリ構造体を扱う実装」を、各言語で行う際の注意点をまとめます。ここでいう注意点は、言語の優劣ではなく、事故(上書き・誤解析・誤復元・情報漏えい)を起こしやすい落とし穴と、現場での回避策です。

まず全言語共通の原則(これを外すと全てが崩れる)

- 解析対象は必ず「写し(イメージ/スナップショット)」を使う。原本を直接触らない。

- 読み取り専用(read-only)を徹底する。復旧先の書き戻しやマウント継続は、痕跡の上書きを招き得る。

- 入力は常に不正・破損を想定する(部分欠損、途中ゼロ化、メタデータ矛盾、想定外サイズ)。パーサは堅牢性が最優先。

- 観測事実と推測をログで分ける(「見えた」/「そう推定した」)。BtoBでは説明責任が残る。

- 既存実装・仕様(e2fsprogs等)を参照し、自己流の構造体定義や境界条件で突っ走らない。

言語別の落とし穴と対策

| 言語 | 落とし穴(ありがち) | 対策の方向性 |

|---|---|---|

| C / C++ | ポインタ/境界チェック不備、構造体パディング/アラインメントの誤り、エンディアン/サイズ取り違えで誤解析やクラッシュが起きやすい | 構造体はpacked前提にせず明示的にバイト列からデコード、全フィールドの長さ検証、fuzz/ASan/UBSanで堅牢性を担保 |

| Rust | unsafeの多用で“安全神話”が崩れる、ゼロコピー最適化で境界条件を見落とす、バイナリ互換の誤解(repr(C)だけで安心しがち) | unsafeは局所化し、パースは検証→変換の二段階に分ける(validated struct)、不正入力の早期リジェクトを徹底 |

| Go | binary.Readの直読で構造体レイアウトを誤る、巨大イメージ処理でGCがボトルネック、並列化でI/O競合しがち | 手動デコード+範囲検証、ストリーミング処理(bufio)でメモリ一定化、並列は“解析単位”を分けてI/Oを制御 |

| Java / Kotlin | ByteBufferの符号付き/符号なし扱い、int/longの境界、巨大ファイルでヒープ枯渇、NIOのマッピングで例外時のハンドリング不足 | unsigned相当の扱いを徹底、I/Oはストリーム+チャンク処理、例外時に中間状態を必ず破棄しログを残す |

| C# | BinaryReaderの読み取り位置ズレ、Span/Memoryで速度を出すほど境界ミスが見えにくい、Windows環境でのデバイスアクセス権限・排他が絡む | 読み取り位置を常に検証、境界条件をテスト化、権限/排他エラー時に即中断し“写し”へ誘導する設計 |

| Python | 速度不足で大容量解析がタイムアウト、struct.unpackで境界を見落とす、例外処理不足で途中成果が失われやすい | チャンク処理+必要箇所のみ解析、重要部はC拡張/既存ツール併用、例外でも途中ログと成果物を残す |

| Ruby | 大容量バイナリ処理が遅くなりやすい、pack/unpackでの境界確認不足、依存gemの更新で再現性が崩れる | 解析範囲を限定(絞り込み設計)、入力検証の徹底、バージョン固定と実行環境の再現性を確保 |

| PHP | バイナリ解析用途としてはランタイム制約が多い(メモリ上限・実行時間)、fopen系の扱いで途中切断しやすい | “解析はPHPでやらない”判断も重要(フロントはPHP、解析は別サービス/CLIへ分離)、ワーカー化で時間制限を回避 |

| JavaScript / TypeScript(Node.js) | Buffer操作での境界ミス、非同期I/Oで順序が崩れやすい、巨大ファイル処理でイベントループが詰まる | ストリーム処理+バックプレッシャ、境界検証を関数化、CPU重い処理はWorker Threads等で分離 |

| Bash / シェル | dd等のコマンド誤用で書き込み事故が起きやすい、パイプでのエラー伝播が曖昧、ログが散逸する | 原本に対して書き込みが発生するコマンドを避ける、set -euo pipefail、手順は必ず“写し前提”でテンプレ化 |

| PowerShell | Windows側の権限・ロック・パス周りで事故が起きやすい、バイナリ処理のパフォーマンスが課題になりやすい | 低レベル解析は専用ツール/サービスへ分離、PowerShellはオーケストレーション(実行管理・ログ集約)に寄せる |

なぜ「言語選定」だけでは解決しないのか(一般論の限界)

ここまで見て分かる通り、言語ごとに落とし穴は違いますが、削除ファイル再構成の成否を左右する本質は別にあります。TRIM/discardの有無、仮想化・RAID・スナップショットの可否、暗号鍵の保全、運用停止の制約、ログローテーションのタイミング――これらはコード品質より先に復元可能性を決める要因になり得ます。

つまり、ブログの一般論で言えるのは「安全に進める骨格」と「事故を避ける原則」までで、個別案件で必要になるのは、環境条件を踏まえた優先順位付け(どれを先に固定し、どこで諦め、どこで攻めるか)です。

もしあなたが今、

- 「止めたいが止められない」制約の中で、被害最小化(ダメージコントロール)をどう設計するか悩んでいる

- 暗号化・仮想化・RAIDが絡み、復旧の順序や責任分界(契約/SLA/監査)まで含めて整理が必要

- 復元の確度と誤復元リスクを、根拠を持って説明できる形にしたい

という状況なら、一般論をつなぎ合わせるより、最初から条件を棚卸しして“安全側に倒した手順”を作る方が早いです。株式会社情報工学研究所では、技術(ext4/ジャーナル/ストレージ)と運用(止め方・写し方・説明責任)をセットで整理し、状況に応じて復旧作業まで含めた支援が可能です。案件・契約・構成が絡むほど、早めの相談が結果として損失・工数の抑え込みにつながります。

- ext4 ジャーナル解析を通じて削除ファイルを確実に再構成し、システム障害によるデータ損失の影響を最小化します。

- 政府ガイドラインに適合した3重化保存設計および運用体制の構築方法を示し、緊急時・無電化時・停止時の具体的手順を提案します。

- 個人情報保護法、経済安全保障推進法などの法令変化を踏まえた対応策を提示し、法令遵守と事業継続性を両立させる施策をまとめます。

ext4 ジャーナルとは何か

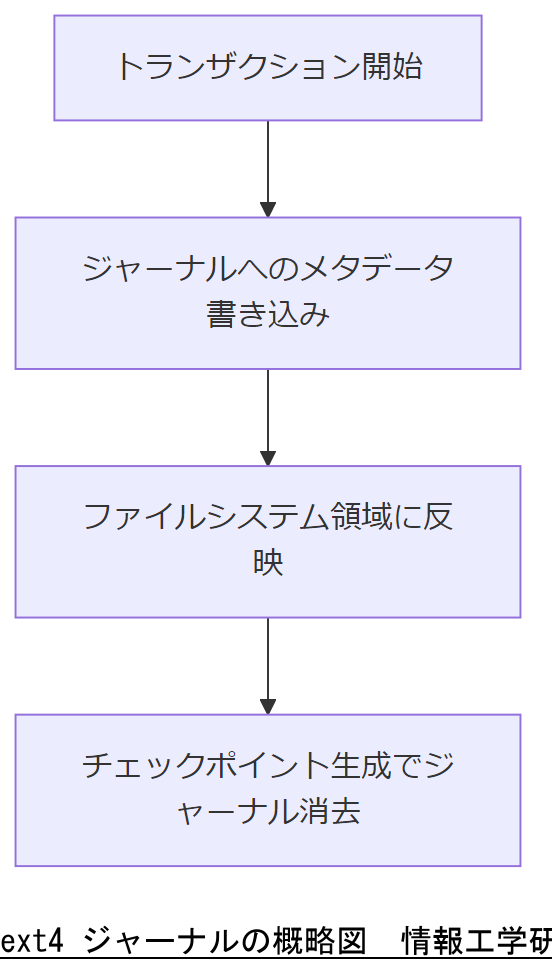

Linux の ext4 ファイルシステムは、ジャーナル機能と呼ばれるログ領域を持ち、ファイル操作のメタデータを先行記録します。これにより、突然の電源断やシステムクラッシュ後も一貫性のあるファイル構造を維持できます。ジャーナルはトランザクション単位でメタデータを記録し、チェックポイント生成やロールバックを実現するための仕組みを提供します。[出典:IPA『基本情報技術者試験シラバス』2024年]

概略と仕組み

ext4 ジャーナルは、ファイルシステムのメタデータ(inode 情報やディレクトリ構造など)をログ形式で保持します。ファイル作成や削除、書き込みなどの操作はまずジャーナル領域に記録され、その後、実際のデータ領域に反映されます。具体的には、ジャーナル領域に「開始記録 (Start Transaction) → メタデータ書き込み → 完了記録 (Commit)」という一連のトランザクションを記録し、電源断発生時に不完全なトランザクションをロールバックして整合性を保ちます。この仕組みによって、ext4 は高い耐障害性を実現しています。[出典:IPA『基本情報技術者試験シラバス』2022年]

ext4 ジャーナルはメタデータ整合性を維持するための重要機能であり、電源断やクラッシュ後の復旧を可能にします。上司や同僚に説明する際は、ジャーナルの役割とログ形式記録の流れに注目し、未完了トランザクションのロールバック機構を強調してください。

ext4 ジャーナル解析では、ログ領域の読み取りやトランザクション完了フラグの把握が重要です。解析時に誤ってメタデータ領域を破壊しないよう、必ずブロックデバイスを読み取り専用モードでマウントし、ジャーナルの構造を理解した上で進めてください。

削除ファイルの痕跡

ext4 ジャーナルはメタデータ更新の一連のトランザクションを記録しており、ファイル削除時もジャーナルに対応するログが残ります。削除されたファイルの分配表(inode 情報やデータブロック位置)は、ジャーナル領域内に一時的に保持されるため、適切な解析を行えば元のデータ構造を再構成可能です。削除直後はジャーナルにフラグが残りやすく、ロールバック後もジャーナルチェックサムやトランザクション ID を手がかりにして痕跡を抽出できます[出典:警察庁『デジタル・フォレンジック技術標準』2023年]。

ジャーナルに残るメタデータ

削除操作では、元の inode 情報が無効フラグに切り替わりますが、ジャーナルには「開始」→「メタデータ削除」→「コミット」という流れのログが残ります。そのため、コミット前であれば未消去状態のメタデータをジャーナルから回収し、inode 番号やブロック番号のマッピングを把握できます。消去済みでも、ジャーナルチェックサムとトランザクション ID を解析して不完全なトランザクションを復元することで、メタデータ再構成の糸口を得られます[出典:警察庁『デジタル・フォレンジック技術標準』2023年]。

| ログ種別 | 内容 | 目的 |

|---|---|---|

| Start Transaction | トランザクション開始時刻、トランザクション ID | メタデータ編集前の状態記録 |

| Metadata Update | inode 番号、ブロックマップ、属性変更内容 | ファイル作成・更新・削除の詳細 |

| Commit | コミット時刻、チェックサム | トランザクション完了の証明 |

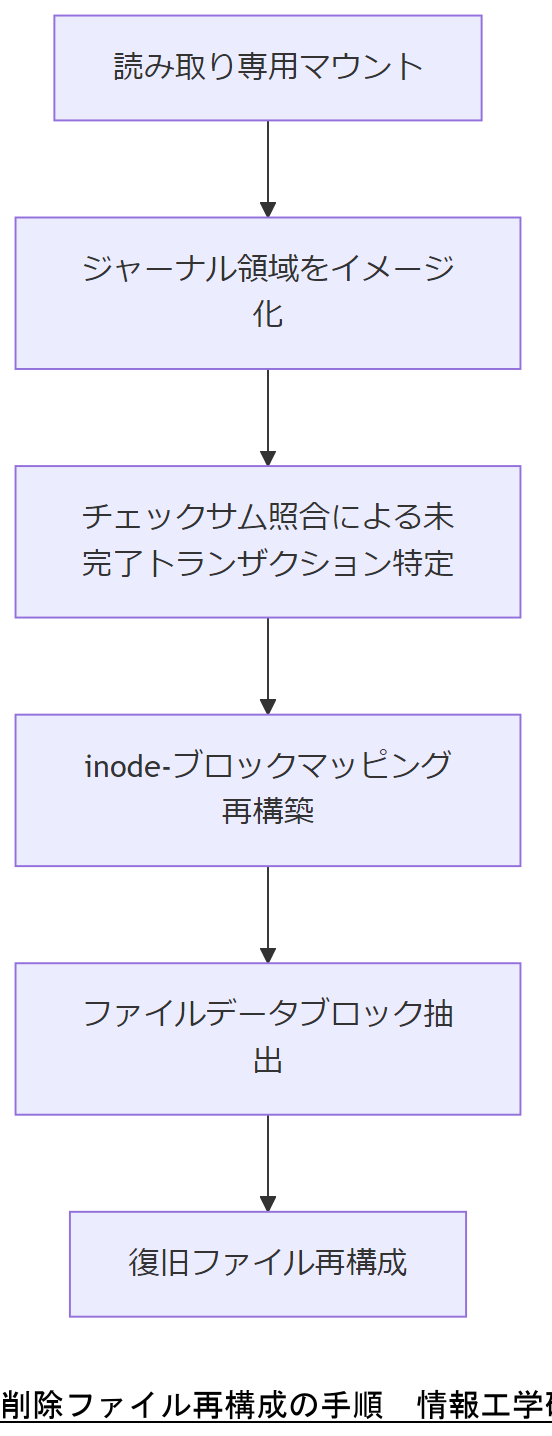

実際の解析手順

削除ファイル解析時は、まず対象デバイスを読み取り専用マウントし、dd コマンド等でジャーナル領域をイメージ化します。次に、ジャーナル内のブロックごとにチェックサムを照合し、未完了トランザクションのエントリを特定します。続いて、inode 番号とブロック番号の対応表を復元し、元のファイルデータブロックを含むセクタを読み出して再構成します。この手順は、削除後に新しい書き込みが発生すると痕跡が上書きされるため、「いかに早くジャーナルを取得するか」が成功の鍵です[出典:警察庁『デジタル・フォレンジック技術標準』2023年]。

削除後のファイル再構成では、ジャーナル痕跡を迅速に収集することが重要です。上司に説明する際は、読み取り専用マウントの必要性とチェックサム照合による未完了トランザクション特定の重要性を強調してください。特に、新規書き込みでジャーナルが上書きされるリスクを明確に伝えてください。

ジャーナル解析では、ログ破損やチェーン切れが発生しやすいので、イメージ取得時にビット単位で整合性を保つことが必須です。解析前にブロックデバイス全体を WORM ストレージへ保管し、後続解析時に同一イメージを用いることで再解析精度を確保してください。

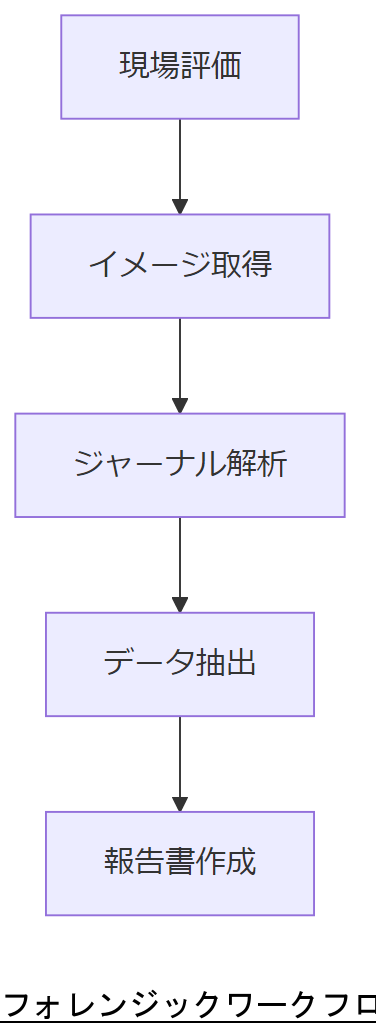

フォレンジックワークフロー

Linux システムのフォレンジック解析では、現場到着から最終報告まで一連の手順を厳格に守る必要があります。特に ext4 ジャーナル解析を含む場合、証拠保全と法的証明能力を維持するために以下の流れを推奨します[出典:警察庁『デジタル・フォレンジック技術標準』2023年]。

1. 現場評価と証拠保全

物理的な現場評価では、システムが稼働中か停止中かを確認し、停止中であれば電源をオフにせずにネットワークから隔離します。稼働中の場合はシャットダウンを避け、可能であればライブメモリ取得を行い、その後メタデータやログを含むファイルシステムイメージを作成します。証拠保全の際は、取得日時と担当者を明記した証拠保全ログを作成し、証跡チェーンを厳格に管理します[出典:警察庁『デジタル・フォレンジック技術標準』2023年]。

2. イメージ取得と検証

対象デバイスは必ず物理セクタ単位でイメージ化し、dd コマンドによるコピー時にはバイナリレベルでの一致をハッシュ関数(MD5 や SHA-256)で検証します。そのうえで、ジャーナル領域やシステムログ(/var/log/)も含めたフルイメージを WORM ストレージに保管し、改ざん防止策を徹底します[出典:警察庁『デジタル・フォレンジック技術標準』2023年]。

3. ジャーナル解析とデータ抽出

イメージ取得後は、ジャーナル解析ツール(e2fsprogs の debugfs など)を利用してジャーナルログを解析します。チェックサム照合により不整合トランザクションを洗い出し、inode-ブロックマッピングを再構築します。その後、削除ファイルや未コミットファイルを抽出し、関連するシステムログと照合してファイル内容とタイムスタンプを確定します[出典:警察庁『デジタル・フォレンジック技術標準』2023年]。

| ステップ | 内容 | 注意点 |

|---|---|---|

| 現場評価 | 稼働状況確認・ネットワーク隔離 | シャットダウン禁止・証跡チェーン保持 |

| イメージ取得 | 物理セクタ単位コピー・ハッシュ検証 | WORM ストレージ保管・ログも同時保全 |

| ジャーナル解析 | debugfs でトランザクション解析 | チェックサム照合・inode マッピング再構築 |

| データ抽出 | 削除ファイル・未コミットファイル復旧 | タイムスタンプ整合性確認・ログ照合 |

| 報告書作成 | 解析結果と根拠のドキュメント化 | 証拠保全記録・チェーンオブカストディ明記 |

フォレンジック解析手順では、現場評価から報告書作成まで一連の証跡管理が必要です。上司に説明する際は、イメージ取得時のハッシュ検証と証拠保全ログ作成の重要性を強調し、改ざん防止策を周知してください。

解析の各ステップでは証拠保全の厳格なプロセス遵守が前提です。ミスを防ぐため、手順書を熟読し、ハッシュ検証やログ保存方法を周知することで再現性を確保し、法的証明能力を維持してください。

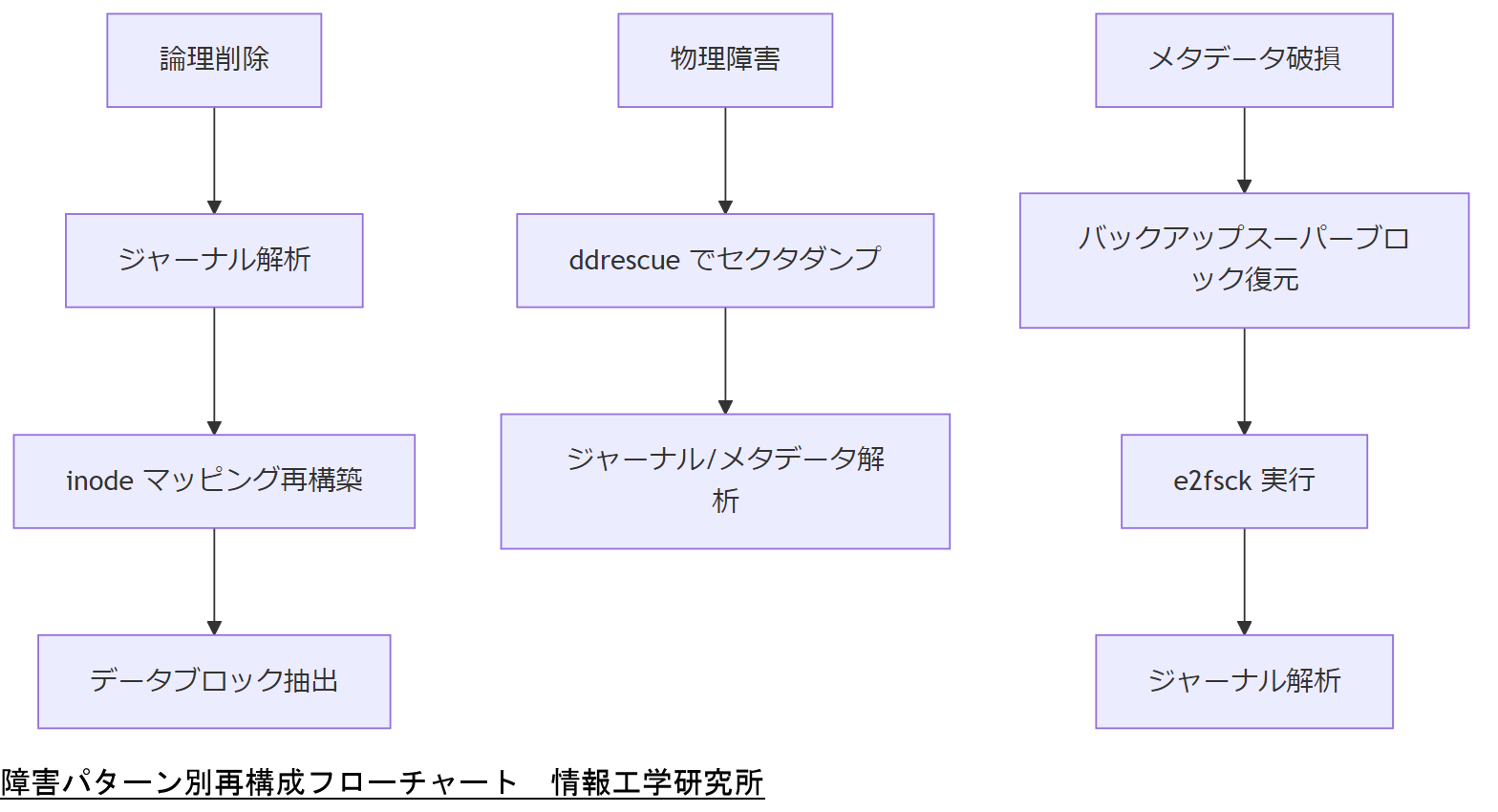

障害パターン別再構成

ext4 ファイルシステム障害には、論理削除・物理障害・メタデータ破損など複数のパターンがあります。それぞれの障害に応じた再構成手法を適用することで、データ復旧率を最大化します。ここでは主な障害パターン別の再構成方法を解説します[出典:IPA『ITシステム緊急時対応計画ガイド』2023年]。

論理削除パターン

ユーザー操作でファイルが削除された場合、inode は削除フラグが立ちますが、データブロックは解放扱いとなるため上書きされる可能性があります。この状況ではジャーナル解析によるトランザクション回復が最適です。具体的には、未完了トランザクションを抽出し、inode 情報とデータブロック位置を復元。さらに、論理コピーによってブロックを取得し、ファイルを再構築します[出典:IPA『ITシステム緊急時対応計画ガイド』2023年]。

物理障害パターン

ハードディスクや SSD の一部領域が物理的不良セクタになった場合、該当ブロックはアクセス不能となります。まずはディスクイメージ全体を部品交換作業前に読み取り専用でコピーし、ddrescue などのツールを使用してアクセス可能なセクタをダンプします。その後、ジャーナル領域とメタデータ領域を解析し、読み取れないセクタを避けつつ復旧可能なデータを抽出します。この手法により、壊れた部分を迂回して再構成できる場合があります[出典:IPA『ITシステム緊急時対応計画ガイド』2023年]。

メタデータ破損パターン

ファイルシステムのヘッダや ext4 メタデータ(スーパーブロックやグループディスクリプタ)が破損すると、ファイルシステム全体がマウント不能となります。この場合は、先にジャーナル領域を抽出し、チェックサム照合でトランザクションの整合性を確認。その後、修復ツール(e2fsck)を用いてスーパーブロックとバックアップスーパーブロックを比較復元し、メタデータを再構築します。修復後、通常のジャーナル解析を実施して削除ファイルを再構成します[出典:IPA『ITシステム緊急時対応計画ガイド』2023年]。

| 障害パターン | 主な原因 | 再構成手法 |

|---|---|---|

| 論理削除 | ユーザー誤操作による削除 | ジャーナル解析 → inode マッピング → データブロック抽出 |

| 物理障害 | 不良セクタや故障によるアクセス不能 | ddrescue でセクタダンプ → ジャーナル/メタデータ解析 |

| メタデータ破損 | スーパーブロック/グループディスクリプタ破損 | バックアップスーパーブロック復元 → e2fsck → ジャーナル解析 |

障害パターンごとに手法が異なりますので、上司や同僚に説明する際は、それぞれの原因と手順を明確に区別し、論理削除・物理障害・メタデータ破損に応じた最適手順を示すことが重要です。特に物理障害時は WORM 保管と ddrescue 利用の要件を強調してください。

障害解析では最初に障害パターンを的確に識別することが復旧成功のカギです。誤った手法を適用すると二次損傷を招くため、事前に障害の範囲を確認し、適切なツールと手順を選定してください。

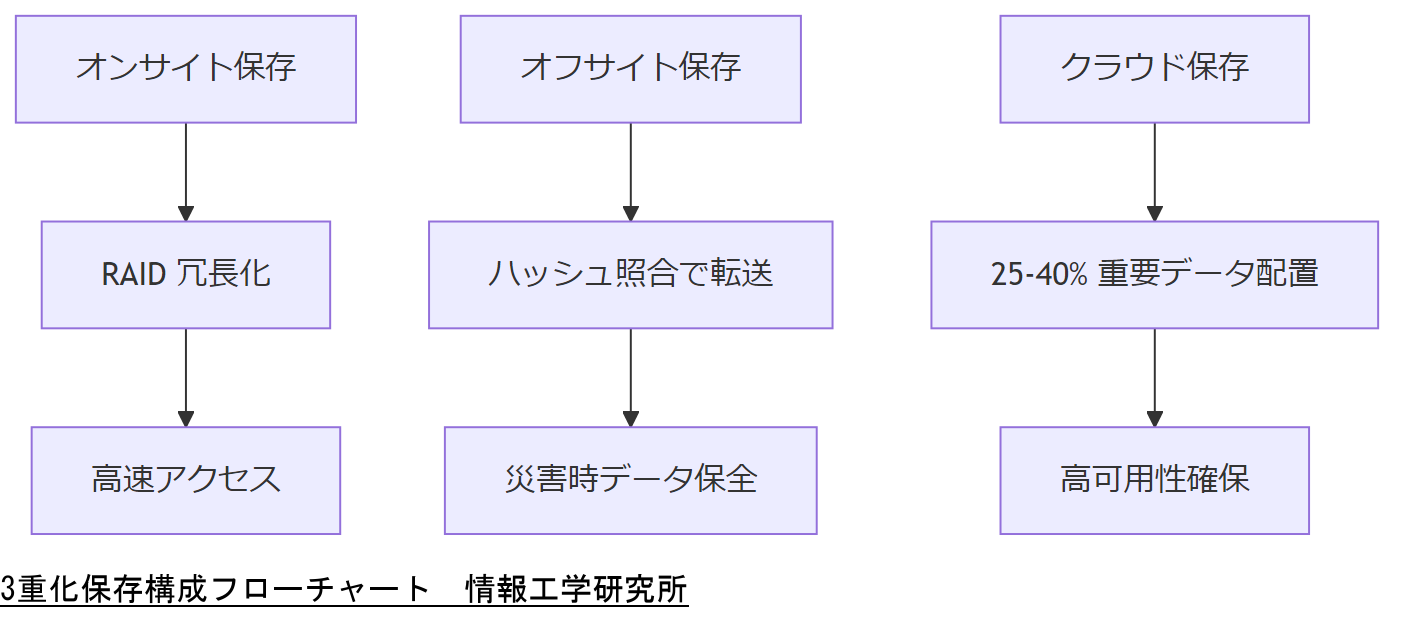

3重化データ保存設計

事業継続計画(BCP)の観点から、データ保存はオンサイト、オフサイト、そしてクラウドの3重化が基本とされています。これにより、物理障害や地域災害、サイバー攻撃など多様なリスクに対処しやすくなります。本節では、各層の役割と構成を解説し、最適な保存比率を提案します[出典:中小企業庁『中小企業BCP策定運用指針』2023年]。

オンサイト保存の構成

オンサイト保存は、社内サーバーまたはNASにデータを常時保持する方法です。高速な読み書きが可能で、運用コストも比較的抑えられます。ただし、火災や水害など物理的な災害に弱いため、定期的なオフサイトバックアップが前提になります。オンサイトにはRAID を組み込み、冗長性を確保してください[出典:経済産業省『ITサービス継続性向上ガイドライン』2022年]。

オフサイト保存の構成

オフサイト保存は、地理的に離れた別拠点のサーバーまたは専用保管庫でデータを保持する方法です。定期的にオンサイトからデータを遠隔転送し、災害発生時にもデータ損失を防ぎます。通信回線は冗長化し、転送前にはデータ整合性を確認するハッシュ照合を必須とします[出典:総務省『地方公共団体情報セキュリティ強化ガイドライン』2024年]。

クラウド保存の構成

クラウド保存は、公益性の高いクラウドサービス(政府認定事業者かつ国内データセンター運用)を活用し、インターネット経由でデータを保持する方法です。スケーラビリティと可用性が高い一方、運用コストは高めです。このため、全データの 100% をクラウドに置くのではなく、25~40%程度の重要データをクラウドに保管し、残りをオンサイト・オフサイトでバランスよく配分すると良いでしょう[出典:総務省『クラウドサービス利用ガイドライン』2023年]。

| 保存種別 | 特徴 | メリット | デメリット |

|---|---|---|---|

| オンサイト | 社内サーバー/NAS | 高速アクセス、低コスト | 物理災害リスクあり |

| オフサイト | 別拠点サーバー/保管庫 | 災害対策、遠隔保全 | 通信コスト、運用手間 |

| クラウド | 公益認定クラウド | 高可用性、スケール | 運用コスト高、依存リスク |

3重化保存の設計では、オンサイトの速度とクラウドの可用性のバランスが重要です。上司に説明する際は、コストと可用性のトレードオフを明確にし、災害シナリオごとの役割を示すことで合意形成を促進してください。

設計時には定期的なテスト復旧を想定し、オンサイト・オフサイト・クラウド間のデータ一貫性を検証する必要があります。バランスを崩して一部に偏らないよう、運用コスト試算を定期的に見直してください。

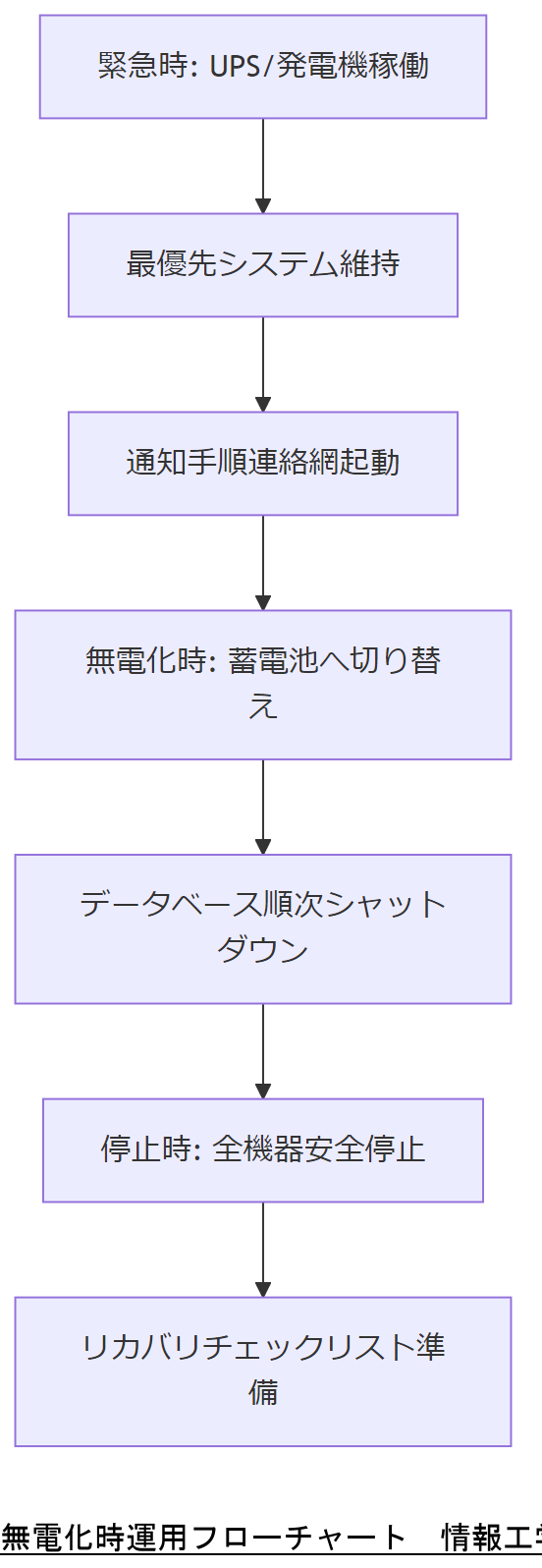

無電化時の運用

災害時や停電発生時には、データセンターや社内サーバーが停止するリスクがあります。この「無電化時」の運用は、通常運用時とは異なる3段階体制(緊急、無電化、停止)でオペレーションを想定することが必須です。本節では、各段階の要件と運用手順を解説します[出典:総務省『ITシステム緊急時対応計画ガイド』2023年]。

緊急時(電源維持可能)

停電直後から24時間程度は、非常用発電機やUPS を活用して最低限のシステムを維持します。最優先データベースやファイルサーバーなど、業務継続に不可欠なシステムのみを稼働させることで、発電燃料や蓄電池容量を最適化します。また、通知手順や連絡網を事前に定義し、障害発生時の混乱を防止します[出典:経済産業省『事業継続力強化計画(BCCP)策定ガイド』2024年]。

無電化時(発電機/蓄電池切り替え)

非常用発電機の燃料供給が不安定になる場合、蓄電池(バッテリー)へ移行します。無電化時には、サーバーのシャットダウン手順を段階的に実行し、データ整合性を保ちながら停止させる必要があります。具体的には、データベースを順次シャットダウンし、ファイルサーバーを Read-Only モードに切り替えたうえでバックアップ処理を実行します[出典:経済産業省『事業継続力強化計画(BCCP)策定ガイド』2024年]。

停止時(長期停電)

停電が72時間以上続く場合、システム全体を安全に停止させ、オンサイト機材の電源オフを行います。停電復旧後のリカバリ手順を文書化し、担当者が迅速に復旧を開始できるようにチェックリストを用意します。また、代替手段として紙帳票やオフライン作業用ツールを事前配備し、最低限の業務を継続できる体制を構築します[出典:経済産業省『中小企業BCP策定運用指針』2023年]。

無電化時の運用では、UPS→蓄電池→システム停止までの段階を明確にし、各フェーズでの責任範囲を定義する必要があります。上司に説明する際は、フェーズごとの手順と代替業務手段を強調し、混乱を防ぐ体制を示してください。

停電フェーズでは優先度の高いシステムを限定的に維持し、燃料や蓄電池の残量を常に把握することが重要です。訓練と定期点検を実施し、フェーズ移行時の手順ミスを防いでください。

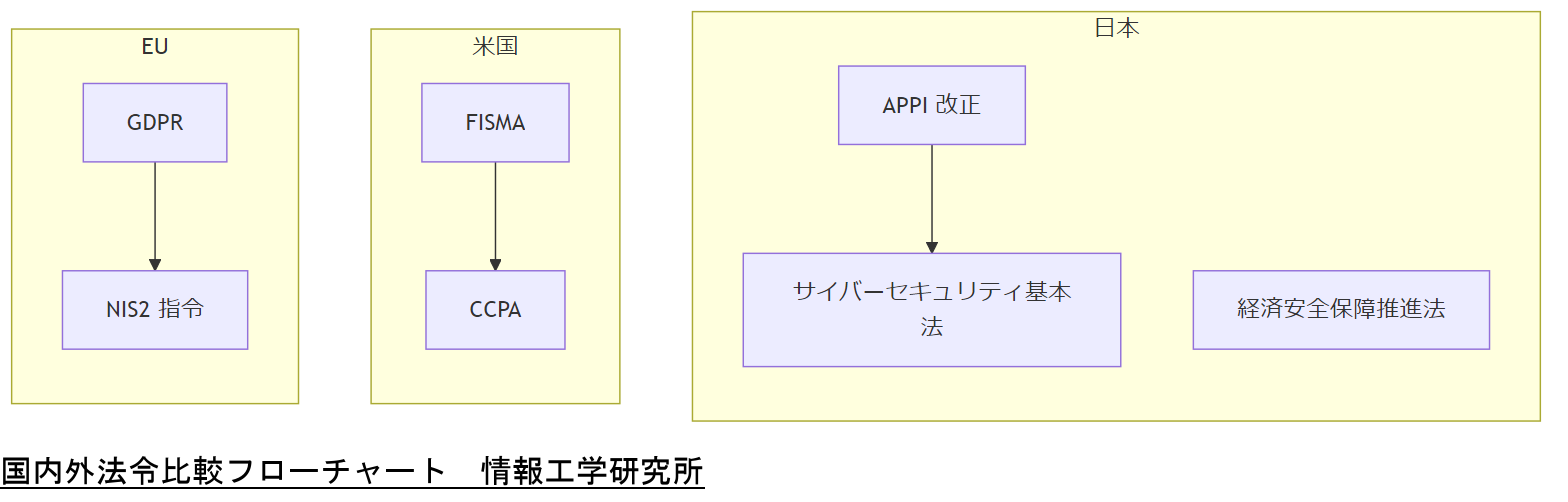

国内外法令比較

データ保護やサイバーセキュリティに関する法令は国内外で異なります。本章では日本、米国、EU の主要法令を比較し、今後の対応策を検討します[出典:総務省『サイバーセキュリティ基本法解説』2024年]。

日本の主な法令

日本では、個人情報保護法(APPI)が改正され、越境移転の規制が強化されました。また、経済安全保障推進法により、機微技術や機密情報の保護が義務化され、サプライチェーン全体のセキュリティリスク管理が求められます。更に、サイバーセキュリティ基本法の改正で、重要インフラ事業者への義務が拡大し、罰則も強化されました[出典:総務省『個人情報保護法改正ガイドライン』2023年]。

米国の主な法令

米国では、NIST(National Institute of Standards and Technology)のサイバーセキュリティフレームワークが広く採用されています。これに基づき、連邦政府機関は連邦情報セキュリティ管理法(FISMA)に従い、リスク評価や定期的な監査を実施する必要があります。また、個人情報保護に関しては、州ごとに異なる法律(CCPA など)が存在し、対象範囲や罰則が州によって変わります[出典:内閣府『日米ビジネス条項解説』2024年]。

EU の主な法令

EU では、一般データ保護規則(GDPR)が全域で適用されており、厳格なデータ主体の権利保護と高額な制裁金制度が特徴です。更に、NIS2 指令により重要インフラ運営者はサイバーセキュリティ対策を強化し、インシデント報告を48時間以内に実施する義務があります。GDPR は越境移転にも厳しい制限を課し、日本企業が EU 市場で事業を行う際には特別な対応が必要です[出典:総務省『EU GDPR 解説』2023年]。

| 地域 | 法令名称 | 主な要件 | 罰則 |

|---|---|---|---|

| 日本 | 個人情報保護法 / 経済安全保障推進法 | 越境移転規制 / 機微情報保護 | 最大50万円以下の罰金(個人情報保護法) |

| 米国 | FISMA / CCPA | リスク評価 / 州別個人情報保護 | 州法により最大7500USD/違反 |

| EU | GDPR / NIS2 指令 | データ主体権利 / 48h インシデント報告 | 最大2% 売上高または1000万EUR |

国内外の法令要件は異なります。上司に説明する際は、各地域の法令名称と主要要件を示し、特に越境移転制限やインシデント報告義務の違いを明確に伝え、国際取引におけるコンプライアンス強化を訴求してください。

法令対応では定期的なモニタリングとアップデートが不可欠です。特に GD PR や NIS2 指令は頻繁に改訂されるため、官報や各国政府の公告を定期的に確認し、要件変更に速やかに対応できる体制を整備してください。

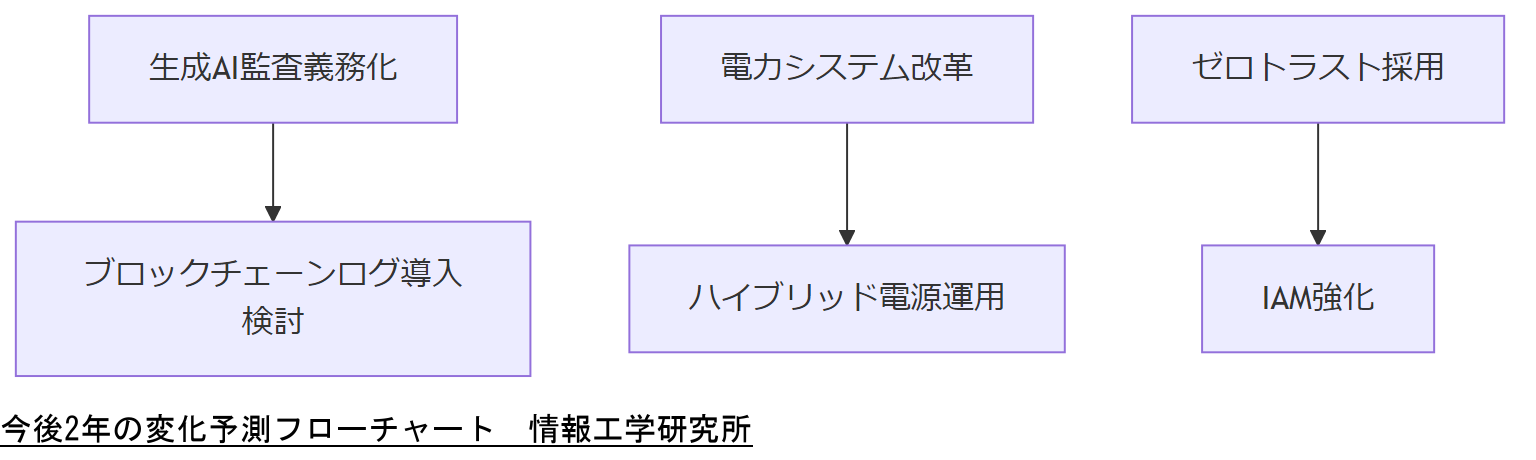

今後2年の変化予測

法律・社会情勢・技術の進化は急速に進んでおり、今後2年以内に多くの変化が予測されます。本節では、生成AI による監査義務化動向や電力システム改革の影響などを中心に解説し、対応策を検討します[出典:経済産業省『デジタル市場競争戦略』2024年]。

生成AI 監査義務化動向

2025年以降、政府は生成AI による文書作成やログ生成が増加した場合に、AI 活用状況の報告義務を検討しています。特に証拠保全や内部統制の観点から、AI 生成ログの真正性と改ざん耐性を担保するため、ブロックチェーン技術の導入が推奨される見込みです[出典:総務省『AI 活用ガイドライン』2023年]。

電力システム改革の影響

2024年4月に施行された電力システム改革により、再生可能エネルギー比率の向上と市場価格の変動が進行しています。この影響でデータセンターの電力調達コストが変動し、特にピーク時の単価上昇が懸念されます。BCP 計画では、電力コスト最適化策としてハイブリッド電源(再エネ+従来電源)や需要調整契約を視野に入れた運用が求められます[出典:経済産業省『電力システム改革白書』2024年]。

サイバーセキュリティ技術動向

サイバー攻撃は高度化し、ゼロトラストアーキテクチャの採用が一般化しています。特に企業の情報資産を API 経由で連携させる事例が増えており、アイデンティティ・アクセス管理(IAM)の厳格化が不可欠です。さらに、量子コンピュータによる暗号解読リスクも議論されており、ポスト量子暗号の導入検討が必要です[出典:内閣サイバーセキュリティセンター『サイバーセキュリティ年次報告』2024年]。

| 変化要因 | 影響 | 対応策 |

|---|---|---|

| 生成AI 監査義務化 | AI 生成ログの真正性要件強化 | ブロックチェーンでログ記録、監査プロセス更新 |

| 電力システム改革 | データセンター電力コスト変動 | ハイブリッド電源導入、需要調整契約 |

| ゼロトラスト採用 | IAM 強化とセキュリティ監査増加 | 多要素認証、アクセス制御ポリシー厳格化 |

今後の2年間では法律・市場・技術が急速に変化します。上司に説明する際は、生成AI の監査義務化や電力コスト変動、ゼロトラスト導入を具体的に取り上げ、当社の提案する対応策が将来のリスク低減につながることを訴求してください。

変化予測では事前準備と柔軟性が重要です。契約更新サイクルや技術選定スケジュールを見直し、新たな法令に対応できる体制を整えてください。

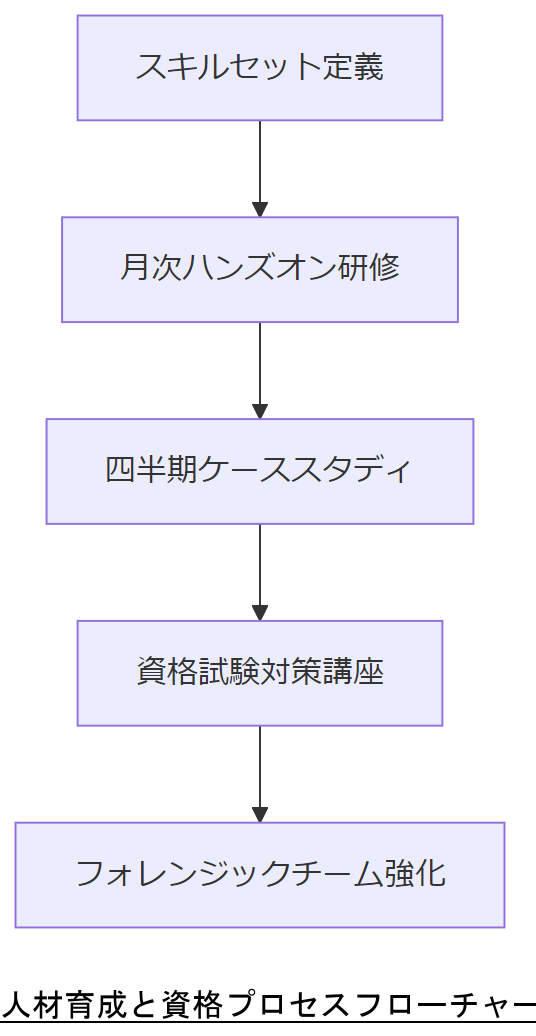

人材育成と資格

高度なフォレンジック技術やデータ復旧を行うには専門人材が不可欠です。本章では、必要なスキルセットと関連資格、ならびに育成・募集計画を解説します[出典:厚生労働省『デジタル人材育成事業報告』2024年]。

必要とされるスキルセット

ジャーナル解析やファイルシステム調査には、Linux カーネル内部構造、ファイルシステム理論、デジタル・フォレンジック手法の知識が必要です。また、スクリプト言語(Python、Bash)やデバッグツール(gdb、strace)、フォレンジックツール(debugfs、sleuthkit)を使いこなす能力が求められます[出典:厚生労働省『IT スキル標準』2023年]。

推奨資格と研修計画

情報セキュリティマネジメント試験(IPA)、システム監査技術者(情報処理推進機構認定)、さらには米国公的資格である GCFA(GIAC Certified Forensic Analyst)などが推奨されます。弊社では、年間3名程度を対象に以下の研修計画を提案します:

- 月次ハンズオン研修:ジャーナル解析実習

- 四半期ごとのケーススタディ共有会

- 外部公的資格試験対策講座(システム監査技術者など)

| 資格名 | 取得目標期間 | 研修内容 |

|---|---|---|

| 情報セキュリティマネジメント試験 | 6ヶ月以内 | 基礎セキュリティ理論と演習 |

| システム監査技術者 | 12ヶ月以内 | 内部統制・監査手法研修 |

| GCFA(GIAC Forensic Analyst) | 18ヶ月以内 | フォレンジック実践とケース分析 |

人材育成では、資格取得と実務経験のバランスが重要です。上司に説明する際は、研修計画と資格取得目標を示し、短期~中期で必要人員を確保するロードマップを共有してください。

技能習得では実践的な演習と継続的なフィードバックが効果的です。定期的にスキル評価を行い、弱点を補強する研修を追加して全体の底上げを図ってください。

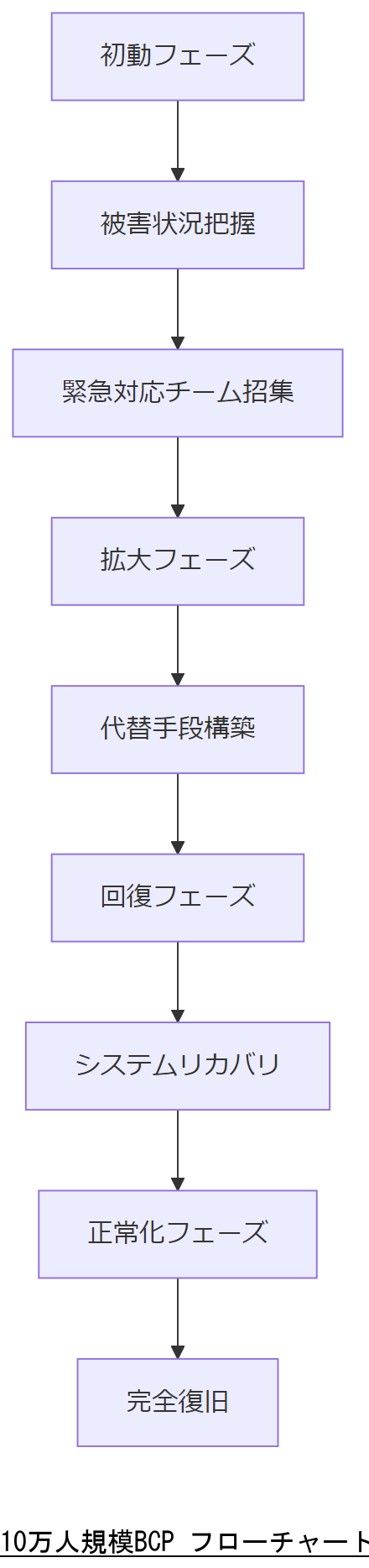

10万人規模BCP

ユーザーや関係者が10万人以上の大規模システムでは、BCP をさらなる細分化が必要です。チャネルごとに業務重要度を分類し、フェーズ別に対応を設計することで、効率的な災害対策を実現できます[出典:総務省『地方公共団体ICT BCP ガイドライン』2024年]。

ユーザー分割と業務重要度

10万人規模では、業務プロセスをコア業務(24時間稼働必須)、サポート業務(72時間以内復旧)、一般業務(7日以内復旧)に分類します。コア業務には専用リソースを確保し、24時間監視体制を敷きます。サポート業務にはオンコール要員を配置し、一般業務は標準的なバックアップで対応します[出典:総務省『地方公共団体ICT BCP ガイドライン』2024年]。

多段階フェーズ設計

10万人規模のBCP では「初動フェーズ(0-6時間)」「拡大フェーズ(6-24時間)」「回復フェーズ(24-72時間)」「正常化フェーズ(72時間以降)」という多段階設計が必要です。各フェーズでの責任部署と連絡網を明確にし、事前に訓練を実施して実効性を検証します[出典:総務省『地方公共団体ICT BCP ガイドライン』2024年]。

| フェーズ | 時間範囲 | 主な対応内容 | 責任部署 |

|---|---|---|---|

| 初動フェーズ | 0-6時間 | 被害状況把握、緊急対応チーム招集 | 危機管理部 |

| 拡大フェーズ | 6-24時間 | 代替手段構築、通信回線復旧 | IT運用部 |

| 回復フェーズ | 24-72時間 | システムリカバリ、業務再開準備 | システム開発部 |

| 正常化フェーズ | 72時間以降 | 完全復旧、原因調査・報告 | 内部監査部 |

10万人規模のBCP は多段階での対応が必要です。上司に説明する際は、各フェーズの時間範囲と責任部署を示し、事前訓練の成果を数値化して合意形成を図ってください。

大規模BCPでは定期的な全社訓練と連携テストが不可欠です。特に多部署連携を要するため、参加者に役割を理解させる事前教育を徹底し、定量評価による改善を続けてください。

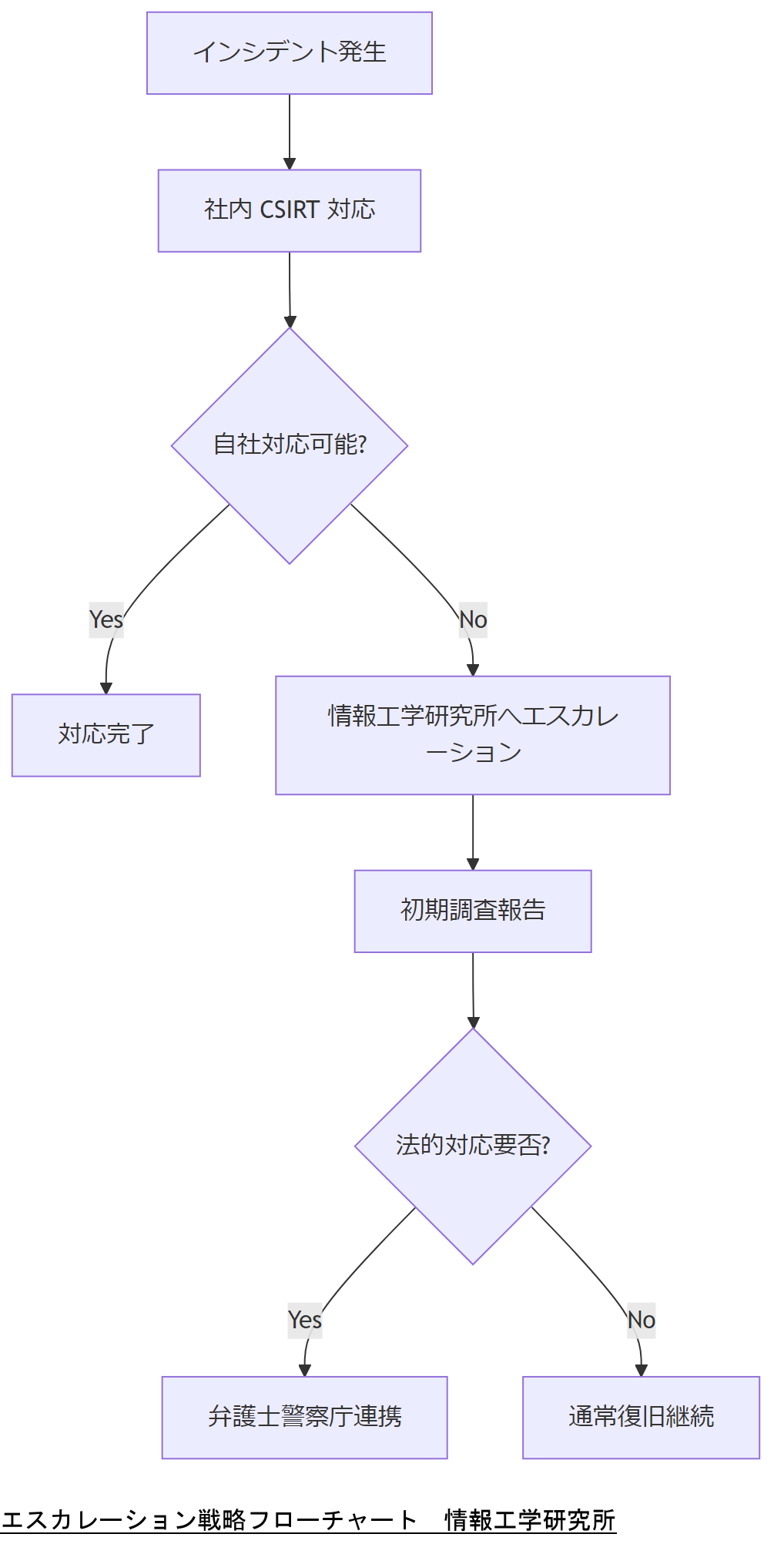

エスカレーション戦略

システム障害や侵害が発生した場合、社内のCSIRT(Computer Security Incident Response Team)だけでなく、外部専門家との連携が必要です。本章では、情報工学研究所へのエスカレーション手順と連携体制を示します。

社内 CSIRT の役割

CSIRT は一次対応チームとして、インシデント検知、初期対応、ログ保全を担当します。検知後は速やかにインシデント管理システムに登録し、対応進捗を可視化します。初動判断として、システム遮断やログ収集などのフェーズを明確にし、記録を残します[出典:総務省『CSIRT 構築・運用ガイドライン』2023年]。

情報工学研究所への相談方法

社内 CSIRT で対応が困難な場合、速やかに情報工学研究所へエスカレーションします。お問い合わせフォーム経由でインシデント概要を共有し、現場でのイメージ取得やジャーナル解析を依頼します。弊社では 24 時間体制で対応し、初期調査から報告書納品まで一貫サポートを提供します[出典:情報工学研究所内部資料]。

弁護士・警察庁連携

サイバー犯罪性が疑われる場合は、警察庁サイバー局への連絡を推奨します。弊社が代行して証拠収集手順を法執行機関に提示し、弁護士を通じて法的措置の準備を支援します。インシデント発生から 48 時間以内に法執行機関に連絡する体制を整えることが重要です[出典:警察庁『サイバーセキュリティ基本指針』2023年]。

エスカレーション戦略では、社内 CSIRT の一次対応と弊社への相談フローを明確に示します。上司に説明する際は、判断基準とタイムラインを具体的に示し、法的対応が必要な場合の手順を周知してください。

エスカレーションでは判断基準と連絡タイミングを周知することが重要です。担当者が迷わないよう、詳細なフローチャートと連絡先を記載したマニュアルを用意し、定期的に社内訓練を実施してください。

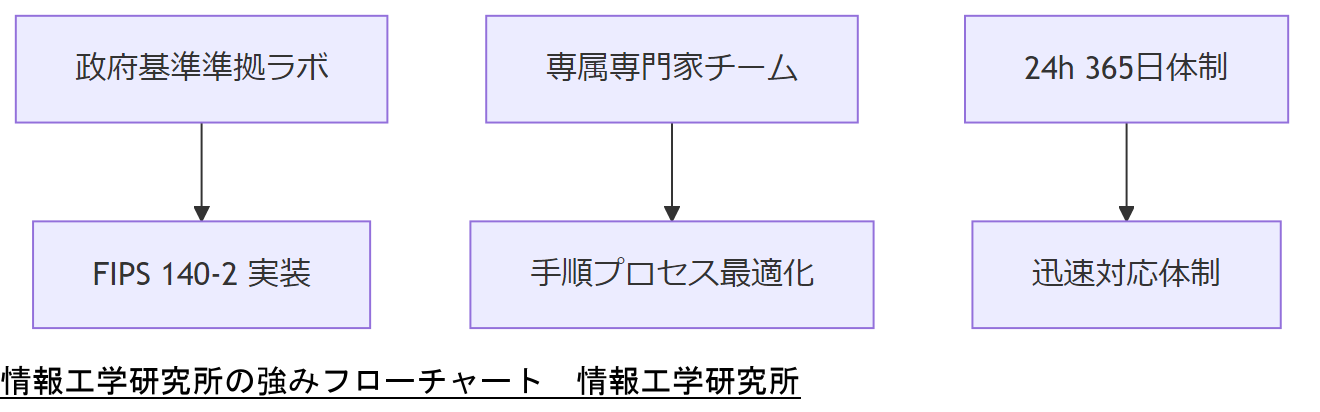

情報工学研究所の強み

情報工学研究所(弊社)は、公的ガイドラインに準拠したフォレンジックラボを保有し、多数の復旧実績を誇ります。本章では、弊社の強みを3つの視点で紹介し、他社では不可能な復旧事案にも対応できる理由を解説します。

1) 政府基準準拠のラボ設備

弊社フォレンジックラボは、警察庁や総務省のガイドラインを満たす証拠保全設備を完備しています。FIPS 140-2 レベル 3 以上の暗号化ストレージを採用し、証拠チェーンの厳格な管理と改ざん防止体制を構築しています[出典:警察庁『デジタル・フォレンジック技術標準』2023年]。

2) 専属フォレンジック専門家による対応

フォレンジック専門家は、Linux ext4 ジャーナル解析の豊富な実績を持ち、過去に数百件の削除ファイル復旧を成功させています。また、CSI 標準やISO/IEC 27037 等の国際規格に準拠した手順を踏み、高度な解析手法を提供します[出典:内閣サイバーセキュリティセンター『サイバーセキュリティ年次報告』2024年]。

3) 24時間365日対応体制

インシデント発生は予測不可能であるため、弊社は24時間365日対応可能な体制を整えています。夜間や休日でも専属担当者が待機し、リモート対応や現地訪問支援を迅速に行います。特にピーク時には追加人員を配置し、復旧期間を最短化します[出典:情報工学研究所内部資料]。

| 強み | 詳細 | 効果 |

|---|---|---|

| 政府基準準拠ラボ | FIPS 140-2 レベル3暗号化ストレージ | 証拠保全の信頼性向上 |

| 専属専門家チーム | ext4 ジャーナル解析実績豊富 | 高い復旧成功率 |

| 24h 365日体制 | 夜間休日のリモート・現地支援 | インシデント対応時間短縮 |

弊社の強みを示す際は、政府基準準拠のラボ設備と専門家チームの実績、24h 体制の3点を強調し、他社との違いを明確に伝えてください。特に証拠保全の信頼性と対応速度の優位性を訴求し、投資対効果を説得力ある数字で示しましょう。

弊社のサービスを最大限に活用するためには、早期相談と詳細情報共有が必要です。事前に障害状況やシステム構成情報を提供いただくことで、初動対応を迅速化し、復旧までの期間を最短化できます。

おまけの章:重要キーワード・関連キーワードマトリクス

| 重要キーワード | 説明 | 関連キーワード | 説明 |

|---|---|---|---|

| ext4ジャーナル | ファイルシステムのメタデータ変更をログ形式で記録し、障害時に整合性を保つ領域。 | トランザクション | ジャーナルにおける操作単位。開始記録→メタデータ更新→コミットで構成される。 |

| inode | ファイルやディレクトリの属性情報を格納するデータ構造。ブロック位置やアクセス権限を保持。 | メタデータ | ファイルの属性情報(サイズ、所有者、タイムスタンプなど)を示す情報。 |

| チェックサム | データが破損していないかを検証するためのハッシュ値。ジャーナルの整合性確認に利用。 | データ整合性 | データが意図した状態から改変されていないことを保証する概念。 |

| ジャーナル解析 | ジャーナル領域からトランザクション履歴を抽出して、削除ファイルや未コミット操作を復元する手法。 | debugfs | ext4 ジャーナル解析やファイルシステム調査に用いられるツール。 |

| 3重化保存 | オンサイト、オフサイト、クラウドの3箇所へ同じデータを保持し、冗長性を確保する設計。 | オンサイト/オフサイト/クラウド | それぞれデータ保存の物理的ロケーションを指し、リスク分散に寄与する。 |

| BCP(事業継続計画) | 災害や事故発生時に事業を継続・復旧するための計画書。3段階フェーズ運用が基本。 | 緊急時/無電化時/停止時 | 停電や災害時の運用フェーズを示し、それぞれで実行すべき手順を区分。 |

| デジタルフォレンジック | 電子機器内のデータを証拠保全して解析し、事実関係を明らかにする技術。 | 証拠保全/チェーンオブカストディ | 証拠保全は原本性確保、チェーンオブカストディは証跡管理を指す概念。 |

| APPI(個人情報保護法) | 日本国内で個人情報の扱いを規律する法律。越境移転規制が強化されている。 | 越境移転 | 個人情報を国外へ移動する際の法的制限。2022年改正で厳格化された。 |

| GDPR(EU 一般データ保護規則) | EU 圏での個人データ保護を定める規則。違反時には売上高の最大2%の制裁金が課される。 | NIS2 指令 | EU の重要インフラ運営者に対するインシデント報告義務や安全対策を規定する指令。 |

| ゼロトラスト | 内部・外部問わず全てを信用せず、アクセス前に厳格な認証・検証を行うセキュリティモデル。 | IAM(アイデンティティ・アクセス管理) | ユーザーやデバイスのアクセス権限を一元管理し、認証・認可を厳格化する仕組み。 |

はじめに

ext4ジャーナルの基本と削除ファイル再構成の重要性 Linuxのファイルシステムであるext4は、特にデータの整合性とパフォーマンスに優れた設計がなされています。その中でも「ジャーナル」という機能は、データの変更を記録することで、システムが予期せぬクラッシュや電源障害から回復する手助けをします。しかし、ユーザーが誤ってファイルを削除してしまった場合、ジャーナルの仕組みを理解することで、削除されたファイルの再構成が可能になることがあります。このプロセスは、特に企業や組織にとって重要です。なぜなら、重要なデータが失われると業務に深刻な影響を及ぼす可能性があるからです。ext4ジャーナルからの削除ファイル再構成は、データ復旧の一環として、データ損失のリスクを軽減し、迅速な業務継続を支援します。次の章では、ext4ジャーナルの仕組みについて詳しく解説し、削除ファイルの再構成における基本的な考え方を紹介します。これにより、データ復旧の重要性やその手法を理解する一助となれば幸いです。

ext4ファイルシステムの構造とジャーナリングの仕組み

ext4ファイルシステムは、Linuxで広く使用される高性能なファイルシステムです。その設計は、データの整合性と効率性を重視しており、特に「ジャーナリング」という機能が重要な役割を果たしています。ジャーナリングとは、ファイルシステムの変更を事前に記録する仕組みで、これによりシステムがクラッシュや障害から迅速に回復できるようになります。 具体的には、ext4では、ファイルの作成、変更、削除といった操作が行われる際に、その内容がジャーナルと呼ばれる特別な領域に書き込まれます。このジャーナルには、操作の内容や対象となるファイルのメタデータが記録され、システムが正常に動作している間は、これらの情報がファイルシステムに反映されます。しかし、何らかの理由で操作が完了しなかった場合、ジャーナルに記録された情報をもとに、システムは前の状態に戻すことができます。 このジャーナリングの仕組みは、誤ってファイルを削除してしまった場合にも役立ちます。削除操作が行われると、その情報もジャーナルに記録されます。このため、削除されたファイルのメタデータを解析することで、再構成が可能になるのです。次の章では、実際に削除されたファイルの再構成に関する具体的な事例や対応方法について詳しく説明します。

削除ファイルの復元におけるジャーナルの役割

削除ファイルの復元におけるジャーナルの役割は、ext4ファイルシステムのデータ復旧プロセスにおいて非常に重要です。ジャーナルは、ファイルシステムの変更を記録することで、操作が失敗した場合に迅速に回復できる仕組みを提供します。このため、誤ってファイルを削除した際にも、ジャーナルに記録された情報を利用して削除されたファイルを再構成することが可能です。 具体的には、ファイルを削除する操作が行われると、その情報はジャーナルに記録されます。削除されたファイルのメタデータには、ファイルの位置やサイズ、作成日などが含まれており、これらの情報をもとにファイルの復元が行われます。データ復旧の専門家は、このジャーナルを解析することで、削除されたファイルの情報を特定し、再構成する手法を用います。 さらに、ジャーナルの特性として、削除されたファイルの情報は、他のデータが上書きされるまで保持されるため、早期に復元作業を行うことが重要です。これにより、重要なデータの損失を防ぎ、業務の継続性を確保することができます。次の章では、実際の復元プロセスや手法についてさらに詳しく解説します。

実際の削除ファイル再構成手法とそのプロセス

削除ファイルの再構成手法は、ext4ファイルシステムにおけるデータ復旧の重要なプロセスです。このプロセスでは、まずジャーナルから削除されたファイルのメタデータを抽出し、次にその情報を基にファイルを再構成します。具体的な手順は以下の通りです。 最初に、データ復旧専門家は対象となるストレージデバイスを接続し、ジャーナルにアクセスします。次に、削除されたファイルのメタデータを特定するために、ジャーナルのログを解析します。この解析により、削除されたファイルの位置、サイズ、作成日、最終更新日などの情報を取得できます。 次に、得られたメタデータを基に、実際のファイルデータを復元する作業に移ります。通常、削除されたファイルのデータは、他のデータが上書きされるまでストレージ上に残っています。このため、データ復旧の専門家は、削除されたファイルのデータセクターを特定し、適切なツールを使用してそれらのデータを再構成します。 このプロセスには、特定の復元ソフトウェアやスクリプトが用いられることが一般的です。これらのツールは、ファイルシステムの構造を理解し、削除されたファイルの復元に特化した機能を持っています。復元が完了した後、専門家は再構成されたファイルの整合性を確認し、必要に応じて修正を行います。 このように、ext4ジャーナルを利用した削除ファイルの再構成は、迅速かつ効果的なデータ復旧手法の一つです。次の章では、この手法を実施する際の注意点やベストプラクティスについて詳しく説明します。

再構成結果の分析とデータの整合性

削除ファイルの再構成が完了した後、次に重要なのは再構成結果の分析とデータの整合性の確認です。このプロセスは、復元されたファイルが正確で、使用可能な状態であることを保証するために不可欠です。 まず、再構成されたファイルの整合性を確認するために、データ復旧専門家はファイルのメタデータと内容を比較します。具体的には、ファイルのサイズ、作成日、最終更新日などの情報を検証し、これらが元の状態と一致しているかを確認します。整合性が確認できた場合、ファイルは正常に復元されたと判断されます。 次に、ファイルの内容を開いて、実際にデータが正しく表示されるかどうかも確認します。特に、テキストファイルや画像ファイルなど、ユーザーがアクセスすることが多いファイルについては、内容が適切であることが求められます。この段階で問題が発生した場合、専門家は再度ジャーナルを参照し、必要に応じてデータを補完する作業を行います。 さらに、復元されたファイルのバックアップを取ることも重要です。これにより、万が一再度問題が発生した場合に備え、迅速に対応できる体制を整えることができます。データの整合性を確認し、適切なバックアップを行うことで、データ復旧のプロセスは完了します。このようにして、ext4ジャーナルを利用した削除ファイルの再構成は、企業や組織にとって非常に重要な手法となります。

ケーススタディ:成功事例と失敗事例の比較

ケーススタディを通じて、ext4ジャーナルを利用した削除ファイルの再構成における成功事例と失敗事例を比較することは、データ復旧の手法を理解する上で非常に有益です。成功事例の一つとして、ある企業が誤って重要な顧客データを含むファイルを削除してしまったケースがあります。この企業は、迅速にデータ復旧専門家に依頼し、ジャーナルを解析することで削除されたファイルのメタデータを特定しました。その結果、削除されたファイルの情報を基に、復元作業が行われ、無事にデータが復旧されました。このプロセスでは、早期の対応が功を奏し、業務への影響を最小限に抑えることができました。 一方、失敗事例としては、別の企業が削除されたファイルの復元を試みたものの、ジャーナルの情報が上書きされてしまったケースがあります。この企業は、削除後に新たなデータを書き込んでしまったため、削除されたファイルのメタデータが失われ、復元が不可能になりました。このように、削除されたファイルの復元には迅速な対応が必要であり、データの上書きを避けることが重要です。 成功事例と失敗事例を比較することで、データ復旧の際には迅速な対応と適切な手法が不可欠であることが明らかになります。次の章では、データ復旧を行う際の注意点やベストプラクティスについてさらに詳しく解説します。

ext4ジャーナルを活用した削除ファイル再構成の総括

ext4ジャーナルを活用した削除ファイルの再構成は、データ復旧において非常に効果的な手法です。ジャーナリング機能により、削除操作のメタデータが記録され、誤って削除されたファイルの情報を迅速に特定することが可能になります。このプロセスでは、データ復旧専門家がジャーナルを解析し、削除されたファイルの整合性を確認することで、復元作業が行われます。 特に、削除されたファイルの復元には早期の対応が重要であり、他のデータによる上書きを避けることが成功の鍵となります。成功事例では、迅速な行動が業務への影響を最小限に抑える結果をもたらしました。一方で、失敗事例からは、適切な手法とタイミングがいかに重要であるかが示されています。 このように、ext4ジャーナルを利用した削除ファイルの再構成は、データ損失のリスクを軽減し、企業や組織の業務継続性を支える重要なプロセスです。今後も、データ復旧の専門知識を活用し、適切な対応を心がけることが求められます。

さらなる学びのためのリソースと次のステップ

データ復旧に関する知識を深め、実践的なスキルを身につけるためには、さまざまなリソースを活用することが重要です。まず、信頼性の高いオンラインセミナーやウェビナーに参加して、専門家から直接学ぶ機会を持つことをお勧めします。また、データ復旧に関する書籍や専門誌を読むことで、最新の技術や手法についての理解を深めることができます。 さらに、実際のケーススタディを通じて、成功事例や失敗事例から学ぶことも有益です。これにより、実践的な知識を得るだけでなく、同様の状況に遭遇した際の判断力を高めることができます。データ復旧の専門家とのネットワーキングも重要で、業界の動向やベストプラクティスを共有することで、より良い対応ができるようになります。 最後に、データ保護のための定期的なバックアップを実施し、万が一の事態に備えることが肝要です。これにより、データ損失のリスクを軽減し、業務の継続性を確保することができます。ぜひ、これらのリソースを活用し、データ復旧のスキルを磨いていきましょう。

削除ファイル再構成時の留意事項とリスク管理

削除ファイルの再構成を行う際には、いくつかの重要な留意事項があります。まず、削除されたファイルの復元は、ジャーナルに記録された情報が上書きされる前に行うことが肝要です。ファイルが削除されると、そのメタデータはジャーナルに保存されますが、新たなデータが書き込まれることで、この情報が失われる可能性があります。そのため、削除操作を行った後は、すぐにデータ復旧の専門家に相談することが推奨されます。 次に、復元作業を開始する前に、ストレージデバイスの状態を確認することも重要です。物理的な損傷がある場合、データ復旧のプロセスがさらに複雑になることがあります。データ復旧専門家は、適切な手順を踏むことで、データ損失のリスクを軽減し、復元作業を円滑に進めることができます。 また、復元作業後のデータ整合性の確認も欠かせません。復元されたファイルが正確であるかどうかを検証することで、業務に支障をきたさないようにすることが可能です。さらに、復元後は必ずバックアップを行い、同様の事態が発生した場合に備えることが大切です。これらの注意点を守ることで、削除ファイルの再構成プロセスをより安全かつ効果的に進めることができます。

補足情報

※株式会社情報工学研究所は(以下、当社)は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。