rsync差分転送で欠けたブロックを「どこで失ったか」を最短で特定する

rsyncの差分転送後に「サイズが小さい」「内容が違う」「partial transfer(code 23)」などが起きたとき、欠損が送信元・転送経路・宛先ストレージのどこで起きたかを最短で切り分けます。まずはdry-runで差分を可視化し、上書き事故を避けて回収(再取得)へつなげます。

この症状なら読み進めてOK

- rsync: partial transfer / code 23 / 一部だけ更新される

- 転送後にサイズが小さい・途中で止まる・欠けたファイルがある

- ファイルはあるが内容が違う(チェックサム不一致・サイレント破損が疑わしい)

- NFS/CIFS/ACL/所有者で止まり権限変更して良いか迷う

- 転送中に「vanished file」等が出て生成物が消える(ログ/テンポラリ/ビルド成果物)

回収(再取得)が成立しやすい前提

・送信元が消えている場合、宛先だけから「欠けたブロック」を元通りに戻すのは原則困難で、別ルート(スナップショット復元・バックアップ・解析)になります。

30秒で争点を絞る(まず“状況証拠”を取る)

まずは実行したrsyncコマンド/終了コード/方式(sshかrsyncdか)を押さえると、「どこで欠けたか」を追いやすくなります。

# 実行ユーザー/環境 whoami id rsync --version # 直前に実行したrsyncの終了コード(直後に確認できるなら) echo $? # 方式の目安:sshかrsyncd(873)か # ssh例: user@host:/path / rsyncd例: rsync://host/module ss -lntp 2>/dev/null | egrep ':(22|873)\b' | head -n 10 # 宛先の“欠け方”を軽く見る(重い全走査は後回し) ls -lah /DEST/PATH 2>/dev/null | head -n 50 find /DEST/PATH -maxdepth 2 -type f -printf "%TY-%Tm-%Td %TH:%TM %s %p\n" 2>/dev/null | tail -n 30 # systemdでrsyncd運用ならログが出ることがある(空でも正常) journalctl -u rsync --no-pager -n 120 2>/dev/null

journalctl -u rsync は空になりがちです。その場合は実行スクリプト(cron/CIログ)や、rsyncに --log-file が付いていないかを確認します。

あなたはどれ?(最短で当てはめる)

- A: 欠けた/小さい(途中中断・除外・削除・vanished)

- B: あるが内容が違う(inplace/サイレント破損/ストレージ/経路)

- C: 権限/所有者/ACLで止まる(NFS/CIFS/監査要件)

まずはdry-runで変更対象を見える化してから、欠けた部分だけを安全に再取得/検査します。

# まずは試走:変更対象だけを見る(事故防止) rsync -avh --dry-run --itemize-changes --numeric-ids /SRC/PATH/ /DEST/PATH/ | head -n 200

# A: 送信元に残っている前提で、欠けた差分を安全に再取得(基本形) # ※まずdry-runで対象が妥当か確認してから実行 rsync -avh --partial --checksum --numeric-ids --info=stats2,progress2 \ /SRC/PATH/ /DEST/PATH/

# A': 途中中断っぽいとき(partialを残して再開しやすくする) rsync -avh --partial --partial-dir=.rsync-partial /SRC/PATH/ /DEST/PATH/ # 途中ファイルの痕跡(環境によりパターンは異なる) find /DEST/PATH -type f -name ".rsync-partial*" -o -name ".*.??????" 2>/dev/null | head -n 50

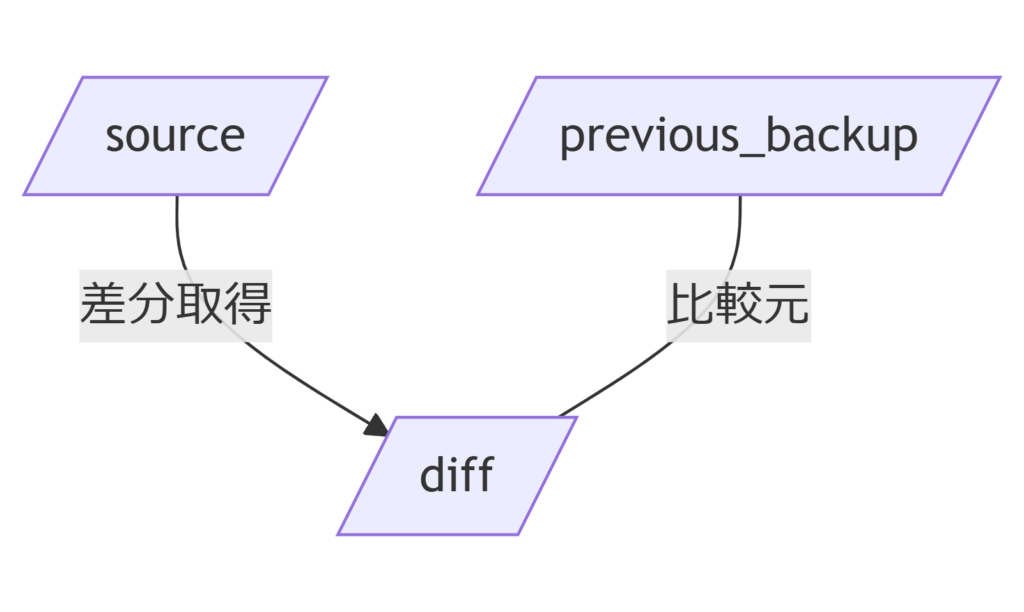

# B: あるが内容が違う(まず“差分の限定”→“最小範囲で検査”) # サンプルでハッシュ比較(全量は重いので範囲を決めて) (cd /SRC/PATH && find . -type f -maxdepth 3 -print0 | xargs -0 sha256sum | sort > /tmp/src.sha256.sample) (cd /DEST/PATH && find . -type f -maxdepth 3 -print0 | xargs -0 sha256sum | sort > /tmp/dst.sha256.sample) diff -u /tmp/src.sha256.sample /tmp/dst.sha256.sample | head -n 80 # I/Oエラーやファイルシステム異常の兆候 dmesg -T | egrep -i "I/O error|ext4|xfs|btrfs|nvme|ata|reset|corrupt" | tail -n 80

# C: 共有ストレージ/NFS/ACL/所有者で止まる(触る前に“何が違うか”を見る) rsync -avh --dry-run --itemize-changes --numeric-ids /SRC/PATH/ /DEST/PATH/ | head -n 200 getfacl -p /DEST/PATH 2>/dev/null | head -n 120 mount | egrep -i " nfs | cifs | fuse " | head -n 30

--inplace は状況によっては復旧を難しくします(途中停止で“元も先も中途半端”になりやすい)。巨大ファイルで容量不足など必要条件が明確なときだけ、対象を限定して使います。

選択や行動する前に:影響範囲を1分で確認(やり過ぎ防止)

「どのファイルだけ欠けたか」「本番で上書きが起きるか」を先に見ておくと、復旧を長期化させにくいです。

# 変更対象の見える化(差分だけ把握してから触る) rsync -avh --dry-run --itemize-changes --numeric-ids /SRC/PATH/ /DEST/PATH/ | head -n 200 # ロールバック余地(スナップショット/世代バックアップ)の有無 ls -la /DEST/PATH 2>/dev/null | head -n 60 ls -la /DEST/PATH/.snapshots 2>/dev/null | head -n 60

失敗するとどうなる?(やりがちなミスと起こり得る結果)

--deleteや誤ったパス指定で、残っているはずの元データまで消えて復旧範囲が拡大する。--inplaceの使いどころを誤り、途中で止まると「元も先も中途半端」になって整合性確認が難しくなる。- 共有ストレージ/NFS/ACLの問題を権限変更で無理に通して、監査要件や運用ルールに抵触して手戻りが増える。

- I/Oエラーやサイレント破損を見落として再転送を繰り返し、停止や復旧長期化につながる。

迷ったら:無料で相談できます

情報工学研究所へ無料相談。状況を固定して、最小変更での収束ルートを一緒に作れます。

・

--delete を付けるか迷ったら。・

--inplace / --partial の使い分けで迷ったら。・送信元が残っているか確信が持てない。

・途中ファイルや一部欠損がどこか診断ができない。

・NFS/CIFS の遅延やロックが絡んで止まる原因が切り分けられない。

・ハッシュ比較の対象範囲が決められず、どこまで検査すべきか迷ったら。

・本番で再転送すると上書き影響が出そうで踏み切れない。

詳細な説明と対策は以下本文へ。

もくじ

- 差分転送のはずが、なぜ「欠けたブロック」が生まれるのか(現場のモヤモヤから入る)

- 「壊れてないのに合わない」― rsyncの“正しさ”が裏目に出る瞬間

- 伏線1:ブロック境界のズレが、差分の一致判定を狂わせる

- 伏線2:--inplace / --partial / --append-verify が“回収”を難しくも、助けもする

- 伏線3:転送中断・再開で起きる「穴あきファイル」とメタデータ不整合の罠

- 症状の見える化:--progress / --stats / --itemize-changes とログ設計で“失われ方”を特定する

- 回収の基本戦略:コピーではなく“証拠”として残す(スナップショット/退避/検証)

- 具体手順:失われたブロックを再構成する(checksum/ブロック比較/部分抽出の組み合わせ)

- 再発防止:rsyncオプション設計を「運用の前提」から作り直す(ネットワーク/FS/ストレージ)

- 帰結:差分転送は魔法じゃない—“回収できる設計”にして初めて強い同期になる

【注意】 rsync の差分転送で「欠けたブロック(欠損したように見える部分)」が疑われる場合、自己判断で上書き同期や再試行を繰り返すと、元データまで巻き込んで状況が悪化することがあります。まずは現状の保全(書き込み停止・退避・検証)を優先し、復旧可否や整合性要件(監査・契約・業務影響)を含めて、株式会社情報工学研究所のような専門事業者へ相談してください。

冒頭30秒:欠損の拡大を「被害最小化」する初動と、今すぐ相談すべき判断基準

「rsync で差分転送しただけなのに、ファイルの一部が欠けたっぽい」「再実行すれば直るはず…でも怖い」。現場だと、まずこういうモヤモヤが来ます。

そして、ここでの最優先は“原因究明”よりも欠損の拡大を防ぐ(被害最小化)です。rsync の再実行は“回復の手段”にもなりますが、条件を誤ると正しい元データを上書きして確定的な損失にもなりえます。

まず、状況別に「取るべき行動」を先に置きます。迷ったらこの表に戻ってください。

| 症状(見えている事象) | 取るべき行動(安全側の初動) |

|---|---|

| 同期先ファイルの一部が欠けた/壊れたように見える |

|

| rsync が中断した/ネットワーク断が頻発する |

|

| 容量不足(No space left on device)やI/Oエラーが出た |

|

| 監査・契約・業務で「完全一致」が必須(ログ・証跡が必要) |

|

“安全な初動”だけは、ここから先に進む前にやってください

ここでのゴールは「復旧作業を自力で完走する」ではなく、回収可能性と整合性を落とさずに次の判断へ進むことです。

- 書き込み停止:同期先・同期元ともに、当該ファイルへの更新を止めます(アプリ、バッチ、Cron、CIなど)。

- 退避:同期先の“壊れたかもしれないファイル”を別名にコピーして保全します(上書き禁止)。

- 最小検証:元(同期元)が確実に正であるか、サイズ・更新時刻・ハッシュで確認します。

心の会話としては、たぶんこうです。

「またログか…。今すぐ直したいのに、手が止まるのが一番つらい」

ただ、この“手を止める数分”が、のちの回収可能性を大きく左右します。

「今すぐ相談」を推奨する条件(一般論の限界が来るライン)

- 同期元・同期先のどちらが“正”か確信が持てない

- --inplace を使っていた/使った可能性がある(上書き更新により元の状態が失われる)

- I/Oエラー、異音、SMART異常、RAID劣化などストレージ側の不調が疑われる

- 法務・監査・顧客契約で「完全一致の証明」や「証跡提出」が必要

このラインを超えると、一般的な手順の紹介だけでは責任ある判断ができません。具体的な案件・契約・システム構成(NAS/RAID/クラウド、暗号化有無、バックアップ世代、復旧許容RPO/RTO)に依存するため、株式会社情報工学研究所への相談を検討してください。

相談導線:https://jouhou.main.jp/?page_id=26983

電話:0120-838-831

「差分転送なのに欠ける」理由:rsyncの前提が崩れると、整合性は簡単に揺らぐ

まず事実として、rsync は「ネットワークが不安定でも勝手に整合性を保証してくれる魔法」ではありません。rsync が得意なのは、“前提が満たされている限り”差分を効率良く運ぶことです。欠損(欠けたブロック)が疑われるときは、この前提がどこかで崩れています。

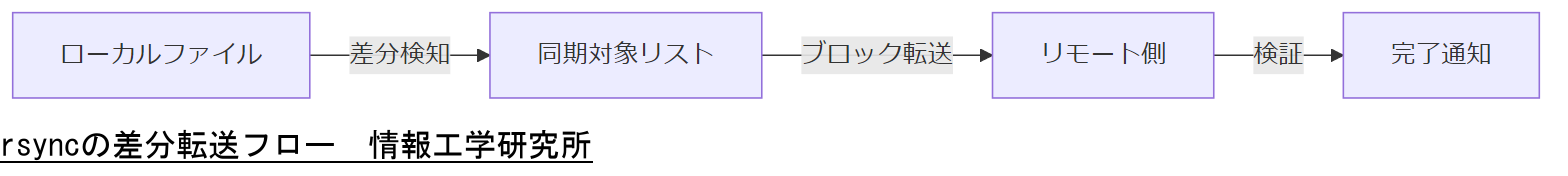

rsyncの差分転送は、こう動く(誤解しやすいポイントだけ)

rsync は一般に、受信側(同期先)にある既存ファイルを一定サイズのブロックに分け、各ブロックのチェックサム情報を送信側(同期元)へ渡します。送信側は送信元ファイルを走査して、受信側に既にあるブロックと一致する部分を見つけ、一致部分は「参照(トークン)」、一致しない部分は「生データ」として送ります。この仕組み自体はよく出来ていますが、次の条件が崩れると「一致判定」や「再開」が期待どおりに動きません。

欠損が疑われる典型パターン(脚色なしの“起こり方”)

- 転送中にファイルが更新された

同期元が生成中・追記中(ログ、DBダンプ、動画、VMイメージ等)の状態で rsync すると、rsync が見ている「読み取り時点」と「転送完了時点」で内容が変わりえます。結果として、受信側のファイルが“部分的に古い/新しい混在”になり、欠けたように見えることがあります。 - --inplace により受信側ファイルを直接書き換えた

通常 rsync は一時ファイルに書いてからリネームするため、失敗しても受信側の既存ファイルが保持されやすい設計です。ところが --inplace は受信側を直接更新します。中断・断線・容量枯渇が起きると、受信側のファイルが中途半端な状態で確定し、しかも“元に戻す材料”が減ります。 - 部分転送(--partial)と再開が、想定外の状態で残った

--partial は中断時の途中ファイルを残して再開しやすくしますが、途中ファイルが「正しい途中状態」だという前提があります。ディスクフル、I/Oエラー、別プロセスによる更新、バックアップソフトの干渉などがあると、途中ファイルが壊れたまま残り、再開が“回復”ではなく“破損の上塗り”になりえます。 - 圧縮・暗号化・コンテナ化で「少しの差分」が「全体差分」になる

gzip や暗号化済みファイル、データベースの圧縮バックアップなどは、先頭付近の小さな変化が全体に波及して、差分一致がほぼ取れなくなることがあります。これはrsyncの欠陥ではなく、データ形式の性質です。差分一致が取れないと転送量が増え、断線やディスクフルのリスクが上がり、結果として欠損が疑われやすくなります。

「欠損」に見えるが、実は“表示側の問題”のこともある

実際にはデータは揃っているのに、アプリがキャッシュやインデックスの不整合で「欠けて見せる」ケースもあります(例:メディアライブラリのDB、検索インデックス、サムネイル等)。この可能性を切るためにも、次章で述べるハッシュやチェックサムでの“事実確認”が必要になります。

ここまでの要点はシンプルです。

「rsync が悪い」ではなく、rsync が前提にしている“静的な入力”と“健全な出力先”が崩れると、整合性が揺らぐ。この現実を踏まえると、次にやるべきは“再実行”ではなく、どこが崩れたかをログと検証で特定することです。

ログがないと回収は難しい:差分の“失われ方”を特定する検証設計(dry-runとチェックサム)

欠損回収で一番つらいのは、「いま何が起きているのか」を推測で埋め始めた瞬間です。推測が入ると、次の一手(再同期・上書き・削除)が高確率で危険になります。ここでは“事実として確認できる”手順だけを書きます。

最初に確保するもの(これがないと後で詰む)

- rsync の実行コマンド(オプション含む)

- 終了コード(0以外なら要注意)と標準出力・標準エラー

- 可能なら rsync のログ(--log-file)、転送統計(--stats)

- 同期対象ファイルのサイズ・更新時刻(同期元/同期先)

心の会話で言うと、こういう抵抗が出ます。

「ログなんて取ってない…今さら何が分かるの?」

ただ、rsync は“何を更新したか”を出す機能が充実しています。次の dry-run で、かなりの事実が取れます。

安全な第一手:dry-runで“上書きの量”を可視化する

実データを変えずに差分を確認するなら、まず dry-run です。特に --itemize-changes は、変更内容を記号で表します。

rsync -a -n --itemize-changes --stats /src/ /dst/ # -n は --dry-run(実際には書き込まない) # -a は代表例(実環境の要件に合わせて調整) ここでのポイントは「差分が大量に出ていないか」です。欠損が疑われる1ファイルだけの問題に見えて、実はディレクトリ全体で整合が崩れていることもあります。大量の差分が出る場合、拙速な再同期は避け、まず“どの条件で崩れたか”を疑うべきです。

事実確認の要:チェックサムで「本当に欠けているか」を確定させる

表示上の不具合やアプリ側キャッシュの問題を切るには、ハッシュ(例:SHA-256)で一致/不一致を確定します。巨大ファイルでは計算コストが上がるため、優先度を付けます。

- 最優先:業務影響が大きいファイル(DBダンプ、顧客成果物、設定、鍵/証明書を除く機密)

- 次点:欠損が疑われるファイル(サイズ不一致、更新時刻不自然、アプリで開けない)

rsync 自体でも、チェックサム比較(-c / --checksum)で“内容”基準の差分判定ができます。ただし -c は全ファイル読み取りになるため負荷が高く、運用中のストレージでは注意が必要です。

rsync -a -n -c --itemize-changes /src/ /dst/ # -c はサイズ・時刻ではなく内容チェックサムで比較(負荷大) この段階で「本当に欠けている(内容が一致しない)」が確定したら、次に考えるのは“回収ルート”です。再実行で回収できるのか、それとも退避データやスナップショットから戻すべきか。ここを誤ると、一般論では取り返しがつかなくなります。

回収の前にやってはいけない行動(一般論として危険度が高い)

- 原因が不明なままの --delete 付き同期(消えていい保証がない)

- 欠損が疑われる同期先を“正”とみなして同期元へ戻す(逆流)

- --inplace のまま何度も再実行(中途状態が積み重なる)

ここまでで“事実”が揃ってきますが、次の章以降は失われたブロックをどう回収するか(--partial/--partial-dir、--append-verify、再取得、スナップショット、部分抽出、検証ログの残し方)に入ります。個別のシステム構成(NAS/RAID/クラウド、帯域、暗号化、ファイル形式、運用停止可否)で最適解が変わるため、終盤では「一般論の限界」と「専門家に相談すべきライン」をさらに明確化します。

伏線:--inplace / --partial / --append-verify を“回収”の味方にする条件、敵にする条件

ここから先は「欠けたブロックを回収できるか」を現実的に判断する章です。結論から言うと、rsync のオプションは“便利”というより前提条件を明示するための契約です。契約(前提)が合っていないと、回収のつもりが破壊になります。

--inplace:速いが、回収余地を削る

--inplace は、受信側(同期先)の既存ファイルを直接書き換えます。巨大ファイルで一時領域が取れないときや、追記型の運用で使われることがありますが、欠損疑いの局面ではリスクが高いです。

- 味方になる条件:受信側ファイルが確実に「捨ててもよい複製」で、かつ中断が起きない(帯域・容量・I/Oが安定)。

- 敵になる条件:中断・容量不足・I/Oエラーが起きる可能性がある/受信側ファイルが唯一のコピーに近い/監査要件がある。

なぜ危ないか。rsync の通常動作(非 --inplace)は、一時ファイル(転送中ファイル)を作り、最後にリネームで置き換えるため、途中失敗でも“元の受信ファイル”が残る余地があります。一方 --inplace は途中で止まると、受信ファイル自体が中途半端な状態で残ります。欠損に見える状態がそのまま固定されるため、後から「どこまでが正しかったか」を追う材料が減ります。

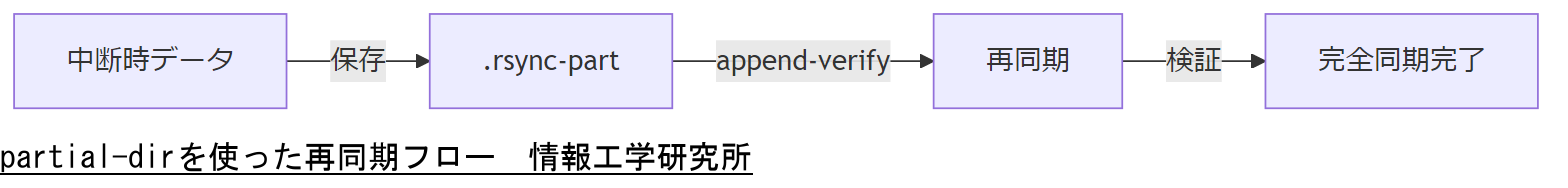

--partial / --partial-dir:中断に強いが、残骸管理が必須

--partial は、転送が途中で止まっても途中ファイルを残し、再開時に続きから進めやすくします。大容量ファイルや不安定回線で有効ですが、前提は「途中ファイルが正しい途中状態であること」です。ディスクフルやI/Oエラーが絡むと“正しい途中状態”ではなくなります。

運用上は --partial-dir を使い、途中ファイルを専用ディレクトリに隔離するのが安全側です。これにより、同期先の“本番ファイル”が汚れにくく、途中ファイルの扱い(保全・削除・再開)が明確になります。

rsync -a --partial --partial-dir=.rsync-partial --info=progress2 /src/ /dst/ - 味方になる条件:途中ファイル用ディレクトリが安定(容量・I/O)し、同期先の本番ファイルと分離できる。

- 敵になる条件:途中ファイルが本番ファイルと同じ場所に混ざり、運用者が「何が本番か」判断しにくい。

--append-verify:追記型ファイルの回収に強いが、前半が“同一”である必要がある

--append-verify は、受信側に既にあるファイルの先頭部分を「既存として使い」、不足分を追加しつつ、既存部分も検証します。ログやバックアップの追記型運用などで有効です。ただし、受信側の先頭部分が既に壊れている/途中で穴がある場合、期待どおりには回収できません。

rsync -a --append-verify /src/big.log /dst/big.log ここでの現実的な判断はこうです。

- 追記型で、受信側の先頭が正しい可能性が高い → append-verify を検討

- 受信側の先頭も疑わしい/途中穴がある → 一旦退避して作り直す方が安全

「どれを使うべきか」を決めるための整理表

| 状況 | 有力な選択肢 | 注意点(回収の観点) |

|---|---|---|

| 回線が不安定/中断が起きる | --partial-dir で隔離しつつ再開 | 途中ファイルが正しい途中状態であることが前提。ディスクフルやI/Oエラーが絡むと危険。 |

| 巨大ファイルを追記運用している | --append-verify | 受信側の先頭が壊れていないことが重要。壊れているなら作り直しが安全。 |

| 一時領域が取れない | (やむを得ず)--inplace | 失敗時の回収余地が小さい。監査要件や唯一コピーの場合は避けるべき。 |

| 完全一致を証明したい | --checksum(必要範囲で)+ログ保全 | 負荷は高いが、事実確認の材料になる。証跡設計とセットで。 |

この章のまとめは一つです。

「回収したい」なら、オプションは“速度”より保全と再現性を優先して選びます。次章では、欠損が疑われるファイルを“これ以上壊さない”ために、スナップショットや退避、検証の順番を確定させます。

回収の前提:コピーではなく“証拠”として保全する(スナップショット/退避/検証の順番)

欠損回収の現場で起きがちな失敗は、「正しいものを作り直す」つもりで正しいものを消すことです。これは技術力というより、時間圧と心理の問題です。だから順番を固定します。ここは脚色できません。順番を守るほど回収率が上がります。

保全の基本手順(順番が重要)

- 書き込み停止:同期ジョブ、アプリ、バックアップ、ウイルス対策のスキャンなど、対象に触れるものを止める。

- 同期先の退避:欠損が疑われるファイルを別名コピーし、以後そのコピーを検証対象にする(本番に触らない)。

- 可能ならスナップショット:ZFS/Btrfs/LVM、NASのスナップショット機能があるなら、現状態を固定する。

- 同期元の正当性確認:同期元が本当に“正”か、更新中ではないか、ハッシュ・アプリ整合性で確認する。

- 検証ログの確保:いつ、誰が、どのコマンドで、何を確認したかを残す(監査・説明責任に直結)。

心の会話としてはこうなります。

「スナップショットなんて今さら…」「退避してる間に復旧できたのに」

でも、ここでの退避とスナップショットは、“戻れる場所”を作る行為です。戻れない状態での試行錯誤は、一般に危険です。

スナップショットが無い環境での“代替”

スナップショット機能が無い場合でも、代替はあります。ただし作業コストが上がるため、業務影響と相談して決めます。

- 対象ディレクトリを別ボリュームへコピー(容量が許せば最も単純)

- 重要ファイルだけを優先退避(全体は無理でも“要”だけ固定する)

- クラウドの場合はバージョニング(S3等)やスナップショット相当機能の有無を確認

ここで重要なのは「どのレベルで整合性が必要か」です。ファイル単体の整合性で足りるのか、ディレクトリ全体の整合性が必要なのか、アプリのトランザクション整合性が必要なのか。これは一般論では決められません。システム構成と業務要件で変わります。

依頼判断:一般論の限界が見えるポイント

- NAS/RAID が絡み、冗長性劣化やディスクエラーが疑われる

- クラスタ・分散FS・オブジェクトストレージなど、整合性が多層

- 監査・契約で「いつの時点の整合か」を説明する必要がある

ここに当てはまるなら、欠損回収は“rsyncの話”を超えます。具体的な案件・契約・システム構成に踏み込んで判断する必要があるため、株式会社情報工学研究所への相談を検討してください。

相談導線:https://jouhou.main.jp/?page_id=26983 / 電話:0120-838-831

次章では、いよいよ「失われたブロック」を現実的に回収するための手順(rsyncの再取得、部分抽出、検証)に入ります。ここからは“何を正として、どこから取り直すか”が主題です。

具体手順:欠けたブロックを回収する3ルート(再取得/スナップショット復元/部分抽出)

「欠けたブロックを回収」と言っても、実務上のルートは大きく3つです。どれが最適かは、同期元が健全か、スナップショットがあるか、業務停止が可能かで決まります。ここでは“事実確認に基づいて選ぶ”ための手順にします。

ルートA:同期元が正 → rsyncで安全に再取得する(上書きしない)

同期元が正で、欠損が同期先のみの問題なら、原理的には再取得で直せます。ただし、いきなり本番ファイルを上書きしないのが基本です。まず“別名”に取得して照合します。

# 例:欠損が疑われる1ファイルを別名に取得(上書き回避の発想) rsync -a --progress /src/path/file.bin /dst/path/file.bin.recovered 取得後にハッシュで一致を確認し、問題なければ切り替えます。これなら「途中でまた失敗した」場合でも、元の(欠損疑い)ファイルを保持できます。

ルートB:スナップショットがある → 欠損前の時点へ戻す(最短で確実)

スナップショットがある環境では、欠損回収は“rsyncで頑張る”より、欠損前時点へ戻すのが最短で確実なことが多いです。ただし、戻す範囲(単一ファイル/ディレクトリ/ボリューム)と、戻した後の再同期設計が必要です。

- 戻す前に、現在状態を別スナップショットで固定(戻しの戻し)

- 戻した後、rsync のオプションを見直して再発防止(後章)

スナップショット復元は、環境によって操作が異なります。ここも一般論の限界があり、NASベンダ・FS設計・運用要件で判断が変わります。

ルートC:同期元が完全には信用できない/部分だけ回収したい → 部分抽出と比較で詰める

同期元も更新中だった可能性がある、あるいは同期先で一部だけ壊れたかもしれない。こういうときは「どの範囲が一致していて、どこから崩れたか」を確定し、必要最小限の回収を狙います。

実務では、次のような比較が行われます。

- サイズの差分(どれくらい欠けた可能性があるか)

- ハッシュの比較(全体一致/不一致)

- 部分ハッシュ(先頭/末尾/固定オフセットの比較)

ただし、ここから先は対象ファイル形式によって手段が分かれます。例えばDBダンプ、ログ、バイナリ、圧縮ファイルでは「部分抽出しても意味があるか」が違うからです。個別案件のファイル種別と業務要件を踏まえて設計する必要があり、無理に一般化すると誤誘導になります。

ここまでの小まとめ:回収は“最短で確実なルート”を選ぶ

回収は根性論ではありません。

同期元が正なら「別名で再取得→照合」。

スナップショットがあるなら「時点復元」。

どちらも不確実なら「比較して最小範囲に絞る」。

この判断を誤ると、欠損を“確定損失”にしてしまいます。

次章では、欠損が起き続ける背景(ファイル更新、ブロック境界、暗号化/圧縮、ネットワーク)を踏まえて、rsync運用を“回収できる設計”に作り直します。

再発防止の核心:rsyncを「回収できる同期」にする運用設計(更新中ファイル・巨大ファイル・暗号化の扱い)

欠損が疑われるケースの多くは、rsync の機能不足ではなく「入力が静的である」「出力先が健全である」という前提が崩れたことが原因です。再発防止は、オプションの小手先より運用の前提条件を“崩れにくくする”ことが本質になります。現場の感覚としてはこうです。

「結局、rsync を責めても戻らない。じゃあ次に同じ事故を起こさない形にするしかない」

1) まず“更新中ファイル”を同期対象から外す(最重要)

ログ、DBダンプ、VMイメージ、アップロード途中のメディアなど、同期中に内容が変わり得るファイルは、差分一致の前提を壊します。対策は「更新中のまま同期しない」に尽きます。実務では次のように設計します。

- 生成→確定→リネーム:生成は一時名で行い、完了後に確定名へ原子的に切り替える(例:file.tmp → file.bin)。

- ロック/フラグ:生成中を示すフラグファイルを置き、rsync はそれを見て除外する。

- 時間窓:夜間バッチ等、更新が止まる時間帯に同期する(RPO/RTOと要相談)。

2) 巨大ファイルは“方式”を変える(rsync万能論をやめる)

巨大な単一ファイル(数十GB〜TB)では、少しの変更が全体差分になったり、転送中断の影響が大きくなります。ここでの選択肢は「rsyncで頑張る」だけではありません。

| 状況 | 現実的な方針 | 狙い(欠損を起こしにくくする) |

|---|---|---|

| 追記型ログ・追記型バックアップ | --append-verify を検討(前提を満たす場合のみ) | “既存部分”を活かしつつ不足分だけ追加し、整合性も確認する |

| 頻繁に書き換わる巨大ファイル | 分割(チャンク化)やスナップショット設計へ | 変更範囲を局所化し、再送・検証コストを下げる |

| 回線が不安定で中断が多い | --partial-dir で途中ファイルを隔離 | 途中状態を管理しやすくし、本番ファイルを汚しにくくする |

| 監査要件が強い | “同期”と“検証”を工程分離(後述) | 説明可能な証跡を残し、合否判定を機械化する |

ここは一般論の限界が出ます。ファイル形式(圧縮・暗号化・DB)、ストレージ(NAS/RAID/クラウド)、許容停止時間(メンテ窓)で最適解が変わるためです。だからこそ、設計段階で株式会社情報工学研究所のような専門家に相談して“回収できる運用”を先に作る価値があります。

3) 圧縮・暗号化データは「差分一致が期待できない」前提で設計する

暗号化済みファイルや圧縮済みアーカイブは、少しの変更が全体に波及しやすく、rsyncの差分効率が落ちます。効率が落ちると転送が長くなり、中断・ディスクフル・タイムアウトのリスクが上がります。対策は次の方向性になります。

- “固めてから送る”のではなく、固める前の素材を同期し、受信側で固める(可能な運用なら)。

- どうしても固める必要があるなら、世代管理(バージョニング/スナップショット)を厚くして、失敗時に戻れるようにする。

この章の結論は、「rsyncを強くする」ではなく、rsyncが強く働ける前提(静的入力・健全出力・戻れる世代)を作ることです。次章では、その前提を“工程”として固定化し、誰がやっても同じ結論にたどり着けるログ・証跡・検証の仕組みに落とします。

相談導線:https://jouhou.main.jp/?page_id=26983

電話:0120-838-831

“同期”と“検証”を分ける:差分転送の事故を「ノイズカット」する二段階パイプライン(証跡・合否判定・ロールバック)

現場でいちばん苦しいのは、障害が起きたあとに上司や関係部門へ説明するときです。

「たぶん同期は終わってます」では通りません。

「直った気がします」も危険です。

だから、rsync運用を“作業”ではなくパイプラインにして、同期と検証を分離します。これが結果的に事故の温度を下げ、場を整えます。

二段階パイプラインの全体像

- 同期(転送):まずは壊さない前提でデータを運ぶ(本番を直接更新しない)

- 検証(合否判定):ハッシュ・チェックサム・件数・メタデータで一致を確認し、合格なら切り替える

ポイントは「同期が成功した=正しい」ではなく、検証に合格した=正しいへ定義を変えることです。

ステージング方式:本番を直接更新しない

欠損事故の多くは「本番ディレクトリを直接rsyncした」ことから始まります。対策として、同期先にステージング領域(検証用)を用意し、検証に合格したら切り替えます。

- 同期先:/data/live(本番)と /data/stage(検証用)を分ける

- rsync は基本 /data/stage に入れる

- 検証合格後に、切り替え(運用に合わせてリネーム・マウント切替・シンボリックリンク切替など)

これだけで「再実行で本番を上書きして悪化する」確率が大きく下がります。

ログと証跡:rsyncは“出力フォーマット設計”が肝

運用で必要なのは、あとから「何が変わったか」を再現できるログです。代表的には次の出力を揃えます。

- dry-runログ:実行前に差分量を把握する(--dry-run、--itemize-changes)

- 実行ログ:いつ、どこからどこへ、何を転送したか(--log-file など)

- 統計:転送量・速度・ファイル数(--stats)

さらに、障害対応で効くのは「人が読むログ」だけでなく「機械が判定できるログ」です。差分が一定以上なら中断する、終了コードが0以外なら切り替えない、といったガードを入れます。

“合否判定”を作る:一致確認の粒度を決める

検証の強度は、業務要件とコストで決めます。全部を最強にすると運用負荷が跳ね上がるため、段階設計が現実的です。

| 検証レベル | 確認内容 | 向いているケース |

|---|---|---|

| レベル1(軽量) | ファイル数、サイズ、更新時刻の整合 | 頻繁同期、業務影響は限定的、まずは事故率を下げたい |

| レベル2(中) | 重要ファイルだけハッシュ一致(SHA-256等) | 重要データが混ざる、説明責任があるが全量は重い |

| レベル3(強) | 広範囲で内容一致(rsync --checksum 相当の思想) | 監査・契約・インシデント後の再構築など、確実性が最優先 |

ここで重要なのは、検証レベルの選択そのものが個別案件(契約・システム構成・業務)に依存する点です。一般論だけで「レベル3にすべき」と言うのは無責任になりがちです。どの粒度で、どの範囲を、どの頻度で検証するかは、現場と経営の折衝も含む設計になります。

“戻せる設計”を仕込む:世代保持と切り替え条件

欠損が疑われたとき、最後に効くのは「戻せる」ことです。スナップショットやバージョニングが理想ですが、最低限でも次を持ちます。

- 切り替えは検証合格後のみ

- 切り替え前の状態を一定期間保持(世代管理)

- 問題が出たら“即ロールバック”できる手順を文書化

この章のまとめは、「rsyncを実行する」ではなく、同期→検証→切り替え→ロールバックまでを一連の仕組みにすることです。これができると、欠損事故のたびに夜間対応が増えるのではなく、むしろ“事故の温度を下げる”方向へ持っていけます。

そして、この仕組み作りは、あなたの環境(NAS/RAID/クラウド、運用停止可否、監査要件、予算)で最適解が変わります。一般論のテンプレだけでは設計しきれないため、具体的に悩んでいる案件があるなら、株式会社情報工学研究所への相談を検討してください。

相談導線:https://jouhou.main.jp/?page_id=26983 / 電話:0120-838-831

実務テンプレ:安全側のrsyncコマンド設計(やらない判断を含めた“歯止め”の作り方)

ここまでの話を「明日からの運用」に落とす章です。現場の本音はだいたいこうです。

「理屈は分かった。じゃあ、何をどう実行すれば“欠損の疑い”で夜間に追い込まれないの?」

答えは、rsyncコマンドそのものより、壊しにくい流れ(ステージング、ログ、検証、切り替え、ロールバック)を先に作ることです。ここでは“安全側に倒す”ための代表テンプレを提示します。あなたの環境で最適化する際は、後半の「一般論の限界」に戻ってください。

テンプレ0:まず dry-run(実行前に差分と削除を見える化)

本番を触る前に、差分量と削除対象が想定どおりかを確認します。特に削除を伴う同期は、最初に“見える化”しないと事故の温度が上がります。

rsync -a -n --itemize-changes --stats /src/ /dst/ - -n(dry-run)で実書き込みを避ける

- --itemize-changesで何が変わるかを記号で出す

- --statsで規模感(件数・転送量)を把握

テンプレ1:ステージングへ同期(本番を直接更新しない)

欠損疑いの“拡大”を抑え込む最も効く作法は、本番に直接rsyncしないことです。まずステージングへ入れて検証し、合格したら切り替えます。

# 例:/dst_stage に同期(/dst_live は本番) rsync -a --info=progress2 --stats --log-file=/var/log/rsync_job.log \ --partial --partial-dir=.rsync-partial \ /src/ /dst_stage/ ここでの狙いは、「失敗しても本番が汚れにくい」ことです。回線断やディスクフルが起きても、ダメージコントロールがしやすくなります。

テンプレ2:削除を伴うときの“歯止め”(削除は最後・遅延・別管理)

「同期元から消えたものは同期先でも消す」は運用上必要なことがあります。ただし、欠損疑い局面で削除を軽率に入れると、回収可能性を落とします。削除の設計は“慎重側”が基本です。

- 最初は削除なしで回し、差分を安定させる

- 削除が必要なら、dry-runで削除対象を確認してから

- 可能なら削除を遅延させ、検証後に確定させる

# 例:削除を伴う場合もまず dry-run で確認 rsync -a -n --delete --itemize-changes --stats /src/ /dst_stage/ 削除の振る舞いは要件(保持期間、監査、誤削除の許容)で変わります。一般論で「deleteを使え/使うな」と断言するのは危険です。ここは個別案件の判断領域です。

テンプレ3:巨大ファイル・不安定回線の“現実解”(途中ファイル隔離+再開)

中断が避けられない環境では、途中状態を管理できるようにしておくことが重要です。

rsync -a --info=progress2 --stats \ --partial --partial-dir=.rsync-partial \ /src/ /dst_stage/ 注意点は1つだけ。途中ファイルが“正しい途中状態”であることが前提です。ディスクフルやI/Oエラーが絡むなら、途中ファイルを鵜呑みにせず、退避・作り直しも視野に入れます。

テンプレ4:検証(合否判定)を“作業”ではなく工程にする

rsyncの終了コードが0でも、それだけで「正しい」とは限りません。だから、同期→検証→切り替えを固定します。検証の強度は、あなたの業務要件で選びます。

| 検証 | 具体例 | 現場での位置づけ |

|---|---|---|

| 軽量 | 件数・サイズ・更新時刻の整合、差分が想定範囲か | 日次/高頻度の同期でまず事故率を下げる |

| 中 | 重要ファイルのみハッシュ一致(SHA-256等) | 説明責任があるが、全量ハッシュは重い場合 |

| 強 | 広範囲の内容一致(思想としては --checksum に近い) | 監査・契約・インシデント後の再構築など |

そして合格したら切り替えます。切り替え方法(リネーム、リンク切替、マウント切替)は環境次第です。ここは“仕組み”の設計領域なので、一般論だけで決めるのは危険です。

困ったときの“やらない判断”チェック(これがあると空気を落ち着かせられる)

- 同期元が更新中の可能性がある → まず同期対象の作り方(確定→リネーム)を直す

- 同期先ストレージにI/O不安がある → rsyncを回す前にストレージ健全性を優先

- 削除を伴う同期で差分が想定外に大きい → いったん止めて原因特定

- 監査・契約で完全一致の説明が必要 → 検証工程と証跡の設計を先に固める

この章のまとめです。

rsyncの運用は「コマンド」ではなく、止める基準・検証・戻し方まで含めた設計です。次章では、この“設計の限界点”を明確にし、一般論でできる範囲と、個別案件で専門家に相談すべき範囲を自然に切り分けます。

帰結:差分転送は魔法じゃない—「一般論の限界」を越えたら専門家に委ねるのが最短ルート

ここまで読んで、「rsyncの欠損回収」は結局こういう話だった、と腹落ちするポイントがあります。

差分転送は“速く運ぶ技術”であって、“正しさを自動保証する仕組み”ではない。

だから、欠損の疑いが出た瞬間に必要なのは、根性で再実行することではなく、被害最小化(拡大抑え込み)→事実確認→回収ルート選択→再発防止設計の順番です。

「一般論」で言えるのは、ここまで

本記事で提示したのは、以下の“どの環境でも概ね成立しやすい”原則です。

- 欠損の疑いが出たら、まず書き込み停止と退避で“戻れる状態”を作る

- dry-runやログで差分を見える化し、推測で動かない

- 本番を直接更新せず、ステージング→検証→切り替えに寄せる

- 巨大ファイル・更新中ファイル・暗号化/圧縮は、差分一致の前提が崩れやすいと理解して設計する

「一般論の限界」が来る場所(ここから先は個別案件)

一方で、次の領域に入ると“正しい答え”は環境・契約・業務要件で変わります。ここを一般論で断言すると、誤った誘導になり得ます。

- NAS/RAID/分散FS/クラウドなど多層ストレージで、整合性の責任範囲が複雑

- 監査・契約で「どの時点の整合か」「証跡は何か」を説明する必要がある

- アプリ整合性(DB、インデックス、トランザクション)まで含めて“正”を定義しないといけない

- 業務停止が難しく、RPO/RTOと現実コストの折り合いを付ける必要がある

この領域では、rsyncの知識だけでは不十分です。システム構成、運用、契約、監査、復旧優先順位まで含めて判断しなければなりません。

だから、読者が具体的な案件・契約・システム構成で悩んだとき、最短ルートになりやすいのは、株式会社情報工学研究所のような専門家に相談し、前提整理と回収方針を一緒に固めることです。

「また新しい相談先増やすの、正直しんどい」—そう感じるのは自然です。

でも、欠損回収は“判断を誤ると取り返しがつかない”性質があります。一般論で粘って時間を失うより、早い段階で状況を棚卸しし、壊さず回収できる手順に乗せる方が、結果的に運用負荷も説明コストも下がります。

相談導線:https://jouhou.main.jp/?page_id=26983

電話:0120-838-831

この後、付録として「現在のプログラム言語各種」で、ファイル生成・同期・検証を実装する際に起きがちな落とし穴(原子的更新、fsync、部分書き込み、ハッシュ、例外処理)を整理します。rsync運用を支える周辺実装の品質が、結局“欠損の疑い”の発生率を左右するためです。

付録:現在のプログラム言語各種で“欠損疑い”を生みにくくする注意点(原子的更新・fsync・検証)

ここは「rsync以前」の話です。同期対象ファイルの作り方や、検証の実装が雑だと、差分転送は簡単に前提を失います。特に重要なのは次の3点です。

- 原子的更新:生成中ファイルを直接本番名で書かず、完了後にリネームで切り替える

- 永続化の保証:必要なら flush / fsync(ファイルだけでなくディレクトリも)を意識する

- 検証可能性:ハッシュ、サイズ、件数、ログで“事実確認”できる材料を残す

C / C++

- 部分書き込み(writeが全量を書かない)を前提にリトライループを組む

- 原子的更新は「一時ファイルへ書く→fsync→rename」。必要に応じてディレクトリもfsync

- バッファリング(stdio)を使う場合は fflush と fsync の役割を分けて理解する

Go

- 原子的更新は「一時ファイル→Sync→Close→Rename」。同一ファイルシステム内のRenameが前提

- ファイルだけでなくディレクトリの同期(fsync相当)を検討する(要件次第)

- 巨大ファイル処理では、エラー伝播と途中状態(中断時の後始末)を明確にする

Python

- 書き込み後は flush と os.fsync を区別して使う(必要な要件のときだけfsync)

- 一時ファイル利用(tempfile等)→最後に os.replace(原子的置換)で切り替える

- ハッシュ計算はストリーム処理で(巨大ファイルを丸ごとメモリに載せない)

Java / JVM系(Kotlin含む)

- FileOutputStream/BufferedOutputStream のflushと、永続化(FileChannel.force)の違いを意識する

- 原子的更新は「一時ファイル→close→Files.move(ATOMIC_MOVE可能なら)」

- 例外時に一時ファイルが残る前提で、清掃方針(残す/消す)を運用に合わせる

JavaScript / Node.js

- fs.writeFile は内部で置換するわけではないため、原子的更新が必要なら一時ファイル→renameを明示する

- 非同期I/Oの失敗(例外/Promise拒否)を握りつぶすと、欠損や途中状態の温床になる

- ストリーム処理(createReadStream/createWriteStream)はerror/closeの取り扱いを厳密にする

Rust

- write_all を使って部分書き込みを吸収しつつ、sync_all/sync_data(要件次第)で永続化を意識する

- 一時ファイル→rename の原則を守り、失敗時に一時ファイルが残る設計に備える

- Resultの伝播を徹底し、途中で落ちたときに“壊れた出力”が本番にならないようにする

.NET(C# / F#)

- FileStream の Flush(true) 等、永続化の意味を理解して使う(要件があるときだけ)

- 原子的更新は一時ファイル→置換(プラットフォーム依存の差を考慮)

- 例外時の後始末(ファイルハンドル解放、部分ファイルの扱い)を明確にする

PHP

- file_put_contents の LOCK_EX は万能ではない。原子的更新が必要なら一時ファイル→renameを検討

- エラー抑制(@)で失敗を隠すと、欠損や途中ファイルを見逃す

- 巨大ファイル処理はメモリ制限とストリームI/Oを前提にする

Ruby

- 一時ファイル→renameの原則。例外時に一時ファイルが残る運用も想定する

- IOのflushと永続化(fsync相当)の必要性を要件で判断する

Shell(bash等)

- set -euo pipefail で失敗を早期に検知し、途中状態で“成功扱い”しない

- コマンドの終了コードとログを残す(rsyncは特に重要)

- 削除を伴う処理は dry-run や対象列挙で事前確認を必須にする

PowerShell

- $ErrorActionPreference や -ErrorAction Stop を活用し、失敗を“成功”として流さない

- ログ出力(Transcript等)で証跡を残し、差分や削除の事前確認を組み込む

付録の結論はシンプルです。

同期の事故は、rsync単体ではなく「ファイルの作り方」「失敗の扱い」「検証の仕組み」で発生率が大きく変わります。

そして、ここもまた一般論だけでは最適化しきれません。業務要件(停止可否、監査、契約、RPO/RTO)とシステム構成(NAS/RAID/クラウド/暗号化)を踏まえ、どこまで強い整合性を求めるかを設計する必要があります。

具体的な案件・契約・システム構成で悩んでいるなら、株式会社情報工学研究所への相談・依頼を検討してください。

相談導線:https://jouhou.main.jp/?page_id=26983 / 電話:0120-838-831

もくじ

- 第1章: 夜間のrsyncが赤くなる瞬間:誰も責められない「差分転送の落とし穴」

- 第2章: rsyncの差分アルゴリズムを分解する:ブロック/ローリングチェックサム/デルタの前提条件

- 第3章: 「失われたブロック」とは何か:partial transferが作る“穴あきファイル”の正体

- 第4章: ログは嘘をつかない:exit codeとメッセージから欠損の種類を見分ける

- 第5章: 原因は3層で起きる:ネットワーク/ストレージI/O/プロセス・メモリの切り分け

- 第6章: 事故を増やすオプション、守るオプション:--inplace/--partial/--append-verify/--checksum

- 第7章: 欠損ブロックの回収手順:最小の再送で「正しい」再同期をやり切る

- 第8章: ソースも怪しいときの二段構え:スナップショット/バックアップで“真値”を固定する

- 第9章: 再発防止は設計で決まる:atomic rename、検証フェーズ、再実行性、監視とリトライ

- 第10章: 帰結:rsyncは「速さ」ではなく「整合性の設計」まで含めて初めて運用になる

【注意】本記事は、rsyncの差分転送(delta transfer)中に発生しうる「部分的に転送された/整合しない状態」を、ログから冷静に切り分け、被害最小化(ダメージコントロール)しながら再同期(再送・再検証)で整合性を取り戻すための一般的な情報提供です。実際の最適解は、データの重要度・更新頻度・回線品質・ストレージ状態・スナップショット有無・暗号化/圧縮・運用制約で変わります。重要データが関わる場合は、判断を誤ると欠損や不整合が固定化して復旧難易度が上がることがあるため、個別案件として株式会社情報工学研究所のような専門事業者への相談をご検討ください。

第1章: 夜間のrsyncが赤くなる瞬間:誰も責められない「差分転送の落とし穴」

夜間バッチの最後に「rsync exited with…」が出て、監視が赤くなる。翌朝、関係者に説明するあなたの脳内はだいたいこんな感じになります。

「いや、ネットワークも落ちてない。ディスクも一見元気。なのに“差分”だけが一部おかしいって、いちばん説明しづらいやつ…」

ここで重要なのは、rsyncの“差分転送”は、速い代わりに「前提条件」が多いという事実です。前提が崩れると、失敗の仕方が「全部失敗」ではなく「一部だけ欠ける」形になり、現場をいちばん苦しめます。

そして、現場がしんどいのは「エラーが出た」ことより、次の問いに即答できないことです。

欠けた(失われた)ブロックはどこか?(どのファイル・どの範囲が危ないか)

それは“再実行”で直るのか?(最小の再送で収束するのか、全面やり直しが必要か)

そもそもソースが真値か?(同期元も更新され続けていて、追いかけているだけではないか)

このシリーズのゴールは、ここを腹落ちさせることです。つまり「rsyncの差分転送が“失われたブロック”を生む条件」を理解し、ログから状態を確定→再同期で整合性を取り戻す→再発防止の設計に落とす、この一本道を作ります。

なお本記事では、闇雲にオプションを盛る話はしません。速くする話も後回しです。最優先は、障害時に“収束”させられる運用です。

第2章: rsyncの差分アルゴリズムを分解する:ブロック/ローリングチェックサム/デルタの前提条件

差分転送の理解は、障害時の「切り分け」を速くします。rsyncはざっくり言うと、宛先(受信側)が持っている内容を“ブロック単位で要約(チェックサム)”し、送信側がそれに合う部分を探して、合わない分だけ送る仕組みです。

ここで出てくるチェックサムが2種類あります。

弱い(高速な)ローリングチェックサム:ブロックを1バイトずつずらして再計算できるように設計されたもの(Adler-32に着想を得た方式)

強い(衝突しにくい)チェックサム:一致候補をより確実に判定するための追加チェック

この「2段構え」は強力ですが、前提条件があります。現場で事故が起きるのは、たいていこの前提が崩れたときです。

前提条件A:比較対象は“同一時点の内容”であること

rsyncは通常、ファイルのサイズや更新時刻(mtime)などのメタ情報も使って「そもそも差分計算が必要か」を判断します。転送中にソース側が書き換わり続けると、比較の土台が揺れます。その結果、差分計算が成立しづらくなったり、検証で弾かれて再送が増えたりします。

前提条件B:宛先の既存データが“安全に扱われる”こと

rsyncはデフォルトでは、宛先に直接上書きせず、一時ファイルを作って最後にリネームすることで「中途半端なファイルが露出しにくい」動作になります。しかし、--inplace などを使うと、この性質が変わります。中断やエラーの瞬間に、宛先が“穴あき”になり得るのはこの系統です。

前提条件C:チェックと検証のコストを許容できること

整合性を上げようとすると、検証コストは増えます。たとえば --checksum(-c)は、サイズ/mtimeではなく内容のチェックサム比較を重視しますが、大規模データではCPU/IOコストが上がります。つまり「速さ」と「確かさ」は、運用要件の中でバランスを取る必要があります。

ここまでを踏まえると、障害時に見るべきポイントが見えてきます。次章では「失われたブロック」と呼びたくなる状態が、具体的に何を指しているのかを整理します。

第3章: 「失われたブロック」とは何か:partial transferが作る“穴あきファイル”の正体

「失われたブロック回収」と言うと、何か特別な復元技術のように聞こえますが、rsyncの文脈ではまず現実を分けて考える必要があります。

ケース1:単に“転送が途中で終わった”だけ(再実行・再送で収束する可能性が高い)

ケース2:宛先ファイルが不整合な状態で残っている(オプション次第で起きやすい)

ケース3:ソース自体が更新・削除され、真値が不明(“回収”というより、真値の確定が先)

特にややこしいのがケース2です。なぜなら、「宛先にある“途中状態”が次回の差分計算の前提になる」からです。前提が壊れたまま差分を当てようとすると、再実行しても収束せず、同じファイルを何度も送る、あるいは検証で弾かれる、といった現象が起きます。

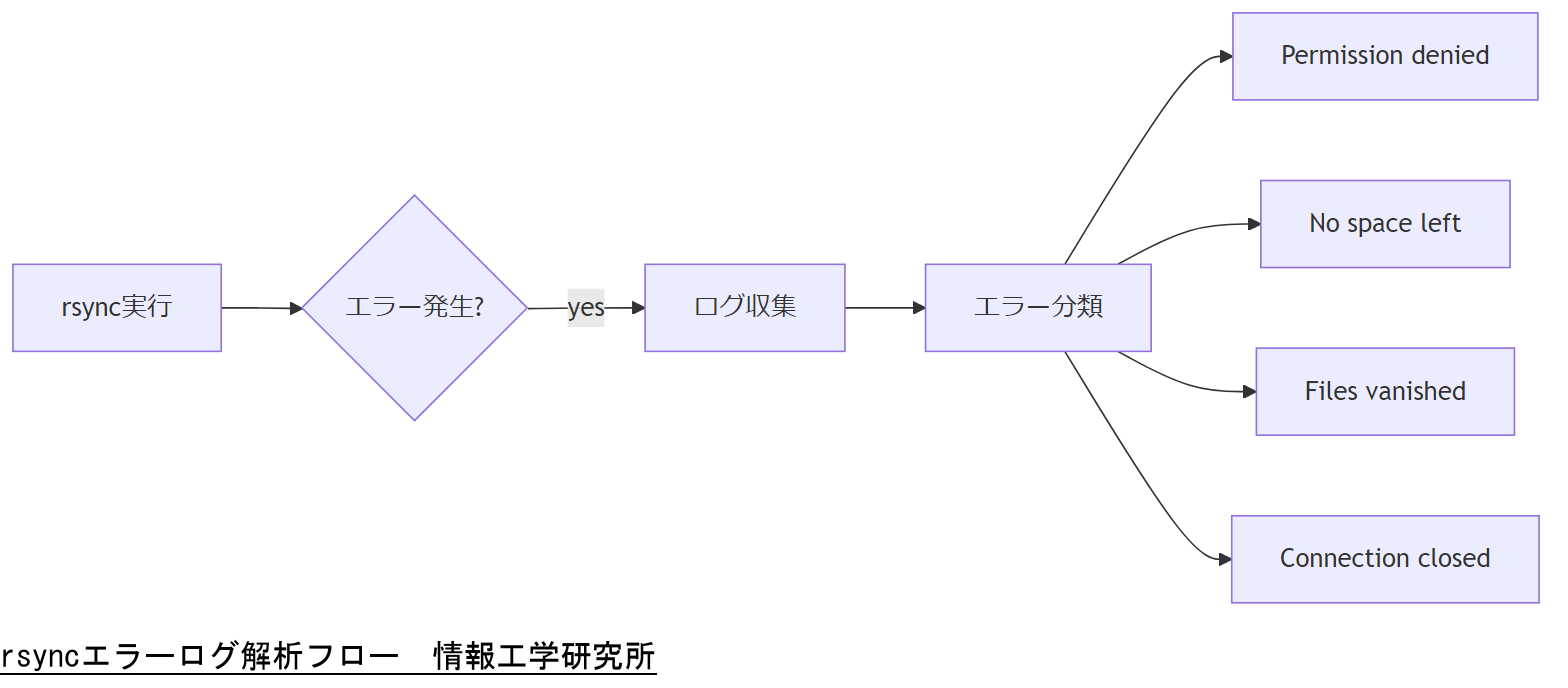

partial transferが意味するもの

rsyncの終了コードやメッセージには「partial transfer(部分的な転送)」が出ます。これは“何かが一部うまくいかなかった”という広い意味で、原因は権限・ACL・リンク切れ・I/Oエラー・転送中の消失など多岐にわたります。重要なのは、この時点で「どのファイルが」「どの状態で残ったか」を確認することです。

「穴あき」が起こりやすい代表例:--inplace と中断

--inplace は宛先ファイルを直接更新します。大きなファイルを扱うとき、二重に容量を使わない利点がある一方で、エラーや中断の瞬間に、宛先ファイルが“途中まで新しく、途中から古い(または欠けた)”という状態で残り得ます。これは運用上、最も説明が難しい事故のひとつです。

「回収」として現実的にできること

rsyncで「失われたブロック」を現実的に回収するとは、多くの場合つぎのどれかです。

再送で足りない差分を埋める(宛先の途中状態を“安全に使える”前提がある)

一度宛先の不整合を捨て、再転送の土台を作り直す(該当ファイルだけ退避・削除して再実行)

真値をスナップショット等で固定し、固定点から同期する(ソース側が動いているなら最優先)

ここでの“賢さ”は、全面やり直しに逃げる前に、どのパターンかをログから確定することです。次章では、そのために見るべきログ(exit code、代表メッセージ、itemize changes)を整理します。

第4章: ログは嘘をつかない:exit codeとメッセージから欠損の種類を見分ける

現場の“心の会話”を一度そのまま置きます。

「ログ、長い。しかも毎回ちょっと違う。結局、何を見ればいいの…?」

この疑いは健全です。rsyncのログは情報量が多く、見方を決めないと疲弊します。ここでは、最小セットの観測点を固定します。

まず見るのは終了コード:23 と 24 は“分岐点”

スクリプト運用で最初に拾えるのが終了コードです。特に頻出なのが次の2つです。

| 終了コード | 意味(要約) | 現場の解釈(次の一手) |

|---|---|---|

| 23 | 部分的転送(何らかのエラー) | 権限/ACL/I/O/パス/転送中断など。対象ファイル特定→原因層(FS/回線/プロセス)に落とす |

| 24 | 転送中にソースが消えた(vanished) | ソースの更新・削除が走っている可能性。スナップショット等で“真値”固定を検討 |

ポイントは、23/24は「どっちにせよ失敗」ではなく、運用の分岐点だということです。24が出ているなら、再実行で追いつくこともありますが、ソースが動き続ける構成だと“いつまでも追いかけるだけ”になりがちです。まず真値を固定できるかを考えたほうが、結果的に早く収束します。

メッセージで“欠損の種類”を言語化する

ログのテキストは、次の3カテゴリに分類すると読みやすくなります。

アクセス系:Permission denied / chown failed / ACL関連 → 権限・所有者・ACL・ファイル属性の差

消失系:vanished file / No such file or directory → 転送中の更新・削除・ローテーション

整合性系:checksum mismatch / file truncated / failed verification → 途中状態・I/O不安定・オプション相性の疑い

この分類ができると、関係者への説明も変わります。「rsyncが壊れた」ではなく、“どの層の問題として扱うか”が言えるようになります。

再現性のある観測ログを取る:最低限のオプション

次に、原因究明に役立つログを安定して残します。ここでは“闇雲に冗長化”せず、まずこれだけに絞ります。

rsync -a --itemize-changes --stats --human-readable \ --out-format="%t %o %i %B %n%L" \ SRC/ DEST/--itemize-changes は「何がどう変わったか」を記号で出します。転送が途中で止まった場合、どこまで処理が進んだかの当たりが付けやすくなります。--out-format はログの粒度を揃えるための工夫で、後からgrepや集計がしやすくなります。

そして、ここまでやっても「整合性系」の疑いが強いなら、次章以降で、ネットワーク/ストレージ/プロセス資源の3層に分けて“切り分けの地図”を作ります。闇雲な再実行で疲弊する前に、手順として収束させましょう。

第5章: 原因は3層で起きる:ネットワーク/ストレージI/O/プロセス・メモリの切り分け

ここから先は「疑い」を具体的な観測に落とします。現場の本音はこうですよね。

「ログは分かった。でも、結局どこが悪いの?ネットワーク?ディスク?それともrsyncの実行環境?」

その問いは正しいです。rsyncの差分転送の失敗は、ほとんどが次の3層のどこか(または複合)で起きています。まずは“地図”を固定します。

| 層 | 典型症状(rsync側) | まず取る観測 | 初動(被害最小化) |

|---|---|---|---|

| ネットワーク | ssh切断、timeout、transferが極端に遅い/ばらつく、再試行で直る | 回線品質(RTT/損失)、sshログ、NICエラー、MTU/PMTU | 再実行前に“対象範囲”を絞る、帯域制御、再試行設計 |

| ストレージI/O | read/write error、file truncated、検証失敗が繰り返す | dmesg、SMART/RAIDログ、iostat、FSエラー | まず“真値”保全(スナップショット/イメージ)、書込みを抑える |

| プロセス/メモリ | OOM、プロセス強制終了、巨大ファイルで不安定、並列実行で悪化 | syslog、OOM killer、ulimit、CPU/メモリ使用量 | 同時実行数を下げる、nice/ionice、バッチ設計の見直し |

ネットワーク層:転送の“途中”が壊れると、差分は一気に難しくなる

rsyncをsshトンネルで使う構成は多いですが、回線が揺れると「途中まで送ったデータ」が宛先にどう残ったかが問題になります。rsync自身は再実行に強い設計ですが、運用側がオプションでその強みを削っていることがあるので注意です。

ネットワークの疑いが強いときの着眼点は2つです。

症状が“散発”か“再現”か:散発なら回線品質や瞬断、再現なら設定(MTU/暗号/CPU飽和)を疑う

失敗が“同じファイルに偏る”か:偏るなら巨大ファイルや特定パスのI/O、偏らないなら回線/プロセス強制終了の可能性

“回収”の観点では、回線が怪しいときほど、次章で触れる --partial や --append-verify の扱いを丁寧にする必要があります。闇雲に再開させると、説明不能な不整合を作りやすくなるからです。

ストレージI/O層:いちばんやってはいけないのは「上書きで症状を隠す」

rsyncの整合性エラーが繰り返され、同じファイルで失敗が続くときは、ストレージ層を疑います。ここで現場が陥りがちな罠があります。

「再実行すれば直るはず」と思って、何度も上書き転送を繰り返すことです。

もしソース側・宛先側のどちらかでI/Oが不安定なら、繰り返し書込みは状態を悪化させる可能性があります。被害最小化(ダメージコントロール)の観点では、まずやるべきは“復旧”ではなく“保全”です。

ソースが怪しいなら、スナップショットやイメージで真値の固定

宛先が怪しいなら、宛先の不整合を“使わない”方向(該当ファイル隔離など)

これをやらずに再実行を続けると、「本当はいつ壊れたのか」「どこが真値か」が分からなくなり、後工程の説明コストが爆増します。

プロセス/メモリ層:rsync自体が悪いのではなく“走らせ方”が悪いこともある

大量のジョブを並列に回したり、同一ホストでバックアップ・圧縮・ログローテなどが同時に走っていたりすると、rsyncが巻き添えで落ちます。ここでの“心の会話”はだいたいこうです。

「え、これrsyncのせいじゃなくて、うちのバッチ設計のせい…?」

そう感じるのは自然です。でも責める話ではなく、設計の話です。rsyncはI/OもCPUも食います。さらにssh暗号化が絡むとCPU負荷が上がります。結果としてOOMやタイムアウトが起きれば、差分転送は途中で切れ、不整合の土壌ができます。

この層の対策は“正しさ”より“収束性”です。具体的には次のような設計に寄せます。

同時実行数を下げ、完走率を上げる(結果として総時間が短くなることが多い)

優先度制御(nice/ionice)で、他の重要処理を守る

監視は「失敗したら即アラート」より、「失敗したときに何を自動でするか」まで設計する

次章からは、いよいよ“オプションが事故を増やす/守る”の話に入ります。ここまでの切り分け地図を前提に読むと、オプション選定が「思想」ではなく「要件」になるはずです。

第6章: 事故を増やすオプション、守るオプション:--inplace/--partial/--append-verify/--checksum

rsync運用で最も揉めるのがここです。

「このオプション、前は速くなったんだよね」

「でも障害が起きたとき、説明不能になったのもその頃からだよね…」

この感情の揺れは自然です。だからこそ、オプションは“好み”ではなく、障害時の収束性(クールダウンできる設計)で判断します。

--inplace:容量節約の代償として“途中状態”が露出しやすい

--inplace は宛先を直接更新します。大容量ファイルで一時領域を確保しづらい環境では魅力的ですが、途中で中断した場合に、宛先ファイルが不整合なまま残りやすくなります。差分転送の文脈で「失われたブロック」が起きたように見える原因として、これが関与するケースは少なくありません。

向いている状況:宛先の一時領域が厳しい、更新が“追記中心”で、かつ別の整合性担保がある

危ない状況:途中中断が起きやすい(回線が揺れる/ジョブが落ちる)、宛先の途中状態が次工程に露出する

もし --inplace を使うなら、障害時に“どのファイルを隔離するか”まで運用に組み込むべきです。そうでないと、再実行で収束しない泥沼に入りやすくなります。

--partial:再開しやすいが、“放置”すると事故に変わる

--partial は途中まで転送したデータを残し、次回再開に活かします。回線が不安定な環境では効果がありますが、問題は「途中ファイルがいつまで残るか」です。

途中ファイルが残った状態で、別の処理(アーカイブ化、別同期、読み取り)が走ると、未完了データが“本物”として扱われる可能性があります。つまり --partial は「再開」ではなく「未完了物を安全に隔離する仕組み」とセットでないと危険です。

運用上は、--partial-dir を使って、途中データを専用ディレクトリに隔離し、完了時にだけ本来の場所に反映する設計が王道です。

--append-verify:追記系ワークロードで“最小の再送”を狙う

--append-verify は、宛先に既にある部分を活かしつつ、整合性も検証しながら追記で埋める方向の挙動になります。巨大ログや追記型ファイルで「最後だけ欠けた」を回収したいときに有効なことがあります。

ただし、何でも追記で解決するわけではありません。途中の欠損や、ソースが書き換わるタイプのファイルには向きません。ここでも判断基準は“収束性”です。

--checksum(-c):確かさは上がるが、コストと副作用を理解して使う

--checksum は内容で比較するため、mtimeが信用できない環境では助けになります。一方で、全ファイルを読んでチェックサムを計算するので、CPU/IOコストが大きくなり、結果としてジョブ時間が伸びたり、I/O競合で別障害を誘発したりするリスクがあります。

“確かさ”は大事ですが、確かさのために運用が壊れたら本末転倒です。実務では次のように使い分けます。

| 目的 | 推奨の考え方 | 注意点 |

|---|---|---|

| 平常運用の高速同期 | mtime/size中心、完了率を上げる設計 | “完了しているはず”の信頼性は別途担保(atomic/検証フェーズ) |

| 障害後の整合性回復 | 範囲を絞って検証(対象ディレクトリ/ファイル) | 全体に一律適用するとコストで別障害を招く |

ここまでが「オプションで事故を増やさない」ための土台です。次の章では、実際に“欠損ブロックを回収する”ための手順を、最小の再送で収束させる形で整理します。

第7章: 欠損ブロックの回収手順:最小の再送で「正しい」再同期をやり切る

ここからが本題の「回収」です。ただし、rsyncの文脈で“欠損ブロック回収”を現実的に言い換えると、「欠損(または不整合)のあるファイルを特定し、真値に対して、必要最小限の再転送で整合性を回復する」という作業になります。

現場の本音はこうなりがちです。

「全部やり直したら確実だけど、時間がない。かといって“どれが欠けたか”分からない…」

この状態で大事なのは、焦って“全部に効きそうなオプション”を付け足さないことです。順番を決めれば、最小の再送で収束させられます。

手順0:まず“動いているもの”を止める(真値を動かさない)

ソース側のデータが更新され続ける状態で回収作業をすると、「何が欠損なのか」と「更新された差分」が混ざります。理想は、アプリケーション停止やスナップショットで真値を固定することです(スナップショットの話は次章)。

難しい場合でも、少なくとも「回収対象ディレクトリ」に対して更新を止める、ローテーションを一時停止する、などの運用的クールダウンを入れます。ここでの目的は“正しさの固定点”を作ることです。

手順1:対象ファイルを絞る(ログ→差分一覧→候補リスト)

回収の成否は、対象範囲を絞れるかで決まります。まずは前回実行ログから、エラーが出たファイルや、転送途中で止まった可能性があるパスを抜き出します。

ログが十分でない場合は、次のように「差分一覧だけ」を作り、候補リストを作ります(実データは送らない)。

rsync -a --dry-run --itemize-changes --stats SRC/ DEST/これで「そもそも一致していないもの(追加・更新されるもの)」の一覧が取れます。回収は、この一覧を起点に進めると事故りにくくなります。

手順2:宛先に“途中状態”が残っていないか確認する

ここで重要なのが、前回の運用で --inplace や --partial をどう扱っていたかです。途中状態が残ると、次回の差分計算がその途中状態を前提にしてしまい、収束しにくくなります。

| 状況 | 起きがちな問題 | 回収の基本方針 |

|---|---|---|

| デフォルト運用(テンポラリ→リネーム) | 未完了物が表に出にくい | 候補だけ再実行で収束しやすい |

| --partial で途中ファイルが残る | 未完了ファイルが誤って利用される可能性 | partialを隔離(--partial-dir推奨)し、回収時は隔離物の扱いを決める |

| --inplace で宛先が直接更新 | “途中まで新しい”不整合が残り得る | 該当ファイルを退避して作り直す(再転送の土台を作る) |

特に --inplace の可能性がある場合、回収対象ファイルをいったん退避(別名リネーム)し、宛先を“空の土台”に戻してから再転送する方が、結果として速く収束します。中途半端な状態を抱えたまま最小差分を狙うのは、説明不能な不整合を増やしがちです。

手順3:最小再送で埋める(ただし“条件付き”)

欠損が「最後の追記分だけ」など追記型ファイルであることが確実な場合は、検証付き追記で最小再送を狙えることがあります。典型はログや追記型のアーカイブです。

rsync -a --append-verify SRC/ DEST/一方、追記型でない(途中のブロックが変わる、再圧縮される、並びが変わる)ファイルは、追記での回収が向きません。その場合は、対象ファイル単位で再転送して整合性を取り戻します。

重要なのは「ディレクトリ全体を盲目的に再送」ではなく、候補リストに絞って再送することです。

rsync -a --files-from=changed_files.txt SRC/ DEST/(changed_files.txt は、dry-runの結果やログ抽出から作成した相対パス一覧を想定)

手順4:検証を“回収対象”に限定して行う

整合性を上げたい気持ちは分かりますが、全体に --checksum をかけると、コストが跳ね上がり別の不安定要因になり得ます。回収局面では、次のように対象を絞ります。

回収対象ディレクトリだけに限定して

--checksumを実行するまたは回収対象ファイルだけを、外部のハッシュ(例:sha256)で照合する

例として、回収対象だけを rsync のチェックサム比較で確定させるなら、次のようにディレクトリを限定します。

rsync -a -c --dry-run SRC/subdir/ DEST/subdir/“dry-run + checksum” で差分が残っていないことを確認してから、本番転送をかけると、説明もしやすくなります。

手順5:再発防止のために「回収できた理由」を記録する

回収が成功したときほど、「なぜ収束したか」を言語化して残します。たとえば次のような形です。

exit code 24 が出ていたため、ソースが動いていた → 次回はスナップショット固定してから同期する

--inplace を使っており宛先が不整合になった可能性 → 重要領域では使わない/使うなら隔離運用を入れる

回線瞬断で散発 → ssh keepalive、リトライ設計、partial-dir で途中物を隔離

“回収”は一度きりの職人芸ではなく、次回に向けて「収束させる設計」に変換して初めて価値になります。次章では、そもそもソースが怪しいときにどう真値を固定するかを扱います。

第8章: ソースも怪しいときの二段構え:スナップショット/バックアップで“真値”を固定する

差分転送の事故が泥沼化する最大の理由は、「真値が動いている」ことです。現場の心の声はたいていこうです。

「同期元が更新され続けてるのは分かる。でも止められない。止めたらサービスが止まる…」

この状況で、rsyncだけで解決しようとすると、回収が“追いかけっこ”になりやすいです。だから二段構えが必要になります。結論から言うと、(1)真値を固定する仕組み(スナップショット等)と、(2)固定点から同期する運用をセットで作ります。

スナップショットが提供するのは「時点固定」

スナップショットは、特定時点のファイルシステム状態を固定し、その固定点を読み出し可能にする仕組みです。環境によって方式はさまざまです。

LVMスナップショット

ZFS/Btrfs のスナップショット

ストレージアレイやNASのスナップショット

クラウドのボリュームスナップショット

ここで注意したいのは、スナップショットが保証するのは「その時点のブロック状態」であり、アプリケーション整合性(DBのトランザクション整合など)まで自動で保証するとは限らないことです。つまり、“時点固定”と“整合性”は別問題です。

止められないなら「止めなくても整合が取れる形」に寄せる

たとえばDBやキューなどが絡む場合、アプリケーション整合性を確保するには、次のような設計が必要です。

短時間だけ書込みを止める(メンテ窓の最小化)

アプリ側のスナップショット機能(ダンプ、チェックポイント)と併用する

ログの追記型(WAL等)を前提に、スナップショット+ログで整合点へ戻す

rsyncの回収に関して言えば、「ソースが動いていてもいい」のではなく、回収作業の間だけでも“比較対象が固定”されていることが必要です。固定点がないまま回収を続けると、欠損の話と更新差分の話が混ざり、説明不能になりやすいです。

固定点(スナップショット)からrsyncする運用に変える

実務で効果が大きいのは、同期元を「ライブ領域」ではなく「スナップショット領域」にすることです。イメージとしてはこうです。

ソースでスナップショット作成(短時間)

スナップショットを読み取り専用でマウント(または参照可能にする)

rsyncはスナップショット側をSRCとして実行

完了後、スナップショットを破棄(または世代管理)

これにより、rsyncが見ている世界は実行中に変わらないため、差分転送の前提が保たれ、障害時も「どの時点のデータを同期しようとしていたか」を明確に言えます。これは、障害報告や監査対応でも強いです。

スナップショットが無い/使えない場合の代替:バックアップで固定点を作る

スナップショットが使えない環境では、バックアップ自体を固定点として扱う発想が必要です。具体的には、バックアップ領域(例:バックアップサーバ、オブジェクトストレージ)に「その日のセット」を作り、そこから下流へ配布します。

ここで重要なのは、バックアップを「置いた」だけで終わらせず、次の性質を持たせることです。

世代管理:何時点のものか追える

検証:ハッシュや検査で整合性が確認できる

再実行性:途中で失敗しても再開でき、最終的に収束する

rsyncの“欠損ブロック回収”を安定させたいなら、最終的には「同期」というより「配布パイプラインの設計」になります。次章では、その設計要素(atomic rename、検証フェーズ、監視とリトライ)を、再発防止の形に落としていきます。

第9章: 再発防止は設計で決まる:atomic rename、検証フェーズ、再実行性、監視とリトライ

回収が一度うまくいっても、同じ構成・同じ運用のままだと、同じ夜がまた来ます。ここで現場の独り言が出ます。

「結局、運用の“クセ”が原因なら、また同じこと起きるよね…」

その通りです。rsync自体は成熟したツールですが、“同期の設計”が弱いと、障害時に収束させられない。第9章は、次に赤くなったときでも落ち着いて対処できるように、設計要素を部品として整理します。

1) 未完了物を露出させない:一時領域とリネーム(atomic-ish)

基本方針はシンプルです。「完了した成果物だけが正規パスに現れる」ようにする。これができると、途中で失敗しても“壊れた途中物”を利用側が掴みにくくなります。

重要領域では、安易に

--inplaceを使わない(直接更新の途中状態が残り得る)途中ファイルが必要なら

--partial-dirで隔離し、正規パスに未完了物が出ない形にする

運用のイメージは「ステージング → 検証 → 切替」です。rsyncのオプションだけで完璧な原子性を保証するというより、ディレクトリ設計で“切替点”を作るほうが現実的です。

2) 検証フェーズを分ける:同期と検証を混ぜない

現場が疲弊する典型は、同期と検証を同じ1コマンドに押し込み、失敗したときに「どっちで失敗したのか」が曖昧になるケースです。

おすすめは、少なくとも運用として次の2フェーズに分けることです。

同期フェーズ:まず“運ぶ”。完走率を優先して収束させる

検証フェーズ:運んだ結果が“正しい”ことを別工程で確認する(対象を絞る)

検証は、全体に一律で重い比較をかけるよりも、次のように段階化すると現場に優しいです。

まずは件数・サイズ・更新時刻などのメタ観測(異常検知)

疑わしい範囲だけ、rsyncの

--dry-runで差分確認さらに必要なら、その範囲だけ内容ハッシュ(sha256等)で照合

これで「同期は完了したが、検証で差分が残った」という状態を明確にでき、説明の粒度が上がります。

3) 再実行性(idempotency)を作る:失敗しても“同じ手順で”収束する

障害対応で大事なのは“必勝の手順”より、同じ手順を繰り返しても壊れないことです。再実行性を損ねる典型は次の2つです。

削除系オプションの不用意な併用:

--deleteは強力ですが、前提(真値固定・対象範囲確定)が崩れていると事故が拡大します途中状態の混在:

--inplaceや未隔離の partial が残り、次回の前提が壊れる

削除を伴う運用は、必ず --dry-run で差分を見てから実行し、さらに「削除は遅延させる」「削除対象を別リストでレビューできる」など、ワンクッション入れると事故が減ります。

4) 同時実行とロック:二重起動が“欠損”を作ることがある

見落とされがちですが、rsyncが赤くなる原因として「同じ同期が二重起動して競合した」ケースがあります。バッチの再実行、監視の自動リトライ、手動実行が重なると起きます。

対策は単純で、ロック(排他)を入れることです。たとえばLinuxなら flock を使って二重起動を抑止し、ログに「二重起動だった」を残せるようにします。これだけで“原因不明”が一気に減ります。

5) 監視とリトライは「アラート」ではなく「収束設計」

エンジニアの現場感として、アラートが増えるほど信用が落ちます。だから監視は「失敗を通知する」だけでなく、次の情報が取れるように設計します。

exit code(23/24など)と、影響ファイル数の要約

再実行で収束したかどうか(自動リトライの結果)

収束しない場合に“回収手順へ移行する条件”

ここまで整えると、夜間対応は「場を整える」方向に変わります。次章は、その帰結として、rsyncを“速い同期ツール”から“整合性の運用”へ位置付け直します。

第10章: 帰結:rsyncは「速さ」ではなく「整合性の設計」まで含めて初めて運用になる

ここまでの話を、現場の言葉でまとめます。

「rsyncって結局、“速い”のが売りじゃなくて、“失敗しても収束させられる設計”を作れるかが勝負なんだな」

この腹落ちが、今回のゴールです。差分転送は強力ですが、前提が崩れると“部分的な不整合”という最も扱いづらい形で表に出ます。だから、技術としてのrsync理解(ブロック・チェックサム・オプション)と、運用設計(真値固定・隔離・検証・再実行性)を一本の線につなげる必要がありました。

導入前後の「感情の変化」を、設計に落とす

導入前はこうなりがちです。

「また新しい運用が増えるだけじゃないの?」

でも、設計が当たると、現場の会話が変わります。

「あれ、失敗しても“自動で再実行して収束した”ってログが残ってる」

「朝イチの説明が“原因不明”じゃなくなった」

「障害のときにやることが、手順として決まってる」

ここまで来ると、rsyncのエラー解析は“火消し”ではなく、ノイズカットして淡々と収束させる運用になります。

一般論の限界:環境ごとに最適解が変わる

一方で、ここまで書いた内容はあくまで一般論です。実際の最適解は、次の条件で大きく変わります。

同期対象が、追記型か/上書き型か(ログ、DBダンプ、VMイメージ、オブジェクトなど)

真値固定が可能か(停止できるか、スナップショットがあるか)

回線品質・帯域・レイテンシ、暗号化コスト

ストレージが単体か、RAID/NAS/分散FSか

削除(--delete)を許容できる運用か(監査・保全・誤削除リスク)

そして、差分転送の“欠損ブロック回収”が難しいのは、技術が難しいからというより、要件(止められない、期限がある、説明責任がある)が厳しいからです。だからこそ、具体的な案件・契約・システム構成で悩んだときは、株式会社情報工学研究所のような専門家に相談して、最短で収束する設計に落とし込むのが現実的です。

「いまの運用に、どこまで手を入れるべきか」

「止められない前提で、真値固定をどう作るか」

「回収手順を、チームで回せる形にするにはどうするか」

このあたりは、机上の正しさだけでは決まりません。現場の制約を前提に、被害最小化(ダメージコントロール)できる運用へ一緒に落としていくのが最短です。

付録: 現在のプログラム言語各種でrsync運用を自動化する際の注意点

ここからは「実装の落とし穴」です。rsync自体の理解があっても、呼び出し側(スクリプト/アプリ)の作りで、回収が難しくなることがあります。特に大規模運用では、言語ごとの“癖”が事故の温床になりがちです。

Shell(bash/sh)

クォート不足でパスが壊れる:スペースや記号を含むパス、ワイルドカード展開で意図しない対象が同期される

パイプの終了コードが失われる:

tee等でログを流すと、rsyncの終了コードを取り損ねることがある(set -o pipefail等の設計が必要)二重起動・多重起動:cron再実行や手動実行が重なる。ロック(

flock)を前提にする

Python

subprocessの使い方:シェル経由で文字列実行するとクォート事故が増える。引数配列で実行し、標準出力・標準エラー・終了コードを確実に回収する

タイムアウトと中断時の扱い:タイムアウトでプロセスを止めたとき、途中ファイルが残る前提で設計(partial-dir隔離など)が必要

ログの構造化:後で切り分けるなら、実行条件(SRC/DEST/オプション/対象範囲)をJSON等で残すと回収が速い

Go

コンテキストキャンセルの副作用:contextで中断すると“途中状態”が残る。中断→回収手順の移行条件を明確にする

並列実行の設計:goroutineで簡単に並列化できるが、I/O競合で失敗率が上がることがある。完走率重視の制御が必要

Node.js

child_processの標準出力バッファ:大量ログで詰まる設計を避ける(streamで捌く、ログ量を調整する)

例外処理で終了コードを落とす:失敗理由(23/24等)を握りつぶすと、回収手順に入れない

Java / Kotlin

プロセス管理の複雑さ:stdout/stderrを読み切らないとデッドロックする実装がある。ログ回収は設計として必須

文字コード・パス:サーバのロケールやファイル名の扱いで差が出る。ログと対象パスはUTF-8前提に寄せる

Rust

安全側に倒しすぎて“便利な危険”を見逃す:実装は堅牢でも、運用設計(真値固定、隔離、検証、ロック)が無いと回収は難しい

エラー型の設計:rsyncの終了コードとログ分類(アクセス系/消失系/整合性系)を構造化しておくと現場で強い

PowerShell(Windows)

パスの扱い:バックスラッシュやUNC、権限周りがLinuxと違う。WSL/rsync利用時は境界が増える

実行ポリシー・権限:スケジューラ実行で権限が変わると、Permission系の失敗が出やすい

共通の結論:言語より先に「収束設計」

どの言語でも、最終的に効くのは同じです。

真値固定(止める/スナップショット/バックアップ)

未完了物の隔離(partial-dir、ステージング)

検証フェーズの分離(対象を絞る)

再実行性(同じ手順で収束する)

ロック(多重起動を潰す)

もしここが自社だけでは設計しきれない、または「止められない」「期限が厳しい」「説明責任が重い」といった条件がある場合は、一般論だけで決めるのは危険です。株式会社情報工学研究所では、現場制約(契約・構成・運用)を前提に、差分同期が“きちんと収束する”設計と回収手順まで含めて整理できます。具体条件があるほど最適解は変わるため、個別案件として相談をご検討ください。

目次

- rsyncとは何か:基本機能と差分転送の仕組み

- エラーログの読み方:代表的な出力例と解析ポイント

- ブロック損失の発生原因:ネットワーク/ファイルシステム観点

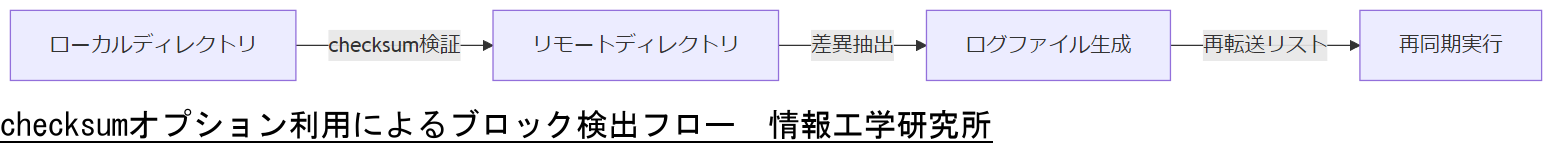

- 失われたブロックの検出方法:–checksumオプション活用術

- ブロック回収コマンド実践:–partial-dir+再同期手順

- 大量データ転送時のパフォーマンスチューニング

- 運用自動化と監視:cron+監視ツール連携例

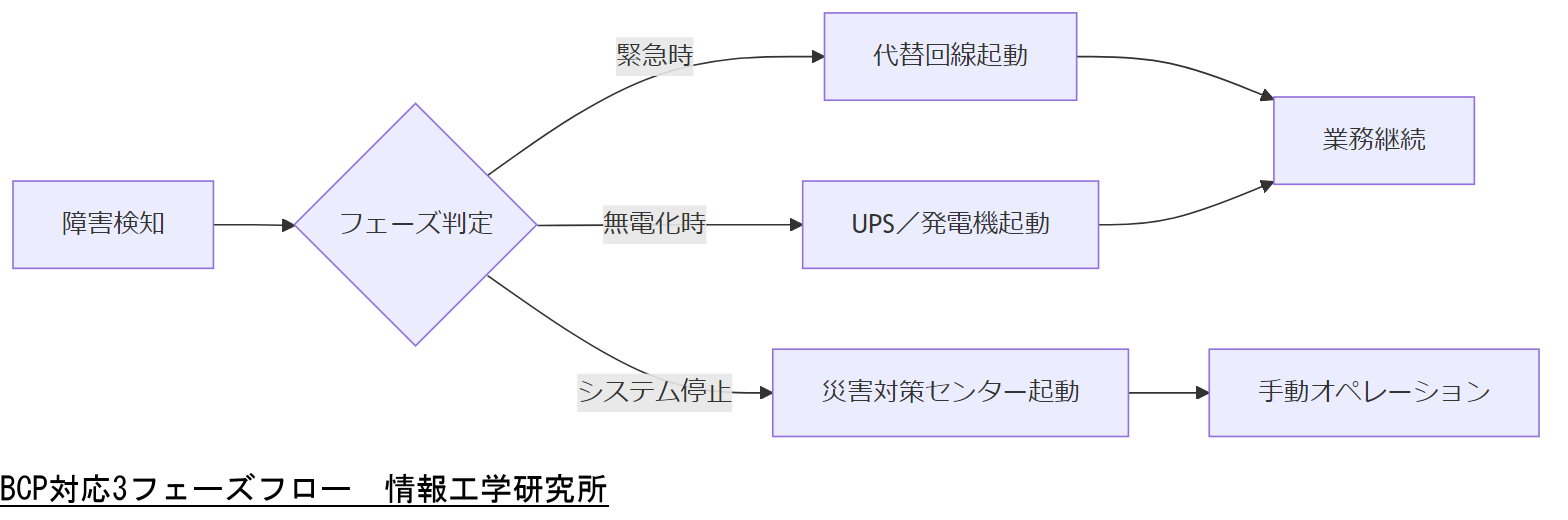

- トラブル時のBCP対応:緊急時・無電化時・システム停止時

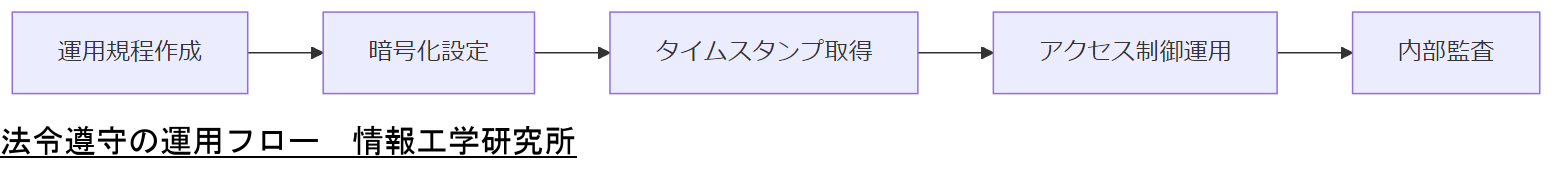

- コンプライアンス遵守:法令・ガイドライン整理

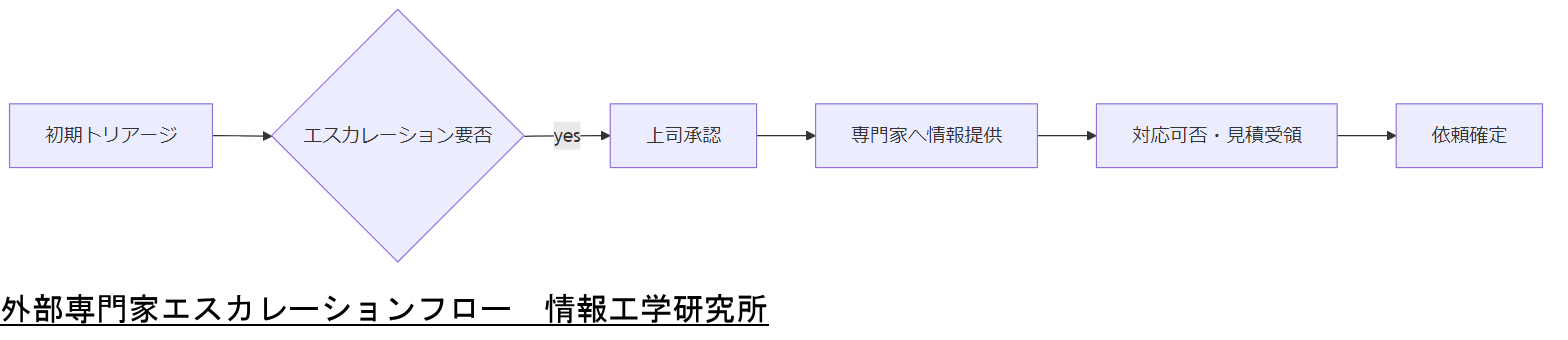

- 外部専門家エスカレーションフロー

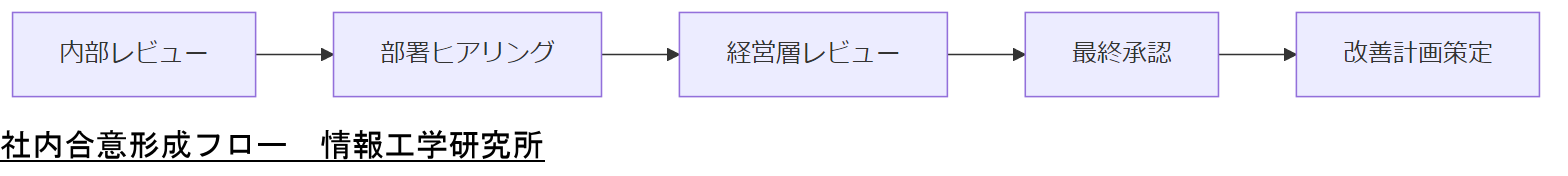

- 御社社内共有・コンセンサス

- まとめと今後の運用改善提案

解決できること・想定課題

- 差分同期中に発生するrsyncの「ブロック欠落」原因を徹底解析し、再転送手順を具体的に示します。

- エラーログから見落としやすい設定ミスを即発見し、ログ解析コマンドとポイントをわかりやすく解説します。

- 大規模環境におけるバックアップ運用のBCP策定と、緊急時のオペレーションフローを網羅的に提案します。

rsyncとは何か:基本機能と差分転送の仕組み

rsyncは、ローカルとリモート間で効率的にファイルを同期するためのコマンドラインツールです。初回同期時には完全コピーを行い、以降は「差分転送」方式で更新部分のみを転送するため、ネットワーク帯域と時間を大幅に節約できます。

差分転送では、まずローカルとリモートのファイルを比較し、タイムスタンプとサイズの差異を検出します。デフォルトではこれらを基準に更新ファイルを抽出し、転送を行います。rsyncの主要オプションを組み合わせることで、属性保持やパーミッションの維持も可能です。

表:rsync基本オプション比較| オプション | 説明 |

|---|---|

| -a | アーカイブモード(再帰的コピー+属性保持) |

| -v | 詳細表示モード |

| –delete | 同期元に存在しないファイルを削除 |

概要解説

この章ではrsyncの基本的な動作原理を解説しました。差分転送では、初回同期後は更新ブロックだけを転送するため効率が高い反面、設定ミスや属性の未保持があると予期せぬ欠落が発生しやすい点に注意が必要です。本章のポイントを押さえ、次章では実際のエラーログ解析へと進みます。

【お客様社内でのご説明・コンセンサス】

技術担当者はrsyncが初回完全コピー後にタイムスタンプとサイズ差で更新部分を検出する仕組みを上司へ説明し、属性保持オプションの設定漏れによる欠落リスクを共有してください。

【Perspective】

差分検知の精度を上げるには–checksumオプションを併用できますが、CPU負荷と転送時間への影響を勘案し、運用環境でのテストを必ず実施してください。

エラーログの読み方:代表的な出力例と解析ポイント

rsync実行時の標準出力・標準エラー出力には、原因を特定するための重要な情報が含まれています。本章では、頻出するエラーメッセージ例とその意味、解析のための着眼点を整理します。

表:代表的なrsyncエラーメッセージ一覧| メッセージ | 原因と意味 |

|---|---|

| rsync: mkstemp “/path/to/file.XXXXXX” failed: Permission denied (13) | 書き込み権限がないため、一時ファイル作成に失敗 |

| rsync: write failed on “/path/to/file”: No space left on device (28) | ディスク容量切れで書き込みが停止 |

| rsync error: some files vanished before they could be transferred (code 24) | 転送中にファイルが消失または移動された |

| rsync: connection unexpectedly closed (code 255) | ネットワーク切断やremote shellの異常終了 |

解析ポイント

各エラーに対し、以下の手順で原因を絞り込みます。

- 権限エラー:対象ディレクトリ・ファイルの所有者・パーミッションを確認

- 容量エラー:dfコマンドで空き容量をチェックし、必要に応じて不要ファイルを削除

- 消失ファイル:転送直前のファイル一覧をログに残し、消失タイミングを把握

- ネットワーク切断:pingやssh接続の安定性を検証

【お客様社内でのご説明・コンセンサス】

技術担当者はログ内のエラーコードと原因対応策を一覧化し、上司へ権限設定や容量計画の見直し提案を共有してください。

【Perspective】

エラー対応策を自動化スクリプトに組み込む際は、想定外エラーへのフォールバック処理を必ず追加し、再現テストを徹底してください。

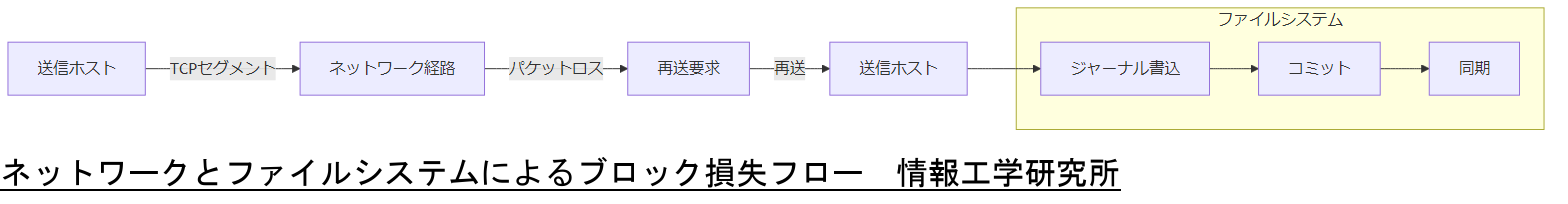

ブロック損失の発生原因:ネットワーク/ファイルシステム観点

差分転送時にファイルの一部ブロックが欠落する主な要因は、ネットワーク品質の低下やリモート側のファイルシステム障害です。本章では、それぞれの観点から発生メカニズムを整理します。

表:ブロック損失発生要因一覧| 要因カテゴリ | 具体的事象 |

|---|---|

| ネットワーク | パケットロス、遅延急増、TCP再送タイムアウト |

| ファイルシステム | ジャーナリング不整合、ハードウェア障害、キャッシュ未同期 |

| リモートシェル | ssh接続途切れ、セッションタイムアウト |

原因メカニズム

パケットロスや再送遅延が繰り返されると、rsyncがブロック受信をタイムアウト扱いし、転送対象から除外する場合があります。また、リモート側でファイルシステムが不整合状態にあると、書き込みが途中でロールバックされ、データ欠落が生じます。

【お客様社内でのご説明・コンセンサス】

技術担当者はネットワーク遅延によるTCP再送やファイルシステムのジャーナリング不整合が欠落原因となる点を整理し、回線品質改善やファイルシステム保守計画の必要性を上司へ報告してください。

【Perspective】

ネットワーク監視ツールでパケットロス率を常時可視化し、ファイルシステムの定期チェック(fsckなど)を運用ルールに組み込んでください。

失われたブロックの検出方法:–checksumオプション活用術

rsyncの標準比較はタイムスタンプとサイズを用いますが、差分検知で見落とされたブロックを洗い出すには–checksumオプションを利用します。本章では、チェックサムによる全ブロック検証手順と応用例を解説します。

表:–checksumオプション活用時の検証パターン| 検証モード | 概要 | 所要時間影響 |

|---|---|---|

| デフォルト | タイムスタンプ+サイズ比較のみ | 最速 |

| –checksum | 全バイトのCRCチェックサム比較 | 遅延増大 |

| –checksum-dir | ディレクトリ単位のチェックサム比較 | 中程度 |

実践手順

1. rsyncに–checksumオプションを追加

2. 初回は完全検証モードで実行(時間がかかります)

3. 検証後に差異リストをログ化し、欠落ファイルを特定

4. 特定ファイルのみ再同期を実行

【お客様社内でのご説明・コンセンサス】

技術担当者は–checksumオプション実行後のログファイルを上司へ提示し、検証時間と精度のトレードオフを合わせて説明してください。

【Perspective】

チェックサム検証を自動化する場合、実行スケジュールを業務時間外に設定し、負荷集中を避ける運用設計を行ってください。

ブロック回収コマンド実践:–partial-dir+再同期手順

一時ファイル保存機能(–partial-dir)を用いることで、転送途中で中断されたブロックを効率的に回収できます。本章ではpartial-dirディレクトリの設定方法と再同期実行ステップを具体例とともに示します。

表:–partial-dirオプション利用例| コマンド | 説明 |

|---|---|

| rsync -a –partial-dir=.rsync-part src/ dest/ | 中断ブロックを.rsync-partに一時保存 |

| rsync -a –partial-dir=.rsync-part –append-verify src/ dest/ | 既存部分に追記かつ検証 |

操作ポイント

partial-dirは中断データを保持し、再転送時の負荷低減につながります。また–append-verifyで部分データの整合性チェックを併用すると、欠落リスクをさらに抑制できます。

【お客様社内でのご説明・コンセンサス】

partial-dirによる一時データ保存と、append-verifyの組み合わせによる再同期フローを上司に説明し、作業手順書への反映を提案してください。

【Perspective】

一時ディレクトリの容量管理を忘れず、定期的に不要データの自動削除スクリプトを用意してディスク圧迫を防いでください。

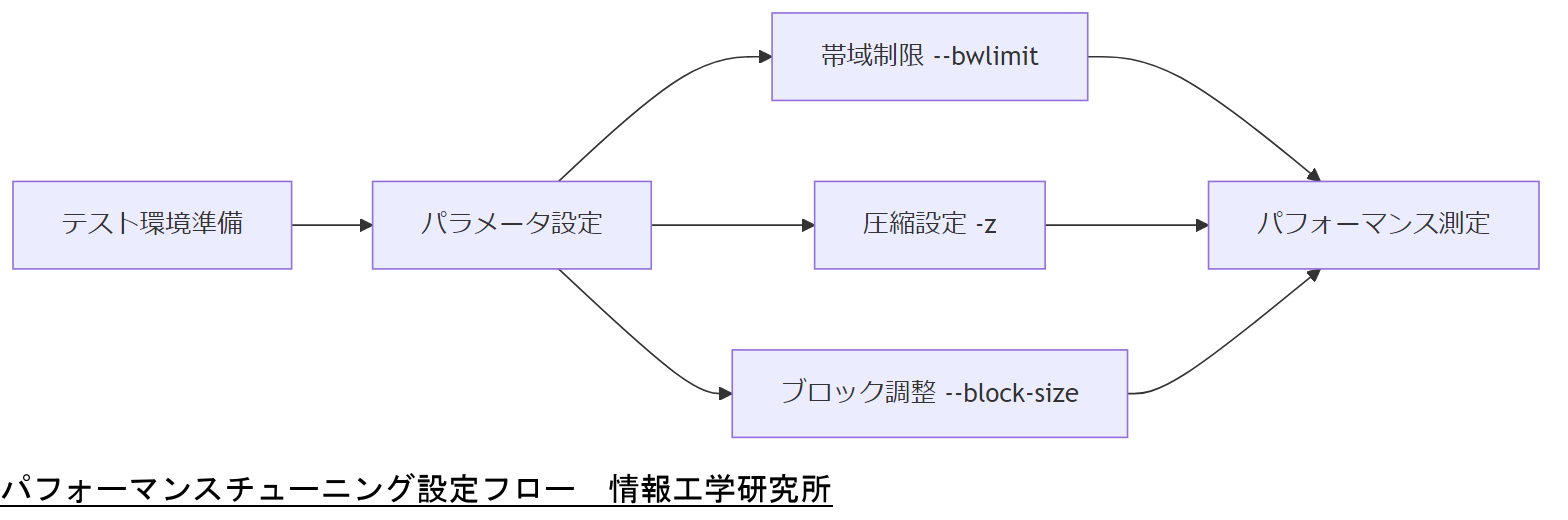

大量データ転送時のパフォーマンスチューニング

数百ギガバイト以上のデータ同期では、デフォルト設定のままでは転送時間が膨大になります。本章では、rsyncの主要チューニングパラメータと運用上のポイントを整理し、実運用での効果的な設定手順を解説します。

表:パフォーマンスチューニング項目| オプション | 役割 | 注意点 |

|---|---|---|

| –bwlimit=KBPS | 帯域使用上限設定 | 過度に絞るとスループット低下 |

| -z | 転送中圧縮 | CPU負荷増大に注意 |

| –inplace | 既存ファイル上書き | 中断時の一貫性にリスクあり |

| –block-size=SIZE | ブロック単位調整 | 大きすぎると検証時間増 |

設定フロー

まずテスト環境で各オプションを組み合わせ、転送速度とCPU負荷を測定します。次にcron等で夜間バッチ実行を設定し、運用環境のピーク時帯域への影響を最小化しながら、転送完了時間を最適化します。

【お客様社内でのご説明・コンセンサス】

技術担当者はテスト結果をまとめ、帯域制限や圧縮適用後の転送時間短縮効果を上司へ提示し、夜間バッチ運用の承認を得てください。

【Perspective】

本番適用前に必ず業務時間帯と非業務時間帯での転送ログを比較し、影響範囲を可視化した資料を残してください。

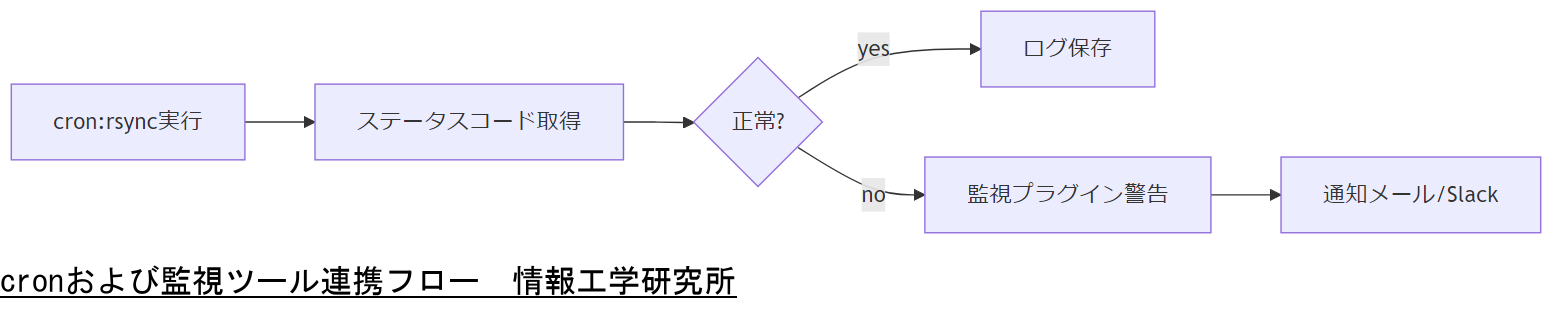

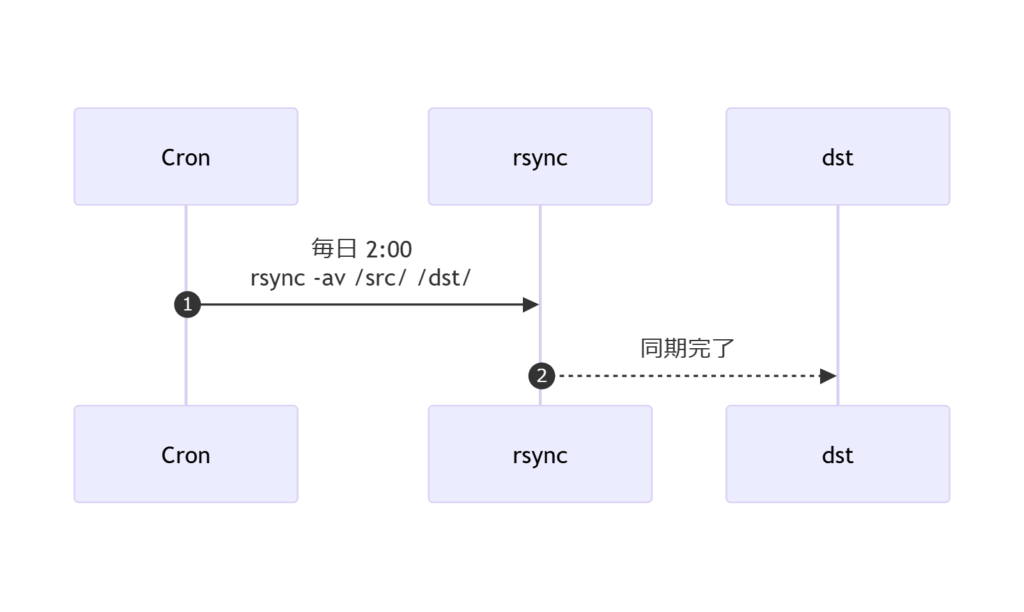

運用自動化と監視:cron+監視ツール連携例

日常のrsyncバッチ処理をcronで自動化し、NagiosやZabbixなどの監視ツールと連携することで、障害発生時に即座に通知を受け取り、対応時間を短縮します。本章では、設定例と運用フローを紹介します。

表:自動化・監視構成例| 項目 | 設定例 | 備考 |

|---|---|---|

| cronジョブ | 0 2 * * * /usr/bin/rsync -a –delete /src/ /dest/ | 毎日02:00実行 |

| 監視プラグイン | check_rsync -H <ホスト> -P 873 | 接続確認+ログチェック |

| 通知手段 | メール/Slack連携 | 障害時に即時アラート |

設定手順

1. cronタブにジョブ登録

2. 監視サーバにcheck_rsyncプラグイン導入

3. 障害条件(エラーコード返却、ログ異常検知)を定義

4. 通知先(メール/Webhook)設定を完了

【お客様社内でのご説明・コンセンサス】

技術担当者はcron自動実行と監視ツールのアラート連携を説明し、ジョブ実行時間や通知フローの承認を上司へ得てください。

【Perspective】

自動化スクリプトと監視設定は別環境でテストし、本番適用前にフェイルオーバー時の動作確認を必ず行ってください。

トラブル時のBCP対応:緊急時・無電化時・システム停止時

システム障害発生時には、BCP(事業継続計画)に基づき、緊急対応・無電化対応・システム停止対応の3段階でオペレーションを実行することが必須です。本章では各フェーズの役割と具体的な手順を解説します。

表:BCP対応フェーズと主なアクション| フェーズ | 主なアクション | 注意点 |

|---|---|---|

| 緊急時 | 一次復旧(代替回線切替・予備機起動) | 優先システムの定義と順序決定 |

| 無電化時 | UPS/非常用発電機起動・電源切替 | 燃料確保と起動手順の明確化 |

| システム停止時 | 災害対策センター起動・手動オペレーション実施 | 手順書の最新版配布と訓練実施 |

実践フロー

1. 緊急時発生:予備回線と代替サーバへ自動リダイレクト

2. 無電化検知:UPSアラーム→発電機自動起動→電源系統切替

3. システム停止:手動操作チーム招集→災害対策センター運用開始→人力バックアップ運用

【お客様社内でのご説明・コンセンサス】

技術担当者はBCPの3段階フェーズと主要アクションを上司へ共有し、優先システムや代替資源のリストを承認してください。

【Perspective】

それぞれのフェーズで使用する代替資源(回線・電源・人員)の可用性を定期的に検証し、訓練結果をBCP文書に反映してください。

コンプライアンス遵守:法令・ガイドライン整理

rsync運用では、データ転送・保存に関わる法令遵守が不可欠です。本章では、個人情報保護法や電子帳簿保存法など、主要な法令とガイドラインを整理します。

表:関連法令・ガイドライン一覧| 名称 | 概要 | 留意点 |

|---|---|---|

| 個人情報保護法 | 個人データの収集・管理基準を規定 | 暗号化・アクセス制御の実装必須 |

| 電子帳簿保存法 | 電子データの保存要件を規定 | タイムスタンプ付与が必要 |

| サイバーセキュリティ基本法 | 組織のセキュリティ対策を義務化 | リスクアセスメントの実施必須 |

実践ポイント

各法令に基づき、データ格納先への暗号化設定やタイムスタンプ取得の運用手順をマニュアル化してください。ログ保管期間や権限管理ポリシーも合わせて整備し、内部監査体制を強化します。

【お客様社内でのご説明・コンセンサス】

技術担当者は関連法令ごとに必要な技術要件(暗号化、タイムスタンプ、監査ログ)を整理し、上司への承認資料として提出してください。

【Perspective】

法令更新時には改正ポイントを即反映できるよう、社内手順書とチェックリストを常に最新化してください。

外部専門家エスカレーションフロー

自社内で対応困難な障害や高度な調査が必要な場合、外部専門家へのエスカレーション手順を定めておくことが重要です。本章では、判断基準と情報提供項目、連携ステップを整理します。

表:エスカレーション判断と提供情報| 判断基準 | 提供情報 | 対応期限 |

|---|---|---|

| 障害範囲不明 | エラーログ全文/システム構成図 | 2時間以内 |

| 復旧試行失敗 | 試行コマンド一覧/結果ログ | 1時間以内 |

| データ整合性懸念 | チェックサム結果/ファイルリスト | 即時 |

連携ステップ

1. 内部チームで初期トリアージ実施

2. 上司承認後、専門家コンタクト先に情報一式を送付

3. 24時間以内に対応可否と見積りを受領

4. 依頼確定後、進捗報告を定期的に実施

【お客様社内でのご説明・コンセンサス】

技術担当者はエスカレーション判断基準と提供情報項目を整理し、上司の承認プロセスを明確化してください。

【Perspective】

エスカレーション先の対応可能時間帯や連絡手段を事前に確認し、契約内容に基づく対応SLAs(サービスレベル合意)を把握しておいてください。

御社社内共有・コンセンサス

技術担当者が本記事で示した各章のポイントを社内で共有し、経営層や関係部署との合意を得るためのフレームワークを解説します。円滑な合意形成により、迅速な対策実行とBCP強化を実現します。

表:社内共有資料の構成例| 資料項目 | 内容 |

|---|---|

| 障害概要と影響範囲 | 発生事象の時系列、影響システムリスト |

| 原因分析と対策案 | 各章で提示した解析手順とコマンド |

| 承認依頼事項 | 予算、人員、スケジュール |

合意形成フロー

1. 技術チーム内部レビュー

2. 関係部署ヒアリング(総務・経理・法務)

3. 経営層向け資料レビュー

4. 最終承認と改善計画策定

【お客様社内でのご説明・コンセンサス】

技術担当者は合意形成フローを関係者に提示し、レビュー日程と責任者を明確に調整してください。

【Perspective】

合意プロセスはドキュメント化し、レビュー履歴を残すことで、後続の監査や改善時に活用できる証拠資料となります。

まとめと今後の運用改善提案

本記事で解説したrsyncの差分転送運用とエラー解析手順を総括し、継続的な信頼性向上のための運用改善提案を示します。定期的な検証と手順書の更新、監視自動化の強化により、障害発生時の復旧時間をさらに短縮できます。

表:運用改善提案一覧| 改善項目 | 内容 |

|---|---|

| 定期チェック自動化 | checksum検証とファイルシステム検査を週次実行 |

| 手順書の定期更新 | 法令改正や環境変化に合わせて半年ごとにレビュー |

| 監視アラート強化 | 障害閾値の細分化と通知ルート多重化 |

| 教育訓練実施 | 年1回のBCP訓練と障害時対応演習 |

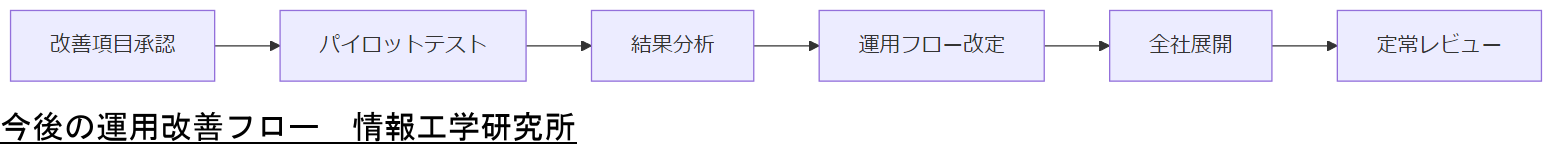

次のステップ提案

まずは改善項目を優先度順に社内承認し、パイロットテストを実施します。テスト結果を踏まえた運用フロー改定後、全社展開および定常レビューサイクルを確立してください。

【お客様社内でのご説明・コンセンサス】

技術担当者は改善提案の優先順位とテスト計画を資料化し、上司および関係部署への承認取得を行ってください。

【Perspective】

改善サイクルを継続的に回すためにKPIを設定し、評価結果を四半期ごとに可視化して経営層へ報告してください。

具体的な使い方について説明。

以下では、代表的な利用シーンごとに rsync の便利な使い方を Mermaid 記法のフローチャートやシーケンス図で示しつつ解説します。エレメンターのテキストボックスにそのまま貼り付けられるよう、コードブロック内に Mermaid 記法を記述しています。必要に応じて Mermaid Live Editor で PNG に変換してご利用ください。

概要

rsync は「差分同期」を行うため、変更されたデータのみを転送し、ネットワーク帯域の節約と高速化を実現します。

ローカル同期からリモート同期、ミラーリング、増分バックアップ、自動化まで、多彩なケースで利用可能です。

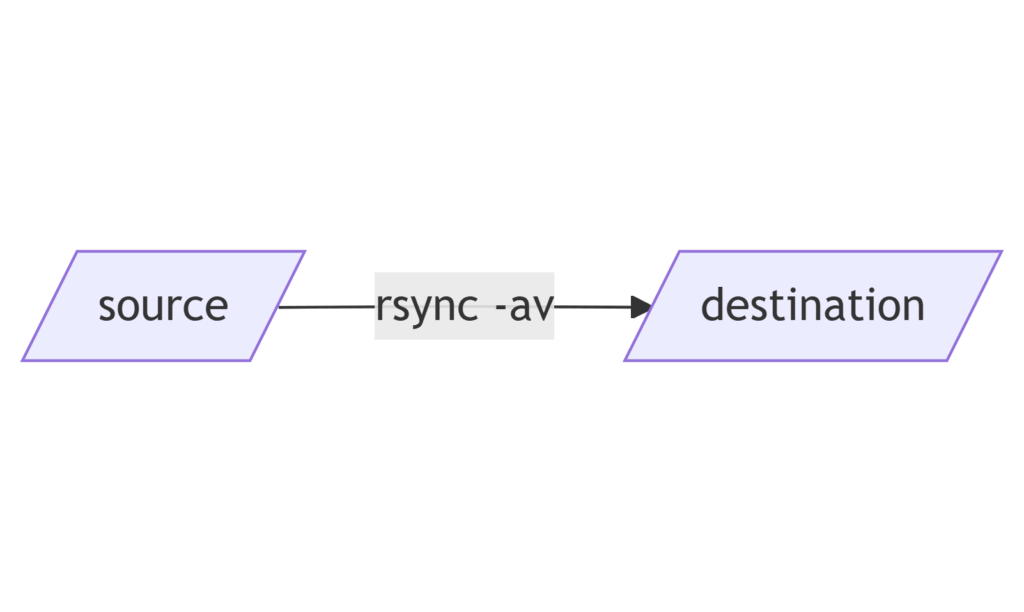

ケース1: ローカルディレクトリ間の基本同期

同一ホスト内のフォルダを丸ごと同期する最も基本的なパターンです。

このコマンドはアーカイブモードで時間情報や権限を保持しつつ完全コピーを行います。

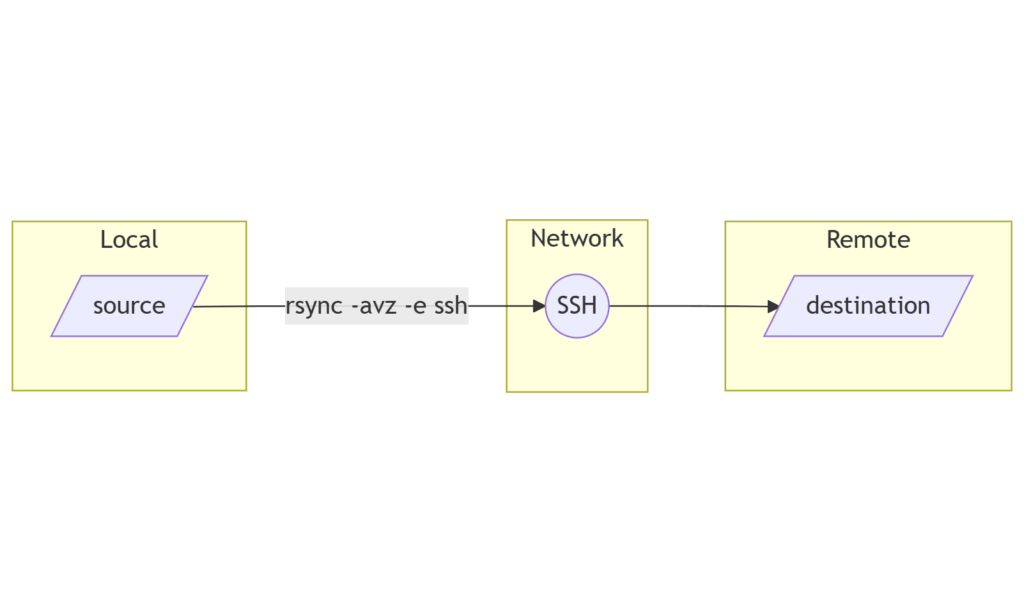

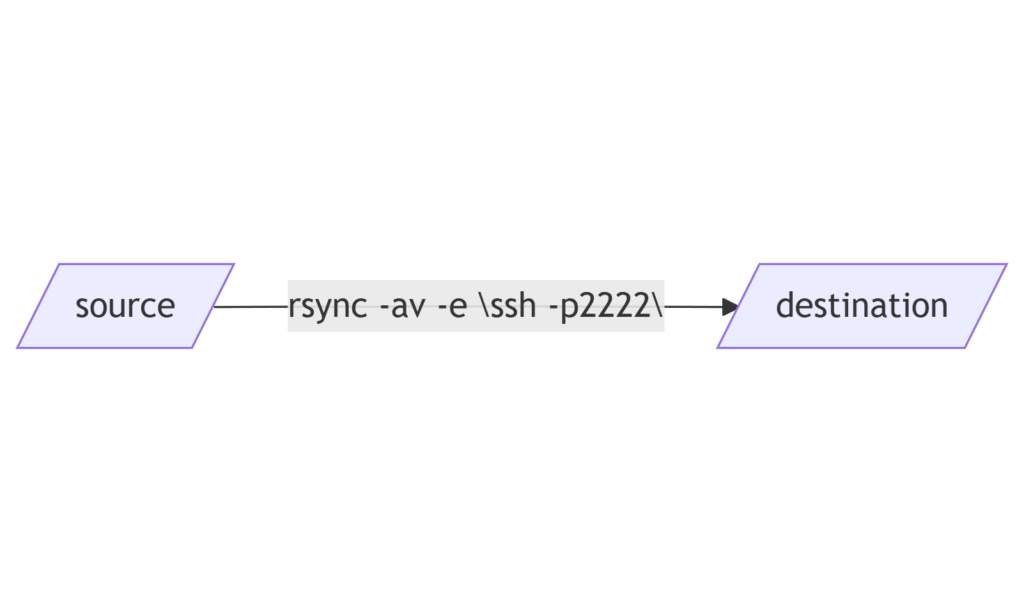

ケース2: SSH 経由でのリモート同期

SSH で暗号化されたチャンネルを使い、リモートサーバーと同期します。

-z による圧縮転送と SSH 鍵認証を併用すると、自動化時のセキュリティが向上します。

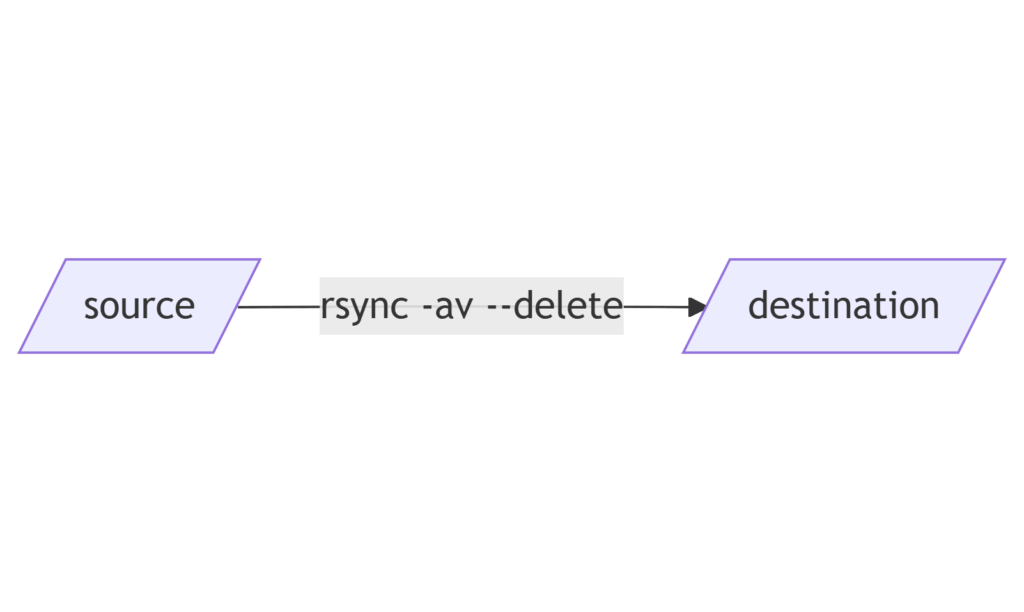

ケース3: ミラーリング(不要ファイルの削除)

宛先をソースと完全に一致させたい場合に有効です。

--delete オプションで、ソースにないファイルを宛先から自動削除します。

ケース4: 増分バックアップ(–link-dest)

過去のバックアップと比較し、差分のみを別ディレクトリに保存します。

--link-dest を使うとハードリンクによる効率的な増分保存が可能です。

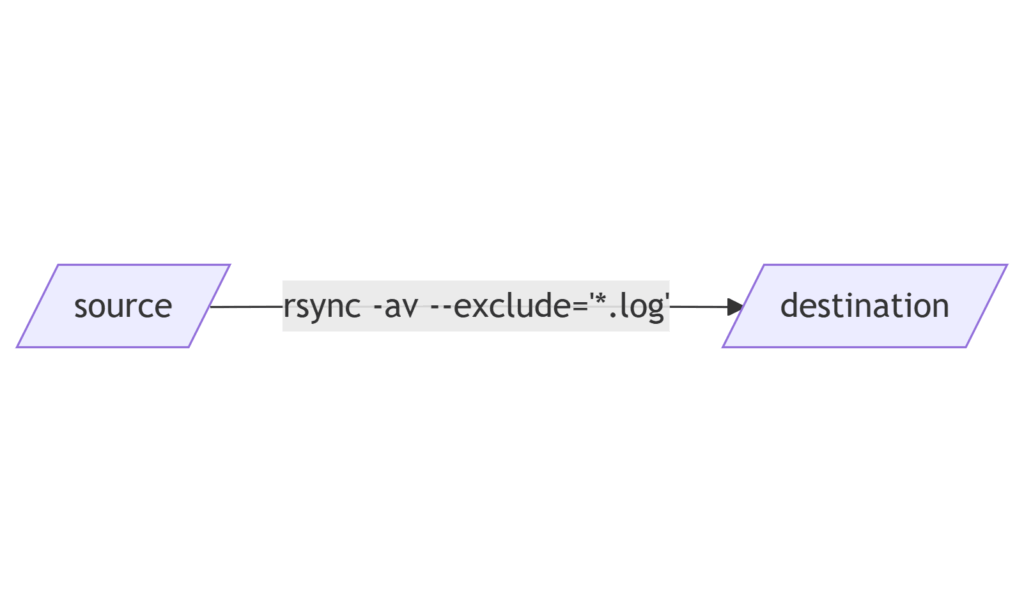

ケース5: 特定ファイルの除外同期

ログや一時ファイルなどを同期対象から外します。

複数パターンを除外する場合、--exclude-from=exclude.txt も利用できます。

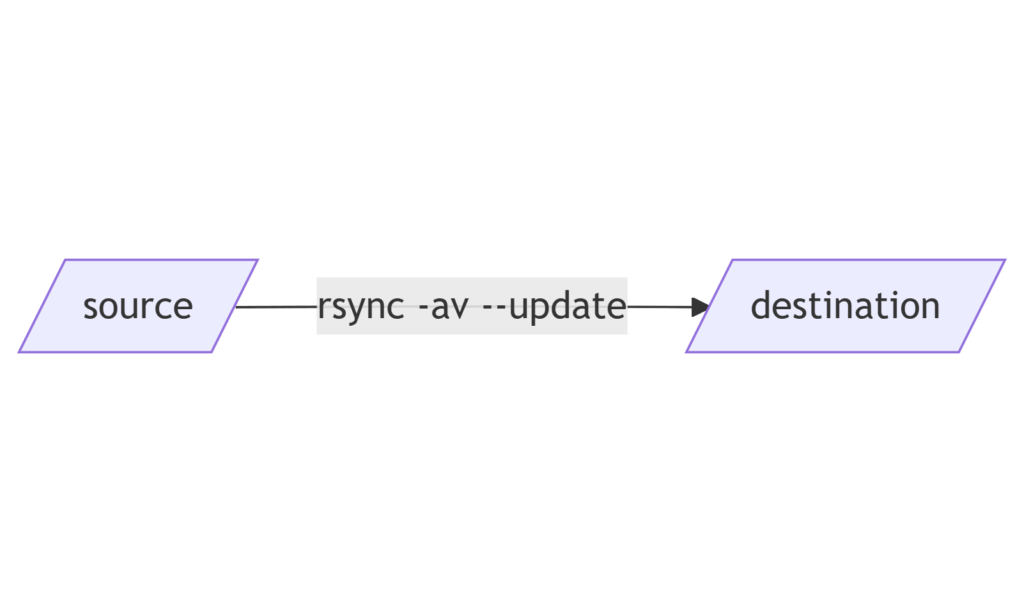

ケース6: 新規/更新ファイルのみ同期(–update)

宛先より新しいファイルだけを転送し、既存のファイルを保護します。

大量ファイルの上書きを抑制し、安全に同期を行えます。

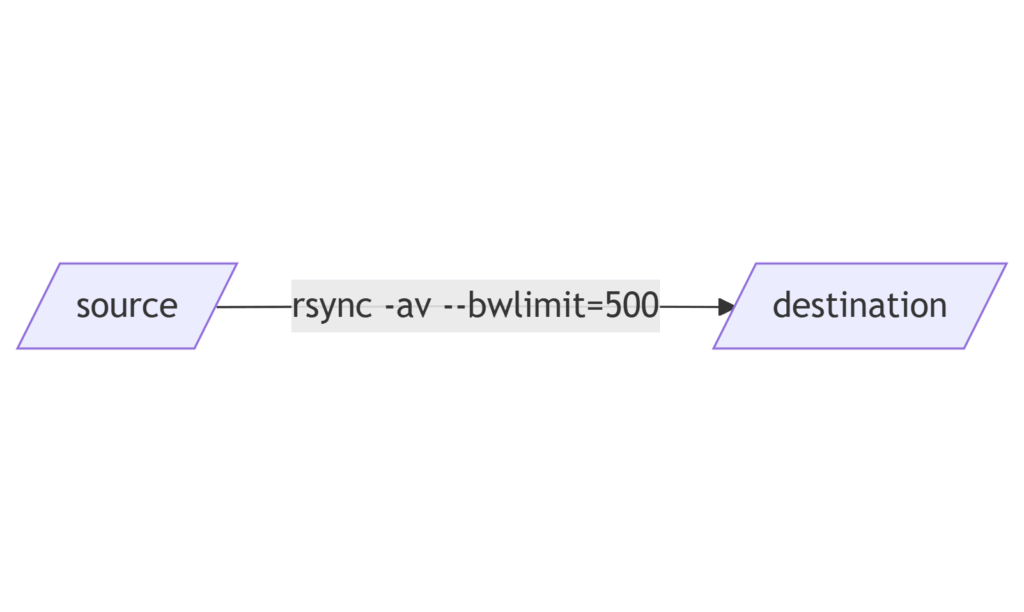

ケース7: 帯域制限をかけた転送(–bwlimit)

ネットワーク帯域を圧迫させずに同期を行いたい場合に有効です。

--bwlimit=KB/s で転送速度上限を設定できます。

ケース8: cron による定期実行の自動化

夜間や非業務時間に定期バックアップを自動化します。

crontab への登録一行で、手間なく定期実行が実現します。

ケース9: rsync デーモンモード

大量クライアントからのアクセスを受け付けるサーバー構築に適しています。

/etc/rsyncd.conf でモジュール定義し、rsync --daemon を起動します。

ケース10: SSH ポート指定やオプション追加

非標準ポートや制限付き環境での接続に対応します。

SSH の -p、-i オプションを併用して柔軟に接続設定が可能です。

以上のケースを組み合わせることで、WordPress やサーバー運用のさまざまなシーンで柔軟に rsync を活用できます。

ローカルテスト → リモート本番

ミラーリング機器バックアップ → 増分ストレージ

バンド幅制限 → 業務混雑回避

cron → 定期自動化

上記コードをエレメンターのテキストボックスに貼るか、Mermaid Live Editor で図を PNG 化して埋め込めば、論文や技術ブログの記事に最適なビジュアル付き解説となります。

はじめに

ファイル同期の重要性とrsyncエラーの影響 ファイルの同期は、企業のデータ管理において非常に重要なプロセスです。特に、rsyncのようなツールを使用することで、効率的にデータを更新し、バックアップを行うことが可能になります。しかし、rsyncを利用する際には、エラーが発生することも少なくありません。これらのエラーは、データの整合性や可用性に深刻な影響を与える可能性があります。特に、差分転送時に失われたブロックの回収が必要になる場面では、適切な対応が求められます。このような状況に直面した場合、原因を理解し、適切な解決策を見つけることが重要です。本記事では、rsyncのエラー解析を通じて、差分転送時に発生する問題とその解決方法について詳しく解説します。これにより、データ管理者やIT部門の方々が安心してデータの同期を行えるよう、サポートしていきます。

rsyncの基本機能と差分転送の仕組み

rsyncは、ファイルやディレクトリを効率的に同期するための強力なツールです。特に、差分転送機能を持つため、変更があった部分のみを転送することができ、ネットワーク帯域の節約や転送時間の短縮に寄与します。この仕組みは、各ファイルをブロック単位で比較し、変更があったブロックだけを送信することで実現されています。 具体的には、rsyncはまず送信元と送信先のファイルを比較し、ハッシュ値を生成します。このハッシュ値を基に、どの部分が異なっているのかを特定します。その後、差分があるブロックのみを転送するため、全体を再送信する必要がありません。これにより、データの転送効率が大幅に向上します。 ただし、このプロセスにおいても、エラーや問題が発生することがあります。特に、差分転送中に何らかの理由でブロックが失われると、データの整合性が損なわれる可能性があります。このような状況においては、適切なエラー解析と回収手段が必要となります。次章では、実際に発生する事例や対応方法について詳しく見ていきます。

エラーの種類とその原因を深掘り

rsyncを使用する際に直面するエラーは多岐にわたりますが、主にネットワーク関連の問題、ファイルシステムの制限、そしてソフトウェアの設定ミスに起因することが一般的です。まず、ネットワーク関連のエラーについて見ていきましょう。例えば、接続が不安定である場合、データ転送中にパケットが失われることがあります。これにより、転送が中断され、結果として差分が正しく反映されないことがあります。 次に、ファイルシステムの制限も重要な要素です。特に、送信元または送信先のディスク容量が不足している場合、rsyncはデータの書き込みを完了できず、エラーが発生します。このような状況では、事前にディスクの空き容量を確認し、必要に応じてファイルの整理を行うことが求められます。 最後に、ソフトウェアの設定ミスも見逃せません。rsyncのオプション設定が不適切であると、意図しない動作を引き起こすことがあります。例えば、特定のファイルを除外する設定が誤っている場合、本来転送されるべきデータが失われることがあります。このため、rsyncを使用する際には、設定内容を十分に確認し、必要なオプションを正しく指定することが重要です。 これらのエラーの原因を理解することで、適切な対処法を見つけやすくなります。次章では、具体的な事例を交えながら、実際の対応方法について詳しく探っていきます。

差分転送時に失われたブロックの特定方法

差分転送時に失われたブロックを特定するためには、rsyncのログ機能やエラーメッセージを活用することが効果的です。まず、rsyncを実行する際に「-v」オプションを使用することで、詳細な出力を得ることができます。この出力には、転送されたファイルの情報やエラーの内容が含まれ、どのブロックが正常に転送されたかを確認する手助けとなります。 さらに、「–dry-run」オプションを併用することで、実際の転送を行わずにどのファイルが転送対象となるかをシミュレーションできます。これにより、失われたブロックが特定のファイルに関連しているかどうかを事前に確認することが可能です。また、rsyncの「–itemize-changes」オプションを使用することで、変更されたアイテムの詳細なリストを表示し、どの部分が差分として認識されているかを把握できます。 もし、ログにエラーや警告が表示されている場合、それらのメッセージを注意深く読み解くことが重要です。特に、ファイルが存在しない、またはアクセス権が不足しているといったエラーは、失われたブロックの原因となることがあります。これらの情報をもとに、必要な対策を講じることで、データの整合性を保ちながら効率的に問題を解決することができます。次章では、具体的な解決策について詳しく説明します。

ブロック回収の手法と実践的なアプローチ

ブロック回収の手法にはいくつかのアプローチがありますが、まずはrsyncの再実行を通じて失われたブロックを回収する方法が考えられます。この際、前述のログやエラーメッセージを参考にし、特定のファイルやディレクトリをターゲットにすることで、効率的にデータを復元できます。例えば、失われたと考えられるブロックが含まれているファイルを指定して再度rsyncを実行することで、必要なデータを再取得することができます。 次に、rsyncの「–checksum」オプションを活用する手法も有効です。このオプションを使用すると、rsyncはファイルの内容を確認するためにハッシュ値を再計算し、転送する必要があるブロックを特定します。これにより、差分転送におけるエラーを最小限に抑えながら、確実にデータを回収することが可能です。 さらに、rsyncの「–delete」オプションを用いることで、送信先に存在しないファイルを削除することができます。この方法は、送信元と送信先のデータを完全に一致させたい場合に有効ですが、注意が必要です。誤って重要なデータを削除しないよう、事前にバックアップを取っておくことが推奨されます。 これらの手法を組み合わせることで、失われたブロックの回収を効率的に行うことができます。次章では、全体のまとめと今後の対策について考察します。

エラーを未然に防ぐためのベストプラクティス

エラーを未然に防ぐためには、rsyncを使用する際のベストプラクティスを理解し、実践することが重要です。まず、定期的なバックアップスケジュールを設定することで、データの損失を防ぐことができます。バックアップは、データの整合性を保つために非常に重要であり、定期的に実行することで、万が一のトラブル時にも迅速に復元が可能です。 次に、rsyncのオプション設定を見直し、最適な設定を選択することも大切です。特に「–archive」オプションを使用することで、ファイルのパーミッションやタイムスタンプを保持しながら転送することができます。また、「–compress」オプションを活用すれば、転送データのサイズを削減でき、ネットワーク負荷を軽減することが可能です。 さらに、転送前に送信元と送信先のディスク容量を確認し、十分な空き容量があることを確保することも肝要です。これにより、ファイルシステムの制限によるエラーを未然に防ぐことができます。また、rsyncのログ出力を定期的に確認し、異常がないかをチェックすることで、早期に問題を発見し、対処することができます。 最後に、rsyncのバージョンを常に最新の状態に保つことも重要です。新しいバージョンでは、バグ修正や機能改善が行われるため、安定した動作が期待できます。これらのベストプラクティスを実践することで、rsyncを使用したファイル同期の信頼性を高め、エラーを未然に防ぐことができるでしょう。

エラー解析から得られる教訓と今後の展望

本記事では、rsyncを用いたファイル同期におけるエラー解析と、特に差分転送時に失われたブロックの回収方法について詳しく解説しました。rsyncはその効率性から多くの企業で利用されていますが、エラーが発生することでデータの整合性が損なわれる可能性があります。エラーの原因を理解し、適切な対処法を講じることが重要です。 特に、rsyncのログ機能やエラーメッセージを活用することで、問題の特定が容易になり、迅速な対応が可能となります。さらに、再実行やオプションの活用によって、失われたデータの回収が実現できます。このような知識を持つことで、データ管理者やIT部門の方々は、より安心してファイルの同期作業を行えるようになるでしょう。 今後は、技術の進化に伴い、rsyncやその他のファイル同期ツールも新たな機能や改善が期待されます。これにより、データ管理の効率性が一層向上することが見込まれます。引き続き、最新の情報をキャッチアップし、適切な運用を心がけることが、データの安全性を高める鍵となるでしょう。

さらなる情報を得るためのリソース紹介

データ同期やバックアップに関する知識を深め、rsyncをより効果的に活用するためには、信頼できるリソースを参照することが重要です。オンラインのフォーラムや専門的なブログ、技術書籍など、さまざまな情報源が存在します。これらのリソースを活用することで、最新の技術トレンドやベストプラクティスを学ぶことができ、実務に役立てることが可能です。 また、データ復旧やデータ保全に関する専門家の意見やアドバイスも非常に有益です。特に、実際の事例をもとにした解説や、具体的な問題解決策を示すコンテンツは、日々の業務において直面する課題を解決する手助けとなります。信頼できる情報源を見つけ、積極的に情報収集を行うことで、データ管理のスキルを向上させ、より安心して業務に取り組むことができるでしょう。

rsync使用時の注意事項とトラブルシューティングのポイント

rsyncを使用する際には、いくつかの注意事項を理解しておくことが重要です。まず、データの整合性を確保するために、転送前に送信元と送信先のディスク容量を確認することが必要です。十分な空き容量がない場合、データが正しく転送されず、エラーが発生する可能性があります。また、rsyncのオプション設定が適切であることも確認しましょう。特に、ファイルのパーミッションやタイムスタンプを保持するために「–archive」オプションを使用することが推奨されます。 さらに、rsyncの実行時には、ログ出力を有効にしておくと良いでしょう。これにより、転送中に発生したエラーや警告を後から確認しやすくなります。エラーが発生した場合は、ログをもとに原因を特定し、適切な対策を講じることができます。特に、接続の不安定さやファイルのアクセス権の問題がエラーの原因となることが多いため、これらの点に注意を払うことが重要です。 最後に、rsyncのバージョンを最新の状態に保つことも忘れずに行いましょう。新しいバージョンでは、バグ修正や機能改善が行われているため、安定した運用が期待できます。これらの注意点を踏まえることで、rsyncをより効果的に活用し、データの安全性を高めることができるでしょう。

補足情報

※株式会社情報工学研究所は(以下、当社)は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。