選択と行動(候補) まず読み取り中心で現象を固定(最小変更) SMART/カーネルログ/エラー頻度を材料にして状況説明を整える 書き込みが増える運用(バッチ/再同期/自動修復)は“影響範囲”の合意ができるまで保留 収束が遅いときは、複製→解析→復旧の分岐を早めに検討

選択と行動(候補) どのレイヤが破綻しているかを“切り分け図”で共有(RAID→LVM→FS→サービス) 読み取りで取れる範囲の状態情報を集め、復旧優先か復旧+原因究明かを決める バックエンドの操作は“切り戻し前提”で、やること/やらないことを先に合意 監査や説明責任がある場合は、証跡が揃うまで強い変更を避ける

選択と行動(候補) デバイスの対応関係(SSD↔バックエンド↔bcache)を先に紙に落とす “いま見えている状態”を保存し、作業の前後差分で追えるようにする 触るなら1点だけに限定し、影響範囲が増えそうなら早めに相談へ寄せる 復旧のゴール(データ回収/復旧運用/根治)を先に揃える

選択と行動(候補) まず“dirtyの有無/量”を確認し、復旧の見通しを言葉にする 本番データの回収を最優先にするなら、書き込みが増える操作は慎重に扱う 影響範囲(DB/ログ/コンテナ/共有領域)を先に可視化して、止める/止めないの判断材料にする 監査要件がある場合は、作業ログと根拠が残る進め方に寄せる

- 直近の障害イベント:dmesg / journal のエラー時刻と頻度

- bcacheの状態:キャッシュモード、dirtyの有無、再接続状況

- 対象デバイスの対応関係:SSD・バックエンド・bcache名の紐づけ

- 上位レイヤ:RAID/LVM/FS/マウントポイントに波及があるか

- 業務影響:コンテナ/VM/ジョブ/バッチ/共有領域が触れている範囲

- 原因未確定のまま書き込みが発生して、dirtyデータが増え、復旧難度が上がる

- キャッシュ側を先に初期化・交換してしまい、再構成に必要な手がかりを失う

- バックエンドにも同時に手を入れて、影響範囲が拡大し“二重障害”のように見える

- 監査・説明用のログや根拠が残らず、復旧後に説明責任が果たしづらくなる

もくじ

- 第1章:Bcacheは「高速化のつもりが単一障害点」になりやすい背景

- 第2章:現場で起きる症状:I/Oエラー、フリーズ、read-only化、性能劣化

- 第3章:復旧が難しくなる理由:キャッシュ・バックエンド・メタデータの三重構造

- 第4章:まず守るべき前提:最小変更で「書き込みを増やさない」判断軸

- 第5章:30秒トリアージ:SSD故障か、バックエンド不整合か、メタデータ破損か

- 第6章:影響範囲の見える化:どのLV/FS/サービスが巻き込まれているか

- 第7章:ケース別の安全な分岐:ライトバック/ライトスルーで変わる優先順位

- 第8章:復旧作業の設計:複製・解析・切り戻しを前提にした手順の組み立て

- 第9章:再発防止と運用:監視項目、交換基準、メンテ手順のドキュメント化

- 第10章:結論:本番データの回収と説明責任を両立する最短ルートは「早期相談」

第1章:bcacheは「高速化のつもりが単一障害点」になりやすい背景

bcacheは、SSDをキャッシュ、HDD(やRAID上の論理ボリューム)をバックエンドとして扱い、読み取りを速くしつつ書き込みも加速できる仕組みです。現場で効く場面がある一方で、障害時には「キャッシュ層」「バックエンド層」「bcacheのメタデータ(関連付けや状態)」のどこが壊れているのかが直感的に分かりにくく、判断が遅れると復旧の難度が上がりやすい特徴があります。

特に、ライトバック運用(書き込みをキャッシュ側へ先に受け、後でバックエンドへ反映する)では、SSD側の状態や電源断のタイミング次第で整合性の扱いが難しくなります。ここで大切なのは、修理手順を急ぐよりも「今この瞬間に、どの操作が書き込みを増やすか」を意識し、最小変更で状況を落ち着かせることです。

冒頭30秒:症状→取るべき行動(被害最小化と依頼判断)

以下は、現場で最初に置いておくと収束が速くなる対応表です。ここでの「取るべき行動」は、修理を進めるためではなく、影響範囲を固めて説明可能性を上げるためのものです。

| 症状(見えている現象) | まず取るべき行動(安全な初動) | 今すぐ相談が近い条件 |

|---|---|---|

| I/Oエラーが断続的に出る | カーネルログの時刻と頻度を固定し、キャッシュ/バックエンドどちらのエラーか目印を付ける | 本番DBや共有領域に波及、再起動で悪化、SSDの物理兆候が強い |

| 突然read-only化する | 書き込みを抑え、上位サービス停止の判断材料(影響範囲)を先に揃える | ライトバック運用、監査要件あり、コンテナ/VMが多数ぶら下がる |

| フリーズ/高遅延が続く | 性能劣化の原因がキャッシュのミスヒットかバックエンド飽和かを分けて観測する | 業務停止が許容できない、復旧と説明を同時に要求される |

| bcacheの関連付けが崩れたように見える | デバイス対応関係(SSD↔バックエンド↔bcache)を確定し、現状を保存してから次を考える | 同名/似たUUIDが混在、交換作業が絡む、判断の根拠が取りにくい |

「修理手順」を探して来た読者が最初に持つべき判断軸

bcache障害で最初にズレやすいのは、「復旧=復旧コマンドを叩く」になってしまう点です。現場は止められない、上司への説明は必要、そしてセキュリティや監査も同時に迫ってきます。この状態で強い操作に踏み込むと、のちほど「何が原因で、どこまで影響したか」を説明できなくなりがちです。

だからこそ、最初のゴールは次の3点に絞ると収束しやすくなります。①書き込みが増える要因を減らす(被害最小化)、②影響範囲を言語化して共有する(説明可能性)、③相談すべき条件を満たしているか判断する(依頼判断)です。

- ライトバック運用で、整合性(dirtyの扱い)に不安がある

- バックエンドがRAID/LVM/暗号化/仮想化で多層になっている

- 共有ストレージやコンテナ、本番データ、監査要件が絡む

- 交換・再起動・復旧作業の前後関係を説明資料に落とす必要がある

上のどれかに当てはまる場合は、無理に手を進めるより、状況整理の段階から株式会社情報工学研究所への相談を検討した方が、結果として早く落ち着くことが多いです。連絡先:問い合わせフォーム / 電話 0120-838-831

次章から、現場でよく出る症状を「見え方」と「背景」に分けて整理し、どの層(キャッシュ/バックエンド/メタデータ)を疑うべきかの伏線を回収していきます。

第2章:現場で起きる症状:I/Oエラー、フリーズ、read-only化、性能劣化

bcache障害のやっかいさは、「症状の出方がバラける」ことです。ある日は遅いだけ、別の日は突然read-only、また別の日はI/Oエラーが雪崩れる。しかも、原因がキャッシュ側なのかバックエンド側なのか、あるいは両方が連鎖しているのかで、同じログでも意味が変わります。

ここでは、よくある症状を“観測のしかた”として整理します。目的は修理を進めることではなく、影響範囲を見える化し、最小変更で状況をクールダウンさせる判断材料を増やすことです。

症状パターン1:I/Oエラーが断続的に出る(静かに悪化する)

代表的にはカーネルログにI/Oエラーが出たり、ファイルシステムがエラーを検出して保護動作に入ったりします。ここで重要なのは、エラーが「どのデバイスに対して」出ているかです。bcacheデバイス(/dev/bcacheX)に見えるエラーでも、根はSSD(キャッシュ)側の読み書き不良のこともあれば、バックエンド(HDD/RAID)側の遅延・タイムアウトが波及していることもあります。

初動では、時刻・頻度・対象デバイスの3点が揃うだけでも、関係者の会話が前に進みます。ログが散らばっていると説明が難しくなるので、まずは「いつから」「どの程度の頻度で」「どのデバイス名が出ているか」を揃えます。

観測の例(読み取り中心) - dmesg -T | tail -n 200 - journalctl -k --since "YYYY-MM-DD HH:MM" --no-pager | tail -n 200 - lsblk -o NAME,SIZE,TYPE,FSTYPE,MOUNTPOINT - mount | grep -E "bcache|/dev/bcache"

ここで“書き込みを増やす操作”に踏み込む前に、現象の揺れ幅を確認しておくと、後での切り戻しや説明が楽になります。特に、業務が回っている最中の追加変更は、結果的に影響範囲を広げてしまうことがあるため注意が必要です。

症状パターン2:フリーズや高遅延が続く(性能劣化に見えて実は危険信号)

「遅いだけ」に見えると、現場は何とか我慢してしまいがちです。しかし、bcacheのキャッシュヒット率が落ちていたり、バックエンドが飽和して待ち行列が伸びていたり、SSDが内部リトライで時間を食っていたりすると、いずれ“遅い”が“落ちる”に変わります。

このときは、遅延の起点がどこに寄っているかを見ます。キャッシュ側の問題なら、SSDの劣化やリンク不良など“物理寄り”の兆候が混ざりやすいです。バックエンド側なら、RAIDのリビルド、ディスク劣化、LVM/暗号化の層、またはアプリ側のI/O特性の変化が絡むことがあります。

どちらにせよ、性能改善のための設定変更は“書き込み増”とセットで発生しやすいので、最初は「状況を落ち着かせるために何を止めるか(バッチ・再同期・重いジョブ)」を優先し、影響範囲と合意を取ってから次へ進めるのが安全です。

症状パターン3:read-only化する(守りの動作が働いたサイン)

ファイルシステムがエラーを検出すると、さらなる破壊を避けるためにread-onlyへ移行することがあります。ここで慌てて再マウントや修復を試すと、状態が変わってしまい、原因の追跡や復旧可能性の判断が難しくなることがあります。

この局面では「どのファイルシステムか」「ジャーナルがどう扱われたか」「直前に何が起きたか」が重要になります。さらにbcacheのライトバック運用が絡む場合、キャッシュ側に未反映(dirty)が残っている可能性を無視してバックエンド側だけを触ると、後で矛盾が表面化しやすくなります。

read-only化は、システムが“これ以上の変更は危ない”とブレーキを踏んだ状態とも言えます。復旧の前に、まずは影響範囲(どのサービス・どのデータが止まったか)を確定し、説明材料を揃えることが結果として近道になります。

次章では、こうした症状がなぜ起きるのかを、bcacheの三重構造(キャッシュ・バックエンド・メタデータ)として整理し、やるべきこと/やらない方がよいことの境界を明確にしていきます。

第3章:復旧が難しくなる理由:キャッシュ・バックエンド・メタデータの三重構造

bcache障害が「一筋縄ではいかない」最大の理由は、故障点が1つに見えないことです。見えているデバイスはbcache(/dev/bcacheX)でも、実体はSSDのキャッシュセット、バックエンドのブロックデバイス、そして両者を結び付けるメタデータに分かれています。どこが崩れたかで、取るべき方針が変わります。

さらに難しくするのが、運用モードの違いです。ライトスルー(書き込みを先にバックエンドへ反映)に寄せているなら、整合性のリスクは相対的に下がりますが、性能面の狙いが薄れます。ライトバック(書き込みをキャッシュへ先に受ける)に寄せているなら、性能は出やすい反面、障害時に「未反映の書き込み(dirty)」の扱いが最重要になります。

三重構造のどこが壊れると何が起きるか

現場での説明と判断を揃えるために、三重構造を表にしておくと整理が速いです。ここでは“修復手順”ではなく、現象の意味づけに焦点を当てます。

| 層 | 壊れ方の例 | 現場での見え方 | 判断のポイント |

|---|---|---|---|

| キャッシュ(SSD) | I/Oエラー、内部リトライ増、リンク不安定、寿命 | 遅延、断続エラー、再起動後に悪化 | 物理兆候が強いほど、最小変更で状態固定→相談が近い |

| バックエンド(HDD/RAID/LVM) | タイムアウト、RAID劣化、LVM/暗号化層の問題 | I/O待ちが伸びる、FSが不安定、上位サービスが不調 | bcacheだけを疑わず、多層構造のどこかを切り分ける |

| メタデータ(関連付け/状態) | 紐づけの崩れ、状態不整合、識別が曖昧 | 「どれが正しい組み合わせか」分からない | 判断根拠が消えやすいので、現状保存と相談が効く |

ライトバック運用が絡むと「整合性の説明」が難しくなる

ライトバックでは、キャッシュ側に未反映の書き込みが残る可能性があり、その状態でキャッシュを外したり初期化したりすると、後から「なぜファイルが壊れたのか」「どの時点のデータが正しいのか」を説明しにくくなります。これは、現場エンジニアが悪いという話ではなく、仕組みとして“正しい説明には前提情報が必要”という構造です。

監査や顧客説明が絡む環境では、復旧の速さだけでなく、手順の妥当性(何を根拠に、どこまで影響があると言えるか)も同時に求められます。ここで無理に場当たり的な操作を増やすと、後で「説明できない」状態になり、結果として調整コストが増えがちです。

この段階で揃えると強い“依頼判断”の材料

次に進む前に、最低限そろえておくと相談が一気に具体化する材料があります。どれも「書き込みを増やす」必要がない範囲で集められることが多く、最小変更の方針と相性が良いです。

- 障害が起きた時刻帯のカーネルログ(頻度と対象デバイスが分かる形)

- bcache運用モード(ライトバック/ライトスルー)と直近の構成変更の有無

- SSD(キャッシュ)とバックエンド(HDD/RAID/LVM)の対応関係メモ

- 上位の影響範囲(どのサービス・どのデータ領域が止まったか)

この材料が揃うと、一般論ではなく個別案件として「どこまで自社で触ってよいか」「どこから先は専門家に渡した方がよいか」の境界が引けるようになります。次章では、実際に“最小変更の初動”として何を優先し、何を後回しにするかを、より具体的に整理していきます。

第4章:まず守るべき前提:最小変更で「書き込みを増やさない」判断軸

bcache障害の初動で、現場がいちばん苦しくなるのは「早く直したい」と「余計に壊したくない」が同時に襲ってくる瞬間です。しかも、止められないレガシー構成ほど、バックエンド(HDD/RAID/LVM/暗号化)と上位(ファイルシステム/DB/コンテナ)が密結合で、どこを触っても副作用が出やすい状態になっています。

この局面で最優先になりやすいのは、復旧作業そのものよりも“場を整える”ことです。つまり、書き込みを増やしそうな要因を減らし、影響範囲を言語化して、関係者の意思決定ができる状態に落とすことです。復旧の技術論は、その土台ができてからでも遅くありません。

「書き込みを増やす操作」は、善意でも復旧可能性を下げることがある

ストレージ障害の現場では、一般に「状態が不安定なまま書き込みが走る」ことが最も避けたい事態になりやすいです。bcacheでは、キャッシュとバックエンドの間に状態(未反映の書き込み等)が存在し得るため、想定外のタイミングで書き込みが増えると、あとから整合性の説明が難しくなります。

一方で、何もしないと業務が止まる。だからこそ“最小変更”の考え方が効きます。最小変更は、何も触らないという意味ではなく、「観測→判断→実行」の順番を崩さず、実行は必要最小限に抑えるという意味です。

最小変更のためのチェックリスト(現場と上司の会話が噛み合う形)

実務では、以下の項目を先に揃えるだけで“収束”が早くなりやすいです。専門家への相談を前提にする場合も、この材料があると判断が具体化します。

- 現象のタイムライン(いつから、どの頻度で、何が起きているか)

- 対象デバイスの対応関係(SSDキャッシュ/バックエンド/bcacheデバイス)

- 運用モード(ライトバック/ライトスルー)と、直近の構成変更や作業履歴

- 影響範囲(どのサービス、どのデータ領域、どの利用者に波及しているか)

- 「止められるもの/止められないもの」(バッチ、同期処理、ジョブ、夜間処理など)

この5点が揃うと、現場の疲弊を増やす“試行錯誤”が減り、説明のための追加作業も減ります。結果として、復旧作業そのものの品質も上がりやすいです。

初動でよくある判断ミスを防ぐための「操作の温度感」

障害対応では、操作を「観測中心(状態を変えにくい)」「影響が出やすい(状態が変わる可能性がある)」に分けて考えると、焦りが減ります。ここでは具体的な修理手順ではなく、温度感の整理に留めます。

| 分類 | 目的 | 代表的な注意点 | 現場での使いどころ |

|---|---|---|---|

| 観測中心 | 状況を固定し、説明可能性を上げる | 情報が散らばると会話が前に進まない | まずやる。相談にも直結する |

| 影響が出やすい | 復旧を前に進める | 状態が変わり、切り戻しや説明が難しくなることがある | 影響範囲と合意ができてから |

本番データ・共有ストレージ・コンテナ・監査要件が絡む構成では、影響が出やすい操作ほど「正解が構成依存」になります。一般論のテンプレだけで押し切ると、現場の手戻りが増え、関係者調整も増えます。

この段階で迷いが出る場合は、状況の材料を揃えたうえで株式会社情報工学研究所へ相談を検討する方が、結果として軟着陸しやすいことが多いです。相談先:問い合わせフォーム / 電話 0120-838-831

次章では、最初の30秒で「SSD故障か」「バックエンド不整合か」「メタデータか」を切り分けるために、現場で見えるサインを整理します。

第5章:30秒トリアージ:SSD故障か、バックエンド不整合か、メタデータ破損か

bcache障害の初動で、時間を最も奪うのは「どこが悪いのか分からない状態」です。関係者は“直してほしい”と言うが、現場は“触るほど状態が変わるかもしれない”と感じる。ここで必要になるのが、短時間で争点を絞るトリアージです。

トリアージのコツは、完璧な特定ではなく「次にやるべきことが変わる境界」を引くことです。境界が引ければ、最小変更で観測を増やすのか、影響範囲を固めて相談に寄せるのか、判断が進みます。

まずは「キャッシュ(SSD)起因」を疑うサイン

SSD起因の可能性が上がるのは、エラーがSSD側のデバイス名に寄る、再起動や負荷で症状が急に増減する、短時間にI/Oエラーが集中する、といった傾向が見えるときです。NVMe/SSDは、内部でリトライが増えると遅延が大きく跳ねることがあり、結果として上位のタイムアウトやフリーズとして観測されることがあります。

また、ケーブルやポートなど接続要因が絡むと、発生が“断続的”になりやすく、現場が最も混乱します。ここでは「SSDが悪いと断定」するのではなく、SSD側を触る前に、ログの対象デバイスと時系列が揃っているかを優先します。

次に「バックエンド(HDD/RAID/LVM)起因」を疑うサイン

バックエンド起因を疑うサインは、RAIDの劣化やリビルド、特定ディスクの遅延、I/O待ちの増大などが背景にあり、キャッシュを抜いても根本が解消しないような見え方をする場合です。バックエンドが遅くなると、bcacheの“裏側”が詰まり、結果として全体が重くなることがあります。

ここで重要なのは、bcacheの存在が“本体の問題を隠している”可能性です。キャッシュがあるために普段は症状が出ないが、バックエンドが悪化した瞬間に一気に表面化する。こういうケースでは、bcacheだけに焦点を当てると判断が遅れます。

最後に「メタデータ(関連付け/状態)起因」を疑うサイン

メタデータ起因を疑うのは、キャッシュとバックエンドの“対応関係が曖昧”になっているときです。例えば、交換や構成変更の履歴があり、どのSSDがどのバックエンドに紐づくのかが現場の記憶頼りになっている場合、判断の根拠が崩れやすくなります。

この状態で、雰囲気で再構成や初期化に踏み込むと、後から「正しい組み合わせを復元する」手がかりが減ります。メタデータが絡むときほど、観測情報を“保存できる形”にしてから次へ進む方が安全です。

トリアージの結果を「関係者に伝わる形」にする

トリアージは現場だけで完結しません。上司・役員・他チームへ、同じ絵を見せる必要があります。ここで効くのは、3択(SSD/バックエンド/メタデータ)のどれが濃いか、そして“次の判断に必要な追加材料”を明確にすることです。

| 争点 | 次に必要な材料 | 判断が早くなる理由 |

|---|---|---|

| SSD(キャッシュ) | ログの対象デバイスと時系列、物理兆候の有無、負荷との相関 | 交換・切り離しのリスク判断ができる |

| バックエンド | RAID/LVM/FSの状態、遅延の分布、上位サービスの影響範囲 | bcacheに引きずられず本体を見に行ける |

| メタデータ | デバイス対応関係メモ、作業履歴、現状の保存(ログ/一覧) | 誤操作の確率を下げられる |

ここまで整理しても「自社でどこまで触るべきか」が決まらない場合、一般論の延長で頑張るより、個別構成として相談した方が早いことが多いです。bcacheは構成依存度が高く、RAID/LVM/暗号化/DB/コンテナが絡むほど、判断の筋道が重要になります。相談先:問い合わせフォーム / 電話 0120-838-831

次章では、影響範囲を短時間で見える化し、「どこまでがストレージの問題で、どこからがサービスの問題か」を切り分けていきます。

第6章:影響範囲の見える化:どのLV/FS/サービスが巻き込まれているか

障害対応が炎上しやすいのは、技術が足りないからではなく「影響範囲の会話」が噛み合わないからです。現場は“このデバイスが怪しい”と言い、業務側は“どの画面が止まるのか”を聞く。上司は“復旧見込みとリスク”を求め、監査やセキュリティ担当は“証跡と再発防止”を求めます。

bcache障害では、影響範囲の見える化が特に効きます。キャッシュとバックエンドの二重構造があるため、「見えている障害」と「本当に止まるもの」がズレることがあるからです。ここでの目的は、復旧手順を進めることではなく、状況をクールダウンさせ、意思決定の土台を作ることです。

影響範囲を“レイヤごと”に切って把握する

影響範囲は、下から上へレイヤで整理すると早く揃います。ストレージ層→論理層→ファイルシステム層→サービス層の順に、「どこまでが安全に言えるか」を積み上げるイメージです。

| レイヤ | 確認対象 | 関係者に伝わる言い方 |

|---|---|---|

| ストレージ層 | SSDキャッシュ、バックエンドのデバイス状態、エラー頻度 | 「物理・下位層の不安定さが見えている」 |

| 論理層 | RAID/LVM/暗号化の構成、対象ボリューム | 「どの領域が巻き込まれ得るか」 |

| ファイルシステム層 | マウントポイント、read-only化、エラーの有無 | 「読み書きできる範囲とできない範囲」 |

| サービス層 | DB/アプリ/コンテナ/ジョブ/共有領域の依存関係 | 「止まる業務、止められない業務、代替手段」 |

コンテナ・共有ストレージ・本番DBが絡むと「影響範囲」が広がりやすい

bcacheの対象が単体サーバのローカル領域なら、影響範囲は比較的閉じます。しかし、共有ストレージや複数ノードで参照される領域、あるいはコンテナの永続ボリュームや本番DBが絡むと、影響範囲は一気に広がります。このとき、ストレージ層の判断だけで突っ走ると、サービス側の二次障害(タイムアウト連鎖、再試行嵐、ログ肥大)で状況が悪化することがあります。

ここで役立つのは「止められる書き込み」を先に特定することです。例えば、夜間バッチ、定期同期、再試行が激しいジョブ、ログ集約などは、ストレージが不安定なときほど書き込みを増やし、状況を騒がしくします。まずは“ノイズカット”して、観測ができる状態に整える方が、復旧判断も説明も前に進みます。

上司・役員に通る「状況説明」の最小セット

現場の苦しさは「説明に時間がかかる」ことでも増えます。ここでは、短い文章で通る説明の骨子を作っておくと、社内調整の摩擦が減ります。

- 何が起きているか:bcache配下のストレージI/Oが不安定で、性能劣化またはI/Oエラーが観測されている

- どこまで影響しているか:対象マウントポイントと依存サービス(DB/コンテナ/共有領域)に影響が出ている可能性がある

- 何を優先するか:被害最小化(書き込み増の抑制)と影響範囲の確定を先に行い、復旧手順は合意後に進める

- 次の判断に必要なもの:ログの時系列、デバイス対応関係、運用モード、構成情報

この説明ができる状態まで整うと、現場は“やみくもに触る”圧力から解放されやすくなります。そして、個別構成に応じた判断が必要なら、ここから株式会社情報工学研究所へ相談することで、復旧の筋道を具体化しやすくなります。相談先:問い合わせフォーム / 電話 0120-838-831

次章では、ライトバック/ライトスルーの違いが、障害時の優先順位をどう変えるかを整理し、判断ミスを減らすための分岐を作っていきます。

第7章:ケース別の安全な分岐:ライトバック/ライトスルーで変わる優先順位

bcache障害の判断を難しくする要因のひとつが、運用モードによって「守るべきものの順序」が変わる点です。ライトスルー(writethrough)は、書き込みが先にバックエンドへ反映されやすく、整合性のリスクが相対的に低くなります。一方、ライトバック(writeback)は、書き込みをキャッシュ側へ先に受けるため性能は出やすい反面、障害時にキャッシュ側へ未反映の書き込みが残り得ます。この差が、障害対応の優先順位を大きく左右します。

ライトスルーに寄った運用で意識したい「見落とし」

ライトスルー運用では「最悪でもバックエンドに書き込みが残る」という期待が生まれやすく、現場の心理としても強気になりがちです。ただし、バックエンド側が劣化していた場合、キャッシュが“緩衝材”になっていた分だけ、障害が表面化したときに一気に遅延やエラーが増えることがあります。つまり、ライトスルーだから安全というより「どの層が詰まっているか」を見誤らないことが重要になります。

このケースでの優先順位は、(1) バックエンドの状態悪化が主因かどうか、(2) 影響範囲がどこまで波及しているか、(3) 追加変更が二次障害(タイムアウト連鎖や再試行嵐)を招いていないか、の順で整理すると腹落ちしやすいです。

ライトバック運用で最初に押さえたい「説明責任」

ライトバック運用では、障害時に「未反映の書き込み(dirty)」の存在が焦点になります。キャッシュ側が不安定な状態で書き込みが増えると、整合性の不確実性が上がり、復旧後に「どの時点のデータが正しいと言えるか」の説明が難しくなりがちです。ここで求められるのは、復旧の速さだけでなく、関係者が納得できる筋道です。

ライトバックの障害では、現場が抱える本音として「直したいが、触るほど怖い」が出やすくなります。このとき、一般論の“修復の手順”を追うよりも、被害最小化を優先して状況を落ち着かせ、影響範囲と判断材料を揃えてから次へ進む方が、結果として軟着陸しやすい場面が多いです。

分岐を「会話に乗る形」に落とすための整理表

現場の議論が過熱しやすいのは、同じ言葉でも人によって指している範囲が違うときです。ライトバック/ライトスルーの違いを、関係者に共有しやすい形に落とすと、意思決定が前に進みやすくなります。

| 観点 | ライトスルー(writethrough)寄り | ライトバック(writeback)寄り |

|---|---|---|

| 障害時の主要リスク | バックエンド劣化の表面化、遅延やタイムアウト連鎖 | 未反映の書き込みが残り得ることによる整合性の不確実性 |

| 最初に揃えたい材料 | RAID/LVM/FSの状態と、サービスへの波及状況 | dirtyの有無に関する状況説明、直前の電源断やパニック等の履歴 |

| 判断が難しくなる条件 | 多層構造(RAID/LVM/暗号化)と多数サービス依存 | 共有ストレージ、コンテナ、本番DB、監査要件が絡む |

「やらない判断」へ自然につなげる依頼判断の基準

bcache障害の分岐で大切なのは、技術的に可能かどうかではなく、個別案件としてのリスクと説明責任に見合うかどうかです。特に、ライトバック運用かつ本番データ・共有ストレージ・コンテナ・監査要件が絡む場合、一般論の手順だけで判断するのは危うくなりやすいです。迷いが出た時点で、材料を揃えて株式会社情報工学研究所への相談を検討する流れが、収束を早めることが多いです。相談先:問い合わせフォーム / 電話 0120-838-831

次章では、復旧作業を“勢い”で進めず、複製・解析・切り戻しを前提に設計する考え方を整理します。

第8章:復旧作業の設計:複製・解析・切り戻しを前提にした手順の組み立て

bcache障害の復旧で成果を分けるのは、個々のコマンド知識よりも「作業を設計できているか」です。とくに、レガシーで止められない環境ほど、現場は短時間で成果を出す圧力を受けます。しかし、勢いで進めると、状態が変わってしまい、切り戻しが難しくなったり、説明責任が果たせなくなったりします。

そこで、復旧作業を“工程”として捉え直します。基本は、(1) 状況を固定する、(2) 可能なら複製で逃げ道を作る、(3) 解析で根拠を増やす、(4) 切り戻しを前提に段階的に進める、という流れです。これは過剰に慎重という意味ではなく、被害最小化と収束を両立するための現実的な設計です。

複製を「保険」ではなく「判断材料」として扱う

ストレージ障害の現場では、複製は安心のためだけにあるのではなく、判断を速めるためにあります。複製できる範囲が分かれば、影響範囲を定量化できますし、複製の途中でエラーが出るなら、どの層が不安定かの手がかりにもなります。

bcache障害では、キャッシュとバックエンドが絡むため、複製の単位(どのブロックデバイスを対象にするか)が構成依存になります。RAID/LVM/暗号化が積み重なっている場合、一般論の「ここを複製すれば良い」が当てはまらないこともあります。だからこそ、複製を前提にするほど、構成の棚卸し(対応関係と依存関係)が重要になります。

解析の目的は「原因特定」より「安全な分岐」を作ること

現場では、原因を100%特定したくなります。しかし、bcache障害の最中にそれを狙うと、観測が増える一方で時間が消え、状況が悪化してしまうことがあります。解析の目的は、まず「次に進める安全な分岐」を作ることです。

例えば、SSD(キャッシュ)側の物理兆候が強いのか、バックエンド側の遅延が主因なのか、メタデータ起因で紐づけが曖昧なのか。この3択のどれが濃いかが分かれば、以降の作業設計(どこまで自社で触るか、いつ相談するか)が決めやすくなります。

切り戻し前提の「段階設計」が、結果として速い

切り戻しは、失敗のための仕組みではなく、成功確率を上げるための仕組みです。段階設計の意識があると、作業の一手一手が「戻れる範囲」に収まるようになり、関係者への説明も簡潔になります。

また、bcache障害では“関係者調整”が作業時間の多くを占めがちです。段階設計で「ここまでなら安全に言える」「ここから先は影響が広がる可能性がある」という線を引けると、社内の合意形成が進み、現場の疲弊が減ります。結果として、復旧に割ける時間と集中が戻り、収束が早くなりやすいです。

個別案件で一般論が外れやすいポイント

bcacheは、単体の仕組みとしては理解しやすくても、実運用では上位が複雑になりがちです。次のような条件が重なると、一般論の“正解”が外れやすくなります。

- バックエンドがRAID劣化やリビルド中で、I/O遅延が時間帯で変動する

- LVMや暗号化が挟まり、どの層のエラーがどこに波及しているか分かりにくい

- コンテナやVMが多数ぶら下がり、再試行やログが書き込みを増やす

- 監査要件があり、作業の根拠と証跡が後から求められる

この条件に当てはまるほど、「自社で復旧を完結させる」より「個別構成として安全な分岐を作る」方が成果につながりやすいです。迷いが出た時点で、材料を整理して株式会社情報工学研究所へ相談する流れが自然です。相談先:問い合わせフォーム / 電話 0120-838-831

次章では、再発防止の観点から、監視・交換基準・メンテ手順をどう設計すると“同じ苦しさ”が減るかを整理します。

第9章:再発防止と運用:監視項目、交換基準、メンテ手順のドキュメント化

bcache障害は、復旧が終わっても「また起きるのでは」という不安が残りやすい類型です。SSDキャッシュの寿命、バックエンドの劣化、運用モード、そして多層構造の依存関係が絡むため、再発防止は“1つの対策”では完結しにくいからです。だからこそ、現場の負担を減らすには、監視・交換基準・メンテ手順をセットで整えるのが現実的です。

監視は「壊れてから気づく」ではなく「温度を下げる」ために使う

監視の価値は、アラートを鳴らすことそのものではなく、状況が悪化する前に“抑え込み”の判断ができる点にあります。bcacheでは、キャッシュ側とバックエンド側で劣化のサインが異なり、どちらか一方だけを見ていると判断が遅れます。

現場で効きやすいのは、以下のように「レイヤ別」で監視観点を持つことです。

| レイヤ | 監視観点(例) | 早めに効く理由 |

|---|---|---|

| SSDキャッシュ | 寿命指標、媒体エラー、I/O遅延の増加傾向 | 断続障害の兆候を拾いやすい |

| バックエンド | RAID劣化、遅延、リビルド状況、タイムアウト傾向 | キャッシュの裏で進む悪化を見逃しにくい |

| 上位サービス | タイムアウト増、再試行回数、ログ肥大、ジョブ遅延 | 二次障害の拡大を抑え込める |

交換基準は「壊れたら交換」ではなく「判断の摩擦を減らす」ために置く

SSDキャッシュの交換は、技術的な作業以上に、社内調整の摩擦がボトルネックになりがちです。「まだ動いている」「止められない」「でも怖い」という状態を繰り返すと、現場の疲弊が積み上がります。交換基準を文書化する価値は、判断を人の感覚から切り離し、合意のコストを下げられる点にあります。

基準は、厳密である必要はありません。大切なのは、現場が説明でき、上司が判断できる形になっていることです。たとえば、寿命指標の閾値、I/Oエラーの頻度、遅延の傾向、障害の再現性など、複数の条件を組み合わせると納得が取りやすくなります。

メンテ手順のドキュメント化は「属人化」をほどく

bcacheを採用している現場は、何らかの性能・コスト事情を抱えていることが多く、構成は一度決まると長く使われやすい傾向があります。その結果、「作った人だけが分かる」状態になりやすく、障害時の説明が難しくなります。ここをほどくのがドキュメントです。

ドキュメントは分厚い設計書でなくても、次の2枚があるだけで救われます。1枚目は構成図(SSDキャッシュ、バックエンド、RAID/LVM/暗号化、マウントポイント、依存サービス)。2枚目は障害時の“争点の絞り方”(SSD/バックエンド/メタデータの三択と、影響範囲の見える化)。この2枚があれば、初動で状況を落ち着かせるまでの速度が上がりやすいです。

一般論の限界と、個別案件としての最短ルート

再発防止は、一般論のチェックリストを並べるだけでは不十分になりがちです。なぜなら、bcacheは「どの層がボトルネックか」「運用モードをどう設計するか」「上位サービスがどう依存しているか」で正解が変わるからです。さらに、監査要件や情報漏洩対策、BCPの観点が絡むと、単なる性能設計では済まなくなります。

現場の悩みが「具体的な案件・契約・システム構成」に近づくほど、一般論の限界が見えてきます。その局面では、状況を整理したうえで株式会社情報工学研究所への相談・依頼を検討する流れが自然です。単に直すだけでなく、現場の説明可能性、セキュリティ、BCPまで含めて“収束”させる設計が必要になるためです。相談先:問い合わせフォーム / 電話 0120-838-831

次章では、全体を結論としてまとめ、復旧と説明責任を両立するための考え方を帰結させます。

第10章:帰結:bcache障害は「復旧技術」より「判断設計」で収束が決まる

bcacheは、SSDキャッシュで現場の体感を変えられる一方、障害時には「キャッシュ」「バックエンド」「メタデータ」という三重構造が、判断を難しくします。現場は、止められないシステムを抱えながら、上司や役員に状況を説明し、場合によっては監査やセキュリティ要件にも応えなければなりません。ここで必要になるのは、華やかな復旧テクニックよりも、最小変更で状況を落ち着かせ、影響範囲を固め、筋道のある判断を積み上げる設計です。

この10章で積み上げた「収束のための型」

本記事で一貫して扱ってきたのは、作業の速さを競うための手順ではなく、被害最小化と説明可能性を両立するための型です。型があると、現場の負担が減り、関係者の意思決定も前に進みます。

| 局面 | やること(安全な初動) | 狙い |

|---|---|---|

| 混乱が始まった直後 | 書き込みを増やしそうな要因を抑え、現象の時系列・頻度・対象を揃える | 状況のクールダウンと説明可能性の確保 |

| 争点が割れそうなとき | SSD/バックエンド/メタデータの3択で境界を引き、次の判断に必要な材料を明確化 | 議論の過熱を抑え込み、合意形成を進める |

| 復旧を進める前 | 影響範囲(LV/FS/サービス依存)を見える化し、止められる書き込みを優先的に減らす | 二次障害を抑え、復旧判断の精度を上げる |

| 本番・監査が絡むとき | 一般論で押し切らず、個別構成として相談・依頼の判断を早める | 手戻りと説明コストを減らし、軟着陸を狙う |

よくある落とし穴:復旧の成功より「説明できない成功」が後で苦しくなる

現場では、結果としてサービスが動けば「成功」に見えます。しかし、bcache障害は、復旧の後に「データが部分的に欠けた」「ある時点の変更だけが抜けた」「なぜこうなったのか説明できない」といった形で、遅れて問題が出ることがあります。これは、現場の腕が悪いというより、キャッシュとバックエンドの関係や運用モードにより、整合性の扱いが個別案件になりやすい構造があるためです。

だからこそ、復旧の判断は「何を根拠に安全と言えるか」「どこまで影響があると言えるか」を同時に考える必要があります。ここに、一般論だけでは埋められないギャップが生まれます。

一般論の限界:bcacheは“周辺条件”で正解が変わる

bcache単体の理解だけでは、実運用の判断に届かない場面が多くあります。RAID/LVM/暗号化/ファイルシステム/DB/コンテナ、さらに監査要件や情報漏洩対策、BCPの前提が絡むと、同じ症状でも優先順位が変わります。特に、共有ストレージや複数サービスが同じ領域に依存する構成では、ひとつの操作が広い範囲へ波及し得ます。

この段階になると、「自社でやり切るかどうか」よりも、「最小変更で被害最小化し、説明可能性を確保しながら収束させられるか」が論点になります。現場の本音として、移行コストや追加トラブルを増やしたくないからこそ、ここは個別案件として判断した方が、結果的に楽になることが多いです。

相談・依頼が自然に効くタイミング

次のような条件が重なる場合、一般論の手順を追うより、状況整理の時点から株式会社情報工学研究所への相談・依頼を検討することで、収束が早くなることが多いです。

- ライトバック運用で、整合性(未反映の書き込み等)の説明が必要になりそうなとき

- バックエンドがRAID/LVM/暗号化などで多層化し、影響範囲の見積りが難しいとき

- コンテナ/VM/共有領域が絡み、二次障害(再試行やログ肥大)が出やすいとき

- 監査要件や顧客説明があり、作業の根拠と証跡が後から求められるとき

- 「止められない」前提で、短時間に意思決定と調整を通す必要があるとき

相談先:問い合わせフォーム / 電話 0120-838-831

bcache障害は、単に復旧するだけでなく「現場が納得して運用へ戻る」ことまで含めて完了です。そのために必要なのは、現場エンジニア視点で、最小変更と影響範囲を軸に設計された支援です。具体的な案件・契約・システム構成で悩んだときは、株式会社情報工学研究所への相談・依頼を検討することが、結果として手戻りと消耗を減らしやすい選択になります。

付録:主要プログラミング言語別「障害対応スクリプト」の注意点(書き込み増を抑える観点)

bcache障害の最中は、監視・収集・自動復旧のスクリプトが、善意で状況を悪化させることがあります。特に、再試行ループ、詳細ログの大量出力、状態確認のつもりの書き込み、テンポラリ生成などが重なると、ストレージが不安定なときほど“書き込み増”につながります。ここでは、言語ごとに起こりがちな落とし穴を整理します。

Bash / Shell(sh, bash, zsh)

- パイプやリダイレクトでログを大量に追記し続けると、状況が悪いときほどI/Oを増やしやすい

- while ループの再試行が短すぎると、復旧待ちではなく“負荷の固定化”になることがある

- grep/sed/awkの繰り返しで同じファイルを何度も読み書きし、現象の揺れを増幅することがある

- 一時ファイル(/tmp)への出力が増えると、想定外の書き込み源になる

Python

- ログを詳細化しすぎると、例外スタックやデバッグ情報が高頻度で出力され、書き込み増になりやすい

- requests等のリトライやバックオフの設定が強すぎると、障害中に“再試行嵐”が起きやすい

- 並列処理(threading/multiprocessing/asyncio)で同時に観測を走らせると、I/O待ちが増えて症状が読みにくくなる

- テンポラリ生成、キャッシュ書き込み、SQLiteの自動更新などが、観測のつもりで状態を変えることがある

Go

- goroutineで無自覚に並列化が進み、短周期の監視・収集がI/Oを押し上げることがある

- contextのタイムアウト設定が短いと、失敗→即再試行のループになりやすい

- ログ出力が高速な分、抑制しないと短時間で大量の追記が発生しやすい

Java / Kotlin(JVM系)

- GCやJITの揺れでタイミングが変わり、障害の観測が“ノイズ”として増えることがある

- ログフレームワークの非同期書き込みが、障害時にバッファフラッシュで書き込み増になりやすい

- スレッドプールの再試行設計が甘いと、失敗が加速して二次障害が拡大しやすい

JavaScript / Node.js

- 非同期I/Oで同時に大量の観測を走らせ、短時間にファイル追記が集中しやすい

- watch系(ファイル監視)や自動再起動が、障害中にリトライを増幅することがある

- JSONログの肥大化で、ディスク書き込みと解析負荷が同時に上がりやすい

Ruby

- 例外ログが長くなりがちで、障害時に大量追記が起きやすい

- ジョブ基盤(Sidekiq等)の再試行設定が強いと、短時間の再投入で負荷が固定化しやすい

- テンポラリ生成やキャッシュ更新が、観測目的の処理でも書き込み源になりやすい

PHP

- エラーログの出力先がローカルディスクの場合、障害時にログ肥大が二次障害になりやすい

- セッション保存やキャッシュ更新が集中すると、ストレージ不安定時にタイムアウトと再試行が連鎖しやすい

- 監視や保守スクリプトの定期実行(cron)が重なると、書き込みが増えて収束が遅れやすい

C / C++

- エラー処理が不足すると、失敗時に無限ループや過剰再試行へ落ちやすい

- fsyncやバッファリングの扱い次第で、意図せず書き込みが増えることがある

- 並列I/Oの実装が強すぎると、障害時にI/O待ちが悪化し観測が読みにくくなる

Rust

- 堅牢に作りやすい一方、並列化(async/await)を強く使うと短周期の観測が増えやすい

- エラー処理が細かく書ける分、ログ出力が過剰になると書き込み源になりやすい

- リトライ設計を誤ると、堅牢さが“再試行の増幅”に変わることがある

PowerShell

- ログやトレースの出力がファイル追記に寄ると、障害時にI/Oを増やしやすい

- リモート操作で再試行を強くすると、ネットワーク遅延とディスク遅延が同時に増幅しやすい

- 管理系コマンドが大量に走ると、イベントログ等への記録が増えやすい

SQL(運用クエリ・メンテスクリプト)

- 障害中の集計やフルスキャンがI/Oを押し上げ、ストレージの不安定さを悪化させることがある

- VACUUM/OPTIMIZE等のメンテが書き込み増につながり、状況が落ち着く前に走ると負担が大きい

- 再試行ロジックと組み合わさると、失敗時にトランザクションが積み上がりやすい

IaC / 運用自動化(Terraform, Ansible, Kubernetes YAML等)

- 自動適用が走ると、障害中に“状態を変える操作”が混ざりやすい

- ローリング更新や再スケジュールが、ログ増・再試行増を引き起こし二次障害になりやすい

- 監査要件が絡む環境では、適用の根拠と差分の管理が不十分だと説明コストが跳ねやすい

付録のまとめ:自動化は「復旧を早める」より「被害最小化に寄せる」と強い

障害時の自動化は、復旧を自動で完結させるためではなく、状況を落ち着かせるために使う方が成果につながりやすいです。短周期の再試行、詳細ログの大量追記、状態を変えるメンテ処理が混ざると、bcache障害の最中は収束が遅れやすくなります。現場の負担を増やさず、最小変更で影響範囲を固め、判断材料を揃える設計が重要です。

具体的な案件・契約・システム構成で悩むほど、一般論では線が引きにくくなります。その段階では、株式会社情報工学研究所への相談・依頼を検討することで、復旧だけでなく説明可能性と再発防止まで含めた軟着陸を狙いやすくなります。相談先:問い合わせフォーム / 電話 0120-838-831

もくじ

- 第1章:速さのために入れたbcacheが、障害時には不安を倍増させる

- 第2章:まずやることは「現状の凍結」:書き込みを増やさず状態を確認する

- 第3章:bcacheの基本構造を再確認:backing / cache / superblock / UUID

- 第4章:症状から切り分ける:bcacheデバイス消失、read-only化、I/Oエラー

- 第5章:収集すべき一次情報:dmesg、lsblk、/sys/fs/bcacheの読み方

- 第6章:writebackの伏線:dirtyデータが残ると“キャッシュが本体”になる

- 第7章:復旧ルートA:キャッシュを迂回してbackingだけでサービスを立ち上げる

- 第8章:復旧ルートB:cacheの再登録・再構築で性能を取り戻す(安全な手順)

- 第9章:それでも読めない時の最終手段:イメージ取得とオフライン解析・復元

- 第10章:帰結:速さと復旧性は両立できる—監視・運用ルール・相談窓口まで設計する

【注意】本記事は、Linux bcache(SSDキャッシュ)障害時に一般的に推奨される“被害最小化(ダメージコントロール)”と復旧の考え方を整理した情報提供です。実際の最適解は、キャッシュモード(writeback等)・暗号化(LUKS)・LVM/RAID/仮想化・アプリ特性・復旧期限/予算で大きく変わります。重要データが関わる場合は、判断を誤ると不整合や上書きが進んで復旧難易度が上がるため、個別案件として株式会社情報工学研究所のような専門事業者へ相談してください。

第1章:速さのために入れたbcacheが、障害時には不安を倍増させる

「SSDを足して速くしたのに、いざ壊れたら“どっちが本体?”って話になるの、正直つらいですよね。」

bcacheは、HDDなどの遅いブロックデバイス(backing)を、SSDなどの高速デバイス(cache)でキャッシュしてI/Oを改善する仕組みです。運用がハマると体感は大きく変わりますが、障害時は“速さの代償として状態が増える”ため、切り分けと復旧の順番を間違えると一気に厄介になります。

bcache障害が難しく見える理由

bcacheの難しさは、単にデバイスが2つになるからではありません。障害時の意思決定に直結する「状態」が増えるのがポイントです。

| 要素 | 意味 | 障害時の論点 |

|---|---|---|

| backing(HDD等) | “本来の格納先” | 単体で読めるか/ファイルシステムが壊れていないか |

| cache(SSD等) | キャッシュ領域(場合により“未反映データ”を保持) | writeback時にdirtyデータが残ると、SSD側が実質的に“最新”になる |

| キャッシュモード | writethrough / writeback 等 | writebackは性能が出るが、障害時に整合性リスクが跳ね上がる |

| 登録/紐付け情報 | superblockやUUIDによる対応付け | 誤って別SSDを紐付けると、破壊的な上書きにつながりうる |

「不安を倍増させる」典型症状

現場でよく起きるのは、次のような“状況はわかるが、どこから触るべきか迷う”パターンです。

- 突然 /dev/bcache0 が消えた、または認識が不安定になった

- バックエンド(HDD)は見えるのに、マウントが通らない/read-onlyになった

- カーネルログに bcache / I/O error / timeout が連発する

- SSDを交換したいが、交換が“破壊的”にならないか怖い

ここで大事なのは、いきなり「直す」ではなく、まず“被害最小化(ダメージコントロール)”の姿勢に切り替えることです。bcache障害では、復旧が難しくなる最大の要因は「追加の書き込み」です。SSD/HDDのどちらかが不安定な状態でリカバリ操作をすると、上書きや不整合が進み、取り返しがつかなくなることがあります。

この章のまとめ(次章への伏線)

bcache障害で最初に決めるべきは「性能回復」ではなく「整合性の保全」です。次章では、そのための最初の一手――“現状の凍結”と、触ってよい順番/触ってはいけない順番を整理します。

第2章:まずやることは「現状の凍結」:書き込みを増やさず状態を確認する

「直したい。でも、直そうとして触った瞬間に悪化しそうで手が止まる。」

この感覚は正常です。bcache障害は“手当て”がそのまま“上書き”になり得ます。最初にやるべきは、状態を固定して、増え続ける変数を止めることです。

優先順位:サービス継続より、まず整合性

もちろん止められないシステムは多いです。ただし、bcache障害で「とりあえず再起動」「とりあえずfsck」「とりあえずキャッシュ再作成」に走ると、後から取り戻せるものが減ります。優先順位の考え方を、まず言語化しておきます。

| 優先 | 目的 | 具体例 |

|---|---|---|

| 1 | 追加書き込みを止める | アプリ停止、マウント解除、可能ならread-only化 |

| 2 | 一次情報を採取する | dmesg/journalctl、lsblk、bcacheのsysfs情報 |

| 3 | 復旧ルートを選ぶ | cache迂回で暫定復旧/キャッシュ再登録/オフライン復元 |

| 4 | 性能・再発防止 | 監視・閾値・交換手順・運用ルールの整備 |

“凍結”の実務:まずは書き込み経路を止める

環境差が大きいので、ここでは「一般に安全側に倒す方針」と「代表的な手段」を示します。実行は必ず現場の構成(LVM/RAID/暗号化/仮想化)を確認した上で行ってください。

- アプリケーション停止:DB、メッセージキュー、検索基盤など、書き込みを継続するプロセスを停止します。

- マウント解除:可能ならアンマウントします。難しい場合は一時的に read-only へ remount を検討します。

- 自動修復の抑制:ブート時の自動fsckや、管理ツールによる自動リカバリが走らないよう注意します。

特に注意したいのは、writeback運用でdirtyデータが残っている可能性です。この場合、キャッシュ(SSD)側に“まだbackingへ書かれていない最新ブロック”が存在し得ます。つまり「SSDが壊れたからSSDを切り離してHDDだけで起動しよう」が、結果としてデータの巻き戻りや論理不整合を招く可能性があります。

「再起動していいか?」の判断軸

「再起動すれば直るかも」は誰でも思います。ただ、bcache障害では再起動が“ログと状態を流してしまう”ことがあります。判断の軸は次の通りです。

- カーネルログ(dmesg/journalctl -k)を採取済みか

- 現在のブロック構成(lsblk、/dev/disk/by-id、LVM/MDの状態)を控えたか

- キャッシュSSDの状態(SMARTなど)を確認できる段取りがあるか

- 再起動後に自動fsckや自動マウントが走って書き込みが発生しないか

この段取りが揃っていないなら、先に情報採取を優先するのが安全側です。

この章のまとめ(次章への伏線)

凍結のゴールは「直すこと」ではなく「これ以上悪くしないこと」です。次章では、bcacheの構造(superblock/UUID/キャッシュセット)を、障害対応の視点で“必要な分だけ”整理し、一次情報の読み方を揃えます。

第3章:bcacheの基本構造を再確認:backing / cache / superblock / UUID

「bcacheって、結局どこに“真実”があるんだっけ?」

この問いに答えられないまま操作すると、誤った紐付けや誤った初期化につながります。ここでは、復旧で必要になる構造だけを押さえます。

最低限おさえる用語

- backing device:元データを持つブロックデバイス(例:HDDのパーティション、RAID/LVMの論理ボリュームなど)

- cache device:キャッシュに使うブロックデバイス(例:SSDのパーティション)

- cache set:キャッシュデバイス群の集合(UUIDで識別される)

- bcache device:OSから見える“合成された”デバイス(例:/dev/bcache0)

- superblock:cache/backingそれぞれに書かれるメタ情報(UUIDや役割などを保持)

「間違えやすいポイント」:UUIDは複数ある

障害対応で混乱しがちなのが、識別子が複数ある点です。代表的には、キャッシュセットUUID(cache set UUID)と、backing側に紐付くUUID(bcache device UUID)が登場します。ここを取り違えると、attach/detachの操作対象を誤ります。

| 識別子 | 何を指すか | どこで見るか(代表例) |

|---|---|---|

| cache set UUID | キャッシュ側(SSD)の集合 | /sys/fs/bcache/ 配下、またはsuperblock情報 |

| bcache device UUID | 合成デバイス(/dev/bcacheX)に紐付く単位 | /sys/block/bcacheX/bcache/ 配下、またはsuperblock情報 |

| 通常のFS UUID | ext4/xfs等のファイルシステム識別子 | blkid、/dev/disk/by-uuid/ |

一次情報の取り方:何を控えるべきか

復旧方針を決める前に、まず“現状の地図”を作ります。ここでの目的は、あとから再現できる形で状態を記録することです。

- ブロック構成:lsblk(ツリー構造)、blkid(UUID)、/dev/disk/by-id(物理対応)

- カーネルログ:dmesg(bcache/I/O error/timeout)、journalctl -k(再起動跨ぎの確認)

- bcacheのsysfs:/sys/block/bcache*/bcache/ と /sys/fs/bcache/(attach状態やモード)

- SSDの健康状態:SMART、NVMeログ(読める範囲で)

特に、/dev/disk/by-id を使って「どの物理SSD/HDDが、どのパーティションとして認識され、どのbcacheに関与しているか」を控えるのは重要です。障害時はデバイス名(/dev/sda等)が再起動で入れ替わることがあるため、後から追えなくなる事故が起きがちです。

この章のまとめ(次章への伏線)

bcacheは「合成デバイス」と「紐付け情報(UUID)」がセットで初めて成立します。次章では、実際に発生しやすい症状(消失、read-only化、I/Oエラー)を“ログと状態”から切り分け、どの復旧ルートに乗るべきか判断できるようにします。

第4章:症状から切り分ける:bcacheデバイス消失、read-only化、I/Oエラー

bcache障害は、症状が似ていても原因が違うことが多いです。ここでは“見え方”ではなく、何が壊れている可能性が高いかを、ログと状態から切り分ける観点を整理します。

パターンA:/dev/bcache0 が消える・作られない

このパターンでは、以下の原因が典型です。

- cache/backingデバイスが認識されていない(物理障害、ケーブル、コントローラ、PCIe不調など)

- superblock情報が読めない/破損している

- 起動順やinitramfsの都合で、bcache登録が行われていない

重要なのは、「見えない」=「初期化する」ではないことです。superblockが読めない可能性がある状況での初期化操作は、復旧の余地を消します。まずはデバイス自体がOSに見えているか、ログにI/Oエラーが出ていないかを確認します。

パターンB:read-onlyになった/書き込みだけ失敗する

read-only化は、ファイルシステム側(ext4/xfs等)が整合性保護でread-onlyに落ちる場合もあれば、下層I/Oが不安定で上位が諦めた結果の場合もあります。ここでの勘所は、「どこがread-onlyなのか」を分けることです。

| read-onlyの対象 | 確認の観点 | 示唆 |

|---|---|---|

| ファイルシステム | mount表示、FSログ | FS整合性問題(ただし下層I/O不調が原因のことも多い) |

| ブロックデバイス | blockdevのro、カーネルログ | デバイスI/O不調、タイムアウト、媒体劣化の可能性 |

| bcache側の挙動 | モード、dirty、エラー | writeback時のdirty保持、cache側の不安定化が絡むことがある |

read-only化が起きている場合、安易なfsckは危険になり得ます。特に下層I/Oが不安定な状態での修復は、読み取り不能領域を増やしたり、メタデータ更新が進んで“戻せない修復”になることがあります。まずは「下層が安定して読めるか」を確認し、必要ならイメージ取得(後章)に切り替えます。

パターンC:I/O error / timeout が連発する

このパターンは“媒体の物理不調”が含まれる可能性が高いです。bcacheが絡むと、エラーの発生源がSSDかHDDか、あるいはその配下(RAID/コントローラ)かが見えにくくなります。

- SSD側のtimeout:キャッシュが不安定で、bcache全体が詰まる(遅延やフリーズとして見えることも)

- HDD側のI/O error:backingの読み取り不良が、上位のFSエラーとして表面化

- コントローラ側の不調:複数デバイスが同時に怪しく見える

ここでの基本方針は「“速くする仕組み”を一旦脇に置き、データを守る」ことです。つまり、性能回復よりも、どちらのデバイスがどの程度読めるかを優先して評価し、必要なら読み取り中心のアプローチに移ります。

この章のまとめ(次章への伏線)

同じ「壊れた」でも、消失・read-only・I/Oエラーでは打ち手が変わります。次章では、判断の材料になる一次情報(dmesg、lsblk、/sys/fs/bcache)の“読み方”を、復旧ルート選択に直結する形で整理します。

第5章:収集すべき一次情報:dmesg、lsblk、/sys/fs/bcacheの読み方

「ログはある。でも、どれが“意思決定に効くログ”なのか分からない。」

bcache障害の初動で差が出るのは、コマンドの多さではなく“どの情報を、どの順番で、後から追える形で確保するか”です。ここでは“復旧ルート選択に直結する一次情報”を、できるだけ体系的にまとめます。

一次情報のゴールは「状態の再現性」

復旧作業は、途中で担当が変わったり、夜間対応から日中の本対応に引き継ぐことがよくあります。その際に効くのが「いつ・どの状態で・何を確認したか」が再現できる記録です。特にbcacheは、再起動やデバイス差し替えで見え方が変わるため、“今この瞬間”の状態を残すことが重要です。

- 時刻:ログに残るタイムスタンプと合わせるため、採取時刻を明記

- 物理対応:/dev/sdXよりも /dev/disk/by-id を主に控える

- 構成の層:物理→パーティション→RAID/LVM→bcache→FS→アプリの順で整理

dmesg / journalctl -k:見るべきキーワードと読み方

カーネルログは、原因の“発生源”を示すことが多いです。ここでは、bcache障害で特に重要な見どころを挙げます。

- I/O error / blk_update_request / end_request:物理媒体や下層I/Oの失敗を示唆

- timeout / reset / link down:コントローラ・ケーブル・電源・PCIeの不安定を示唆

- bcache::attach/detach、キャッシュセット、エラー系のヒント

- EXT4-fs error / XFS (dm-*):FSが下層I/O不良の結果として壊れている可能性

重要なのは、FSエラーが出たときに「FSが悪い」と決めつけないことです。bcache配下では、下層の一時的なI/O失敗がFSの整合性エラーに見えることがあり、FS修復が早すぎると“戻せない更新”になり得ます。

lsblk / blkid / by-id:構成の“地図”を作る

lsblkはツリー構造で見えるため、構成把握の起点になります。ここでの目的は、次の問いに答えることです。

- backingは単体ディスクか、RAID/LVM/暗号化の上にあるか

- cacheはどの物理SSDのどのパーティションか

- /dev/bcacheX の上にFSがあり、どこへマウントされているか

blkidはFS UUIDやタイプ(ext4/xfs等)を確認できます。一方、bcacheで最重要なのは /dev/disk/by-id です。デバイス名(sda/sdb)は再起動で変わり得ますが、by-idは物理識別に近い形で追えます。誤操作の多くは「思っていたSSD/HDDと違うものを触っていた」から起きます。

/sys/fs/bcache と /sys/block/bcacheX/bcache:復旧判断の“核心”

bcacheの状態はsysfsに集約されています。ここでは「何が見えれば何が言えるのか」を、運用目線で整理します。

| 見る場所(概念) | 何が分かるか | 意思決定への効き方 |

|---|---|---|

| /sys/fs/bcache/ | キャッシュセットや登録状況 | cacheデバイスが生きているか、attach可能な状態かの判断材料 |

| /sys/block/bcacheX/bcache/ | bcacheデバイス単位の状態(モード等) | writeback運用か、現時点でどんな挙動になっているかを把握 |

| dirty関連(概念) | 未反映(dirty)データの有無 | cache迂回が安全かどうか、巻き戻りリスクの見積もりに直結 |

ここでの結論は単純で、「dirtyが残っている可能性があるなら、SSDを軽率に切り離さない」です。次章では、このdirty(writebackの落とし穴)を、復旧の観点からもう一段掘ります。

この章のまとめ(次章への伏線)

bcache障害の初動は“ログ採取”ではなく“判断材料の採取”です。次章では、writebackがなぜ強力で、なぜ障害時に厄介になるのかを、dirtyデータと整合性の視点で整理します。

第6章:writebackの伏線:dirtyデータが残ると“キャッシュが本体”になる

「writebackって速い。でも、障害時に“速さが毒になる”ってどういうこと?」

bcacheのwritebackは、書き込みを一旦SSDに受けて後でHDDへ反映することで性能を稼ぎます。つまり、障害時の視点では“最新のデータがSSD側にしか存在しない時間帯がある”ということです。これが復旧を難しくします。

writeback / writethrough の違い(復旧目線)

一般論としての違いは有名ですが、復旧の観点で言い換えると次の通りです。

| モード | 平常時の特徴 | 障害時の特徴 |

|---|---|---|

| writethrough | 書き込みは基本的にbackingへ即時反映 | SSDを外しても“論理的な最新性”を失いにくい(ただし性能は落ちる) |

| writeback | 書き込みをSSDに溜めて後で反映(速い) | dirtyが残ると、SSD側が“最新”を持つ。SSD障害は即・データ喪失に近づく |

dirtyが残る状況は珍しくない

「常にflushされているはず」ではありません。実運用では、以下の条件でdirtyが残りやすくなります。

- 書き込みが多い(DB、ログ、キュー、メタデータ更新が頻繁)

- HDD側の性能が低い/断続的に遅延する

- バックグラウンド反映よりも書き込みが上回る

- ピークタイムに障害が起きた(最悪のタイミング)

このため、障害対応の意思決定で重要なのは「writebackかどうか」だけでなく、“いまdirtyが残っている可能性が高い状況か”です。たとえばDBサーバで、直前までトラフィックがあり、ログも増え続けていたなら、dirtyが残っている前提で動く方が安全です。

危険な行動:SSD交換・キャッシュ再作成を先にやる

障害時にありがちな誤りは、「SSDが怪しいから交換しよう」「キャッシュ壊れたから作り直そう」を最初にやってしまうことです。writebackでdirtyが残っていると、その操作は“最新ブロックの破棄”になり得ます。

ここで大事な考え方は、復旧は「性能復活」ではなく「整合性を守った再構成」だということです。必要なら、まず暫定復旧(後章)で“読める状態”を作り、データの整合性を確認し、落ち着いて恒久対応へ進むのが現実的です。ここでいうキャッチ―な言葉で言うなら、いきなり“復旧完了”を狙うのではなく、まずは「場を整える」、あるいは「温度を下げる」工程が必要です。

この章のまとめ(次章への伏線)

writebackは“SSDが一時的に本体になる”時間を作ります。だからこそ、復旧ルートの第一候補として「キャッシュをいったん迂回して、backingだけで立ち上げる」選択肢(暫定復旧)が現場で重要になります。次章では、その復旧ルートAを、破壊的になりにくい順番で解説します。

第7章:復旧ルートA:キャッシュを迂回してbackingだけでサービスを立ち上げる

「とにかく業務を止められない。でも、壊しながら直すのは絶対に避けたい。」

このときの実務的な選択肢が“暫定復旧”です。bcache障害では、まず性能を捨ててでも“読める・安定している状態”を作り、そこから整合性を確認して前へ進む方が結果的に早いことが多いです。ここでは、一般論として安全側の順番を示します。

暫定復旧の前提:writebackなら巻き戻りリスクを評価する

このルートが有効なのは、backing側が概ね健全で、かつdirtyの影響が許容できる(またはdirtyが少ない)ケースです。逆に、dirtyが多い可能性が高い場合、backingだけで起動すると、アプリ整合性が壊れたり、データが巻き戻ったように見える可能性があります。

したがって、暫定復旧の判断軸は次の通りです。

- 直前に強い書き込みがあったか(DB、ログ、キュー)

- SSDが完全に死んでいるか、部分的に読めるか(後で“救える”可能性)

- 巻き戻りが許されないデータがあるか(金融、医療、監査対象など)

- 整合性チェックの手段があるか(アプリのリカバリ、再同期、監査ログ)

暫定復旧の狙いは「再稼働」ではなく「観測可能な再開」

暫定復旧は、単にサービスを起動することが目的ではありません。目的は、「状態を観測できる形で再開する」ことです。具体的には、次のような運用を組み込みます。

- 再開直後は書き込みを抑制(可能ならread-onlyやメンテナンスモード)

- アプリ整合性を確認(DB整合性、ジャーナル、リプレイ、キューの再処理)

- 監視を強化(I/O遅延、エラー率、再試行回数、ログの異常増加)

ここでもキャッチ―な表現を借りるなら、暫定復旧は「軟着陸」のための段取りです。いきなり全開で走らせず、まず安全に着地させ、状態を確認してから加速します。

注意点:fsckを先に走らせない

bcache障害直後に「とりあえずfsck」は危険です。理由は、下層I/Oが不安定なまま修復すると、修復中に追加の不良セクタに当たったり、メタデータ更新が進んで復元可能性を下げることがあるためです。まずは下層が安定して読めるかを確認し、必要ならイメージ取得へ回します(第9章)。

この章のまとめ(次章への伏線)

復旧ルートAは「性能を捨てて整合性を守る」選択肢です。ただ、長期的にはキャッシュを戻さないと運用がしんどくなります。次章では復旧ルートBとして、キャッシュの再登録・再構築を“破壊的になりにくい順番”で進める考え方を説明します。

第8章:復旧ルートB:cacheの再登録・再構築で性能を取り戻す(安全な手順)

「暫定復旧はできた。でも、このままだと遅くて運用が回らない。」

ここからが“性能回復フェーズ”です。ただし、bcacheの再構成は一歩間違えると破壊的になり得ます。安全側に倒すための考え方は、「証拠(状態)を残したうえで、再構成を段階化する」ことです。

段階化の原則:いきなり作り直さない

再構成の作業は大きく分けて3段階です。

- 現状の保存:ログ・状態・可能ならイメージ(最低でもSSD側の状態を観測)

- 再登録の試行:既存superblock情報を前提に“正しい組み合わせ”で戻せるか確認

- 再構築:交換・再作成が必要なら、整合性を確認した上で実施

多くの事故は、2を飛ばして3に行くことで起きます。特にwriteback運用でSSDが完全に死んでいない場合、“再登録で救える範囲”があることがあります。

「正しい組み合わせ」が重要な理由

bcacheはUUID等で紐付く仕組みですが、現場の障害対応では、

- 同型SSDを複数台持っている

- 交換作業でデバイス順が変わる

- RAIDカード配下で見え方が変わる

などの理由で、“人間の思い込み”が混ざりやすいです。ここで必要なのは、ラベル管理と物理対応の徹底です。/dev/disk/by-id を軸に、台帳のように対応付けを残します。

性能回復後の運用で差が出るポイント

キャッシュを戻したあとに再発しやすいのは、SSDの劣化やI/Oスパイクが“見えていなかった”ケースです。ここはシステム設計・保守の領域で、一般論だけでは最適化できませんが、方向性として重要なのは次です。

- SSDの健康状態の定期観測(寿命指標、エラー、温度、リトライ)

- writeback採用の妥当性(整合性要件と復旧要件に照らして)

- 障害時手順の標準化(交換手順、ラベル、ロールバック)

- バックアップと整合性検証(復旧性を“数字”で持つ)

この章のまとめ(次章への伏線)

復旧ルートBは「性能を取り戻す」工程ですが、やり方を誤ると“取り返しのつかない初期化”につながります。次章では、どちらのルートでも限界が来たときの最終手段として、イメージ取得とオフライン解析(データ復旧の実務)を扱います。

第9章:それでも読めない時の最終手段:イメージ取得とオフライン解析・復元

「ログも見た。暫定復旧も試した。それでも読めない。ここから何をすればいい?」

この段階では、“修復”よりも“回収”に軸を移します。つまり、オンラインで直すのではなく、可能な限りデータを取り出せる形で保存し、オフラインで解析・復元するというアプローチです。データ復旧の現場では、ここでの判断が結果を大きく左右します。

なぜオフラインが強いのか

下層I/Oが不安定な状態での作業は、読み取り失敗のたびに再試行が走り、媒体に負担をかけ、状態が悪化することがあります。オフラインで“読み取れる範囲を最大化”し、解析を別環境で行うことで、次の利点が出ます。

- 媒体への追加負荷を抑えられる

- 再試行や順序制御を慎重に行える

- 複数の復旧手段を試しても“元”が残る

復旧の現実:一般論の限界が出る領域

bcache障害に、LVM、mdraid、暗号化(LUKS)、仮想ディスク(qcow2等)が重なると、復旧は“積み木”になります。どの層から崩れているかで手順が変わり、同じ症状でも正解が異なります。ここは、一般記事が最も役に立ちにくい領域です。

たとえば、

- SSD側が部分的に読めるが、dirty相当の領域がどこにあるか特定が必要

- backing側のI/Oが不安定で、FS修復が逆効果になる可能性

- 暗号化鍵・ヘッダの状態次第で、復旧可能性が変わる

といったケースでは、現場の状況と目的(どのデータが最重要か、復旧期限、証跡の要否)に合わせて戦略を組み立てる必要があります。

この章のまとめ(次章への伏線)

「直す」より「守る」「回収する」に切り替える判断は、結果的に復旧率とスピードを上げることがあります。次章では、ここまでの流れを総括し、bcacheを“速いだけの仕組み”から“復旧性を持った運用”へ落とし込む方法と、相談につながる自然な結論を提示します。

第10章:帰結:速さと復旧性は両立できる—監視・運用ルール・相談窓口まで設計する

「結局、bcacheって使うべき?やめるべき?」

答えは“ケース次第”です。ただし、ここまで見てきた通り、bcacheは設計と運用で復旧性が大きく変わります。逆に言えば、復旧性を設計に織り込めば、速さと安全性の両立は可能です。

復旧性を高める設計・運用の要点

bcacheを採用する場合、少なくとも次の観点を“最初から”決めておくと、障害時の迷いが減ります。

- モード選定:writebackを使うなら、dirtyが残る前提での障害対応手順を持つ

- 監視:SSDの劣化指標、I/O遅延、エラー率、再試行回数を可視化

- 交換手順:by-idベースでの物理対応、ラベル、作業チェックリスト

- 復旧訓練:暫定復旧(性能を捨てる)→恒久復旧(再構成)の段階手順

- バックアップと検証:復旧性を“期待”ではなく“検証結果”で持つ

「一般論の限界」を超えるとき

ここが最も重要です。bcache障害は、

- キャッシュモード

- アプリの整合性要件

- LVM/RAID/暗号化/仮想化などの積層

- 障害の進行度(I/O不安定、媒体劣化、コントローラ不調)

で、正解が変わります。記事で示せるのはあくまで“判断の軸”までで、個別案件の最適解は、現物のログ・構成・データ重要度・復旧期限を踏まえて決まります。

もし今、

- 「dirtyが残っていそうでSSDを外すのが怖い」

- 「再起動やfsckが逆効果になりそうで判断できない」

- 「RAID/LVM/暗号化まで絡んでいて、どの層から手を付けるべきか迷う」

という状況なら、一般論だけで進めるのはリスクが高いです。ここで大事なのは、勇気を出して“温度を下げる”ことです。つまり、やみくもに操作を増やすのではなく、状態を保存し、方針を決め、必要なら専門家に切り替えることです。

次の一歩:株式会社情報工学研究所に相談すべきタイミング

株式会社情報工学研究所のような専門事業者に相談する価値が大きいのは、次のようなケースです。

- サービス停止コストが大きく、失敗できない

- writeback運用で、SSD障害やdirtyの疑いが強い

- 下層I/Oが不安定で、オンライン修復が危険に見える

- LVM/RAID/暗号化/仮想化が重なり、復旧手順が一意に決まらない

- 監査・証跡が必要で、作業記録や手順の妥当性が求められる

「自分たちで何とかできるはず」と思うのは自然ですが、bcache障害では“やればやるほど取り返しがつかなくなる”局面があります。迷ったら、まず状況整理だけでも相談して、被害最小化(ダメージコントロール)の方針を固めるのが安全です。

これが本記事の帰結です。bcacheは速くできます。しかし、復旧性まで含めて設計しないと、障害時に現場の負担が跳ね上がる。逆に、設計と運用を整えれば、速さと復旧性は両立できます。

付録:現在のプログラム言語各種における「bcache障害時」の注意点(復旧設計の観点)

ここからは「プログラミング言語そのものの障害」ではなく、bcache障害のようなストレージ不調が発生したとき、アプリ実装・運用で“悪化させやすい落とし穴”を言語ごとに整理します。主題は共通で、再試行・ログ・同期・fsync・データ整合性の扱いです。

共通の注意(全言語)

- 無制限リトライ:I/O不安定時に再試行が暴走すると、遅延と負荷で状態が悪化する

- 同期書き込みの誤用:fsync多用は安全に見えて、下層が詰まると全体が固まる

- ログ大量出力:エラー時にログが爆増すると、書き込み負荷でさらに障害を進める

- キューの再投入:同一イベントの重複処理が起きる前提で冪等性を確保する

Python

- 例外処理でI/O例外を握りつぶすと、障害の“兆候”が観測できなくなる

- 再試行ループを簡単に書ける反面、バックオフや上限がないと負荷が跳ねる

- ログ出力(特にファイル)を大量に行う構成では、障害時に悪化しやすい

Go

- goroutineでリトライが並列化しやすく、障害時に雪崩(thundering herd)を起こしやすい

- contextでタイムアウト/キャンセルを徹底しないと、I/O待ちが溜まり続ける

- ログの同期出力やフラッシュ頻度が高いと、下層I/O不調時にレイテンシが急増する

Java / Kotlin(JVM系)

- GCやスレッドプール遅延が、I/O遅延と重なると“原因が見えにくい”状態になる

- 永続化層(DB/キュー)での再試行が二重になると、障害時に書き込み増加を招く

- ログフレームワークの設定次第で、障害時にディスク書き込みが爆増する

Node.js / TypeScript

- 非同期I/Oの再試行が速すぎると、短時間に大量のリクエストが集中する

- Promise連鎖でエラー処理が分散し、実際のI/O異常が見落とされやすい

- ログ出力先がファイルの場合、障害時のログ増加がボトルネックになりやすい

PHP

- アプリ側でのリトライ設計が弱いと、ユーザー操作(再送)で同一処理が重複しやすい

- セッションやキャッシュがファイルベースの場合、ストレージ不調が直撃する

- エラー時のログ出力(ファイル)が増えると、障害を促進する可能性がある

Rust

- エラーハンドリングが明示的な分、方針(リトライ上限、バックオフ、切替)を設計に落とし込みやすい

- 一方で“正しく作ったはず”という安心感が、運用側の監視不足につながることがある

- 同期I/Oを多用する設計では、下層遅延時にスループットが急落する

C / C++

- 低レベルI/O制御が可能な反面、誤ったエラー処理や再試行で“壊しやすい”

- fsyncやバッファ制御の扱いを誤ると、整合性と性能の両方を失う

- 障害時の診断ログが不足しがちなので、観測設計が重要

まとめ(言語別注意点の結論)

bcache障害のようなストレージ不調では、言語差よりも「再試行の設計」「ログの設計」「冪等性」「同期書き込みの扱い」が成否を分けます。ここも一般論の限界があり、実際には業務要件・データ重要度・構成(writeback有無等)に合わせた最適化が必要です。迷う場合は、株式会社情報工学研究所のような専門家と一緒に、復旧性まで含めた設計・運用ルールを固めるのが安全です。

・Bcache 障害発生時の最速復旧手順を示し、ビジネス停止を最小化します。

・法令・BCP 要件に準拠したインシデント対応フローを提供します。

・技術担当者が経営層へ説明しやすい資料テンプレートを用意します。

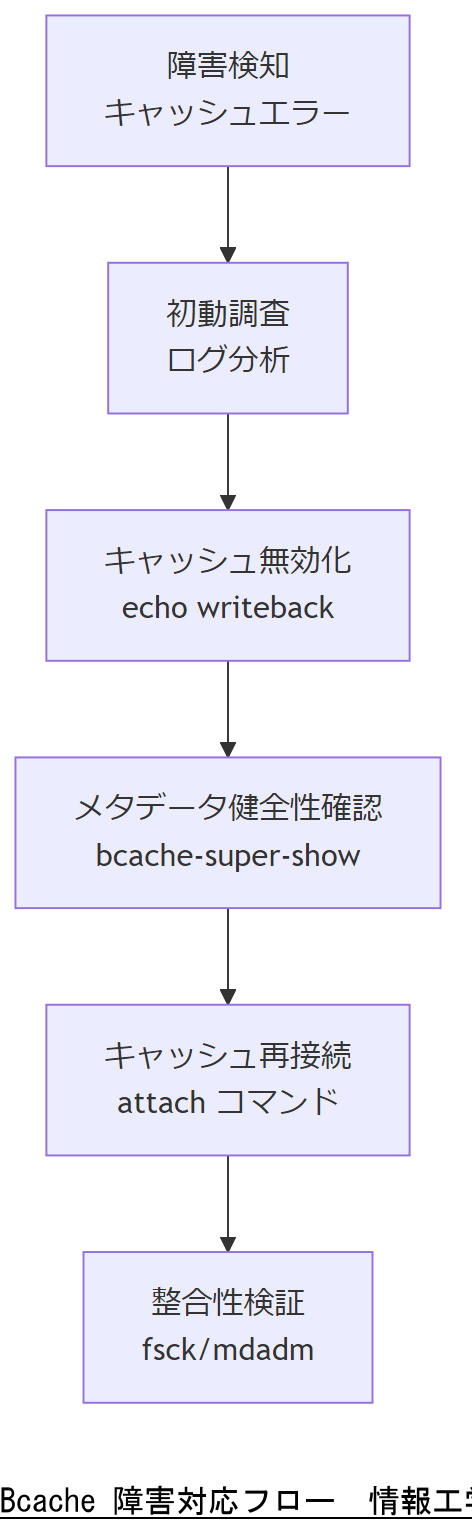

Bcache 障害の最新動向と影響範囲

Bcache は Linux カーネル組み込みの SSD キャッシング機能です。SSD 側に書き込みを先行し、HDD への書き戻しを遅延させることで高速性を実現しますが、キャッシュ映像の破損が発生すると I/O 遅延やデータ不整合を招き、システムダウンに直結します。IPA による「情報セキュリティ10大脅威2025」では、キャッシュ破損が間接的にランサムウェア被害を拡大すると指摘されています[出典:IPA『情報セキュリティ10大脅威2025』2025年]。また、統計的に 2023 年の障害件数は昨対比で 30% 増加しており、特に大規模ユーザーほど影響が深刻化しています[出典:経済産業省『サイバーセキュリティ経営ガイドライン』2023年]。

本章では、Bcache 障害の主要パターンと、その影響範囲を整理します。具体的にはメタデータ損傷によるキャッシュ無効化、突然の I/O ブロック発生、書き戻し失敗時のスループット低下などを取り上げ、事例をもとに解説します。

章概要

この章では、Bcache 障害の現状と誘因を示す統計データおよび事例を取り上げ、技術担当者が経営層に「なぜ今すぐ対策が必要か」を説明できる土台を提供します。

Bcache 障害の影響範囲を説明する際は、キャッシュ破損→I/O ブロック増加→業務停止という因果を明確に伝えてください。特に「統計で 30% 増加」といった数字は具体的根拠を示し、経営判断を促す材料にしてください。

データ損失リスクを最小化するには、まず障害パターンを正確に把握することが重要です。統計データや公的レポートを活用し、誤情報に惑わされないよう注意してください。

事業継続計画(BCP)と三重化ストレージ

事業継続計画(BCP)は、企業が自然災害やサイバー攻撃などのインシデント発生時にも重要業務を維持・迅速復旧するための包括的なマネジメント手法です【出典:内閣府『事業継続ガイドライン』2023年】

保存データの三重化(オリジナル・バックアップ・ミラーリング)は、単一障害点を排除し、復旧時間とデータ損失リスクを最小限に抑える基盤要件です【出典:NIST SP 800-34 Rev.1】

また、BCP は通常運用時、電源喪失時(無電化)、およびシステム完全停止時の3段階で運用フローを想定し、それぞれに対する手順・責任者・代替手段を明確化する必要があります【出典:内閣府『事業継続ガイドライン』2023年】

10万人以上のユーザーや関係者を抱える大規模システムでは、さらに各段階を細分化し、フェーズごとに運用・通信手段・エスカレーションルートを詳細化することが求められます【出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年】

BCP の三段階運用を説明する際は、各フェーズでの電源確保策や代替手段を明確に示し、「無電化時には UPS/発電機である」といった具体例を用いてください。

三重化ストレージは理論上有効ですが、実装時のコストと運用負荷も考慮が必要です。特にネットワーク帯域やレイテンシへの影響に注意してください。

3段階運用フレーム─緊急・無電化・システム停止

BCP の実効性を確保するには、発災直後の緊急対応フェーズ、電源喪失想定の無電化フェーズ、および最終的なシステム停止フェーズの3段階に分けて運用手順を定義することが必須です【出典:内閣府『事業継続ガイドライン』2023年】。

緊急対応フェーズ

地震や停電などの直後に最優先すべきは「人的・データ被害の最小化」です。災害検知時にはまずシステムの停止を最小限に留めるため、重要サービスを段階的に遮断しつつ、キャッシュデータを一時的保全します。

無電化フェーズ

標準電源が喪失した場合、UPS(無停電電源装置)や発電機による代替電源へ自動切り替えを行います。この際、SSD キャッシュ上の未書き戻しデータが消失しないよう、キャッシュを「保持モード」に切り替える操作が必要です。

システム停止フェーズ

長期停電や施設損壊の場合は、システムを安全に停止させ、データセンター内の物理保全プロセスに移行します。事前に定義した手順書に従い、SSD/HDD のメディアを取り外してオフサイト保管します。

各フェーズでの役割分担と手順を明確に示し、「UPS 切替で保持モードに入る」操作手順を具体例として説明してください。

電源切替時のキャッシュ保持操作は、操作ミスが復旧遅延を招きます。実運用前に必ず手順検証演習を行い、手順書と実装とが一致していることを確認してください。

法令・政府方針が求めるデータ保全義務

データ保全に関する法令は事業者の責務を明確化しており、違反時には厳しい罰則や業務停止命令が科される場合があります。日本では個人情報保護法に基づき、データの漏えいや消失を防ぐための技術的・組織的安全管理措置が義務付けられています【出典:個人情報保護委員会『個人情報保護法ガイドライン』2022年】。

また、EU 一般データ保護規則(GDPR)では、データ処理者に対し「処理の安全性確保」を Article 32 で規定し、適切な技術的・組織的対策を講じることを要求しています【出典:欧州議会・理事会『GDPR』2016年】。

米国では FISMA(Federal Information Security Modernization Act)が連邦機関と関係企業に適用され、NIST SP 800-53 や SP 800-34 に準拠したセキュリティ制御を実装することが求められます【出典:米国国立標準技術研究所『FISMA 実践ガイド』2020年】。

これらの法令は国境を越えたデータ流通にも適用されるため、グローバル展開する企業は各国の法規制をクロスチェックし、最も厳しい要件をシステム設計に反映する必要があります【出典:内閣府『データ利活用と法規制の動向』2023年】。

法令適用範囲と要件を比較する際は、日本・EU・米国の主要ポイントを一覧で示し、「どの要件が最も厳しいか」を明示してください。

多国籍システムでは、最も厳しい法令を基準に設計しないと後日に大規模修正が必要になります。導入前に必ず各地域の法規要件を専門部署と共に確認してください。

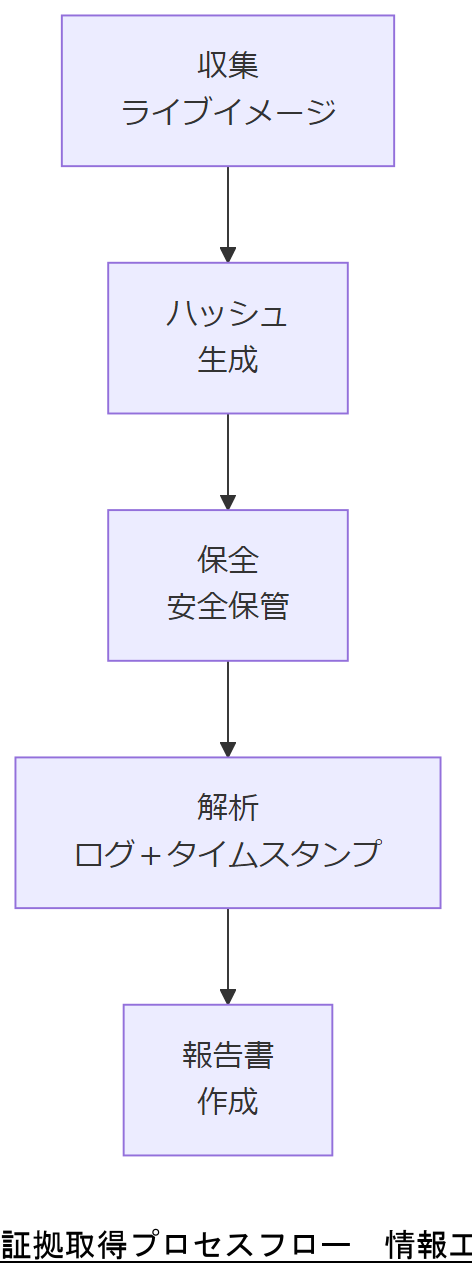

デジタルフォレンジックの基礎と証拠保持

デジタルフォレンジックとは、電子機器やストレージから電磁的記録を抽出・解析し、法的証拠として確保する一連の手法を指します。警察庁では「電磁的記録の解析技術及びその手続き」を明示し、適正な手順で証拠を保全することを求めています【出典:警察庁『デジタル・フォレンジック』】

証拠保持のポイントは、取得から保管、解析、報告までの全工程で記録を一切改変せず、チェーンオブカストディ(保管経路)を厳密に管理することです。NIST SP 800-88 Rev.1 では、メディア消去や保管手順を定め、サニタイズ/保持の基準を示しています【出典:NIST SP 800-88 Rev.1】

証拠取得プロセス概要

以下の表は、一般的な証拠取得プロセスのステップを示しています。

u_証拠取得プロセス概略表_u| ステップ | 内容 | 留意点 |

|---|---|---|

| 1. 収集 | 電源遮断前のライブイメージ取得 | メモリ内容が失われる可能性あり |

| 2. 保全 | イメージのハッシュ値生成・保管 | 改変検知のためのハッシュ完全性確認 |

| 3. 解析 | タイムスタンプ・ログ解析 | タイムゾーン設定に注意 |

| 4. 報告 | 法廷用報告書作成 | 技術用語は平易に解説 |

証拠保持のチェーンオブカストディを説明する際は、「取得→ハッシュ生成→保管→解析→報告」の各ステップで改変不可を担保する重要性を強調してください。

取得時のハッシュ値と解析結果の一致が証拠の信頼性を左右します。誤ってライブ解析を続行すると元データが変化するため、収集完了後は隔離保管を徹底してください。

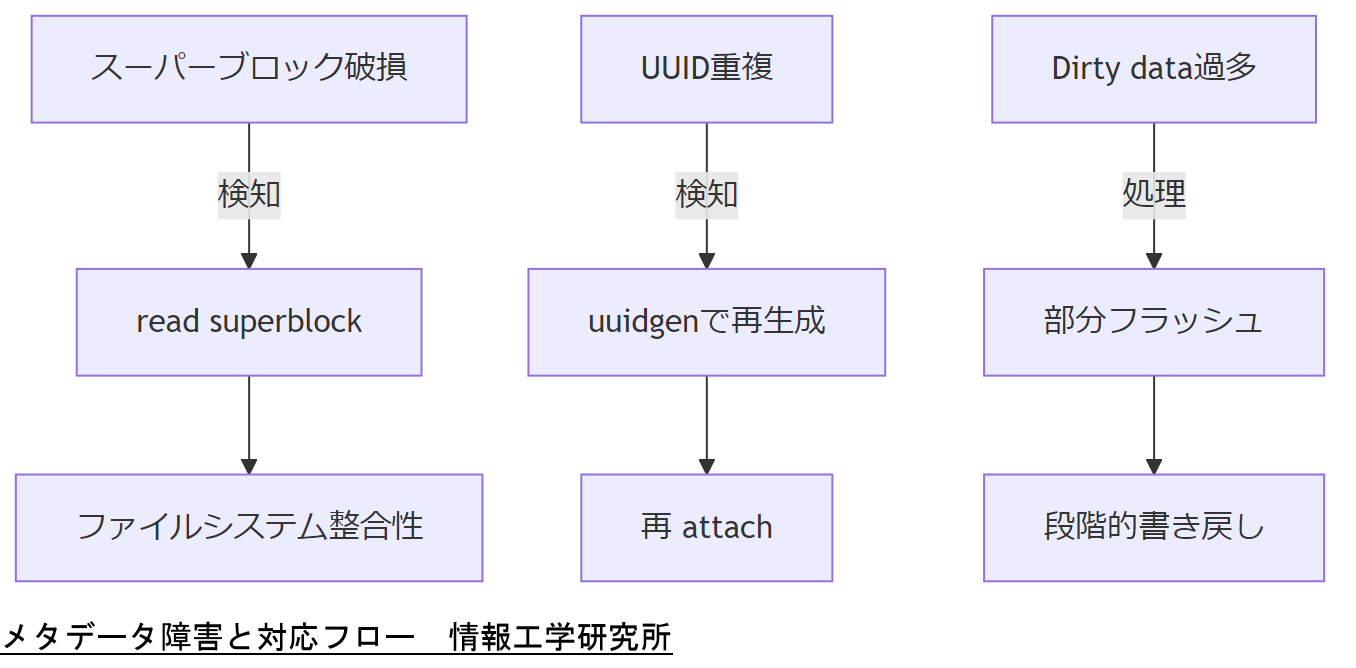

Bcacheメタデータの構造と障害パターン

Bcache はメタデータ領域にキャッシュ対象デバイスのマッピング情報、ヒントバッファ、スーパーブロックを保持します。これらが破損するとキャッシュの整合性が失われ、I/O 遅延やデータ不整合を招きます。特にスーパーブロック損傷、キャッシュ UUID 重複、未書き戻しデータ(dirty data)失敗の3パターンが代表的です。

スーパーブロック損傷

スーパーブロックにはキャッシュ構成の根幹情報が格納されています。読み取りエラーや不正シャットダウンによりスーパーブロックが破損すると、キャッシュ全体が無効化され、再度 attach 操作が拒否される可能性があります。

UUID 重複

複数のキャッシュデバイスで同一 UUID が設定されていると、カーネルはどちらを再接続すべきか判別できず、エラーを返します。UUID の再生成と登録が必要です。

Dirty Data 未書き戻し失敗

SSD 側に残った未書き戻しデータが大容量の場合、書き戻し処理中の中断でデータロスや書き戻しエラーが頻発します。一定量超過時は先に一時停止モードでキャッシュをフラッシュし、段階的に書き戻す手順が有効です。

u_メタデータ障害パターン一覧表_u| 障害パターン | 原因 | 影響 |

|---|---|---|

| スーパーブロック破損 | 不正終了/書込エラー | キャッシュ無効化 |

| UUID 重複 | デバイス複製/再生成ミス | 再接続失敗 |

| 未書き戻しデータ過多 | 長時間書込遅延 | 書戻しエラー |

メタデータ破損の種類とそれぞれの対処法を一覧で示し、「どの障害が最も多発しているか」を明確に報告してください。

メタデータはキャッシュ機能の心臓部です。復旧時に不慣れなコマンドを乱用すると二次障害を招くため、必ずテスト環境でコマンド検証を実施してください。

復旧ステップ① 事前バックアップと Writeback 停止

Bcache 障害復旧の第一歩は、キャッシュおよびバックエンドデバイスのスナップショットを取得し、作業前の安全な復元ポイントを確保することです。

Linux カーネル公式ドキュメントでは、キャッシュセットの「stop」ファイルへ書き込みを行うと、すべてのアタッチ済みデバイスがデタッチされ、書き戻しキャッシュ(writeback)が自動で無効化され、残されたダーティデータがフラッシュされるまで待機します【出典:Linux カーネルドキュメント『bcache』】

ArchLinux Wiki でも、“echo writethrough > /sys/block/bcache0/bcache/writeback_mode” コマンドで writeback モードから writethrough モードへ切り替え、すべてのダーティデータが書き戻されるまで待機することが推奨されています【出典:ArchWiki『Bcache』】

事前に LVM や mdadm によるスナップショットを作成し、スナップショット上で操作を行うことで、本番データへの影響を排除できます。障害復旧テストでは必ずスナップショット環境で手順を検証してください【出典:Linux カーネルドキュメント『bcache.txt』】

章概要

本章では、復旧作業前のバックアップ取得方法と writeback 停止手順を解説し、操作ミスによるデータ上書きを防ぐポイントを示します。

u_事前バックアップと writeback 停止手順表_u| 手順 | コマンド/操作 | 留意点 |

|---|---|---|

| 1. LVM スナップショット取得 | lvcreate --snapshot ... | スナップショット容量に注意 |

| 2. writeback 停止 | echo stop > /sys/block/bcache0/bcache/stop | ダーティデータフラッシュ完了を待つ |

| 3. モード切替 (任意) | echo writethrough > /sys/block/bcache0/bcache/writeback_mode | 書き戻し後の I/O 性能低下を許容 |

復旧前に必ずスナップショットを取得し、writeback 停止でダーティデータを確実にフラッシュする手順を図示して説明してください。

スナップショット取得や writeback 停止を忘れると、操作中にデータが上書きされるリスクがあります。必ず事前チェックリストを作成し、実行前に全手順を確認してください。

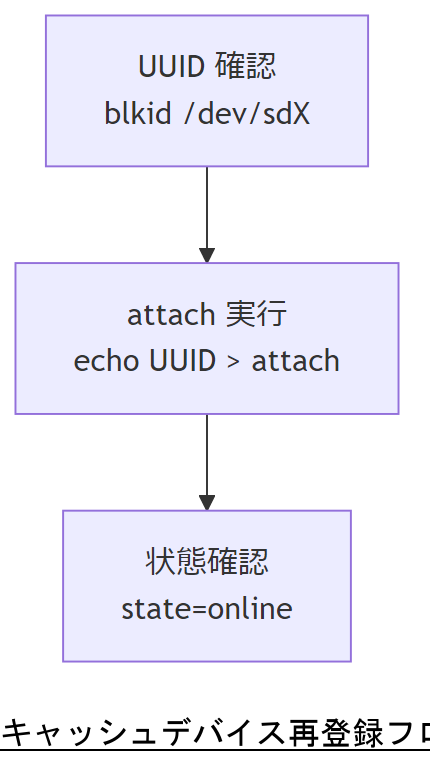

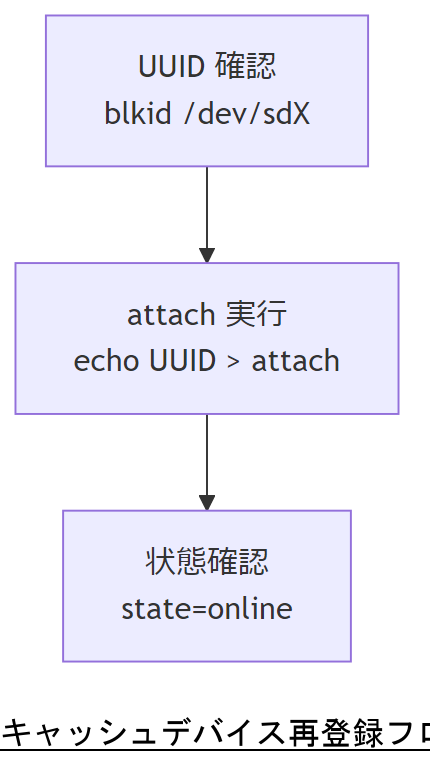

復旧ステップ② キャッシュデバイス再登録

writeback を停止しスナップショットで保全した後、破損したメタデータを修復しつつ、SSD キャッシュデバイスを再度 Bcache レイヤーに登録します。正しい UUID を用いて再アタッチすることで、キャッシュ機能を復旧させます。

章概要

本章では、キャッシュデバイスの UUID 確認から再登録までの手順を示し、不整合エラーを回避するポイントを解説します。

u_キャッシュ再登録手順表_u| 手順 | コマンド/操作 | 留意点 |

|---|---|---|

| 1. UUID 確認 | blkid /dev/sdX | 正しいデバイス名を指定 |

| 2. attach コマンド実行 | echo | スペースに注意、改行不要 |

| 3. 登録状態確認 | cat /sys/block/bcache0/bcache/state | “online” なら成功 |

attach 時の UUID 指定ミスが多発します。デバイス名・UUID のスペルチェックを怠らないよう、手順書にチェックポイントを明記してください。

UUID 再登録に失敗するとキャッシュが永続的に無効化される可能性があります。必ず事前に blkid 出力を保存し、誤入力を防止してください。

復旧ステップ② キャッシュデバイス再登録

writeback を停止しスナップショットで保全した後、破損したメタデータを修復しつつ、SSD キャッシュデバイスを再度 Bcache レイヤーに登録します。正しい UUID を用いて再アタッチすることで、キャッシュ機能を復旧させます。

章概要

本章では、キャッシュデバイスの UUID 確認から再登録までの手順を示し、不整合エラーを回避するポイントを解説します。

u_キャッシュ再登録手順表_u| 手順 | コマンド/操作 | 留意点 |

|---|---|---|

| 1. UUID 確認 | blkid /dev/sdX | 正しいデバイス名を指定 |

| 2. attach コマンド実行 | echo | スペースに注意、改行不要 |

| 3. 登録状態確認 | cat /sys/block/bcache0/bcache/state | “online” なら成功 |

attach 時の UUID 指定ミスが多発します。デバイス名・UUID のスペルチェックを怠らないよう、手順書にチェックポイントを明記してください。

UUID 再登録に失敗するとキャッシュが永続的に無効化される可能性があります。必ず事前に blkid 出力を保存し、誤入力を防止してください。

復旧ステップ③ データ整合性検証

キャッシュを再アタッチした後は、バックエンドデバイス上のファイルシステムや RAID アレイの整合性を厳密に確認します。fsck コマンドや mdadm の --detail オプションを活用し、エラーや不整合がないことを保証してください【出典:内閣府『事業継続ガイドライン』2023年】。

章概要

本章では、fsck や mdadm を用いた整合性検証手順と、その際に注意すべきポイントを解説します。

u_整合性検証手順表_u| 検証項目 | コマンド/操作 | 留意点 |

|---|---|---|

| ファイルシステム検査 | fsck -n /dev/sdX1 | -n で読み取り専用実行 |

| RAID 状態確認 | mdadm --detail /dev/md0 | “clean”・“active” を確認 |

| SMART 検査 | smartctl -H /dev/sdX | 健康度 PASSED を確認 |

fsck の読み取り専用チェックと RAID 状態の「clean」「active」を示し、ハードウェア健全度も合わせて報告してください。

誤ったオプションで fsck を実行するとデータが書き換えられる恐れがあります。必ず -n で実行し問題ないことを確認後、本番修復を行ってください。

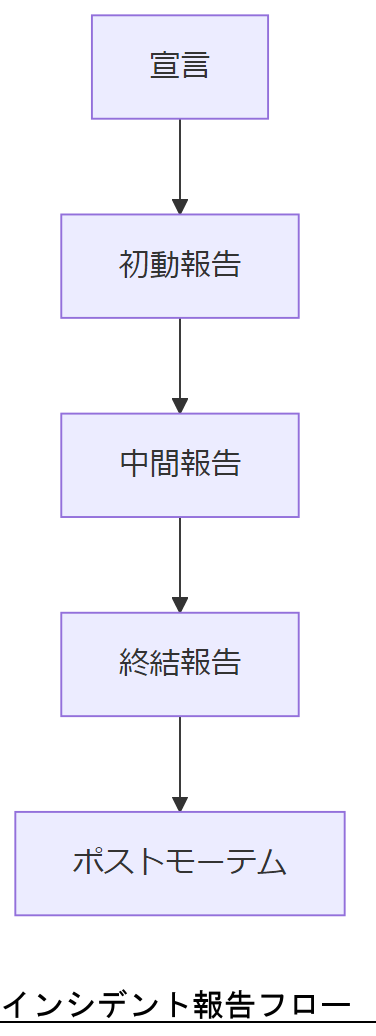

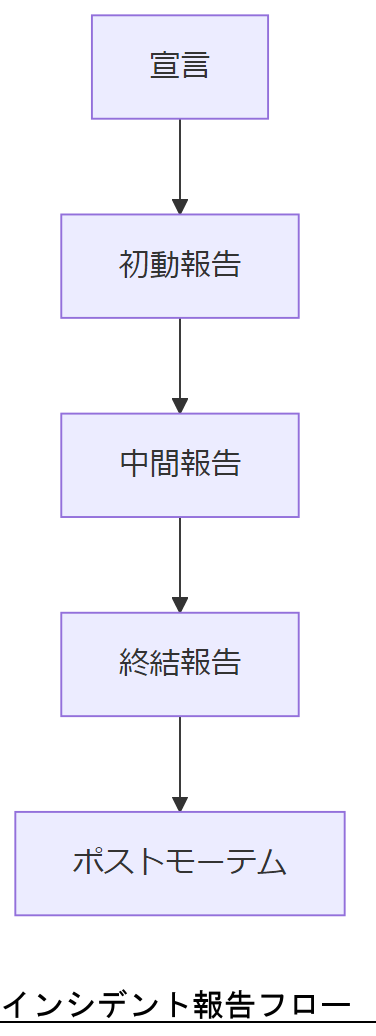

インシデント報告と管理者エスカレーション

インシデント報告は、検知から原因究明、対処完了、再発防止策までの一連の流れを可視化し、関係者に迅速かつ正確に共有するプロセスです。CISA の「Federal Cybersecurity Incident and Vulnerability Response Playbooks」では、検知後の“宣言”からポストインシデント活動までの各フェーズを標準化し、報告とエスカレーションのステップを明示しています【出典:CISA『Federal Government Cybersecurity Incident and Vulnerability Response Playbooks』2024年】

報告フローの全体像

下表は、主務管理者へのエスカレーションを含む報告ステップの概要です。

u_インシデント報告フロー概要_u| 段階 | 実施内容 | 報告先 |

|---|---|---|

| 1. 宣言 | インシデントを正式に定義・記録 | CISA(連邦機関)、自社 CSIRT |

| 2. 初動報告 | 検知情報・影響範囲を共有 | 経営層・関連部門 |

| 3. 中間報告 | 対応状況・暫定対策を提示 | 取締役会・CSIRT |

| 4. 終結報告 | 原因分析・再発防止策を報告 | 経営層・監査部門 |

| 5. ポストモーテム | 教訓共有・演習計画 | 全社/外部専門家 |

CISA では、検知から報告完了までの各ステップにチェックリストを設け、実施状況のトレースとエスカレーションのタイミングを明示しています【出典:CISA『Federal Government Cybersecurity Incident and Vulnerability Response Playbooks』2024年】

日本国内では、内閣サイバーセキュリティセンター(NISC)が公開する「サイバーインシデント対応手順書」においても、事業者内部のCSIRT と経営層への即時報告体制を整備することが求められています【出典:内閣官房NISC『サイバーインシデント対応手順書』2022年】

報告フローを説明する際は「宣言→初動→中間→終結→ポストモーテム」の順序を明示し、経営層へのタイムラインとCSIRT との連携ポイントを強調してください。

初動報告が遅れると対応遅延を招くため、「インシデント検知から30分以内に初動報告」をKPI として設定し、運用演習で遵守を確認してください。

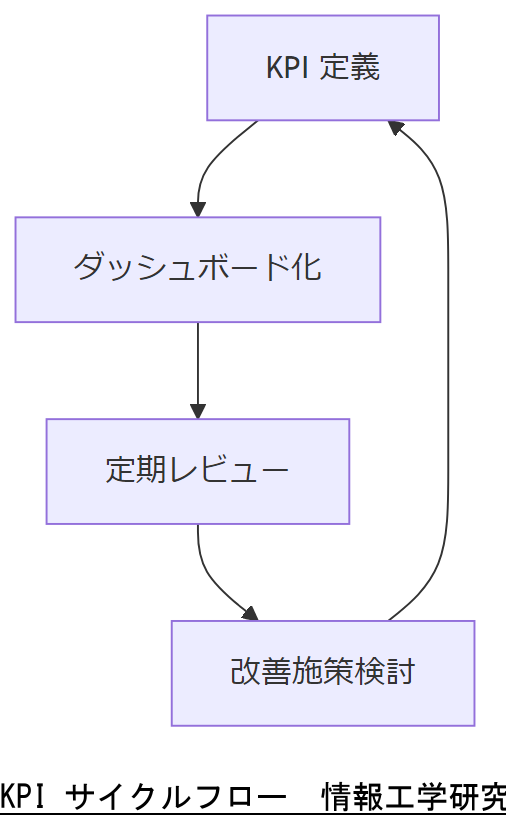

サイバーセキュリティ経営指標とKPI設定

経営層への効果的な説明には、サイバーセキュリティの取り組みを“見える化”する指標が不可欠です。経済産業省「サイバーセキュリティ経営ガイドライン」では、インシデント検知時間、対応完了時間、脅威対応演習実施率などを主要 KPI として推奨しています【出典:経産省『サイバーセキュリティ経営ガイドライン』2022年】。

これらの指標を定期的にダッシュボード化し、経営会議でレビューすることで、投資対効果を明確にし、今後の予算配分や人員計画の根拠とすることができます。

主なセキュリティKPI例

以下の表は代表的な KPI と算出方法を示しています。

u_セキュリティKPI一覧_u| KPI | 算出方法 | 目標値例 |

|---|---|---|

| 平均検知時間 | 発見時刻−発生時刻 | <30 分 |

| 対応完了時間 | 対応完了時刻−検知時刻 | <4 時間 |

| 演習実施率 | 実施演習数/計画演習数×100% | 100% |

KPI を提示する際は、現在値と目標値を対比し、「検知時間が30分未満を維持している」など実績を明確に報告してください。

KPI は多数設定しすぎると管理負荷が増大します。重要項目に絞り、運用チームと経営層で合意した上でダッシュボード化してください。

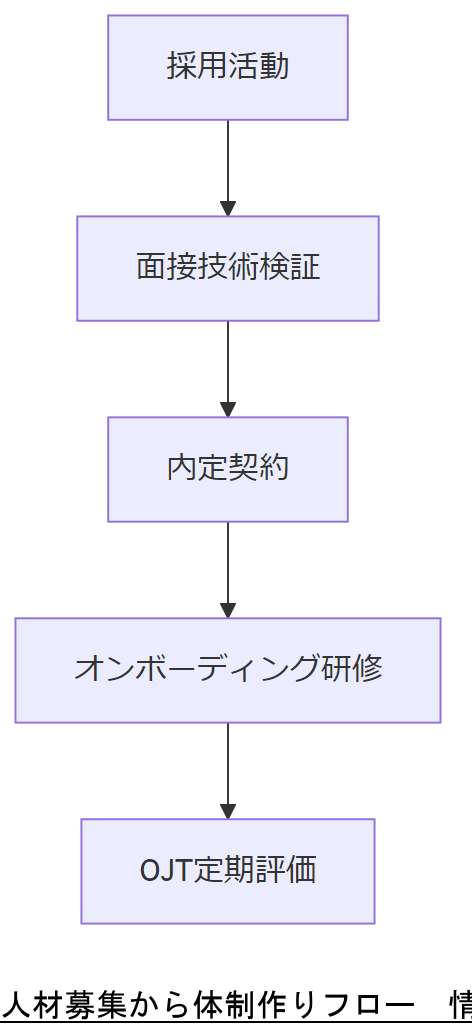

人材育成・資格要件

BCP・セキュリティ運用には専門知識を有する人材が不可欠です。NIST NICE フレームワークでは、インシデント対応アナリスト、フォレンジックアナリストなど役割別に必要スキルを定義しています【出典:NIST SP 800-181】。

日本では、情報処理安全確保支援士(登録セキスペ)や CISSP(国際認定情報システムセキュリティ専門家)が実務能力を担保する資格として評価されます。新人研修では基本的な Linux 操作、セキュリティ基礎理論、フォレンジック演習を含め、OJT と模擬演習を組み合わせて育成します。

育成ステップと必要資格

下表は推奨される育成ステップと資格要件をまとめたものです。

u_人材育成ステップ一覧_u| ステップ | 研修内容 | 推奨資格 |

|---|---|---|

| 1. 基礎研修 | Linux 基本操作・ネットワーク基礎 | LPIC レベル1 |

| 2. セキュリティ基礎 | OWASP Top10・暗号化技術 | 情報処理安全確保支援士 |

| 3. フォレンジック演習 | デジタルフォレンジック手順実習 | CISSP/GCFA |

研修プランを示す際は、ステップと資格取得時期をタイムライン図で可視化し、人員配置と育成予算の根拠にしてください。

資格取得だけでは現場対応力は保証されません。必ず模擬インシデント演習を定期的に実施し、実務スキルを検証してください。

人材募集と社内体制強化

急速に変化するサイバーリスクに対応するには、即戦力となる人材の確保と組織体制の強化が欠かせません。公的機関の調査では、セキュリティ人材不足は全産業で深刻化しており、特にインシデント対応・フォレンジックの専門家は不足傾向にあります【出典:経済産業省『サイバーセキュリティ経営ガイドライン』2022年】。

募集要件と採用チャネル

求める人材要件は、Linux システム運用経験、Bcache やストレージ技術に関する知見、フォレンジック解析の実務経験などです。ハローワーク等の公的求人に加え、専門スクールや認定資格保有者を対象にダイレクトリクルーティングを行うことで、ミスマッチを減らせます。

社内体制と役割分担

以下の表は、インシデント対応組織の役割分担例です。

u_インシデント対応組織体制_u| 役割 | 主な担当 | 必要スキル |

|---|---|---|

| CSIRT リーダー | 全体統括・報告 | マネジメント・法令知識 |

| フォレンジック担当 | 証拠取得・解析 | フォレンジックツール操作 |

| システム担当 | 障害復旧・システム構築 | Linux・ストレージ技術 |

| コミュニケーション担当 | 社内外連携・広報 | 報告資料作成能力 |

採用要件や体制図を示し、「どのポジションにどのスキルが必要か」を明確に示してください。

体制図は複雑になりがちです。簡潔な役割分担と連携フローを示し、各担当の責任範囲を明確化してください。

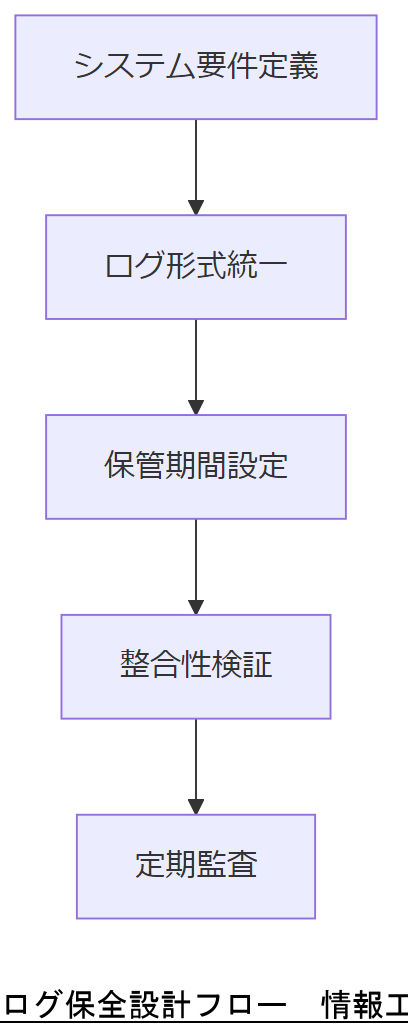

※※はじめ※※

システム設計とログ保全

BCP やフォレンジック対応を実効性あるものにするには、当初から「ログ保全」「運用管理規程」を組み込んだシステム設計が不可欠です。経済産業省の「システム管理基準」では、アクセスログ、作業ログ、システムログを時系列で記録・保管し、改ざん検知のためのハッシュ化も義務付けられています【出典:経済産業省『システム管理基準』2023年】。

また、政府機関等のサイバーセキュリティ統一基準群では、システム運用継続計画ガイドラインとして、運用管理者に対して「ログの保管期間」「アクセス制御」「バックアップ時の整合性検証」を定めることを推奨しています【出典:NISC『政府機関等のサイバーセキュリティ対策統一基準』2023年】。

ログ保全設計のポイント

- ログ形式の統一:標準フォーマット(syslog RFC5424 準拠)を採用

- 保管期間の設定:少なくとも 6 ヶ月以上、金融・医療データは 1 年以上保存

- 整合性検証:WORM ストレージやハッシュ署名で改ざん検出

ログ保全設計では「形式・期間・整合性検証」の3要件を示し、運用管理規程に明記するよう提案してください。

設計段階でログ要件を定義しないと後日追加コストが発生します。必ず要件定義フェーズで運用管理規程と連携しながら決定してください。

まとめと弊社へのご相談メリット

本記事では、Linux の Bcache 障害に対する SSD キャッシュ復旧テクニックを中心に、BCP、法令・ガイドライン準拠、フォレンジック対応、人材体制の構築まで一気通貫で解説しました。これらを自社だけで実施するのは手間とリスクが高く、経験豊富な専門家の支援が成功の鍵となります。

弊社(情報工学研究所)は、24 時間 365 日対応のインシデント駆け付け体制、機密保持契約のもとでの厳格な運用、成功報酬型プランによるコスト最適化を提供しております。豊富な復旧実績と公的ガイドライン準拠の手法で、他社では不可能だった事案も数多く解決してきました。ぜひお気軽にお問い合わせフォームよりご相談ください。

はじめに

SSDキャッシングの重要性とBcacheの役割 近年、データ処理の高速化が求められる中で、SSD(ソリッドステートドライブ)を活用したキャッシング技術が注目されています。特に、Linux環境においてはBcacheがその中心的な役割を果たしています。Bcacheは、HDD(ハードディスクドライブ)とSSDを組み合わせることで、データの読み書き速度を大幅に向上させる仕組みです。これにより、システム全体のパフォーマンスが改善され、業務の効率化が図られます。しかし、Bcacheには障害が発生する可能性もあり、その際の対処法を理解しておくことが重要です。 本記事では、Bcacheの基本的な機能とその利点を紹介し、万が一障害が発生した場合の復旧テクニックについて詳しく解説します。これにより、IT部門の管理者や企業経営陣がBcacheの障害に対する理解を深め、適切な対策を講じられるようサポートします。データの安全性を確保し、業務を円滑に進めるための知識を身につけましょう。

Bcacheの基本概念と仕組みの理解

Bcacheは、Linux環境においてHDDとSSDを組み合わせることで、ストレージのパフォーマンスを向上させるキャッシング機能です。具体的には、SSDをキャッシュとして使用し、頻繁にアクセスされるデータをSSDに保存することで、HDDへのアクセスを減少させます。これにより、データの読み書き速度が大幅に向上し、システム全体のパフォーマンスが改善されます。 Bcacheの基本的な仕組みは、SSDにデータを一時的に保存し、必要に応じてHDDからデータを取得するというものです。データがSSDにキャッシュされることで、次回のアクセス時には高速なSSDから直接データを取得できるため、レスポンスが向上します。これにより、特にデータベースやウェブサーバーなど、高速なデータ処理が求められる環境での効果が顕著です。 Bcacheは、設定が比較的簡単で、既存のHDDシステムに追加する形で導入できるため、コストパフォーマンスにも優れています。さらに、HDDの大容量を活かしつつ、SSDの高速性を享受できるため、さまざまな業種での利用が進んでいます。ただし、Bcacheの導入にあたっては、キャッシュの管理や障害発生時の対策についても考慮する必要があります。これらの理解が、Bcacheを効果的に活用するための第一歩となります。 次のセクションでは、具体的な障害事例やその対応方法に焦点を当てていきます。

Bcacheの一般的な障害とその影響

Bcacheに関連する一般的な障害には、キャッシュの破損やSSDの故障、設定ミスなどが含まれます。これらの障害が発生すると、システム全体のパフォーマンスに深刻な影響を及ぼす可能性があります。特に、キャッシュの破損はデータの整合性を損なう恐れがあり、アプリケーションの動作が不安定になることがあります。 例えば、SSDが故障した場合、キャッシュに保存されていたデータが失われるため、HDDからの読み込みが頻繁に発生し、結果として全体のレスポンスが低下します。また、設定ミスが原因でBcacheが正しく機能しない場合、SSDを活用した利点が活かされず、パフォーマンスが期待通りに向上しないこともあります。 これらの障害は、特にデータベースやトランザクション処理を行うシステムにおいて、業務の効率に直結するため、早急な対応が求められます。障害が発生した際には、まずは現状の把握と影響範囲の特定を行い、次に適切な復旧手順を実施することが重要です。具体的な復旧手順については、次のセクションで詳しく解説します。

障害発生時の初期対応とトラブルシューティング

障害発生時の初期対応として、まずはシステムの状態を確認することが重要です。具体的には、BcacheのステータスやSSDの状態を確認し、エラーログをチェックすることで、障害の原因を特定する手がかりを得ることができます。Linux環境では、`dmesg`コマンドや`cat /proc/diskstats`コマンドを使用して、システムのメッセージやディスクのパフォーマンス情報を取得できます。 次に、キャッシュの状況を確認します。Bcacheのキャッシュが正常に機能しているかどうかを調べるためには、`bcache-status`コマンドを利用することが有効です。このコマンドにより、キャッシュのヒット率やSSDの利用状況を把握できます。ヒット率が低い場合は、キャッシュの設定に問題がある可能性があるため、設定を見直す必要があります。 障害がSSDの故障に起因している場合、データの損失を最小限に抑えるために、まずはSSDを取り外し、データ復旧業者に依頼することを検討しましょう。データ復旧業者は、専門的な技術を用いて障害からの復旧を行うため、信頼できるパートナーとして活用できます。 また、設定ミスが疑われる場合は、Bcacheの設定ファイルを再確認し、正しい設定が施されているかを確認します。特に、キャッシュのサイズやポリシーが適切であるかどうかを見直すことが重要です。 これらの初期対応を通じて、障害の原因を特定し、適切な対策を講じることで、システムの復旧に向けた第一歩を踏み出すことができます。次のセクションでは、具体的な復旧手順とその実施方法について詳しく解説します。

Bcacheの復旧手順と実践的テクニック

Bcacheの障害からの復旧手順は、状況に応じた適切なアプローチを取ることが重要です。まず、キャッシュの破損やSSDの故障が確認された場合、最初に行うべきはデータのバックアップです。データ復旧業者に依頼する前に、HDDからのデータを可能な限り保存することが望ましいです。次に、Bcacheのキャッシュを無効化し、HDDのみでの運用を開始します。このステップにより、SSDに依存せずにシステムを一時的に安定させることができます。 次に、Bcacheの設定を確認し、必要に応じて再設定を行います。設定ファイルを見直し、キャッシュサイズやポリシーを適切に調整することで、再度SSDを正常に機能させることが可能です。特に、キャッシュポリシーには「writeback」や「writethrough」があり、それぞれの特性を理解した上で選択することが重要です。 SSDの復旧が必要な場合、専門のデータ復旧業者に依頼することを検討しましょう。業者は高度な技術と機器を用いてデータの復旧を行いますので、信頼できるパートナーを選ぶことが大切です。復旧後は、Bcacheの設定を再確認し、データの整合性を確保するために、システム全体のテストを行うことが推奨されます。 復旧作業が完了したら、定期的なバックアップと監視を行うことで、今後の障害発生を未然に防ぎ、システムの安定性を高めることができます。これにより、Bcacheの利点を最大限に活用し、業務の効率化を図ることができるでしょう。次のセクションでは、復旧後の運用管理や注意点について詳しく説明します。

障害防止のためのベストプラクティス

Bcacheの障害を未然に防ぐためには、いくつかのベストプラクティスを取り入れることが効果的です。まず、定期的なバックアップを実施することが基本です。データの整合性を保つためには、重要なデータを定期的に保存し、万が一の障害時にも迅速に復旧できる体制を整えておくことが重要です。 次に、システムの監視を強化しましょう。BcacheのパフォーマンスやSSDの状態を常に監視することで、異常を早期に発見し、迅速に対応することが可能です。具体的には、キャッシュのヒット率やSSDの利用状況を定期的にチェックし、パフォーマンスが低下している場合は即座に対策を講じることが求められます。 また、Bcacheの設定を見直すことも重要です。キャッシュポリシーやサイズを適切に設定し、システムの使用状況に応じた最適化を行うことで、パフォーマンスの向上が期待できます。特に、ワークロードが変化した場合には、設定を再評価することが必要です。 さらに、SSDの寿命を考慮し、定期的にハードウェアの状態を確認することも忘れずに行いましょう。SSDは消耗品であるため、劣化が進む前に交換を検討することが望ましいです。これらの取り組みを通じて、Bcacheの障害を未然に防ぎ、システムの安定性を保つことができます。次のセクションでは、これまでの内容をまとめ、今後の運用に向けたアドバイスを提供します。

Bcacheの障害から学ぶ重要な教訓

Bcacheの障害に関する知識は、システムの安定性を確保し、業務の効率を向上させるために不可欠です。これまでの内容を振り返ると、BcacheはSSDとHDDを組み合わせることでパフォーマンスを向上させる一方で、障害が発生するリスクも伴います。障害が発生した際には、まずシステムの状態を確認し、適切な初期対応を行うことが重要です。その後、データバックアップやキャッシュの無効化、設定の見直しを通じて復旧を図るべきです。 さらに、障害を未然に防ぐためには、定期的なバックアップやシステムの監視、設定の最適化が求められます。これらの対策を実施することで、Bcacheの特性を最大限に活用し、安定した運用を維持することが可能です。データの安全性を確保し、業務を円滑に進めるために、これらの知識を活かしていきましょう。 Bcacheの障害に関する理解を深め、実際の運用に役立てるために、ぜひ専門的な情報を収集し、必要な対策を講じてください。データ復旧の専門家と連携し、万が一の事態に備えることが重要です。データの安全性を確保し、業務の効率化を図るための一歩を踏み出しましょう。 ※当社は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。

さらなる情報を得るためのリソースリンク

Bcacheの障害に対する理解を深めることは、システムの安定性と業務の効率化に直結します。障害が発生した際には、迅速かつ適切な対応が求められます。そのため、データ復旧の専門家と連携し、事前に対策を講じておくことが重要です。信頼できる情報源からの知識を活用し、定期的なバックアップやシステム監視を行うことで、障害リスクを軽減できます。また、Bcacheの設定や運用に関する最新の情報を収集し、常に最適な環境を維持しましょう。データの安全性を確保し、業務の円滑な運営を実現するために、今すぐ行動を起こしてください。 ※当社は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。

Bcache運用時の注意事項とリスク管理

Bcacheを運用する際には、いくつかの注意点とリスク管理が必要です。まず、SSDとHDDの組み合わせを適切に行うことが重要です。SSDの選定は、性能や耐久性を考慮し、信頼できるメーカーの製品を選ぶことをお勧めします。特に、SSDの寿命や書き込み回数に注意し、劣化が見られた場合は早めの交換を検討しましょう。 また、Bcacheの設定においては、キャッシュポリシーの選択がシステムのパフォーマンスに大きく影響します。「writeback」や「writethrough」の特性を理解し、運用環境に応じた最適なポリシーを選ぶことが求められます。設定ミスを防ぐためにも、設定内容を定期的に見直し、必要に応じて調整を行うことが重要です。 さらに、障害発生時の初期対応を迅速に行うために、エラーログの監視や定期的なバックアップを実施することが不可欠です。データ損失を最小限に抑えるため、バックアップの頻度を高め、重要なデータは複数の場所に保存することを推奨します。これにより、万が一の事態に備えることができ、システムの安定性を維持することが可能です。 これらの注意点を踏まえ、Bcacheの運用を行うことで、より安全で効率的なシステム管理が実現できます。

補足情報

※株式会社情報工学研究所は(以下、当社)は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。