# 直近のカーネルメッセージ(時刻付き) dmesg -T | tail -n 120 直近ブートのカーネルログ(systemd環境) journalctl -k -b --no-pager | tail -n 180 典型的なハード障害サインを抽出(まずは粗く) journalctl -k -b --no-pager | egrep -i "i/o error|blk_update_request|reset|timeout|nvme|ata|scsi|medium error|crc|uncorrect|xid|pcie|mce|edac" どのデバイス名が出ているかを拾う(sda/nvme0n1 など) journalctl -k -b --no-pager | egrep -o "sd[a-z]+|nvme[0-9]+n[0-9]+|dm-[0-9]+|md[0-9]+" | tail -n 40

まず対象デバイスとマウント位置を特定(読むだけ) lsblk -o NAME,TYPE,SIZE,MODEL,SERIAL,FSTYPE,MOUNTPOINTS findmnt -a SMARTが取れるなら状態だけ確認(読むだけ) sudo smartctl -x /dev/sdX NVMeならSMART相当(読むだけ) sudo nvme smart-log /dev/nvme0 link reset / CRC / timeout の頻度を確認(読むだけ) journalctl -k -b --no-pager | egrep -i "link reset|crc|timeout|resetting|aborted command|nvme.*reset"

カーネル側のFSメッセージを抽出(読むだけ) journalctl -k -b --no-pager | egrep -i "ext4|xfs|btrfs|I/O error|metadata|journal|corrupt|checksum" 影響ボリューム(dm-/md-含む)を把握(読むだけ) lsblk -f blkid まずはマウント状態と read-only 化の有無を確認(読むだけ) mount | egrep -i " ro[,)]| rw[,)]"

MCE/EDAC/PCIe関連を抽出(読むだけ) journalctl -k -b --no-pager | egrep -i "mce|machine check|edac|ras|pcie|aer|corrected|uncorrected" 直近の再起動・異常終了の気配(読むだけ) last -x | head -n 30 journalctl -b --no-pager | egrep -i "panic|oops|BUG:|Call Trace|watchdog|soft lockup|hard lockup" | head -n 80

前回ブートのカーネルログ(残っていれば最優先) journalctl -k -b -1 --no-pager | tail -n 200 永続ジャーナルの有無と容量(読むだけ) journalctl --disk-usage ls -la /var/log/journal 2>/dev/null rsyslog系のカーネルログが残っていないか(読むだけ) ls -la /var/log | egrep -i "kern|syslog|messages|dmesg" sudo zgrep -h -i "i/o error|timeout|reset|nvme|ata|scsi|ext4|xfs|btrfs" /var/log/kern.log* /var/log/syslog* /var/log/messages* 2>/dev/null | tail -n 120 予期せぬ再起動で pstore が残る環境なら(読むだけ) ls -la /sys/fs/pstore 2>/dev/null

# どのマウント/どのデバイスが関係するか(読むだけ) findmnt -a lsblk -o NAME,TYPE,FSTYPE,SIZE,MOUNTPOINTS 共有・ネットワーク系が絡むか(読むだけ) mount | egrep -i "nfs|cifs|gluster|ceph|fuse|sshfs|overlay" RAID/LVM/暗号化などの層(読むだけ) cat /proc/mdstat 2>/dev/null sudo pvs 2>/dev/null; sudo vgs 2>/dev/null; sudo lvs 2>/dev/null sudo cryptsetup status --all 2>/dev/null 重要サービスの稼働状況(読むだけ) systemctl --failed --no-pager systemctl status docker containerd kubelet 2>/dev/null | head -n 40

- 劣化ディスクに対して修復系(fsck/書き込み)を先に当てて、読み出し不能が増える。

- ログのvacuum/ローテート整理で証跡が消え、原因特定と説明責任が難しくなる。

- 対象デバイス取り違えで別ボリュームに上書きしてしまい、復旧が長期化する。

- 共有・本番環境で権限や設定を広く触って波及し、停止や監査対応に発展する。

もくじ

- 第1章:dmesgは「後から読むログ」ではなく、障害と会話するための“実況”である

- 第2章:「消えたはずのI/Oエラー」が戻ってくる理由──カーネルは“削除”ではなく“上書き”する

- 第3章:まず押さえる3種類の現場ノイズ──ring buffer、rate limit、driverの言い回し

- 第4章:ハード障害のシグナルはここに出る──block層・SCSI/ATA層・ファイルシステム層の関係

- 第5章:「I/O error」の正体を分解する──timeout/reset/medium error/link down

- 第6章:削除ログを“再現”する発想──同じエラーを出すのではなく「同じ経路を踏む」

- 第7章:再現環境の作り方──負荷・温度・ケーブル・電源・コントローラ差分を固定する

- 第8章:観測の設計──dmesgだけで終わらせず、smartctl・nvme-cli・journalctl・iostatを束ねる

- 第9章:因果を確定する手順──「疑わしい順」ではなく「壊れる順」で切り分ける

- 第10章:帰結:ログが消えても壊れた事実は消えない──“消える前提”で運用を組み替える(相談の勧め)

【注意】 本記事はLinuxカーネルログ解析の一般的な解説です。実環境では機器構成・負荷・ドライバ・ファームウェア・保守契約などで判断が変わります。障害の切り分けやデータ保全が必要な場合は、株式会社情報工学研究所のような専門事業者への相談も検討してください。

第1章:dmesgは「後から読むログ」ではなく、障害と会話するための“実況”である

障害対応でいちばんつらいのは、「何が起きたか」が分からないことよりも、「分かるはずの手がかりが消えている」ことです。ディスクが一瞬だけタイムアウトして復帰した、ケーブルが揺れてリンクが落ちた、コントローラがリセットをかけた──その瞬間の実況が dmesg に出るのに、後で見たら流れてしまっている。これが“削除ログ”の実態です。

ここで重要なのは、dmesg は「ログファイル」ではなく、カーネルが出力するメッセージのバッファ(ring buffer)を読むための表示手段だという点です。バッファなので容量は有限で、古いものから上書きされます。つまり、時間が経つほど“過去は消える”構造です。

「消えた」の正体:ring bufferと出力経路

Linuxのカーネルメッセージは、概ね次の経路で流れます。

| 層 | 役割 | 観測の入口 |

|---|---|---|

| kernel ring buffer | カーネル内部のメッセージ蓄積(有限で上書き) | dmesg |

| kmsg/console | kmsgデバイスやコンソールへの出力 | journalctl -k / コンソールログ |

| journald/syslog | 永続化・フィルタ・転送(設定次第) | /var/log / 集約基盤 |

「dmesgに無い=起きていない」と短絡しやすいのですが、実際には「ring bufferからは消えたが、journaldやログ集約には残っている」ケースもあります。逆もあります(出力がrate limitで抑制され、永続化側に十分残らない)。

現場の“心の会話”:後から調べるほど不利になる

「いまは復旧してるし、後でゆっくり確認でいいか」──そう思った瞬間に、調査の難易度は上がります。ring bufferは上書きされ、ドライバは同じ警告をrate limitで間引き、システムは次のイベントでログを押し流します。だからこそ、障害対応は“原因究明のための採取”を最優先に組み込む必要があります。

この章の伏線:再現とは「同じエラーを出す」ではない

本記事のテーマは「削除ログ再現」ですが、ここで言う“再現”は、同じメッセージ文字列をもう一度出すことではありません。ログが消える条件(上書き、間引き、出力経路の欠落)を理解し、同じ経路・同じ層で起きた事象を観測可能な形で再度踏むことです。次章から、その前提となる「なぜログが消えたように見えるのか」を分解します。

第2章:「消えたはずのI/Oエラー」が戻ってくる理由──カーネルは“削除”ではなく“上書き”する

「昨日の深夜、I/Oエラーが出たって聞いたのに、今 dmesg を見ても無い」──これは“証拠隠滅”ではなく、構造上の必然です。カーネルメッセージは有限バッファに蓄積され、古い順に上書きされます。つまり、観測が遅いほど、過去の痕跡は薄れます。

ring bufferの“容量”がつくる罠

ring bufferのサイズは環境・設定に依存します。大量のログが出る状況(ドライバの警告ループ、ネットワークのリンクアップダウン、ファイルシステムの再試行など)では、短時間で押し流されます。特にハード障害系は「同じ警告の繰り返し」が多く、重要な1行がノイズに埋もれて消えがちです。

一方で、journalctl -k を使うと、journaldが保持しているカーネルログを時系列で追えることがあります。つまり、dmesg しか見ていないと「消えた」と誤認しやすい。まず観測点を増やすことが第一歩です。

「戻ってくる」現象:同じ根本原因が形を変えて再発する

もう一つの典型が、「一度消えたはずのI/O問題が、別のタイミングで“別のメッセージ”として戻ってくる」ことです。例として、次のような連鎖が起こり得ます。

- 最初は軽微な遅延(timeout寸前)として現れる

- 次にコントローラやリンクのリセットとして現れる

- さらに進むと、ブロック層でI/O errorとして顕在化する

- 最終的にファイルシステムがread-only化やエラーを報告する

メッセージ文字列が変わるので、現場では「別件」に見えます。しかし根は同じ(媒体劣化、ケーブル不良、バックプレーン、HBA、電源品質、温度、ファームウェア不整合など)で、症状が段階的に悪化しているだけ、というケースが少なくありません。

削除ログ“再現”に必要な設計:消える前提で保全する

ここまでで分かるのは、「ログが無い」こと自体が診断材料になる、という点です。ログが無いのは、起きていないからではなく、保持される設計になっていないからかもしれません。再現に向けては、少なくとも次のどれかが必要になります。

- 永続化:journaldの永続化設定、syslogへの転送、ログ集約(外部送信)

- 即時採取:障害の兆候を検知した瞬間に

dmesg/journalctl -kを退避 - 帯域の確保:ログが押し流されないよう、ノイズ源(ループログ)を抑え、観測点を整理

ただし注意点として、ハード障害が疑われる局面で「ログを取りたいから」と負荷を上げすぎるのは危険です。媒体が不安定なら、追加の読み書きが障害を進行させる可能性があります。後半章では、この“採取と安全”のバランスを具体的に扱います。

この章の伏線:次は「ノイズ」を見分ける

削除ログ再現をやるなら、次に必要なのは「何を本線として追うか」です。現場のカーネルログはノイズだらけで、重要な兆候は短く、言い回しもドライバ依存です。次章では、まず“ノイズの種類”を分類し、追うべきシグナルを取りこぼさないための読み方に落とします。

第3章:まず押さえる3種類の現場ノイズ──ring buffer、rate limit、driverの言い回し

「ログは見た。でも確証が持てない」──この状態を作る最大の要因がノイズです。特にハード障害の初期兆候は、派手な“故障宣言”ではなく、地味な遅延・再試行・リセットとして現れます。その上に、ログの仕組み由来のノイズが乗ります。

ノイズ1:ring bufferの上書き(重要ログが物理的に残らない)

第1章・第2章で触れた通り、dmesg の元になるring bufferは有限です。障害時はログが増えやすく、重要な瞬間が押し流されがちです。したがって、障害解析は「いつ見たか」が品質を左右します。

- まず

journalctl -kで永続側に残っていないか確認する - 残っていないなら、次回に備えて永続化・転送・即時採取の設計を入れる

ノイズ2:rate limit(同じ警告が“間引かれて”見えなくなる)

カーネルやjournaldには、ログの洪水を防ぐためのrate limit(出力制限)が存在します。これにより、同じ種類のメッセージが大量に出ている状況ほど、「最初の数件だけが見えて、肝心の後半が消える」ことが起きます。結果として、原因の進行度合いや頻度を誤認しやすくなります。

ここでの実務的な対策は「rate limitを解除して全部取る」ではありません。障害時にログを増やすと、観測自体が重くなり、さらにバッファを圧迫します。むしろ、次のように設計するのが安全です。

- 本番ではログを“取れる形”に整える(永続化・転送・時刻同期)

- 再現環境ではrate limitの影響を見越して、複数の観測点(ドライバ、ブロック層、FS層)を同時に取る

ノイズ3:driverの言い回し(同じ事象が別名で出る)

ハード障害に関するログは、層とドライバで表現が変わります。たとえば「タイムアウト」一つでも、SATA/ATA、SCSI、NVMe、RAIDコントローラで文言が違います。さらに、上位層(ファイルシステム)には「I/O error」や「read-only remount」など別の形で現れます。

| 観測層 | よく出る兆候 | 解釈のポイント |

|---|---|---|

| ドライバ/リンク層 | link down/up、reset、timeout | ケーブル/バックプレーン/コントローラ/電源品質の疑い |

| ブロック層 | I/O error、request timeout、abort | 再試行の結果として表面化。頻度と対象LBA/デバイスを追う |

| ファイルシステム層 | ext4/xfsのエラー、read-only化 | “被害最小化”のための保護動作。原因は下位層にあることが多い |

ここまでの伏線回収:再現の前に「何を再現するか」を決める

削除ログを再現したいとき、やりがちなのが「同じメッセージを出すテスト」ですが、これは本質から外れます。大事なのは、どの層で、どの種類の兆候が最初に出たのかを特定し、その層を中心に観測を組むことです。たとえば「リンクリセットが最初」ならケーブル・バックプレーン・HBAの観測が主役になりますし、「特定LBAでの読み取り遅延が最初」なら媒体劣化・再配置・SMART/NVMeログが主役になります。

次章では、層の関係(block層・SCSI/ATA層・ファイルシステム層)を“頭の中で図にできる”形に整理し、ログの読み違いを減らします。そこから先で、再現環境の作り方と、観測の束ね方に進みます。

/

第4章:ハード障害のシグナルはここに出る──block層・SCSI/ATA層・ファイルシステム層の関係

ハード障害を示すカーネルメッセージは、単発の「I/O error」だけで完結しません。むしろ多くの場合、複数の層が連鎖してログが出ます。ここを理解しているかどうかで、「見えているログから何が言えるか」が変わります。

まず全体像:下位の異常が上位に“翻訳”される

Linuxストレージのログは、大まかに次の層で出ます。

- 物理〜リンク層:SATA/SAS/NVMeのリンク、ケーブル、バックプレーン、HBA、電源品質などの影響が出やすい

- デバイス/プロトコル層:SCSI(SAS/FC/iSCSIなど含む)、ATA、NVMeなどのコマンド処理・エラー報告

- ブロック層:I/O要求(request)のタイムアウト、再試行、失敗が集約される

- ファイルシステム層:ext4/xfs/btrfs等が整合性を守るために警告やread-only化を行う

- アプリ層:最終的にread(2)/write(2)がEIO等で失敗し、アプリやDBが異常を示す

ポイントは、上位に行くほど抽象化され、原因の情報が削れていくことです。たとえばアプリが「Input/output error」を出しても、それが媒体劣化なのか、リンク不安定なのか、コントローラのリセットなのかは分かりません。原因に近い情報は下位層にあります。

“どこを起点に読むか”の実務ルール

現場で迷いがちな読み方を、判断しやすい形に落とします。

| 最初に目についたログ | 次に当たる層 | 狙うべき追加情報 |

|---|---|---|

| ext4/xfsの整合性警告 | ブロック層 → デバイス層 | 同時刻のI/O error、timeout、reset、対象デバイス名(sda/nvme0n1等) |

| I/O error / request failed | デバイス層(SCSI/ATA/NVMe) | sense key/ASC/ASCQ、ATA error、NVMe status、reset履歴 |

| link down/up / controller reset | 物理〜リンク層 | ケーブル/バックプレーン/電源/温度、同一ポートでの再発、別ディスクへの波及 |

「削除ログ再現」の伏線:層ごとに“再現の目的”が違う

ここで重要な伏線があります。削除ログを“再現”すると言っても、層によって再現の狙いは変わります。

- リンク層が主因なら:同一ポートでリンクの瞬断やリセットが起きる条件(ケーブル・振動・温度・電源)を再現し、同時に観測する

- 媒体/デバイス層が主因なら:特定の読み取り遅延やエラー報告(SMART/NVMeログ含む)を観測できる状態で、危険な負荷を避けつつ兆候を捉える

- ファイルシステム層が主因に見えるなら:実際は下位のI/O問題が起点か、メモリ/バグ/設定(例:突然の電断、キャッシュ破損)が起点かを切り分ける

次章では、現場でよく見る「I/O error」という一言の中身を分解し、何を見れば“どの種類の異常か”を言えるのかを整理します。

第5章:「I/O error」の正体を分解する──timeout/reset/medium error/link down

「I/O errorが出ました」と言われたとき、エンジニアは反射的にこう思います。「で、どのI/O?」「どの層?」「再試行は?」「同時刻に何が起きてる?」。この章では、その“腹落ち”に必要な分解軸を、ログの読み方としてまとめます。

よくある4分類:現場の判断が速くなる

同じI/O失敗でも、背景が違うと対処が変わります。実務上は次の4分類が有用です。

| 分類 | 典型的な兆候 | 疑う範囲 |

|---|---|---|

| timeout系 | request timeout、command timeout、I/Oが完了しない | 過負荷、キュー詰まり、デバイスの応答遅延、ファームウェア、温度 |

| reset系 | controller reset、bus reset、link reset、device reset | リンク不安定、コントローラ/HBA、電源品質、ケーブル/バックプレーン |

| medium error系 | 読み出し不可、uncorrectable、reallocated増加など(S.M.A.R.T.側にも兆候) | 媒体劣化、NAND/磁気面の劣化、ECC限界、寿命 |

| link down系 | link down/up、PHY reset、CRC errorに関連する兆候 | ケーブル、コネクタ接触、バックプレーン、振動、温度、電源ノイズ |

「心の会話」:交換すべきはディスク?それとも周辺?

ここで現場が悩むのは、「ディスクを交換して終わりにしたい」気持ちと、「周辺が原因なら交換しても再発する」現実の間です。たとえばlink down系が出ているのにディスクだけ交換すると、同じポートで次のディスクも落ちます。逆にmedium error系でディスクが劣化しているのに、ケーブルを疑って時間を使うと、劣化が進んで救出難易度が上がります。

“削除ログ”があっても確度を上げるコツ:時刻・対象・頻度

ログが消えていたり間引かれていたりしても、確度を上げるためのコツがあります。ここでは、事実ベースで積み上げる方法に限定します。

- 時刻:同じタイムウィンドウ(±数分〜十数分)で、下位層→上位層の連鎖がないかを見る

- 対象:デバイス名(sda/sdb、nvme0n1等)と、その背後(RAID仮想か、物理か)を一致させる

- 頻度:単発か、周期的か、負荷に比例するか。単発でも“兆候”として扱う

特に、周期性や負荷依存は再現の設計に直結します。たとえば「バックアップ時間帯にだけ出る」なら、I/Oが増えたときにキューや温度が上がる条件が関与している可能性があります。

次章への伏線:再現は“同じエラー”ではなく“同じ経路”

ここまでで、「I/O error」と一口に言っても背景が違うことが分かりました。次章では、削除ログ再現の考え方として、同じメッセージを出すのではなく、同じ経路(層)で同じ種類の異常が起きる状況を作るという方針に落とします。そのために必要な、再現環境・観測設計の最小構成を提示します。

第6章:削除ログを“再現”する発想──同じエラーを出すのではなく「同じ経路を踏む」

「削除されたログを再現する」と言うと、どうしても“同じログ行を出す”方向に引っ張られます。しかし、それは危険です。ハード障害の兆候を無理に出そうとして、ディスクに過剰な負荷をかけたり、運用環境で不必要な操作をしたりすると、被害が拡大する恐れがあります。

ここでの再現は、あくまで解析のための再観測です。目的は「メッセージ文字列の復元」ではなく、「因果の確定」にあります。

再現の定義:観測可能な形で因果の鎖をもう一度作る

実務での再現は、次の3点が揃って初めて意味があります。

- 条件が固定されている(負荷、温度、構成、ファームウェア、ケーブル、HBAなど)

- 観測が同時に取れている(dmesg/journalctlだけでなく、SMART/NVMe、I/O統計など)

- 安全が担保されている(データ保全が優先。危険な書き込みや長時間の連続負荷を避ける)

これが揃わない再現は、「派手なログが出た/出ない」に引きずられて結論がぶれます。

再現を設計するための“最小セット”

まずは、環境差分で議論が崩れないように、最低限押さえる要素を表にまとめます。

| 要素 | 固定/記録する理由 | 例 |

|---|---|---|

| デバイス経路 | 同じ物理経路でないと別原因になる | 同一スロット/同一ポート/同一HBA |

| 負荷特性 | 症状が負荷依存の場合が多い | ランダム/シーケンシャル、read多め/write多め |

| 温度・電源 | 境界条件で不安定化しやすい | 夜間だけ出る、ピーク時だけ出る |

| ソフト層 | ドライバ/FS設定で出方が変わる | kernel/driver、RAID、FS種別、mountオプション |

「一般論の限界」を先に言っておく:再現は環境依存が大きい

ここは誤解が起きやすいので明確にします。ハード障害の兆候は、ストレージ構成(直結、RAID、SAN、仮想化)、ドライバ、ファームウェア、機器世代によって現れ方が違います。同じ「timeout」でも、ログの文言や上位への波及は変わります。したがって、再現と因果確定は個別案件の設計問題です。

このブログでは、どの環境でも通用する「層の見方」と「観測設計」を示しますが、実際の案件で「どこまで負荷をかけてよいか」「どこでデータ保全を優先すべきか」は、保守契約・RPO/RTO・データ重要度で変わります。ここが、後半で株式会社情報工学研究所のような専門家への相談が意味を持つ理由でもあります。

次回への伏線:再現環境の作り方(安全設計)に入る

次章では、再現環境の作り方を「危険を増やさない」観点で具体化します。負荷・温度・ケーブル・電源・コントローラ差分をどう固定するか、そしてdmesgに頼らず観測を束ねて“消える前提”で証拠を残す方法へ進みます。

第7章:再現環境の作り方──負荷・温度・ケーブル・電源・コントローラ差分を固定する

ハード障害の兆候を追うとき、いちばん危険なのは「とりあえず同じ操作をもう一回やってみる」です。偶然再発することもありますが、再発しなければ“問題なし”と誤認しがちですし、再発させようとして負荷を上げると、データ保全の観点で取り返しがつかない場合があります。ここでは、安全に再観測するための再現環境を、要素分解して固定する考え方を示します。

固定すべき4軸:差分が残ると結論が揺れる

再現で本当に必要なのは「同じ機器」より「同じ条件」です。最低限、次の4軸を固定・記録します。

| 軸 | なぜ重要か | 固定・記録の例 |

|---|---|---|

| 負荷 | 症状が負荷依存で出たり消えたりする | read/write比率、ランダム/シーケンシャル、I/O深度、同時ジョブ数 |

| 温度 | 境界条件で不安定化しやすい | 筐体吸排気、ファン回転、季節/時間帯、SMART温度 |

| 物理経路 | ケーブル/ポート/バックプレーンで症状が変わる | 同一スロット、同一ポート、同一ケーブル、同一HBA |

| 電源品質 | 瞬断・電圧降下・ノイズがリセットを誘発することがある | UPS有無、電源系統、PDU、冗長電源の片系運用有無 |

安全設計の基本:再現より「保全」が優先

現場の“心の会話”としてよくあるのが、「原因を突き止めたいけど、これ以上悪化させたくない」という葛藤です。これは健全な疑いです。再現の前に、まず次の優先順位を明文化します。

- データ保全(最優先):必要なら即時に読み取り中心の保全計画へ移る

- サービス継続:冗長構成ならフェイルオーバーや退避で影響を抑える

- 原因究明:安全な範囲で観測と切り分けを行う

この優先順位が曖昧だと、「ログを取りたい」気持ちで危険な負荷試験に進んでしまいます。特に媒体劣化が疑われる場合、再現試験は“壊す試験”になり得ます。ここは一般論では線引きできず、データ重要度・バックアップ状況・保守契約・復旧目標で決まります。

再現環境の現実解:本番と同等にせず、比較可能にする

理想は「本番と同じ構成で再現」ですが、現実には難しいことが多いです。そこで実務では、次の方針が有効です。

- 同等構成が無理なら、差分を減らす(同型筐体、同型HBA、同型ケーブル)

- 差分が残るなら、差分を記録して解釈に織り込む(世代差・ファーム差)

- 再現で得たいのは“派手な故障”ではなく、兆候の層と種類(timeout/reset/link/medium)

次章では、再現環境で「何を同時に取るべきか」を具体化します。dmesgだけを見ていると、また“消える”からです。

第8章:観測の設計──dmesgだけで終わらせず、smartctl・nvme-cli・journalctl・iostatを束ねる

削除ログ再現の実務で最重要なのは、「ログが消える前提」で観測を設計することです。dmesgは便利ですが、有限バッファであり、障害時ほど押し流されます。したがって、複数の観測点を束ねて同じ時刻に並べることが基本になります。

観測は“層ごと”に揃える:一つの証拠に依存しない

最小構成として、少なくとも次の4系統を揃えると、因果が追いやすくなります。

| 観測系統 | 目的 | 例 |

|---|---|---|

| カーネルログ | リセット、タイムアウト、エラー報告の一次情報 | journalctl -k、必要に応じてdmesg退避 |

| デバイス健全性 | 媒体劣化やエラー蓄積の兆候 | SATA/SAS: SMART(smartctl)、NVMe: SMART/ログ(nvme) |

| I/O統計 | 負荷依存・詰まり・遅延の可視化 | iostat、pidstat、vmstatなど |

| サービス側ログ | アプリへの影響の時刻合わせ | DBログ、アプリログ、監視アラート時刻 |

観測で絶対に外せない前提:時刻の整合

“同じ時刻に並べる”ために、時刻がズレていると解析が崩れます。NTP/chrony等で同期されているか、タイムゾーンが一致しているか、ログのタイムスタンプ形式が混在していないかを確認します。これは地味ですが、事実ベースの解析では致命的な差分になります。

ログが消える状況の典型:洪水と間引き

障害時にログが消えるのは、次の2パターンが多いです。

- 洪水(flood):同じ警告が大量に出て、ring bufferが短時間で上書きされる

- 間引き(rate limit):同じメッセージが抑制され、頻度や連鎖が見えにくくなる

この状況では、dmesg単独に頼ると「何も起きていないように見える」ことすらあります。そこで、観測を束ねます。たとえば、カーネルログが間引かれていても、I/O統計(待ち時間の上昇)やデバイス健全性(エラー累積)が同時刻に動いていれば、兆候は追えます。

“束ねる”とは何か:1本の線にする

束ねるとは、単にデータを集めることではなく、次のように「同時刻の出来事」を一つの線として読める形にすることです。

- 監視・アラートの発火時刻を起点にする

- 同時刻の

journalctl -kを抜き出す - 同じ窓でI/O統計(待ち時間/スループット)を確認する

- デバイス健全性(SMART/NVMe)で累積兆候を確認する

この手順により、ログが部分的に欠落していても「どの層が先に異常を出したか」を推定できます。推定は推定ですが、根拠が並びます。根拠が並べば、次章の「因果確定」に進めます。

伏線:終盤で効いてくる「一般論の限界」

ここで一つ、後半につながる伏線を置きます。観測が整ってくると、次に必ず出る問いがあります。「で、これは交換?それとも周辺?」「データ保全はどこまで急ぐ?」。ここは一般論が通用しづらい領域です。だからこそ、観測の事実を基に、個別案件として意思決定できる状態が必要になります。次章では、その“意思決定可能な因果”を作る手順に入ります。

第9章:因果を確定する手順──「疑わしい順」ではなく「壊れる順」で切り分ける

障害対応でありがちな落とし穴は、「経験則で疑わしいもの」から手を付けて、結果的に証拠を壊してしまうことです。ここで目指すのは、推測ではなく、観測された事実の順序で因果を積み上げることです。言い換えると、「壊れる順」に切り分けます。

切り分けの軸:先に出た層を起点にする

因果の確定は、次の問いに答える作業です。

- 最初に異常を示したのはどの層か(リンク/デバイス/ブロック/FS/アプリ)

- その層の異常が、上位層のエラーにつながる連鎖になっているか

- 同じ対象(同じ物理ディスク/同じポート)で再発しているか

ここが揃うと、単発ログが欠けていても「筋の通った説明」が可能になります。

実務手順:証拠を壊さずに“候補を潰す”

ここでは、安全側に倒した実務手順を提示します。環境により順序は入れ替わり得ますが、考え方は共通です。

ステップ1:まず「波及範囲」を確認する

同じ筐体で複数ディスクに兆候が出ているのか、特定ディスクだけなのかを確認します。複数に出るなら、ディスク単体よりも周辺(バックプレーン、HBA、電源、温度、筐体)を疑う根拠になります。

ステップ2:リンク系の兆候があるなら“先に”扱う

link down/upやリセットが先に出ている場合、ディスク交換だけでは解決しない可能性があります。ここで重要なのは「同じポートで再発するか」です。同じポートで再発するなら、物理経路の問題が濃くなります。

ステップ3:媒体劣化の兆候は“時間の味方をしない”

medium error系(読み出し不能、訂正不能、エラー累積)が疑われる場合、判断を先延ばしすると状況が悪化し得ます。ここでのポイントは、過剰な再現試験で追い込まないことです。観測の範囲で兆候が出ているなら、データ保全を優先する判断が現実的です。

「心の会話」:上司への説明が難しいのは、一般論では決められないから

現場の本音として、「交換すれば直ると言い切れない」「でも交換しない理由も説明しづらい」という苦しさがあります。これは、一般論では線引きできないからです。どこまでを“被害最小化”として優先するかは、RPO/RTO、保守契約、データ価値、停止許容時間、バックアップ状況で変わります。

だからこそ、説明の軸は「勘」ではなく「観測された順序」です。たとえば「リンクリセット→I/O timeout→FS警告」という順序が取れていれば、周辺起因の可能性を根拠付きで説明できます。逆に「特定ディスクの媒体エラー兆候→I/O error→FS read-only」という順序なら、ディスク起因の説明が可能です。

次章への伏線:終盤は“意思決定”の章になる

ここまでで、ログが消えても因果を作れる骨格ができました。次に必要なのは、「では現場として何を選ぶか」です。終盤では、導入・移行・保守・契約・構成の話に踏み込みます。一般論の限界を認めた上で、個別案件として設計し直す──そのときに、株式会社情報工学研究所のような専門家に相談する意味が自然に出てきます。

第10章:帰結:ログが消えても壊れた事実は消えない──“消える前提”で運用を組み替える

ここまでの結論はシンプルです。ログが消えたことは、原因が消えたことを意味しません。消えるのは「観測設計」がそうなっているからで、ハード障害やリンク不安定といった事象は、別の形でまた現れます。だから、やるべきことは「dmesgを頑張って読む」だけではなく、消える前提で運用を組み替えることです。

運用を組み替える3本柱:永続化・即時退避・相関

“削除ログ再現”が必要になる現場は、多くの場合、次の3つが不足しています。

- 永続化:カーネルログが後から追える形で保持されていない

- 即時退避:兆候が出た瞬間に、必要な範囲を切り出して退避できない

- 相関:I/O統計・デバイス健全性・アプリ影響が同じ時刻で並ばない

この3本柱が揃うと、「ログが少し欠けた」程度では結論が崩れにくくなります。

永続化:dmesg依存から脱却する

dmesg はring bufferの表示であり、保持の仕組みではありません。したがって、運用では「カーネルログを永続側に残す」設計が重要です。代表例としては、journaldでカーネルログを保持し、必要に応じてsyslogやログ集約へ転送します。

ただし、ここにはトレードオフがあります。ログを“全部”残そうとすると、障害時の洪水でストレージやCPUを圧迫し、別の問題を誘発することがあります。よくある対処は次のバランスです。

- 保持期間・容量を決める(「いつまで遡れれば意思決定できるか」)

- 重大度の高いイベントは外部に退避し、詳細はローカルに短期保持する

- rate limitの影響を前提に、別系統の観測(I/O統計、健全性)も併走させる

即時退避:障害対応の“最初の一手”を手順化する

現場の苦しさは、「後で見よう」と思った時点で、観測が不利になることです。したがって、障害時の最初の一手は「復旧作業」だけでなく、「証拠の退避」を含む手順にする必要があります。

ここで言う退避は、過剰な作業ではありません。たとえば「同時刻のカーネルログ抜き出し」「I/O統計のスナップショット」「デバイス健全性の要約取得」といった、短時間で終わる採取です。ポイントは、後で相関できる粒度で残すことです。

相関:時刻で“1本の線”にする

意思決定を可能にするのは、ログ単体ではなく「連鎖」です。たとえば次のように、同じ時間窓で揃っていると、因果の説明がしやすくなります。

| 観測 | 同時刻に見えると強い根拠 | 示唆 |

|---|---|---|

| カーネルログ | timeout / reset / link down などの一次兆候 | どの層が先に異常を示したか |

| I/O統計 | 待ち時間の上昇、キュー滞留、スループット低下 | 負荷依存か、詰まりか、瞬断か |

| 健全性情報 | エラー累積、寿命指標の悪化、温度上昇 | 媒体劣化か、環境要因か |

| アプリ影響 | 同時刻の遅延/失敗、再試行の増加 | 業務影響と優先度判断 |

“一般論の限界”を正面から扱う:運用設計は契約と要件で決まる

ここで必ず出るのが、「結局どうすれば安全か」という問いです。しかし、これは一般論で一刀両断できません。データが重要でバックアップが薄いなら、再現より保全が優先です。冗長が強く交換が容易なら、周辺を含めた段階的交換で“歯止め”をかけられることもあります。監視・ログ保持の強化も、保持コストやセキュリティ要件(機密情報の扱い)で線引きが必要です。

だからこそ、ここまで積み上げた「観測→相関→因果」の枠組みが意味を持ちます。事実ベースで説明できれば、現場の判断が孤立しにくくなり、組織として“場を整える”ことができます。

次章への伏線:最後は「意思決定」と「相談」の章になる

終盤では、具体的に「どのパターンなら何を優先すべきか」を整理し、一般論の限界を認めた上で、個別案件として設計し直す導線を作ります。そのとき、株式会社情報工学研究所のような専門家に相談する価値が、押し付けではなく自然に浮かび上がる形にします。

第11章:終盤の実務整理──パターン別に「優先順位」と「次の一手」を決める

ここからは、現場が実際に悩む「次の一手」を、観測パターン別に整理します。重要なのは、“正解探し”ではなく、被害最小化の優先順位を明確にして、意思決定を前に進めることです。

パターン別:観測された事実から優先順位を決める

| 観測パターン | 示唆 | 優先すべき次の一手(例) |

|---|---|---|

| link down/up や reset が先行し、複数ディスクに波及 | 周辺(ケーブル/バックプレーン/HBA/電源/温度)起因の可能性が高い | 物理経路の点検・差し替え、同一ポート再発の確認、ログ相関の強化 |

| 特定ディスクで timeout が増え、I/O待ちが伸びる | デバイス応答遅延(負荷・温度・寿命・FW要因)の可能性 | 負荷条件の把握、温度/電源の確認、健全性情報の確認、保全計画の検討 |

| 媒体劣化を示す兆候が累積し、I/O error が出る | 媒体起因の可能性が高く、時間経過で悪化し得る | 安全側へ(保全優先、不要な負荷を避ける、復旧手順の確立) |

| FSがread-only化/整合性警告、下位層にI/O兆候 | FSは保護動作。原因は下位層にあることが多い | 下位層ログの収集、影響範囲の確認、復旧と保全の両立設計 |

「心の会話」:結局、交換?保全?どっち?

「交換すれば早い。でも交換しても直らなかったら?」

「保全したい。でも保全のための作業が業務を止めるかも…」

こういう迷いは自然です。ここで大事なのは、迷いを“気合い”で押し切らず、意思決定の材料を揃えることです。材料とは、観測された順序と、影響の範囲と、データの重要度です。どれかが欠けると、結論が揺れ続けます。

終盤で効く現実:個別案件では判断基準が変わる

同じログでも、判断は案件で変わります。たとえば、バックアップが直近で確認できていて復元手順も確立しているなら、切り分けの自由度は上がります。逆に、バックアップが不確実でデータ価値が高いなら、再現試験よりも保全を優先する判断が合理的になります。さらに、保守契約や冗長構成の有無によって、交換やフェイルオーバーの選択肢が変わります。

相談が必要になる境界:一般論で決めると事故るところ

ここまでの枠組みで多くのケースは整理できますが、現場には「一般論で決めると危ない境界」があります。たとえば次のような状況です。

- 症状が断続的で、再現条件が複数要因(負荷×温度×経路)にまたがる

- 仮想化やSAN、RAID、暗号化などで、物理と論理の対応が複雑

- 業務影響が大きく、止められないまま原因究明と保全を両立する必要がある

- 法務・監査・BCPの観点で、証跡性(ログの保持と説明責任)が求められる

この領域では、「正しそうな一般論」を当てはめるだけだと、判断ミスのリスクが上がります。観測設計、構成理解、保全手順、説明資料まで含めて、個別案件として設計する必要があります。

次回への伏線:最終章で“自然な次の一歩”へつなぐ

次の章で、本記事を締めくくります。締めくくりでは、一般論の限界を認めた上で、読者が「じゃあ自分の案件ではどう設計し直す?」に進めるよう、相談の観点(準備すると話が速い情報、見落としやすい論点、契約・構成の整理)を提示します。そこで、株式会社情報工学研究所への相談・依頼を“押し売りではなく合理的な選択肢”として検討できる形にします。

第12章:締めくくり──「消えるログ」に振り回されないために、現場の意思決定を“整流”する

本記事で一貫して伝えたかったのは、「dmesgを上手に読む」より前に、ログが消える前提で意思決定できる状態を作ることです。ring bufferは有限で、障害時ほど押し流されます。rate limitで間引かれ、ドライバの言い回しで同じ事象が別名に見えます。だから、dmesgだけで勝負すると、どうしても「見えなかったもの」に引っ張られます。

一方で、層(リンク/デバイス/ブロック/FS/アプリ)を意識して、同時刻にカーネルログ・I/O統計・健全性情報を束ねれば、たとえ一部のログが欠けても「壊れる順」で因果が作れます。因果が作れれば、現場の説明が通りやすくなり、無駄な疑心暗鬼や“勘のぶつかり合い”が減ります。ここが、実務での被害最小化につながります。

一般論の限界:最後は「案件の条件」で結論が変わる

ただし、最後の一手(交換か、保全か、構成変更か、運用強化か)は、一般論で決め切れません。バックアップの確実性、停止許容時間、冗長構成、保守契約、データ価値、法務・監査・BCP上の制約で、合理的な判断は変わります。

たとえば、同じ「timeout」でも、業務停止が許されない環境では“場を整える”ために段階的な退避・フェイルオーバー・ログ相関の強化を先に打つことがあります。逆に、媒体劣化が強く疑われ、データが最重要なら、再現より保全を優先するのが合理的です。ここは、現場の事情を織り込んだ設計問題であり、単純なテンプレ回答が危険になる領域です。

次の一歩:相談が速く進む「準備チェックリスト」

もし「自分の案件では、どこから手を付けるべきか」で悩んだら、次の情報を揃えるだけで、相談や切り分けが一気に前に進みます(すべてを完璧に揃える必要はありません)。

- 発生時刻の窓:影響が出た時刻(±10〜30分程度の範囲)

- 構成情報:物理(筐体/HBA/ケーブル/スロット)と論理(RAID/SAN/VM/暗号化/FS)の対応関係

- 観測の3点セット:同時刻のカーネルログ(可能ならjournalctl -k相当)、I/O統計の傾向、デバイス健全性(SMART/NVMeログの要点)

- 影響範囲:単一ディスクか、複数ディスク/複数ホストに波及しているか

- 運用条件:バックアップ状況、復元手順の有無、RPO/RTO、停止の可否

- 変更履歴:直近のファーム更新、ケーブル交換、負荷増、カーネル/ドライバ更新、筐体移設など

この情報がそろうと、「ログが消えている」こと自体を前提に、因果を組み直して、現場にとって現実的な選択肢(交換・保全・構成変更・運用強化)を並べられます。

相談・依頼を検討するタイミング:判断が“揺れ続ける”とき

次のような状態に入っているなら、個別案件として整理する価値が高いです。

- 症状が断続的で、再現条件が複合(負荷×温度×経路)になっている

- 仮想化/SAN/RAID/暗号化などで、物理と論理の対応が複雑

- 止められない前提で、保全と原因究明を同時に進める必要がある

- 監査・BCP・説明責任の観点で、証跡性(保持と説明)が求められる

この領域では、一般論を当てはめるだけだと事故リスクが上がります。観測設計・構成理解・保全計画・説明資料まで含めて組み立てる必要があります。そういう局面では、株式会社情報工学研究所のような専門家に相談して、状況に合った“歯止め”の打ち方を一緒に設計するのが現実的です。

付録:現在のプログラム言語各種にそれぞれの注意点(I/O障害・ログ欠落に強い実装のコツ)

カーネルやハードの問題はアプリだけでは直せません。ただし、アプリ側の作り次第で「被害最小化」や「原因追跡のしやすさ」は大きく変わります。ここでは、言語別に“やりがちな落とし穴”を事実ベースで整理します。

| 言語/実行環境 | 注意点(障害時に差が出るところ) |

|---|---|

| C / C++ |

|

| Rust |

|

| Go |

|

| Java(JVM) |

|

| Python |

|

| Node.js(JavaScript/TypeScript) |

|

| PHP |

|

| Ruby |

|

| .NET(C#) |

|

どの言語でも共通して重要なのは、(1)I/O失敗を握りつぶさない、(2)「どの対象で何が起きたか」をログに残す、(3)再試行は無制限に増やさず“整列”させる、(4)カーネル/ハード起因の兆候が出たらアプリ側の対処に過信しない、の4点です。これができていると、dmesgが押し流されても、後から相関して説明できる確率が上がります。

最後に:読者の悩みが「構成・契約・運用」の領域に入ったら

ここまで読んで、「自分の案件は一般論では決められない」と感じたなら、その感覚は正しいです。構成が複雑だったり、止められなかったり、証跡性が必要だったりするほど、判断は“設計”になります。そういうときは、株式会社情報工学研究所への相談・依頼を検討し、観測設計から保全、説明資料まで含めて、現場が納得できる形で“歯止め”を打つことをおすすめします。

解決できること・想定課題

- dmesgログの解析手法を身につけ、ハード障害の初期兆候を見逃さず早期対応できる

- 初動対応フローを構築し、サーバーダウン時の手順を明文化・共有できる

- 経営層への報告ポイントを整理し、社内コンセンサスを円滑に得られる資料を作成できる

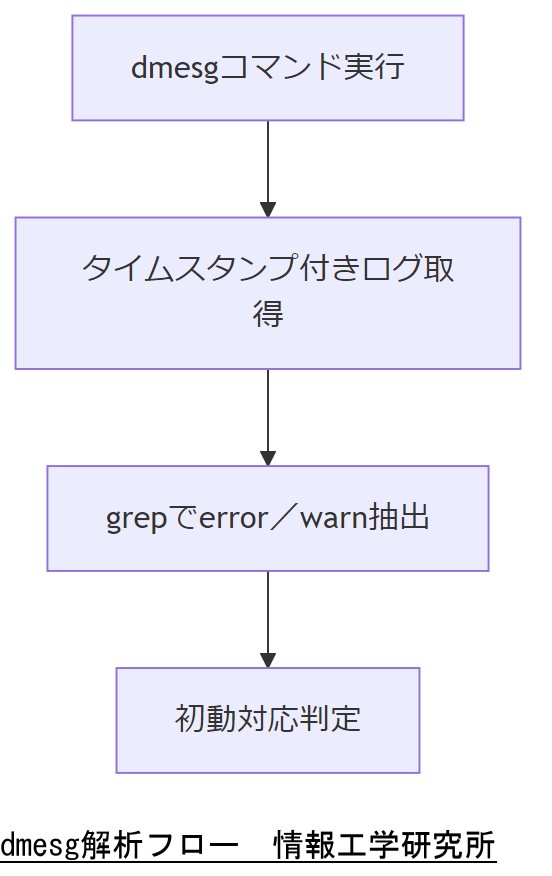

dmesg解析の基礎知識

dmesg(ディーメッセージ)コマンドは、Linuxカーネルが起動時や動作中に記録したログを表示するツールです。ここでは、dmesgログの取得方法と、ログに含まれる主要要素の読み方を解説します。

dmesgコマンドの実行

基本的にはターミナルで「dmesg」と入力すると、カーネルバッファに蓄積されたメッセージが全て表示されます。システム再起動後でもログが一時保管されるため、過去の障害情報を辿ることが可能です。

タイムスタンプの見方

dmesgログに付与されるタイムスタンプは、システム起動からの経過時間(秒)を示します。これを人間が解釈しやすい日付・時刻に変換するには、以下のコマンドを併用します。

- dmesg -T:起動からの経過秒を現地時刻に変換して表示

ログレベルの理解

dmesgには緊急度を示すレベル(emerg, alert, crit, err, warn, notice, info, debug)が含まれます。err(エラー)やwarn(警告)はハード障害の兆候として優先的に確認が必要です。

以上の基礎知識を押さえれば、dmesgログの取得から初歩的な解釈が可能になります。次章以降で、具体的なハード障害パターンの抽出方法を学びます。

技術担当者が上司や同僚にdmesgコマンドで取得した基本ログの読み方を説明する際は、タイムスタンプが起動後の経過時間である点や、err/warnの優先度を強調してください。

dmesgの基礎を理解するには、実際にシステムでコマンドを実行し、手を動かしてタイムスタンプ変換やログレベル確認を繰り返すことが重要です。

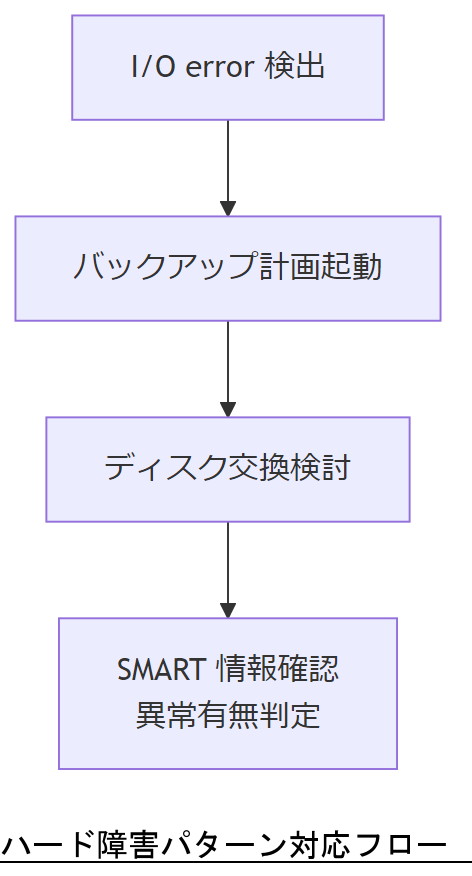

ハード障害を示す代表的ログパターン

dmesgログには、多くのメッセージが流れますが、ハード障害の兆候として特に注目すべきパターンがあります。ここでは代表的なものを解説します。

I/O error の意味解説

I/O error は、ディスクやコントローラーとの入出力処理で重大な障害が発生したことを示します。たとえば、以下のように出力されます。

- [123.456789] sd 0:0:0:0: [sda] I/O error, dev sda, sector 123456

この場合、指定のセクタへのアクセスが失敗しているため、物理的なディスク故障やケーブル不良が考えられます。早急なバックアップ取得とディスク交換を検討してください。

medium error の対処

medium error は、読み書きデバイスの「媒体」(medium)でエラーが発生したことを示します。I/O error と類似しますが、より低レベルの物理層の問題を指します。

例:[234.567890] ata1.00: medium error

この場合、ディスクのセクタやプラッタ面の損傷が疑われます。SMART情報で該当デバイスの状態を確認し、必要なら即時取り替えを推奨します。

| パターン | 示唆する障害 |

|---|---|

| I/O error | 物理的ディスク故障/ケーブル不良 |

| medium error | プラッタ損傷など媒体層の障害 |

I/O error や medium error のログ例を示し、物理層の障害である点を強調してください。復旧手順と交換タイミングを具体的に共有しましょう。

これらのエラーは物理故障の可能性が高いため、ログ検出後は速やかにSMART情報を取得し、リスク評価を行う習慣を身につけましょう。

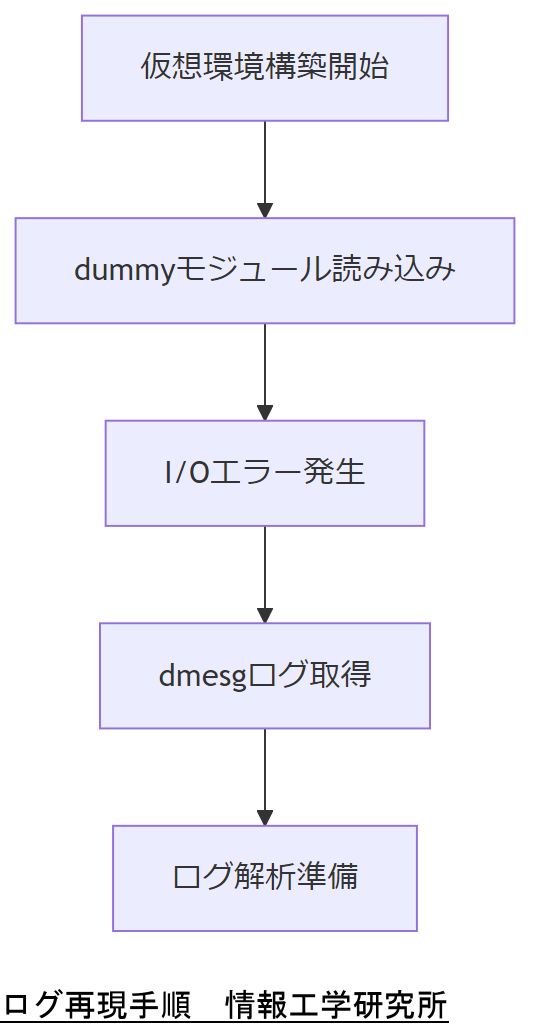

ログ再現手順のサンプルスクリプト

本章では、仮想マシン環境上で疑似的にハード障害を発生させ、dmesgログを取得する手順とサンプルスクリプトを紹介します。これにより、実運用に近い環境で障害解析のテストが可能です。

仮想環境での障害シナリオ構築

まず、VM上にCentOSやUbuntuなどのLinuxをインストールし、root権限で以下のシナリオを準備します。目的はディスクI/Oエラーを発生させることで、故障モジュールの読み込みや特定デバイスへの強制アクセスを行います。

副副題解説:仮想環境では物理ディスクの代わりに仮想ディスクを操作するため、実機とは異なる点に注意が必要です。適切なスナップショット取得や設定バックアップを必ず実施してください。

サンプルシェルスクリプト解説

以下のシェルスクリプトは、dummyモジュールを用いて強制的にI/Oエラーを発生させ、dmesg出力をファイルに保存します。実行前にスクリプト権限とモジュール読み込み環境を確認してください。

#!/bin/bash modprobe dummy echo 1 > /sys/module/dummy/parameters/enable_error dmesg -wH &> /root/dmesg_reproduce.log & sleep 10 rmmod dummy

副副題解説:dummyモジュールはエラー生成専用のテスト用ドライバです。本番環境では絶対に使用せず、テスト専用環境でのみ実行してください。

テスト環境でのみdummyモジュールを用いたエラー再現を行うこと、実稼働環境では適用しない点を明確に共有してください。

再現手順を自動化する際は、スクリプト実行前後の環境状態を必ず記録し、誤操作による設定変更を防止する運用手順を策定しましょう。

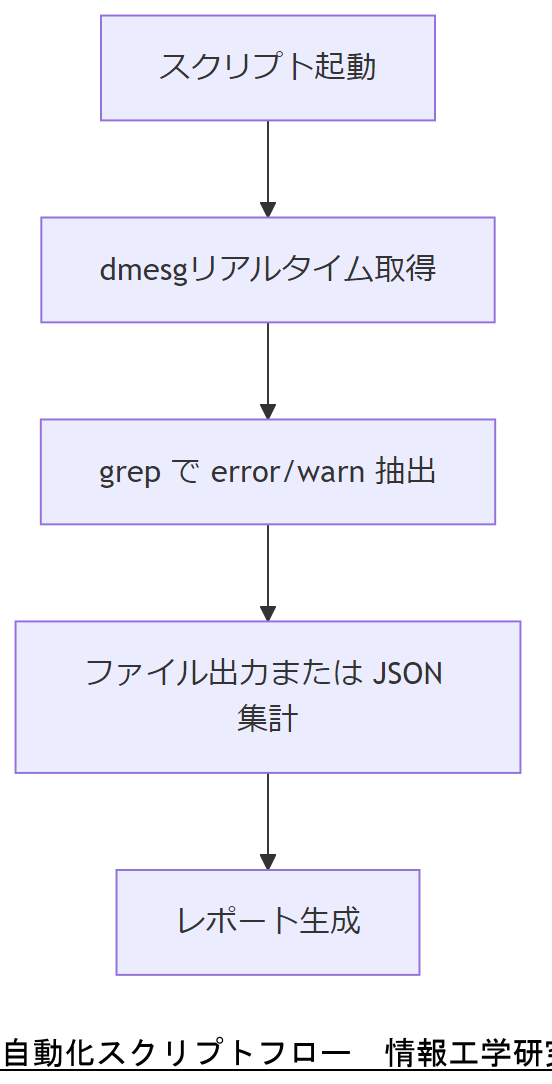

解析自動化のためのシェル/Python例

大量のdmesgログから特定のエラーを効率よく抽出し、障害対応レポート作成までを自動化することで、解析工数を大幅に削減できます。本章では、シェルスクリプトとPythonスクリプトの両面からサンプル例を示します。

シェルスクリプトによる自動抽出

以下のシェルスクリプトは、dmesgログをリアルタイムに監視し、error/warnレベルのメッセージを別ファイルにまとめます。定期実行(cron)との組み合わせで運用可能です。

#!/bin/bash LOGFILE=/var/log/dmesg.log OUTFILE=/var/log/dmesg_errors.log dmesg -wH >> ${LOGFILE} & tail -n0 -F ${LOGFILE} | grep --line-buffered -E "error|warn" >> ${OUTFILE} 副副題解説:–line-buffered オプションでリアルタイム性を確保します。ログファイルのローテーション設定も忘れずに行ってください。

Pythonスクリプトによる構造化解析

Pythonを用いると、ログをJSON形式でパースし、件数集計や統計処理が容易になります。以下は、ログレベルごとの件数を集計する例です。

import subprocess, json, re result = subprocess.run(["dmesg", "-T"], capture_output=True, text=True) entries = result.stdout.splitlines() stats = {"err":0, "warn":0} for line in entries: if re.search(r"\berr\b", line, re.I): stats["err"] += 1 if re.search(r"\bwarn\b", line, re.I): stats["warn"] += 1 print(json.dumps(stats, ensure_ascii=False, indent=2)) 副副題解説:dmesg -T のパースにはタイムスタンプの妥当性を確認し、必要に応じてdatetimeモジュールで整形処理を追加してください。

シェルおよびPythonスクリプトの自動実行設定とログローテーション運用を合わせて導入し、定例ミーティングで自動集計結果を参照する仕組みを共有してください。

自動化スクリプトはメンテナンス性が鍵です。スクリプトのバージョン管理やテスト環境での動作確認をルール化し、誤検出やログ漏れを防ぎましょう。

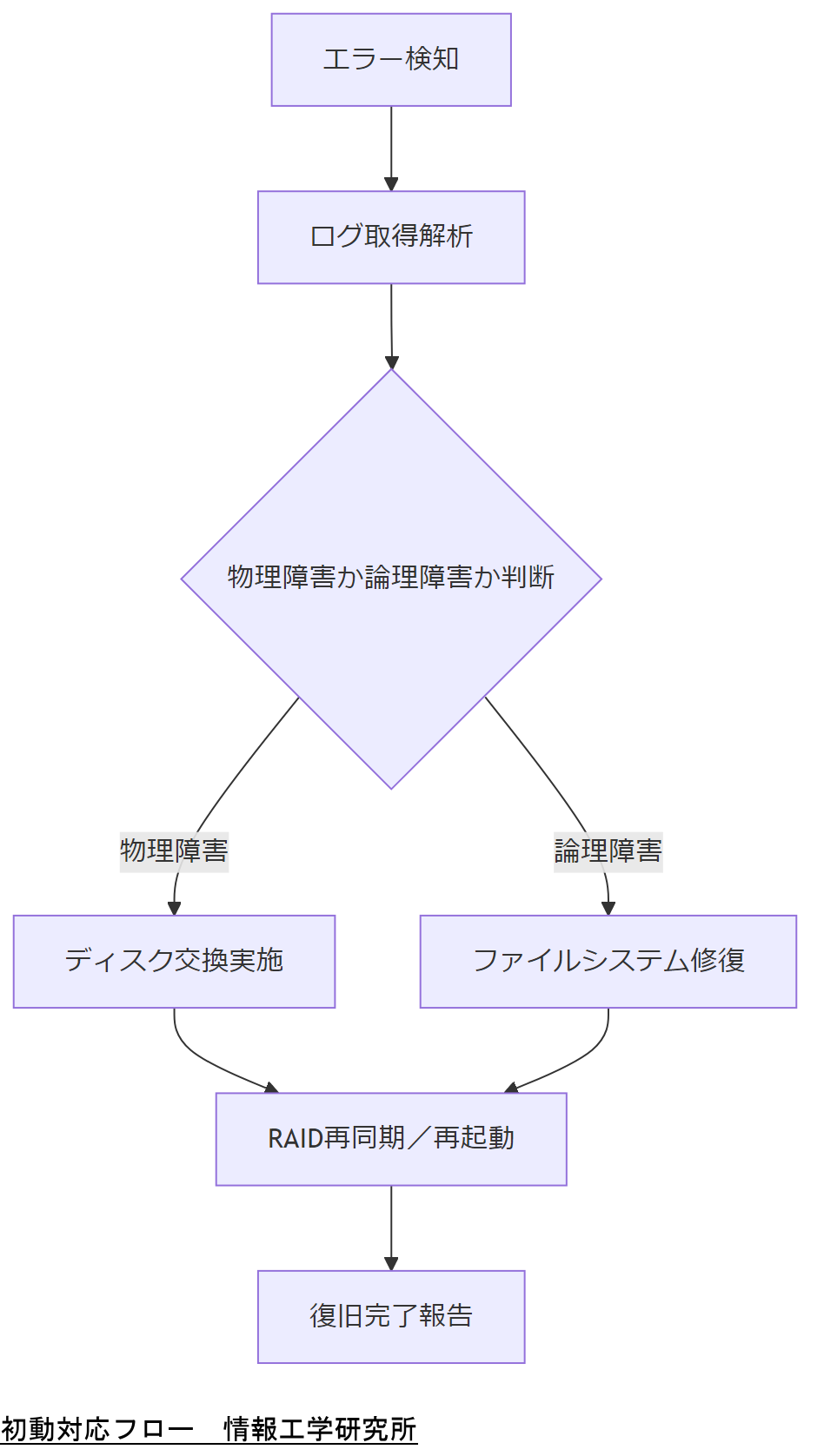

初動対応ガイドライン

システム障害発生時は、迅速かつ的確な初動対応がサービス継続の鍵となります。本章では、エラー検知後の切り分けフローと緊急対応手順を示します。

障害切り分けフロー

エラーが検知されたら、以下の手順で物理障害か論理障害かを速やかに判断します。手順ごとに担当者を割り当て、社内連絡網を起動してください。

- ログ取得:dmesg -T を実行し、最新のerror/warnを確認

- 障害判定:I/O error や medium error の有無をチェック

- 物理・論理判断:ハード故障ならハード交換、論理障害ならファイルシステム修復

- 一次対応:該当チームへエスカレーションし、交換・修復作業を開始

| ステップ | 対応内容 |

|---|---|

| ログ確認 | dmesg -T で最新ログを取得 |

| エラー判定 | error/warn レベルを抽出・判断 |

| 障害分類 | 物理障害 vs 論理障害の分類 |

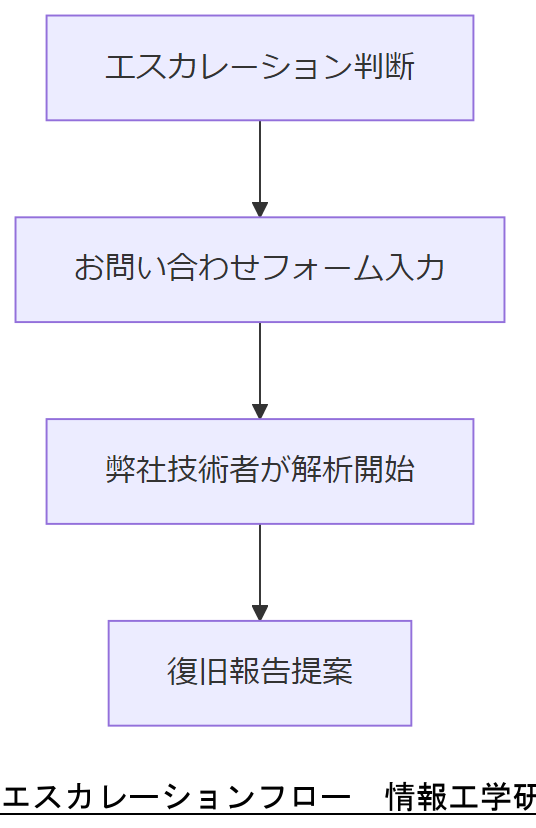

| エスカレーション | 情報工学研究所へお問い合わせフォームで連絡 |

緊急対応手順

物理障害の場合は速やかに該当ディスクを交換し、RAID再同期やサービス再起動を実施します。論理障害の場合は、fsckなどのファイルシステム修復ツールを用い、事前に取得したバックアップからの復元も併用してください。

初動対応では「ログ取得→障害分類→物理/論理対応→再起動」の一連手順を図示し、社内手順書に反映してください。

緊急対応時は手順の順守が重要です。リハーサルを定期実施し、誤操作を防ぐためのチェック体制を整えましょう。

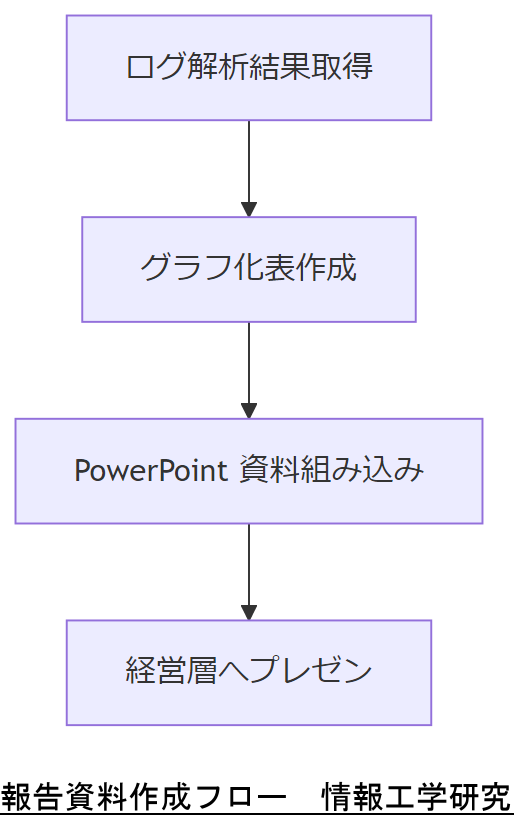

経営層向け報告資料作成術

障害解析結果を経営層に報告する際は、要点を簡潔にまとめ、結論→事実→詳細の順で構成することが重要です。本節では、資料作成のポイントと図表活用の手法を解説します。

重要ポイントの整理

- 結論の明示:「ハード障害発生」「サービス影響範囲」「復旧見通し」を最初に提示

- 事実データの提示:dmesgログのエラー件数、発生タイミングなどをグラフ化

- 対応状況とリスク:実施済み対応、残留リスク、次のフォローアップ予定を表形式で整理

| セクション | 内容 |

|---|---|

| Executive Summary | 結論と推奨アクション |

| 事実データ | ログ解析結果のグラフ・表 |

| 対応状況 | 実施済み手順と進捗 |

| リスク評価 | 残留リスクと提案策 |

結論→事実→詳細の順で資料を構成し、ログ件数や影響範囲を簡易グラフで示すことで、短時間での理解を促進してください。

報告資料は経営層の意思決定を支援するツールです。データの正確性を担保しつつ、視覚的に分かりやすい図表を用意しましょう。

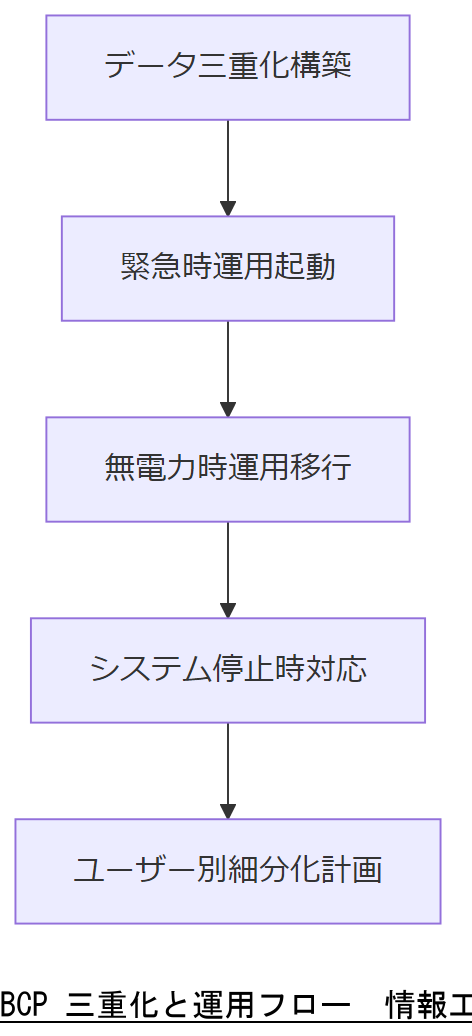

BCPへの組み込み

災害時や障害発生時にも事業継続を確保するには、データ保存の三重化と、運用の3段階対応が必須です。本節では基本要件と、ユーザー数10万人以上の場合の細分化ポイントを解説します。

データ保存の三重化

BCPでは、同一データをオフサイト含む3拠点に保管します。拠点間は地理的に分散し、災害リスクを低減します。暗号化転送と定期的な整合性チェックも欠かせません。

運用の3段階対応

- 緊急時運用:障害直後の初動体制。最小限のサービス維持を目標。

- 無電力時運用:非常用発電/UPS稼働下での限定運用。優先サービスのみ継続。

- システム停止時運用:本格復旧作業段階。代替システム切り替えやリストア作業を実施。

副副題解説:各段階での責任者と連絡経路を明確化し、訓練計画に組み込むことで有事に備えます。

10万人以上ユーザーの場合の細分化

利用者10万人を超える場合は、業務影響度に応じてサービスレベル別に計画を分割します。金融系、認証系、データベース系など、依存関係に基づく優先順位付けが重要です。

BCP要件まとめ| 要件 | 内容 |

|---|---|

| データ三重化 | 地理的に分散した3拠点に保存 |

| 運用段階 | 緊急時/無電力時/停止時の3段階 |

| ユーザー細分化 | サービス依存度で計画分割 |

データ三重化と運用3段階の体制を社内手順書に示し、緊急時・無電力時・停止時での役割分担を明文化してください。

BCP計画は実践と訓練を通じて磨かれます。定期的な演習で各段階の移行判断ポイントを確認し、改善を継続しましょう。

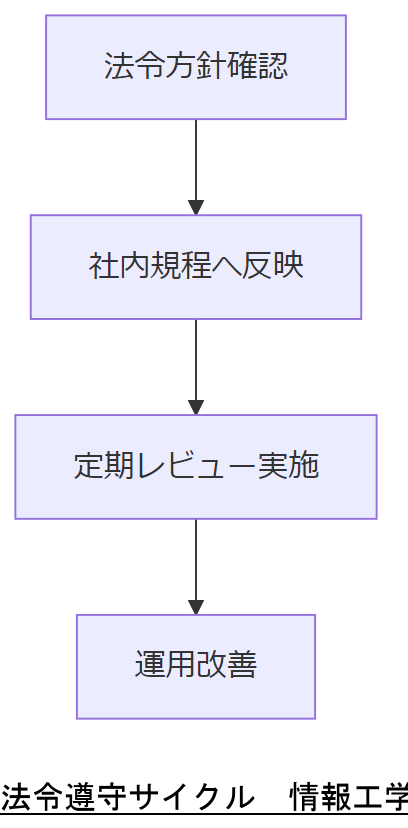

法律・政府方針

事業継続や障害対応に関わる活動は、各国の法令や政府方針によって大きく影響を受けます。本章では、日本、アメリカ、EUそれぞれの主要な法令・政府方針を概観し、遵守のポイントを解説します。

日本の法令・政府方針

日本では、情報セキュリティ基本法に基づき、各企業がセキュリティ対策を実施することが義務づけられています。また、個人情報保護法では、障害による個人情報漏洩時の報告義務が明確化されています。BCP計画や障害対応手順書には、これらの遵守要件を必ず反映してください。

アメリカの法令・政府方針

アメリカでは、NIST(National Institute of Standards and Technology)が策定するサイバーセキュリティフレームワーク(CSF)が事実上の標準となっています。重要インフラ事業者や政府機関は、このフレームワークに従ったリスク管理を行う必要があります。

EUの法令・政府方針

EU域内では、NIS指令(Network and Information Security Directive:EU Directive 2016/1148)により、加盟国の事業者がサイバーセキュリティ対策を義務化されています。さらにGDPRでは、障害発生時に個人データ漏洩の際の通知要件が厳格に定められています。

主な法令一覧| 地域 | 法令・方針名 |

|---|---|

| 日本 | 情報セキュリティ基本法、個人情報保護法 |

| アメリカ | NIST CSF(Framework for Improving Critical Infrastructure Cybersecurity) |

| EU | NIS指令(EU Directive 2016/1148)、GDPR |

遵守すべき法令を一覧化し、社内手順書に明記してください。特に個人情報保護法やNIS指令の要件は必ず確認を徹底しましょう。

法令は改正される可能性があります。定期的な官報・政府サイトのチェックをルール化し、最新要件を計画に反映しましょう。

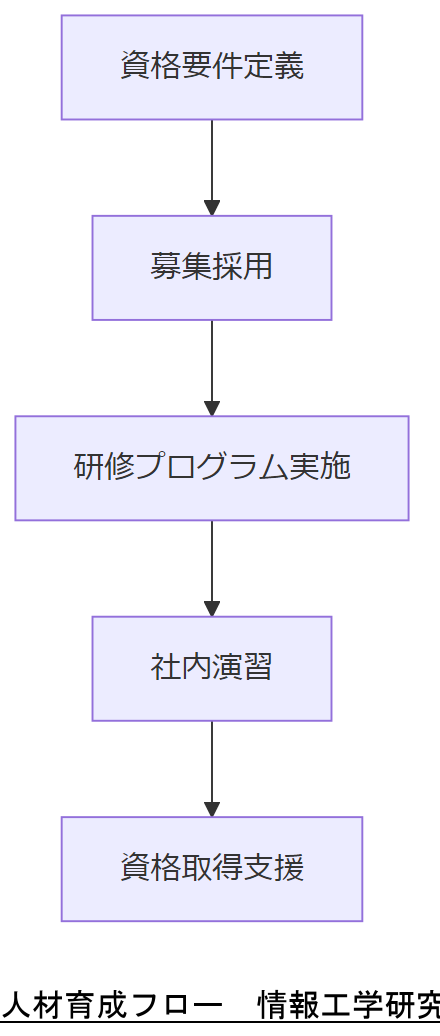

該当資格と人材育成・募集

dmesg解析や障害対応を遂行する上で、適切な資格と教育体制の整備が不可欠です。本章では、推奨資格と育成・採用戦略を解説します。

推奨資格一覧

- LPIC(Linux Professional Institute Certification):Linux管理全般の理解度を証明

- RHCE(Red Hat Certified Engineer):Red Hat環境での高度な運用スキルを認定

- 情報処理安全確保支援士:セキュリティ対策に関する国家資格

| 資格 | 主なスキル領域 |

|---|---|

| LPIC | Linuxシステム管理全般、ログ解析 |

| RHCE | Red Hat系OS運用、トラブルシューティング |

| 情報処理安全確保支援士 | 情報セキュリティ計画立案、リスク評価 |

人材育成・採用戦略

資格取得支援や定期研修の実施に加え、社内ハンズオン演習を導入します。募集時には「dmesg解析実務経験」や「障害対応フロー構築経験」を要件として掲げ、即戦力を確保しましょう。

資格要件と育成プログラムを明示し、部門間で共通認識を持つよう調整してください。

継続的なスキルアップはチーム力強化の鍵です。研修成果を定量評価し、フィードバックサイクルを確立しましょう。

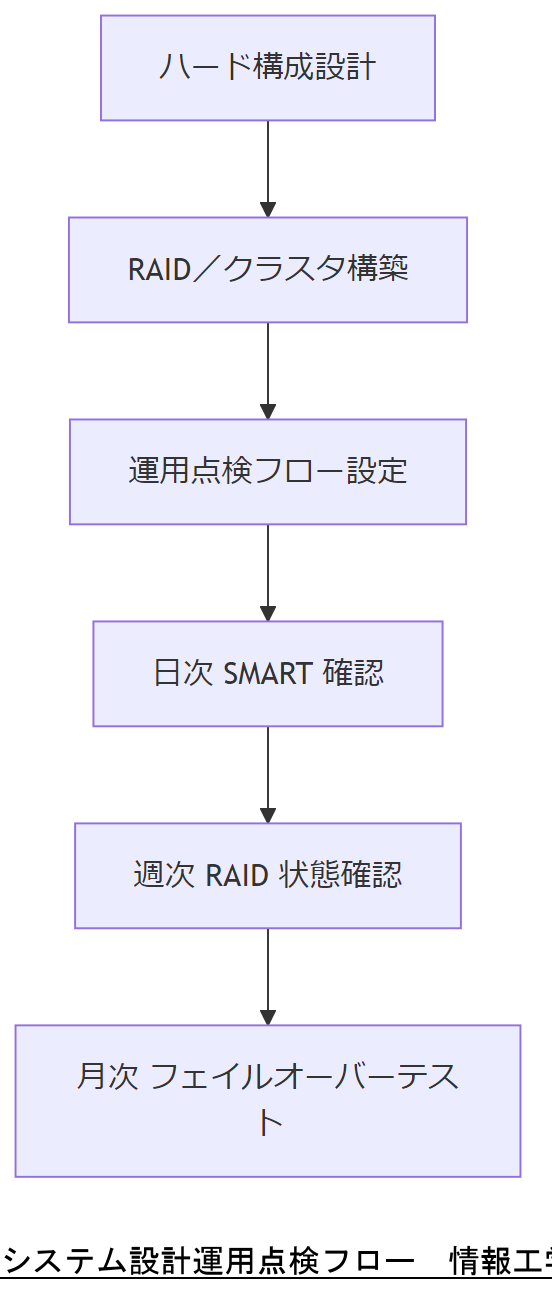

システム設計・運用・点検

安定的な障害対応には、冗長化を含むシステム設計と、定期的な点検・運用フローの確立が欠かせません。本章では、具体的な設計パターンと運用チェックのポイントを紹介します。

冗長化構成例

ディスク障害時に単一故障点を排除するため、RAID構成やクラスタリングを適用します。代表的な例として、以下の2種類を組み合わせると効果的です。

- RAID6:二重パリティにより2ディスク故障まで耐えられる

- アクティブ–アクティブクラスタ:サービスノードを二重化し、フェイルオーバーで継続稼働

| 構成 | 利点 | 留意点 |

|---|---|---|

| RAID6 | 高いディスク冗長性 | 書き込み性能低下の可能性 |

| アクティブ–アクティブクラスタ | ノンストップ稼働 | 構成・監視の複雑化 |

運用手順とログ監視

設計通りに運用を継続するには、定期点検リストとログ監視体制が必要です。具体的には、週次でのハードウェア状態チェックと、リアルタイムログ監視を組み合わせます。

運用・点検チェックリスト| 頻度 | 項目 | 詳細 |

|---|---|---|

| 日次 | SMART状態確認 | ディスクヘルス指標の取得 |

| 週次 | RAID同期状態 | 同期残時間とエラー数の確認 |

| 月次 | サービス稼働テスト | フェイルオーバー動作検証 |

冗長化構成と定期点検リストを可視化し、運用チーム全体で共有してください。特に月次テストの責任者と手順を明文化しましょう。

設計通りの運用を維持するには、点検結果のレビューと改善サイクルを必ず設けることが重要です。

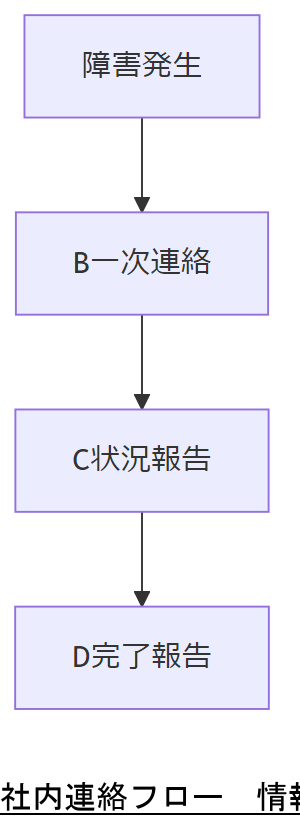

関係者への注意点と社内共有

障害対応では、多様なステークホルダーが関与します。本章では、関係者別の注意点と社内共有のポイントを解説します。

関係者マッピング

主な関係者は以下の通りです。各ステークホルダーへの情報伝達方法を定め、タイムリーな共有を徹底してください。

- 経営層:影響範囲と復旧見通しを簡潔に報告

- IT運用部門:技術詳細と実施手順を具体的に共有

- ビジネス部門:サービス停止の影響と代替手段を周知

- 法務・コンプライアンス部:報告義務と対応記録の確認

社内連絡フロー

社内共有の際は、一次連絡→状況報告→復旧完了報告の3段階で情報を更新します。担当者と時刻を明示した連絡テンプレートを用意し、迅速な対応を促進してください。

社内共有フローチャート| フェーズ | 内容 |

|---|---|

| 一次連絡 | 障害発生報告(経営層・IT運用部門) |

| 状況報告 | 解析結果/進捗(全関係者) |

| 完了報告 | 復旧完了と再発防止策(全関係者) |

「一次連絡→状況報告→完了報告」の社内フロー図を展開し、各フェーズの担当者と内容を明示しましょう。

共有フローは定期演習で浸透させることが重要です。訓練後に振り返りを行い、フローの改善点を抽出してください。

外部専門家へのエスカレーション基準

内部対応で解決困難な場合、情報工学研究所へのエスカレーションを行います。本節では、判断基準とお問い合わせ手順を示します。

エスカレーション判断基準

- ハード交換後もエラー継続:物理層で深刻な障害が疑われる場合

- データロストリスクが高い:自社での復旧困難と判断した場合

- 再発防止策の立案が必要:高度な解析ノウハウが求められる場合

お問い合わせフォーム利用方法

情報工学研究所への依頼は、お問い合わせフォームから行います。以下の項目を入力してください。

- 会社名/部署名

- 障害発生日時およびdmesgログ要約

- これまでの対応履歴

- 希望するサービス内容

エスカレーション判断基準を共有し、フォーム入力内容をテンプレート化しておくことで、スムーズな依頼手続きを確立してください。

フォーム送信後のフォローアップ体制を確認し、問い合わせから復旧完了までのスケジュール管理を実施しましょう。

はじめに

Linuxカーネルメッセージの重要性とハード障害の兆候 Linuxカーネルメッセージは、システムの動作状況やエラー情報を提供する重要な情報源です。特に、ハードウェアの障害が発生した場合、これらのメッセージは問題の診断や解決に不可欠な手がかりを提供します。多くの管理者が直面する課題は、これらのメッセージを適切に解釈し、迅速に対応することです。ハード障害の兆候は、しばしば微妙であり、初期の段階で見逃されがちです。しかし、dmesgコマンドを用いることで、システムのログを確認し、潜在的な問題を早期に発見することが可能になります。本記事では、Linuxカーネルメッセージの解析方法と、ハード障害の兆候を示す削除ログの再現について詳しく解説します。これにより、システムの健全性を維持し、業務の安定運用を支える手助けとなることを目指します。

dmesgコマンドの基本と使用方法

dmesgコマンドは、Linuxシステムのカーネルメッセージを表示するための非常に重要なツールです。このコマンドを使用することで、システムの起動時や動作中に発生したイベントやエラーメッセージを確認することができます。具体的には、ハードウェアの検出、ドライバの読み込み、エラーの発生など、システムの状態に関する詳細な情報を提供します。 dmesgコマンドの基本的な使用方法は非常にシンプルです。ターミナルを開き、「dmesg」と入力するだけで、最新のカーネルメッセージが表示されます。表示内容は、時系列で並んでおり、最新のメッセージが一番上に来ます。また、特定のメッセージをフィルタリングするためには、grepコマンドを組み合わせることが有効です。例えば、「dmesg | grep error」と入力することで、エラーメッセージのみを抽出できます。 さらに、dmesgコマンドにはオプションもあり、例えば「-T」オプションを使用すると、タイムスタンプを人間に読みやすい形式で表示できます。これにより、問題が発生した具体的な時間を把握することが容易になります。このように、dmesgコマンドはシステム管理者にとって不可欠なツールであり、ハード障害の兆候を早期に発見するために活用されるべきです。

ハード障害の診断に役立つログメッセージの解読

ハード障害の診断において、ログメッセージの解読は非常に重要です。dmesgコマンドで表示されるメッセージには、ハードウェアの状態やエラーに関する情報が豊富に含まれています。特に、ハードディスクやメモリに関連するメッセージは、故障の兆候を示すことが多く、これらを早期に把握することがシステムの安定性を保つ鍵となります。 例えば、「I/O error」や「bad block」といったメッセージは、ハードディスクの障害を示唆する重要なサインです。また、「memory allocation failure」や「out of memory」といったエラーは、メモリ関連の問題を示している可能性があります。これらのメッセージを見逃さないためには、定期的にdmesgの出力を確認し、異常が発生した際には即座に対応することが求められます。 さらに、ログメッセージには時系列情報が含まれているため、トラブルシューティングの際には、問題が発生した時間帯を特定し、システムの他のログ(例えば、syslogやアプリケーションログ)と照らし合わせることが有効です。このように、dmesgのメッセージを正しく解読することは、ハード障害の早期発見と適切な対処に繋がります。

削除されたログの再現手法とその意義

削除されたログの再現手法は、システム障害の診断において非常に重要なプロセスです。dmesgコマンドが提供するカーネルメッセージは、システムの状態を把握するための貴重な情報源ですが、時にはログが削除されてしまうこともあります。こうした場合に、どのようにして削除されたログを再現するかが、問題解決の鍵となります。 まず、削除されたログの再現には、ログファイルのバックアップを活用することが基本です。定期的にログのバックアップを取ることで、万が一の事態に備えることができます。また、ログローテーションを設定し、古いログを適切にアーカイブすることで、必要な情報を保持することが可能です。これにより、過去のログを参照し、ハード障害の兆候を追跡することができます。 さらに、システム監視ツールを導入することで、リアルタイムでのログ収集と分析が可能になります。これにより、削除されたログの内容を即座に把握し、問題の発生を未然に防ぐことができます。ログの監視は、障害発生後の迅速な対応にも寄与し、業務の継続性を維持するための重要な手段となります。 このように、削除されたログの再現手法は、システムの健全性を保つために不可欠であり、管理者はこれらの手法を積極的に活用することが求められます。

具体的な事例分析:障害発生時のログから学ぶ

具体的な事例分析を通じて、障害発生時のログから得られる知見を深めることは、システム管理者にとって非常に重要です。例えば、ある企業でハードディスクの障害が発生した際、dmesgコマンドを使用してログを確認した結果、特定のエラーメッセージが頻繁に出力されていることが判明しました。メッセージには「I/O error」や「bad sector」が含まれており、これらはハードディスクの物理的な損傷を示すものです。 このような状況では、まずは影響を受けているデータのバックアップを行い、その後、ハードディスクの健康状態を評価するためにSMART(Self-Monitoring, Analysis and Reporting Technology)情報を確認しました。SMART情報からは、再分配されたセクタやエラー率が高まっていることが明らかになり、ハードディスクの交換が必要であることが判断されました。 また、他の事例では、メモリ関連のエラーが発生した際に「memory allocation failure」というメッセージがログに記録されていました。この場合、メモリ不足が原因である可能性が高く、リソースの使用状況を分析することで、どのプロセスがメモリを大量に消費しているかを特定しました。これにより、不要なプロセスを停止させたり、システムのメモリを増設することが可能となり、安定した運用を回復することができました。 このように、具体的な事例を通じて得られる教訓は、今後の障害対応において非常に価値のあるものです。ログメッセージの適切な解読と迅速な対応が、システムの健全性を保つ鍵となります。

効果的なログ管理と障害予防策

効果的なログ管理と障害予防策は、システムの安定性を確保するために不可欠です。まず、定期的なログのバックアップを行うことが重要です。これにより、万が一のデータ損失や障害が発生した際にも、過去の情報にアクセスし、迅速に対応することが可能になります。また、ログローテーションの設定を行い、古いログを適切にアーカイブすることも推奨されます。これにより、必要な情報を効率的に管理できるだけでなく、ストレージの無駄を減らすことができます。 次に、システム監視ツールの導入が効果的です。これにより、リアルタイムでのログ収集と分析が可能になり、異常を早期に検知することができます。異常が発生した際には、即座にアラートを受け取ることで、迅速な対応が実現します。さらに、定期的なシステムの健康診断を行い、ハードウェアやソフトウェアの状態を把握することも重要です。これにより、潜在的な問題を事前に発見し、障害の発生を未然に防ぐことができます。 最後に、ログの分析を通じて得られた知見を基に、運用手順やポリシーを見直すことも効果的です。過去の障害事例を振り返り、改善策を講じることで、同様の問題の再発を防ぐことができます。このように、効果的なログ管理と障害予防策を講じることで、システムの健全性を維持し、業務の安定運用を支えることが可能となります。

ハード障害を未然に防ぐための知識と実践

ハード障害を未然に防ぐためには、Linuxカーネルメッセージの解析とログ管理の重要性を理解し、実践することが不可欠です。dmesgコマンドを活用することで、システムの状態やエラーを把握し、早期の問題発見につなげることができます。特に、ハードウェアに関連するエラーメッセージに注意を払い、定期的なログの確認を行うことで、潜在的な障害を未然に防ぐことが可能です。 また、削除されたログの再現手法やシステム監視ツールの導入は、障害発生時の迅速な対応を支えます。具体的な事例分析を通じて得られた知見は、今後の障害対応の改善に役立つ貴重な情報となります。効果的なログ管理や障害予防策を講じることで、システムの健全性を維持し、業務の安定運用を支えることができます。これらの知識と実践を通じて、安心してシステムを運用できる環境を整えましょう。

さらなる情報を得るためのリソースとコミュニティ参加の勧め

システムの健全性を維持し、ハード障害を未然に防ぐための知識を深めることは重要です。そこで、関連するリソースやコミュニティに参加することをお勧めします。オンラインフォーラムや専門的なブログでは、他のシステム管理者と情報を共有し、最新の技術やベストプラクティスについて学ぶことができます。また、定期的に開催されるウェビナーやセミナーに参加することで、専門家の知見を直接得ることができ、実践的なスキルを向上させる機会にもなります。 さらに、ドキュメントやガイドラインを活用することで、dmesgコマンドの詳細な使い方やログ管理の方法についての理解を深めることができます。これにより、日々の運用に役立つ知識を得ることができ、万が一の障害発生時にも迅速に対応できる力を身につけることができるでしょう。 ぜひ、これらのリソースを活用して、システム管理のスキルを高め、より安全で安定した運用環境を構築していきましょう。

dmesg解析時の注意事項とトラブルシューティングのポイント

dmesgを解析する際には、いくつかの注意点があります。まず、dmesgの出力はシステムの起動時からのメッセージが含まれており、膨大な情報量になることがあります。そのため、特定のエラーや警告を迅速に見つけるためには、grepコマンドを使用してフィルタリングすることが効果的です。例えば、特定のハードウェアに関連するメッセージを検索することで、必要な情報を迅速に抽出できます。 次に、dmesgの情報はリアルタイムで更新されるため、システムが稼働している間にエラーメッセージが追加されることがあります。これにより、過去のメッセージが消えてしまうこともあるため、定期的にログを保存しておくことが推奨されます。ログのバックアップを行うことで、後から問題を追跡する際の手助けになります。 さらに、dmesgのメッセージは必ずしも正確な原因を示すわけではありません。特定のエラーが発生しても、必ずしもそのメッセージが直接的な原因とは限らないため、他のログファイルと照らし合わせて総合的に判断することが重要です。syslogやアプリケーションログなど、他の情報源を活用することで、より正確なトラブルシューティングが可能になります。 最後に、dmesgの解析は専門的な知識を要する場合がありますが、基本的な理解を持っていることで、早期の問題発見と適切な対応が可能になります。これらのポイントを押さえて、効果的なログ解析を行いましょう。

補足情報

※株式会社情報工学研究所は(以下、当社)は、細心の注意を払って当社ウェブサイトに情報を掲載しておりますが、この情報の正確性および完全性を保証するものではありません。当社は予告なしに、当社ウェブサイトに掲載されている情報を変更することがあります。当社およびその関連会社は、お客さまが当社ウェブサイトに含まれる情報もしくは内容をご利用されたことで直接・間接的に生じた損失に関し一切責任を負うものではありません。